PINN은 왜 시간 문제에서 자꾸 무너질까 — causal training으로 다시 읽는 학습 실패의 구조

시간 의존 PDE에서 PINN은 왜 자주 실패할까? 2022년 causal training 논문을 중심으로, 시간축 causality를 무시한 훈련이 만드는 병목과 그 처방, 그리고 2026년 현재 이 기술의 실제 자리를 쉽고 깊게 풀어본다.

시간 의존 PDE에서 PINN은 왜 자주 실패할까? 2022년 causal training 논문을 중심으로, 시간축 causality를 무시한 훈련이 만드는 병목과 그 처방, 그리고 2026년 현재 이 기술의 실제 자리를 쉽고 깊게 풀어본다.

시간 의존 PDE를 PINN으로 풀다 보면 이상한 장면을 자주 본다. 부근의 초기 상태는 아직 어긋나 있는데, 시각화된 해의 후반부는 얼핏 그럴듯해 보인다. 더 정확히 말하면, 네트워크는 앞선 시간을 아직 설명하지 못하는데도 뒤 시간을 향한 잔차를 먼저 줄여 버리는 방향으로 움직일 수 있다.

이 현상은 단순한 "최적화가 조금 불안정하다" 정도의 문제가 아니다. Wang, Sankaran, Perdikaris의 2022년 논문 Respecting causality is all you need for training physics-informed neural networks가 날카롭게 지적한 핵심은 이것이다. 표준 continuous-time PINN은 물리 시스템의 시간적 선후관계를 손실함수 안에서 충분히 존중하지 않는다. 물리 세계는 원인이 먼저이고 결과가 나중이지만, 손실함수는 종종 시공간 전체를 평평한 합으로 본다.

이 글은 그 논문을 요약하는 글이 아니다. 더 중요한 질문은 이것이다.

시간 문제에서 PINN이 실패하는 진짜 병목은 무엇인가?

그리고 causal training은 그 병목을 어떻게, 어디까지 해결하는가?

이미 PINN의 기본 개념은 알고 있고, PDE와 수치해석의 직관도 어느 정도 있는 독자를 상정하겠다. 그래서 이 글은 "PINN이 무엇인가"보다 "왜 시간축에서 무너지는가", "causal weighting이 실제로 무슨 제약을 거는가", "2026년 지금 이 아이디어가 어디까지 살아남았는가" 에 초점을 맞춘다.

PINN의 역사는 곧 "신경망이 PDE를 대신 풀 수 있을까?"라는 오래된 낙관과, 그 낙관이 현실 앞에서 부딪힌 실패의 역사이기도 하다.

이 흐름을 한 문장으로 요약하면 이렇다.

Lagaris는 아이디어를 열었고, Raissi는 프레임을 만들었고, 2021년의 실패 모드 연구들은 그 프레임이 모든 문제에 통하지 않음을 드러냈으며, Wang et al. 2022는 그 실패를 시간축의 관점에서 재해석했다.

시간 의존 PDE를 푼다고 해 보자. 표준 continuous-time PINN은 대개 시공간 내부 collocation point 전체에서 residual을 계산하고, 그것을 한꺼번에 합산한다. 시간을 개의 window 또는 slice로 나눠 보면 직관은 더 분명해진다.

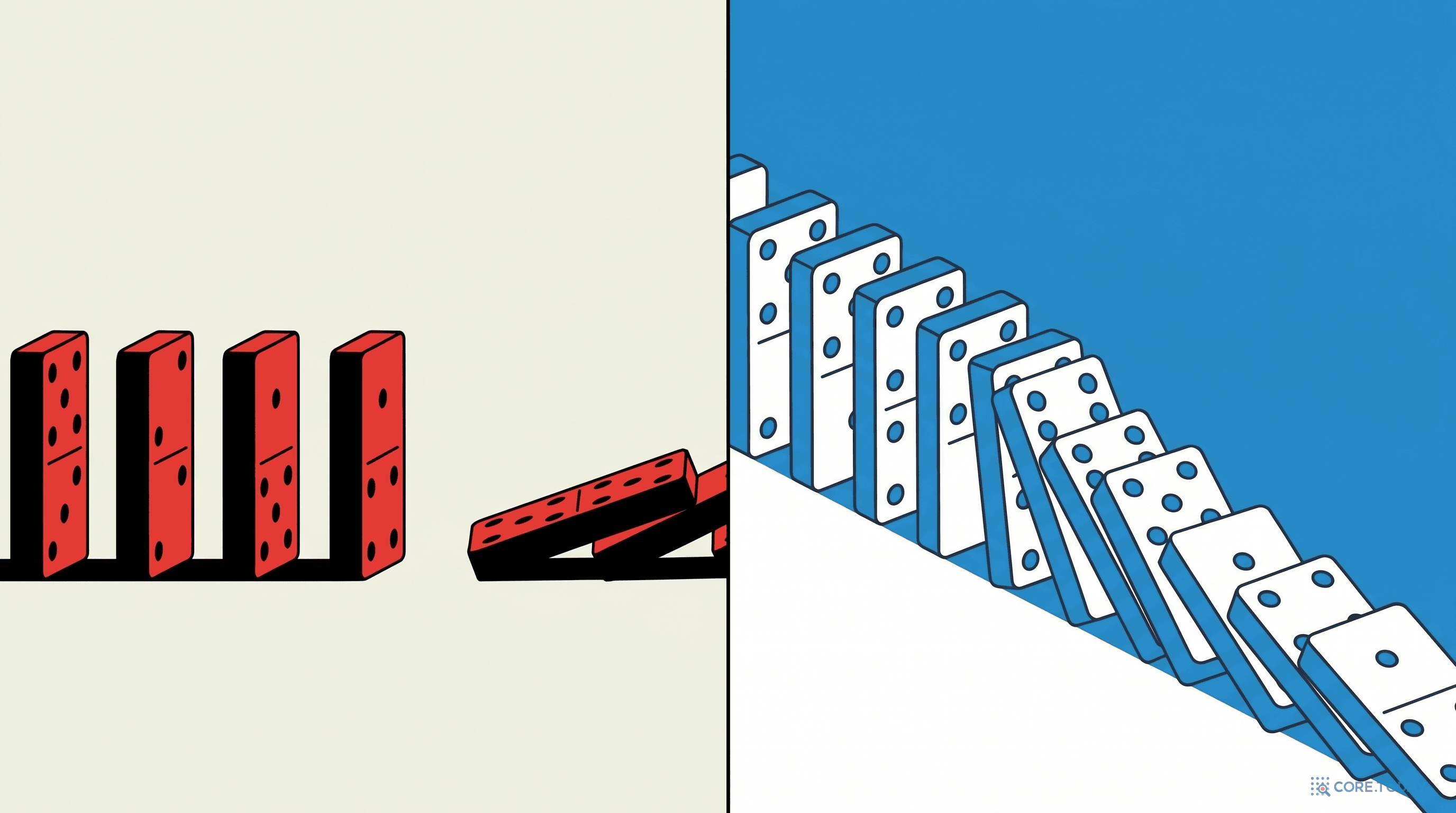

여기서 는 번째 시간 구간의 PDE residual loss다. 문제는 이 합이 수학적으로는 교환 가능하다는 점이다. optimizer 입장에서는 과 사이에 본질적 선후가 없다. 하지만 물리 시스템은 그렇지 않다.

이 차이는 단순한 철학이 아니라 수치해석의 기본 직관과 맞닿아 있다. 예를 들어 forward Euler를 떠올리면,

이다. 즉 의 품질은 이 제대로 맞아야 비로소 의미가 있다. 앞 시간이 틀렸는데 뒤 시간을 먼저 맞춘다는 것은, 물리적으로는 잘못된 기반 위에 나중 상태를 억지로 접합하는 일에 가깝다.

Wang et al.은 이 현상을 NTK 관점으로도 해석한다. 표준 PINN의 parameter dynamics가 어떤 temporal residual mode를 먼저 줄이는 implicit bias를 가질 수 있고, 그 결과 초기조건을 충분히 맞추기 전에 later-time residual이 줄어드는 방향으로 학습이 진행될 수 있다는 것이다. 하지만 이 글에서 더 중요한 렌즈는 NTK가 아니다. 더 직접적인 진단은 이것이다.

continuous-time PINN은 시간의 화살표를 "합의 구조" 안에 넣지 못했다.

그래서 time-dependent PDE에서 흔히 보이는 증상들이 나온다.

Allen-Cahn처럼 비교적 단순한 예제에서는 이것이 "왜 0.5 수준의 큰 상대오차가 남는가"로 나타나고, Lorenz나 Kuramoto-Sivashinsky, Navier-Stokes에서는 "왜 장시간 동역학을 아예 붙잡지 못하는가"로 증폭된다.

Wang et al.의 해법은 생각보다 직설적이다. 시간 residual을 동일하게 더하지 말고, 앞선 시간 residual이 충분히 줄어들기 전에는 뒤 시간 residual의 영향력을 잠가 두자는 것이다.

weighted residual loss는 다음처럼 쓸 수 있다.

여기서 은 causality parameter다. 이 식의 의미는 매우 분명하다.

즉 causal training은 뒤 시간을 더 똑똑하게 맞추는 기법이라기보다, 앞 시간이 아직 틀렸을 때 뒤 시간을 함부로 맞추지 못하게 하는 규율이다.

논문의 가장 좋은 점은 이 weighting이 PDE의 temporal precedence를 수식으로 복원한다는 데 있다. 표준 PINN에서는 모든 시간이 동등한 투표권을 가진다. causal training에서는 그렇지 않다. 뒤 시간은 앞 시간의 residual이 만든 "관문"을 통과해야만 optimizer에게 발언권을 얻는다.

이 너무 작으면 gating이 약해진다. 뒤 시간 window가 너무 빨리 열려서 causal training이 사실상 평범한 weighted sum에 가까워진다. 반대로 이 너무 크면 앞 구간 residual을 극도로 작게 만들기 전에는 뒤 구간이 거의 열리지 않아 optimization이 지나치게 뻣뻣해진다.

논문도 이 민감도를 분명히 인정한다. 그래서 실전에서는 하나를 영원히 고정하기보다 annealing strategy를 쓴다. 작은 값에서 시작해 점점 강한 causality를 부과하는 증가열을 사용한다. 부록 설정에서는 같은 단계적 스케줄이 기본값으로 제시된다.

이 논문의 또 다른 장점은 학습 종료 조건을 loss 값 하나로 보지 않는다는 점이다. Wang et al.은 temporal weights가 전부 충분히 활성화되었는지, 즉

가 되는지를 stopping criterion으로 제안한다. 직관은 이렇다.

논문은 이 stopping criterion이 더 빠를 뿐 아니라 더 정확할 수도 있다고 보고한다. 특히 Lorenz 예제에서는 고정 iteration으로 더 오래 돌렸을 때 loss는 더 내려가지만 예측은 오히려 나빠지는 overfitting 비슷한 양상이 관찰된다.

Allen-Cahn은 이 논문을 읽는 첫 관문이다. 이유는 간단하다. 문제 자체는 비교적 익숙하지만, 표준 PINN의 시간축 실패와 causal training의 개선이 가장 선명하게 드러나기 때문이다.

| 방법 | 상대 L2 오차 | 해석 |

|---|---|---|

| Original formulation of Raissi et al. | 4.98e-01 | 시간 의존 문제에서 사실상 실패 |

| Adaptive time sampling | 2.33e-02 | 샘플링 개선만으로는 한계 |

| Self-attention | 2.10e-02 | 표현력 개선은 되지만 순서 문제는 남음 |

| Time marching | 1.68e-02 | 시간 분할은 도움 되지만 오차는 여전히 큼 |

| Causal training (MLP) | 1.43e-03 | 시간 causality 복원만으로 급격한 개선 |

| Causal training (modified MLP) | 1.39e-04 | 아키텍처 개선과 결합 시 한 단계 더 내려감 |

숫자만 봐도 포인트가 선명하다. 샘플링을 바꾸거나 self-attention을 넣는 것보다, loss에 시간 순서를 다시 심는 것이 더 강하게 작동한다. Allen-Cahn은 이 논문의 주장을 가장 우아하게 증명한다.

Lorenz는 chaotic ODE의 대표 예제다. 아주 작은 초기 오차가 빠르게 증폭되기 때문에, 앞 시간을 제대로 맞추지 못하면 뒤 시간은 겉보기로만 비슷한 궤적이 되기 쉽다. 논문이 보고한 상대 L2 오차는 다음과 같다.

| Lorenz 성분 | 상대 L2 오차 | 의미 |

|---|---|---|

| x | 1.139e-02 | 초기 민감도를 감안하면 매우 낮은 수준 |

| y | 1.656e-02 | window별 stopping이 실제로 작동 |

| z | 7.038e-03 | 세 성분 중 가장 안정적 |

Lorenz에서 중요하게 읽어야 할 대목은 단순히 "오차가 작다"가 아니다. stopping criterion을 제거하고 더 오래 학습하면 오히려 예측이 나빠질 수 있다는 관찰이다. causal training은 학습 순서를 설계하는 동시에, 언제 멈춰야 하는지도 temporal weight로 알려 준다.

Kuramoto-Sivashinsky는 PINN에게 잔인한 문제다. 고차 미분, 강한 시공간 상호작용, chaotic regime이 겹친다.

이 대목에서 causal training의 역할은 분명하지만, 동시에 한계도 드러난다. regular case에서는 매우 정교하게 맞지만, chaotic case로 가면 여전히 오차가 한 자릿수 더 커진다. 즉 causal training은 "chaos를 공짜로 해결"하는 마법이 아니다. 시간 순서를 복원해 학습이 무너지지 않게 만들 뿐, chaotic dynamics 자체를 쉽게 만들지는 않는다.

논문은 2D decaying turbulence 예제에서 velocity-vorticity formulation을 사용해 Navier-Stokes를 푼다. 보고된 상대 L2 오차는 다음과 같다.

| Navier-Stokes 변수 | 상대 L2 오차 | 해석 |

|---|---|---|

| u | 3.90e-02 | turbulence를 무감독 PINN으로 붙잡았다는 점이 중요 |

| v | 2.61e-02 | 가장 낮은 오차 |

| w | 3.53e-02 | vorticity까지 시공간 전체에서 유지 |

이 결과는 과소평가할 필요도, 과대평가할 필요도 없다. 분명한 성과는 이것이다. PINN이 이전에는 접근하기 어려웠던 turbulent regime에 실제로 들어갔다. 하지만 그 사실이 곧바로 "산업용 CFD를 PINN이 대체한다"를 뜻하지는 않는다.

이 논문을 읽을 때 가장 흔한 오해는 "loss에 weight만 곱했더니 다 풀렸다"는 식의 독해다. 실제 recipe는 더 강하다.

따라서 더 정확한 결론은 이렇다.

causal training은 단독 만능약이 아니라, 강한 PINN recipe 안에서 특히 시간축 병목을 해결하는 핵심 재료다.

여기서부터는 2026년 시점의 해석을 조금 더 분명히 하겠다. 아래 평가는 위 논문들과 후속 시스템들을 바탕으로 한 코어닷투데이의 해석이다.

2024년 PirateNets 논문은 causal training을 여전히 핵심 failure mode 대응책으로 다룬다. 더 흥미로운 점은 JAX-PI 계열 실험 파이프라인이 이를 사실상 표준 재료로 흡수했다는 점이다. 실제 JAX-PI 공개 구현에는 여러 예제에서 use_causal = True와 causal_tol 설정이 기본값으로 들어가 있다. 이는 단순한 인용이 아니라, 후속 강한 PINN stack 안에서 causal training이 살아남았다는 증거다.

즉 2026년의 causal training은 "한때 화제가 된 아이디어"라기보다, 시간 의존 PINN을 진지하게 돌릴 때 기본적으로 고려해야 하는 training pattern으로 보는 편이 맞다.

그렇다고 causal training을 PINN의 최종 해답으로 읽으면 곤란하다. 다음 문제들은 여전히 남는다.

다시 말해 causal training이 고치는 것은 "시간 순서를 무시한 학습" 이지, PINN의 모든 고질병이 아니다.

PINN이 여전히 설득력 있는 영역은 어디일까? 가장 먼저 떠오르는 답은 inverse problems다. 2025년 Neural Networks에 실린 Physics-informed neural networks for solving inverse problems in phase field models는 관측이 희소하고, 미지의 매개변수나 latent field를 동시에 복원해야 하는 문제에서 PINN 계열 접근이 여전히 강력하다는 점을 보여준다.

이 맥락에서는 causal training의 가치가 더 커진다. sparse observation 아래에서 시간 정보까지 거꾸로 학습하면 inverse problem은 더 불안정해진다. 반대로 시간 순서를 먼저 세우면, PINN은 데이터 적합과 물리 제약 사이에서 훨씬 덜 흔들린다.

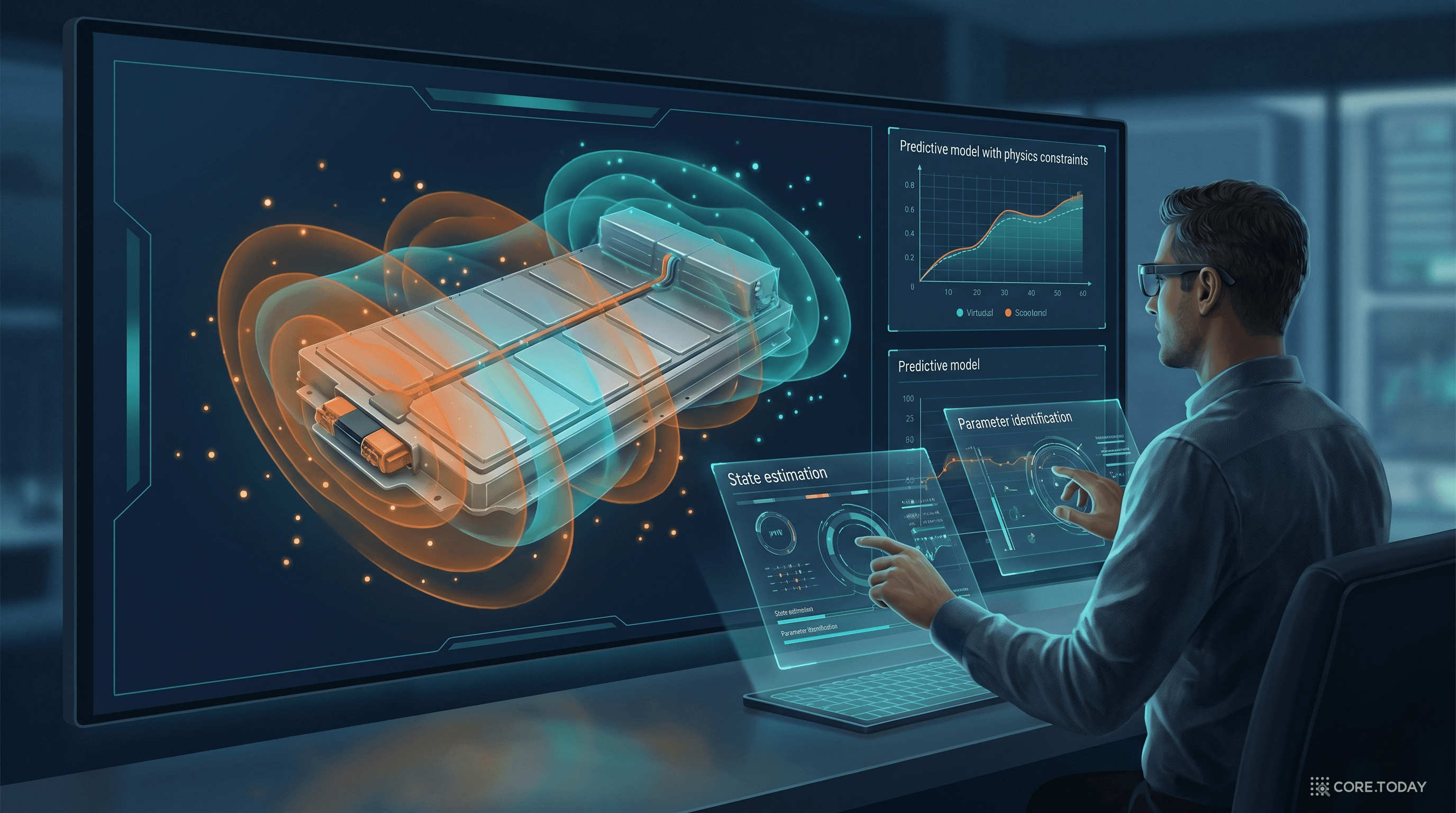

2026년의 실전적 자리매김은 디지털 트윈 쪽에서 더 분명하다. Digital twin framework with physics-informed neural networks for real-time monitoring of PEM electrolyzers in renewable microgrids 같은 사례가 보여 주는 것은, PINN이 초대형 고충실도 솔버를 전부 대체한다는 이야기가 아니다. 오히려 실시간 모니터링, state estimation, parameter identification, reduced-order prediction 같은 층위에서 물리를 아는 surrogate/estimator로 쓰인다는 이야기다.

이런 워크플로에서는 다음 두 형태가 특히 자연스럽다.

| 워크플로 | PINN의 역할 | 왜 causal training이 유효한가 |

|---|---|---|

| 순수 PINN 디지털 트윈 | 실시간 상태 추정, 결측 센서 보간, 파라미터 식별 | 시간축 순서를 지켜 sparse sensor data를 안정적으로 동화 |

| PINN + operator hybrid | operator가 장기 전개를 맡고, PINN이 제약·보정·역문제를 맡음 | 각자의 강점을 분리해 실무성이 높음 |

| 전통 솔버 + PINN 보조 | 잔차 교정, boundary/parameter inference | PINN을 전체 솔버가 아니라 추론 모듈로 제한 가능 |

이 질문에는 단호해야 한다. 긴 horizon, 다중 스케일, 대규모 3D, 고충실도 산업 CFD라면 operator learning이나 전통 솔버가 더 자연스러운 경우가 많다. DeepONet이나 FNO는 학습 데이터가 준비되어 있다면 장기 전개와 다수 query 추론에서 훨씬 효율적일 수 있고, 검증된 CFD 솔버는 여전히 정확성과 신뢰성의 기준점이다.

그래서 2026년의 실무 감각은 "PINN 대 operator"의 이분법이 아니다. 더 가까운 구도는 이렇다.

causal training은 이 지도에서 PINN을 더 쓸 만하게 만들어 준다. 하지만 지도를 뒤집지는 못한다.

Wang et al. 2022의 메시지는 생각보다 넓다. PINN은 PDE residual을 손실함수에 넣는다고 해서 자동으로 "물리를 배운" 모델이 되지 않는다. 물리의 구조를 어떤 방식으로 loss와 architecture 안에 넣었는가가 더 중요하다.

causal training의 진짜 공헌은 다음 한 문장으로 압축된다.

시간 의존 문제에서 물리는 교환 가능하지 않다. 따라서 residual도 교환 가능한 합으로만 다뤄서는 안 된다.

Allen-Cahn에서는 이것이 order-of-magnitude 개선으로 보였고, Lorenz와 Kuramoto-Sivashinsky에서는 PINN이 이전보다 훨씬 긴 시간 구조를 붙잡을 수 있게 했으며, Navier-Stokes turbulence에서는 "PINN이 이 문제까지 들어갈 수 있나?"라는 문턱을 넘게 했다. 동시에 2026년의 관점에서 보면, 이 기법은 universal cure가 아니라 강한 scientific ML recipe의 표준 부품으로 남았다.

PINN이 시간 문제에서 자꾸 무너지는 이유를 한 줄로 묻는다면, 이제 답은 꽤 명확하다.

앞 시간을 충분히 이해하기 전에 뒤 시간을 먼저 줄여도 된다고 optimizer에게 허락했기 때문이다.

causal training은 그 허락을 철회한다.