FP64 is All You Need — PINN 실패 모드를 다시 생각하다

모두가 BF16과 FP8을 외치는 시대에, 한 논문은 정반대로 말한다. PINN의 유명한 실패 모드는 로컬 최솟값보다 '정밀도가 부족한 조기 정지'에 더 가깝다는 것. 이 도발적인 논문을 출발점으로, PINN의 역사와 실패 사례, FP64의 의미, 그리고 2026년 과학 AI에서 이 기술의 자리를 쉽고 깊게 풀어본다.

모두가 BF16과 FP8을 외치는 시대에, 한 논문은 정반대로 말한다. PINN의 유명한 실패 모드는 로컬 최솟값보다 '정밀도가 부족한 조기 정지'에 더 가깝다는 것. 이 도발적인 논문을 출발점으로, PINN의 역사와 실패 사례, FP64의 의미, 그리고 2026년 과학 AI에서 이 기술의 자리를 쉽고 깊게 풀어본다.

요즘 AI 업계의 분위기는 명확합니다. FP32도 무겁다, BF16으로 가자. 가능하면 FP8까지 내려가자. 대규모 언어모델도, 비전 모델도, 추론 시스템도 대체로 그 방향으로 발전해 왔습니다. 숫자를 덜 정밀하게 표현해도 성능이 크게 무너지지 않는 경우가 많았기 때문입니다.

그런데 2025년 NeurIPS에 채택된 한 논문은 완전히 반대 방향으로 외칩니다.

FP64 is All You Need: Rethinking Failure Modes in Physics-Informed Neural Networks

제목부터 도발적입니다. "정말 FP64만 있으면 되는 거야?"라는 반문이 먼저 나옵니다. 그런데 논문을 읽다 보면, 저자들이 단순히 "더 정밀하게 계산하면 좋다"는 상식적 이야기를 하는 게 아니라는 걸 알게 됩니다. 이들은 PINN(Physics-Informed Neural Network)의 유명한 실패 모드 자체를 다시 정의하자고 주장합니다.

기존 해석:

이 논문의 해석:

이 한 문장이 왜 큰 파장을 만드는지 이해하려면, 먼저 PINN이 왜 등장했고 왜 이렇게 많은 사람이 매달렸는지부터 봐야 합니다.

편미분방정식(PDE)은 세상의 거의 모든 연속 현상을 설명합니다. 열이 퍼지고, 유체가 흐르고, 재료가 갈라지고, 전자기장이 변하고, 오염 물질이 확산하는 문제는 결국 PDE로 갑니다.

전통적으로는 FEM(유한요소법), FDM(유한차분법), FVM(유한체적법) 같은 수치해석 도구가 이 일을 맡았습니다. 이들은 강력하고 신뢰할 만하지만, 다음과 같은 대가가 있습니다.

PINN이 매력적이었던 이유는 여기에 있습니다. 신경망을 함수 근사기로 쓰되, 손실함수 안에 물리 법칙을 직접 넣자는 발상이었기 때문입니다.

쉽게 말하면:

PINN의 아이디어는 사실 2019년에 갑자기 하늘에서 떨어진 것이 아닙니다.

여기서 중요한 enabling factor는 자동미분(autodiff) 입니다. 미분방정식을 신경망에 넣으려면 , 같은 항을 계산해야 하는데, 2010년대 후반의 딥러닝 프레임워크는 이걸 비교적 자연스럽게 해냈습니다. 그래서 PINN은 "오래된 아이디어가 시대를 잘 만난 사례"에 가깝습니다.

PINN은 특히 다음 같은 문제에서 매력적이었습니다.

문제는 마지막 줄입니다. PINN은 아이디어가 너무 예뻐서, 실제 훈련의 잔혹함이 늦게 보였다는 점입니다.

2021년 Krishnapriyan et al.이 유명하게 정리했듯, PINN은 종종 아주 이상한 방식으로 실패합니다.

이건 학생이 시험지에 답을 다 쓴 것처럼 보이는데, 채점해 보면 논리 전개가 전부 틀린 상황과 비슷합니다. 더 정확히 말하면, PINN은 '문제의 분위기'는 맞추는데 '정답의 구조'는 놓치는 경우가 많다는 뜻입니다.

일반적인 지도학습이라면 검증 오차가 바로 경고를 줍니다. 그러나 PINN은 종종 잔차 손실이 낮다는 이유로 안심하기 쉽습니다. 특히 ground truth가 없는 실제 공학 문제에서는 더욱 그렇습니다.

예를 들어 봅시다.

배터리 열관리 열 방정식을 PINN으로 풀고 있다고 합시다. 잔차는 작아 보이지만 내부 hotspot 위치가 조금만 틀려도 안전 여유 계산이 바뀝니다.

지하 유동 역문제 센서가 몇 개 안 되는 상황에서 투수계수를 추정하는 PINN이 잘못된 smooth solution으로 가라앉으면, 시추 위치나 주입 전략이 잘못될 수 있습니다.

재료 균열·상전이 균열 끝이나 상 경계는 고주파 성분과 급격한 변화가 많습니다. PINN이 여길 뭉개면, 전체적으로는 그럴듯해 보여도 핵심 물리는 놓칩니다.

PINN 문헌에서 널리 퍼져 있던 직관은 대략 이랬습니다.

이 가설은 나름 설득력이 있었습니다. 실제로 이후 문헌은 이 방향으로 폭발했습니다.

문제는, 이번 FP64 논문이 이 전제를 정면으로 흔든다는 점입니다.

논문의 가장 중요한 철학적 전환은 여기 있습니다.

| 기존 해석 | 이 논문의 해석 | 무슨 의미인가 |

|---|---|---|

| Loss-Barrier Hypothesis 실패와 성공은 다른 basin에 있다 | Same-Basin Hypothesis 실패와 성공은 같은 basin의 다른 위치다 | 문제는 탈출이 아니라 계속 전진하느냐일 수 있다 |

| optimizer가 가짜 해에 갇힌다 | optimizer가 너무 일찍 멈춘다 | 정밀도, stop criterion, optimizer 구현이 연구 주제로 올라온다 |

| 특화 아키텍처가 새로운 길을 만든다 | 특화 아키텍처가 기존 길을 더 오래 가게 해줄 수도 있다 | architecture innovation을 다시 해석하게 만든다 |

이 가설을 뒷받침하기 위해 논문은 세 가지 단서를 제시합니다.

논문은 convection 문제에서 2000개의 랜덤 초기화를 시도했는데, 계속 실패 패턴이 나타났다고 보고합니다. 만약 성공 basin과 실패 basin이 정말 분리되어 있다면, 운 좋게라도 성공 basin에 떨어지는 경우가 좀 나와야 합니다. 그런데 거의 항상 비슷한 실패가 반복됩니다.

이건 "운이 나빴다"보다 애초에 optimization이 중간에서 멈춘다는 해석 쪽에 더 잘 맞습니다.

이 대목이 논문의 하이라이트입니다. 저자들은 FP32로 학습하다 실패한 파라미터에서 출발해, 정밀도만 FP64로 바꾸고 학습을 이어갑니다. 그러자 loss가 아주 조금 더 내려가고, 그 작은 추가 이동이 오차(error)의 급락으로 이어집니다.

즉, 높은 barrier를 뛰어넘은 게 아니라, 같은 평지 위에서 조금 더 걸어간 것처럼 보인다는 뜻입니다.

논문이 그리는 그림은 이렇습니다.

즉, 파라미터가 조금만 더 움직이면 error는 크게 줄 수 있는데, loss만 보고 있으면 "거의 변한 게 없는 것처럼" 보일 수 있습니다.

이 비유는 아주 중요합니다. PINN 실패를 "벽에 막힘"이 아니라 "미세 이동을 못 읽어서 주행 종료"로 보면, 우리가 봐야 할 것은 아키텍처 이전에 수치 정밀도와 종료 조건이 됩니다.

논문은 PINN의 훈련을 세 단계로 나눕니다.

중요한 포인트는 이것입니다.

성공하는 모델도 실패 phase를 통과할 수 있다.

즉, failure phase는 "영원한 종착역"이 아니라 지나가는 구간일 수 있습니다. 문제는 FP32 학습이 그 지점에서 멈춰 버린다는 것입니다.

이걸 직관적으로 이해하려면, 산을 오르는 게 아니라 긴 터널을 통과한다고 생각하면 쉽습니다.

FP32는 터널 중간에서 "여기쯤이면 끝난 것 같은데?" 하고 멈추고, FP64는 조금 더 가서 출구를 본다는 그림입니다.

이 세 단계 관점은 이후 문헌을 읽는 방식도 바꿉니다. 예전에는 "왜 이 구조가 loss barrier를 넘게 만들지?"라고 생각했다면, 이제는 "왜 이 방법이 failure phase를 더 잘 통과하게 만들지?"로 질문이 바뀝니다.

여기서 논문은 더 구체적으로 들어갑니다. 많은 PINN 실험은 여전히 L-BFGS를 사용합니다. 이유는 간단합니다.

즉, PINN은 CV/NLP 모델처럼 "대충 Adam으로 오래 돌리면 된다"는 감각과 다릅니다. 애초에 수치해석 냄새가 강한 최적화 문제입니다.

저자들은 PyTorch류의 L-BFGS 구현에서 optimizer.step(closure) 내부에 inner loop가 있고, 이 inner loop가 gradient norm이나 parameter change 기준으로 멈춘다고 설명합니다.

논문에서 핵심으로 보는 지점은 이 부분입니다.

이 값이 바로 machine epsilon입니다.

논문은 자신들의 PINN 설정에서 tolerance_change = 1e-7이 FP32 정밀도와 충돌하고, 가중치 norm은 커지고 gradient norm은 작아지면서 업데이트가 사실상 underflow에 가까워진다고 해석합니다.

쉬운 비유로 바꿔보겠습니다.

FP32는 이 계기판이 너무 거친 상황에 가깝습니다.

무게가 실제로 바뀌어도, 숫자는 안 바뀝니다. 그 순간 멈춘 것처럼 보이는 착시가 생깁니다.

논문 Table 2에 따르면, 같은 vanilla PINN이라도 FP32와 FP64의 차이는 극단적입니다.

| PDE | FP32 rRMSE | FP64 rRMSE | 속도 변화 | 메모리 변화 |

|---|---|---|---|---|

| Convection | 0.7640 | 0.0072 | 0.29s → 0.32s / iter | 1609MB → 2441MB |

| Reaction | 0.9778 | 0.0502 | 0.26s → 0.29s / iter | 1629MB → 2481MB |

| Wave | 0.2837 | 0.0081 | 0.47s → 0.61s / iter | 2295MB → 3845MB |

| Allen-Cahn | 0.9662 | 0.0545 | 0.40s → 0.48s / iter | 1975MB → 3167MB |

숫자를 보면 메시지는 분명합니다.

즉, 적어도 H100급 하드웨어에서는 "FP64는 너무 느려서 못 쓴다"는 통념이 이 논문 맥락에서는 성립하지 않습니다.

이 논문이 화제를 모은 이유는 단순히 아이디어가 새로워서가 아니라, 결과가 너무 강했기 때문입니다. 저자들은 convection, reaction, wave, Allen-Cahn 네 가지 대표 failure-mode 문제에서 vanilla PINN + FP64가 크게 개선된다고 보입니다.

하지만 여기서 한 걸음 더 들어가 보면, 더 재밌는 이야기가 나옵니다.

논문 본문은 꽤 강하게 말합니다. 그러나 Table 1을 자세히 보면, 항상 모든 특화 구조를 이기는 것은 아닙니다.

예를 들어 reaction 문제에서는:

즉, reaction에서는 여전히 특화 구조가 더 좋습니다. 반대로 convection, wave, Allen-Cahn에서는 FP64 vanilla PINN이 압도적으로 좋아집니다.

이건 오히려 논문의 메시지를 더 흥미롭게 만듭니다.

이 논문은 "architecture는 무의미하다"를 증명한 것이 아니라, "precision은 architecture보다 훨씬 더 근본적인 변수일 수 있다"는 걸 보여준 것에 가깝다.

를 한 묶음의 시스템 설계 문제로 봐야 한다.

논문을 읽고 나면 많은 사람이 이렇게 생각합니다.

"그래서 그냥 FP64 켜면 되는 거네?"

그렇게 끝나면 이 논문을 반밖에 이해하지 못한 것입니다. 진짜 중요한 건 PINN의 실패를 바라보는 눈이 바뀌었다는 데 있습니다.

배터리 팩 내부의 온도장은 직접 다 측정하기 어렵습니다. 그래서 몇 개 센서와 열 방정식을 함께 써서 내부 분포를 복원하려는 유혹이 큽니다. 이때 PINN이 failure phase에서 멈추면 무슨 일이 생길까요?

배터리 안전 설계에서 이건 꽤 치명적입니다. 문제는 결과가 너무 매끈해서 오히려 믿기 쉽다는 것입니다.

시추공 데이터는 비싸고 드뭅니다. 반면 Darcy flow나 확산 계열 PDE는 알고 있습니다. 그래서 PINN은 역문제에 매력적입니다. 하지만 투수계수나 경계 유량을 잘못 추정하면, 생산 계획 자체가 틀어질 수 있습니다.

이 논문이 중요한 이유는 이런 상황에서 연구자에게 이렇게 말해주기 때문입니다.

"loss가 낮다고 안심하지 마라. optimizer가 진짜로 더 갈 수 있는지부터 보라."

Allen-Cahn, phase-field fracture, corrosion front 같은 문제는 얇고 날카로운 구조가 핵심입니다. 여기서는 전체 field가 좀 틀린 게 아니라, 경계면 위치가 조금만 틀려도 해석 전체가 달라집니다.

이런 문제에서 FP32가 failure phase에 오래 머무르면, 넓게 보면 그럴듯하지만 실제로 중요한 interface physics는 놓칠 수 있습니다. 그래서 이 논문은 단순한 "optimizer tips"가 아니라, 과학 AI의 신뢰성 문제로 읽혀야 합니다.

지금의 AI 문화는 압축과 저정밀도에 익숙합니다.

그런데 과학 AI에서는 종종 정반대입니다. PDE를 푼다는 건 결국 수치해석 문제를 신경망 도구로 다시 푸는 것이기 때문입니다. 이 논문은 이 사실을 매우 선명하게 드러냅니다.

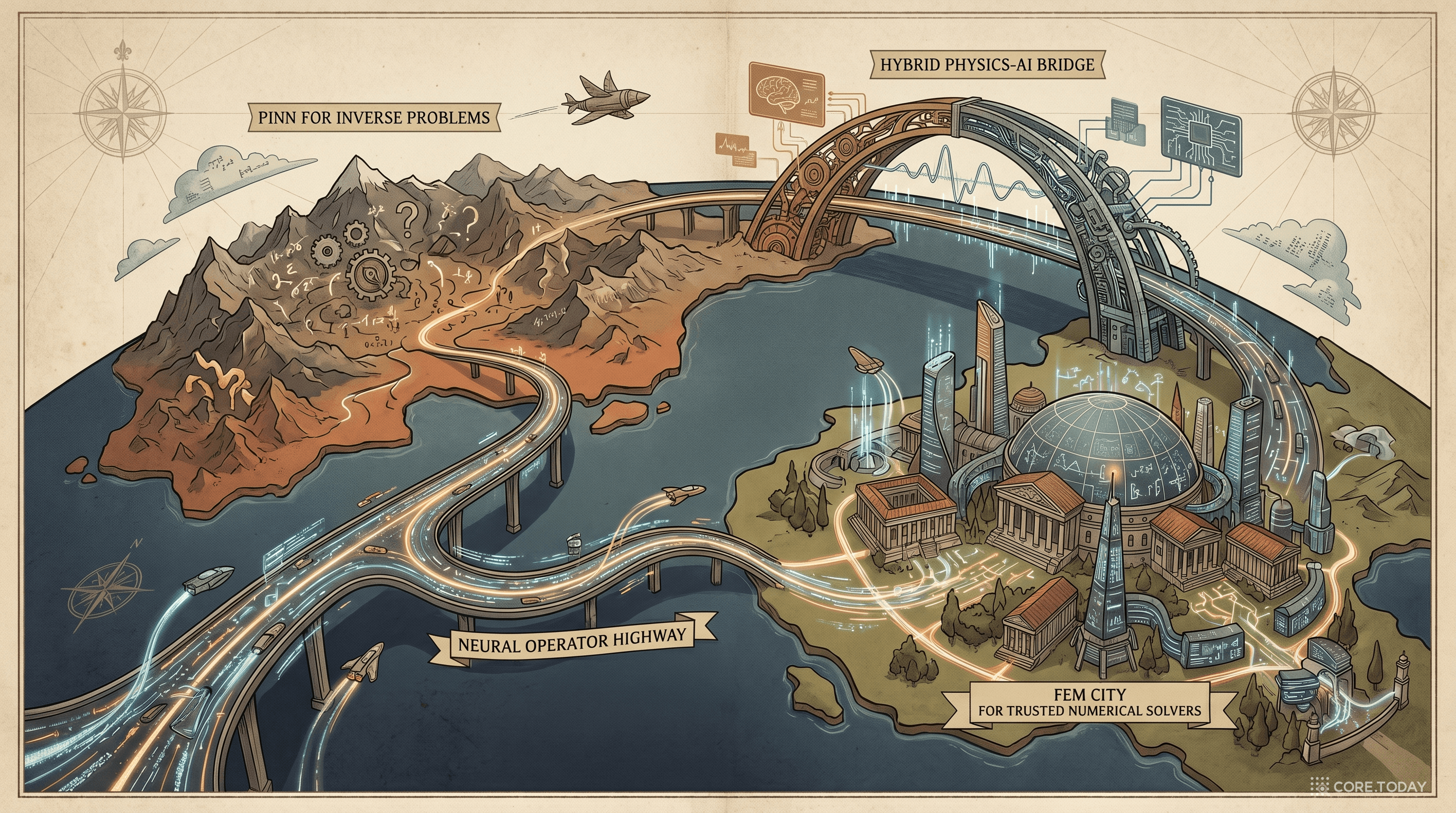

2026년 시점에서 PINN을 둘러싼 풍경은 훨씬 성숙해졌습니다. Grossmann et al. (2024)은 여러 PDE에 대해 PINN과 FEM을 체계적으로 비교했고, 시간과 정확도 측면에서 PINN이 FEM을 전반적으로 이기지 못했다고 보고합니다. 반면 2025년 리뷰는 PINN이 여전히 열전달, 균열, 결함 탐지, inverse design, multiscale 재료 해석 등에서 활발히 쓰이고 있음을 보여줍니다.

즉, 결론은 "PINN 끝"도 아니고 "PINN 만능"도 아닙니다.

| 도구 | 잘 맞는 문제 | 약한 지점 | FP64 논문이 준 교훈 |

|---|---|---|---|

| Vanilla PINN | 희소 데이터 역문제, parameter identification, differentiable scientific ML | 고주파/다중 스케일 forward solve, 대규모 many-query | 정밀도와 종료 기준을 무시하면 결과 전체를 오판할 수 있다 |

| FP64 PINN | failure phase를 통과해야 하는 stiff PDE, trustworthy baseline 구축 | 메모리 비용 증가, 고급 GPU 의존 | "먼저 깨끗한 baseline을 세운 뒤" 다른 개선을 얹어라 |

| Neural Operator | 많은 조건에 대한 빠른 반복 추론, operator learning, surrogate modeling | 문제별 물리 제약 주입, sparse inverse problem 직결성 | PINN을 대체한다기보다, 다른 종류의 문제에 더 자연스럽다 |

| Hybrid PINN + FEM | multiscale, domain decomposition, engineering workflow 통합 | 시스템 복잡도 증가 | 정밀도는 이제 hybrid stack에서도 독립 변수로 다뤄야 한다 |

2026년의 흐름을 넓게 보면 다음 네 방향이 두드러집니다.

정밀도 재평가 FP64 논문 덕분에, PINN 실험에서 dtype을 "부차 옵션"으로 넘기는 태도가 설득력을 잃었습니다.

Hybridization 리뷰 문헌이 보여주듯, PINN-enhanced multiscale FEM, domain decomposition, physics-informed operator learning이 활발합니다. "전통 수치해석 vs 신경망"의 싸움보다는 둘을 섞는 방향이 강합니다.

Task specialization forward solve 전체를 대체하려는 시도보다, inverse problem, parameter inference, simulator calibration 같은 PINN이 원래 잘하는 자리로 수렴하고 있습니다.

Numerical literacy의 복귀 딥러닝 엔지니어도 이제

같은 단어를 다시 배워야 하는 시대가 됐습니다.

이 논문이 말하는 가장 중요한 사실은 "FP64가 무조건 만능이다"가 아닙니다.

그보다 더 큰 전환은 이것입니다.

PINN의 실패를 신경망의 신비한 local minimum으로만 보지 말고, 수치해석 관점의 조기 정지와 정밀도 문제로 다시 보자.

이건 생각보다 훨씬 큰 변화입니다. 왜냐하면 질문이 바뀌면, 그다음 2년의 연구 방향도 바뀌기 때문입니다.

예전 질문:

바뀐 질문:

과학 AI에서 중요한 것은 "그럴듯한 그림"이 아니라 신뢰할 수 있는 수치입니다. 그리고 이 논문은 그 당연한 사실을, 가장 딥러닝다운 언어로 다시 상기시켜 줍니다.

RELATED