AI 서비스 실패는

모델 실패가 아닙니다

Pipeline 실패입니다.

Retrieval이 실패하고, Agent tool이 오작동하고, Prompt가 regression을 일으킵니다. CPU와 Latency만 보는 대시보드로는 이 문제를 절대 알 수 없습니다.

AI Dashboard = AI Observability + AI Control Plane

보는 것 + 조정하는 것. 관측과 제어를 하나의 화면에서.

THE PARADIGM SHIFT

Observability가 달라졌습니다

AI 이전의 Observability는 시스템이 살아있는지 보는 것이었습니다. AI 시대의 Observability는 AI가 제대로 작동하는지 보는 것입니다.

System Observability

CPU, Memory, Latency, Error rate

Application logs, Access logs

Request trace, Service mesh

한계: CPU가 정상이어도 모델이 Hallucination을 일으킬 수 있습니다

시스템 메트릭만으로는 AI 서비스의 품질을 알 수 없습니다

AI Observability

Accuracy, Hallucination rate, Groundedness, Toxicity, Safety

Embedding drift, Dataset shift, Retrieval quality, Index freshness

RAG/Agent 각 단계 성공률, Tool call 실패, Prompt regression

Token usage, Model usage, Tool usage, Cost per task

Latency, GPU util, Throughput, Error rate (기존 유지)

전통 대시보드가 보여주는 것: CPU, Memory, Latency

AI 대시보드가 보여주는 것: Quality, Cost, Trace, Safety

OBSERVABILITY LAYERS

AI Observability 5계층

AI 서비스를 완전히 관측하려면 5개 계층을 모두 봐야 합니다.

하나라도 빠지면 장애 원인을 찾을 수 없습니다.

AI Observability = Model + Data + Pipeline + Cost + System

Model Observability

모델이 제대로 답하고 있는가?

CPU 100% 정상, Latency 정상이어도 모델이 Hallucination을 일으키면 서비스는 실패입니다.

응답 정확도 (Ground truth 대비)

근거 없는 생성 비율

검색된 문서와의 일치도

유해 콘텐츠 생성 여부

프롬프트 변경 후 품질 저하 감지

Data Observability

데이터가 여전히 유효한가?

어제까지 잘 작동하던 RAG가 오늘 실패한다면, 데이터가 변했기 때문입니다.

임베딩 분포 변화 감지

학습/서비스 데이터 괴리

검색 결과 관련성 점수

벡터 DB 인덱스 최신성

입력 데이터 품질 지표

Pipeline Observability

각 단계가 정상 작동하는가?

모델은 완벽해도 Retrieval이 실패하면 답변 품질은 0입니다. 파이프라인 전체를 봐야 합니다.

RAG/Agent 각 단계 성공률

외부 도구 호출 실패율

검색 품질과 생성 품질 간 차이

전체 파이프라인 실행 경로 추적

병목 단계 자동 탐지

Cost Observability

비용이 통제되고 있는가?

프롬프트 한 줄 변경으로 월 비용이 3배가 될 수 있습니다. 비용도 관측해야 합니다.

모델별 토큰 소비량 추적

요청당 비용 산출

GPT-4, Claude 등 모델별 사용 비율

외부 API/도구 호출 비용

비정상 비용 증가 실시간 알림

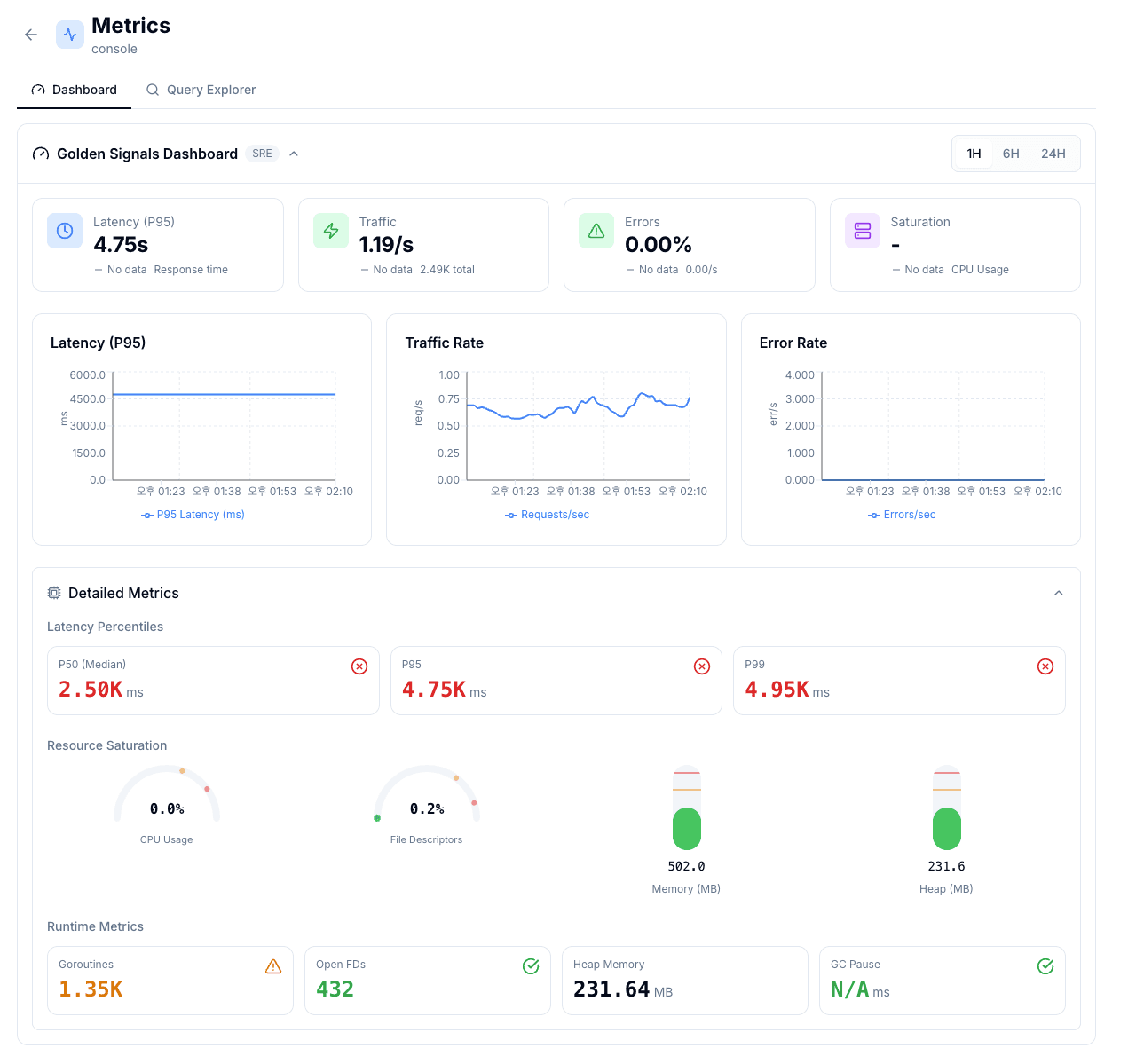

System Observability

인프라가 안정적인가?

전통적 모니터링 영역. 여전히 중요하지만, 이것만으로는 AI 서비스를 관측할 수 없습니다.

응답 지연 시간 분포

GPU 사용률 및 메모리

초당 처리량 (RPS)

HTTP 500, Timeout 등 오류율

서비스 가용성 (SLA)

PIPELINE TRACE

AI Pipeline 실시간 추적

RAG, Agent, Multi-step 파이프라인의 각 단계를 실시간으로 추적합니다.

어떤 단계에서 실패했는지, 왜 실패했는지를 즉시 파악할 수 있습니다.

Query Understanding

사용자 질의 분석 및 의도 파악

Retrieval

벡터 DB에서 관련 문서 검색

Re-ranking

검색 결과 재정렬 및 필터링

Generation

LLM을 통한 최종 응답 생성

Tool Call / Action

외부 API 호출 및 액션 실행

모델 정확도 96%인데 서비스 품질은 왜 낮을까?

Retrieval 성공률 94.7% × Generation 성공률 96.3% × Tool Call 성공률 72.4%

= End-to-End 성공률 66.2%

각 단계가 90% 이상이어도, 파이프라인 전체로 보면 품질이 크게 떨어집니다.

Pipeline Observability가 필수인 이유입니다.

CONTROL PLANE

보는 것에서 조정하는 것으로

AI Dashboard는 단순한 모니터링 도구가 아닙니다.

관측(Observability)과 제어(Control)를 하나의 화면에서 수행합니다.

Observability

보는 것

무슨 일이 일어나고 있는지

실시간으로 파악합니다

Control Plane

조정하는 것

문제를 발견하면 즉시

대시보드에서 조치합니다

Prompt Management

프롬프트 버전 관리, A/B 테스트, 품질 비교를 한 곳에서. 프롬프트 변경이 품질에 미치는 영향을 실시간으로 추적합니다.

Model Routing

요청 유형에 따라 최적의 모델로 자동 라우팅. 단순 질의는 경량 모델로, 복잡한 분석은 고성능 모델로 보내 비용을 최적화합니다.

Guardrails & Safety

입출력 필터링, PII 마스킹, 유해 콘텐츠 차단 등 안전장치를 중앙에서 관리합니다. 정책 위반 시 자동 차단 및 알림.

Pipeline Configuration

RAG 파라미터, Chunk 크기, Top-K, Temperature 등 파이프라인 설정을 대시보드에서 직접 조정합니다. 코드 배포 없이 즉시 반영.

Cost Control

모델별, 팀별, 프로젝트별 비용 한도를 설정하고 초과 시 자동 제한합니다. 예산 내에서 최대 성능을 끌어냅니다.

Feature Flags & Rollout

새 모델, 새 프롬프트, 새 파이프라인을 점진적으로 배포합니다. 문제 발생 시 원클릭 롤백으로 안전하게 운영합니다.

실제 시나리오: Hallucination 급증 대응

Observability가 감지하고, Control Plane이 조치합니다

Hallucination Rate 급증

Model Observability에서 Hallucination rate가 1.3% → 8.7%로 급증 감지

Retrieval 품질 저하 확인

Pipeline Trace에서 Retrieval 단계의 Relevance Score가 급락한 것을 확인

RAG 파라미터 조정

Control Plane에서 Top-K를 5→10으로, Chunk size를 512→256으로 실시간 조정

품질 복구 확인

5분 내 Hallucination rate가 1.5%로 복구. 코드 배포 없이 대시보드에서 해결

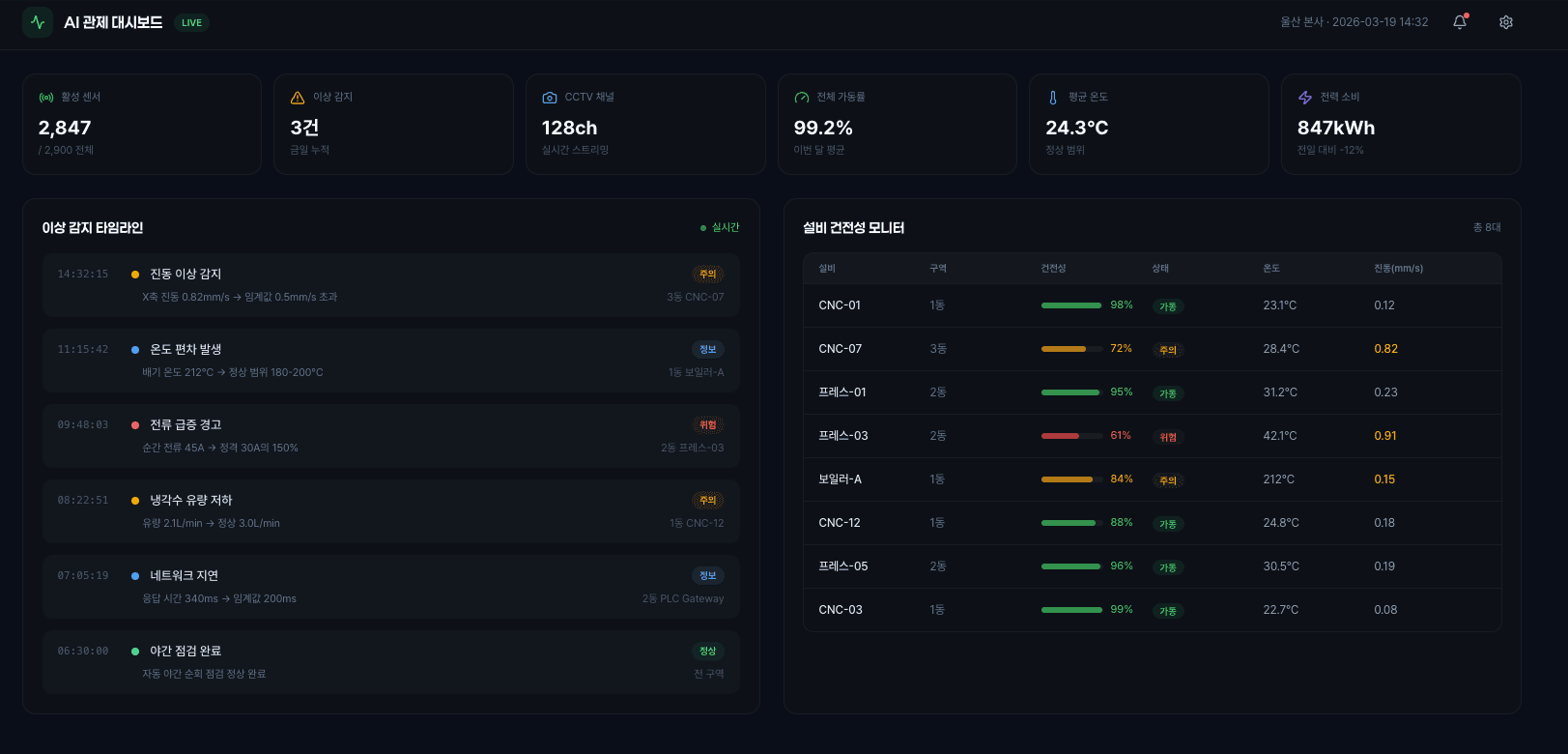

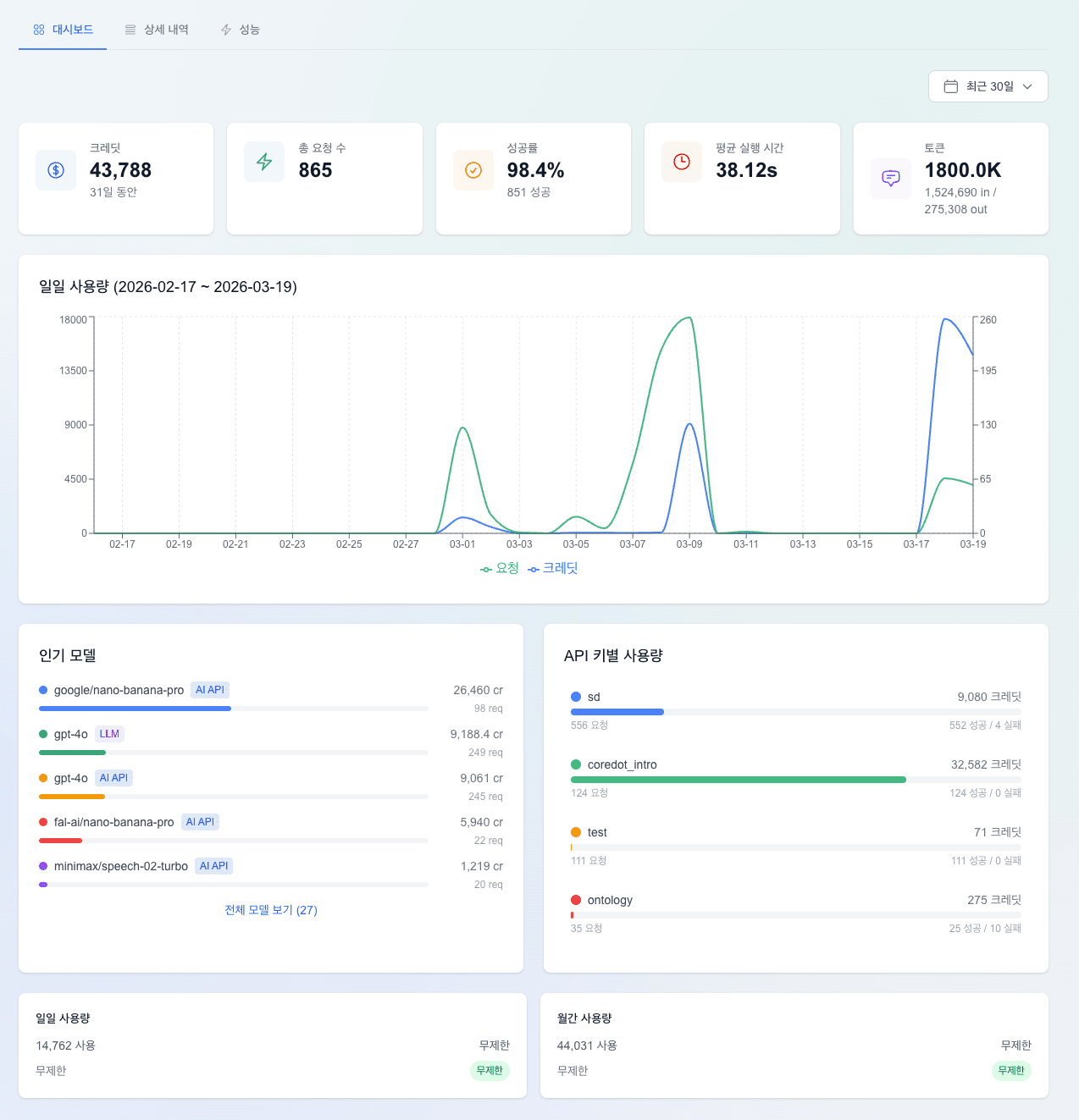

Product Preview

실제 대시보드 화면을 확인하세요

산업 관제, AI API 모니터링, SRE 메트릭 — 용도에 맞는 대시보드를 제공합니다.

사고가 일어나기 전에

AI가 먼저 알려줍니다

AI 관제 대시보드 도입 상담 및 PoC를 신청하세요. 현장 분석부터 대시보드 구축까지 코어닷투데이가 함께합니다.