PINN의 손실은 왜 서로 싸우는가 — gradient pathology에서 2026년의 해법까지

PINN은 왜 PDE를 손실에 넣고도 자주 학습이 무너질까? Lagaris와 Raissi의 약속에서 출발해 gradient pathology, learning rate annealing, architecture 개선, NTK 분석, domain decomposition, NewPINNs까지 2026년 현재의 해법 지형을 깊고 읽기 쉽게 정리한다.

PINN은 왜 PDE를 손실에 넣고도 자주 학습이 무너질까? Lagaris와 Raissi의 약속에서 출발해 gradient pathology, learning rate annealing, architecture 개선, NTK 분석, domain decomposition, NewPINNs까지 2026년 현재의 해법 지형을 깊고 읽기 쉽게 정리한다.

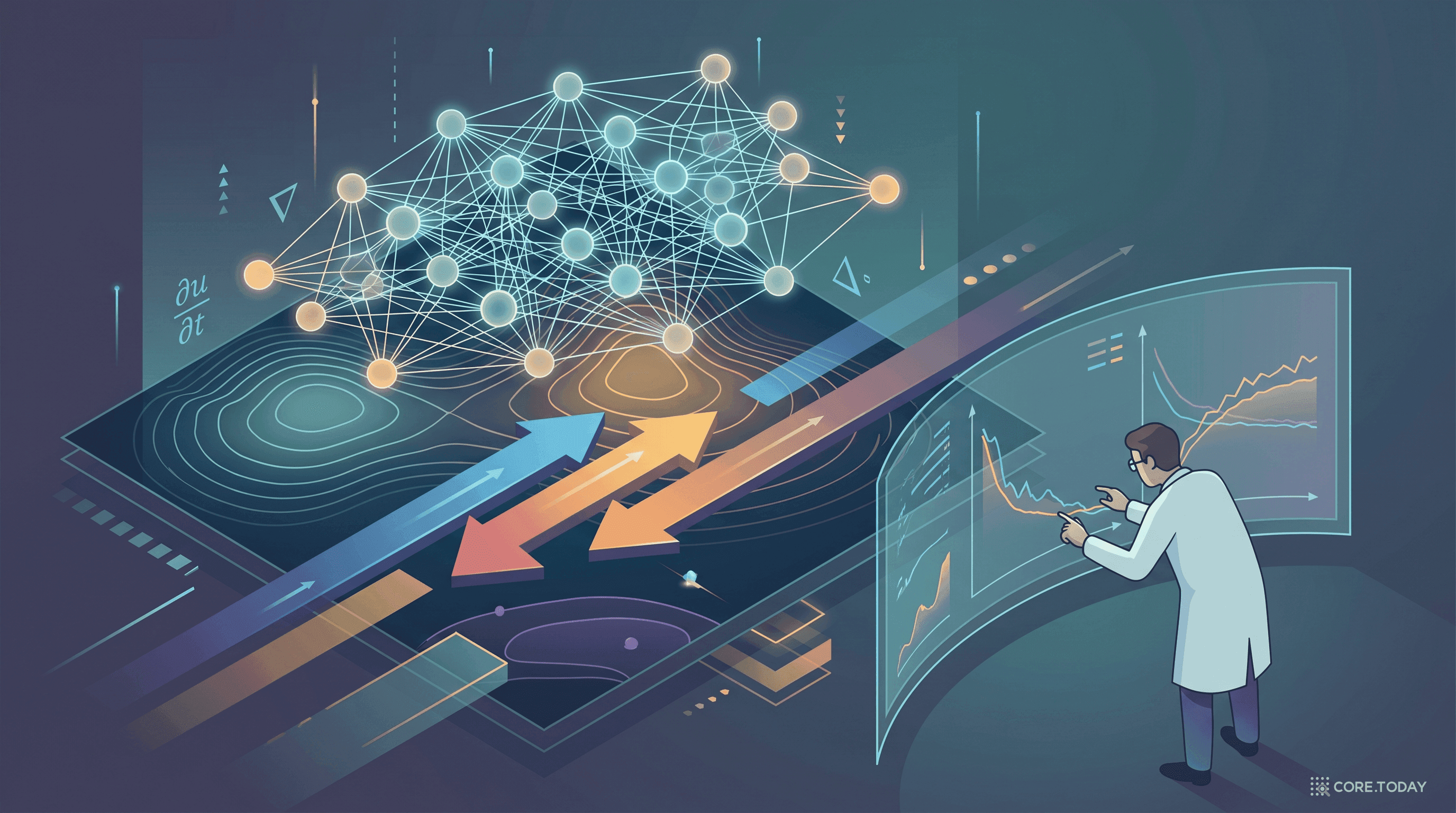

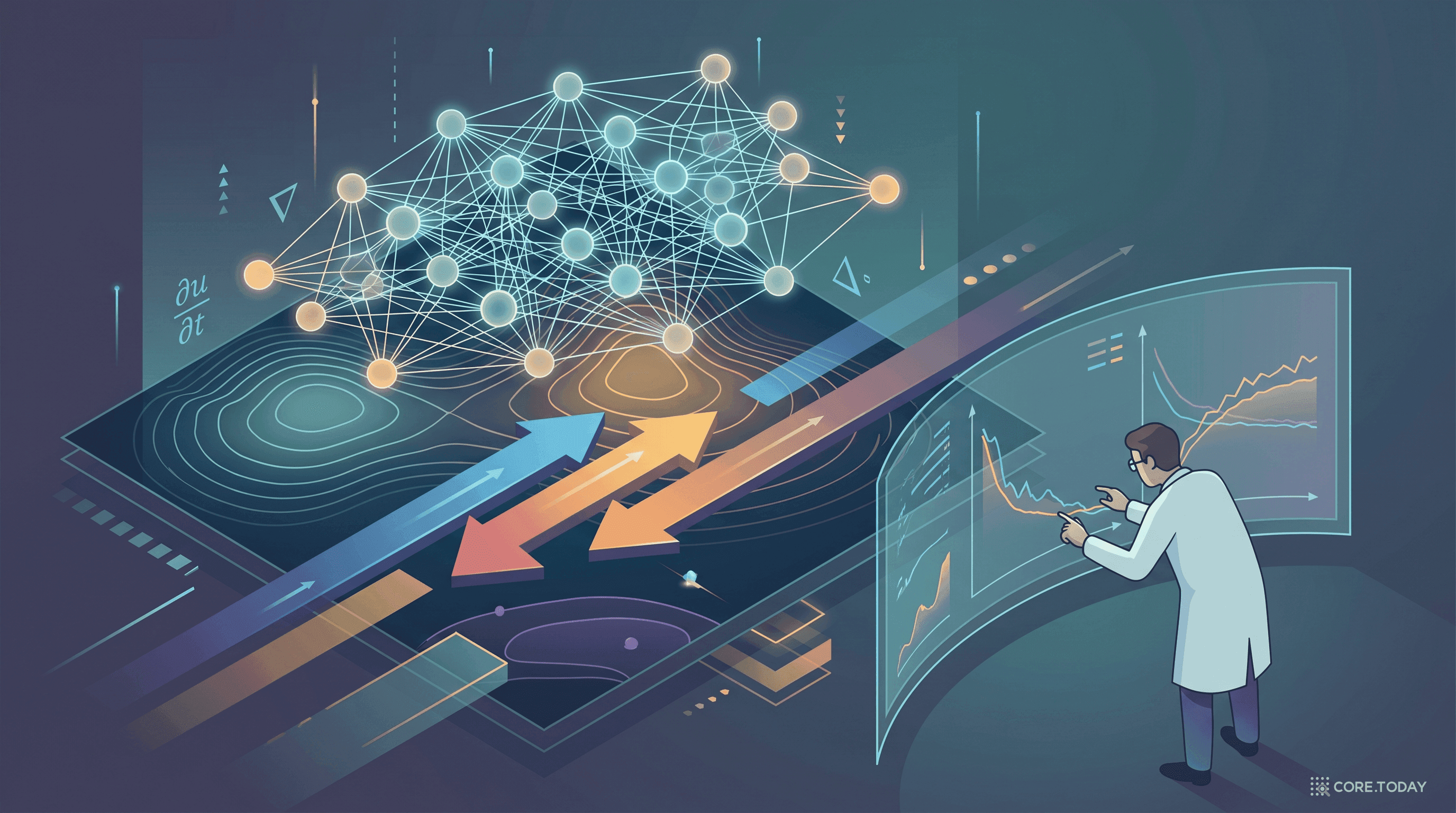

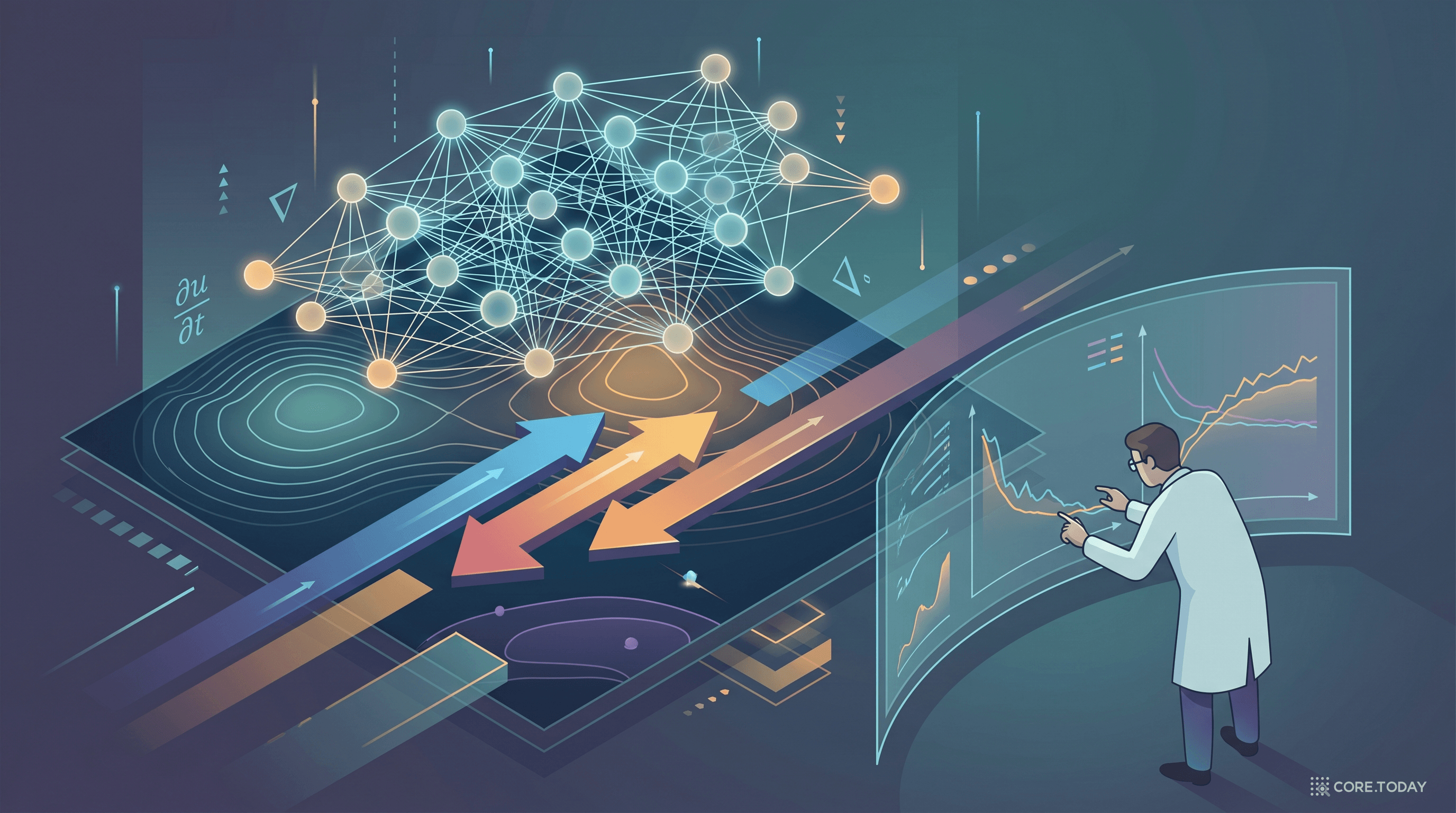

Physics-Informed Neural Networks, 줄여서 PINN은 한동안 과학 AI의 가장 매혹적인 약속처럼 보였다. 지배 방정식이 있고, 경계조건과 초기조건이 있으며, 관측 데이터는 부족하다. 전통적으로는 수치해석과 실험이 나눠 맡던 일을, 이제는 신경망 하나가 통합적으로 다룰 수 있다는 그림이었다. 특히 역문제에서는 이 약속이 더 강하게 들렸다. 정답 데이터가 충분하지 않아도 PDE 자체가 감독 신호가 되어 줄 것처럼 보였기 때문이다.

하지만 실전은 훨씬 까다로웠다. PDE를 손실함수에 넣는다고 해서 곧바로 안정적인 학습이 보장되지는 않는다. 오히려 물리 잔차, 경계조건, 초기조건, 데이터 적합 항을 한데 묶는 순간, 손실 함수는 단순한 합이 아니라 서로 다른 스케일과 곡률, 주파수 성분, 시간 척도를 가진 목적들의 충돌장이 된다. 여기서 나타나는 대표적 현상이 바로 gradient pathology 다.

이 글은 그 병목을 역사와 기술, 사례, 그리고 2026년 4월 16일 현재의 해법 지형까지 한 번에 연결해 설명한다. 출발점은 Lagaris (1998) 의 초기 아이디어이고, 대중적 전환점은 Raissi (2019) 다. 그리고 이 열광을 차갑게 다시 읽게 만든 계기가 2020년의 Understanding and Mitigating Gradient Pathologies in Physics-Informed Neural Networks 였다. 지금 PINN을 이해하려면, 더 이상 “물리를 넣었다”는 선언만으로는 부족하다. 그 물리가 optimizer에게 어떤 기하를 강요하는지 를 봐야 한다.

PINN의 매력은 사실 매우 직관적이다. 과학과 공학의 많은 문제는 “데이터는 적고, 구조는 많다”는 형태를 가진다. 유체, 열전달, 전자기, 재료, 생체 시스템 모두 그렇다. 순수 딥러닝은 데이터가 충분할 때 강하고, 고전 수치해석은 방정식이 분명할 때 강하다. PINN은 그 둘을 접합하려 했다.

이 계보는 보통 2019년에서 시작하지만, 씨앗은 더 오래됐다. Lagaris, Likas, Fotiadis의 1998년 논문 Artificial Neural Networks for Solving Ordinary and Partial Differential Equations 는 신경망 출력이 경계조건을 만족하도록 trial solution을 설계하고, 그 위에서 미분방정식 잔차를 줄이는 접근을 제시했다. 당시에는 자동미분, GPU, 대규모 최적화 도구가 지금처럼 성숙하지 않았기에 널리 확장되지는 못했지만, “신경망으로 PDE를 직접 푼다”는 생각 자체는 이미 그때 나와 있었다.

이 아이디어가 본격적으로 대중화된 것은 Raissi, Perdikaris, Karniadakis의 2019년 논문 Physics-informed neural networks: A deep learning framework for solving forward and inverse problems involving nonlinear partial differential equations 이후였다. 자동미분이 딥러닝 프레임워크의 기본 기능이 되면서, , , 같은 미분 항을 별도 이산화 없이 바로 계산할 수 있게 됐다. forward problem과 inverse problem을 같은 틀 안에 놓을 수 있다는 메시지도 강했다.

초기의 기대는 충분히 설득력 있었다.

이 약속은 2026년 현재도 완전히 폐기된 것이 아니다. 다만 이제는 조건이 붙는다. 문제가 충분히 매끄럽고, 손실 설계가 잘 되어 있고, 제약이 적절히 다뤄지며, optimizer와 architecture가 문제 성격에 맞아야 한다 는 것이다. 바로 그 조건들이 어려웠기 때문에, PINN 연구사는 곧 “왜 이렇게 자주 실패하는가”를 해명하는 역사이기도 했다.

PINN을 과대평가하거나 과소평가하지 않으려면, 먼저 전통적 PDE 해법과 문제 정의가 어떻게 다른지 분명히 해야 한다. FDM, FEM, FVM은 기본적으로 이산화된 선형대수 문제를 푼다. 연속 문제를 격자나 요소, 체적으로 쪼개고, 국소 보존법칙이나 약형식을 사용해 큰 연립방정식으로 바꾼 뒤, 선형 혹은 비선형 해법으로 푼다.

반면 PINN은 보통 파라미터화된 함수 근사 문제를 최적화 문제로 푼다. 신경망 를 두고, collocation point에서 PDE 잔차와 경계조건, 초기조건, 데이터 적합을 동시에 최소화한다. 따라서 PINN의 핵심 난점은 이산화 오차보다 먼저 비선형 최적화의 난이도 로 나타난다.

| 축 | FDM / FEM / FVM | PINN |

|---|---|---|

| 문제 변환 | 연속 PDE를 이산 시스템으로 변환 | 연속 해를 신경망 함수로 파라미터화 |

| 주요 병목 | 메시 품질, 안정성, 선형계 해법, CFL/conditioning | 복합 손실의 최적화, gradient imbalance, 스펙트럴 바이어스 |

| 경계조건 처리 | 약형식, 수치 flux, basis 설계로 직접 반영 | soft penalty 혹은 hard constraint로 반영 |

| 정확도 보장 | 해석적 안정성·수렴성 이론이 비교적 풍부 | 문제별 편차가 크고 학습 성공 여부 의존적 |

| 강점 | forward solve에 매우 강함 | 역문제, 희소 데이터 결합, 미분가능 surrogate 구성에 유리 |

이 차이는 중요하다. FDM/FEM/FVM에서는 경계층이 생기거나 고주파 진동이 커지면 보통 메시 해상도, stabilization, preconditioner, basis enrichment 같은 대응을 생각한다. PINN에서는 같은 문제가 optimizer가 한 번의 update에서 무엇을 먼저 줄일지 결정하지 못하는 현상 으로 나타난다. 문제의 난점이 수학적으로는 같아 보여도, 계산적으로 마주치는 실패 양상은 다르다.

그래서 PINN은 “딥러닝 버전의 범용 PDE 솔버”라기보다, 최적화 기반 함수 근사기를 이용해 PDE 제약을 학습에 녹이는 도구 로 보는 편이 정확하다. 이 차이를 놓치면 왜 어떤 forward PDE에서는 전통 해법이 여전히 압도적이고, 왜 inverse problem에서는 PINN이 여전히 매력적인지 설명하기 어렵다.

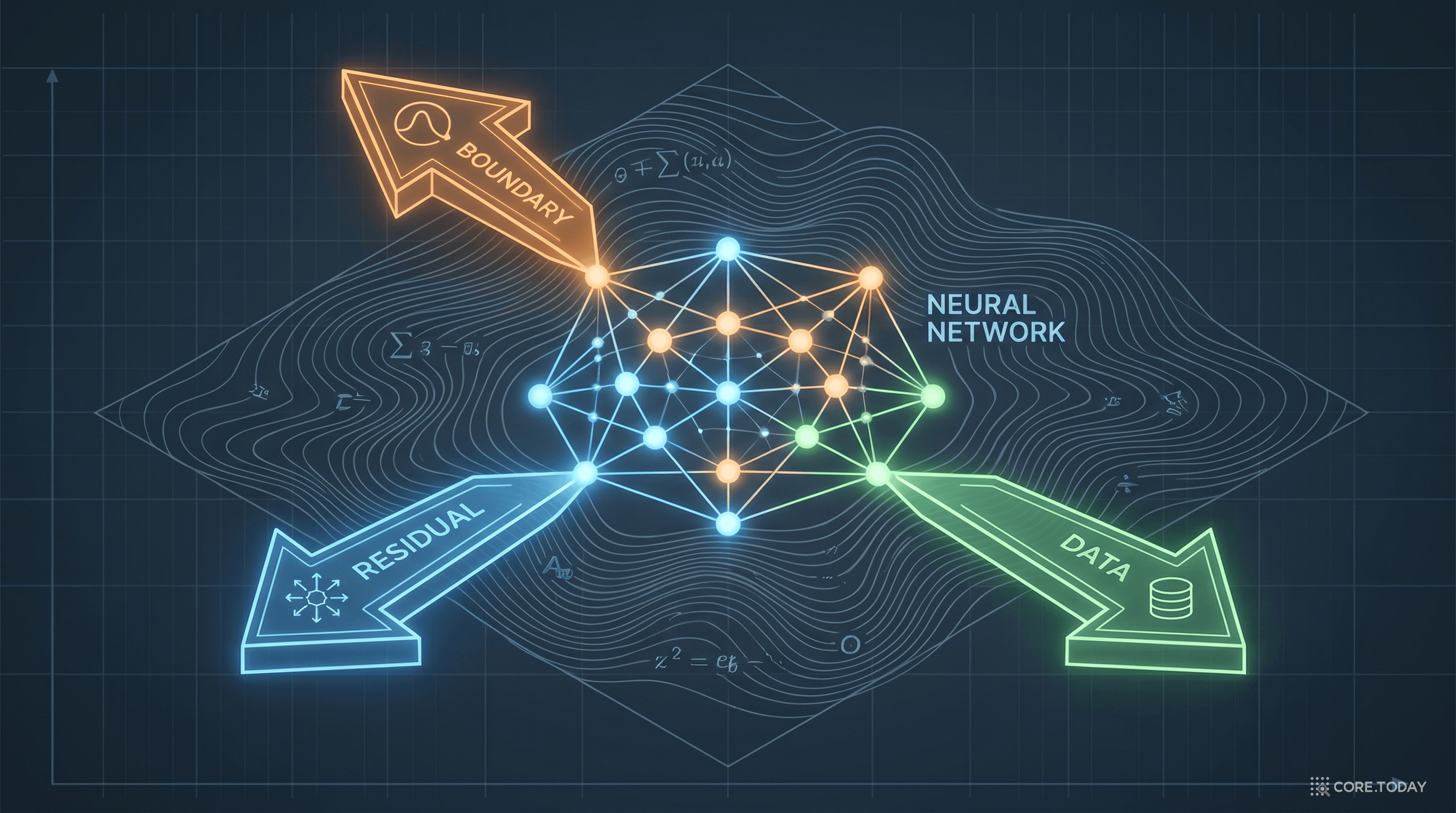

가장 표준적인 형태의 PINN은 다음과 같이 쓴다. 어떤 PDE가

를 만족한다고 하자. 신경망 를 두고, 총손실을

처럼 구성한다.

여기서

를 뜻한다.

문제는 이것이 “그냥 합”이 아니라는 데 있다. 표면적으로는 scalar loss의 합이지만, optimizer가 실제로 보는 것은 스칼라 값이 아니라 각 항이 만들어내는 파라미터 공간의 그래디언트와 곡률 이다. 즉,

이고, 각 벡터의 크기와 방향이 크게 다르면 “합”은 협력이 아니라 충돌이 된다.

특히 PDE residual은 자동미분으로 고차 미분을 반복 계산하는 경우가 많다. 같은 network라도 boundary loss는 저차 미분 혹은 함수값 자체에 민감하고, residual loss는 높은 미분 차수와 연산자 구조에 민감하다. 이 둘은 학습 중에 전혀 다른 주파수 대역을 본다. PINN의 기본기는 그래서 단순하지 않다. 손실항의 구성은 곧 학습 동역학의 설계 이다.

PINN이 실패하는 가장 전형적인 장면은 이렇다. 경계조건은 어느 정도 맞기 시작하는데 PDE residual이 줄지 않거나, residual을 세게 밀면 경계 오차가 다시 커진다. 데이터 적합은 좋아 보이는데 domain 전체 해는 틀린다. 총손실은 조금씩 내려가는데 상대 오차는 거의 개선되지 않는다. 이것이 composite loss conflict의 얼굴이다.

이 현상을 이해하려면 세 가지 표현을 구분해 두는 편이 좋다.

실제로는 이 셋이 따로 노는 경우보다 서로 겹쳐서 나타난다. 예를 들어 Burgers 방정식에서는 shock 전구간을 잘 표현하려면 저주파 근사만으로는 부족한데, PINN의 기본 MLP는 저주파를 먼저 학습하는 spectral bias를 가진다. 반면 Helmholtz 같은 고주파 PDE에서는 residual 항이 고진동 모드를 강하게 요구한다. 경계조건 손실은 비교적 빨리 낮아지더라도, residual 쪽 gradient는 훨씬 작거나 불안정하게 나타나기 쉽다. 이때 총손실은 줄어도 물리적으로 중요한 모드는 학습되지 않는다.

boundary-layer가 있는 문제도 마찬가지다. 해의 대부분 영역은 완만하지만, 얇은 층에서 급격한 변화가 일어난다. 균일 샘플링과 vanilla PINN으로는 그 얇은 구간이 손실 평균에서 희석되기 쉽고, optimizer는 “평균적으로 무난한 함수”를 선호한다. 그러나 PDE는 평균적으로 그럴듯한 해가 아니라, 어려운 구간까지 맞는 해 를 요구한다.

결국 “손실은 왜 서로 싸우는가”에 대한 짧은 답은 이것이다. 각 손실 항이 서로 다른 함수 공간의 결함을 보고 있고, 네트워크와 optimizer가 그 결함을 같은 속도와 같은 방향으로 고칠 수 없기 때문 이다.

이 문제를 가장 선명하게 정식화한 것이 Wang, Teng, Perdikaris의 2020년 논문 Understanding and Mitigating Gradient Pathologies in Physics-Informed Neural Networks 다. 후속 저널판에서는 제목이 Understanding and mitigating gradient flow pathologies in physics-informed neural networks 로 다듬어졌지만, 현장에서 널리 회자된 문제의식은 2020년 preprint 제목 그대로 기억되는 편이다.

이 논문에서 말하는 gradient pathology는 단순히 “gradient가 작다”는 뜻이 아니다. 핵심은 soft penalty로 합쳐진 여러 손실 항의 back-propagated gradients가 심하게 불균형해지고, 그 결과 numerical stiffness가 발생한다 는 것이다. 어떤 항은 파라미터 업데이트를 거의 혼자 끌고 가고, 어떤 항은 의미 있는 학습 신호를 전달하지 못한다. 결국 composite loss의 일부는 사실상 mute되고, 일부는 과도하게 dominant해진다.

논문이 강조한 관찰은 다음과 같다.

여기서 “stiffness”는 PINN 바깥의 수치해석 용어와도 연결된다. ODE/PDE에서 stiff system은 서로 다른 시간 척도가 공존해 안정적 적분이 어려운 경우를 뜻한다. PINN에서는 같은 아이디어가 최적화의 시간 척도 차이 로 나타난다. 어떤 손실 성분은 빠르게 줄고, 어떤 성분은 거의 움직이지 않는다. 그래서 gradient pathology는 비유가 아니라, 실제로 수치적 stiffness가 학습으로 번역된 현상 이라고 보는 편이 정확하다.

이 논문의 실천적 제안 중 가장 널리 알려진 것이 learning rate annealing이다. 다만 이름만 보고 일반적인 optimizer의 global learning rate schedule 을 떠올리면 오해가 생긴다. PINN 문맥에서 더 핵심적인 역할은 gradient 통계를 바탕으로 손실 항들의 상대적 영향력을 다시 맞추는 adaptive balancing 에 가깝다.

Wang/Teng/Perdikaris의 아이디어는 간단하다. PDE residual 항의 gradient 통계와 boundary/initial/data 항의 gradient 통계를 비교하고, 그 비율을 바탕으로 각 항의 손실 가중을 동적으로 조절한다. 논문은 특히 residual gradient의 최대 크기와 다른 손실 항 gradient의 대표 통계를 비교해 moving average 방식으로 보정한다. 목적은 하나다. 지배적인 손실 항이 update를 독식하지 못하게 하고, 약한 손실 항도 optimizer가 실제로 들을 수 있는 크기로 키우는 것 이다.

중요한 점은 이것이 문제를 “해결”한다기보다, 병목의 종류를 바꿔 준다 는 데 있다.

대신 composite loss에서 발생하는 극단적 불균형을 줄여, optimizer가 여러 제약을 동시에 조금 더 공정하게 보게 만든다. 그래서 Burgers나 경계층 문제처럼 한쪽 항이 빨리 내려가고 다른 쪽이 질식하던 경우, 학습이 아예 멈추는 것을 완화할 수 있다. 반면 Helmholtz처럼 고주파 표현 자체가 매우 어려운 경우에는, annealing만으로 충분하지 않은 일이 많다.

요약하면 learning rate annealing이 고치는 것은 “정답 함수”가 아니라 업데이트의 정치학 이다. PINN의 각 손실 항이 optimizer 회의실에서 낼 수 있는 목소리의 크기를 다시 조절하는 셈이다.

Wang/Teng/Perdikaris 논문은 optimizer와 weighting만 이야기하지 않았다. 같은 논문은 gradient pathology에 더 견디는 네트워크 구조 가 필요하다는 점도 함께 제기했다. 이 대목은 종종 과소평가되지만 중요하다. 손실 항이 아무리 잘 재가중되어도, 네트워크가 요구되는 주파수나 급경사를 표현하기 어려우면 문제는 다시 돌아오기 때문이다.

여기서 조심할 점이 있다. “좋은 architecture 하나를 고르면 PINN 문제가 사라진다”는 식으로 읽으면 곤란하다. 2026년 현재까지의 문헌은 오히려 반대의 메시지를 준다. architecture는 중요하지만, optimizer·sampling·constraint handling·domain split을 대체하지는 못한다.

그래도 architecture가 실질적으로 영향을 주는 구간은 분명하다.

그래서 이후 계보에서는 residual connection, multiplicative skip, Fourier feature, SIREN 계열, 문제 구조를 반영한 hard constraint parameterization, 심지어 domain-wise subnetwork까지 다양한 구조 개선이 시도됐다. 대표적으로 Wang et al.의 On the eigenvector bias of Fourier feature networks: From regression to solving multi-scale PDEs with physics-informed neural networks 는 multi-scale PDE에서 Fourier feature 기반 좌표 임베딩이 왜 도움이 되는지 설명했고, Sitzmann et al.의 Implicit Neural Representations with Periodic Activation Functions 는 주기 활성화가 도함수 표현과 고주파 신호 재현에 왜 유리한지 보여 줬다. 핵심은 늘 같다. optimizer가 볼 수 있는 해의 좌표계를 조금 더 잘 만든다 는 것이다. architecture는 만병통치약이 아니라, 손실 기하를 덜 적대적으로 만드는 도구다.

문헌에서 이 문제가 반복적으로 드러난 대표 사례는 네 가지다.

Burgers는 PINN 논문에서 거의 교과서처럼 등장하지만, 바로 그래서 함정이 있다. 낮은 점성에서는 shock-like steep gradient가 나타나고, 해가 매끄럽지 않은 쪽으로 기울기 시작한다. vanilla PINN은 전체적으로 매끈한 함수를 선호해 shock 근방을 무디게 만드는 경우가 많다. 경계와 데이터는 얼추 맞는데 핵심 구조가 퍼져 버리는 식이다.

Helmholtz는 고주파 PINN의 취약점을 보여 주는 대표 문제다. 잔차를 줄이려면 빠르게 진동하는 공간 모드를 재현해야 하지만, 기본 MLP와 표준 학습은 이 모드를 늦게 배운다. 이때는 gradient imbalance 문제와 spectral bias 문제가 겹친다. 단순 weighting만으로는 부족하고, sampling, feature encoding, architecture 조정, domain decomposition이 동시에 필요해지는 일이 흔하다.

반응 지배 문제, singular perturbation, 경계층이 있는 유동은 평균적인 함수 근사로는 통과할 수 없다. 얇은 구간에서 매우 큰 변화가 일어나기 때문에, collocation sampling이 조금만 평범해도 손실 평균이 그 구간을 놓친다. optimizer는 넓은 영역의 쉬운 오차를 먼저 줄이는 쪽으로 가고, 정작 중요한 층은 끝까지 맞지 않는다. PINN이 “전체 loss는 낮은데 국소 구조는 틀린” 결과를 내기 쉬운 이유다.

흥미로운 점은 inverse problems에서는 이야기가 다소 달라진다는 것이다. forward solve만 놓고 보면 전통 FEM/FVM이 훨씬 강한 경우가 많다. 그러나 sparse sensor data와 PDE prior를 함께 써서 미지 파라미터를 추정하는 문제에서는 PINN이 여전히 경쟁력이 있다. 센서가 적고, 미분가능한 end-to-end 추정이 중요하며, forward solver를 매 반복마다 직접 돌리기 부담스러운 경우다. 2026년 현재도 vanilla PINN이 완전히 밀려나지 않은 이유가 여기에 있다.

2020년 이후 PINN 연구는 “gradient pathology”를 여러 층위에서 다시 설명하고 우회하는 계보로 전개됐다.

When and Why PINNs Fail to Train: A Neural Tangent Kernel Perspective 는 손실 항마다 수렴 속도가 다르게 나타나는 이유를 NTK 관점에서 해석했다. 요지는 boundary term, residual term, data term이 동일한 속도로 학습되지 않으며, 네트워크 폭이 커져도 이 불균형이 자동으로 사라지지 않는다는 것이다. gradient pathology가 현상 기술이라면, NTK 분석은 그것의 학습 동역학 버전 설명 에 가깝다.

여기에 2024년의 Challenges in Training PINNs: A Loss Landscape Perspective 가 한 층을 더 보탰다. 이 계보는 PINN의 실패를 단순한 local minima 문제가 아니라, differential operator가 유도하는 ill-conditioning과 near-zero loss 요구, 그리고 Hessian 스펙트럼 왜곡의 문제로 읽는다. 즉 gradient pathology와 NTK imbalance가 “보이는 현상”이라면, loss landscape 관점은 그 아래의 곡률 구조를 더 직접적으로 드러낸다.

learning rate annealing 이후에도 self-adaptive weighting, GradNorm류 조정, soft-attention weighting, residual-based adaptive refinement(RAR)와 결합된 재가중이 잇따랐다. 대표 사례로 McClenny와 Braga-Neto의 Self-Adaptive Physics-Informed Neural Networks using a Soft Attention Mechanism 는 collocation point별 가중을 학습하게 만들어 어려운 구간에 더 많은 최적화 자원을 쓰게 했다. 방향은 분명하다. 손실 항의 상대 중요도를 고정 상수로 두지 말고, 학습 중 관측되는 난이도와 gradient 통계에 따라 바꾸자 는 것이다. 다만 어떤 weighting도 만능은 아니며, 잘못 쓰면 오히려 특정 제약을 잊게 만들 수 있다.

경계조건과 보존법칙, 물리적 범위를 soft penalty가 아니라 parameterization 자체에 집어넣는 흐름도 강해졌다. 이는 PINN이 “위반하면 벌점을 받는 모델”에서 “아예 일부 위반은 할 수 없는 모델”로 가는 방향이다. 예를 들어 Sukumar와 Srivastava의 Exact imposition of boundary conditions with distance functions in physics-informed deep neural networks 는 거리 함수 기반 trial solution으로 경계조건을 정확히 집어넣는 대표적 접근이다. 특히 자유도 수를 줄이고 탐색 공간을 물리적으로 admissible한 부분으로 제한한다는 점에서, 단순 accuracy보다 optimization conditioning 개선에 기여하는 경우가 많다.

문제가 너무 크거나 너무 고주파이거나 서로 다른 regime이 공존할 때는 하나의 전역 네트워크로 버티기 어렵다. 그래서 subdomain별 네트워크를 두는 XPINNs, 보존량 연속성에 초점을 둔 cPINNs, 시간영역 분할 등이 중요해졌다. 대표적으로 Jagtap, Kharazmi, Karniadakis의 Conservative physics-informed neural networks on discrete domains for conservation laws 와 Jagtap, Karniadakis의 Extended physics-informed neural networks (XPINNs): A generalized space-time domain decomposition based deep learning framework for nonlinear partial differential equations 가 이 계열의 기준점 역할을 한다. 이는 고전 수치해석의 domain decomposition이 PINN으로 옮겨온 것으로 볼 수 있다. 전역적으로 하나의 손실을 모두 해결하려 하지 않고, 문제를 잘게 나눠 더 온건한 최적화 문제들로 바꾸는 것 이다.

또 하나의 큰 흐름은 “PINN이 모든 forward PDE를 직접 풀어야 하는가?”라는 반성이다. Fourier Neural Operator(FNO) 같은 neural operator는 파라미터화된 PDE family의 operator learning에 강점을 보였고, hybrid 방식은 기존 solver와 학습기를 결합하는 방향으로 진화했다. 이 흐름의 최신 예시 중 하나가 바로 NewPINNs 다.

2026년 1월 arXiv에 공개된 NewPINNs: Physics-Informing Neural Networks Using Conventional Solvers for Partial Differential Equations 는 residual-based loss engineering 대신, 기존 수치 솔버를 training loop 안에 직접 넣는 방식을 제안했다. 물리 enforcement를 자동미분 잔차에만 맡기지 않고, conventional solver의 안정성과 일관성을 활용해 standard PINN의 optimization pathology와 weighting 민감도를 완화하려는 방향이다. 이것은 “PINN을 버린다”기보다, PINN의 약한 부분을 수치해석 전통으로 다시 보강한다 는 신호에 가깝다.

2026년 4월 16일 현재, vanilla PINN의 위치를 한 문장으로 요약하면 이렇다. forward PDE solver로서의 범용성은 제한적이지만, inverse problem과 sparse-data scientific ML에서는 여전히 의미 있는 도구 다.

이 평가는 두 극단을 동시에 거부한다. 하나는 “PINN은 실패한 아이디어”라는 과도한 비관이고, 다른 하나는 “조금만 튜닝하면 모든 PDE를 neural network 하나로 풀 수 있다”는 낙관이다. 실제 문헌이 말하는 바는 더 실용적이다. 아래 정리는 단일 벤치마크의 계량 점수표가 아니라, 2026년 시점 문헌 전체를 종합한 literature-synthesis judgment 로 읽는 편이 맞다.

| 사용 맥락 | 2026년 해석 | 이유 |

|---|---|---|

| 범용 forward solver 대체 | 제한적 | 전통 solver가 안정성·정확도·계산 효율에서 여전히 우세한 경우가 많다. |

| 희소 센서 기반 inverse problem | 의미 있는 강점 유지 | PDE prior와 관측 데이터를 한 틀에서 묶는 장점이 여전히 크다. |

| solver와 결합된 hybrid scientific ML | 유망 | NewPINNs 같은 방향이 residual-only PINN의 병목을 완화하려 한다. |

| 고주파·stiff regime 단독 대응 | 신중 필요 | adaptive weighting, hard constraints, domain decomposition, architecture 보강이 사실상 전제되는 경우가 많다. |

실무적으로 보면 판단 기준은 더 단순하다.

이런 의미에서 PINN은 실패한 것이 아니라, 과장된 초기 약속에서 벗어나 제자리를 찾아가는 중 이라고 보는 편이 맞다. 2019년의 PINN은 “하나의 프레임워크가 forward와 inverse를 모두 바꿀 것”처럼 읽혔다. 2026년의 PINN은 훨씬 현실적이다. 문제에 따라 vanilla PINN, 강화된 PINN, operator model, solver-in-the-loop hybrid 중 무엇을 쓸지 구분하는 쪽으로 진화했다.

그리고 바로 이 맥락에서 gradient pathology 연구는 중요했다. 그것은 단지 “PINN이 어렵다”는 불평이 아니라, 왜 어려운지, 무엇을 손봐야 하는지, 어디까지는 되고 어디부터는 다른 도구가 필요한지 를 구체적으로 드러낸 분기점이었기 때문이다.