이미지 객체 인식 완전 가이드: 컴퓨터에게 '보는 법'을 가르친 25년 — 공장에서 자율주행까지

얼굴 검출에서 시작해 반도체 결함 검사까지 — 이미지 객체 인식의 역사, 네 가지 핵심 태스크, 그리고 제조·자동차·식품 산업에서의 실전 활용법을 풍부한 사례와 함께 완전 해설한다.

얼굴 검출에서 시작해 반도체 결함 검사까지 — 이미지 객체 인식의 역사, 네 가지 핵심 태스크, 그리고 제조·자동차·식품 산업에서의 실전 활용법을 풍부한 사례와 함께 완전 해설한다.

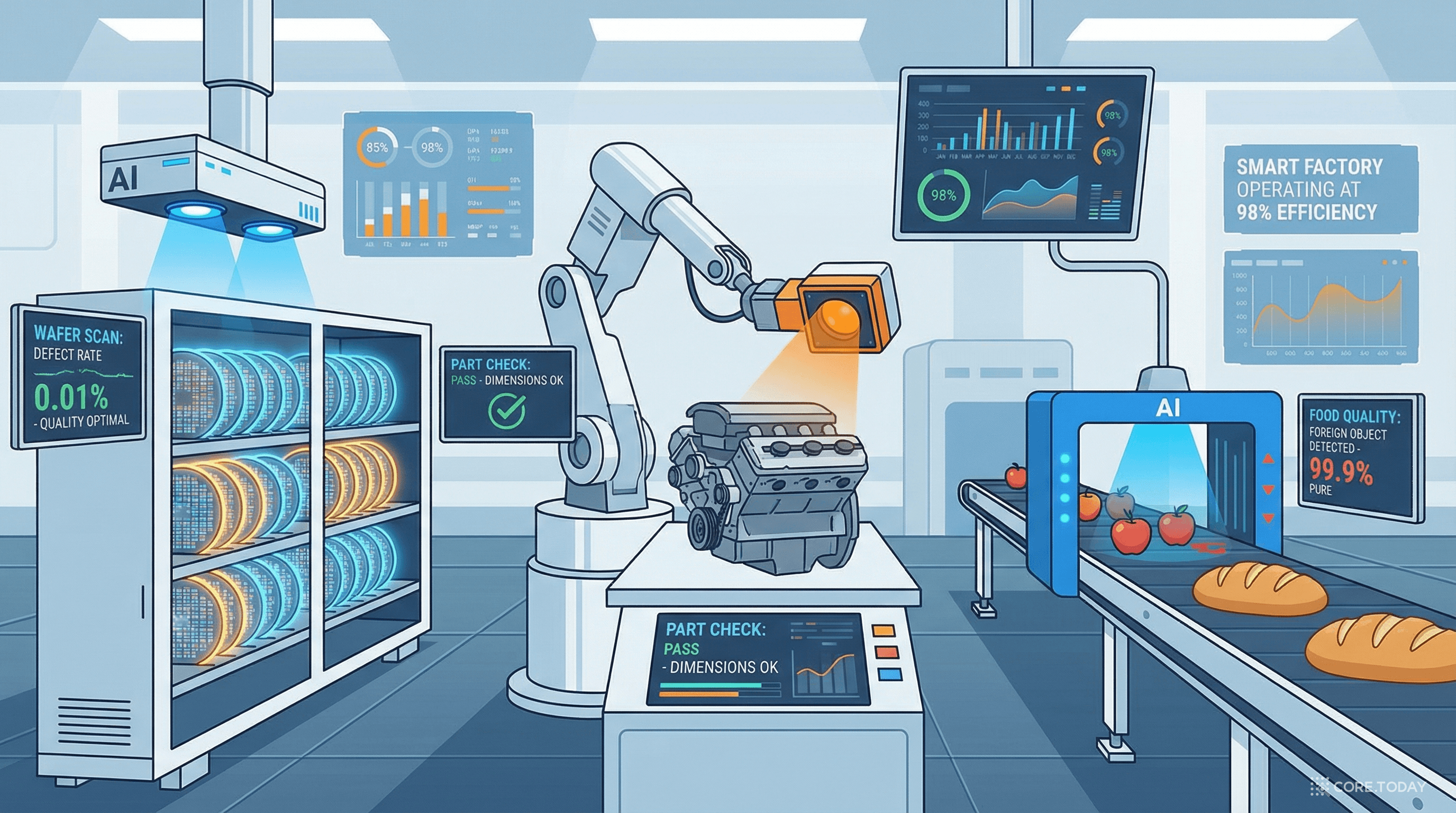

반도체 공장의 클린룸. 300mm 실리콘 웨이퍼 위에 나노미터 단위의 회로가 새겨져 있다. 이 웨이퍼 하나에 수백 개의 칩이 들어 있고, 각 칩에는 수십억 개의 트랜지스터가 있다. 이 중 단 하나의 미세 스크래치, 단 하나의 파티클 오염이라도 있으면 칩 전체가 불량이 된다.

과거에는 숙련된 검사원이 현미경으로 웨이퍼를 들여다보며 결함을 찾았다. 하지만 인간의 눈은 피로해지고, 집중력은 떨어지며, 나노미터 단위의 결함을 매번 정확히 잡아내는 것은 불가능에 가깝다. 하루에 수만 장의 웨이퍼가 생산되는 현대 팹(fab)에서, 인간 검사는 병목이자 리스크였다.

2026년 오늘, 이 검사를 하는 것은 AI다. 고해상도 카메라가 웨이퍼를 촬영하고, 딥러닝 기반 검출 모델이 밀리초 단위로 결함을 찾아내고 분류한다. 결함의 위치, 크기, 종류까지 자동으로 분석된다. 24시간 쉬지 않고, 피로하지 않으며, 99.9% 이상의 검출률로.

이것이 이미지 객체 인식(Image Object Recognition)의 산업적 힘이다.

이 글은 이미지 인식의 역사부터 핵심 개념, 그리고 제조·자동차·식품 산업에서의 실전 활용까지를 깊이 있게 다룬다. 특히 "우리 공장에 어떻게 적용할 수 있을까?"라는 실무적 질문에 답하는 데 초점을 맞춘다.

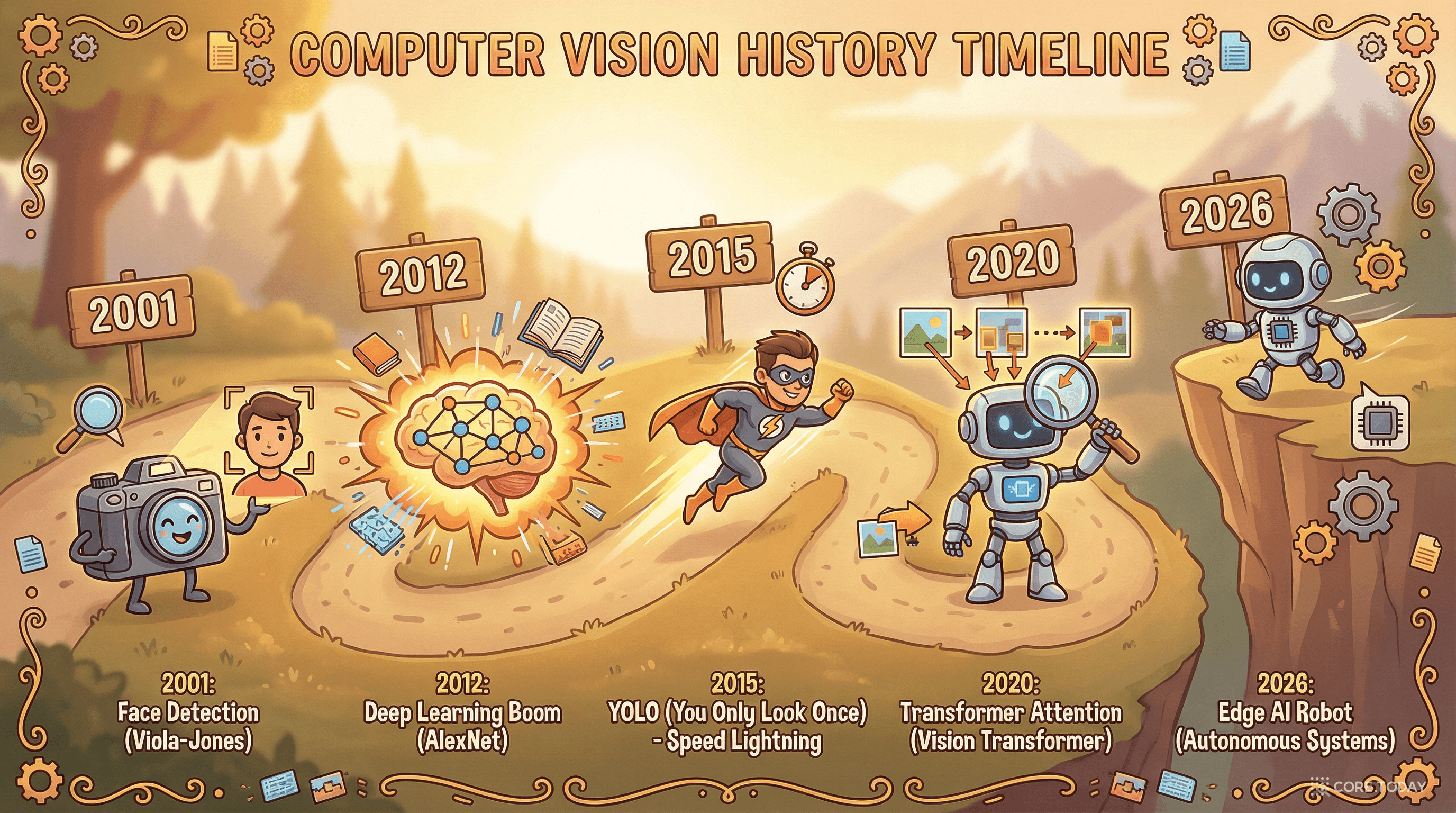

컴퓨터로 이미지에서 무언가를 "인식"하는 첫 번째 실용적 성공은 2001년 Viola-Jones 얼굴 검출기였다. 하르(Haar) 특징과 Adaboost 분류기를 계단식(cascade)으로 쌓아, 실시간으로 얼굴을 검출할 수 있게 된 것이다. 디지털 카메라의 "얼굴 인식 AF"가 바로 이 기술이다.

2005년, Dalal과 Triggs가 발표한 HOG(Histogram of Oriented Gradients)는 보행자 검출의 표준이 되었다. 이미지의 국소 영역에서 기울기 방향의 히스토그램을 추출하고, SVM으로 분류하는 방식이었다.

2010년, Felzenszwalb 등의 DPM(Deformable Parts Model)은 객체를 부분(parts)으로 나누어 검출하는 방식으로, Pascal VOC 대회를 지배했다.

이 시대의 공통점은 수작업 특징(hand-crafted features)에 의존했다는 것이다. 인간이 "이 패턴이 자동차다"라는 규칙을 직접 설계해야 했다. 새로운 객체를 인식하려면 새로운 규칙을 만들어야 했고, 조건이 바뀌면(조명, 각도, 크기) 규칙이 무너졌다.

2012년은 분수령이다. Alex Krizhevsky의 AlexNet이 ImageNet 대회에서 2위와 10.8%p 격차로 우승하면서, CNN(합성곱 신경망)이 수작업 특징을 완전히 대체할 수 있음을 증명했다. 기계가 스스로 "무엇이 중요한 특징인지" 학습하게 된 것이다.

이후 폭발적인 발전이 이어졌다.

| 연도 | 이정표 | 핵심 혁신 |

|---|---|---|

| 2012 | AlexNet | CNN이 ImageNet 우승, 딥러닝 혁명 시작 |

| 2014 | R-CNN | 영역 제안 + CNN = 객체 검출의 새 표준 |

| 2015 | ResNet | 152층 네트워크, 잔차 연결로 깊이의 한계 돌파 |

| 2015 | YOLO | 검출을 회귀 문제로 재정의, 실시간의 시작 |

| 2017 | Mask R-CNN | 검출 + 인스턴스 분할을 동시에 |

| 2019 | EfficientNet | Compound Scaling으로 효율 혁명 |

2020년 DETR이 트랜스포머를 객체 검출에 도입하면서 패러다임이 다시 바뀌었다. 앵커 박스, NMS 등 수작업 구성요소를 완전히 제거하고, 엔드투엔드 검출을 실현했다.

| 연도 | 이정표 | 핵심 혁신 |

|---|---|---|

| 2020 | DETR | 트랜스포머로 NMS 제거, 엔드투엔드 |

| 2024 | RT-DETR | 실시간 트랜스포머 검출, YOLO 능가 |

| 2024 | D-FINE | 좌표 대신 확률 분포 정제 |

| 2025 | RT-DETRv4 | VFM 증류, 추론비용 0 |

| 2026 | DEIMv2 | DINOv3 직접 통합, 8스케일 프레임워크 |

| 2026 | EdgeCrafter | 태스크 특화 증류, 소형 ViT 엣지 배포 |

2026년 현재, 최고 성능의 실시간 검출기는 COCO 데이터셋에서 57.9% AP를 달성한다. 10년 전만 해도 상상하기 어려운 수치다. 그리고 이 기술이 가장 빛나는 곳은 산업 현장이다.

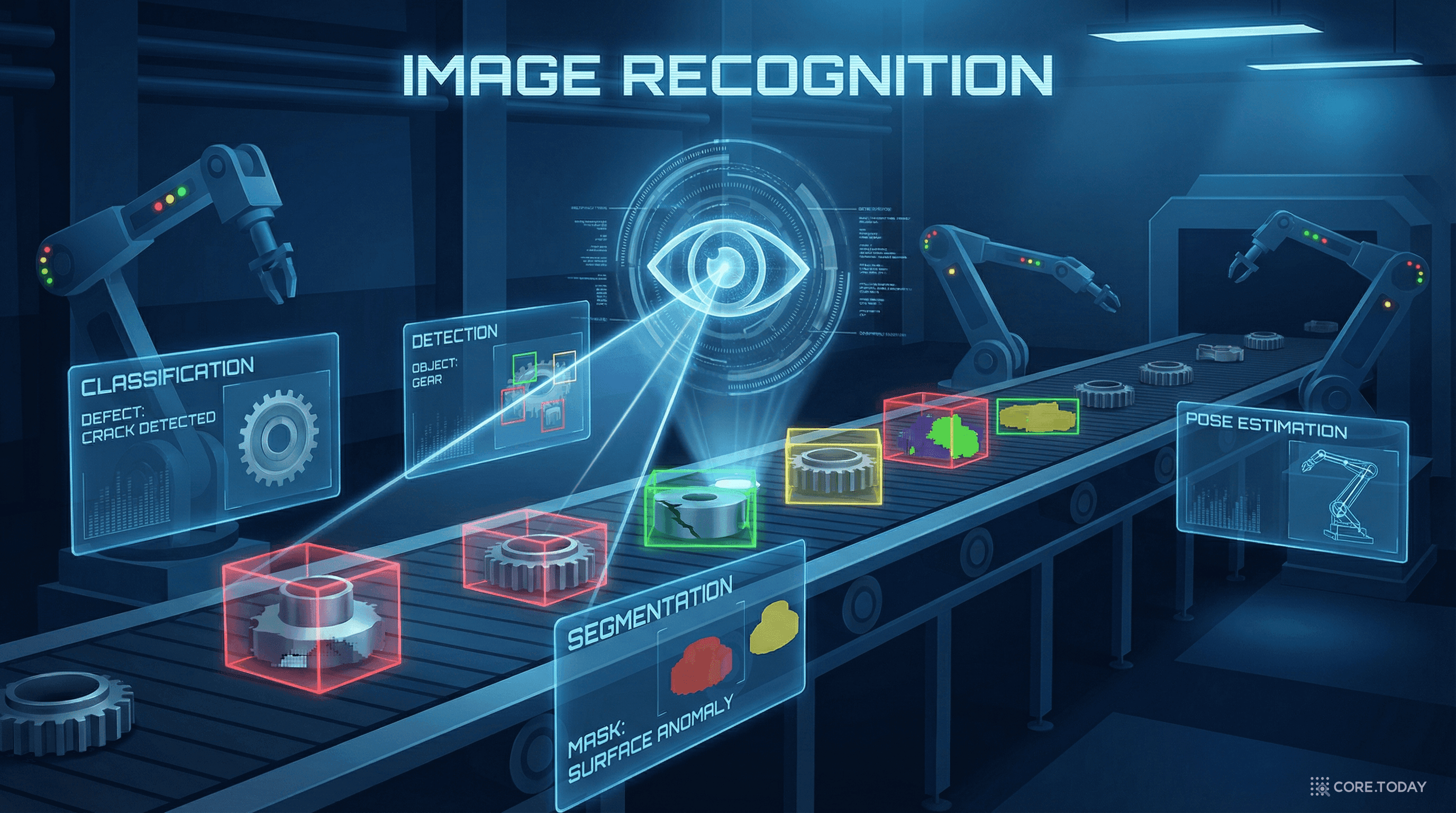

컴퓨터 비전의 밀집 예측(dense prediction) 과제는 크게 네 가지로 나뉜다. 각각이 다른 질문에 답한다.

질문: "이 이미지는 무엇인가?"

입력은 이미지 한 장, 출력은 라벨 하나. "이 사진은 고양이다", "이 X-ray는 정상이다", "이 제품은 불량이다."

산업 활용: 제품 양/불 판정, 부품 종류 식별, 문서 분류

대표 모델: AlexNet → VGG → ResNet → EfficientNet → ViT

가장 단순하지만, 가장 기본적인 태스크다. "어디에 뭐가 있는지"는 알 수 없고, 이미지 전체를 하나의 라벨로 분류한다.

질문: "무엇이, 어디에 있는가?"

입력은 이미지, 출력은 여러 개의 바운딩 박스 + 클래스 라벨 + 신뢰도 점수. 이미지 안의 모든 관심 객체를 찾아서, 각각에 네모 박스를 그리고 이름표를 붙인다.

산업 활용: 결함 위치 검출, 이물질 검출, 부품 누락 검사

대표 모델: R-CNN → YOLO → RT-DETR → D-FINE → DEIMv2 → EdgeCrafter

분류와의 핵심 차이: "어디에"를 알 수 있다. 결함이 웨이퍼의 어느 위치에 있는지, 컨베이어 벨트 위의 어느 제품에 이물질이 있는지를 특정할 수 있다.

질문: "어떤 픽셀이 어떤 객체에 속하는가?"

입력은 이미지, 출력은 객체별 픽셀 마스크. 바운딩 박스가 아닌, 객체의 정확한 윤곽을 픽셀 단위로 추출한다.

산업 활용: 결함 면적 측정, 도장 품질 영역 분석, 종양 경계 추출

대표 모델: Mask R-CNN → SAM → RF-DETR-Seg → EdgeCrafter ECInsSeg

검출과의 핵심 차이: "얼마나 넓은지"를 알 수 있다. 바운딩 박스는 직사각형이라 객체의 실제 형태를 반영하지 못하지만, 분할은 정확한 윤곽과 면적을 제공한다. 결함의 심각도를 면적으로 판단해야 하는 산업 검사에서 필수적이다.

질문: "관절(키포인트)이 어디에 있는가?"

입력은 이미지, 출력은 키포인트 좌표 + 스켈레톤 연결. 사람의 머리, 어깨, 팔꿈치, 손목, 엉덩이, 무릎, 발목 등의 위치를 추출한다.

산업 활용: 작업자 자세 분석, 인체공학적 위험 감지, 스포츠 모션 분석

대표 모델: OpenPose → ViTPose → YOLO-Pose → EdgeCrafter ECPose

| 산업 니즈 | 적합한 태스크 | 이유 |

|---|---|---|

| "이 제품이 양품인지 불량인지만 알면 돼" | 분류 | 위치 불필요, 판정만 필요 |

| "어디에 결함이 있는지 위치를 알아야 해" | 검출 | 바운딩 박스로 위치 특정 |

| "결함의 면적과 형태를 정확히 측정해야 해" | 분할 | 픽셀 단위 마스크 필요 |

| "작업자의 동작과 자세를 분석해야 해" | 포즈 추정 | 관절 위치 추적 필요 |

| "결함 위치 + 면적을 동시에 알아야 해" | 검출 + 분할 | EdgeCrafter 같은 멀티태스크 프레임워크 |

반도체 산업은 AI 비전 검사의 가장 앞선 적용 분야다. 회로의 선폭이 3nm까지 줄어든 2026년, 인간의 눈으로는 감지할 수 없는 결함을 AI가 찾아낸다.

실제 기업 사례:

자동차 제조에서 품질 검사는 안전과 직결된다. 용접 불량, 도장 결함, 조립 누락은 리콜과 사고로 이어질 수 있다.

실제 기업 사례:

식품과 의약품 산업에서 이물질 검출과 품질 검사는 소비자 안전과 직결된다.

실제 기업 사례:

AI 비전 검사 시스템의 경제적 효과는 명확하다.

| 지표 | 수치 | 출처 |

|---|---|---|

| 평균 투자 회수 기간 | 6~18개월 | Forrester |

| 3년 평균 ROI | 374% | Forrester |

| 라인별 연간 인건비 절감 | 약 $691,200 | 업계 평균 |

| 제조업 AI 시장 (2030) | $1,550억 | CAGR 35.3% |

| AI 비전 검사 시장 (2033) | $897억 | CAGR 19.6% |

| 산업 | 활용 사례 | 태스크 | 핵심 이점 |

|---|---|---|---|

| 철강 | 표면 결함 검출 (스크래치, 스케일, 크랙) | 검출 + 분할 | 연속 생산 라인에서 실시간 검사 |

| 섬유 | 직물 결함 검출 (올 빠짐, 얼룩, 구멍) | 분할 | 고속 직조기에서 미세 결함 포착 |

| 태양광 | 셀 크랙·핫스팟 검출 | 검출 | EL(전계발광) 이미지 분석 |

| 배터리 | 전극 코팅 불량, 이물질 검출 | 검출 + 분할 | EV 배터리 안전성 확보 |

| 물류 | 패키지 손상 검출, 라벨 인식 | 검출 + 분류 | 자동 분류 시스템 통합 |

가장 중요한 첫 단계는 "무엇을 검출/분류/측정하고 싶은가?"를 명확히 하는 것이다.

AI 비전 시스템의 성능은 데이터의 질과 양에 직접적으로 의존한다.

일반적 기준:

2026년 기준, 산업용으로 추천되는 모델 아키텍처:

| 시나리오 | 추천 모델 | 이유 |

|---|---|---|

| GPU 서버 배포 (최고 정확도) | DEIMv2-X / ECDet-X | 57.8~57.9% AP, ViT 백본 |

| 엣지 디바이스 (균형) | ECDet-S / DEIMv2-S | 50~51% AP, 10M 파라미터 |

| 멀티태스크 필요 | EdgeCrafter | 검출+분할+포즈를 하나의 백본으로 |

| 초경량 (모바일/IoT) | DEIMv2-Pico/Atto | 0.5~1.5M 파라미터 |

| 배포 비용 최소화 | 기존 D-FINE + RT-DETRv4 증류 | 아키텍처 변경 없이 성능 향상 |

핵심 메트릭:

산업 기준:

DINOv3, SAM2 같은 VFM이 산업 비전에 본격적으로 활용되고 있다. RT-DETRv4의 증류 방식이나 DEIMv2/EdgeCrafter의 직접 통합 방식으로, 대규모 데이터 없이도 높은 성능을 달성할 수 있게 되었다. 특히 결함 이미지가 희소한 산업 환경에서, VFM의 전이 학습은 "적은 데이터로 높은 성능"이라는 핵심 난제를 해결하는 열쇠가 되고 있다.

EdgeCrafter와 DEIMv2의 초경량 모델(0.49~10M 파라미터)은 카메라 자체에 AI를 내장하는 것을 가능하게 한다. 서버에 이미지를 전송할 필요 없이, 촬영 즉시 검사가 완료된다. 네트워크 지연 제거, 데이터 보안 강화, 대역폭 절약이라는 세 가지 이점을 동시에 제공한다.

EdgeCrafter가 보여준 것처럼, 하나의 백본으로 검출 + 분할 + 포즈를 동시에 수행하는 것이 가능해졌다. 하나의 카메라 시스템이 결함 검출, 면적 측정, 작업자 안전 모니터링을 동시에 수행하는 시대가 열리고 있다.

AI 비전으로 검출된 결함 데이터가 디지털 트윈(Digital Twin) 시스템에 실시간으로 반영되어, 공정 최적화와 예측 유지보수에 활용되고 있다. 검출은 시작일 뿐, 데이터가 만드는 공정 인텔리전스가 진정한 가치다.

25년 전, Viola-Jones 알고리즘이 처음으로 카메라에서 얼굴을 찾았을 때, 그것은 놀라운 성취였다. 오늘, AI는 나노미터 크기의 반도체 결함을 밀리초 만에 찾아내고, 시속 200km로 달리는 차의 보행자를 실시간으로 검출하며, 0.49M 파라미터의 초소형 모델로 스마트 카메라에서 동작한다.

이 글에서 살펴본 것처럼, 이미지 객체 인식은 더 이상 "연구 주제"가 아니다. 반도체 공장의 수율을 결정하고, 자동차의 안전을 보장하고, 식품의 위생을 지키는 산업의 핵심 기술이다.

그리고 기술은 계속 진화하고 있다. YOLO에서 시작된 실시간 검출은 RT-DETR, D-FINE, DEIMv2를 거쳐 EdgeCrafter에 이르렀고, VFM 시대와 엣지 AI의 결합은 "모든 곳에 AI의 눈"이라는 비전을 현실로 만들고 있다.

당신의 공장, 당신의 제품 라인, 당신의 품질 관리 시스템에 이 기술을 어떻게 적용할 수 있을지 — 그 첫걸음을 이 글이 도울 수 있기를 바란다. 기술은 준비되어 있다. 이제 적용할 차례다.