PINN vs Neural Operator vs KAN — 물리 시뮬레이션을 대체할 AI는 누구인가

편미분방정식(PDE)을 풀기 위한 세 가지 AI 패러다임 — 물리법칙을 손실함수에 넣는 PINN, 함수 공간 간의 매핑을 학습하는 Neural Operator, 해석 가능한 스플라인 엣지를 학습하는 KAN — 을 원리·벤치마크·한계·산업 적용까지 깊이 비교합니다.

편미분방정식(PDE)을 풀기 위한 세 가지 AI 패러다임 — 물리법칙을 손실함수에 넣는 PINN, 함수 공간 간의 매핑을 학습하는 Neural Operator, 해석 가능한 스플라인 엣지를 학습하는 KAN — 을 원리·벤치마크·한계·산업 적용까지 깊이 비교합니다.

2019년, 한 편의 논문이 계산물리학의 풍경을 바꿔놓았습니다. 브라운 대학교의 Maziar Raissi, Paris Perdikaris, George Em Karniadakis — 이 세 사람이 Journal of Computational Physics에 발표한 Physics-Informed Neural Networks(PINN) 논문은, 신경망이 편미분방정식(PDE)을 "격자(mesh) 없이" 풀 수 있다는 가능성을 보여주었습니다.

1년 뒤인 2020년, 칼텍의 Zongyi Li 등이 Fourier Neural Operator(FNO)를 제안하면서 새로운 질문이 등장합니다: "한 번의 학습으로 모든 파라미터 조건의 해를 한꺼번에 배울 수는 없을까?" 2024년에는 MIT의 Ziming Liu 등이 KAN(Kolmogorov-Arnold Network)을 발표하며, "더 적은 파라미터로 더 높은 정확도와 해석 가능성"이라는 세 번째 선택지를 제시합니다.

이 글은 PINN, Neural Operator(FNO, DeepONet), KAN — 물리 시뮬레이션을 위한 세 가지 AI 패러다임을 원리, 벤치마크 수치, 한계, 실제 적용 사례까지 종합적으로 비교합니다.

신경망으로 미분방정식을 푸는 아이디어는 PINN보다 20년 앞서 있습니다. 1998년, 그리스 이오아니나 대학교의 Isaac Lagaris, Aristidis Likas, Dimitrios Fotiadis가 IEEE Transactions on Neural Networks에 발표한 논문이 최초입니다. 이들의 핵심 아이디어: 해를 경계조건을 만족하는 항 + 신경망이 학습하는 항의 합으로 표현한 것입니다.

그로부터 21년 뒤, Raissi 등의 2019년 논문이 이 아이디어를 현대 딥러닝 프레임워크 위에서 체계화합니다. 이 논문이 바로 PINN의 정식 탄생입니다.

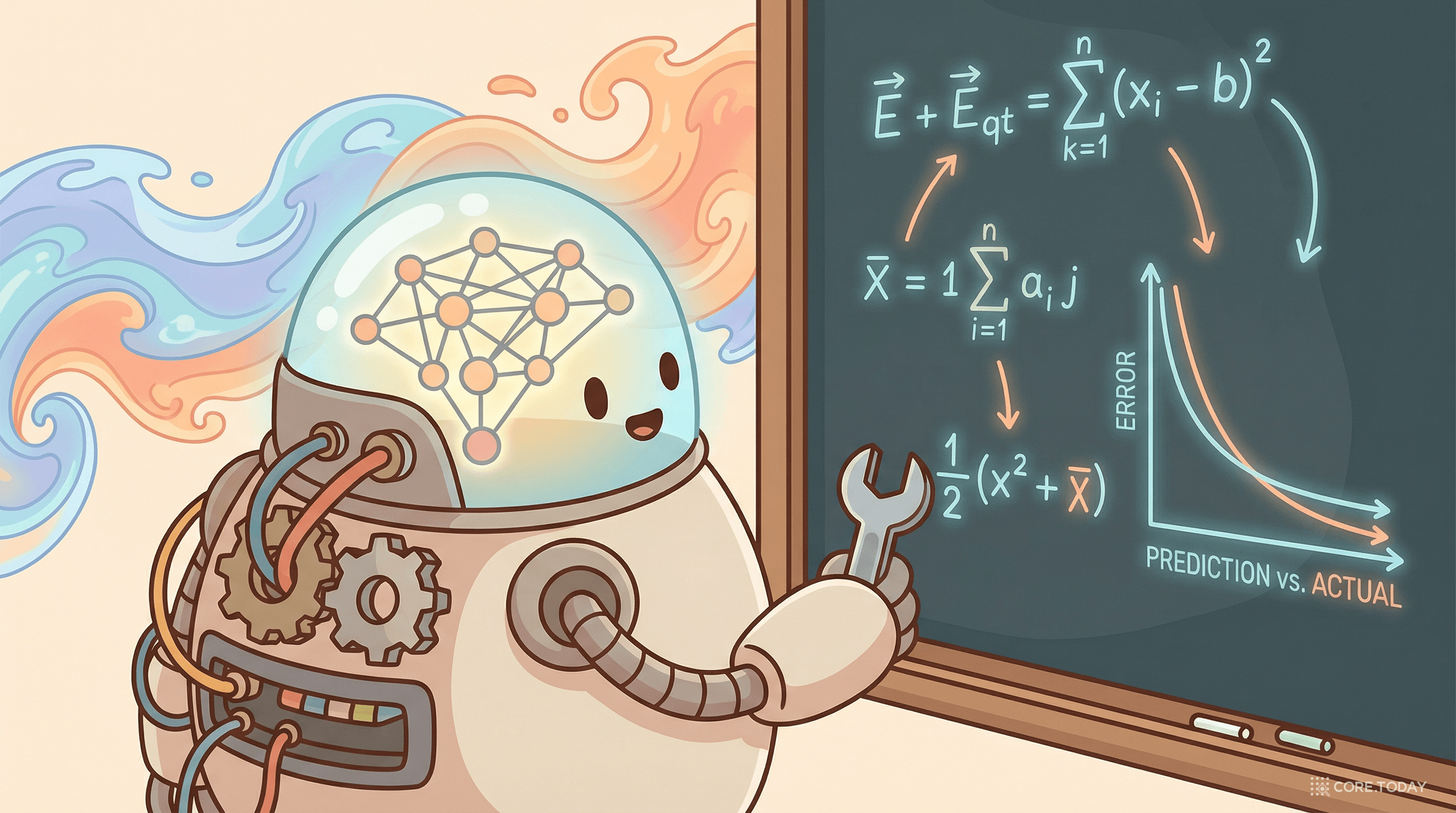

PINN의 핵심은 손실함수 설계에 있습니다. 일반적인 PDE를 이라 할 때:

자동 미분(autodiff)이 핵심 기술입니다. 신경망 의 편미분 , 등을 프레임워크가 자동으로 계산합니다. 유한차분법처럼 격자를 짤 필요가 없습니다 — 이것이 PINN이 메시 프리(mesh-free) 방법인 이유입니다.

Raissi 등은 여러 고전적 PDE에서 PINN의 성능을 검증했습니다:

| PDE | 상대 L2 오차 | 네트워크 구조 | 의미 |

|---|---|---|---|

| Burgers 방정식 | 1.97 × 10⁻³ | 8층, 뉴런 20개 | 충격파(shock) 포착 성공 |

| 비선형 Schrödinger 방정식 | 1.97 × 10⁻³ | 5층, 뉴런 100개 | 양자역학적 파동 재현 |

| Allen-Cahn 방정식 | 6.99 × 10⁻³ | 4층, 뉴런 200개 | 상전이 경계면 학습 |

| Navier-Stokes 방정식 | 4.9 × 10⁻⁴ | 8층, 뉴런 40개 | 비압축성 유체 유동 |

이 숫자들은 인상적이지만, 곧 밝혀지듯 특정 조건에서만 달성됩니다.

PINN의 실제 적용을 가로막는 문제들이 2020년 이후 속속 보고되었습니다:

1) 스펙트럴 바이어스(Spectral Bias)

신경망은 저주파 성분을 먼저 학습하고, 고주파 성분을 학습하는 데 극도로 느립니다. 난류, 충격파, 다중 스케일 현상에서 치명적입니다.

2) 손실 경관(Loss Landscape)의 병적 구조

PDE 잔차에 미분 연산자가 포함되면서, 손실 경관이 극도로 ill-conditioned해집니다. PDE 손실과 경계조건 손실의 수렴 속도 불균형이 발생하여 훈련이 정체됩니다.

3) 비선형·고주파·다중스케일 문제에서의 실패

PDE 계수가 커지거나, 비선형성이 강해지면 PINN의 수렴이 급격히 어려워집니다. 난류 유동(turbulent flow), 강성(stiff) PDE, 카오스 시스템에서 종종 수렴에 실패합니다.

PINN은 다음 영역에서 활발히 연구·적용되고 있습니다:

PINN의 근본적 한계 중 하나: 파라미터가 바뀔 때마다 처음부터 다시 훈련해야 합니다. 초기조건이 달라지면? 경계조건이 바뀌면? 새로운 PINN을 훈련해야 합니다.

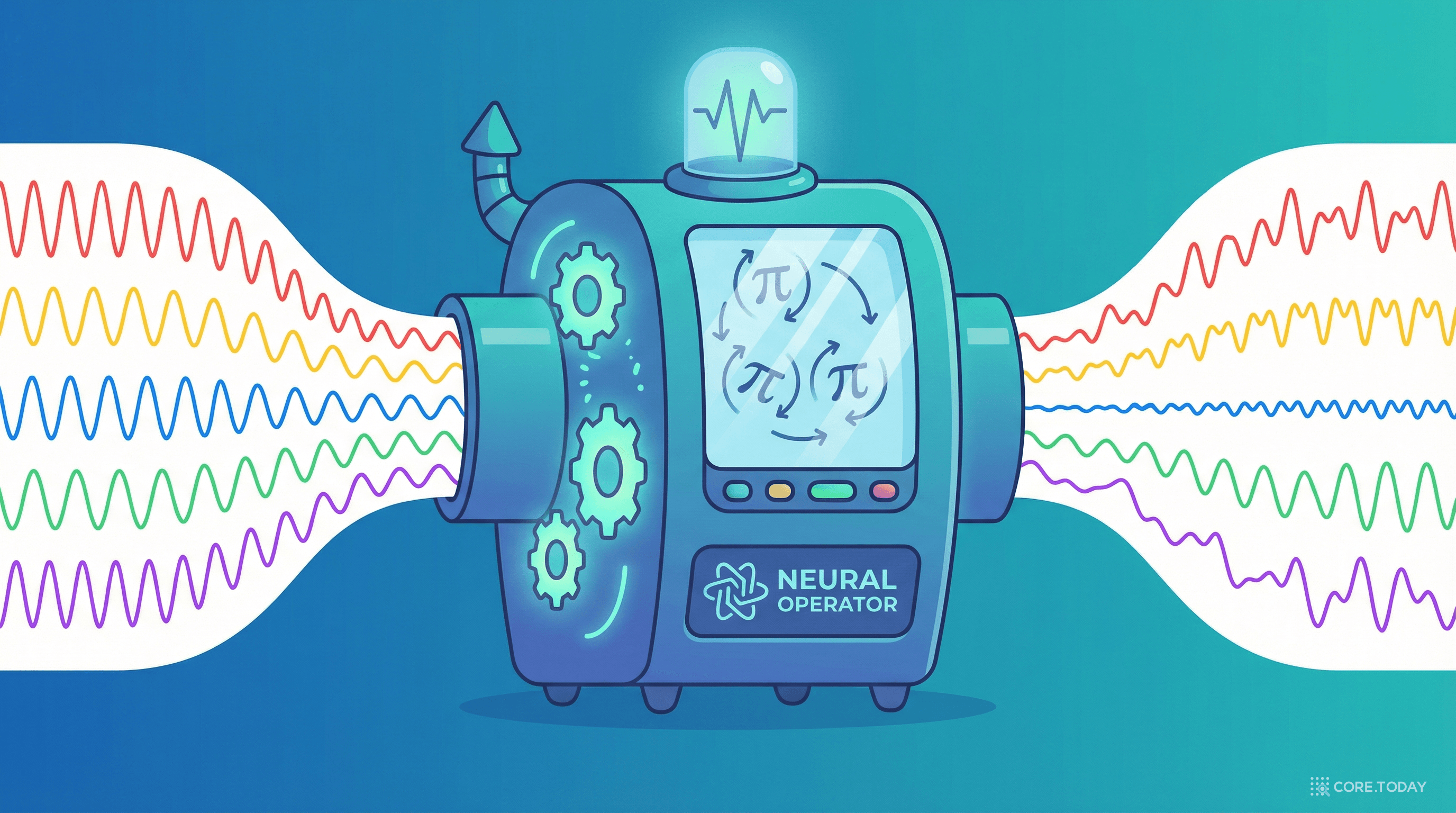

Neural Operator는 이 문제를 정면으로 해결합니다:

Fourier Neural Operator(FNO)는 2020년 10월 칼텍의 Zongyi Li, Nikola Kovachki, Kamyar Azizzadenesheli, Anima Anandkumar 등이 발표하고, ICLR 2021에 채택된 논문입니다.

핵심 아이디어: 적분 커널을 직접 푸리에 공간에서 파라미터화합니다. 이산화 방식에 무관하게 동일한 학습된 파라미터를 공유하므로, 훈련 해상도와 다른 해상도에서도 평가 가능합니다(zero-shot super-resolution).

| PDE / 설정 | ResNet | U-Net | TF-Net | FNO |

|---|---|---|---|---|

| Burgers (s=421) | — | — | — | 0.0098 |

| Darcy Flow (s=8192) | — | — | — | 0.0139 |

| Navier-Stokes (ν=10⁻³) | 0.0701 | 0.0245 | 0.0225 | 0.0086 |

| Navier-Stokes (ν=10⁻⁴) | 0.2311 | 0.1190 | 0.1168 | 0.0820 |

| Navier-Stokes (ν=10⁻⁵) | 0.2753 | 0.1982 | 0.2268 | 0.1556 |

기존 방법 대비: Burgers에서 30% 낮은 오차, Darcy Flow에서 60% 낮은 오차, Navier-Stokes 난류 영역에서 30% 낮은 오차. 추론 속도는 256×256 격자에서 0.005초 — 의사-스펙트럴 방법의 2.2초 대비 ~440배 빠릅니다.

DeepONet은 브라운 대학교의 Lu Lu, Pengzhan Jin, Guofei Pang, George Em Karniadakis 등이 2021년 Nature Machine Intelligence에 발표했습니다.

이론적 기반: 1995년 Tianping Chen & Hong Chen의 연산자의 범용 근사 정리(Universal Approximation Theorem of Operators) — 단일 은닉층 신경망으로 임의의 비선형 연속 연산자를 근사할 수 있다는 정리입니다.

Branch Network가 이산화된 입력 함수 공간을 인코딩하고, Trunk Network가 출력 함수의 도메인(좌표)을 인코딩합니다. 두 네트워크의 출력을 내적하면 원하는 위치에서의 해를 얻습니다.

Lu et al. (2022)은 Computer Methods in Applied Mechanics and Engineering에서 16개 벤치마크로 두 연산자를 공정 비교했습니다:

| 특성 | DeepONet | FNO |

|---|---|---|

| 단순 설정 성능 | 양호 | 양호 (동등) |

| 복잡 기하학 | 강건함 | 성능 저하 |

| 노이즈 민감도 | 0.1% 노이즈에도 안정적 | 0.1% 노이즈로 오차 10,000배 증가 |

| 이론적 근거 | 연산자의 범용 근사 정리 | 유사한 오차 한계 (동등) |

| 입력 유연성 | 비정형 격자 지원 | 정형(uniform) 격자 필요 |

핵심 발견: 단순한 문제에서는 FNO와 DeepONet이 비슷하지만, 복잡 기하학과 노이즈가 있는 환경에서 DeepONet이 훨씬 강건합니다.

2023~2025년 사이 Neural Operator 분야는 빠르게 진화했습니다:

| 모델 | 발표 | 핵심 혁신 | 성능 |

|---|---|---|---|

| GNOT | ICML 2023 | Heterogeneous Normalized Attention (HNA) — 선형 복잡도로 임의 입력 처리 | 유체·열·전자기 7개 데이터셋 SOTA |

| Transolver | ICLR 2024 | 학습 가능한 슬라이스(slice)로 물리적 상태 포착, 내재적 물리 상관관계 모델링 | 6개 벤치마크 일관된 SOTA |

| GINO | 2024 | Geometry-Informed Neural Operator — 비정형 격자와 비직사각형 도메인 | 복잡 기하학에서 FNO 대비 우위 |

| Neural Spectral Methods | ICLR 2024 | 직교 기저 기반 스펙트럼 손실, 파르세발 항등식 활용 | 기존 ML 방법 대비 정확도 1~2 자릿수 향상 |

Physics-Informed Neural Operator(PINO)는 훈련 데이터와 물리 제약을 동시에 활용합니다. 핵심 전략: 저해상도 훈련 데이터 + 고해상도 PDE 제약으로 연산자를 학습합니다.

PINO는 PINN이 실패하는 장시간 과도 유동(long temporal transient flow)과 카오스 콜모고로프 유동(chaotic Kolmogorov flow)에서 합리적인 정확도를 달성합니다. PINN과 달리, 한 번 학습 후 새로운 파라미터에 대해 즉시 추론이 가능하면서도 물리적 일관성을 유지합니다.

KAN의 핵심 특성이 과학 문제와 왜 잘 맞는지는 이전 글("콜모고로프-아르놀드 정리 완전 해부")에서 다뤘습니다. 여기서는 PDE 풀이에서의 성능에 집중합니다.

KAN이 과학 컴퓨팅에서 주목받는 세 가지 이유:

2024년 6월, Wang et al.은 KINN(Kolmogorov-Arnold-Informed Neural Network)을 제안했습니다 — PINN의 MLP를 KAN으로 대체하는 접근입니다. Computer Methods in Applied Mechanics and Engineering에 게재되었습니다.

테스트한 문제 유형: 다중스케일, 특이점(singularity), 응력 집중, 비선형 초탄성, 이종 재료, 복잡 기하학.

핵심 결과: KINN이 MLP 기반 PINN 대비 정확도와 수렴 속도에서 대부분 유의미하게 우수. 단, 복잡 기하학 문제는 예외.

2024년 11월, ChebPIKAN(Physics-informed Kolmogorov-Arnold Network with Chebyshev Polynomials)이 유체역학 문제에서 상세한 벤치마크를 제시했습니다 (NVIDIA RTX 4090, 10,000 에폭):

| PDE (최적 구조) | KAN 평균 잔차 | ChebPIKAN 평균 잔차 | 개선율 |

|---|---|---|---|

| Allen-Cahn (4층) | 6.14% | 0.34% | 18배 |

| Burgers (3층) | 13.67% | 1.13% | 12배 |

| Helmholtz (3층) | 29.90% | 4.29% | 7배 |

| Navier-Stokes 속도 u (2층) | 15.09% | 3.34% | 4.5배 |

| Navier-Stokes 속도 v (2층) | 38.39% | 8.46% | 4.5배 |

| Navier-Stokes 압력 p (2층) | 39.45% | 10.85% | 3.6배 |

주목할 점: KAN은 깊이가 증가하면 과적합과 불안정이 심해지는 반면, ChebPIKAN은 깊이 증가에도 안정적입니다. 그러나 2D 시간 의존 문제(Navier-Stokes)에서의 손실은 ~10⁻¹ 수준으로, 1D 문제의 ~10⁻³ 대비 아직 개선 여지가 큽니다.

Ziming Liu et al.의 "KAN 2.0: Kolmogorov-Arnold Networks Meet Science"(Physical Review X, 2024)는 KAN을 과학적 발견 도구로 확장했습니다:

이것이 KAN의 가장 독보적인 가치입니다: 단순히 PDE를 푸는 것을 넘어, 데이터에 숨겨진 물리 법칙 자체를 발견합니다.

| 기준 | PINN | Neural Operator (FNO/DeepONet) | KAN (KINN) |

|---|---|---|---|

| 학습 대상 | 특정 PDE의 해 | 함수→함수 연산자 | 특정 PDE의 해 (해석 가능한 형태) |

| 물리 반영 방식 | 손실함수에 PDE 잔차 포함 | 데이터에서 암묵적 학습 (PINO는 명시적) | 손실함수에 PDE 잔차 포함 (PINN과 동일) |

| 훈련 데이터 필요량 | 0 (순수 물리 기반 가능) | 대량 (수천~수만 시뮬레이션) | 0 (순수 물리 기반 가능) |

| 새 파라미터 일반화 | 재훈련 필요 | 즉시 추론 가능 | 재훈련 필요 |

| 해석 가능성 | 블랙박스 | 블랙박스 | 엣지 함수 시각화, 기호식 추출 가능 |

| 추론 속도 | 빠름 (단일 전방 패스) | 매우 빠름 (0.005초) | 보통 (스플라인 평가 오버헤드) |

단, 이 비교에는 중요한 맥락이 있습니다: PINN은 훈련 시간이 길지만 데이터가 불필요, FNO는 추론이 극빠르지만 대량의 훈련 데이터 생성 비용이 든다는 것입니다.

PINN은 단일 인스턴스에서는 매우 높은 정확도를 달성하지만, FNO는 파라미터가 변하는 모든 조건을 한 모델로 커버합니다. 사과와 오렌지를 비교하는 것이므로 주의가 필요합니다.

| 기준 | PINN | Neural Operator | KAN |

|---|---|---|---|

| 3D+ 확장 | collocation 포인트 폭증 → 느림 | 선형 스케일링 가능 | 스플라인 평가 비용 → 현재 2D까지 실용적 |

| 데이터 요구량 | 0개 (PDE만으로 충분) | 수천~수만 시뮬레이션 쌍 | 0개 (PDE만으로 충분) |

| 역문제(Inverse) | 자연스러운 지원 | 추가 설계 필요 | 자연스러운 지원 + 해석 가능 |

| 고차원 문제 | 차원의 저주 영향 | Separable 구조로 완화 | 차원의 저주 영향 심함 |

LoRA(Low-Rank Adaptation)는 Hu et al. (2021)이 제안한 파라미터 효율적 미세조정 기법입니다. 사전훈련된 모델의 가중치 행렬 를 고정하고, 저랭크 분해 (, , )만 학습합니다.

GPT-3 175B 기준: 전체 미세조정 대비 학습 파라미터 10,000배 감소, GPU 메모리 3배 절약.

과학 컴퓨팅에서 LoRA의 적용은 아직 초기 단계이지만, 강력한 잠재력이 있습니다:

흥미로운 연결: KAN의 B-스플라인 엣지 함수는 LoRA처럼 "기저 함수의 가중합"으로 표현됩니다. KAN에서 격자 확장(grid extension)은 LoRA에서 랭크(rank) 증가와 개념적으로 유사합니다 — 둘 다 표현력을 점진적으로 늘려가는 전략입니다.

이전 글("LoRA까지 이어지는 수학 여행")에서 범용 근사 정리 → 저랭크 근사의 수학적 맥락을 다뤘습니다. 이 맥락에서 KAN → LoRA → Neural Operator 적응은 하나의 수학적 연속선 위에 놓여 있습니다.

과학 AI의 가장 극적인 성공 사례는 기상 예측입니다:

| 모델 | 개발 | 핵심 수치 | 특이사항 |

|---|---|---|---|

| FourCastNet 3 | NVIDIA, 2024 | 60일 예보를 단일 GPU에서 4분 이내 | 구면 신경 연산자 기반, 확산 모델 대비 8~60배 빠름 |

| GenCast | DeepMind, 2024 | ECMWF ENS 대비 97.2% 높은 정확도 (15일 예보) | 확률적 앙상블 예측, 8분 만에 15일 예보, Nature 게재 |

| Aurora | Microsoft, 2025 | IFS 대비 ~5,000배 연산 비용 절감 | 100만 시간 이상 지구물리 데이터로 사전훈련, Nature 게재 |

이 모델들의 공통점: Neural Operator 아키텍처 + 대규모 사전훈련 + 파운데이션 모델 패러다임. FourCastNet은 AFNO(Adaptive Fourier Neural Operator) 기반이고, Aurora는 트랜스포머 기반이며, GenCast는 확산 모델 기반입니다.

2024년 NeurIPS에서 발표된 Poseidon은 PDE 풀이 전용 파운데이션 모델입니다. 압축성 오일러 방정식과 비압축성 Navier-Stokes 방정식으로 사전훈련한 뒤, 다양한 하류 PDE 작업에 적응합니다.

모델 규모: Poseidon-T(21M), Poseidon-B(158M), Poseidon-L(629M) 파라미터. 15개 하류 작업 중 13개에서 FNO 대비 10배 이상 적은 샘플로 동일 오차 달성. 사전훈련에 없던 완전히 새로운 PDE(파동 방정식, Allen-Cahn, 포아송, 헬름홀츠)에서도 8개 작업에서 최고 성능.

NVIDIA는 Modulus에서 이름을 바꾼 PhysicsNeMo를 오픈소스 Physics-ML 플랫폼으로 제공합니다. PINN, FNO, GNN, 확산 모델을 모두 지원하며, DGX 인프라에서 산업 규모의 디지털 트윈 구축을 목표로 합니다.

지원 도메인: CFD(전산유체역학), 구조역학, 전자기학, 저수지 모델링.

NeurIPS 2022에서 발표된 PDEBench는 FNO, U-Net, PINN을 포함한 과학 ML 모델의 표준 벤치마크입니다. 2024년의 후속 연구 PDENNEval은 12개 신경망 방법을 11개 수역학 PDE에서 체계적으로 평가했습니다.

핵심 발견: FNO는 주파수 스펙트럼 전반에 걸쳐 ~4 × 10⁻⁴의 일관된 오차를 보이며, PINN은 고주파 특성을 예상보다 잘 처리합니다. 그러나 압축성 Navier-Stokes 같은 복잡한 PDE는 모든 기준 모델에게 여전히 도전적입니다.

결론부터 말하면, 아니다. 오히려 수치해석과 AI의 시너지가 Physics-ML의 핵심입니다.

세 방법은 경쟁이 아니라, 각자의 강점이 다른 방법의 약점을 보완하는 관계입니다. PINN의 물리 정합성, Neural Operator의 속도와 일반화, KAN의 해석 가능성 — 이 세 축이 결합되는 곳에서 차세대 과학 AI가 탄생할 것입니다.