콜모고로프-아르놀드 정리 완전 해부 — 130년 된 수학 난제가 AI의 미래를 바꾸고 있다

1900년 힐베르트가 던진 도전장, 19세 천재 아르놀드의 증명, 그리고 2024년 MIT에서 탄생한 KAN까지 — 130년에 걸친 수학 정리가 어떻게 AI 신경망의 새로운 패러다임이 되었는지, 역사·논문·사례로 깊이 파고듭니다.

1900년 힐베르트가 던진 도전장, 19세 천재 아르놀드의 증명, 그리고 2024년 MIT에서 탄생한 KAN까지 — 130년에 걸친 수학 정리가 어떻게 AI 신경망의 새로운 패러다임이 되었는지, 역사·논문·사례로 깊이 파고듭니다.

1900년, 파리. 20세기가 막 시작된 해에 독일의 수학자 다비트 힐베르트(David Hilbert)가 세계 수학자 대회에서 23개의 미해결 문제를 발표합니다. 이 문제들은 이후 100년간 수학의 방향을 결정짓게 됩니다.

그중 13번 문제는 이런 질문이었습니다:

"여러 변수를 가진 복잡한 함수를, 더 적은 변수를 가진 간단한 함수들의 조합으로 분해할 수 있는가?"

힐베르트는 "불가능하다"고 추측했습니다. 변수가 많아질수록 함수는 근본적으로 더 복잡해져서, 단순한 함수들의 조합으로는 표현할 수 없다고 생각한 것이죠.

57년 뒤, 소련의 수학자 안드레이 콜모고로프와 그의 19세 제자 블라디미르 아르놀드가 힐베르트의 추측을 완전히 뒤집는 증명을 발표합니다. 그리고 다시 67년이 지난 2024년, MIT와 칼텍의 연구자들이 이 130년 된 수학 정리를 새로운 신경망 아키텍처 KAN으로 부활시킵니다.

이 글은 그 130년의 여정을 따라갑니다.

힐베르트 13번 문제를 이해하려면, 먼저 7차 방정식을 알아야 합니다.

수학자들은 오래전부터 고차 방정식의 해를 구하는 데 관심이 있었습니다. 2차 방정식의 근의 공식은 중학교에서 배우죠. 3차, 4차 방정식도 (복잡하지만) 공식이 있습니다. 5차 이상은? 아벨-루피니 정리에 의해 일반적인 공식은 없습니다.

하지만 변수 치환(Tschirnhaus 변환)을 통해, 모든 7차 방정식은 아래 형태로 환원될 수 있음이 알려져 있었습니다:

여기서 해 는 세 변수 의 함수입니다. 힐베르트의 질문은:

이 해 를, 두 변수 이하의 연속함수들의 합성으로 표현할 수 있는가?

힐베르트는 "불가능하다"고 추측했습니다. 세 변수가 얽혀 만들어내는 복잡성은, 두 변수 함수로는 포착할 수 없다고 생각한 것입니다.

힐베르트가 이 문제를 제시한 배경에는 노모그래피(nomography)라는 실용적 맥락이 있었습니다. 노모그래피란 눈금자와 곡선을 이용해 복잡한 계산을 시각적으로 푸는 기법으로, 당시 공학에서 널리 사용되었습니다.

노모그래피에서 두 변수 함수는 2차원 평면의 곡선 패밀리로 쉽게 표현됩니다. 하지만 세 변수 이상의 함수는? 차원이 늘어나면 시각적 표현이 급격히 어려워집니다. 힐베르트의 문제는 결국 이런 질문이었습니다:

"고차원의 복잡성을 저차원으로 환원하는 것이 근본적으로 가능한가?"

안드레이 니콜라에비치 콜모고로프(1903-1987)는 20세기 가장 영향력 있는 수학자 중 한 명입니다. 확률론, 복잡성 이론, 위상수학, 난류 이론 등 거의 모든 수학 분야에 이름을 남겼죠.

1956년, 콜모고로프는 먼저 예비 결과를 발표합니다: 여러 변수의 연속함수는 세 변수 함수들의 유한한 조합으로 구성할 수 있다. 힐베르트가 추측한 것보다 한 단계 약한 결과였지만, 이미 방향은 명확했습니다 — 힐베르트의 추측이 틀릴 가능성이 높다는 것.

1957년, 모스크바 국립대학교의 학부생이던 블라디미르 아르놀드(Vladimir Arnold)가 결정적인 결과를 발표합니다. 당시 그의 나이, 겨우 19세.

아르놀드는 증명했습니다:

세 변수의 모든 연속함수는 두 변수 연속함수들의 유한한 합성으로 표현할 수 있다.

이것은 힐베르트의 13번 문제 연속함수 버전을 완벽히 부정한 것입니다. 힐베르트는 "불가능하다"고 추측했는데, 아르놀드가 "가능하다"고 증명해 버린 것이죠.

콜모고로프는 제자 아르놀드의 결과에서 영감을 받아, 더욱 강력한 최종 정리를 증명합니다.

정리의 내용을 수학적으로 정확하게 표현하면 이렇습니다:

에서 정의된 모든 연속함수 는 다음과 같이 표현할 수 있다:

여기서:

레스토랑 비유를 들어봅시다.

전통적인 관점(힐베르트의 추측):

"10가지 재료로 요리를 만들려면, 10가지 재료가 동시에 어우러지는 복잡한 조리 과정이 필요하다."

콜모고로프-아르놀드 정리가 증명한 것:

"아무리 복잡한 요리도, 각 재료를 개별적으로 손질하고(일변수 함수), 그 결과를 합친 다음(덧셈), 한 번 더 조리하면(외부 함수) 만들 수 있다."

핵심 통찰을 정리합니다:

다변수 함수에서 유일하게 "진짜 다변수"인 연산은 덧셈뿐이다.

나머지 모든 복잡성은 일변수 함수로 인코딩할 수 있습니다. 이것은 직관에 반합니다. 우리는 "변수가 많으면 더 복잡하다"고 생각하는데, 정리는 "아무리 변수가 많아도, 일변수 함수와 덧셈만으로 모든 것을 표현할 수 있다"고 말합니다.

정리에는 실용적 한계가 있었습니다. 내부 함수 가 연속이기는 하지만, 극도로 불규칙한(wildly behaving) 프랙탈에 가까운 형태일 수 있었습니다. 원래 함수 가 아무리 매끈하더라도, 분해된 내부 함수는 미분조차 불가능할 수 있었죠.

이 때문에 수학자들은 정리를 "아름답지만 쓸모없는 이론적 결과"로 치부했고, 67년간 실용적 응용 없이 잠들어 있었습니다.

그 잠을 깨운 것이 2024년의 KAN 논문입니다.

2024년 4월 30일, MIT와 칼텍의 연구자 쯔밍 류(Ziming Liu) 등 8명이 arXiv에 논문을 공개합니다:

"KAN: Kolmogorov-Arnold Networks"

이 논문은 공개 직후 AI 커뮤니티에서 폭발적인 반응을 얻었습니다. GitHub 저장소(pykan)는 16,200+ 스타를 기록하고, 논문은 ICLR 2025(세계 최고 AI 학회 중 하나)에 정식 채택됩니다.

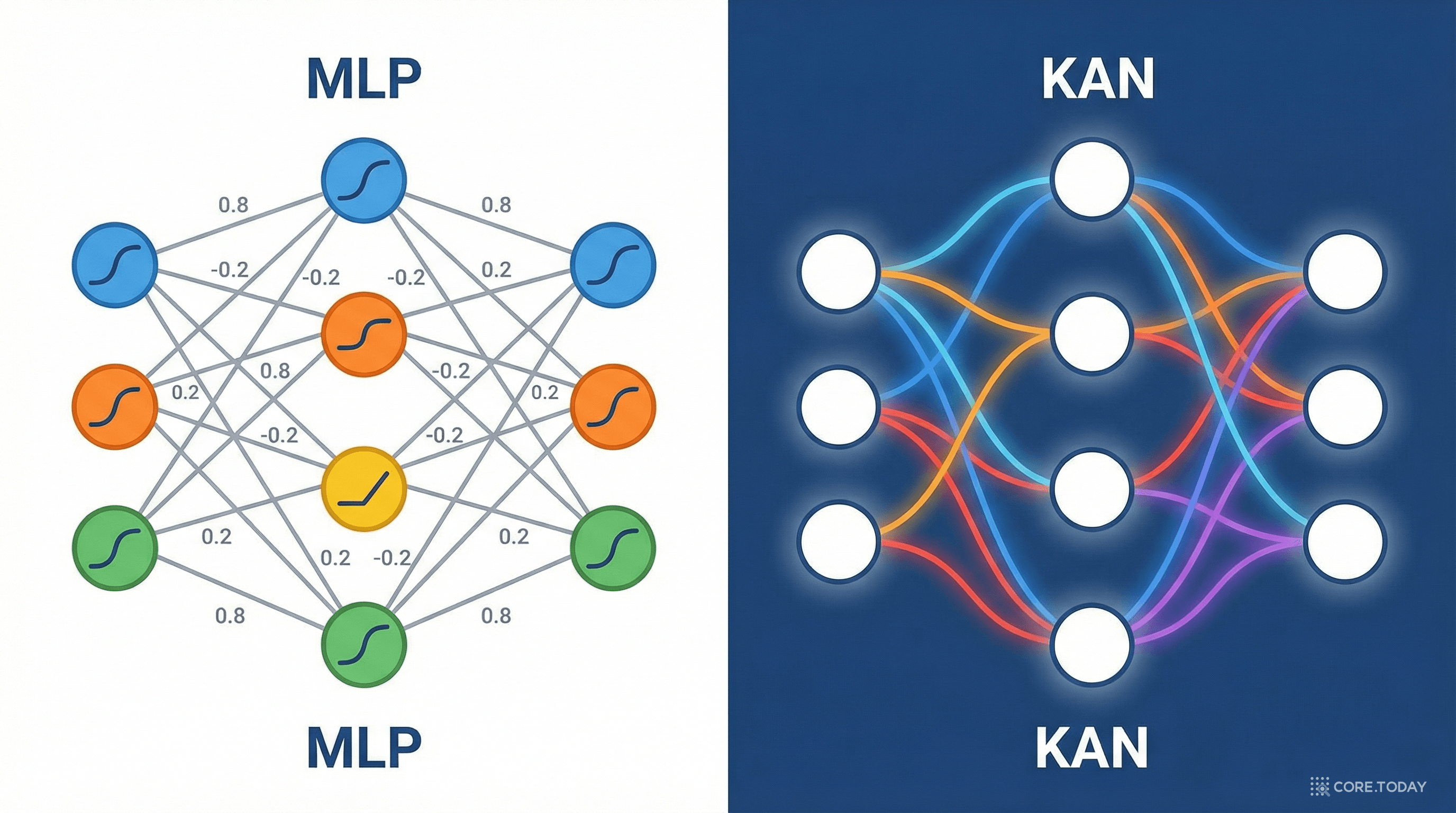

KAN을 이해하려면 먼저 기존 신경망인 MLP(Multi-Layer Perceptron)를 알아야 합니다.

| 구분 | MLP (기존 신경망) | KAN (새로운 신경망) |

|---|---|---|

| 이론적 기반 | 범용 근사 정리 (Cybenko, 1989) | 콜모고로프-아르놀드 정리 (1957) |

| 활성화 함수 위치 | 노드(뉴런)에 고정된 함수 (ReLU, sigmoid 등) | 엣지(연결선)에 학습 가능한 함수 (B-스플라인) |

| 엣지(연결선) 역할 | 단순한 선형 가중치 (w × x + b) | 일변수 함수 φ(x) — 곡선 자체가 학습됨 |

| 노드(뉴런) 역할 | 가중합 + 활성화 적용 | 단순 덧셈만 수행 |

| 해석 가능성 | 블랙박스 — 내부 작동 해석 어려움 | 각 엣지의 함수를 시각화하고 수식으로 변환 가능 |

쉽게 말하면:

KAN의 엣지에서 학습되는 함수는 B-스플라인(B-spline)이라는 수학적 도구로 표현됩니다.

B-스플라인은 "부드러운 곡선을 조각조각 이어 만드는 방법"입니다. 각 조각은 다항식이고, 조각들이 매끄럽게 연결됩니다. 중요한 특성:

KAN의 학습 과정에서 격자(grid)를 점점 세밀하게 만들면, 손실(loss) 그래프에 "계단 현상"이 나타납니다 — 격자를 확장할 때마다 손실이 급격히 떨어지고, 다시 안정화되는 패턴이 반복됩니다.

KAN 논문의 실험 결과는 충격적이었습니다:

PDE(편미분방정식) 풀기 — 포아송 방정식:

KAN이 파라미터 100배 적게 사용하면서 정확도는 100배 높은 결과를 보여준 것입니다.

특수함수 근사 성능:

| 함수 | MLP (RMSE) | KAN (RMSE) | KAN 우위 |

|---|---|---|---|

| 베셀 함수 (jv) | 5.52 × 10⁻³ | 1.64 × 10⁻³ | 3.4배 |

| 수정 베셀 함수 (kv) | 1.67 × 10⁻⁴ | 2.52 × 10⁻⁵ | 6.6배 |

| 구면 조화 함수 | 1.25 × 10⁻⁶ | 2.21 × 10⁻⁷ | 5.7배 |

KAN이 강한 이유는 스케일링 법칙(scaling law)에 있습니다.

3차 B-스플라인() 기준으로, KAN의 스케일링 지수는 입니다. MLP는 차원이 높아질수록 이 지수가 급격히 떨어지는 반면, KAN은 차원과 무관하게 빠르게 수렴합니다.

KAN이 만능일까요? 2024년 7월, 공정한 비교를 시도한 논문이 등장합니다.

파라미터 수를 동일하게 맞추고 5개 도메인에서 테스트한 결과:

| 도메인 | MLP 성능 | KAN 성능 | 승자 |

|---|---|---|---|

| 머신러닝 (8개 데이터셋) | 우세 | 열세 | MLP |

| 컴퓨터 비전 (8개 데이터셋) | 우세 | 열세 | MLP |

| 오디오 분류 (2개 데이터셋) | 우세 | 열세 | MLP |

| 텍스트 분류 (2개 데이터셋) | 우세 | 열세 | MLP |

| 수식 근사 (8개 함수) | 열세 | 7/8 승리 | KAN |

결과는 명확합니다:

KAN의 가장 독특한 장점은 사람이 이해할 수 있는 AI를 만든다는 것입니다.

MLP의 내부는 블랙박스입니다 — 수백만 개의 가중치 숫자가 왜 그런 값인지 설명할 수 없죠. 하지만 KAN은 각 엣지의 활성화 함수를 시각적으로 볼 수 있고, 나아가 기호식(symbolic expression)으로 변환할 수 있습니다.

예를 들어, KAN에 물리 데이터를 학습시키면:

이것이 바로 KAN이 "과학자와 협업하는 AI"로 불리는 이유입니다.

| 약점 | 내용 |

|---|---|

| 학습 속도 | B-스플라인의 재귀 계산으로 MLP 대비 약 2ᵏ배 느림 |

| GPU 효율 | B-스플라인이 병렬 연산에 최적화되지 않음. MLP는 행렬 곱으로 GPU에 완벽 최적화 |

| 대규모 확장 | 깊이 20층 이상, 격자 크기 20+ 에서 학습 불안정 |

| 연속 학습 | MLP보다 심각한 파국적 망각(catastrophic forgetting) 문제 |

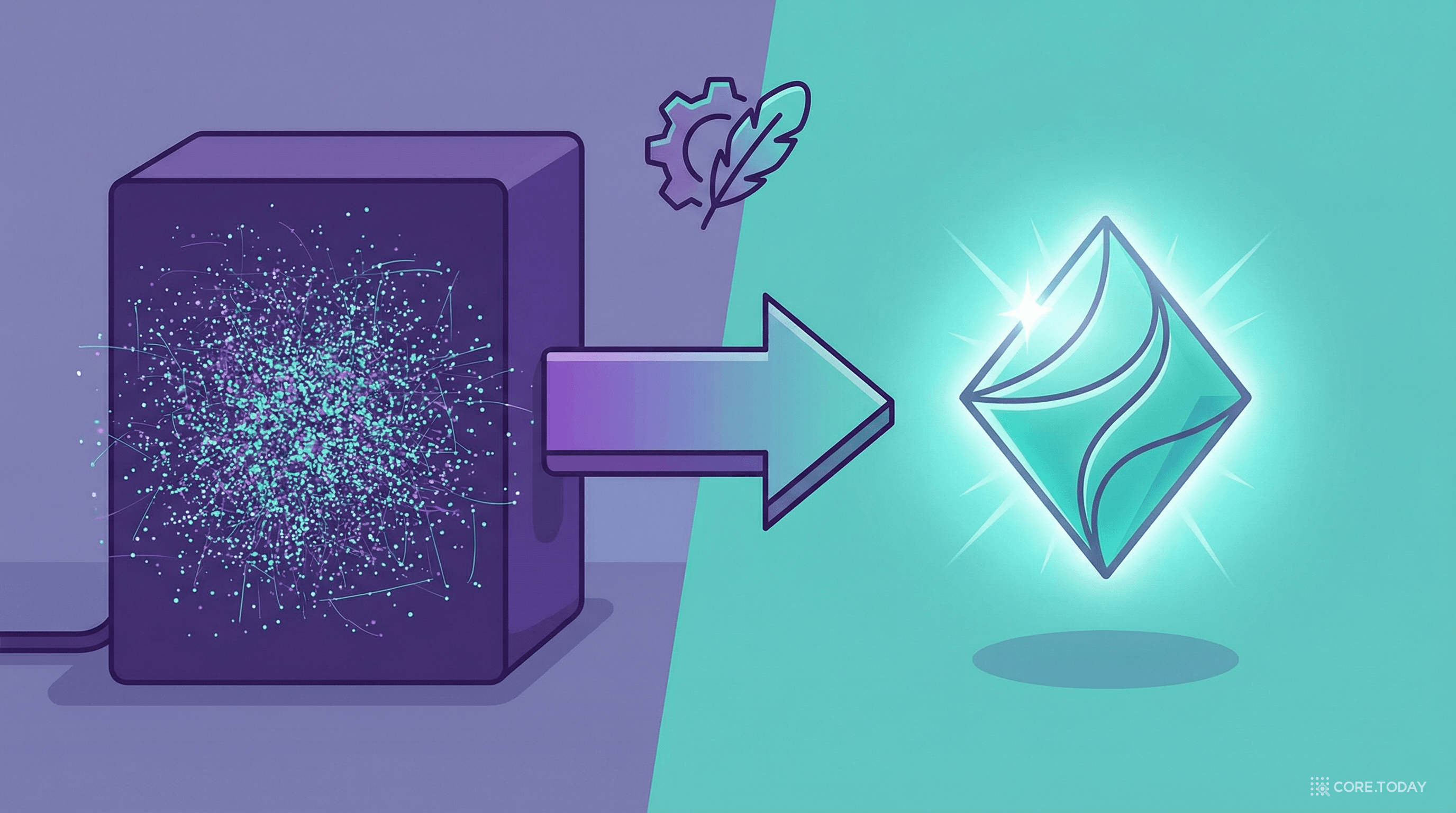

KAN과 비교할 때 빠지지 않는 기술이 LoRA(Low-Rank Adaptation)입니다. 2021년 마이크로소프트 연구팀이 발표한 이 기법은 현재 AI 업계의 표준이 되었죠.

LoRA의 핵심 아이디어:

GPT-3 같은 175B 파라미터 모델을 새로운 작업에 맞추려면, 원래라면 175B개의 가중치를 모두 업데이트해야 합니다. LoRA는 이 거대한 가중치 행렬의 변화량이 낮은 랭크(low-rank)를 가진다는 것을 이용합니다.

쉽게 말해: 175B개의 손잡이를 모두 돌리지 않아도, 핵심 손잡이 수백 개만 돌리면 같은 효과를 얻을 수 있다.

결과는 놀랍습니다:

KAN과 LoRA는 완전히 다른 기술이지만, 같은 철학을 공유합니다:

"모든 파라미터가 다 필요한 것은 아니다."

| 관점 | LoRA | KAN |

|---|---|---|

| 핵심 관찰 | 가중치 업데이트는 낮은 랭크를 가진다 | 다변수 함수는 일변수 함수들로 분해된다 |

| 전략 | 큰 행렬 W를 작은 행렬 A×B로 근사 | 가중치를 스플라인 함수로 대체 |

| 적용 대상 | 기존 아키텍처의 미세 조정 기법 | 완전히 새로운 아키텍처 |

| 결과 | 적은 파라미터로 동일한 성능 | 적은 파라미터로 동일 이상의 성능 |

| 철학 | 실세계 문제는 겉보기보다 낮은 차원의 구조를 가지고 있다 |

둘의 공통된 통찰은 이겁니다: 실세계의 데이터와 문제는 이론적 차원보다 훨씬 낮은 내재적 차원(intrinsic dimensionality)을 가집니다. LoRA는 이것을 가중치 공간에서, KAN은 함수 공간에서 활용합니다.

이미 몇 가지 흥미로운 시도가 나타나고 있습니다:

LoRA가 기존 거대 모델의 효율적 조정을 담당하고, KAN이 새로운 모델의 효율적 설계를 담당하는 — 효율적 AI의 양대 축이 형성되고 있습니다.

2024년 8월, 같은 팀이 KAN 2.0 논문을 발표합니다. 이 논문은 Physical Review X(물리학 최고 저널 중 하나)에 게재되어, KAN이 단순한 ML 기법이 아니라 과학적 발견 도구임을 입증합니다.

KAN 2.0의 핵심 기능:

KAN 2.0으로 발견한 것들: 보존량(conserved quantities), 라그랑지안(Lagrangians), 대칭성(symmetries), 구성 법칙(constitutive laws) — 물리학의 핵심 구조를 데이터로부터 자동 발견한 것입니다.

분자 과학과 신약 개발:

양자 KAN (QKAN):

비전 트랜스포머에 KAN 적용 (KAT):

2024~2025년 사이 폭발적으로 등장한 KAN 변종들:

| 변종 | 핵심 혁신 | 장점 |

|---|---|---|

| FastKAN | 최적화된 B-스플라인 계산 | MLP 역전파 대비 ~2배 속도 |

| FourierKAN | B-스플라인 대신 푸리에 급수 사용 | 순전파(forward) 속도 향상 |

| ChebyKAN | 체비셰프 다항식 사용 | 가장 빠른 변종 중 하나 |

| WavKAN | 웨이블릿 함수 사용 | 다중 스케일 분석에 유리 |

| P-KAN (2025) | 파라미터 축소 아키텍처 | 파라미터 최대 83% 절감 |

| AF-KAN (2025) | 활성화 함수 기반 접근 | 최신 변종, 유연성 극대화 |

이 이야기를 다시 처음으로 돌아가 봅시다.

1900년, 힐베르트는 "복잡한 것은 단순하게 풀 수 없다"고 추측했습니다. 1957년, 19세의 아르놀드와 그의 스승 콜모고로프가 "아니, 풀 수 있다"고 증명했습니다. 그리고 2024년, MIT의 연구자들이 이 정리를 "신경망으로 구현하면 어떨까?"라고 물었습니다.

그 질문의 답이 KAN입니다.

KAN은 MLP를 대체하지 않습니다. 대규모 언어 모델이나 이미지 분류 같은 범용 태스크에서는 여전히 MLP가 강하죠. 하지만 KAN이 여는 새로운 가능성은 분명합니다:

130년 전 힐베르트가 던진 질문은, 결국 "복잡한 세상을 단순하게 이해할 수 있는가?"라는 물음이었습니다. 콜모고로프-아르놀드 정리는 "네, 가능합니다"라고 답했고, KAN은 그 답을 실행 가능한 AI로 만들고 있습니다.

그리고 이 이야기는 아직 끝나지 않았습니다.