TECH BLOG

기술 블로그

AI 기술 인사이트와 엔지니어링 경험을 공유합니다.

ALL POSTS

모든 포스트

InstructGPT 해부: 1.3B 모델이 175B를 이긴 날, RLHF의 모든 것

GPT-3는 왜 '도움이 되는 비서'가 아니었을까? 100배 작은 모델이 거대 모델을 이긴 비결은? InstructGPT 논문을 해부하며, ChatGPT를 탄생시킨 RLHF 기술을 처음부터 쉽게 풀어낸다.

PagedAdamW 특집: GPU 메모리가 부족해도 LLM을 파인튜닝하는 법

650억 파라미터 모델을 48GB GPU 하나로 파인튜닝한다? QLoRA의 세 번째 비밀 무기 — PagedAdamW는 CUDA 통합 메모리로 옵티마이저 상태를 GPU↔CPU 사이에 자동으로 페이징한다. 8비트 옵티마이저부터 QLoRA까지, Tim Dettmers가 열어젖힌 효율적 파인튜닝의 역사를 추적한다.

LoRA 논문 해부: 1,750억 개의 손잡이 중 470만 개만 돌리다

GPT-3를 파인튜닝하려면 1.2TB 메모리가 필요하다. LoRA는 파라미터의 0.003%만 학습하여 동일한 성능을 달성했다. 350GB 체크포인트가 35MB로 줄었고, AI 맞춤화가 민주화됐다. 이 혁명의 원리를 처음부터 쉽게 풀어낸다.

Sophia 옵티마이저 특집: 곡률을 보는 눈으로 Adam을 2배 앞서다

Adam은 기울기만 본다. Sophia는 '지형의 곡률'까지 본다 — 가파른 골짜기에서는 조심스럽게, 평평한 평원에서는 과감하게. 스탠퍼드 팀이 만든 이 2차 옵티마이저는 GPT-2 학습을 2배 빠르게 만들었다. 그리고 같은 팀이 스스로 그 주장을 재검증했다.

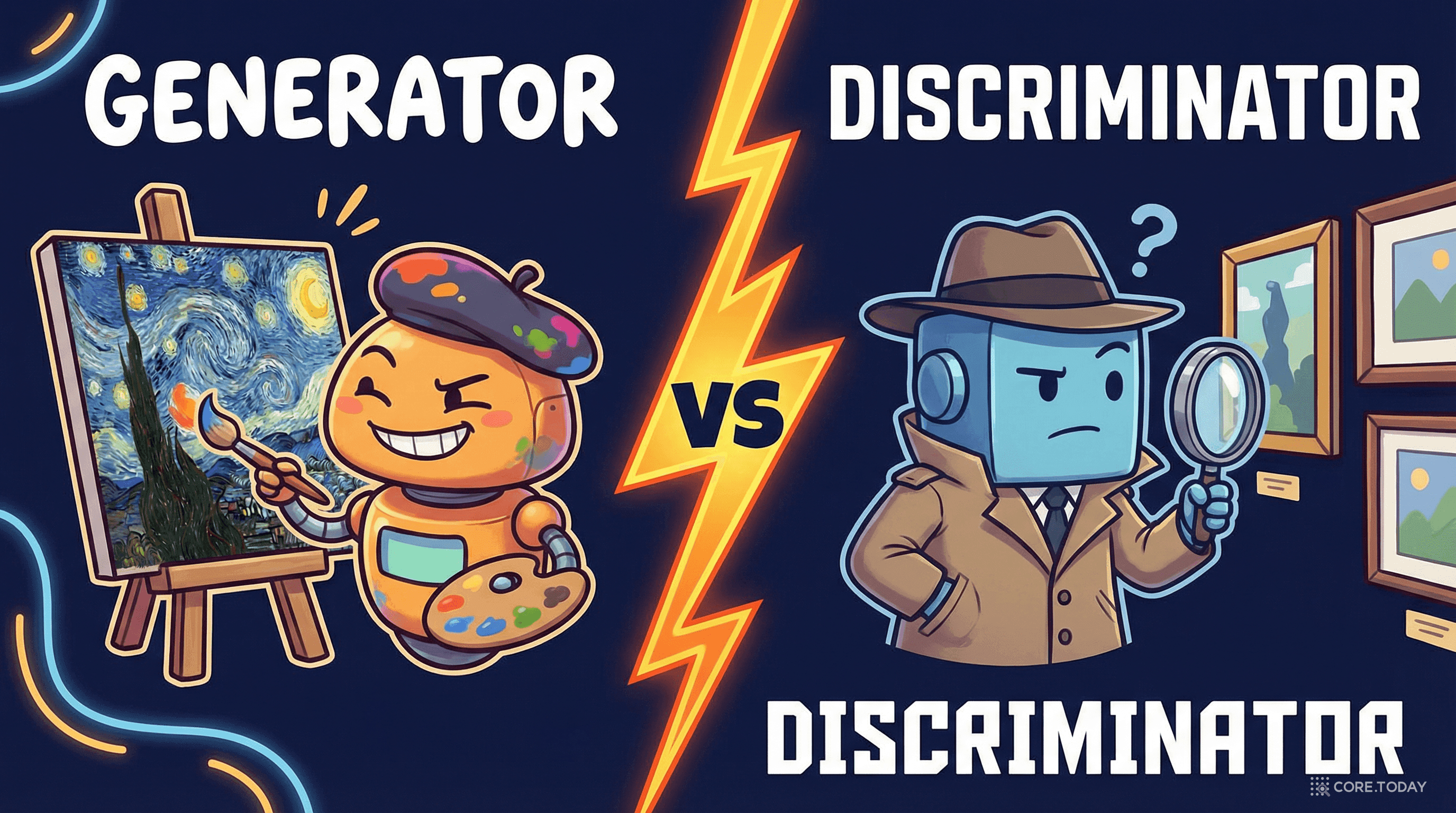

GAN 완전 정복: 위조지폐범과 경찰의 두뇌 싸움이 만든 AI 혁명

술집 대화에서 탄생한 아이디어가 AI 이미지 생성의 역사를 바꿨습니다. GAN의 원리부터 딥페이크 논란, 그리고 디퓨전 모델과의 세대교체까지 — 생성 AI의 핵심을 재미있게 정리합니다.

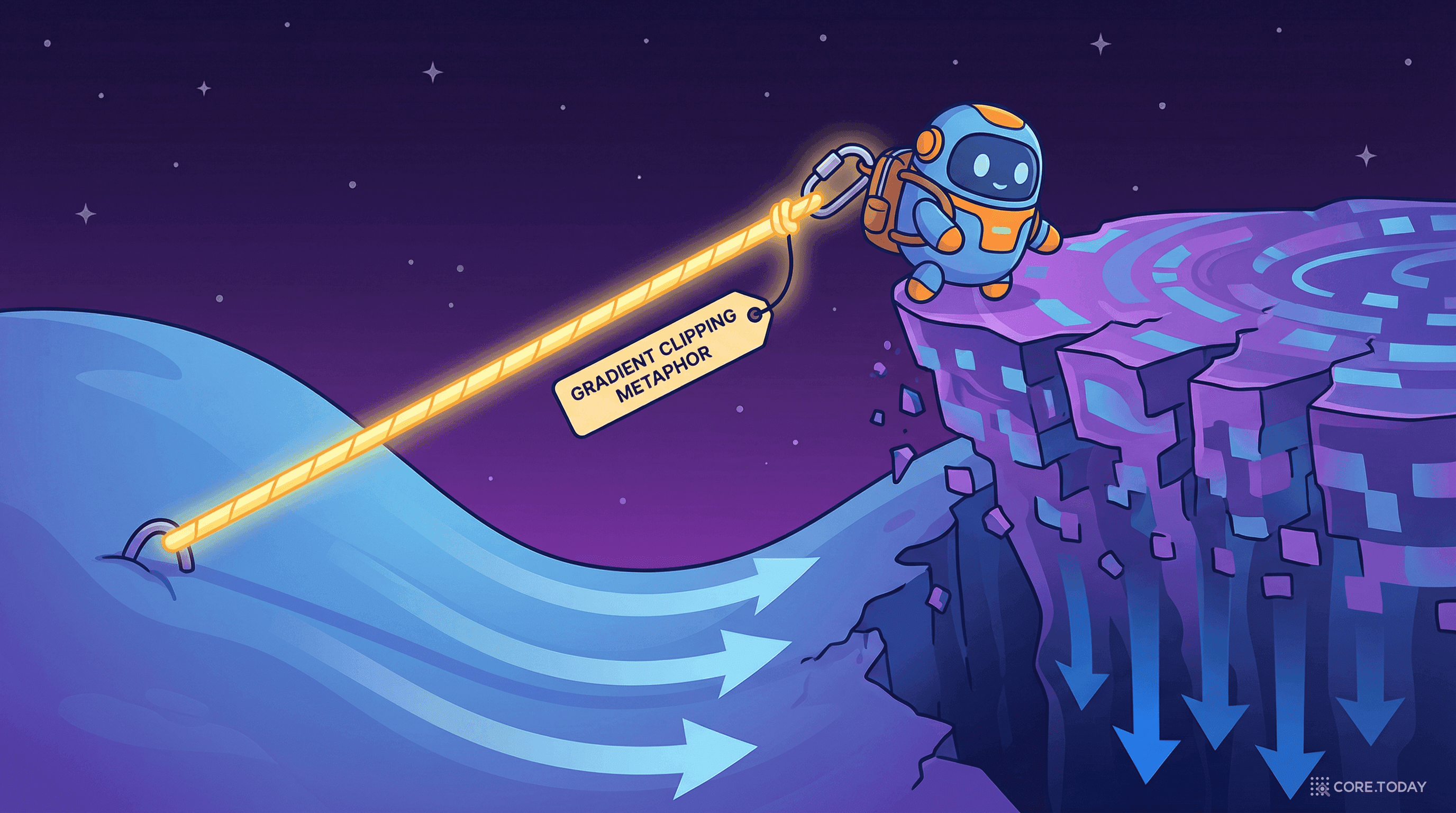

Gradient Clipping 완전 해부: 딥러닝의 안전벨트는 어떻게 탄생했는가

1991년, 독일어로 쓴 석사 논문 하나가 딥러닝의 근본 문제를 발견했다. 기울기가 폭발하거나 소멸한다. 22년 뒤, 세 명의 연구자가 해법을 제시했다 — Gradient Clipping. GPT-3부터 LLaMA까지, 모든 대형 모델의 훈련에 쓰이는 이 기법의 역사와 원리를 처음부터 파헤친다.

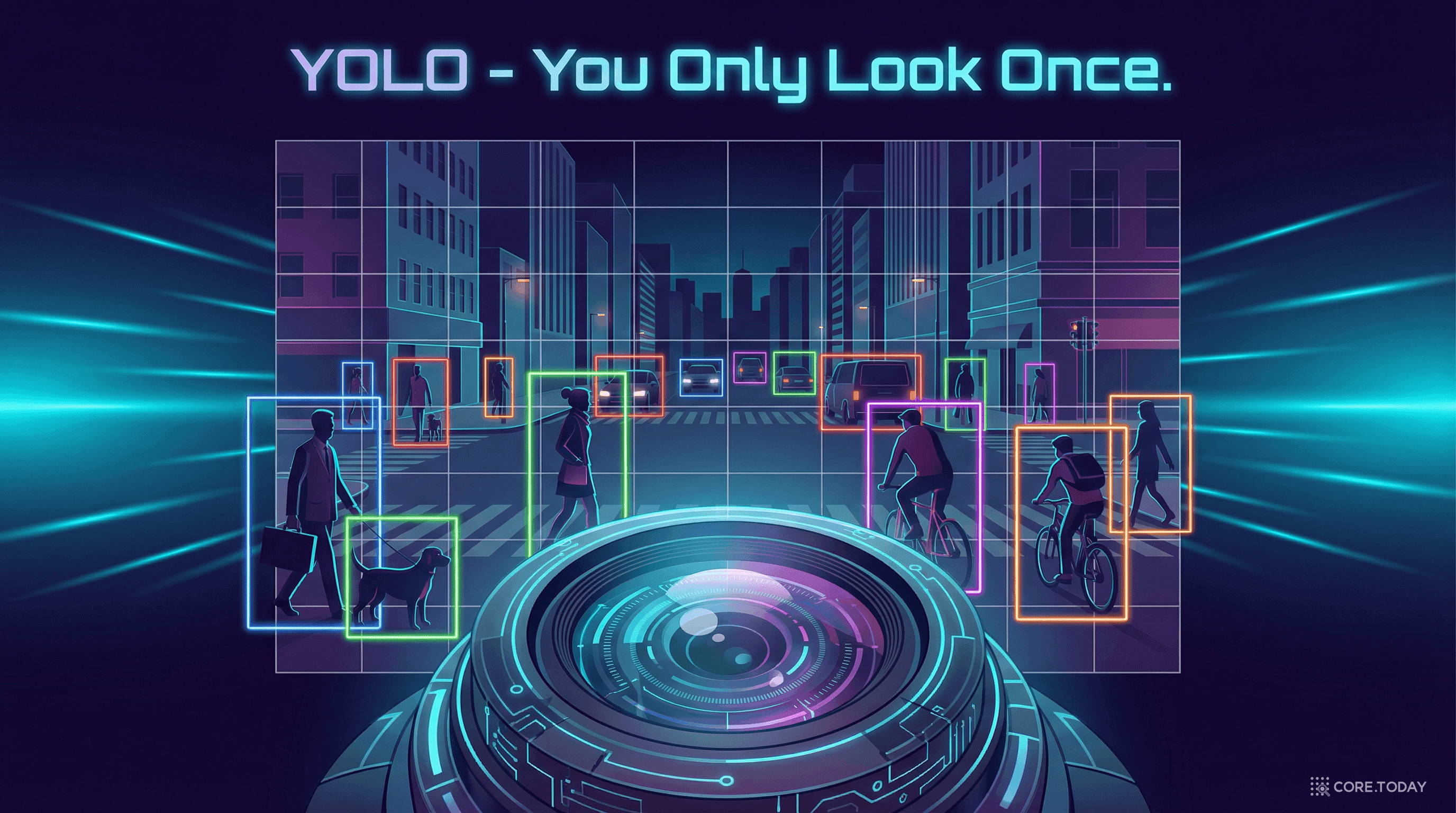

YOLO 완전 이해: 한 번만 봐! — 실시간 객체 검출의 혁명

'느리지만 정확하게'가 아니라 '한 번에 전부' — 객체 검출을 회귀 문제로 재정의하여 실시간 처리를 가능하게 한 YOLO가 어떻게 탄생했고, 왜 10년이 지난 지금도 세상을 바꾸고 있는지를 논문과 사례로 풀어본다.

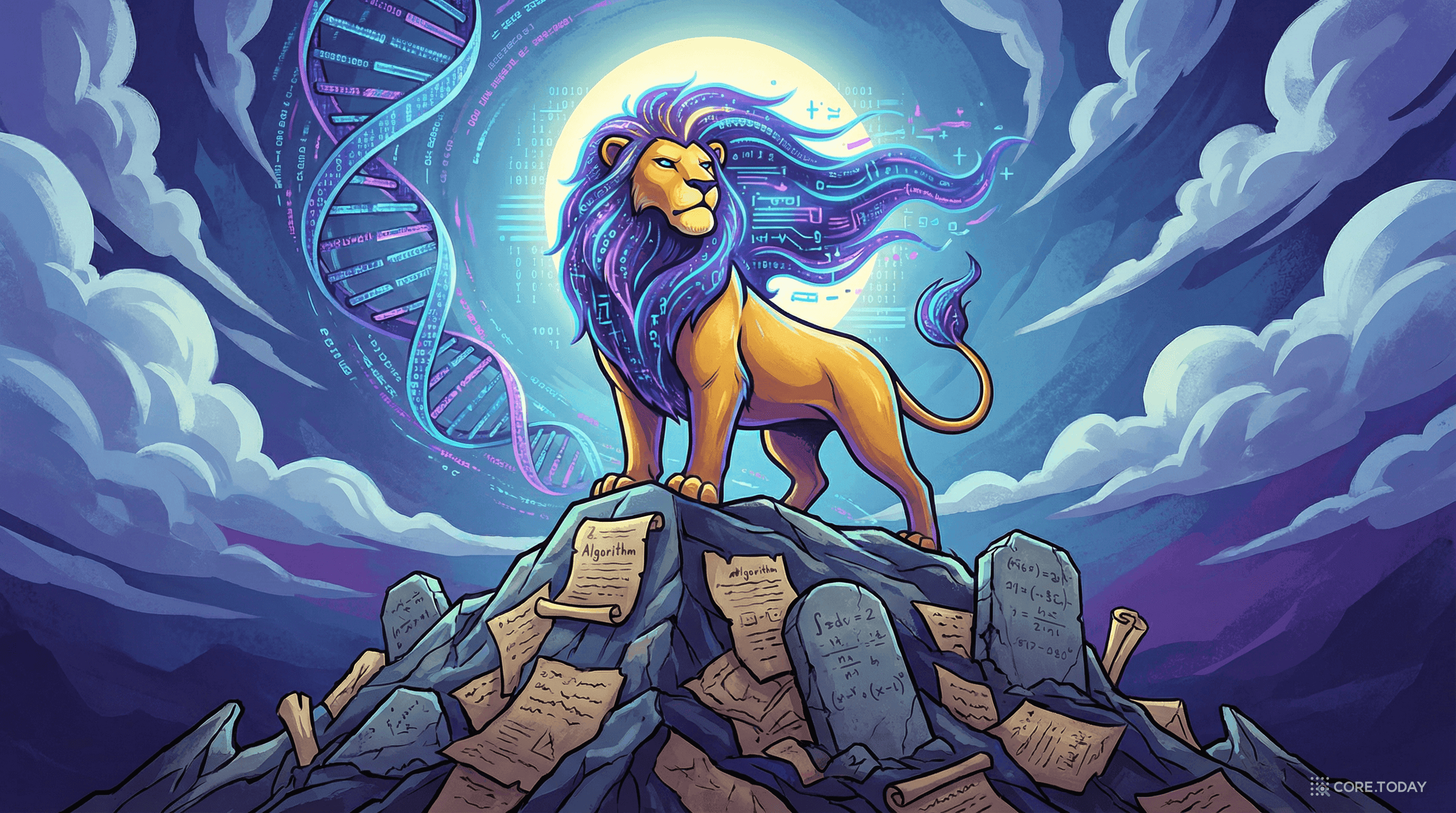

Lion 옵티마이저 특집: AI가 스스로 발견한 최적화 알고리즘

2023년, Google Brain의 AI가 수십만 개의 프로그램을 진화시켜 옵티마이저를 '발견'했다. 그 이름은 Lion — Adam보다 메모리를 절반만 쓰고, 확산 모델에서 2.3배 빠르며, Google 검색 광고에 배치된 최초의 'AI가 만든 AI 구성 요소'. 발견 과정, 알고리즘, 성능, 한계까지 깊이 파헤친다.

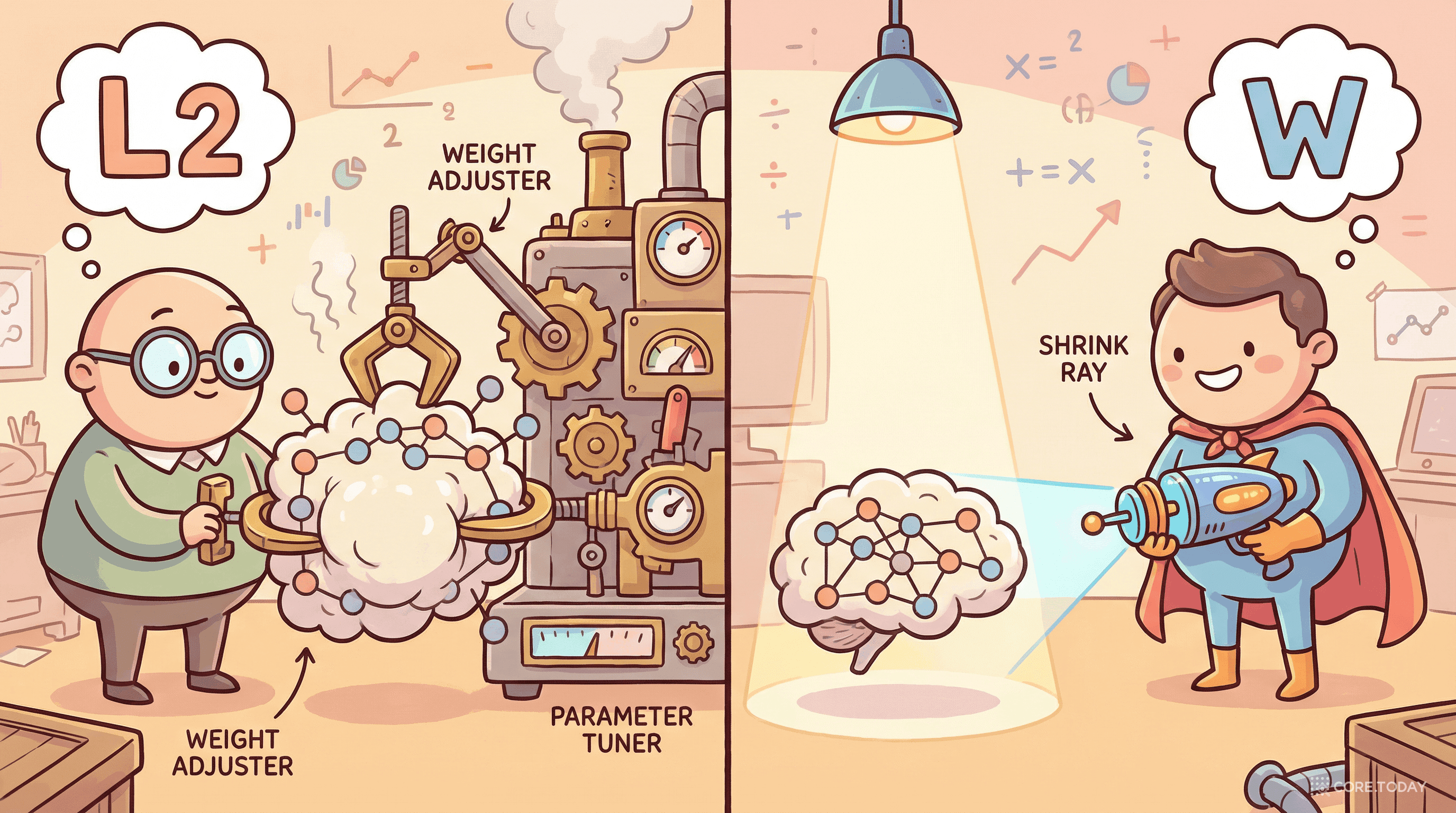

AdamW 특집: 왜 거의 모든 LLM이 이 옵티마이저를 쓰는가

2017년, 프라이부르크의 두 연구자가 Adam의 가중치 감쇠에 숨겨진 버그를 발견했다. 이 '수정'이 BERT, GPT-3, LLaMA 등 거의 모든 대규모 언어 모델 학습의 표준이 되기까지 — AdamW의 탄생, 수학적 원리, 그리고 현대 AI에서의 위상을 추적한다.