GAN 완전 정복: 위조지폐범과 경찰의 두뇌 싸움이 만든 AI 혁명

술집 대화에서 탄생한 아이디어가 AI 이미지 생성의 역사를 바꿨습니다. GAN의 원리부터 딥페이크 논란, 그리고 디퓨전 모델과의 세대교체까지 — 생성 AI의 핵심을 재미있게 정리합니다.

술집 대화에서 탄생한 아이디어가 AI 이미지 생성의 역사를 바꿨습니다. GAN의 원리부터 딥페이크 논란, 그리고 디퓨전 모델과의 세대교체까지 — 생성 AI의 핵심을 재미있게 정리합니다.

2014년 어느 날 밤, 몬트리올의 한 술집. 박사과정 학생이던 이안 굿펠로우(Ian Goodfellow)는 친구들과 생성 모델(Generative Model)에 대해 논쟁하고 있었습니다. "기계가 사실적인 이미지를 '만들어내게' 할 수 있을까?"

기존 접근법들은 모두 한계가 있었습니다. 친구들의 아이디어를 듣다가, 굿펠로우는 갑자기 번뜩이는 생각을 합니다:

"두 개의 신경망을 서로 경쟁시키면 어떨까?"

술집에서 집으로 돌아온 그는 밤새 코딩합니다. 그리고 놀랍게도 — 첫 번째 실험에서 바로 작동했습니다.

이 하룻밤의 코딩이 낳은 것이 바로 GAN(Generative Adversarial Network, 생성적 적대 신경망)입니다. 2014년 NeurIPS에서 발표된 논문 "Generative Adversarial Nets"(Goodfellow et al.)는 AI 역사에서 가장 영향력 있는 논문 중 하나가 되었고, 얀 르쿤(Yann LeCun)은 이를 "지난 10년간 머신러닝에서 가장 흥미로운 아이디어"라고 극찬합니다.

대체 어떤 아이디어이길래?

GAN을 이해하려면 먼저 "생성 모델(Generative Model)"이 무엇인지 알아야 합니다.

2014년 이전에도 생성 모델은 존재했습니다. 하지만 모두 심각한 한계가 있었습니다:

볼츠만 머신(Restricted Boltzmann Machine) — 힌턴이 2006년 제안한 확률적 생성 모델. 학습이 어렵고, 생성되는 이미지가 흐릿했습니다.

VAE(Variational Autoencoder) — 킹마와 웰링(Kingma & Welling)이 2013년 발표. 데이터를 압축(인코딩)했다가 복원(디코딩)하는 과정에서 새로운 데이터를 생성합니다. 수학적으로 우아하지만, 생성된 이미지가 뿌옇고 디테일이 부족했습니다.

GAN 이전의 생성 모델들은 "만들기는 하는데... 별로 진짜 같지 않은" 수준이었습니다.

굿펠로우의 혁신은 이 문제를 완전히 다른 각도에서 접근한 것입니다.

GAN의 아이디어는 놀랍도록 직관적입니다. 두 개의 신경망이 서로 경쟁하며 함께 성장합니다:

이 두 네트워크는 동시에 학습됩니다. 마치 군비 경쟁처럼:

이 과정을 수학적으로 표현하면, 굿펠로우 논문의 유명한 미니맥스 게임(minimax game) 목적 함수가 됩니다:

minG maxD V(D, G) = 𝔼x~pdata[log D(x)] + 𝔼z~pz[log(1 - D(G(z)))]

쉽게 풀어쓰면:

• 판별자(D)는 이 값을 최대화하고 싶다 → 진짜를 진짜로, 가짜를 가짜로 잘 맞추기

• 생성자(G)는 이 값을 최소화하고 싶다 → 판별자가 틀리게 만들기

이 두 목표가 충돌하면서 내시 균형(Nash Equilibrium)을 향해 수렴합니다.

게임 이론의 개념입니다. 영화 "뷰티풀 마인드"의 주인공 존 내시가 정립한 이론이죠.

내시 균형이란 "각 플레이어가 상대방의 전략을 알더라도, 자신의 전략을 바꿀 이유가 없는 상태"입니다.

GAN에서의 내시 균형은: 생성자가 진짜 데이터의 분포와 완전히 동일한 가짜를 만들어내서, 판별자가 진짜와 가짜를 50:50으로밖에 구분하지 못하는 상태입니다. 이론적으로는 이 지점에 도달하면 완벽한 생성 모델이 됩니다.

물론 현실에서는 이 균형에 정확히 도달하기가 매우 어렵습니다. 이것이 GAN 학습의 가장 큰 도전 과제입니다.

import torch

import torch.nn as nn

# 생성자: 랜덤 노이즈 → 가짜 이미지

class Generator(nn.Module):

def __init__(self):

super().__init__()

self.net = nn.Sequential(

nn.Linear(100, 256), # 100차원 노이즈 입력

nn.ReLU(),

nn.Linear(256, 512),

nn.ReLU(),

nn.Linear(512, 784), # 28×28 이미지 출력

nn.Tanh()

)

def forward(self, z):

return self.net(z)

# 판별자: 이미지 → 진짜/가짜 확률

class Discriminator(nn.Module):

def __init__(self):

super().__init__()

self.net = nn.Sequential(

nn.Linear(784, 512),

nn.LeakyReLU(0.2),

nn.Linear(512, 256),

nn.LeakyReLU(0.2),

nn.Linear(256, 1),

nn.Sigmoid() # 0(가짜)~1(진짜) 확률

)

def forward(self, x):

return self.net(x)

놀랍도록 단순하죠? 생성자는 노이즈를 이미지로 바꾸고, 판별자는 이미지를 확률로 바꿉니다. 이 두 네트워크를 번갈아가며 학습시키는 것이 GAN의 전부입니다.

원조 GAN은 놀라운 아이디어였지만, 실전에서는 문제가 많았습니다. 이후 수천 편의 후속 논문이 쏟아지며 GAN은 빠르게 진화합니다.

래드포드 등(Radford, Metz & Chintala)이 "Unsupervised Representation Learning with Deep Convolutional Generative Adversarial Networks"을 발표합니다.

원조 GAN이 단순한 완전연결층(FC)을 쓴 반면, DCGAN은 합성곱 신경망(CNN)을 도입합니다. 이미지의 공간적 구조를 활용할 수 있게 되면서, 생성 이미지의 품질이 크게 향상됩니다.

DCGAN은 또한 "생성자의 잠재 공간(latent space)에서 벡터 연산이 가능하다"는 흥미로운 발견을 합니다:

안경 쓴 남자 - 안경 안 쓴 남자 + 안경 안 쓴 여자 = 안경 쓴 여자 👓

웃는 여자 - 무표정 여자 + 무표정 남자 = 웃는 남자 😊

마치 Word2Vec의 "왕 - 남자 + 여자 = 여왕"처럼, 이미지에서도 의미적 연산이 가능!

GAN 학습은 악명 높게 불안정합니다. 두 가지 대표적 문제:

아르조프스키 등(Arjovsky, Chintala & Bottou)의 WGAN(Wasserstein GAN)은 기존 GAN의 손실 함수를 바서슈타인 거리(Wasserstein distance)로 교체합니다. 직관적으로 설명하면:

이 변경으로 학습이 훨씬 안정적이 되고, 손실값이 실제로 이미지 품질과 상관관계를 가지게 됩니다. 기존 GAN에서는 손실이 줄어도 이미지가 좋아지는지 알 수 없었거든요.

카라스 등(Karras et al., NVIDIA)의 연구는 GAN의 이미지 품질을 인간이 구분할 수 없는 수준으로 끌어올립니다.

Progressive GAN (2017): 4×4 해상도부터 시작해서 점진적으로 1024×1024까지 키워나가는 학습 방법. 갑자기 고해상도를 만드는 대신, 단계적으로 디테일을 추가합니다.

StyleGAN (2018): 스타일 전이(Style Transfer) 아이디어를 접목하여, 생성 과정을 "거칠게(포즈, 얼굴형) → 중간(이목구비) → 세밀하게(피부, 머리결)" 단계로 분리. 각 단계를 독립적으로 제어할 수 있게 됩니다.

StyleGAN2 (2020): 아티팩트(물방울 모양의 노이즈)를 제거하고 더욱 사실적인 이미지를 생성. ThisPersonDoesNotExist.com이라는 웹사이트가 화제가 됩니다 — 새로고침할 때마다 존재하지 않는 사람의 얼굴이 생성됩니다.

* 바 길이는 해상도뿐 아니라 전반적인 이미지 품질과 사실성을 종합적으로 표현한 것입니다.

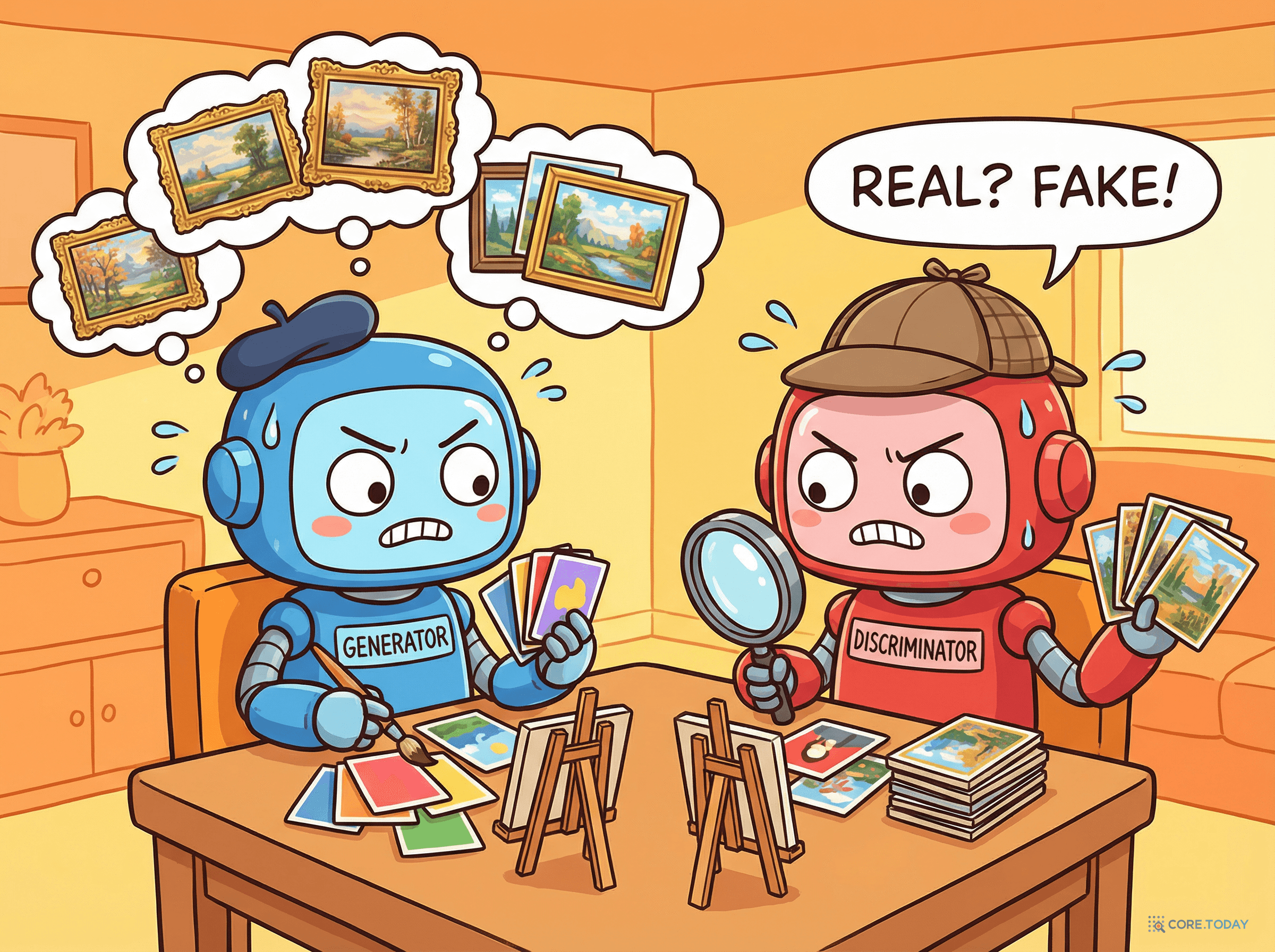

GAN은 "얼굴 만들기"를 넘어 놀라울 정도로 다양한 분야에 적용됩니다.

이솔라 등(Isola et al.)의 "Image-to-Image Translation with Conditional Adversarial Networks"은 한 종류의 이미지를 다른 종류로 변환합니다.

흑백 사진을 컬러로, 낮 사진을 밤으로, 스케치를 실사로 — 모든 "이미지 A → 이미지 B" 변환을 하나의 프레임워크로 해결합니다. 다만 쌍(pair)으로 된 학습 데이터가 필요합니다.

주 등(Zhu et al.)의 CycleGAN은 Pix2Pix의 한계를 극복합니다. 쌍을 이루는 데이터 없이도 이미지 스타일을 변환할 수 있습니다.

핵심은 사이클 일관성(Cycle Consistency): 말 → 얼룩말로 바꾼 뒤, 다시 → 말로 되돌렸을 때 원본과 같아야 한다는 제약 조건입니다. 이 간단한 아이디어로 여름 풍경 ↔ 겨울 풍경, 사진 ↔ 모네 화풍 등의 변환이 가능해집니다.

머신러닝 모델은 데이터가 많을수록 성능이 좋아집니다. 하지만 현실에서는 데이터가 부족한 경우가 훨씬 많습니다:

GAN으로 현실적인 가짜 데이터를 대량 생성하면, 이런 부족한 데이터를 보충할 수 있습니다. 이를 데이터 증강(Data Augmentation)이라 하며, 의료 AI 분야에서 특히 활발하게 연구되고 있습니다.

GAN의 이미지 생성 능력이 강력해지면서, 그 기술이 악용되는 사례도 급증합니다.

딥페이크는 딥러닝(Deep Learning) + 페이크(Fake)의 합성어로, AI를 사용해 사람의 얼굴이나 음성을 합성하는 기술입니다. GAN이 핵심 기반 기술이며, 특히 얼굴 교체(Face Swap)에 널리 사용됩니다.

1. 데이터 수집: 타겟 인물의 영상/사진 수백~수천 장

2. GAN 학습: 인물의 얼굴 특징, 표정, 각도를 학습

3. 합성: 다른 사람의 영상에 타겟 인물의 얼굴을 자연스럽게 합성

4. 후처리: 경계선 블렌딩, 색상 보정, 깜빡임 동기화

결과: 구분이 거의 불가능한 가짜 영상

2018년 — Reddit 딥페이크 논란

2017년 말, Reddit에서 "deepfakes"라는 사용자가 유명인의 얼굴을 합성한 영상을 게시하며 큰 논란이 됩니다. Reddit은 2018년 2월 관련 서브레딧을 차단했지만, 이미 기술은 오픈소스로 확산된 뒤였습니다. 이 사건은 AI 생성 콘텐츠의 윤리적 문제를 전 세계에 알린 첫 번째 대형 사건입니다.

2019년 — 가봉 쿠데타 의혹

가봉의 대통령 알리 봉고가 건강 악화로 수개월간 공개 석상에 나타나지 않자, 정부가 발표한 신년 연설 영상이 딥페이크라는 의혹이 제기됩니다. 이 영상을 계기로 군부가 쿠데타를 시도합니다. 국가 안보에 AI 합성 기술이 직접적 위협이 된 최초의 사례 중 하나입니다.

2020년 — CEO 사기 통화

영국의 한 에너지 회사 CEO가 독일 모회사 CEO의 목소리를 흉내 낸 AI 음성으로 전화를 받고, 24만 3천 달러를 송금하는 사건이 발생합니다. 목소리의 억양, 미묘한 독일식 액센트까지 완벽히 재현되어 의심하지 못했습니다.

2024년 — 한국 딥페이크 범죄 급증

2024년 한국에서 텔레그램 기반의 딥페이크 성착취물 유통이 사회적 문제로 대두됩니다. 지인의 얼굴을 합성한 불법 콘텐츠가 조직적으로 제작·유포되면서, 딥페이크 처벌법 강화와 탐지 기술 개발에 대한 논의가 급물살을 탑니다.

흥미롭게도, GAN으로 만든 딥페이크를 잡는 데도 AI가 사용됩니다:

Microsoft의 Video Authenticator, Meta의 딥페이크 탐지 모델, 그리고 각국 정부·학계의 연구가 이 분야에서 활발히 진행 중입니다. 하지만 "창과 방패"의 관계처럼, 생성 기술이 발전하면 탐지도 어려워지는 군비 경쟁이 계속되고 있습니다.

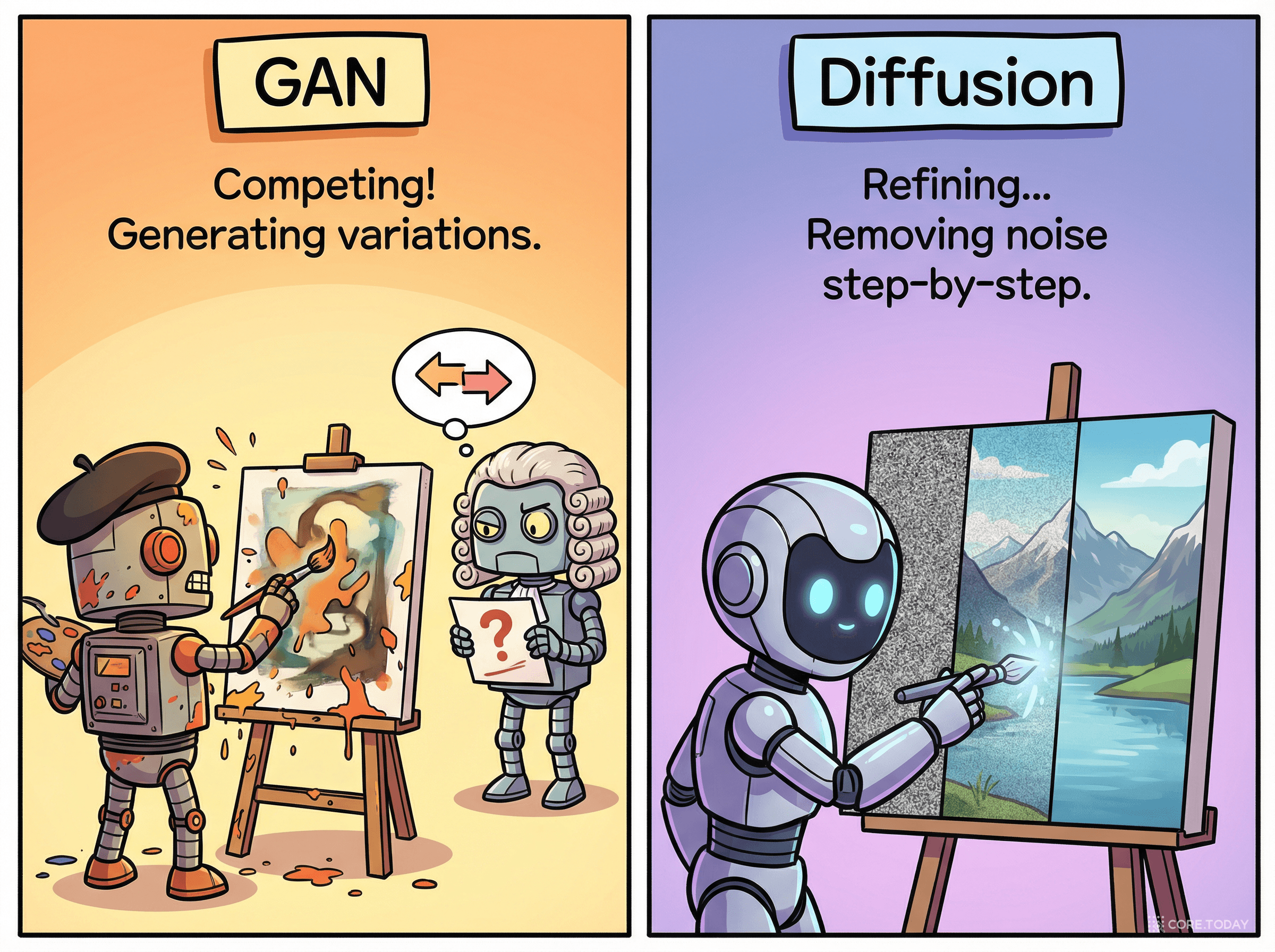

2025년 현재, AI 이미지 생성의 주류는 GAN에서 디퓨전 모델(Diffusion Model)로 넘어갔습니다. 이 세대교체를 이해하려면, 세 가지 생성 모델을 비교해야 합니다.

디퓨전 모델의 아이디어는 GAN과 정반대입니다:

핵심 논문은 호(Ho et al.)의 "Denoising Diffusion Probabilistic Models"(2020)입니다. 이 논문은 노이즈 제거 과정을 학습하는 것만으로 GAN에 필적하는 이미지를 생성할 수 있음을 보여줬습니다.

2022년 이후 디퓨전 모델이 GAN을 대체한 결정적 이유들:

아닙니다. GAN은 여전히 중요한 영역들이 있습니다:

실시간 생성: GAN은 한 번의 순전파로 이미지를 생성하므로, 디퓨전 모델보다 훨씬 빠릅니다. 게임, 실시간 필터 같은 속도가 중요한 곳에서는 GAN이 여전히 유리합니다.

초해상도(Super Resolution): ESRGAN, Real-ESRGAN 같은 GAN 기반 모델은 저해상도 이미지를 고해상도로 변환하는 데 여전히 최고 수준입니다.

의료 이미지 증강: GAN의 빠른 생성 속도와 조건부 생성 능력은 의료 영역에서 여전히 활발히 사용됩니다.

디퓨전 모델의 가속: 아이러니하게도, 디퓨전 모델의 느린 생성 속도를 개선하기 위해 GAN과 디퓨전을 결합하는 연구(예: consistency distillation)가 활발합니다.

적대적 학습의 원리: GAN의 핵심 아이디어인 "적대적 훈련"은 이미지 생성을 넘어 강건성 향상, 도메인 적응, 데이터 프라이버시 등 다양한 분야에서 활용됩니다.

GAN의 진짜 유산은 "예쁜 이미지를 만드는 모델"이 아니라, "두 시스템을 경쟁시키면 둘 다 강해진다"는 사고방식입니다.

이 아이디어는 이미지 생성을 넘어 다양한 곳에 적용됩니다:

GAN을 직접 학습시킬 일은 줄어들고 있지만, GAN의 핵심 아이디어를 이해하는 것은 여전히 중요합니다:

굿펠로우가 술집에서 떠올린 "두 네트워크를 경쟁시키자"는 아이디어는, 11년간 수천 편의 논문, 수십 개의 스타트업, 그리고 전 세계적인 딥페이크 논란을 낳았습니다.

GAN 자체는 디퓨전 모델에 주류 자리를 넘겨주었지만, GAN이 연 "기계가 창조할 수 있다"는 문은 다시 닫히지 않습니다. DALL-E, Stable Diffusion, Midjourney, Sora — 지금 우리가 경험하는 생성 AI 혁명의 모든 것은, 2014년 그 술집 대화에서 시작된 것입니다.

좋은 아이디어는 때로 복잡한 수식이 아니라, "만약에 이렇게 하면?"이라는 단순한 질문에서 시작됩니다.