AdamW 특집: 왜 거의 모든 LLM이 이 옵티마이저를 쓰는가

2017년, 프라이부르크의 두 연구자가 Adam의 가중치 감쇠에 숨겨진 버그를 발견했다. 이 '수정'이 BERT, GPT-3, LLaMA 등 거의 모든 대규모 언어 모델 학습의 표준이 되기까지 — AdamW의 탄생, 수학적 원리, 그리고 현대 AI에서의 위상을 추적한다.

2017년, 프라이부르크의 두 연구자가 Adam의 가중치 감쇠에 숨겨진 버그를 발견했다. 이 '수정'이 BERT, GPT-3, LLaMA 등 거의 모든 대규모 언어 모델 학습의 표준이 되기까지 — AdamW의 탄생, 수학적 원리, 그리고 현대 AI에서의 위상을 추적한다.

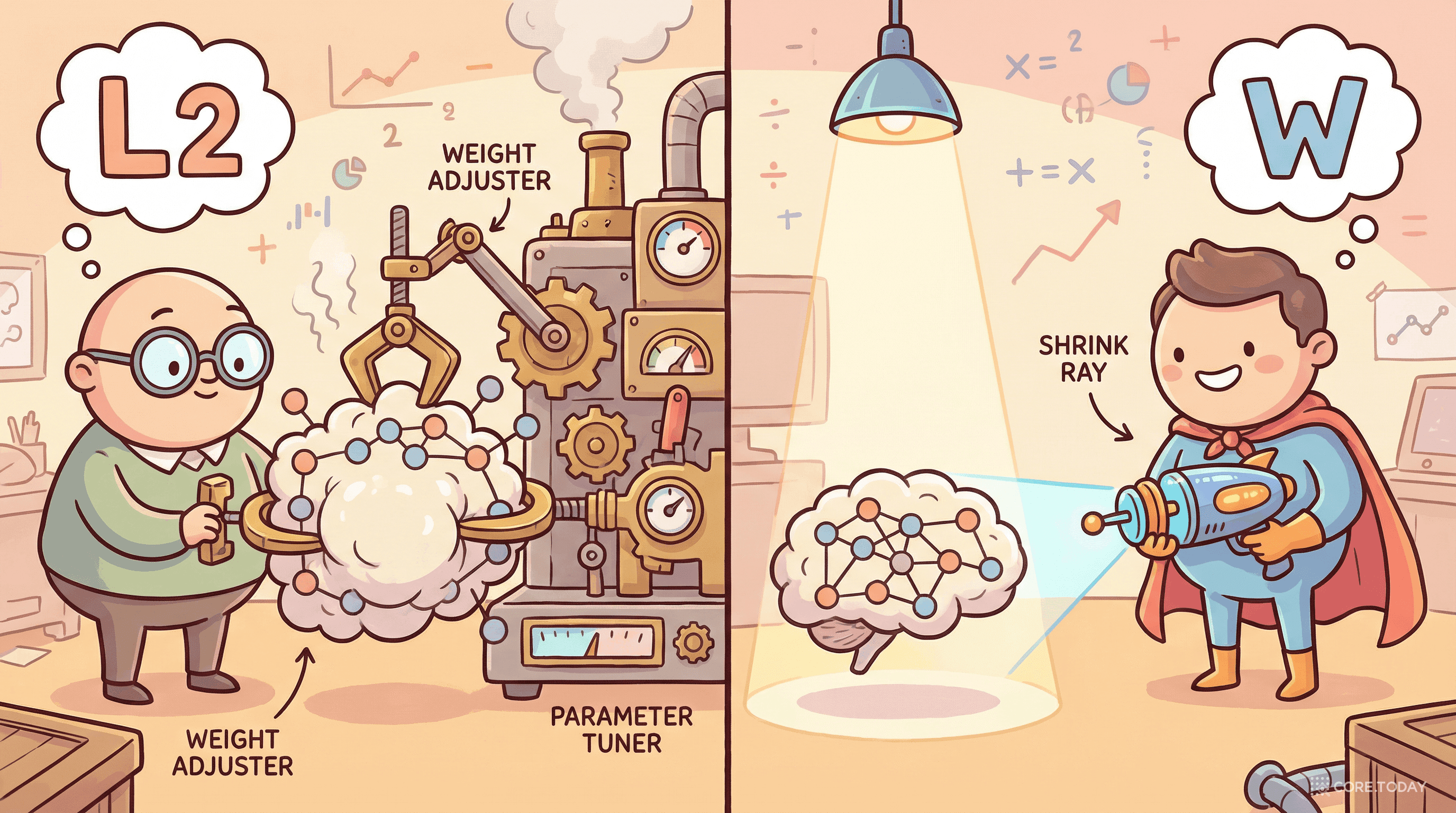

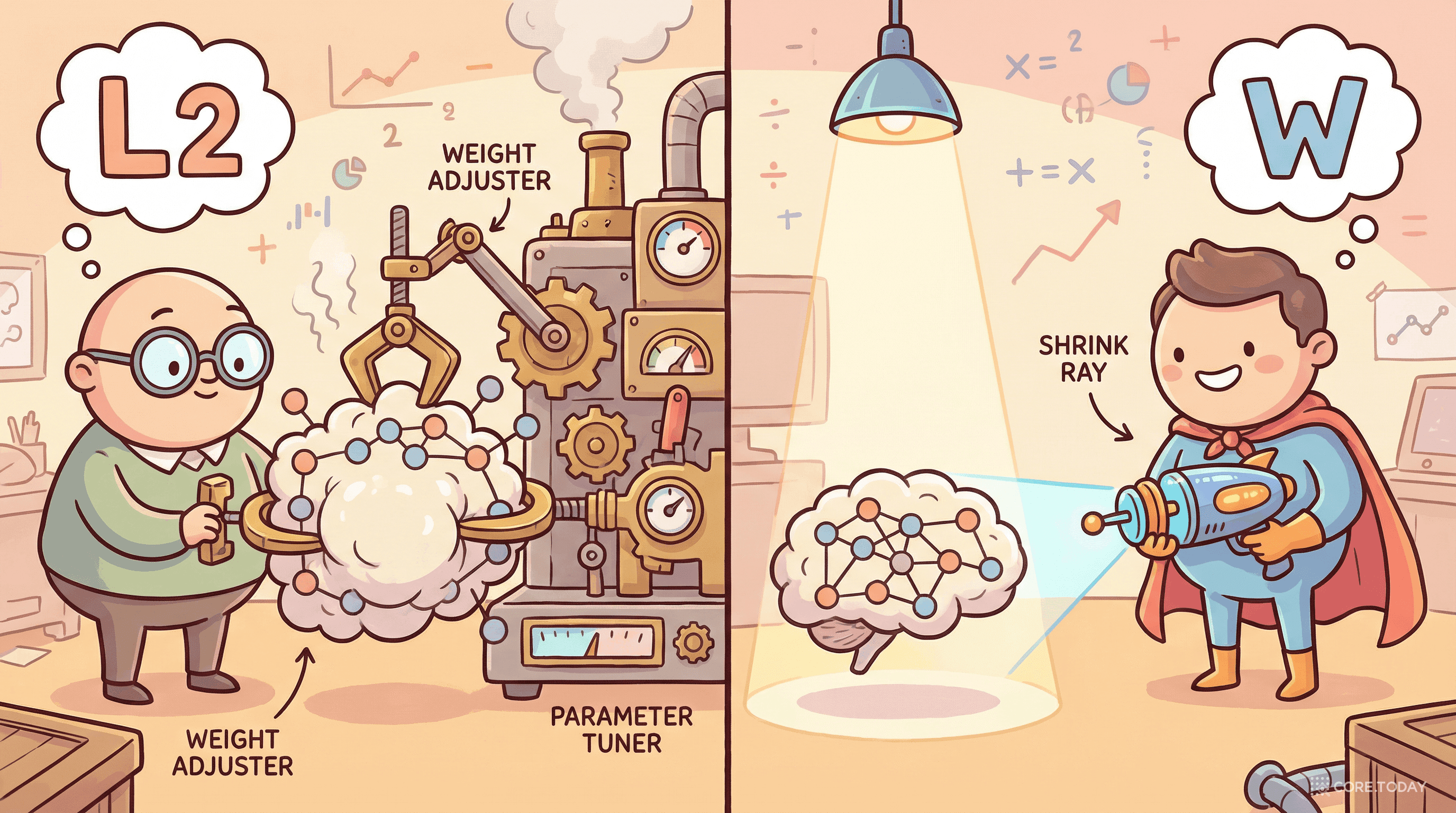

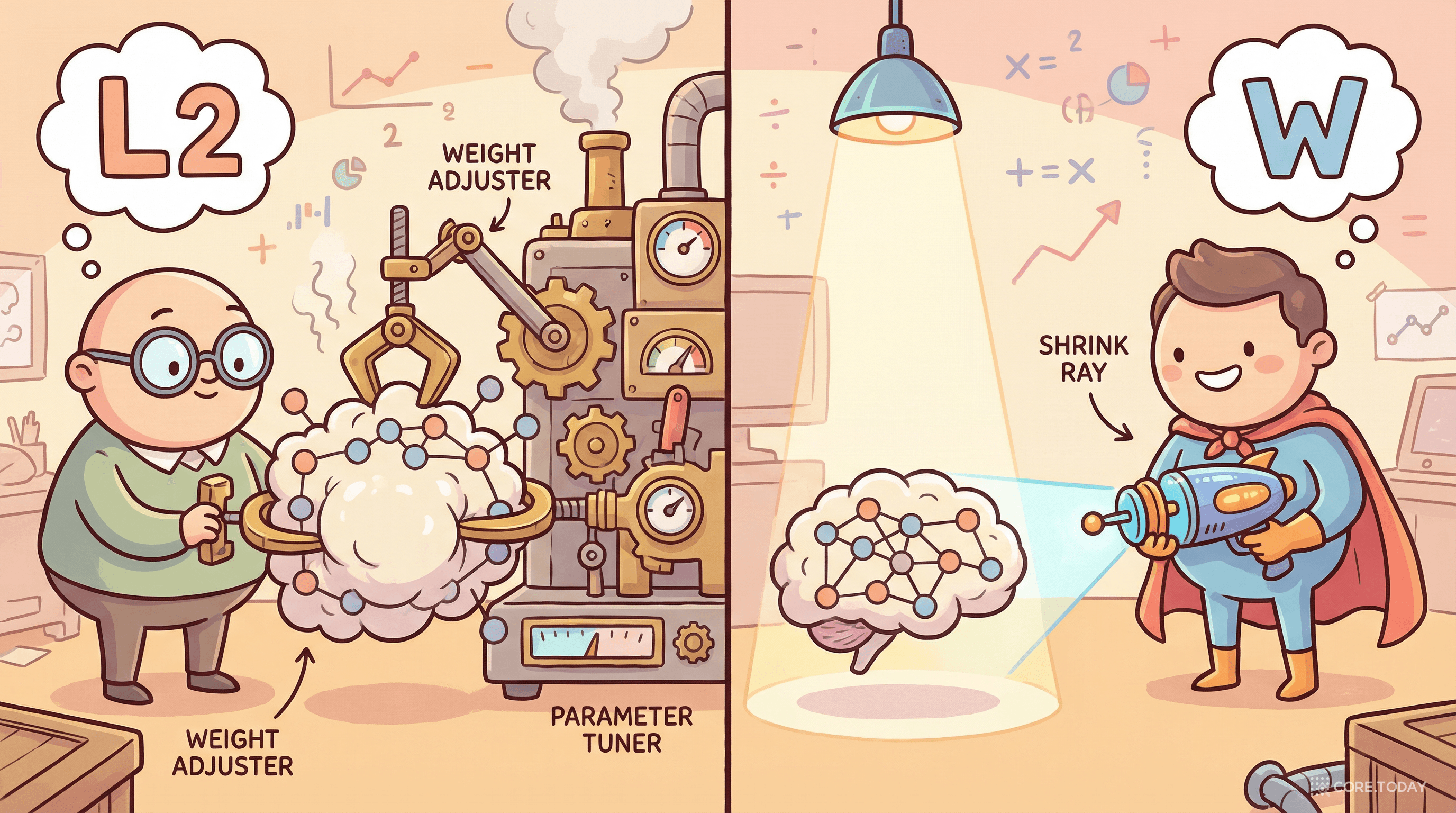

딥러닝 교과서에서 이런 문장을 본 적이 있을 것이다:

"가중치 감쇠(weight decay)와 L2 정규화는 동일하다."

이것은 SGD에서만 맞는 말이다. Adam에서는 틀리다.

2017년, 프라이부르크 대학의 일리야 로쉴로프(Ilya Loshchilov) 와 프랭크 후터(Frank Hutter) 가 이 사실을 발견했다. Adam에서 L2 정규화를 적용하면, 적응적 학습률이 정규화 효과를 왜곡시켜, 자주 업데이트되는 파라미터에 정규화가 덜 적용된다. 이것은 Adam의 원래 의도와 정반대다.

그들의 해법 — 가중치 감쇠를 기울기 업데이트에서 분리(decouple) 하는 것 — 이 바로 AdamW다. 이 단순한 수정이 GPT-3부터 LLaMA까지, 거의 모든 대규모 언어 모델 학습의 표준 옵티마이저가 되었다.

신경망이 학습 데이터에 너무 맞추면 과적합(overfitting) 이 발생한다. 과적합된 모델의 공통 특성: 가중치가 비정상적으로 크다. 큰 가중치는 입력의 작은 변화에도 출력이 급격히 변하게 만든다.

해법: 가중치를 작게 유지하도록 벌칙(penalty) 을 준다.

1988년 핸슨과 프랫(Hanson & Pratt, NIPS 1988) 이 가중치 감쇠를 최초 제안했고, 1992년 크로그와 헤르츠(Krogh & Hertz, NIPS 1991) 가 선형 네트워크에서 가중치 감쇠가 불필요한 가중치 성분을 억제하고 일반화를 개선함을 수학적으로 증명했다.

SGD에서 L2 정규화를 적용하면:

w := w - lr · (∇L + λ·w) = w - lr·∇L - lr·λ·w

가중치 감쇠를 적용하면:

w := (1-λ')·w - lr·∇L = w - lr·∇L - λ'·w

λ' = lr·λ로 재매개변수화하면 수학적으로 동일하다. 이것이 로쉴로프-후터 논문의 Proposition 1이다.

킹마(Kingma) 와 바(Ba) 의 Adam(ICLR 2015)은 두 가지 모멘트를 추적한다:

업데이트: w := w - lr · m̂ / (√v̂ + ε)

2차 모멘트 v가 크면 → 실제 학습률이 작아지고, v가 작으면 → 학습률이 커진다. 이것이 "적응적"의 의미다.

Adam에 L2 정규화를 적용하면 어떻게 될까?

이것은 Adam의 설계 결함이 아니라, L2 정규화가 적응적 옵티마이저에서 잘못 작동하는 것이다. 로쉴로프-후터 논문의 Proposition 2:

"적응적 옵티마이저에 대해, L2 정규화를 적용한 것과 동등한 가중치 감쇠 계수 λ'는 존재하지 않는다."

| 단계 | Adam + L2 | AdamW |

|---|---|---|

| 기울기 | ∇L + λ·w (L2 항 포함) | ∇L (순수 손실만) |

| 2차 모멘트 | (∇L + λ·w)² 에 오염됨 | ∇L² 만 추적 |

| 감쇠 적용 | 적응적 학습률에 의해 왜곡 | 균일하게 모든 파라미터에 적용 |

| 하이퍼파라미터 | lr과 λ가 결합 | lr과 λ가 독립 |

마지막 행이 실용적으로 중요하다. AdamW에서는 학습률과 가중치 감쇠를 독립적으로 튜닝할 수 있다. Adam+L2에서는 둘이 결합되어 있어 하이퍼파라미터 탐색이 어렵다.

둘은 이미 2016년에 SGDR(코사인 어닐링 + 따뜻한 재시작) 을 함께 발표한 바 있다. AdamW는 그들의 두 번째 대작이었다.

원래 제목 "Adam의 가중치 감쇠 정규화 수정"에서 "분리된 가중치 감쇠 정규화"로 바뀐 것은, 이것이 단순한 버그 수정이 아니라 새로운 원리임을 강조하기 위함이었다.

CIFAR-10과 ImageNet32x32에서 26-layer ResNet으로 실험:

AdamW가 발표된 후, 트랜스포머 기반 모델의 학습에 급속히 채택되었다:

GPT-3(Brown et al., 2020)가 확립한 AdamW + 선형 워밍업 + 코사인 감쇠 조합은 이후 사실상 모든 LLM의 표준 레시피가 되었다:

| 설정 | 소형 (125M~350M) | 중형 (1B~7B) | 대형 (13B~175B) |

|---|---|---|---|

| 학습률 | 3e-4 ~ 6e-4 | 1.2e-4 ~ 3e-4 | 0.6e-4 ~ 1.5e-4 |

| β₁ | 0.9 | 0.9 | 0.9 |

| β₂ | 0.95 | 0.95 | 0.95 |

| 가중치 감쇠 | 0.1 | 0.1 | 0.1 |

| 기울기 클리핑 | 1.0 | 1.0 | 1.0 |

모델이 커질수록 학습률이 낮아지는 패턴이 일관된다.

Hugging Face Transformers 라이브러리의 기본 옵티마이저는 adamw_torch다. get_cosine_schedule_with_warmup()과 결합하면 위의 표준 레시피가 완성된다.

로쉴로프와 후터가 2016년 발표한 SGDR(코사인 어닐링 + 따뜻한 재시작) 은 AdamW와 시너지를 이룬다.

이 조합은 BERT → GPT-3 → LLaMA를 거치며 트랜스포머 사전학습의 사실상 표준(de facto standard) 으로 확립되었다.

윌슨(Wilson) 등 (NeurIPS 2017) 은 "The Marginal Value of Adaptive Gradient Methods"에서 SGD+모멘텀이 동일한 하이퍼파라미터 튜닝 예산에서 적응적 방법보다 더 잘 일반화한다고 보였다. 이론적으로, 적응적 방법은 날카로운 최솟값(일반화 나쁨)에 수렴하는 경향이 있다.

AdamW는 적절한 가중치 감쇠로 이 격차를 상당 부분 줄였지만, CNN 이미지 분류에서는 여전히 SGD+모멘텀이 우세한 경우가 있다.

샤지어와 스턴(Shazeer & Stern, ICML 2018) 의 Adafactor는 2차 모멘트를 행/열별로 분해 저장한다. 메모리 O(m·n) → O(m+n). Google의 T5(110억 파라미터) 학습에 사용 — Adam의 메모리 비용이 감당 불가한 규모에서 필수적이다.

그러나 2026년 현재, AdamW는 여전히 LLM 학습의 기본 표준이다. 새로운 옵티마이저들이 특정 실험에서 우위를 보이지만, AdamW의 안정성, 검증된 레시피, 프레임워크 지원을 대체하기에는 아직 이르다.

AdamW의 핵심은 놀랍도록 단순하다: 가중치 감쇠를 기울기 업데이트에서 분리하라. 코드로는 몇 줄의 차이에 불과하다.

그러나 이 단순한 수정의 영향은 거대했다:

로쉴로프와 후터의 논문 원제가 "Adam의 가중치 감쇠 수정(Fixing)"이었다는 것은 의미심장하다. 때로는 세상을 바꾸는 데 혁명이 아니라 수정 하나면 충분하다.