TECH BLOG

기술 블로그

AI 기술 인사이트와 엔지니어링 경험을 공유합니다.

ALL POSTS

모든 포스트

RT-DETRv4 완전 이해: 거인의 지혜를 빌리다 — 비전 파운데이션 모델이 실시간 검출을 바꾸는 법

추론 비용 0으로 DINOv3의 지혜를 실시간 검출기에 주입하다 — Deep Semantic Injector와 Gradient-guided Adaptive Modulation으로 YOLO13, D-FINE, DEIM을 모두 넘어선 RT-DETRv4의 이야기.

DAPO 완전 해부: DeepSeek-R1의 비밀을 풀어낸 오픈소스 강화학습의 모든 것

DeepSeek-R1이 강화학습만으로 AI에게 '생각하는 법'을 가르쳤다고 했지만, 핵심 레시피는 비밀이었다. DAPO는 그 비밀을 4가지 기법으로 풀어내고, 절반의 훈련 스텝으로 더 높은 성능을 달성한 뒤 모든 코드를 공개했다. 엔트로피 붕괴부터 동적 샘플링까지, 대규모 RL의 진짜 난관과 해법을 논문 기반으로 풀어본다.

Terraform 입문: 인프라를 코드로 관리하는 시대

AWS 콘솔에서 클릭 100번 vs HCL 코드 한 파일. Infrastructure as Code의 핵심 도구 Terraform의 개념부터 실전 예제, State 관리, 모듈화, 그리고 BSL 라이선스 논란까지 — 클라우드 입문자를 위한 완전 가이드.

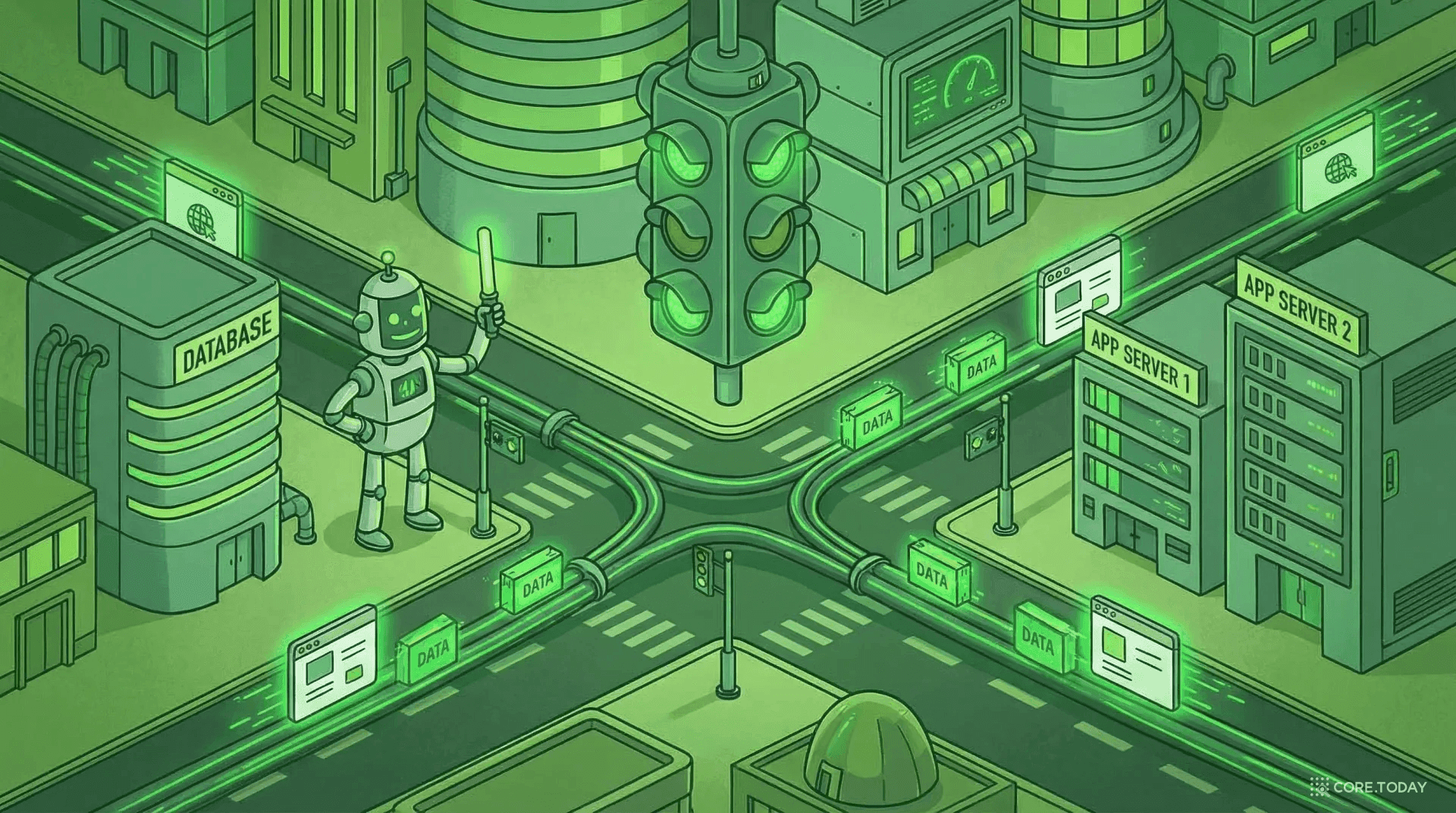

AWS SQS·SNS 완전 정복: 시스템 사이에 '메시지'를 보내는 기술

배달앱에서 주문 버튼을 누르면 뒤에서 수십 개의 시스템이 동시에 움직인다. 이 시스템들을 연결하는 '메시지 큐'와 '이벤트 알림'의 세계 — SQS와 SNS를 카페 주문 비유부터 실전 아키텍처까지 완전히 풀어본다.

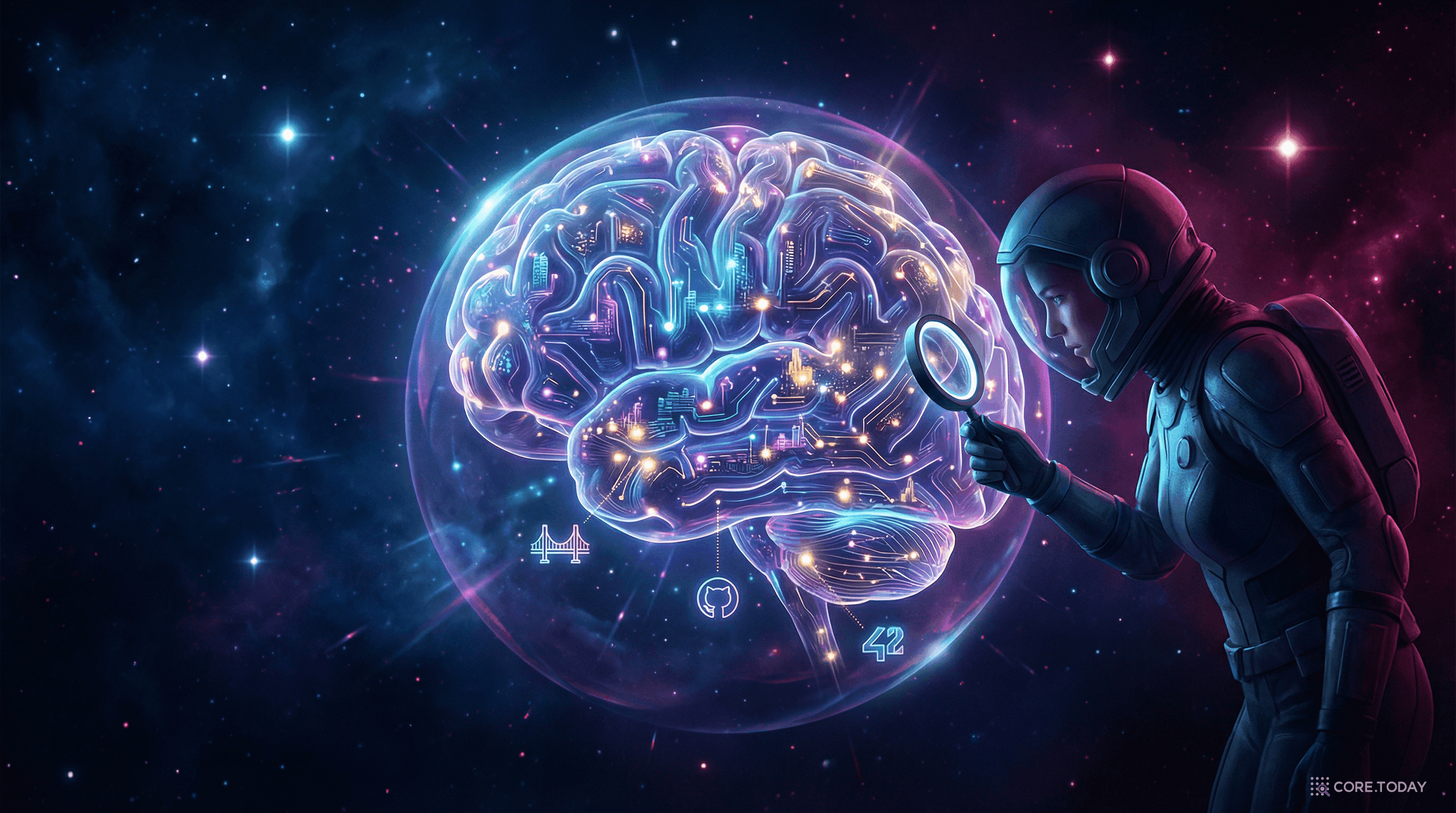

기계적 해석가능성 특집: AI의 '블랙박스'를 열어본 과학자들 — MIT 2026 10대 기술의 이유

MIT가 2026 10대 기술로 선정한 '기계적 해석가능성'은 AI의 블랙박스를 열고 내부 회로를 추적하는 기술이다. 금문교에 반한 Claude, 거짓말하는 AI를 잡아내는 법, 환각의 메커니즘까지 — AI를 MRI 찍듯 들여다보는 시대가 열리고 있다.

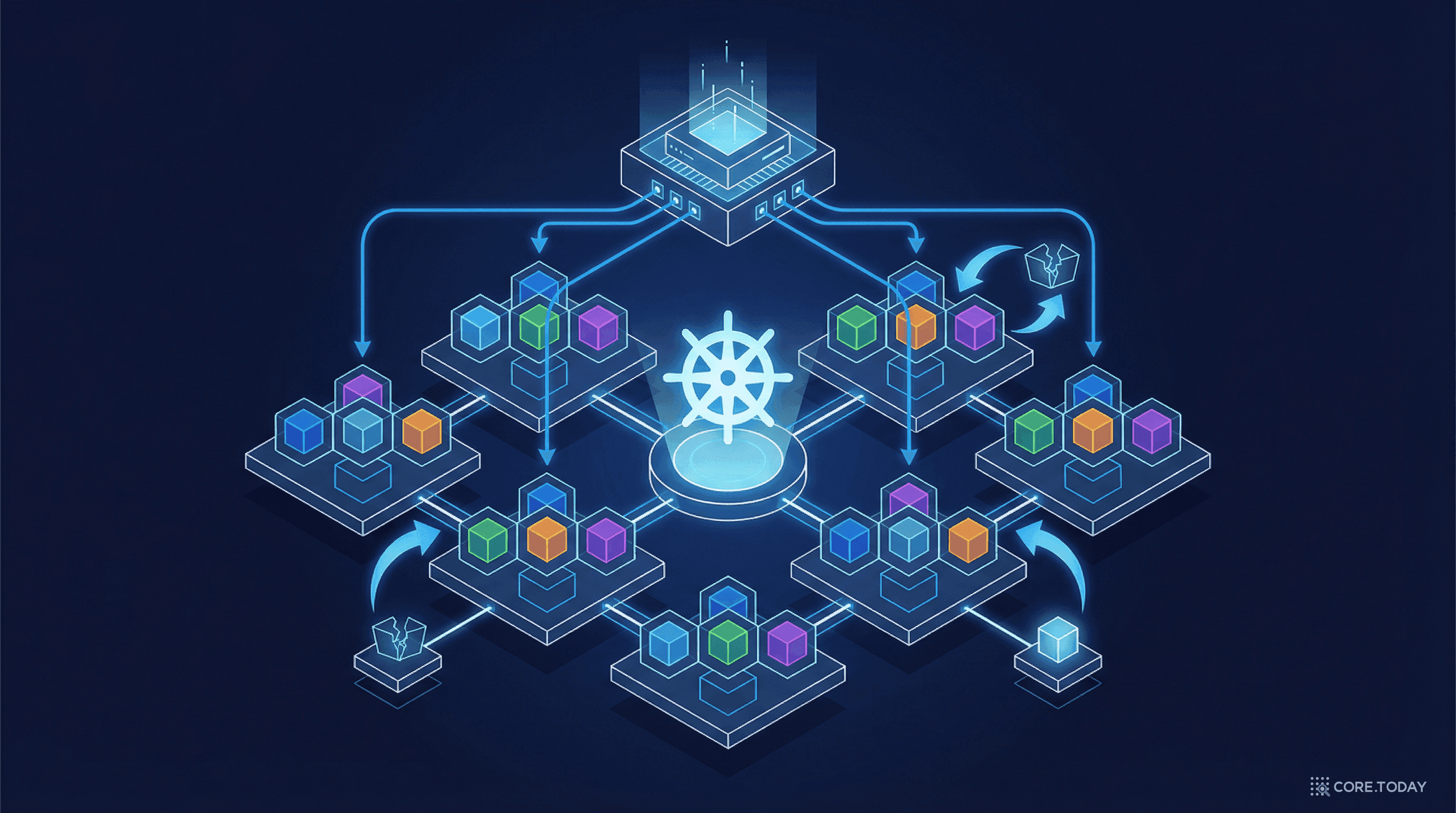

쿠버네티스 완전 정복: Google이 15년간 숨겨둔 비밀 병기의 모든 것

Google이 내부에서 15년간 운영한 Borg의 경험이 어떻게 쿠버네티스로 오픈소스화되었는지, 핵심 개념은 무엇이며, 왜 전 세계 기업의 사실상 표준이 되었는지를 역사·원리·실전 사례로 풀어본다.

12-Factor App: 클라우드 시대에 '잘 만든 앱'의 12가지 원칙

로컬에서 잘 돌아가던 앱이 클라우드에만 올리면 왜 망가질까? 2011년 Heroku 엔지니어들이 수천 개의 앱 배포 경험에서 뽑아낸 12가지 원칙을 한국어로, 비유와 안티패턴 중심으로 풀어본다. Docker, Kubernetes, 서버리스 시대에도 여전히 유효한 클라우드 네이티브 앱의 기본기.

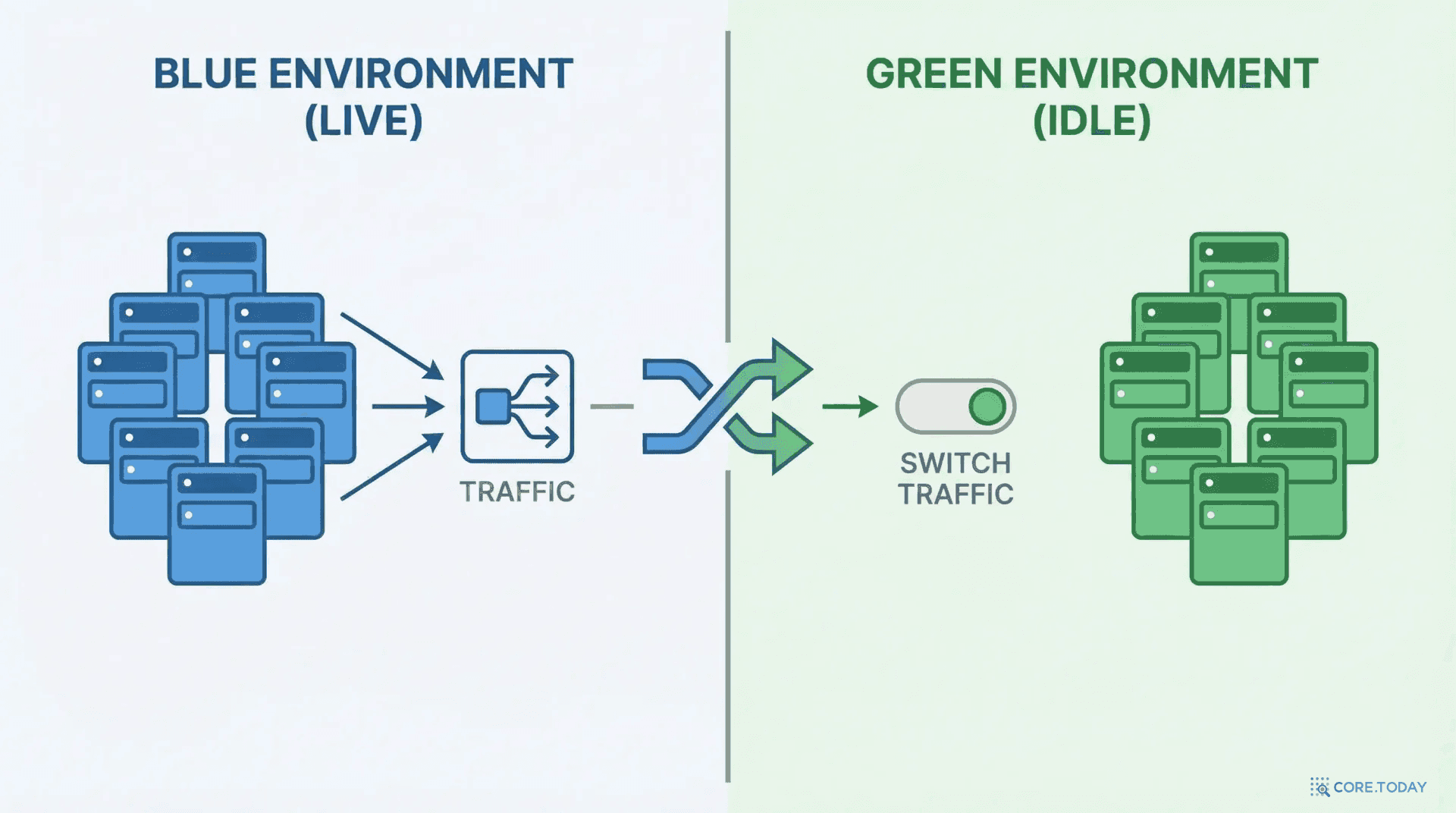

ArgoCD와 GitOps: Git에 푸시하면 쿠버네티스가 알아서 배포한다

kubectl apply를 수동으로 치는 것은 FTP 시대와 다를 바 없다. Git 저장소를 단일 진실의 원천으로 삼고, ArgoCD가 쿠버네티스 클러스터를 자동으로 동기화하는 GitOps 패러다임의 모든 것을 풀어본다.

AI가 '모르는 것을 아는' 법을 배우다 — Process Reward Model의 불확실성 캘리브레이션

수학 문제를 풀 때 AI는 '이 풀이가 맞을 확률'을 심각하게 과대평가한다. MIT 연구팀은 분위수 회귀로 이 과신을 교정하고, 문제 난이도에 따라 연산량을 자동 조절하는 프레임워크를 제안했다. NeurIPS 2025 논문을 쉽게 풀어본다.