TECH BLOG

기술 블로그

AI 기술 인사이트와 엔지니어링 경험을 공유합니다.

ALL POSTS

모든 포스트

LLM 정확도 최적화 완전 가이드: 프롬프트부터 파인튜닝까지

LLM이 틀리는 이유는 두 가지뿐이다 — 맥락이 부족하거나, 행동이 불안정하거나. OpenAI의 최적화 프레임워크를 중심으로 프롬프트 엔지니어링, RAG, 파인튜닝의 역사와 원리를 깊이 파헤치고, 실전 사례와 함께 2026년 최적화 전략을 완전 정리한다.

Git 완전 정복: 코드 버전 관리가 왜 팀 협업의 핵심인가

final_v2_진짜최종_수정3.pptx 시대를 끝내자. 리누스 토르발스가 2주 만에 만든 Git이 어떻게 현대 소프트웨어 협업의 기반이 되었는지 — 핵심 개념, 내부 구조, 브랜칭 전략, DevOps 연동까지 완전히 풀어본다.

서버리스란 무엇인가: 서버가 사라진 게 아니라, 당신의 문제 목록에서 사라진 것이다

EC2를 관리하고, Docker를 빌드하고, 쿠버네티스를 운영하는 것 — 이 모든 것의 끝에 '서버를 아예 신경 쓰지 않는' 세계가 있다. 서버리스가 왜 탄생했고, 무엇을 해결하며, 언제 써야 하고 언제 쓰지 말아야 하는지를 실전 사례와 함께 풀어본다.

Prometheus + Grafana: 오픈소스 모니터링의 표준 조합 완전 정복

서버가 죽기 5분 전에 알 수 있다면? 전 세계 개발자가 선택한 오픈소스 모니터링 표준 Prometheus와 Grafana를 데이터 모델부터 PromQL, Alertmanager, Kubernetes 클러스터 모니터링까지 완전 정복한다.

Vision-R1 특집: AI에게 '눈으로 보고 생각하는 법'을 가르치다 — 과잉사고의 함정부터 점진적 훈련까지

DeepSeek-R1이 텍스트에서 '생각하는 법'을 배웠다면, Vision-R1은 이미지를 보면서 생각하는 법을 배웠다. 하지만 그 과정에서 AI가 '쓸데없이 오래 생각하는' 과잉사고 문제에 빠졌다. ICLR 2026에서 발표된 이 논문이 제시한 점진적 사고 억제 훈련의 원리를, 일러스트와 인터랙티브 요소로 쉽고 깊게 풀어본다.

MongoDB 완전 정복: '스키마가 없는 DB'가 세계에서 가장 인기 있는 NoSQL이 된 이유

ALTER TABLE 없이 데이터 구조를 자유롭게 바꾸고, JSON을 그대로 저장하며, 수평 확장이 기본인 DB. MongoDB가 왜 탄생했고, 관계형 DB와 무엇이 다르며, 언제 써야 하고 쓰지 말아야 하는지를 라이선스 전쟁과 보안 사고까지 포함하여 풀어본다.

프롬프트 엔지니어링 완전 정복: AI에게 말 거는 기술의 모든 것

AI에게 '잘 물어보는 법'이 왜 이렇게 중요해졌을까? GPT-3의 등장부터 2026년 에이전트 시대까지, 프롬프트 엔지니어링의 역사·핵심 기법·실전 사례를 논문 기반으로 깊이 있게 풀어봅니다. 인터랙티브 실험실에서 직접 기법을 비교해 보세요.

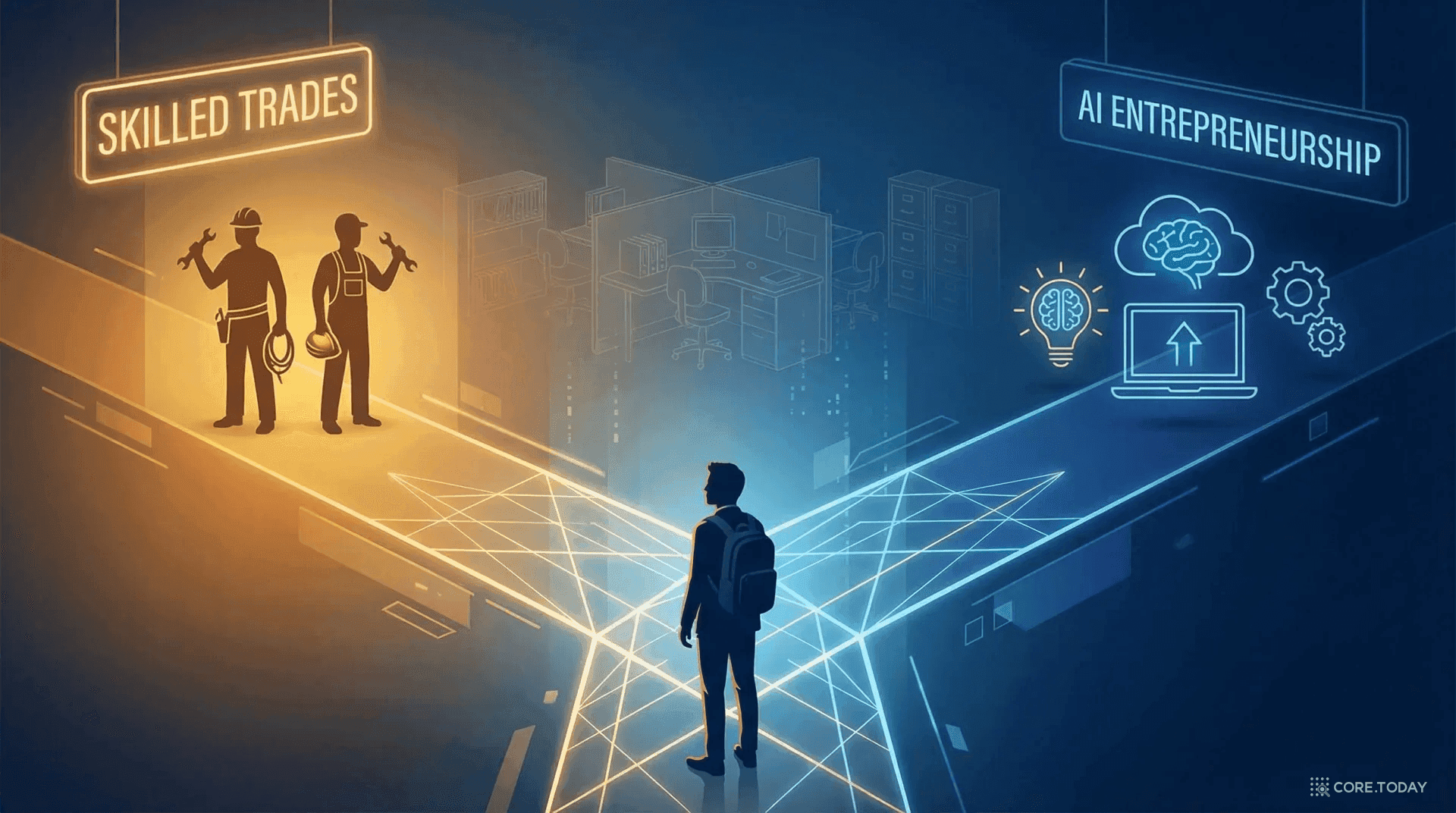

AI 시대, 청년들은 왜 커리어를 다시 설계하는가 — 대체 불가능한 일의 조건

보험 사무직이 소방관을 준비하고, 컴퓨터공학도가 전기 기술을 배운다. AI가 화이트칼라의 안전지대를 무너뜨리면서, 젊은 세대는 '대체 불가능한 일'을 찾아 움직이고 있다. 데이터와 역사가 말하는 커리어 전환의 논리.

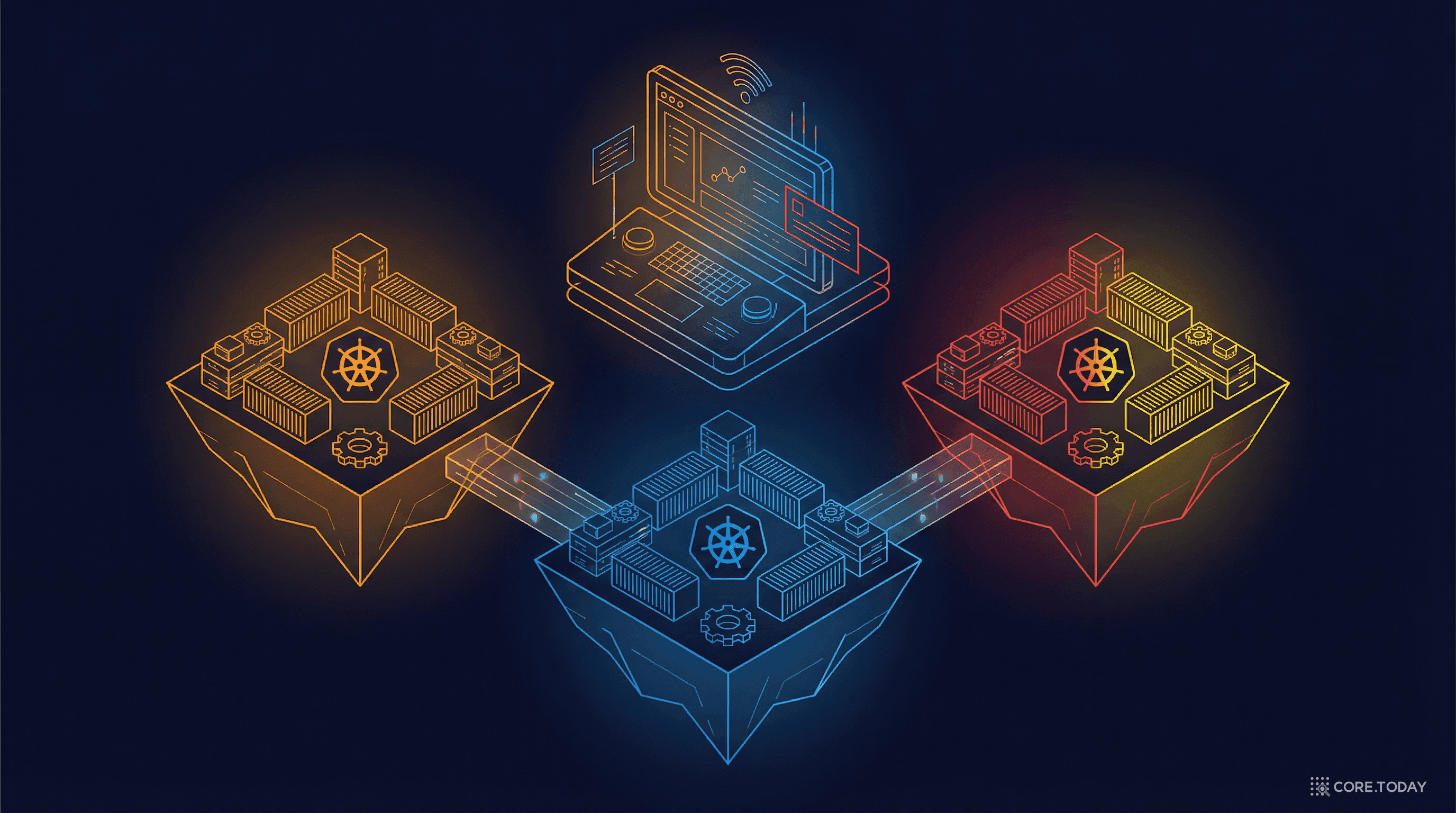

관리형 쿠버네티스 완전 가이드: EKS, GKE, AKS — 무엇을 선택할 것인가

쿠버네티스를 직접 운영하는 것은 '집을 짓는 것'이고, 관리형 서비스를 쓰는 것은 '아파트에 입주하는 것'이다. AWS EKS, Google GKE, Azure AKS가 왜 탄생했고, 어떤 차이가 있으며, 당신의 팀에 맞는 선택은 무엇인지를 실전 관점에서 풀어본다.