프롬프트 엔지니어링 완전 정복: AI에게 말 거는 기술의 모든 것

AI에게 '잘 물어보는 법'이 왜 이렇게 중요해졌을까? GPT-3의 등장부터 2026년 에이전트 시대까지, 프롬프트 엔지니어링의 역사·핵심 기법·실전 사례를 논문 기반으로 깊이 있게 풀어봅니다. 인터랙티브 실험실에서 직접 기법을 비교해 보세요.

AI에게 '잘 물어보는 법'이 왜 이렇게 중요해졌을까? GPT-3의 등장부터 2026년 에이전트 시대까지, 프롬프트 엔지니어링의 역사·핵심 기법·실전 사례를 논문 기반으로 깊이 있게 풀어봅니다. 인터랙티브 실험실에서 직접 기법을 비교해 보세요.

2024년 초, 한 스타트업 개발자가 커뮤니티에 올린 글이 화제가 되었다.

"GPT-4에게 코드 리뷰를 시켰는데, 매번 '좋은 코드입니다!'라고만 합니다. 비싼 돈 내고 칭찬봇을 쓰고 있는 기분이에요."

댓글에 달린 답변은 간단했다:

"프롬프트를 바꿔보세요. '당신은 10년 경력의 시니어 개발자입니다. 이 코드에서 버그, 성능 이슈, 보안 취약점을 반드시 3개 이상 찾아주세요'라고 하면 완전히 다른 결과가 나옵니다."

실제로 프롬프트를 바꾸자, 같은 모델이 NULL 포인터 참조, SQL 인젝션 취약점, O(n^2) 루프까지 정확히 짚어냈다. 모델은 그대로인데, 물어보는 방법만 바꿨을 뿐이었다.

이것이 바로 프롬프트 엔지니어링(Prompt Engineering)의 핵심이다.

OpenAI는 이를 이렇게 설명한다:

"모델이 생성하는 콘텐츠는 비결정적(non-deterministic)이기 때문에, 원하는 출력을 얻기 위한 프롬프팅은 예술과 과학의 혼합이다."

여기서 중요한 단어는 "일관되게"이다. AI에게 한 번 좋은 답을 얻는 것은 운이지만, 100번 물어서 90번 이상 좋은 답을 얻는 것은 엔지니어링이다.

OpenAI는 프롬프트의 역할 구조를 프로그래밍에 비유한다:

즉, 시스템 프롬프트는 함수를 정의하는 것이고, 사용자 메시지는 그 함수를 호출하는 것이다. 좋은 함수를 짜듯이 좋은 프롬프트를 설계해야 한다.

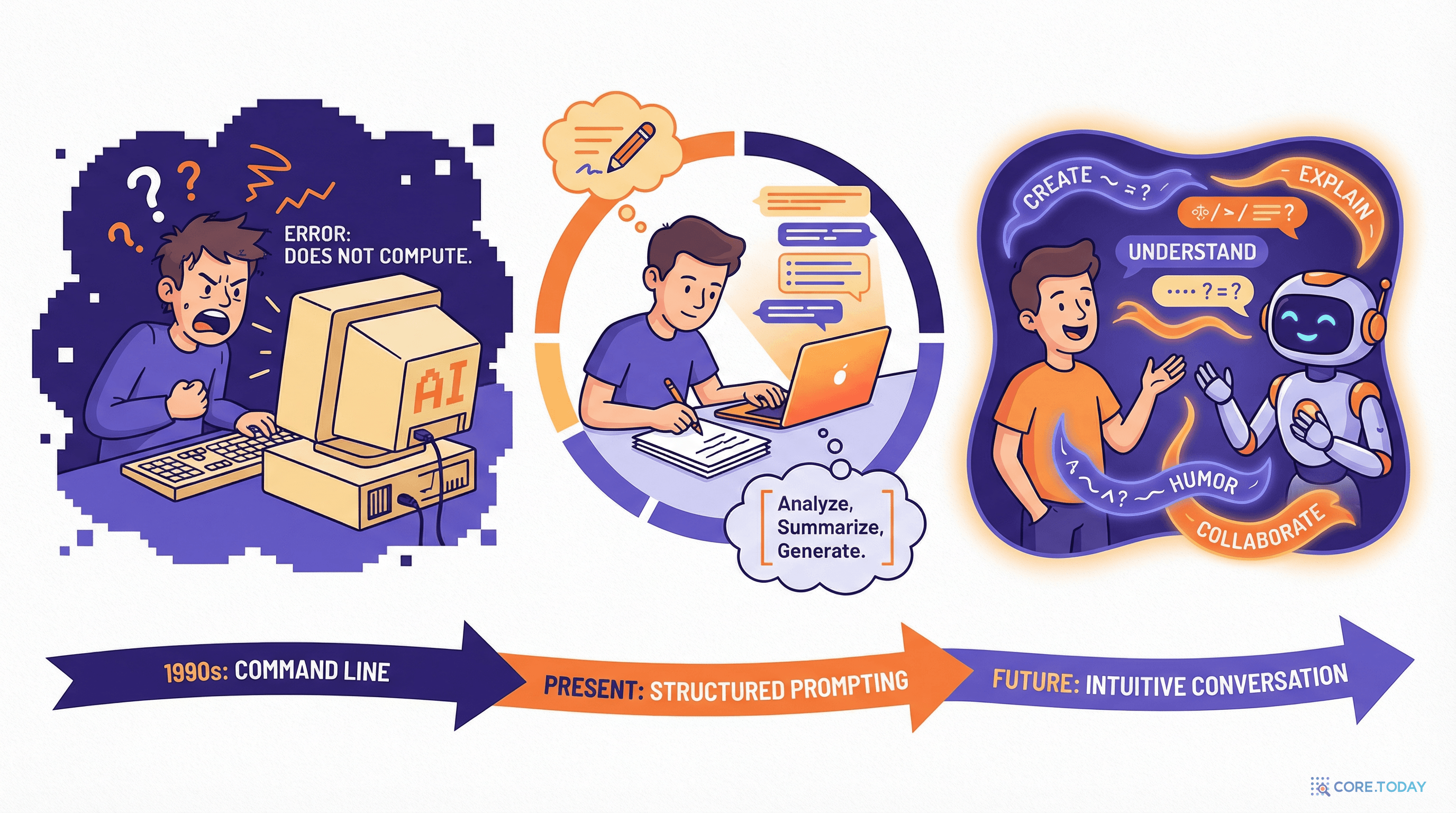

프롬프트 엔지니어링이 하늘에서 뚝 떨어진 것은 아니다. AI가 진화하면서 자연스럽게 등장한 분야다. 그 여정을 따라가 보자.

이제 본론으로 들어가자. 프롬프트 엔지니어링의 핵심 기법들을 하나씩 파헤쳐 보겠다. 각 기법이 왜 등장했는지, 어떤 원리인지, 실제로 얼마나 효과적인지 논문 데이터와 함께 살펴본다.

가장 기본적인 방법이다. 예시 없이, 지시만으로 작업을 수행한다.

언제 쓸까? 모델이 이미 잘 아는 단순한 작업 — 번역, 간단한 분류, 요약. 지시 조정(instruction-tuned) 모델인 ChatGPT, Claude 같은 모델에서 특히 잘 작동한다.

한계: 복잡한 포맷, 도메인 특화 작업, 미묘한 판단이 필요한 경우에는 결과가 불안정하다.

GPT-3 논문(Brown et al., 2020)이 세상에 알린 혁명적 발견이다.

OpenAI 가이드에서 제시하는 퓨샷 프롬프트의 모범 구조를 보자:

핵심 팁: 예시는 다양한 케이스를 커버해야 한다. 긍정 예시만 3개 넣으면 모델이 "항상 긍정"이라는 편향을 학습할 수 있다. OpenAI는 XML 태그(<product_review>, <assistant_response>)로 예시의 경계를 명확히 하라고 권장한다.

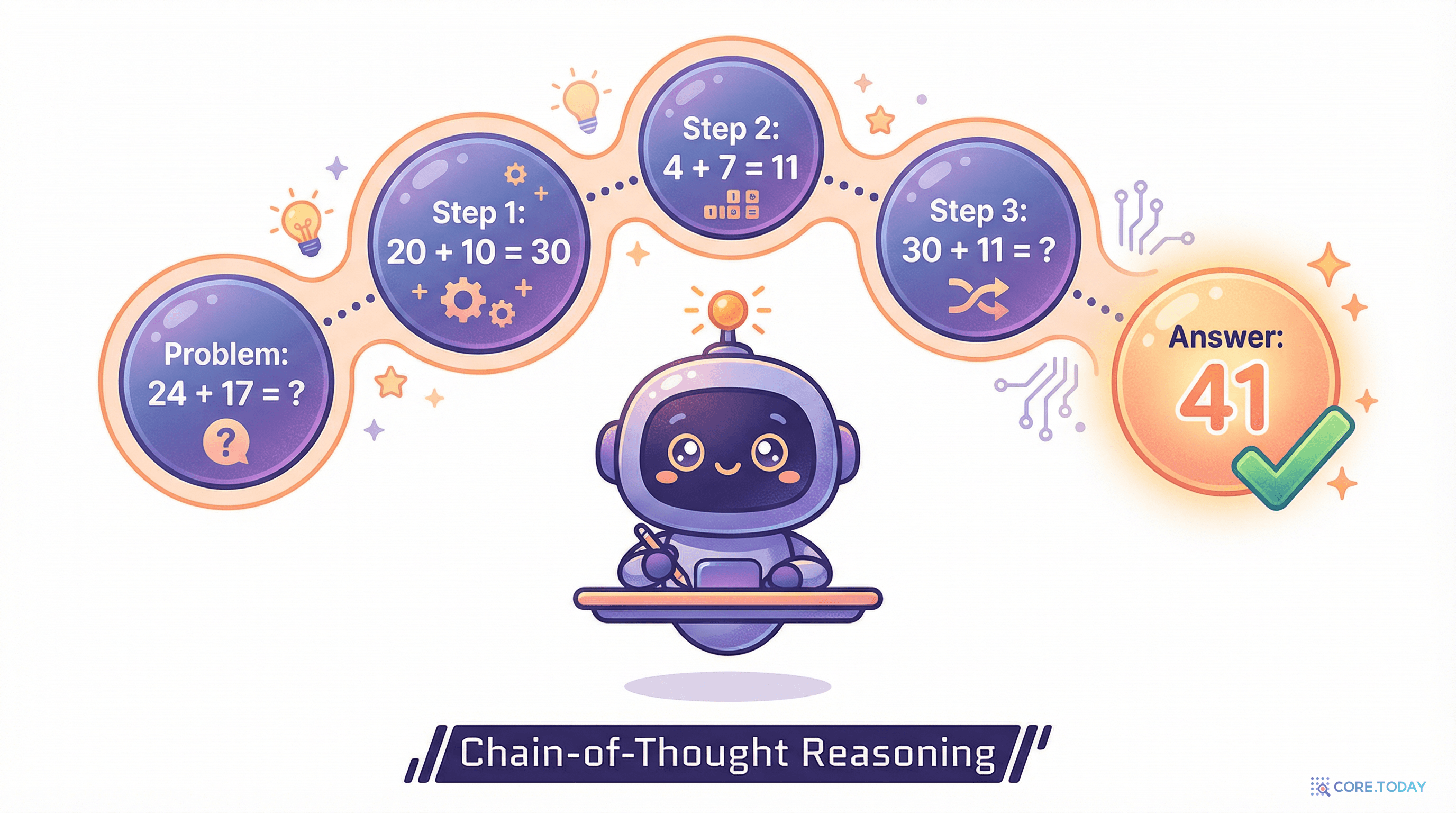

2022년, Wei et al.의 논문 하나가 AI의 추론 능력을 뒤바꿔 놓았다.

핵심 발견은 놀라울 만큼 단순하다:

왜 이런 일이 벌어질까?

사람도 마찬가지다. 복잡한 계산을 머릿속으로만 하면 틀리지만, 종이에 단계별로 쓰면 정확해진다. CoT는 AI에게 "연습장"을 쓰도록 유도하는 것이다.

중요한 발견: CoT는 대형 모델에서만 작동한다. 100억 파라미터 이하의 소형 모델에서는 오히려 성능이 떨어진다. 이것을 창발적 능력(emergent ability)이라고 한다 — 규모가 충분해야 비로소 "단계별 사고"가 가능해지는 것이다.

Wang et al.(2022)이 제안한 이 기법은 CoT를 한 단계 더 발전시킨다.

의사 결정에서 "세컨드 오피니언"을 받는 것과 같은 원리다. 한 명의 의사보다 다섯 명의 의사가 동의하는 진단이 더 신뢰할 수 있듯이.

GSM8K에서 CoT 단독 56.5% → CoT + Self-Consistency(40회 샘플) 74.4%. 단점은 비용이 N배로 늘어난다는 것. 정확도가 중요한 고가치 작업에 적합하다.

Yao et al.(2023)은 여기서 한 걸음 더 나아간다. 추론을 직선이 아닌 나무 구조로 확장한 것이다.

핵심 아이디어: LLM이 생성자(후보 생성)와 평가자(품질 판단) 역할을 동시에 수행하면서, BFS나 DFS 같은 고전적 탐색 알고리즘으로 최적 경로를 찾는다.

"24 게임"에서의 결과가 압도적이다:

주목할 점: CoT가 오히려 기본보다 나빠졌다(7.3% → 4.0%). 이 문제는 단순한 순차적 사고로는 해결할 수 없고, 여러 가능성을 탐색하고 되돌리는 능력이 필요하기 때문이다. ToT는 이 "되돌리기"를 가능하게 만들었다.

Yao et al.(2022)의 ReAct는 현대 AI 에이전트의 직접적인 조상이다.

ReAct가 혁명적인 이유:

HotpotQA에서 ReAct가 CoT와 Act-only를 모두 앞질렀다. 그리고 이 패턴은 2026년 현재 Claude Code, ChatGPT, Cursor 같은 모든 AI 에이전트의 근간이 되었다.

OpenAI 가이드가 강조하는 메시지 역할 체계에서 핵심이 되는 기법이다.

| 역할 | Developer | User | Assistant |

|---|---|---|---|

| 의미 | 앱 개발자가 설정한 지시 | 최종 사용자의 입력 | 모델이 생성한 응답 |

| 우선순위 | 가장 높음 | 중간 | 낮음 |

| 비유 | 함수 정의 | 함수 인자 | 리턴 값 |

| 예시 | "당신은 법률 전문가" | "이 계약서 검토해줘" | (AI의 분석 결과) |

같은 모델이지만, 역할에 따라 완전히 다른 응답을 한다:

2024년 이후 급격히 중요해진 기법이다. 모델의 출력을 JSON, XML 등 정해진 스키마로 강제한다.

# OpenAI Structured Outputs 예시

from openai import OpenAI

client = OpenAI()

response = client.responses.create(

model="gpt-4.1",

input="서울 맛집 3곳을 추천해줘",

text={

"format": {

"type": "json_schema",

"name": "restaurant_list",

"schema": {

"type": "object",

"properties": {

"restaurants": {

"type": "array",

"items": {

"type": "object",

"properties": {

"name": {"type": "string"},

"cuisine": {"type": "string"},

"price_range": {"type": "string"},

"reason": {"type": "string"}

}

}

}

}

}

}

}

)

왜 중요한가? AI의 출력을 프로그래밍적으로 처리해야 하는 모든 경우 — API 응답, 데이터 파이프라인, 자동화 워크플로우 — 에서 "가끔 JSON이 깨진다"는 문제를 원천적으로 해결한다.

아래 실험실에서 각 프롬프트 기법이 어떻게 동작하는지 직접 확인해 보세요. 기법을 선택하면 프롬프트 구조, 난이도, 효과, 비용을 한눈에 비교할 수 있습니다.

| 기법 | 난이도 | 효과 | 비용 | 최적 사용 시나리오 |

|---|---|---|---|---|

| 제로샷 | ★☆☆☆☆ | 보통 | 최저 | 간단한 분류, 번역, 요약 |

| 퓨샷 | ★★☆☆☆ | 높음 | 낮음 | 패턴 맞추기, 포맷 통일 |

| Chain-of-Thought | ★★☆☆☆ | 매우 높음 | 중간 | 수학, 논리, 다단계 분석 |

| Self-Consistency | ★★★☆☆ | 매우 높음 | 높음 (N배) | 정확도 최우선 작업 |

| Tree of Thoughts | ★★★★☆ | 최고 | 매우 높음 | 퍼즐, 전략, 창의적 작업 |

| ReAct | ★★★★☆ | 매우 높음 | 중간 | 정보 검색, 에이전트 시스템 |

| 역할 프롬프팅 | ★☆☆☆☆ | 높음 | 최저 | 톤 제어, 전문성 유도 |

| 구조화된 출력 | ★★☆☆☆ | 높음 | 낮음 | API 연동, 데이터 파이프라인 |

OpenAI의 최신 가이드(2026년 3월 업데이트)에서 특히 주목할 만한 내용을 정리했다.

이 차이는 결정적으로 중요하다. 같은 프롬프트가 GPT-5에서는 최적이지만, o3에서는 오히려 방해가 될 수 있다.

OpenAI가 제시하는 Developer 메시지의 이상적 구조:

OpenAI가 GPT-5의 에이전트 작업에서 특별히 강조하는 패턴이다:

OpenAI 가이드의 실용적 조언 중 가장 즉시 적용 가능한 것:

반복적으로 사용되는 콘텐츠를 프롬프트 앞쪽에, API 요청 JSON의 앞쪽 파라미터에 배치하세요. 이렇게 하면 프롬프트 캐싱의 비용과 지연 시간 절감 효과를 극대화할 수 있습니다.

"잘 물어보기"가 정말 그렇게 중요할까? 데이터가 말해준다.

McKinsey의 2024년 글로벌 AI 서베이에 따르면, 생성 AI를 사용하는 기업의 72%가 프롬프트 설계를 "중요" 또는 "매우 중요"한 배포 성공 요인으로 꼽았다.

잘 설계된 프롬프트는 더 작고 저렴한 모델로도 큰 모델의 성능을 낼 수 있게 한다:

2026년의 프롬프트 엔지니어링은 더 이상 "한 줄의 질문을 잘 쓰기"가 아니다. 업계에서는 점점 "컨텍스트 엔지니어링(Context Engineering)"이라는 용어를 쓰기 시작했다:

APE(2022), OPRO(2023), DSPy(2023) 등의 연구가 보여주었듯, 프롬프트 자체를 AI가 최적화하는 시대가 열렸다. DSPy는 프롬프트를 프로그래밍 가능한 모듈로 취급하여, 데이터를 기반으로 자동으로 최적의 프롬프트와 예시를 찾아낸다.

APE가 자동으로 발견한 CoT 프롬프트 — "Let's work this out in a step by step way to be sure we have the right answer" — 는 수동으로 발견된 "Let's think step by step"보다 약간 더 효과적이었다.

OpenAI가 반복해서 강조하는 것:

프로덕션 애플리케이션은 특정 모델 스냅샷에 고정(pin)하고, 프롬프트 성능을 측정하는 eval을 구축하세요.

프롬프트 엔지니어링이 "감으로 하는 작업"에서 데이터 기반 엔지니어링으로 성숙한 것이다. 프롬프트를 변경할 때마다 자동화된 테스트가 성능 회귀를 감지해야 한다.

이 글에서 다룬 핵심 논문들을 정리했다. 더 깊이 공부하고 싶다면 이 논문들부터 시작하자.

| 논문 | 저자 | 연도 | 핵심 기여 |

|---|---|---|---|

| Language Models are Few-Shot Learners | Brown et al. | 2020 | 인컨텍스트 학습 패러다임 확립 |

| Chain-of-Thought Prompting | Wei et al. | 2022 | 단계별 추론으로 수학 능력 3배 향상 |

| Self-Consistency | Wang et al. | 2022 | 다수결 투표로 CoT 정확도 추가 향상 |

| ReAct | Yao et al. | 2022 | 추론+행동 패턴 — AI 에이전트의 원형 |

| Tree of Thoughts | Yao et al. | 2023 | 탐색 알고리즘을 프롬프팅에 도입 |

| APE (Automatic Prompt Engineer) | Zhou et al. | 2022 | 프롬프트 자동 최적화의 시작 |

| DSPy | Khattab et al. | 2023 | 프롬프트를 프로그래밍 가능한 모듈로 |

| Toolformer | Schick et al. | 2023 | LLM이 스스로 도구 사용을 학습 |

| Many-Shot ICL | Agarwal et al. | 2024 | 수백 개 예시가 수 개보다 효과적 |

프롬프트 엔지니어링을 시작하는 사람들을 위한 실전 가이드다.

프롬프트 엔지니어링은 단순한 기술 스킬이 아니다. 이것은 AI 시대의 리터러시(문해력)이다.

인쇄 혁명 이후 "글을 읽고 쓰는 능력"이 교양의 기본이 되었듯, AI 혁명 이후 "AI와 효과적으로 소통하는 능력"은 모든 지식 노동자의 기본 역량이 될 것이다.

2020년 GPT-3의 퓨샷 학습에서 시작된 이 여정은, 2022년 CoT와 ReAct를 거쳐, 2026년 현재 멀티 에이전트 시스템 설계까지 이어지고 있다. 기법은 점점 정교해지고 있지만, 핵심 원리는 놀라울 만큼 일관적이다:

명확하게 말하라. 맥락을 제공하라. 예시를 보여줘라. 단계별로 생각하게 하라.

이 네 가지 원칙을 기억한다면, AI가 어떻게 진화하든 당신은 항상 AI에게 "잘 물어보는 사람"이 될 수 있다.