PINN은 왜 자꾸 학습에 실패하는가 — Loss Landscape 관점으로 다시 읽는 훈련의 핵심

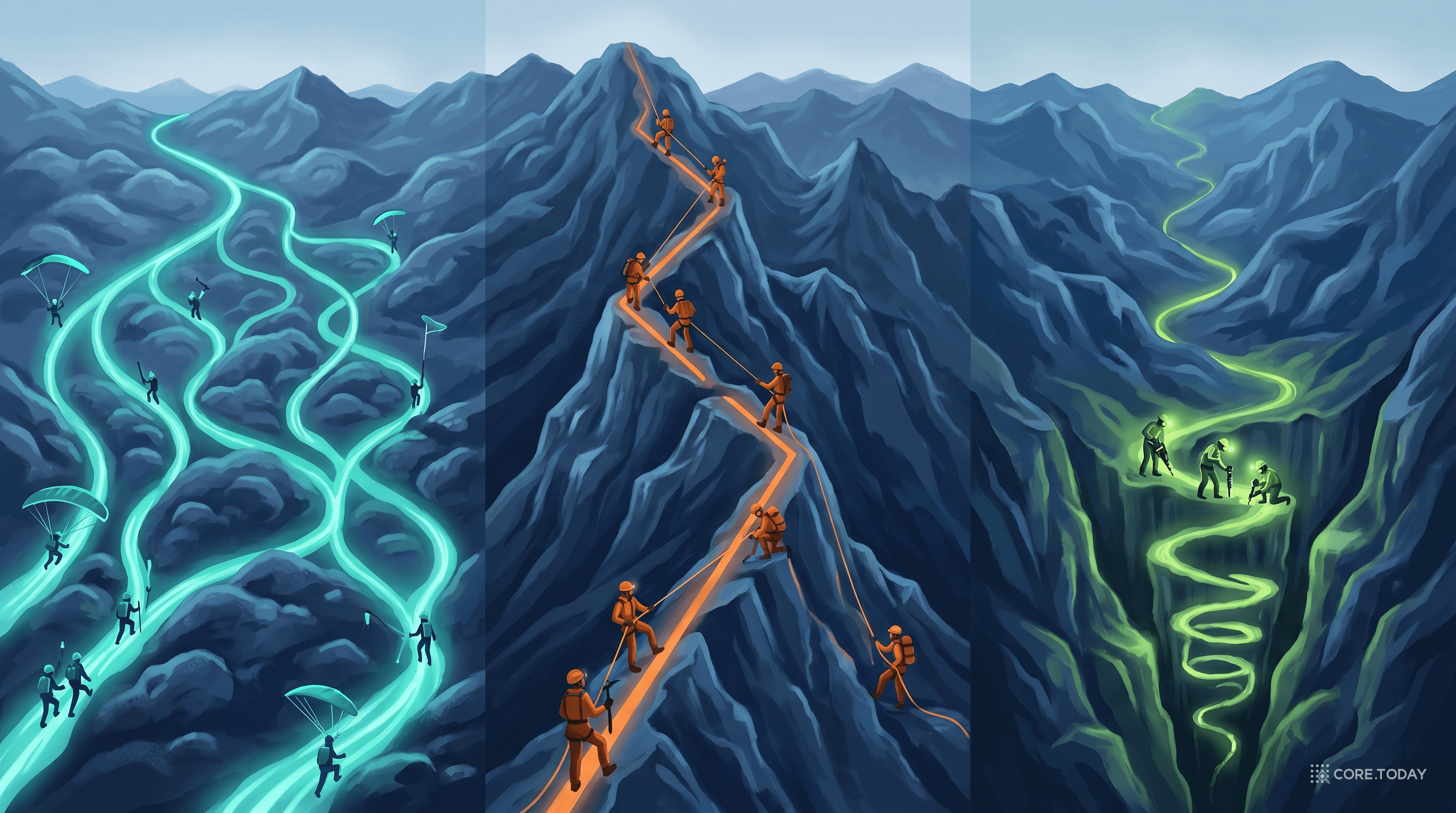

PINN은 왜 물리식을 알고도 자주 무너질까? ICML 2024의 대표 논문을 중심으로, Hessian 스펙트럼, ill-conditioning, Adam-L-BFGS-NNCG의 역할, 그리고 2026년 현재 PINN 최적화 문헌사의 흐름까지 깊고 쉽게 해설한다.

PINN은 왜 물리식을 알고도 자주 무너질까? ICML 2024의 대표 논문을 중심으로, Hessian 스펙트럼, ill-conditioning, Adam-L-BFGS-NNCG의 역할, 그리고 2026년 현재 PINN 최적화 문헌사의 흐름까지 깊고 쉽게 해설한다.

편미분방정식(PDE)을 안다는 것은 보통 문제의 구조를 안다는 뜻이다. 지배 방정식, 경계조건, 초기조건이 주어지면 수치해석자는 "이제 남은 것은 잘 푸는 일"이라고 생각한다. 그래서 PINN(Physics-Informed Neural Networks)은 처음 등장했을 때 거의 혁명처럼 보였다. 신경망의 손실함수 안에 물리식을 직접 넣으면, 데이터가 거의 없어도 해를 학습할 수 있고, 심지어 역문제까지 하나의 프레임워크로 다룰 수 있을 것처럼 보였기 때문이다.

하지만 지난 몇 년의 경험은 냉정했다. 방정식을 알고 있다는 사실만으로는 충분하지 않다. optimizer가 그 방정식이 만들어낸 손실 지형을 실제로 내려갈 수 있어야 한다. PINN이 자주 실패하는 이유는 "네트워크가 물리를 몰라서"가 아니라, 물리를 손실로 넣는 순간 생기는 최적화 지형이 지나치게 뒤틀려 있기 때문이다.

이 글의 핵심 논지는 명확하다. PINN의 실패는 근본적으로 architecture의 빈약함보다 ill-conditioned loss landscape의 문제다. 이 관점을 가장 선명하게 제시한 논문이 바로 Rathore et al.의 ICML 2024 논문 Challenges in Training PINNs: A Loss Landscape Perspective이다. 이 논문은 reaction ODE, convection PDE, wave PDE를 통해, 왜 PINN이 near-zero loss를 요구하는지, 왜 Hessian 스펙트럼이 망가지는지, 왜 Adam 이후에 L-BFGS, 나아가 NNCG 같은 2차 정보 기반 정련이 필요한지를 실증적으로 보여준다.

이 특집은 그 논문을 중심축으로 삼되, Wang et al.의 gradient pathology, NTK 분석, adaptive weighting 계열, 그리고 2025~2026년의 constrained optimization 흐름까지 연결해 본다. 이미 이 블로그에 있는 Sharp-PINNs 해설이 "결합 PDE에서 그래디언트 충돌을 어떻게 다룰 것인가"를 보여줬다면, 이 글은 그보다 더 밑바닥의 질문, 즉 왜 PINN 훈련 자체가 이렇게 자주 정체되는가를 다룬다. 또 KAN, PINN, Neural Operator 비교은 패러다임 간 위치를 비교했다면, 여기서는 그중 PINN 내부의 최적화 병목을 현미경처럼 확대한다.

PINN의 계보를 2019년 Raissi에서만 시작하면 절반만 보는 셈이다. 더 오래된 출발점은 1998년의 Lagaris, Likas, Fotiadis 논문이다. 이 초기 연구는 신경망 출력을 경계조건을 만족하는 형태로 재매개화해 미분방정식을 푸는 아이디어를 제시했다. 당시에는 자동미분도, 지금 같은 GPU 생태계도 없었기 때문에 접근 자체가 널리 퍼지지 못했다.

전환점은 Raissi, Perdikaris, Karniadakis (2019)였다. 이 논문은 PINN을 하나의 범용 프레임워크로 정리했다. forward problem에서는 물리식이 정답 분포를 제약하는 도구가 되고, inverse problem에서는 부족한 관측치와 PDE 구조를 결합해 미지의 계수나 파라미터를 추정할 수 있다. 딥러닝 프레임워크의 자동미분 덕분에 , 같은 미분 항을 손으로 유도하지 않고도 바로 손실로 넣을 수 있게 되면서, "메시 없이 PDE를 학습한다"는 약속이 현실의 문장으로 바뀌었다.

초기 환상은 충분히 이해할 만했다. 수치해석의 관점에서 보면 PINN은 다음 세 가지 약속을 동시에 했다.

이 약속은 지금도 완전히 거짓은 아니다. 실제로 2021년 Karniadakis et al.의 Nature Reviews Physics 리뷰는 physics-informed ML을 forward/inverse problem, hidden physics discovery, high-dimensional scientific learning까지 포괄하는 큰 흐름으로 정리했다. 문제는 "개념이 옳다"와 "훈련이 안정적이다"가 전혀 다른 명제라는 점이다.

2020년 전후로 현장의 경험은 점차 다른 사실을 드러냈다. 간단한 toy PDE는 잘 맞는데, 조금만 강한 대류가 들어가거나, 진동성이 생기거나, 손실 항 사이의 스케일이 어긋나면 학습이 멈춘다. 어떤 경우에는 네트워크 폭을 늘려도, activation을 바꿔도, collocation point를 늘려도 충분하지 않았다. 이때부터 질문이 바뀌기 시작한다. "PINN은 좋은 아이디어인가?"가 아니라, "PINN이 풀고 있는 최적화 문제는 애초에 잘 풀리도록 생겼는가?"

Rathore et al. 2024의 첫 번째 공헌은 문제 설정을 다시 쓰는 데 있다. PINN이 어려운 이유를 단순히 "local minimum이 많아서" 혹은 "모델 capacity가 부족해서"로 설명하지 않는다. 대신 좋은 해를 얻으려면 정말로 near-zero loss 영역까지 들어가야 한다는 점을 강조한다.

일반적인 supervised learning에서는 손실이 어느 정도 낮아지면 예측 품질이 이미 충분히 좋을 수 있다. 하지만 PINN에서는 상황이 다르다. 대표적인 손실은

처럼 구성되는데, 여기서 핵심은 residual term이다. 이 항은 "해가 PDE를 거의 만족하는가"를 본다. PDE 해는 단순히 평균적으로 괜찮은 함수가 아니라, 연속 영역 전체에서 연산자 조건을 맞추는 함수이기 때문에 residual이 충분히 작지 않으면 전체 해의 질이 빠르게 무너진다.

Rathore et al.은 reaction, convection, wave 사례에서 손실과 상대 오차(L2RE, relative error)의 관계를 실험적으로 보여준다. 결론은 직관적이지만 중요하다. PINN은 낮은 loss가 아니라 near-zero loss를 필요로 한다. 손실이 에서 로 줄어드는 것보다, 이미 작아진 손실을 , 수준까지 더 밀어 넣는 구간이 실제 해 품질을 결정하는 경우가 많다.

이 점은 왜 optimizer 선택이 그렇게 예민한지도 설명한다. 손실을 "어느 정도" 낮추는 optimizer와, 극도로 좁은 valley 바닥까지 실제로 도달하는 optimizer는 완전히 다르다. PINN에서 흔히 보이는 현상은 다음과 같다. Adam으로 초반의 큰 오차를 빠르게 줄인 뒤 손실이 plateau에 걸리고, 그 plateau는 supervised learning 기준으로는 이미 충분히 낮아 보이지만 PDE 해석 관점에서는 아직 한참 모자라다.

이 상황을 직관적으로 정리하면 이렇다.

바로 여기서 이 글의 핵심 명제가 선명해진다. PINN의 실패는 단지 architecture choice의 문제가 아니다. 물론 activation, skip connection, feature encoding은 중요하다. 그러나 좋은 해가 near-zero loss에 묶여 있고, 그 영역으로 가는 통로 자체가 ill-conditioned하다면, 구조를 조금 바꾸는 것만으로는 병목이 사라지지 않는다. 훈련의 핵심은 representational power보다 descent geometry에 있다.

이제 핵심 기계실로 내려가 보자. Rathore et al.의 가장 중요한 메시지는 PDE residual에 들어간 differential operator가 손실 지형의 Hessian을 심하게 ill-conditioned하게 만든다는 것이다.

이를 가장 단순한 선형 직관으로 쓰면, residual이 꼴일 때 손실은 대략 구조를 가진다. 이 경우 최적화 관점에서 중요한 것은 연산자 그 자체보다도, 그것이 Jacobian과 합성되며 만들어내는 curvature다. 선형화 근사에서는 Hessian이 와 비슷한 형태를 띠는데, 여기서 의 나쁜 조건수는 제곱된 형태로 손실 지형에 증폭된다.

쉽게 말해, 미분 연산자는 어떤 방향의 오차는 과도하게 증폭하고 다른 방향의 오차는 거의 보지 못한다. 그 결과 파라미터 공간에는 아주 가파른 축과 거의 평평한 축이 동시에 생긴다. optimizer는 한 방향으로는 너무 조심해야 하고, 다른 방향으로는 도무지 충분한 진전을 만들지 못한다. 이것이 바로 PINN 훈련에서 자주 보이는 stiffness다.

Rathore et al.은 Hessian 고유값 스펙트럼을 통해 이 현상을 실증적으로 보여준다. reaction보다 convection이 더 어렵고, wave는 더 어렵다. 이는 단순히 "파동 PDE가 멋있어서"가 아니라, 연산자 구조가 더 넓은 주파수 대역을 건드리고 더 나쁜 곡률 스케일을 만들기 때문이다. 논문은 또한 L-BFGS 기반 preconditioning이 조건수를 1000배 이상 줄일 수 있음을 보인다. 이 대목은 중요하다. PINN 최적화의 중심 문제가 local minima보다 condition number에 있다는 강한 증거이기 때문이다.

이 설명은 이전 문헌과도 정합적이다. Wang et al.의 gradient pathologies 논문은 PINN에서 backpropagated gradient가 손실 항마다 심하게 불균형해지고 numerical stiffness가 나타난다고 말했다. Wang et al.의 NTK 관점 논문은 각 손실 구성요소가 서로 다른 시간 척도로 수렴한다고 분석했다. 언뜻 보면 하나는 gradient 통계, 다른 하나는 kernel dynamics, Rathore는 Hessian 이야기라 서로 다른 주장처럼 보일 수 있다.

하지만 실제로는 누적적 설명이다. gradient pathology는 관측되는 증상이고, NTK imbalance는 학습 동역학의 선형화된 설명이며, Hessian ill-conditioning은 그 밑의 curvature 구조다. 같은 현상을 서로 다른 층위에서 보는 셈이다. 그래서 adaptive weighting이 조금 도움을 주고, architecture 조정이 일부 사례에서 좋아 보여도, 근본 병목이 완전히 사라지지 않는 것이다.

그렇다면 어떤 optimizer가 이 지형을 어떻게 다룰까. Rathore et al.의 실험이 설득력 있는 이유는 단순한 주장 대신 역할 분담을 매우 명확하게 보여주기 때문이다.

Adam은 초반 탐색에 강하다. noisy한 gradient와 나쁜 초기 스케일에서도 꽤 안정적으로 손실을 낮춘다. 하지만 PINN의 협소한 valley 바닥으로 들어갈수록, 특히 curvature가 강하게 찢어진 영역에서는 더 이상 충분한 전진을 만들지 못한다. 반대로 L-BFGS는 curvature 정보를 quasi-Newton 방식으로 압축해 쓰므로 valley 정렬에는 강하지만, 초기화가 나쁘거나 line search가 민감하게 흔들리는 구간에서는 불안정하거나 너무 일찍 멈출 수 있다.

Rathore et al.의 Table 1은 이 점을 수치로 잘 보여준다.

| 문제 | Adam | L-BFGS | Adam+L-BFGS | 핵심 해석 |

|---|---|---|---|---|

| Convection | loss 1.40e-4 L2RE 5.96e-2 | loss 1.51e-5 L2RE 8.26e-3 | loss 5.95e-6 L2RE 4.19e-3 | Adam이 넓게 찾고 L-BFGS가 바닥을 정렬할 때 가장 좋다. |

| Reaction | loss 4.73e-6 L2RE 2.12e-2 | loss 8.93e-6 L2RE 3.83e-2 | loss 3.26e-6 L2RE 1.92e-2 | 비교적 쉬운 문제에서도 하이브리드가 가장 안정적이다. |

| Wave | loss 2.03e-2 L2RE 3.49e-1 | loss 1.84e-2 L2RE 3.35e-1 | loss 1.12e-3 L2RE 5.52e-2 | 가장 어려운 파동 문제에서 단일 optimizer의 한계가 극명하다. |

이 표를 보면 중요한 교훈이 하나 있다. Adam 대 L-BFGS의 승부가 아니라, 단계별 역할의 결합이 본질이라는 점이다. 초반에는 Adam이 거친 지형을 훑고, 후반에는 L-BFGS가 preconditioning에 가까운 역할을 하며 긴 valley를 따라 정렬한다. 그래서 실전에서는 "Adam으로 워밍업 후 L-BFGS로 정련"이 사실상 기본 레시피처럼 자리 잡았다.

그런데 Rathore et al.은 여기서 멈추지 않는다. 그들은 왜 L-BFGS조차도 PINN에서 충분하지 않을 수 있는지 보여준다. 핵심 이유 중 하나는 strong Wolfe line search다. 손실 지형이 너무 왜곡되어 있으면 line search가 적절한 스텝을 찾지 못하고, 결과적으로 L-BFGS가 early termination에 빠질 수 있다. 즉, curvature 정보를 쓰는 quasi-Newton 방법도 PINN의 병적인 지형 앞에서는 완전한 해답이 아니다.

이 지점에서 등장하는 것이 NNCG (NysNewton-CG) 다. NNCG는 Nyström 근사를 이용해 2차 정보를 더 직접적으로 활용하면서, conjugate gradient 기반으로 refinement를 수행한다. Rathore et al.의 fine-tuning 결과는 이 접근의 의미를 분명히 보여준다.

| 문제 | Adam+L-BFGS | + NNCG | 오차 감소율 | 해석 |

|---|---|---|---|---|

| Convection | L2RE 4.19e-3 | L2RE 1.94e-3 | 약 53.7% | 이미 좋은 해에 들어간 뒤에도 curvature refinement가 더 먹힌다. |

| Reaction | L2RE 1.92e-2 | L2RE 9.92e-3 | 약 48.3% | 상대적으로 쉬운 문제에서도 후반 정련의 이득이 유지된다. |

| Wave | L2RE 5.52e-2 | L2RE 1.27e-2 | 약 77.0% | 가장 어려운 파동 문제일수록 second-order refinement의 체감 이득이 크다. |

이렇게 같은 표 안에서 직접 비교하면, 문제마다 서로 다른 baseline을 억지로 같은 bar width로 착시시키지 않고도 NNCG의 개선 폭을 읽을 수 있다. 특히 wave 문제에서 improvement가 가장 크다는 점이 선명하게 보인다.

정리하면 optimizer의 역할은 이렇게 구분할 수 있다.

이 구도는 "더 복잡한 optimizer가 무조건 낫다"는 뜻이 아니다. 오히려 반대다. PINN에서는 optimizer가 모델의 보조 수단이 아니라 문제 구조의 일부가 된다. 네트워크를 설계하는 것만큼, 어느 시점에 어떤 최적화 기법으로 넘어갈지를 설계해야 한다.

Rathore et al.의 공헌을 정확히 이해하려면, 이것을 앞선 PINN 최적화 문헌과 경쟁 관계로 놓으면 안 된다. 오히려 2020년대의 여러 설명이 하나의 누적 지도로 모여 왔고, Rathore는 그 지도의 중심축을 loss landscape와 Hessian으로 다시 정리한 것에 가깝다.

첫 번째 축은 Wang, Teng, Perdikaris의 gradient pathology다. 이들은 Understanding and Mitigating Gradient Pathologies in PINNs에서, PINN 훈련이 stiff system처럼 행동하며 손실 항들 사이의 backpropagated gradient 스케일이 크게 불균형해진다고 분석했다. 그리고 gradient 통계를 바탕으로 한 learning-rate annealing 및 resilient architecture를 제안했다. 이 연구의 의미는 "왜 어떤 손실 항은 줄고 다른 항은 거의 움직이지 않는가"를 gradient 수준에서 잡아낸 데 있다.

두 번째 축은 Wang, Yu, Perdikaris의 NTK 분석이다. When and Why PINNs Fail to Train: A Neural Tangent Kernel Perspective는 PINN의 각 손실 항이 서로 다른 유효 kernel을 통해 매우 다른 속도로 수렴한다고 설명했다. 이것은 단순한 현상 묘사가 아니라, 왜 adaptive weighting이나 calibration이 필요한지 이론적 정당성을 제공했다.

세 번째 축은 adaptive weighting과 sampling 전략이다. 손실 항 사이의 비대칭을 완화하기 위해 residual weighting, self-adaptive weight, curriculum, causality-aware training 같은 처방이 나왔다. 이들은 분명 효과가 있었다. 그러나 많은 경우 증상을 줄이는 수준에 머물렀고, "왜 여전히 후반부 정련이 어려운가"라는 질문은 남아 있었다.

네 번째 축이 바로 second-order 혹은 constrained optimization 흐름이다. Rathore et al.의 NNCG는 그 대표 사례다. 더 최근의 Williams et al. (2025)는 constrained optimization 관점에서 PINN 훈련의 신뢰성과 안정성을 다시 문제 삼는다. 이 흐름의 공통된 메시지는 분명하다. 2025년이 되어도 PINN의 중심 과제는 표현력 과시가 아니라 수렴성과 안정성 보장이라는 것이다.

이 흐름을 이렇게 읽으면 충돌이 사라진다. gradient pathology는 역전파 스케일의 문제를 드러냈고, NTK는 손실 항의 수렴률 불균형을 설명했으며, Rathore는 differential operator가 손실 지형의 curvature를 어떻게 망가뜨리는지 보여줬다. 서로 다른 어휘를 쓰지만 하나의 결론으로 모인다. PINN 훈련 실패는 여러 논문이 각자 다른 이름으로 보고한 하나의 구조적 병목이다.

이 지점에서 Sharp-PINNs 해설과의 차이도 더 선명해진다. Sharp-PINNs는 결합 PDE에서 그래디언트가 서로 충돌할 때 학습 절차와 제약 구조를 바꾸는 해법이다. 반면 이 글이 다루는 Rathore 계열의 메시지는, 단일 PINN만 보아도 residual 연산자 때문에 손실 지형 자체가 이미 어렵다는 것이다. 하나는 다중 방정식 간 충돌, 다른 하나는 방정식 하나만 있어도 생기는 curvature 병목이다. 실제 현장에서는 두 문제가 동시에 나타날 수 있다.

Rathore et al.이 reaction, convection, wave를 고른 이유는 단순한 데모 편의가 아니다. 이 셋은 PINN 난이도가 어디서 오는지 매우 교육적으로 보여준다.

먼저 reaction ODE는 상대적으로 단순하다. 공간 미분이 없거나 적고, 경계/초기 조건 구조도 비교적 온순하다. 하지만 그렇다고 쉬운 것은 아니다. near-zero loss 요구가 살아 있기 때문에, 후반 정련이 부족하면 L2RE가 생각만큼 내려가지 않는다. 실제 Table 1에서도 Adam+L-BFGS가 Adam과 L-BFGS 단독보다 가장 좋다.

다음은 convection PDE다. 대류 항은 방향성을 강하게 만든다. 해가 한쪽으로 운반되며, 작은 위치 오차가 큰 residual 차이로 이어질 수 있다. 이때 PINN은 공간 전역의 collocation point에서 PDE를 동시에 맞추려 하므로, 어떤 영역의 오차를 줄이는 움직임이 다른 영역에는 거의 도움이 되지 않을 수 있다. 결과적으로 길고 비스듬한 valley가 생기고, Adam은 탐색은 하지만 정렬이 서툴다.

가장 인상적인 것은 wave PDE다. 파동 문제는 진동성, 부호 변화, 위상 정렬, 시간-공간 결합이 동시에 들어온다. 조금 과장해 말하면 optimizer 입장에서는 "오차의 크기"뿐 아니라 "오차의 위치와 위상"까지 맞춰야 한다. 그래서 Table 1에서 Adam과 L-BFGS 단독은 둘 다 L2RE가 0.3대에 머무르는데, Adam+L-BFGS는 5.52e-2까지 크게 떨어진다. 그리고 여기에 NNCG를 더하면 1.27e-2까지 내려간다. 어려운 PDE일수록 loss landscape 관점의 설명력이 더 커진다.

이를 요약하면 다음 비교가 가능하다.

| 문제 유형 | 어려움의 원인 | 관측되는 훈련 증상 | 잘 듣는 처방 |

|---|---|---|---|

| Reaction ODE | near-zero loss를 요구하는 협소한 해 영역 | 후반 수렴 둔화, 미세 정련 부족 | Adam 워밍업 후 L-BFGS 정련 |

| Convection PDE | 방향성, 수송, 비대칭 curvature | 긴 plateau, 손실 항별 진전 속도 불균형 | adaptive weighting + L-BFGS preconditioning |

| Wave PDE | 진동성, 위상 정렬, 넓은 스펙트럼 | stall, line search 실패, 큰 L2RE 잔존 | Adam+L-BFGS 이후 NNCG 같은 second-order refinement |

여기서 중요한 것은 "어떤 PDE가 더 복잡한가"를 물리학적 직관만으로 판단하지 말아야 한다는 점이다. PINN 관점에서는 PDE의 난이도가 곧 연산자가 만드는 최적화 지형의 난이도다. 대류-확산처럼 물리적으로는 익숙한 방정식도, optimizer 입장에서는 훨씬 까다로운 목표일 수 있다.

또 한 가지. 이 논리는 다른 최근 PINN 연구와도 연결된다. 예를 들어 Sharp-PINNs가 겨냥한 상장(phase-field) 계열 문제는 고차 미분, 강결합, 다중 손실 항이 겹친다. 이런 시스템에서는 gradient conflict와 Hessian ill-conditioning이 한꺼번에 나타난다. 따라서 "왜 어떤 PDE는 더 어렵나"라는 질문의 답은 하나가 아니다. 하지만 그 답들의 공통 분모는 여전히 최적화 지형의 악조건이다.

2026년 시점에서 PINN을 평가할 때는 과장도, 반동도 피해야 한다. PINN은 실패한 아이디어가 아니다. 그렇다고 모든 PDE 학습 문제의 기본 해법도 아니다. 지금 시점에서 가장 정확한 평가는 이렇다. PINN은 특정 문제군에서는 여전히 강력하지만, 그 강점은 "방정식을 손실에 넣을 수 있다"는 추상적 장점보다 "희소 데이터와 물리 제약이 동시에 중요한 상황"에 집중되어 있다.

강점이 가장 분명한 곳은 sparse-data inverse problem과 parameter estimation이다. 관측 데이터가 적고, 지배 방정식이 강한 구조적 제약을 제공할 때 PINN은 매우 매력적이다. 센서가 몇 개뿐인 시스템에서 확산계수, 반응속도, 경계 플럭스, 재료 파라미터를 추정하는 문제는 여전히 PINN의 본진이다. Raissi 2019 이후 이어진 많은 응용이 이 지점에서 설득력을 유지해 왔고, Karniadakis 2021 리뷰 역시 이런 방향을 PINN의 대표 무대로 본다.

반면 large-family operator learning이나 high-throughput inference에서는 상황이 다르다. 여기서부터는 아래 판단이 문헌에서 직접 한 문장으로 선언된 결론이라기보다, Raissi 2019, Karniadakis 2021, Rathore 2024, Williams 2025와 최근 operator learning 흐름을 종합한 제 해석임을 분명히 밝힌다. 여러 초기조건, 경계조건, 계수 조합에 대해 반복적으로 빠른 추론을 해야 한다면, PINN은 문제 인스턴스마다 다시 최적화하는 구조 때문에 점점 덜 자연스러운 선택이 된다. 이 구간에서는 Neural Operator 비교 글에서 다뤘듯이 FNO, DeepONet, 그리고 physics-informed hybrid가 더 적합한 경우가 많다.

즉 2026년의 실전 판단 기준은 대략 다음과 같다.

최근 constrained optimization, hybrid solver, domain decomposition, curriculum/causal training 흐름은 모두 같은 현실을 반영한다. PINN의 미래는 "vanilla PINN 하나로 모든 것을 해결"하는 방향보다, 물리 제약 + 더 나은 최적화 + 문제 구조별 분해 전략의 조합으로 가고 있다. 그런 의미에서 2026년의 PINN은 과대광고의 주인공이 아니라, 더 엄밀한 공학 도구로 재배치되고 있다.

이 재배치는 오히려 건강하다. 기대가 줄어든 대신 적용 위치가 더 명확해졌기 때문이다. 이전 글인 Sharp-PINNs 해설이 보여주듯, 특정 구조의 어려운 PDE에서는 vanilla가 아니라 구조화된 변형이 경쟁력을 만든다. 또 KAN, PINN, Neural Operator 비교가 보여주듯, 오늘의 scientific ML은 단일 패러다임의 승자가 아니라 문제 구조에 맞는 도구 선택의 시대다.

PINN의 역사는 흔히 "좋은 아이디어가 현실의 어려움과 만난 이야기"로 요약된다. 그러나 Rathore et al. 2024 이후에는 더 정확한 문장으로 바꿔야 한다. PINN의 실패는 신경망이 물리를 이해하지 못해서가 아니라, 물리를 손실에 넣는 순간 생기는 ill-conditioned loss landscape를 optimizer가 끝까지 내려가지 못해서다.

이 관점은 중요하다. 왜 near-zero loss가 필요한지, 왜 Hessian 스펙트럼을 봐야 하는지, 왜 Adam 하나로는 부족한지, 왜 L-BFGS가 유용하면서도 때로는 일찍 멈추는지, 왜 NNCG 같은 second-order refinement가 등장하는지, 그리고 왜 2026년에도 PINN 문헌이 여전히 convergence와 stability를 붙들고 있는지가 한 줄로 이어진다.

결국 좋은 PINN 연구는 이제 "더 깊은 네트워크를 썼다"보다 "더 어려운 손실 지형을 어떻게 길들였는가"를 묻는다. 이것은 비관적 결론이 아니라, 오히려 분야가 성숙해졌다는 신호다. 환상이 걷힌 자리에 진짜 공학이 남는다.