AI 법률 추론의 미래 — SOLAR: 검증 가능한 법률 추론을 위한 멀티 에이전트 프레임워크

GPT-4o가 세금 계산 문제에서 18.8%의 정확도를 보이는 동안, 추론 모델 o4-mini는 91.7%를 기록한다. 하지만 비용이 수십 배 비싸다. SOLAR 프레임워크는 저비용 모델의 정확도를 76.4%로 끌어올려, 이 격차를 68.2%에서 5.9%로 줄인다.

GPT-4o가 세금 계산 문제에서 18.8%의 정확도를 보이는 동안, 추론 모델 o4-mini는 91.7%를 기록한다. 하지만 비용이 수십 배 비싸다. SOLAR 프레임워크는 저비용 모델의 정확도를 76.4%로 끌어올려, 이 격차를 68.2%에서 5.9%로 줄인다.

AI에게 이런 문제를 내보자:

"앨리스와 밥은 1998년 2월 3일에 결혼했고, 아들 찰리는 1999년 4월 1일에 태어났다. 밥은 2017년 1월 1일에 사망했다. 2019년에 찰리는 앨리스가 주거지로 유지하는 집에서 살고 있다. 앨리스의 2019년 총소득은 $236,422이다. 앨리스는 표준공제를 적용받는다. 앨리스가 2019년에 내야 할 세금은 얼마인가?"

이 문제를 풀려면 AI는 다음을 해야 한다:

GPT-4.1의 zero-shot 정확도: 24%. 대부분의 기본 모델은 20% 이하다. 반면 o4-mini(추론 모델)는 91.7%를 달성하지만, 비용과 지연시간이 수십 배 비싸다.

2025년 8월, 바르샤바 공과대학교의 Albert Sadowski와 Jarosław A. Chudziak이 CIKM 2025에서 발표한 SOLAR(Structured Ontological Legal Analysis Reasoner) 프레임워크는 이 격차를 극적으로 줄인다. 기본 모델의 정확도를 76.4%로 끌어올려, 추론 모델과의 격차를 68.2%포인트에서 5.9%포인트로 좁힌 것이다.

그 비결은 "법률가처럼 생각하는 방법을 AI에게 가르치는 것"이 아니라, "법률 지식을 AI가 사용할 수 있는 형태로 구조화하는 것"이다.

법률 추론은 AI에게 특별히 어려운 과제다. 세 가지 핵심 도전이 있다.

1. 자연어 해석의 모호성. 법률 용어는 일상어와 다른 의미를 가진다. "소득(income)"이 일상에서는 단순하지만, 세법에서는 근로소득, 사업소득, 자본이득, 임대소득 등으로 세분되며 각각 다른 규칙이 적용된다.

2. 조건부 규칙의 연쇄. 세금 계산은 단순한 곱셈이 아니다. 신고 자격(Filing Status)이 표준공제(Standard Deduction)를 결정하고, 이것이 과세소득(Taxable Income)을 결정하고, 이것이 적용 세율 구간을 결정한다. 하나의 조건이 바뀌면 전체 계산이 달라진다.

3. 일관성 요구. 같은 법률 규칙을 같은 상황에 적용하면 항상 같은 결과가 나와야 한다. 하지만 LLM은 같은 질문에도 다른 답을 내놓기도 한다.

기본 모델과 추론 모델 사이에 68.2%포인트의 거대한 격차가 존재한다. 추론 모델은 정확하지만 비용과 지연시간이 수십 배 높다. "저렴한 모델은 못하고, 정확한 모델은 비싸다" — 이것이 법률 AI의 핵심 딜레마다.

SOLAR의 핵심 통찰은 법률가가 실제로 문제를 푸는 방식에서 나온다.

숙련된 세무사가 새로운 세법 조항을 다룰 때:

SOLAR는 이 두 단계를 명시적으로 분리한다:

SOLAR의 중심에는 온톨로지(TBox)가 있다. 온톨로지란 특정 도메인의 개념, 관계, 규칙을 형식적으로 표현한 것이다.

세법의 TBox는 세 가지로 구성된다:

1. 클래스(C) — 핵심 법적 개념:

2. 속성(P) — 개념 간 관계:

3. 규칙(R) — 법적 추론 규칙:

이 규칙은 "사망한 배우자가 있고(Y), 부양가족(Z)을 위해 가구를 유지하면, 적격 생존배우자다"라는 세법 규정을 형식 논리로 표현한 것이다.

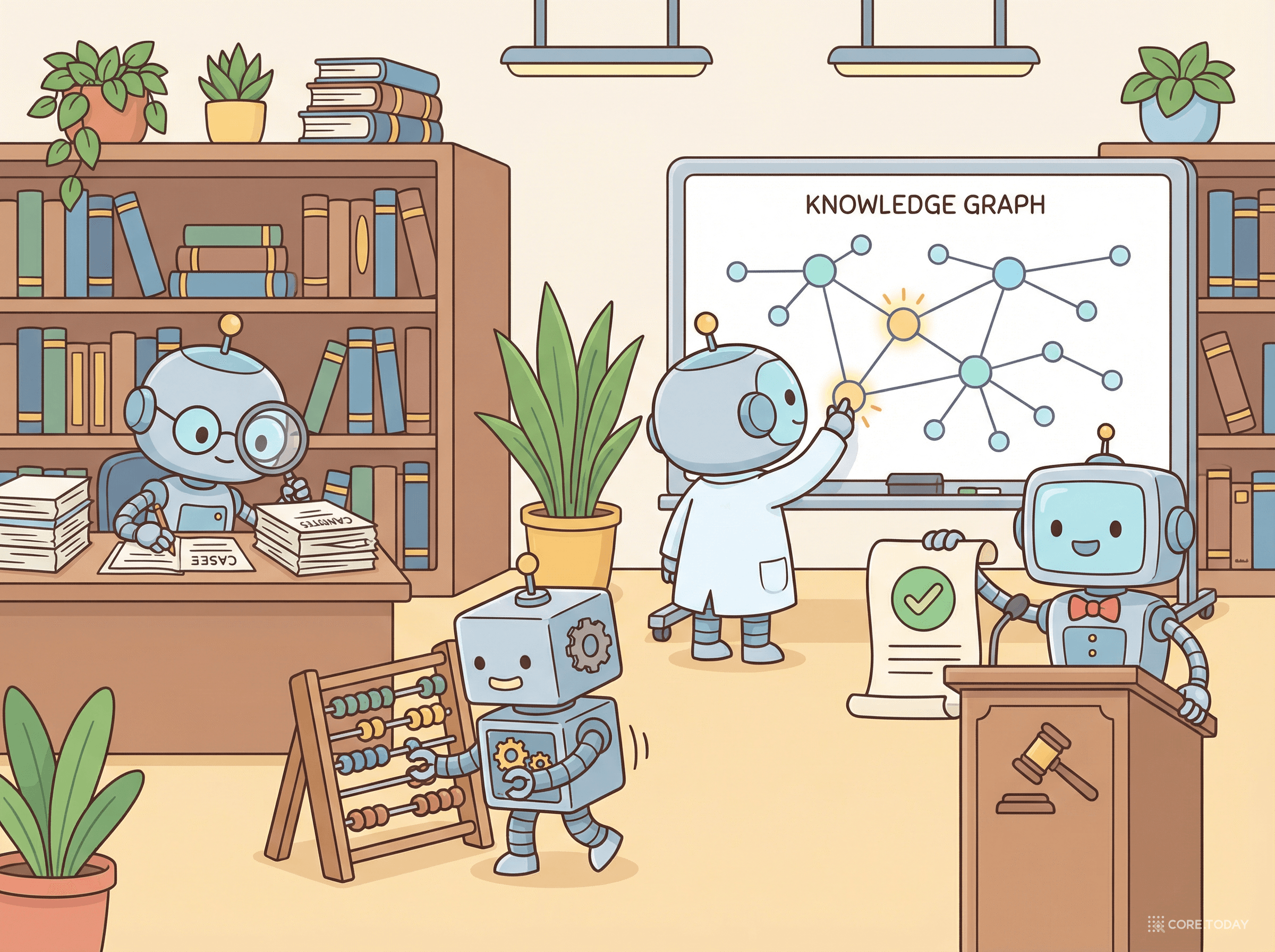

핵심은 역할 분리다. LLM이 잘하는 것(자연어 이해)과 못하는 것(논리적 일관성, 수치 계산)을 분리해, 못하는 것은 기호 추론 엔진과 프로그래밍 코드에 맡긴다.

법률 조문에서 핵심 법적 개체와 관계를 식별한다. "납세자", "소득", "공제", "신고 자격" 같은 후보 클래스(C)와 속성(P)을 제안한다.

동시에 병렬로, 조건부 논리를 추출해 1차 논리(first-order logic)의 형식 규칙(R)으로 변환한다. "배우자가 사망했고 부양가족이 있으면 → 생존배우자 자격"

두 에이전트의 출력을 통합해 일관된 TBox로 만든다. 용어 표준화, 모호성 해소.

TBox의 내부 일관성을 검증한다. 불일치가 있으면 통합 에이전트로 반환해 수정.

TBox 인터프리터를 생성한다 — ABox(사례 사실)를 입력받아 세금을 계산하는 Python 함수. Chain-of-Code 기법 활용.

학습 샘플로 테스트 후 실패를 분석한다. 온톨로지 문제인지 코드 문제인지 분류해, 해당 에이전트에 타겟 피드백을 전달. 전체 학습 샘플이 통과할 때까지 반복.

사실 추출(ABox 생성): LLM이 자연어 사례를 읽고, TBox의 클래스와 속성에 맞게 매핑한다.

앨리스 사례의 ABox:

기호 추론(SMT Solver): TBox의 규칙(R)을 ABox의 사실(A)에 적용해 새로운 사실을 도출한다.

TBox 인터프리터: 생존배우자 자격 → 부부공동 세율 적용 → 24,000 = $212,422 과세소득 → 누진 세율 적용 → $62,000.42

SARA(Statutory Reasoning Assessment)는 LegalBench의 벤치마크로, 미국 연방 세법에 기반한 96개의 세금 계산 문제다. 각 문제에 구체적 사실(소득, 신고 자격, 공제)과 관련 세법 조항이 주어진다.

| 모델 | Zero-Shot | SOLAR | 개선 |

|---|---|---|---|

| DeepSeek V3 | 15.6% | 82.3% | +66.7%p |

| LLaMA 3.3 70B | 12.5% | 67.7% | +55.2%p |

| GPT-4.1 mini | 21.9% | 86.5% | +64.6%p |

| Qwen 2.5 72B | 22.9% | 78.1% | +55.2%p |

DeepSeek V3가 가장 극적이다. 15.6%에서 82.3%로 — 추론 모델 수준에 도달했다. 비용은 추론 모델의 일부에 불과하다.

SOLAR의 또 다른 강점은 일관성이다. 모델 간 성능 분산이 극적으로 줄어든다.

어떤 기본 모델을 쓰든, SOLAR를 적용하면 비슷하게 좋은 성능이 나온다. 모델 선택에 대한 의존도가 크게 줄어드는 것이다.

SOLAR는 정확도를 높이면서 동시에 토큰 사용량을 줄인다.

| 방법 | 토큰/쿼리 | 지연시간/쿼리 |

|---|---|---|

| Zero-shot | ~8,000 | 1.5초 |

| Chain-of-Code | ~8,500 | 7.1초 |

| SOLAR | ~4,000 | 12.8초 |

TBox가 이미 법률 지식을 구조화해 놓았기 때문에, 매 쿼리마다 전체 법률 조문을 보낼 필요가 없다. 압축된 TBox만 전달하면 된다. 토큰이 45-48% 줄어든다.

다만 지연시간은 12.8초로 증가한다. 멀티 에이전트 파이프라인의 순차 처리 때문이다. 하지만 법률 분석에서 12.8초는 충분히 수용 가능한 수준이다.

법률 분야에서는 결론만큼 그 근거가 중요하다. "세금이 $62,000.42입니다"라는 답만으로는 부족하다. "왜 그 금액인가?"를 설명할 수 있어야 한다.

SOLAR는 각 단계에서 추적 가능한 추론 경로를 제공한다:

ABox의 각 단언에 신뢰도 점수와 근거 설명이 붙는다.

예: hasGrossIncomeAmount(Alice, 1200.0) — "수감 기간(5월 5일까지)의 서비스 소득"

SMT 솔버의 추론 과정이 형식 논리 체인으로 기록된다.

hasDeceasedSpouse ∧ maintainsHousehold → isSurvivingSpouse

TBox 인터프리터의 각 계산 단계가 기록된다.

총소득 → 공제 → 과세소득 → 세율 적용 → 최종 세액

논문의 표현을 빌리면:

"각 단계에서 시스템은 법률 조항을 직접 참조하는 추적 가능한 추론을 제공한다. 이 분해는 도메인 전문가가 지식 추출, 규칙 적용, 계산 구현을 별도로 검증할 수 있게 한다 — 법률 맥락에서 정당화가 결론 자체만큼 중요한 능력이다."

SOLAR의 투명성 덕분에, 실패의 원인을 정확히 진단할 수 있다.

1. TBox의 어휘 공백. TBox에 특정 법적 개념의 어휘가 없으면, 해당 개념은 표현 자체가 불가능하다. 예: TBox에 "항목별 공제(itemized deductions)" 속성이 없으면, 입력에 항목별 공제가 명시되어 있어도 ABox에 기록되지 않는다. "법적 개념이 자연어로 명확히 기술되어 있음에도, 형식화할 수 없는 근본적 사각지대."

2. 사용 패턴의 불완전한 전달. TBox가 어휘를 정의했지만, 그 어휘가 어떻게 조합되어야 하는지(암묵적 "문법")를 충분히 전달하지 못하는 경우. 예: 부부공동신고에서 isMarriedIndividual과 filesJointReturn을 기록했지만 hasSpouse 관계를 누락 — TBox 인터프리터는 배우자 관계가 있어야 소득을 합산하는데, 이 요구사항이 온톨로지 자체에서는 명시되지 않았다.

3. TBox 인터프리터의 구현 오류. 신고 자격의 우선순위(생존배우자 > 세대주 > 독신) 같은 법적 위계를 코드가 잘못 구현한 경우.

이 실패 분석이 가능하다는 것 자체가 SOLAR의 강점이다. 논문의 핵심 통찰:

"효과적인 뉴로-심볼릭 법률 추론은 여러 층위에 주의를 기울여야 한다: 포괄적 온톨로지 어휘, 명시적 사용 패턴 전달, 올바른 응용 로직 구현. 우리 프레임워크의 투명한 특성은 이러한 구별된 실패 모드를 식별할 수 있게 한다 — 엔드투엔드 블랙박스 접근에서는 숨겨져 있을 것이다."

SOLAR의 가장 실용적인 함의는 법률 AI의 민주화다.

현재 상황: 정밀한 법률 추론이 필요하면 o4-mini 같은 비싼 추론 모델을 사용해야 한다. 이것은 대형 법률 사무소나 기업만 감당할 수 있는 비용이다.

SOLAR로 변하는 것: 저렴한 기본 모델(GPT-4.1 mini, DeepSeek V3, Qwen 2.5)로도 추론 모델에 근접하는 성능을 얻을 수 있다. 비용이 수십 분의 1로 줄어든다.

논문은 세법에 집중했지만, 같은 접근이 적용 가능한 영역:

SOLAR는 뉴로-심볼릭 AI(Neuro-Symbolic AI)의 구체적 성공 사례다. 신경망(LLM)의 자연어 이해 능력과 기호 시스템(SMT 솔버, 프로그래밍)의 논리적 정확성을 구조화된 온톨로지를 다리로 연결한다.

이 접근은 법률 너머로 확장된다. 논문의 저자들이 지적하듯, "규칙 기반 도메인이라면 어디든 — 금융 규제, 의료 프로토콜, 과학적 추론 — 유사한 방법론이 적용될 수 있다."

이 논문의 메시지를 한 문장으로 압축하면:

법률 추론에서 LLM의 약점(논리적 비일관성, 계산 오류)을 보완하는 가장 효과적인 방법은, LLM에게 "더 열심히 생각하라"고 하는 것이 아니라 "잘하는 것만 하게 하라"는 것이다.

LLM은 자연어 이해에 탁월하다. 논리적 추론은 SMT 솔버가 더 잘한다. 수치 계산은 Python이 더 정확하다. SOLAR는 각 도구를 최적의 역할에 배치하고, 온톨로지로 이들을 연결한다.

결과: 기본 모델 18.8% → 76.4%. 추론 모델과의 격차 68.2% → 5.9%. 토큰 사용량 48% 절감. 그리고 무엇보다, 매 단계가 검증 가능하고 설명 가능한 투명한 추론 경로.

법률은 "결론이 맞는가"만큼 "그 결론에 어떻게 도달했는가"가 중요한 분야다. SOLAR는 정확도를 높이면서 동시에 투명성을 보장하는, 법률 AI의 실용적 미래를 보여준다.

참고 논문: