LLM + 시맨틱 웹: AI의 '감'을 '논리'로 바꾸는 법 — Structured Decomposition 논문 해부

GPT-5도 규칙을 일관되게 적용하지 못한다. 이 논문은 LLM을 '온톨로지 채우기 엔진'으로 재정의하고, SWRL 추론기가 규칙을 결정론적으로 적용하는 신경-상징 통합 프레임워크를 제안한다. 법률, 의학, 과학 3개 도메인에서 11개 모델로 검증한 결과를 해부한다.

GPT-5도 규칙을 일관되게 적용하지 못한다. 이 논문은 LLM을 '온톨로지 채우기 엔진'으로 재정의하고, SWRL 추론기가 규칙을 결정론적으로 적용하는 신경-상징 통합 프레임워크를 제안한다. 법률, 의학, 과학 3개 도메인에서 11개 모델로 검증한 결과를 해부한다.

2026년 초, 법률 AI 스타트업이 GPT-5.2에게 이런 질문을 했다고 하자:

"증인이 법정 밖에서 '피고인이 도망가는 것을 봤다'고 말한 내용을 검찰이 법정에서 인용했습니다. 이것은 전문증거(hearsay)인가요?"

미국 연방증거규칙 제801조에 따르면, 전문증거의 판단은 세 가지 조건을 모두 충족해야 한다:

이론적으로 간단하다. 세 조건을 확인하고 AND로 결합하면 끝이다. 하지만 GPT-5.2는 이 "간단한" 규칙을 일관되게 적용하지 못한다. 같은 사안에 대해 물을 때마다 다른 답이 나올 수 있다. 세 조건 중 하나를 빠뜨리기도 하고, 조건을 충족하지 않는데 "전문증거"라고 판단하기도 한다.

왜? LLM은 규칙을 "이해"하는 것이 아니라 "근사"하기 때문이다. 학습 데이터에서 "전문증거"와 관련된 패턴을 흉내 내지만, 논리적 규칙을 엄밀하게 적용하는 메커니즘이 없다.

이 문제에 대해 2026년 1월, Albert Sadowski와 Jaroslaw A. Chudziak가 정면으로 답하는 논문을 발표했다.

"Structured Decomposition for LLM Reasoning: Cross-Domain Validation and Semantic Web Integration."

핵심 제안: LLM을 "추론 엔진"이 아니라 "온톨로지 채우기(ontology population) 엔진"으로 재정의하라. 비정형 텍스트에서 구조화된 정보를 추출하는 것은 LLM에게 맡기고, 규칙 적용은 시맨틱 웹 추론기(SWRL reasoner)에게 맡긴다. 법률, 의학, 과학 3개 도메인에서 11개 모델로 검증한 결과, 이 접근이 few-shot 프롬프팅 대비 통계적으로 유의미한 성능 향상을 보였다.

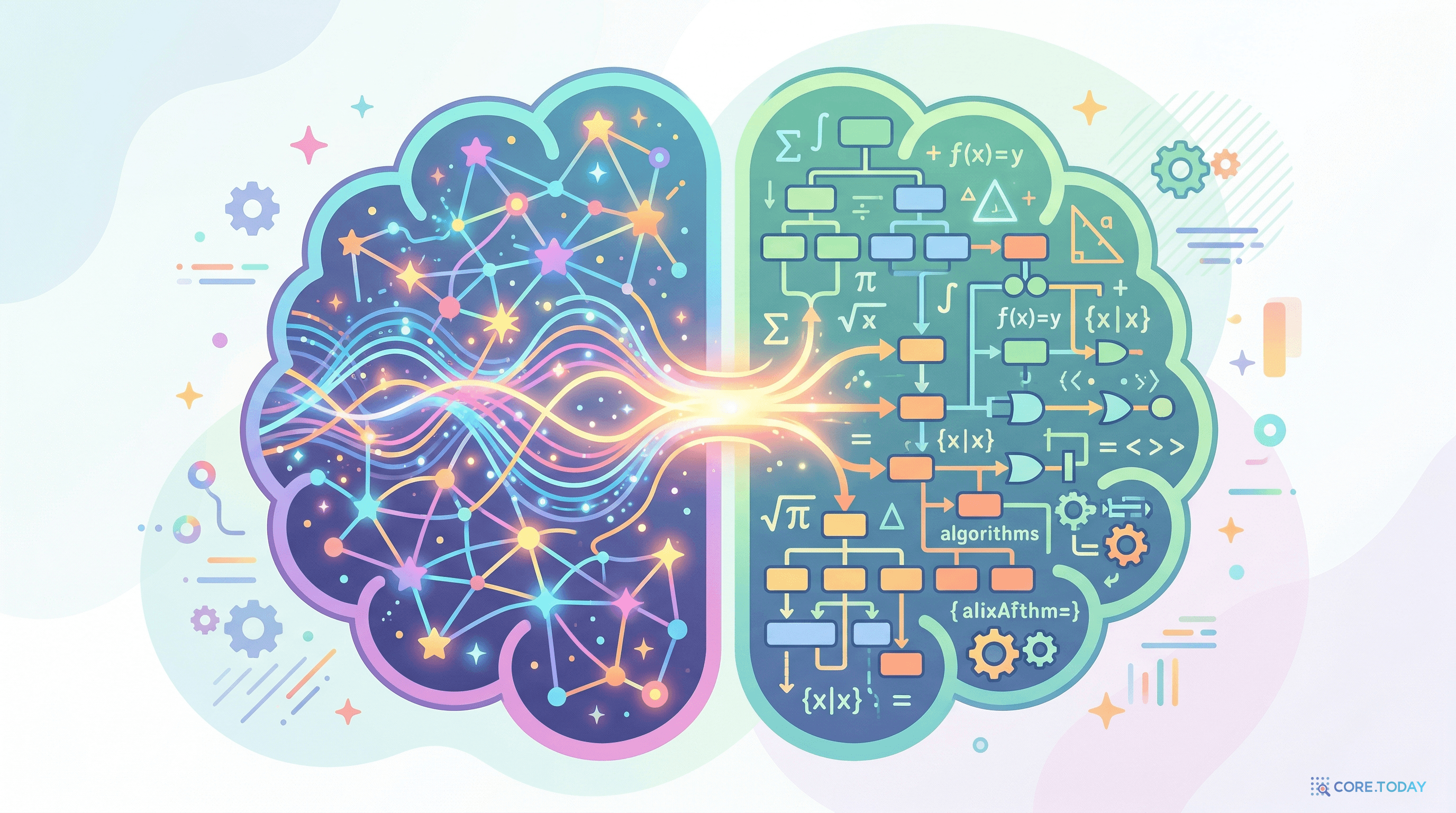

LLM은 놀라운 유연성을 가지고 있다. 자연어를 이해하고, 맥락을 파악하고, 모호한 표현을 해석한다. 하지만 세 가지 근본적 한계가 있다:

법률, 의학, 과학 — 결정이 감사 가능(auditable)하고 정당화 가능(justifiable)해야 하는 도메인에서 이 한계는 치명적이다.

반대편에는 전통적 상징 시스템이 있다. OWL 온톨로지, SWRL 규칙, SPARQL 쿼리 — 이 시스템들은 결정론적이고 감사 가능하고 일관된 추론을 보장한다.

하지만 치명적 약점이 있다 — 구조화된 입력이 필요하다. "증인이 법정 밖에서 말한 내용"이라는 자연어 문장을 직접 처리할 수 없다. 누군가가 먼저 이 문장에서 Statement, OutOfCourt, Assertion 같은 구조화된 개체를 추출해야 한다.

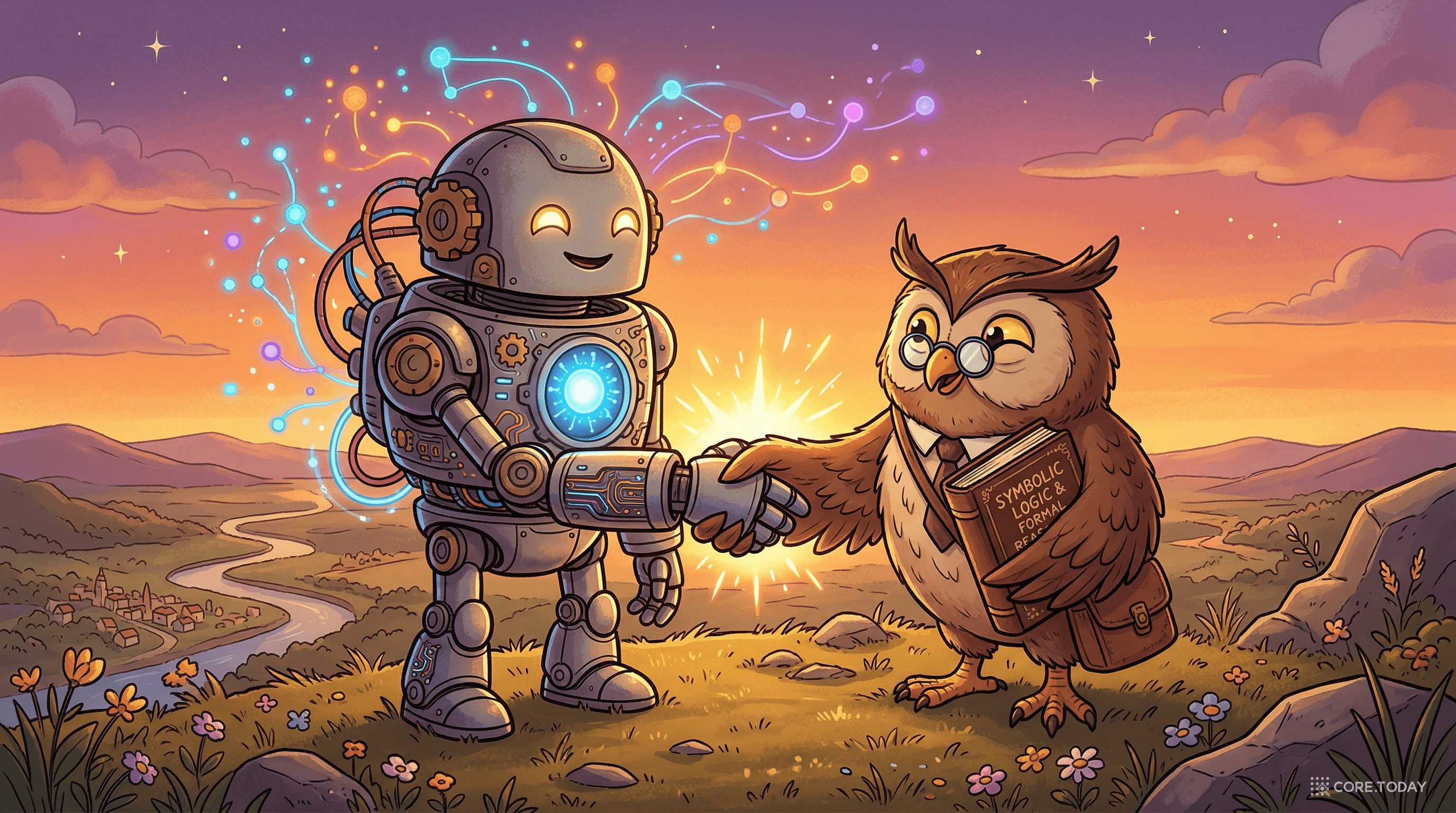

LLM에게 규칙 적용을 시키지 말고, 정보 추출만 시켜라. 규칙 적용은 상징 추론기에게 맡겨라.

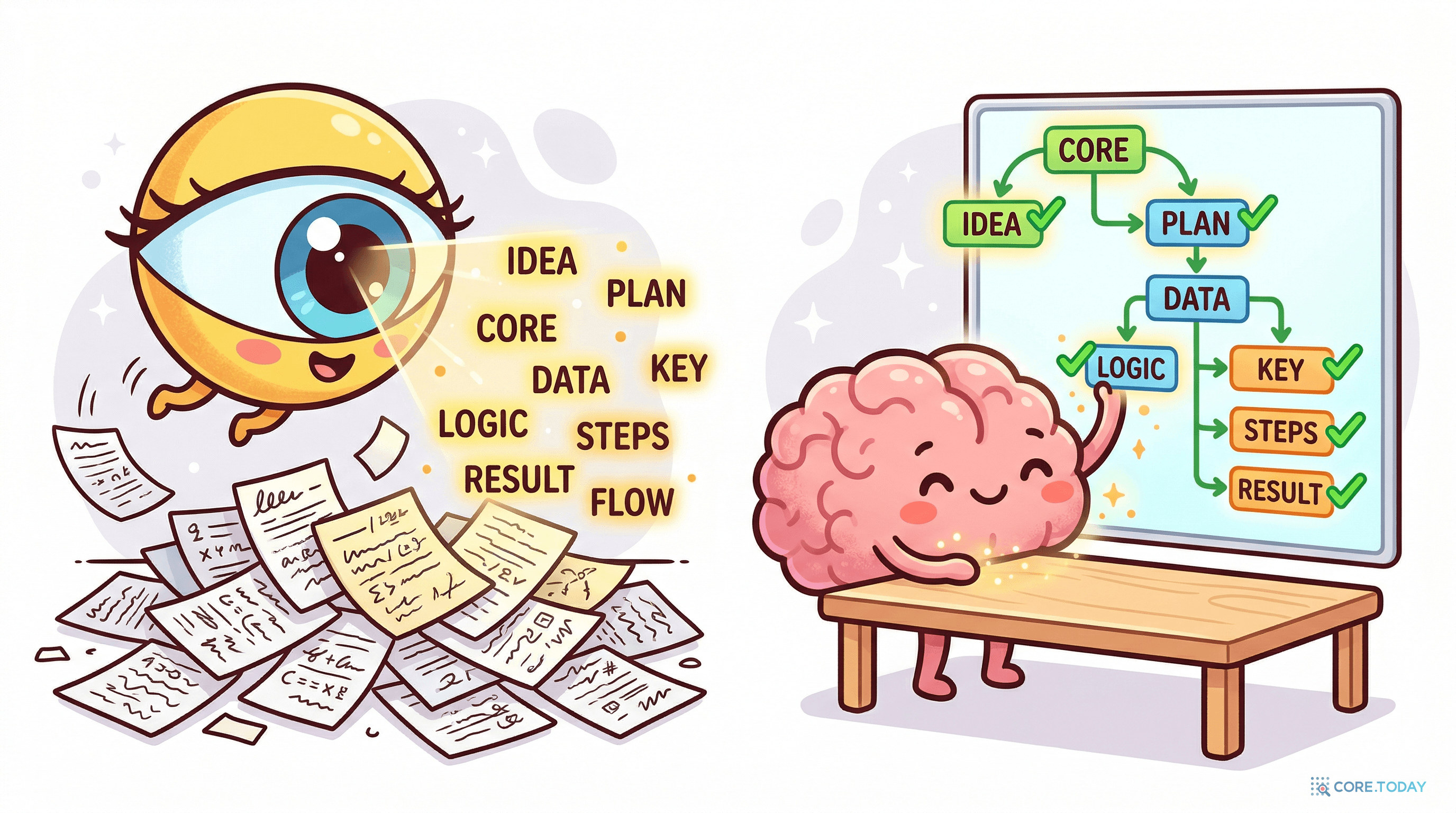

LLM은 자연어를 이해하는 "눈"이고, SWRL 추론기는 규칙을 적용하는 "두뇌"다. 눈에게 판단을 시키면 안 된다 — 눈은 보는 것, 두뇌는 판단하는 것.

이 논문을 이해하려면 몇 가지 시맨틱 웹 개념을 알아야 한다. 최대한 쉽게 설명한다.

OWL(Web Ontology Language)은 "세계의 구조"를 정의하는 형식 언어다. 두 부분으로 나뉜다:

비유하자면:

TBox = "사람은 이름과 나이를 가진다. 환자는 사람의 하위 유형이다." ABox = "홍길동은 사람이다. 홍길동의 나이는 35이다."

SWRL(Semantic Web Rule Language)은 OWL에 규칙을 추가한다. 형식:

조건(전제) → 결론(결과)

전문증거 판단을 SWRL로 쓰면:

"?s가 진술이고, 법정 밖에서 이루어졌고, 주장을 포함하며, 그 주장의 진실성을 증명하기 위해 제출되었으면 → 전문증거다."

OWL 온톨로지에 저장된 데이터를 쿼리하는 언어. SQL이 관계형 데이터베이스를 쿼리하듯, SPARQL은 온톨로지를 쿼리한다.

LLM이 비정형 텍스트를 읽고, TBox에 정의된 클래스에 해당하는 개체(entity)를 추출한다.

입력: "증인 A가 사건 현장에서 '피고인이 도망갔다'고 말했다."

LLM 출력:

- 개체 1: "증인 A의 진술" → 클래스:

Statement- 개체 2: "'피고인이 도망갔다'" → 클래스:

Assertion

각 개체에 대해: 추출된 텍스트 범위, 할당된 식별자, 자연어 설명(왜 이 개체를 식별했는지).

추출된 개체들 사이의 속성과 관계를 결정한다. 각 속성에 대해 참/거짓 판단과 텍스트 근거를 생성한다.

IsOutOfCourt(진술1)= true (근거: "사건 현장에서" 발언 → 법정 밖)ProvesTruthOfAssertion(진술1)= true (근거: 검찰이 피고인의 도주 사실을 증명하기 위해 인용)

추출된 개체와 주장이 OWL ABox에 채워지면, Pellet 추론기가 SWRL 규칙을 결정론적으로 적용한다.

세 조건이 모두 true → Hearsay 클래스 추론. 하나라도 false → 추론 안 됨.

핵심: 모든 가변성은 Step 1, 2의 LLM에서 발생한다. Step 3의 상징 추론기는 완전히 결정론적이다. 같은 ABox가 주어지면 항상 같은 결론을 낸다.

출처: LegalBench (미국 연방증거규칙 제801조)

증거법에서 전문증거 판단은 실무적으로 매우 중요하다. 전문증거는 원칙적으로 배제되므로, 이 판단이 재판의 방향을 바꿀 수 있다.

SWRL 규칙으로 형식화된 3개 조건: 진술인가 + 법정 밖인가 + 주장의 진실성 증명 목적인가.

출처: SciERC (과학 논문의 Used-For 관계)

"이 논문에서 SVM이 텍스트 분류에 실제로 적용되었는가?" 단순 동시 출현(co-occurrence), 비교(comparison), 분류(taxonomy)와 진정한 적용(application)을 구별해야 한다.

SWRL: 방법인가 + 태스크인가 + 기능적 연결이 있는가 + 배제 관계가 아닌가.

출처: NLI4CT (임상시험 자연어 추론)

"이 환자의 조건이 임상시험의 선정/제외 기준을 충족하는가?" 의학 용어의 동의어(예: "고혈압" = "hypertension"), 암묵적 제외 논리를 처리해야 한다.

SWRL: 적격성 진술인가 + 적격성 기준인가 + 전제에서 도출되는가.

논문은 프레임워크의 적용 범위를 명확히 제한한다. 두 가지 조건을 모두 충족해야 한다:

반례 검증 (URTI 진단): 상기도감염 진단 같은 통계적 패턴 매칭 태스크에 적용하면 F1 0.145 (few-shot 0.979 대비 처참). 프레임워크의 범위를 벗어나는 태스크임을 확인.

| 조건 | 설명 | 상징 검증 | 보완 술어 |

|---|---|---|---|

| Few-Shot (FS) | 기본 프롬프팅 | ❌ | ❌ |

| Chain-of-Thought (CoT) | 단계별 사고 유도 | ❌ | ❌ |

| SD | 구조적 분해 + SWRL | ✅ | ❌ |

| SD-Comp | SD + 보완 술어 | ✅ | ✅ |

| SD-Direct | 구조적 분해만 (SWRL 없음) | ❌ | ❌ |

| SD-Direct-Comp | SD-Direct + 보완 술어 | ❌ | ✅ |

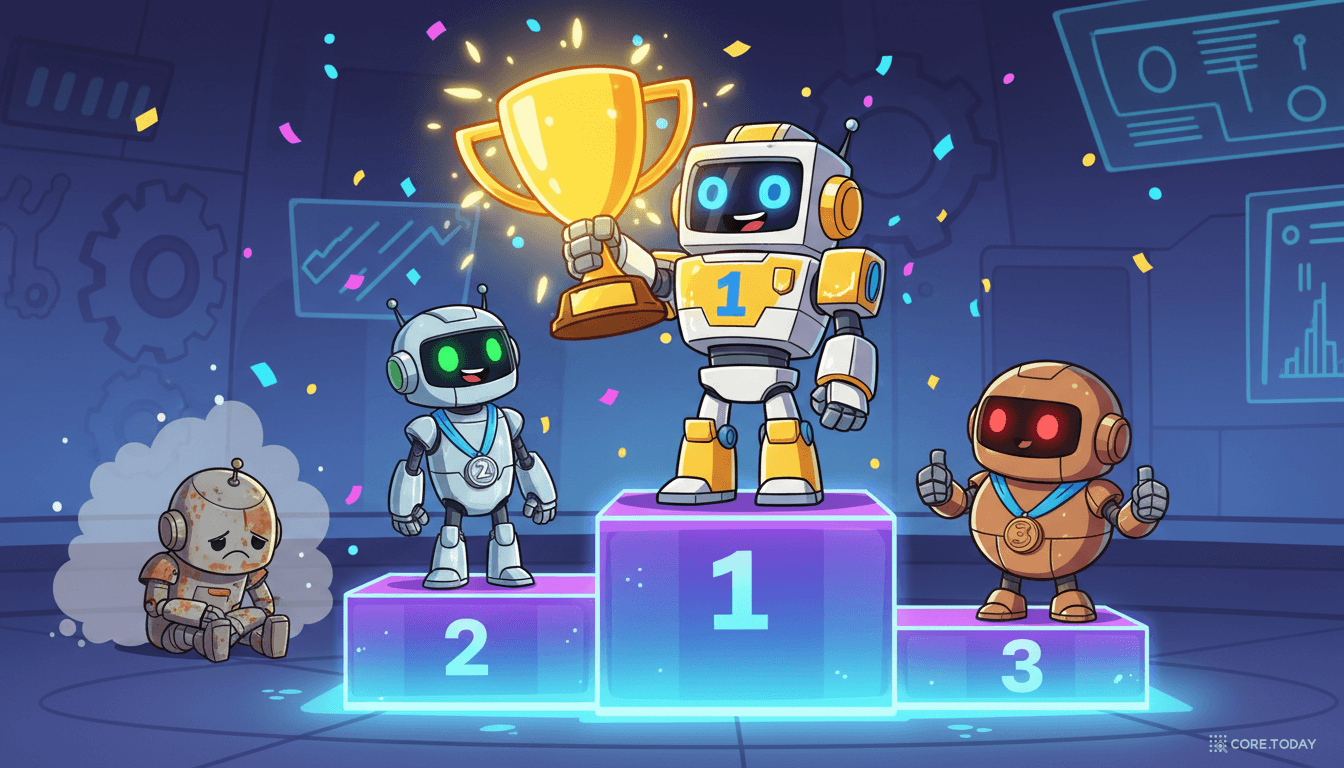

SD vs SD-Direct의 비교가 핵심 — SWRL 추론기의 기여를 순수하게 분리하기 위한 설계.

SD vs Few-shot: +4.6%p, t(32)=2.88, p=0.007, Cohen's d=0.50 (중간 효과 크기)

SD (79.8%) vs SD-Direct (70.1%): +9.7%p, p=0.001

이 차이가 논문의 가장 중요한 발견이다. 구조적 분해를 하되 SWRL 추론기 없이 LLM에게 최종 판단을 시키면, 오히려 기본 few-shot보다 성능이 떨어진다 (70.1% < 75.2%).

왜? 분해 과정에서 새로운 오류가 유입되기 때문이다. 개체 추출에서 실수하고, 주장 추출에서 또 실수하고, 그 실수들이 누적된다. SWRL 추론기가 이 누적된 오류를 교정하고 제약하는 역할을 한다.

"구조적 분해 자체는 도움이 안 된다. 구조적 분해 + 상징 검증이 도움이 된다."

도메인별 SD vs SD-Direct 차이:

| 도메인 | SD | SD-Direct | 차이 |

|---|---|---|---|

| 임상시험 적격성 | 74.4% | 54.5% | +19.9%p |

| 연구 방법 적용 | 88.9% | 80.4% | +8.5%p |

| 전문증거 판단 | 75.9% | 75.2% | +0.7%p |

임상시험에서 SWRL 추론기 없이 LLM만으로 최종 판단하면 54.5% — 동전 던지기 수준. 의학 용어의 복잡성과 암묵적 논리 때문이다. SWRL 추론기가 이를 20%p 가까이 끌어올린다.

이전 연구에서는 "보완 술어(complementary predicates)" — 긍정/부정 쌍을 모두 명시적으로 추출 — 이 성능을 높인다고 보고되었다. 하지만 이 논문에서는 반대 결과:

SD (79.8%) vs SD-Comp (74.8%): -5.0%p, p=0.001

보완 술어가 성능을 떨어뜨렸다. 저자들의 해석: 이전 세대 모델(o1, o3-mini)에서는 "확인 편향(confirmation bias)" 교정이 필요했지만, 현재 세대 모델들은 이 문제가 덜하다. 더 간단한 온톨로지가 더 낫다.

11개 모델 중 9개에서 긍정적 효과. 큰 모델일수록 효과가 크다 — Claude Sonnet (+10.8%p) vs Haiku (-6.1%p), Gemini Pro (+8.3%p) vs Flash (+0.6%p). 프레임워크는 모델 품질의 대체재가 아니라 증폭기다.

채워진 ABox는 완전한 추론 추적(reasoning trace)을 제공한다. SPARQL로 쿼리하면 "왜 이 사안이 전문증거로 판단되었는가?"에 대한 구조화된 답변을 얻을 수 있다.

# 전문증거로 판단된 사안의 근거 조회

SELECT ?statement ?property ?value ?justification

WHERE {

?statement rdf:type :Hearsay .

?statement ?property ?value .

?statement :hasJustification ?justification .

}

이것은 EU AI Act의 설명 가능성 요건, 미국 FDA의 AI 의사결정 감사 요건 등 규제 준수에 직접적으로 도움이 된다.

TBox와 SWRL 규칙은 Protégé 같은 표준 도구로 편집할 수 있다. 법률 전문가가 코드를 쓰지 않고도 "이 조건을 추가하고 싶다"면 온톨로지에 속성을 추가하고 SWRL 규칙을 수정하면 된다. LLM 재학습이나 프롬프트 재설계가 필요 없다.

SD의 재현율은 84.7% (few-shot: 69.0%, +15.7%p). 정밀도는 약간 떨어진다 (79.4% vs 85.3%). 이것은 위양성(false positive)보다 위음성(false negative)이 더 비싼 분야에 적합하다:

채워진 ABox는 표준 시맨틱 웹 도구와 즉시 통합된다. SPARQL 엔드포인트, 트리플 스토어, 연결된 데이터(Linked Data) 생태계. 기존에 SNOMED CT, LOINC(의학), FIBO(금융), LKIF(법률) 같은 도메인 온톨로지를 사용하는 조직이라면, 이 프레임워크를 그 위에 쌓을 수 있다.

LLM의 추론 능력을 개선하려는 시도는 계보가 있다:

논문은 9가지 한계를 솔직하게 인정한다:

향후 연구 방향:

이 논문의 가장 깊은 통찰은 LLM의 역할을 재정의한 것이다.

LLM은 "모든 것을 할 수 있는 범용 AI"가 아니다. 비정형 텍스트에서 구조화된 정보를 추출하는 것 — "보는 것" — 에 탁월하다. 하지만 추출된 정보에 규칙을 일관되고 결정론적으로 적용하는 것 — "판단하는 것" — 은 상징 시스템이 더 낫다.

이 논문은 LLM에게 "판단"을 시키려고 씨름하는 대신, LLM을 "온톨로지 채우기 엔진"으로 재정의하고, 판단은 30년 역사의 검증된 상징 추론 기술에 맡기는 우아한 분업을 보여준다.

2026년, LLM은 점점 더 똑똑해지고 있다. 하지만 "똑똑함"과 "일관된 규칙 적용"은 다른 능력이다. 법률 판단, 의료 적격성, 과학적 방법론 검증 — 감사 가능하고 정당화 가능한 의사결정이 필요한 곳에서, 신경과 상징의 결합이 어느 쪽 단독보다 강력하다는 것을 이 논문이 실험적으로 증명했다.

눈은 보고, 두뇌는 판단한다. 각자 잘하는 일을 하는 것이 팀워크다.

참고 문헌