NeOn-GPT: LLM이 온톨로지를 자동으로 만들어 준다고?

온톨로지 전문가가 몇 달 걸리던 작업을, GPT가 몇 시간 만에? NeOn 방법론과 LLM을 결합한 NeOn-GPT 파이프라인의 모든 것. 와인 온톨로지 케이스 스터디와 함께 자동 온톨로지 생성의 현재와 미래를 파헤친다.

온톨로지 전문가가 몇 달 걸리던 작업을, GPT가 몇 시간 만에? NeOn 방법론과 LLM을 결합한 NeOn-GPT 파이프라인의 모든 것. 와인 온톨로지 케이스 스터디와 함께 자동 온톨로지 생성의 현재와 미래를 파헤친다.

2024년 LinkedIn에서 "ontology engineer" 채용 공고를 검색하면 약 3,000건이 나온다. 평균 연봉은 미국 기준 15만~20만 달러. Google, Meta, Amazon, JPMorgan, Mayo Clinic — 업종을 가리지 않는다.

그런데 이상한 점이 있다. 온톨로지 엔지니어란 직업은 대학 전공으로도 거의 가르치지 않고, 경력자를 찾기가 유니콘만큼 어렵다. 도메인 전문 지식(의학, 금융, 법률 등)에 더해 OWL, RDF, SPARQL 같은 시맨틱 웹 기술까지 갖춘 인재를 원하기 때문이다.

한편, 온톨로지에 대한 수요는 폭증하고 있다. Palantir는 온톨로지를 플랫폼의 핵심으로 내세워 시가총액 1,300억 달러를 돌파했고, Microsoft의 GraphRAG는 지식 그래프 기반 검색으로 LLM의 환각을 줄이고 있으며, 의료·법률·제조 분야에서는 AI 시스템의 신뢰성을 위해 도메인 온톨로지가 필수가 되었다.

공급은 부족하고, 수요는 폭증한다. 이 간극을 메울 수 있는 방법은 하나뿐이다 — 자동화.

2024년, 독일 슈투트가르트 대학과 이탈리아 볼로냐 대학, 영국 킹스칼리지 런던 연구팀이 흥미로운 논문을 발표했다. NeOn-GPT: NeOn 방법론이라는 체계적 온톨로지 개발 프레임워크를 GPT-3.5에 프롬프트로 주입하여, 자연어 설명만으로 온톨로지를 자동 생성하는 파이프라인이다.

결론부터 말하면: LLM은 아직 완벽한 온톨로지를 만들지 못한다. 하지만 전문가의 작업 시간을 극적으로 줄여주는 코파일럿으로서의 가능성은 확실히 증명되었다. 이 논문이 보여주는 것은 LLM의 한계이자 동시에 가능성이다.

온톨로지에 대한 더 깊은 배경이 궁금하다면, 온톨로지의 모든 것: 아리스토텔레스에서 Palantir까지 글을 먼저 읽어보시길 추천한다.

와인 소믈리에에게 "까베르네 소비뇽"에 대해 물어보면, 그의 머릿속에서는 이런 일이 벌어진다:

이 "머릿속 지식 구조"를 컴퓨터가 이해할 수 있는 형식으로 정리한 것이 온톨로지다. 더 정확히 말하면:

이 질문을 많이 받는다. 핵심 차이는 추론(inference) 능력이다.

| 비교 항목 | 관계형 DB | 온톨로지 |

|---|---|---|

| 데이터 표현 | 테이블, 행, 열 | 클래스, 속성, 트리플 (주어-관계-목적어) |

| 스키마 유연성 | 고정 스키마 | 개방 세계 가정 (Open World Assumption) |

| 추론 능력 | 없음 (명시적 데이터만 질의) | 있음 (암묵적 관계 자동 도출) |

| 질의 | SQL | SPARQL |

| 표준 형식 | SQL DDL | OWL, RDF, Turtle |

예를 들어, 온톨로지에 "까베르네 소비뇽은 포도 품종이다"와 "포도 품종은 레드 와인을 만드는 데 사용된다"라고 정의하면, 명시적으로 입력하지 않아도 "까베르네 소비뇽으로 만드는 와인은 레드 와인이다"를 자동으로 추론한다. 이것이 데이터베이스에서는 불가능한 일이다.

NeOn-GPT는 Turtle(Terse RDF Triple Language) 형식으로 온톨로지를 생성한다. Turtle은 RDF 트리플을 사람이 읽기 쉬운 형태로 표현하는 문법이다:

@prefix wine: <http://example.org/wine#> .

@prefix rdf: <http://www.w3.org/1999/02/22-rdf-syntax-ns#> .

@prefix rdfs: <http://www.w3.org/2000/01/rdf-schema#> .

# 클래스 계층 정의

wine:Wine rdf:type rdfs:Class .

wine:RedWine rdf:type rdfs:Class ;

rdfs:subClassOf wine:Wine .

# 속성 정의

wine:hasColor rdf:type rdf:Property ;

rdfs:domain wine:Wine ;

rdfs:range wine:WineColor .

# 인스턴스(개별 와인)

wine:CabernetSauvignon rdf:type wine:RedWine ;

wine:hasColor wine:Red ;

wine:hasBody wine:Full .

이 코드가 말하는 것: "레드 와인은 와인의 하위 클래스이고, 까베르네 소비뇽은 레드 와인의 인스턴스이며, 색은 Red이고 바디는 Full이다."

스탠포드 대학의 유명한 와인 온톨로지를 보자. 교육용으로 만들어진 이 온톨로지는 77개 클래스, 13개 객체 속성, 161개 개별 인스턴스로 구성된다. 비교적 작은 규모인데도 개발에 상당한 전문 지식과 시간이 필요했다.

산업 현장에서는 규모가 완전히 다르다:

SNOMED CT 같은 대규모 의학 온톨로지는 수십 년에 걸쳐 수백 명의 전문가가 개발하고, 지금도 매년 업데이트된다. 새로운 도메인마다 이런 노력을 반복하는 것은 현실적으로 불가능하다.

텍스트에서 온톨로지를 자동 추출하려는 시도는 2000년대 초반부터 있었다:

NeOn-GPT가 기존 접근법과 다른 점은 체계적 온톨로지 개발 방법론(NeOn)을 프롬프트 파이프라인으로 번역했다는 것이다. 단순히 "이 텍스트에서 온톨로지를 만들어줘"가 아니라, 전문가가 따르는 절차를 LLM에게 단계별로 안내한다.

LLM에게 "와인 도메인의 온톨로지를 만들어줘"라고 바로 요청하면 어떻게 될까?

마치 건축 설계도 없이 집을 짓는 것과 같다. 기둥은 세웠는데 벽이 없고, 지붕은 있는데 바닥이 빠진 그런 집.

NeOn(Networked Ontologies) 은 2008년 독일·스페인·이탈리아 등 유럽 연구팀이 개발한 온톨로지 공학 방법론이다. Agile 방법론의 빠르고 최소한의 접근과 달리, NeOn은 깊은 개념화와 체계적 검증을 강조한다.

Phase 1 — 요구사항 명세: 온톨로지가 왜 필요하고, 무엇을 표현해야 하는지 정의한다. 핵심은 역량 질문(Competency Questions, CQs) — 온톨로지가 답할 수 있어야 하는 질문 목록이다.

예를 들어 와인 온톨로지의 역량 질문:

Phase 2 — 개념화: 역량 질문에서 엔티티와 관계를 추출하고, 주어-관계-목적어 트리플 형태의 개념 모델을 만든다. 예: Wine hasGrapeVariety GrapeVariety.

Phase 3 — 구현: 개념 모델을 Turtle, OWL 같은 형식 언어로 변환한다. 여기서 객체 속성의 역(inverse), 반사성(reflexivity), 추이성(transitivity), 대칭성(symmetry), 함수적 특성(functional) 등 논리적 제약 조건을 추가한다.

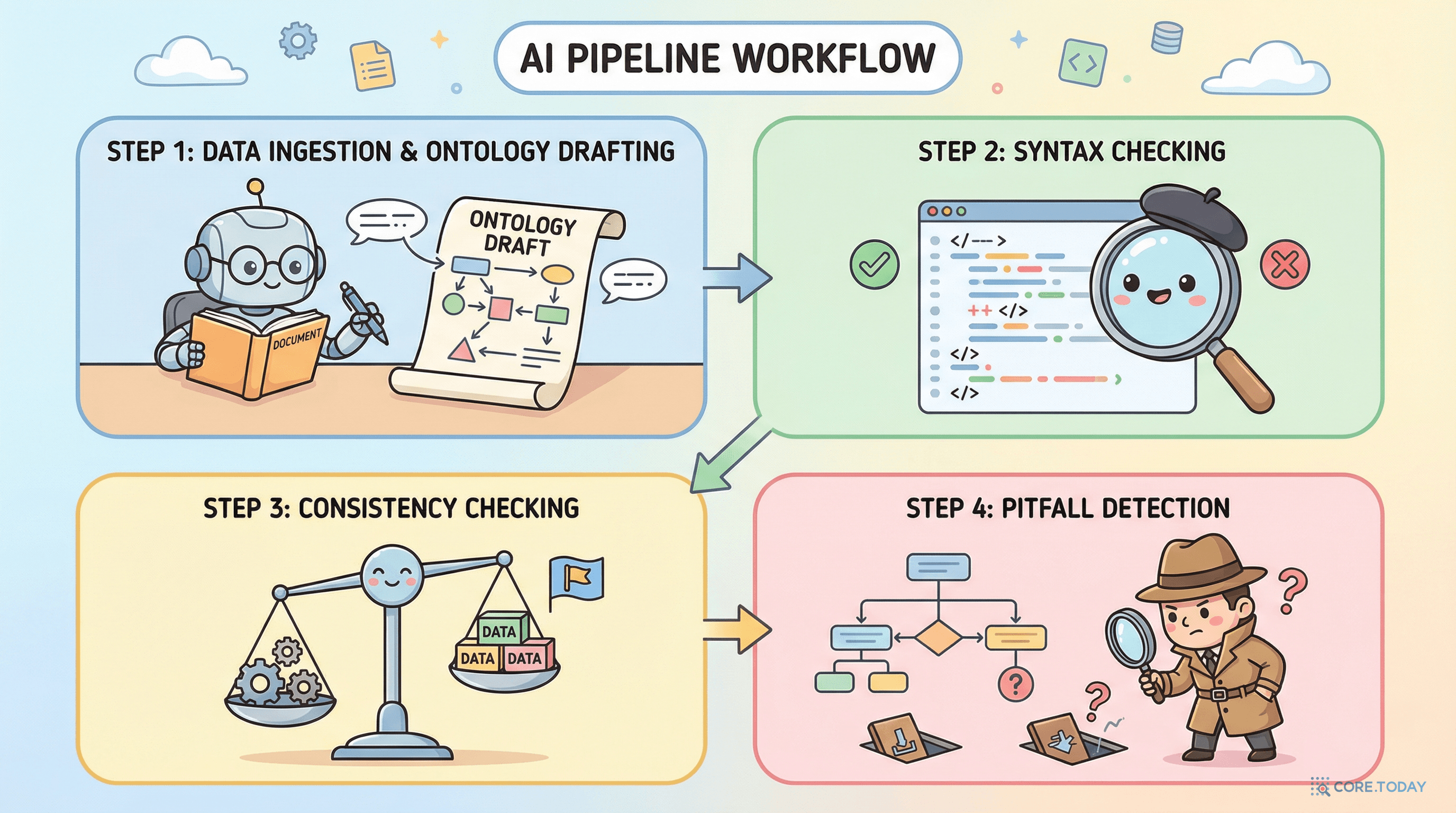

이제 핵심이다. NeOn-GPT는 NeOn 방법론의 3단계를 GPT-3.5에 대한 일련의 프롬프트 시퀀스로 변환하고, 여기에 자동 검증 단계 3개를 추가한다. 총 4단계 파이프라인이다.

이 단계에서 NeOn-GPT는 세 가지 프롬프트 기법을 활용한다:

1) Chain-of-Thought (CoT) 프롬프팅: 단순히 "온톨로지를 만들어줘"가 아니라, 논리적 단계를 밟도록 유도한다.

2) Role-play 프롬프팅: GPT에게 "경험 많은 지식 공학자" 역할을 부여한다. 이로써 도메인 전문가의 관점에서 더 정확한 개념화가 가능해진다.

3) Few-shot 프롬프팅: 엔티티와 관계 추출 시, 예시를 제공한다.

이 과정을 거쳐 GPT-3.5는 역량 질문 생성 → 엔티티/관계 추출 → 트리플 생성 → Turtle 코드 구현 → 인스턴스 추가까지 순차적으로 수행한다.

GPT가 생성한 Turtle 코드에는 구문 오류가 있을 수 있다. NeOn-GPT는 RDFLib 파이썬 라이브러리로 자동 파싱하여 오류를 탐지한다.

구문이 맞아도 논리적 모순이 있을 수 있다. NeOn-GPT는 HermiT Reasoner — OWL 온톨로지 전용 추론 엔진을 사용한다.

논문에서 발견한 실제 오류 사례:

이것은 LLM의 본질적 한계를 잘 보여준다. GPT는 통계적 상관관계에 기반하여 "샤르도네"와 "노란색"을 연결했다 — 실제로 샤르도네 와인은 금빛 노란색이다. 하지만 온톨로지 도메인에서 정의한 색 범위({Red, White, Rose})를 이해하지 못했다. 이런 도메인 규칙 위반은 추론 엔진 없이는 잡을 수 없다.

마지막 단계에서는 OOPS! (OntOlogy Pitfall Scanner) API를 사용하여 온톨로지 설계의 일반적인 함정을 탐지한다.

OOPS!는 함정을 세 등급으로 분류한다:

| Critical | Important | Minor |

|---|---|---|

| 순환 axiom, 누락된 disjointness 등 | 불필요한 상위 클래스, 미사용 속성 등 | 명명 규칙 위반, 주석 누락 등 |

| GPT: 잘 해결함 | GPT: 잘 해결함 | GPT: 해결 못 함 |

논문에서 발견된 대표적 함정: 누락된 비분리성(Missing Disjointness). RedWine과 WhiteWine은 분명히 서로 다른 클래스인데, GPT가 이 비분리 관계를 명시하지 않았다. OOPS!가 이를 탐지하면, NeOn-GPT는 GPT에게 다음을 생성하도록 요청한다:

# Disjointness Axioms

ex:RedWine owl:disjointWith ex:WhiteWine .

ex:SparklingWine owl:disjointWith ex:StillWine .

이 선언이 없으면, 추론 엔진은 "한 와인이 동시에 레드이면서 화이트일 수 있다"고 판단할 수 있다. 현실에서는 말이 안 되지만, 컴퓨터는 명시적으로 금지하지 않으면 허용한다.

NeOn-GPT 팀은 스탠포드 대학의 와인 온톨로지를 기준(gold standard) 으로 사용했다. 이 온톨로지는 Protege 도구와 함께 가장 널리 사용되는 교육용 온톨로지로, 포도 품종, 맛 프로필, 생산 지역 등을 체계적으로 구조화한다.

세 가지 방법을 비교 실험했다:

| 방법 | 접근 방식 | 결과 |

|---|---|---|

| Zero-shot | "와인 온톨로지를 만들어줘" | 평탄한 계층, 구문 오류, 중복 용어 |

| 개발 가이드 프롬프트 | 스탠포드 가이드를 프롬프트로 변환 | 약간 개선되었지만 여전히 구조적 문제 |

| NeOn-GPT | NeOn 방법론 + 4단계 파이프라인 | 논리적으로 건전하고, 도메인 복잡성 포착 |

논문의 Table 1에서 가장 흥미로운 데이터를 가져왔다:

| 메트릭 | 골드 스탠다드 | NeOn-GPT | 비율 |

|---|---|---|---|

| Axioms (공리) | 911 | 387 | 42% |

| Logical Axioms | 657 | 139 | 21% |

| Asserted Classes | 77 | 39 | 51% |

| Object Properties | 13 | 24 | 185% |

| Data Properties | 1 | 12 | 1200% |

| Properties Count | 14 | 36 | 257% |

| Individuals | 161 | 25 | 16% |

이 숫자를 해석하면 매우 흥미로운 패턴이 보인다:

LLM이 잘하는 것:

LLM이 못하는 것:

이것은 LLM의 근본적 작동 방식과 관련이 있다:

논문의 표현을 빌리면:

"LLM이 생성하는 클래스 표현은 일반적으로 포함(subsumption) 유형에 한정되며, 교집합(conjunction)과 분리합(disjunction) 표현이 부족하다. 속성 제약도 주로 HasValue 유형에 한정되어, 카디널리티, 존재적, 전칭적 제약이 없다."

쉽게 말해: GPT는 "A는 B의 일종이다"는 잘 표현하지만, "A는 정확히 B이면서 C이고, D 속성의 값이 3개 이상인 것"은 표현하지 못한다.

논문의 가장 인상적인 비교가 CabernetSauvignon(까베르네 소비뇽)의 추론 결과다:

| 추론 결과 | 골드 스탠다드 | NeOn-GPT |

|---|---|---|

| 추론된 클래스 | DryRedWine (클래스 등가 + 속성 제약으로 추론) | GrapeVariety (단순 분류) |

| 추론 경로 | hasColor=Red, hasSugar=Dry → class equivalence → DryRedWine | rdf:type GrapeVariety (직접 선언) |

| 추론 깊이 | 다단계 추론 | 단일 단계 |

골드 스탠다드에서는 CabernetSauvignon이 hasColor Red, hasSugar Dry 등의 속성을 가지고 있고, DryRedWine이라는 클래스가 "색이 Red이고 당도가 Dry인 와인"으로 등가 정의되어 있으므로, 추론 엔진이 자동으로 CabernetSauvignon을 DryRedWine으로 분류한다.

반면 NeOn-GPT의 온톨로지에서는 이런 복잡한 클래스 정의가 없어서, CabernetSauvignon은 단순히 "포도 품종"으로만 분류된다. 정확하지만 단순하다.

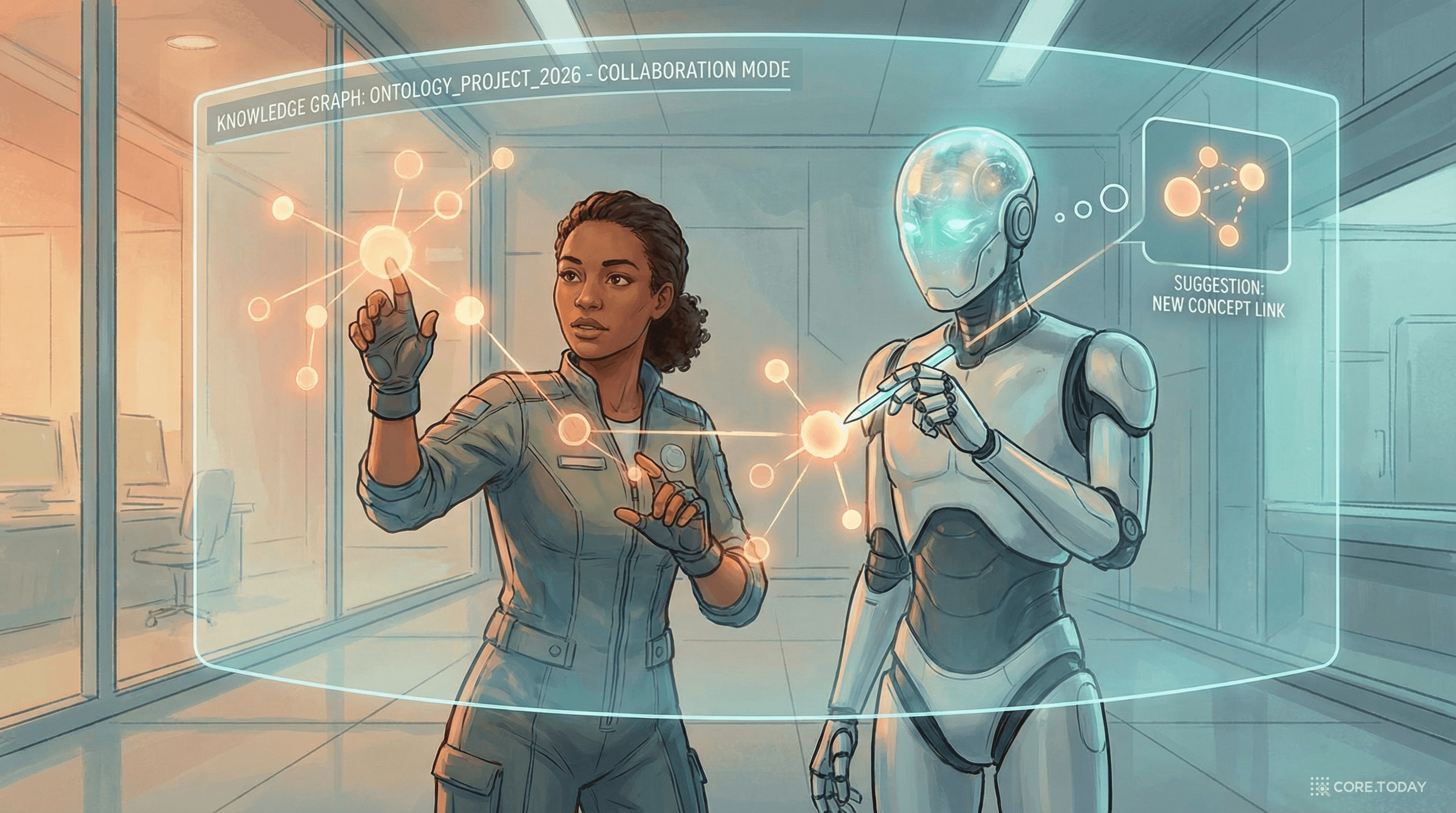

NeOn-GPT는 학술 논문에서 끝나지 않고, metaphactory라는 지식 그래프 관리 플랫폼에 통합되었다. metaphactory는 기업용 온톨로지와 지식 그래프를 시각적으로 관리할 수 있는 상용 플랫폼이다.

통합 방식이 영리하다. metaphactory의 Workflow Ontology를 활용하여, NeOn-GPT의 각 단계를 워크플로우 스텝으로 정의했다. 사용자는 GUI에서 단계별로 진행하며, 각 스텝의 프롬프트 템플릿이 자동으로 제시된다.

이 접근법의 핵심 장점은 LLM이 절차적 태스크를 건너뛸 수 없도록 가드레일을 제공한다는 것이다. 논문이 지적하듯, LLM은 절차적 작업에서 환각(hallucination)을 일으키거나 단계를 건너뛰는 경향이 있다. 워크플로우 시스템이 이를 방지한다.

NeOn-GPT가 2024년에 발표된 이후, 이 분야는 빠르게 진화하고 있다.

1) 더 강력한 LLM의 등장

NeOn-GPT는 GPT-3.5를 사용했다. 2026년 현재, GPT-4o, Claude 3.5, Gemini 1.5 등 더 강력한 모델이 있다. 특히 코드 생성에 특화된 모델(Code Llama, StarCoder 등)은 Turtle 같은 형식 언어 생성에서 더 나은 성능을 보인다. 논문도 이 방향을 미래 연구로 제안했다.

2) 지식 그래프 링크 예측과의 결합

NeOn-GPT의 가장 큰 약점인 "공리 부족"을 해결하기 위해, KG 링크 예측(link prediction) 기법과 결합하는 연구가 진행 중이다. 링크 예측은 기존 지식 그래프에서 누락된 관계를 통계적으로 추론하는 기법으로, LLM이 놓치는 세밀한 관계를 보완할 수 있다.

3) RAG + 온톨로지의 융합

2025~2026년의 가장 뜨거운 트렌드는 온톨로지 기반 RAG다. GraphRAG, OG-RAG(Ontology-Grounded RAG) 등이 등장하며, LLM의 검색 증강 생성에 온톨로지를 활용하여 환각을 줄이고 도메인 정확성을 높이고 있다. NeOn-GPT 같은 파이프라인으로 자동 생성한 온톨로지가 RAG 시스템의 지식 백본이 될 수 있다.

논문의 결론은 명확하다: 아직은 아니다. 하지만 강력한 코파일럿이 된다.

이상적인 워크플로우는 이렇다:

기존에 몇 달 걸리던 작업이 며칠로 줄어든다. LLM이 전문가를 대체하는 것이 아니라, 전문가가 가장 가치 있는 작업 — 복잡한 논리적 모델링 — 에 집중할 수 있게 해준다.

NeOn-GPT는 "LLM이 전문가를 대체할 수 있는가?"라는 질문에 대한 솔직한 답변이다. 대체하진 못하지만, 전문가의 시간을 극적으로 절약해줄 수 있다. 그리고 이것만으로도 온톨로지 분야의 인재 병목을 해소하는 데 큰 기여를 할 수 있다.

온톨로지 자동 생성의 여정은 이제 시작이다. NeOn-GPT의 코드는 GitHub에서 공개되어 있으며, 누구나 자신의 도메인에 적용해볼 수 있다.

참고 논문: Fathallah, N., Das, A., De Giorgis, S., Poltronieri, A., & Haase, P. (2024). NeOn-GPT: A Large Language Model-Powered Pipeline for Ontology Learning. University of Stuttgart, King's College London, ISTC-CNR, University of Bologna, metaphacts GmbH.