왜 PINN은 자꾸 실패할까 — Physics-informed Neural Networks 훈련 전문가 가이드

PINN의 아이디어보다 어려운 것은 훈련이다. 왜 학습이 자주 무너지는지, 2023년의 전문가 가이드 논문이 어떤 처방을 제안했는지, 그리고 2026년 현재 PINN이 어디에 남아 있는지를 사례와 함께 쉽게 풀어본다.

PINN의 아이디어보다 어려운 것은 훈련이다. 왜 학습이 자주 무너지는지, 2023년의 전문가 가이드 논문이 어떤 처방을 제안했는지, 그리고 2026년 현재 PINN이 어디에 남아 있는지를 사례와 함께 쉽게 풀어본다.

PINN(Physics-Informed Neural Networks)을 처음 접하면 대개 같은 감탄이 나온다. "데이터가 적어도 괜찮다. 물리 법칙을 손실함수에 넣으면 되니까." 실제로 이 문장은 여전히 맞다. 문제는 그다음이다. 방정식을 안다고 해서 잘 학습되는 것은 아니다.

좋은 레시피를 손에 쥐고도 오븐 온도는 들쭉날쭉하고, 재료 계량은 엉망이고, 굽는 순서까지 뒤바뀌면 결과가 망가지는 것처럼 PINN도 그렇다. PDE residual, 경계 조건, 초기 조건, 관측 데이터, 샘플링 전략, 네트워크 구조, 활성화 함수, 입력 스케일링, 시간 전개 방식이 서로 줄다리기를 벌인다. 그래서 현업에서는 "PINN이 안 된다"가 아니라 더 정확히는 "PINN을 잘 훈련시키기 어렵다" 가 문제였다.

이 글은 그 지점을 정면으로 다룬다. 2023년 8월 16일 arXiv에 공개된 An Expert’s Guide to Training Physics-informed Neural Networks는 PINN을 둘러싼 논의를 "아이디어가 아름답다"에서 "어떻게 하면 실제로 수렴시키는가"로 이동시킨 상징적인 문헌이다. 왜 PINN이 역사적으로 등장했는지, 무엇이 훈련을 무너뜨리는지, 그리고 2026년 4월 현재 왜 PINN이 더 좁지만 더 중요한 자리로 이동했는지를 사례 중심으로 읽어보자.

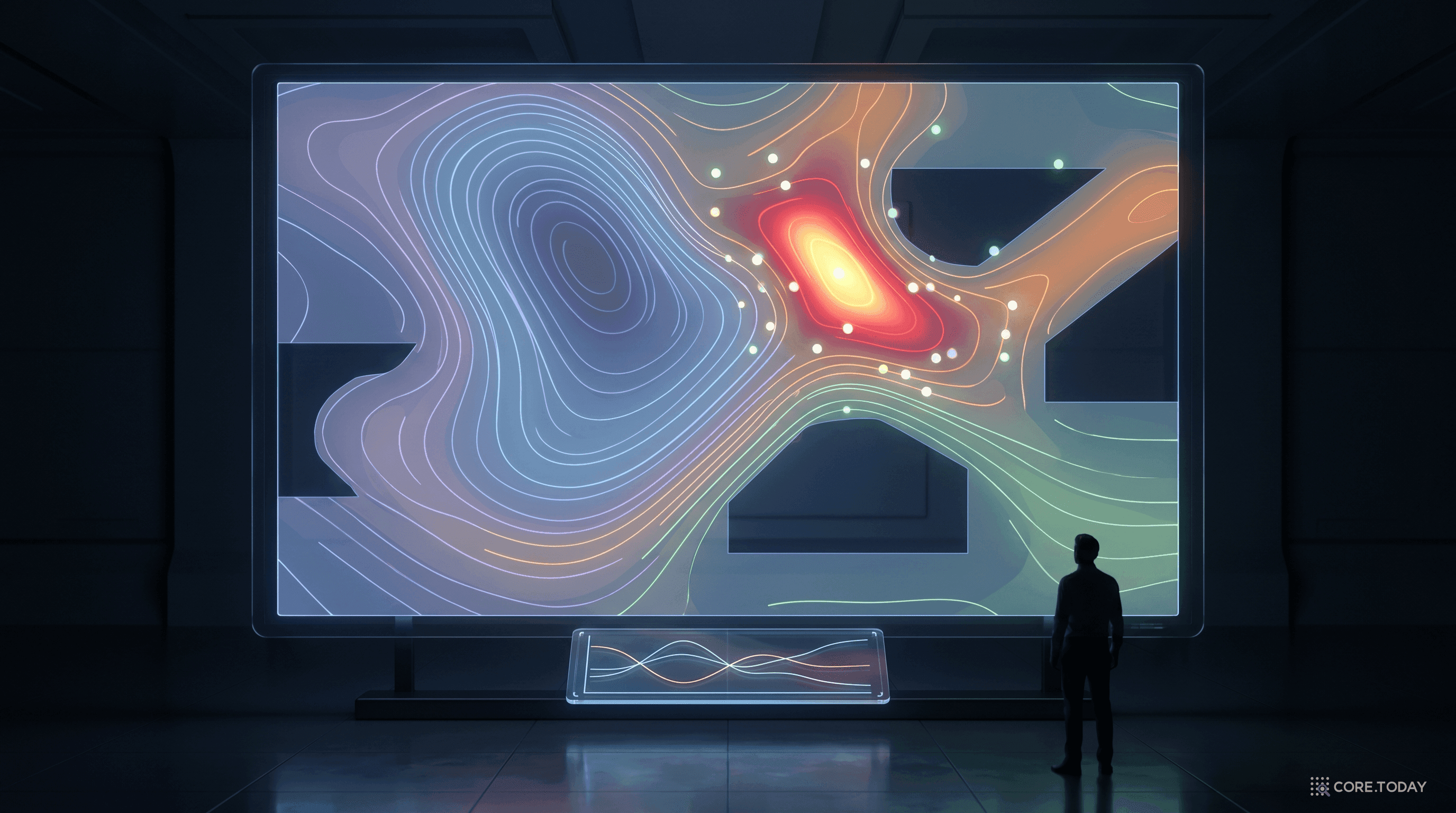

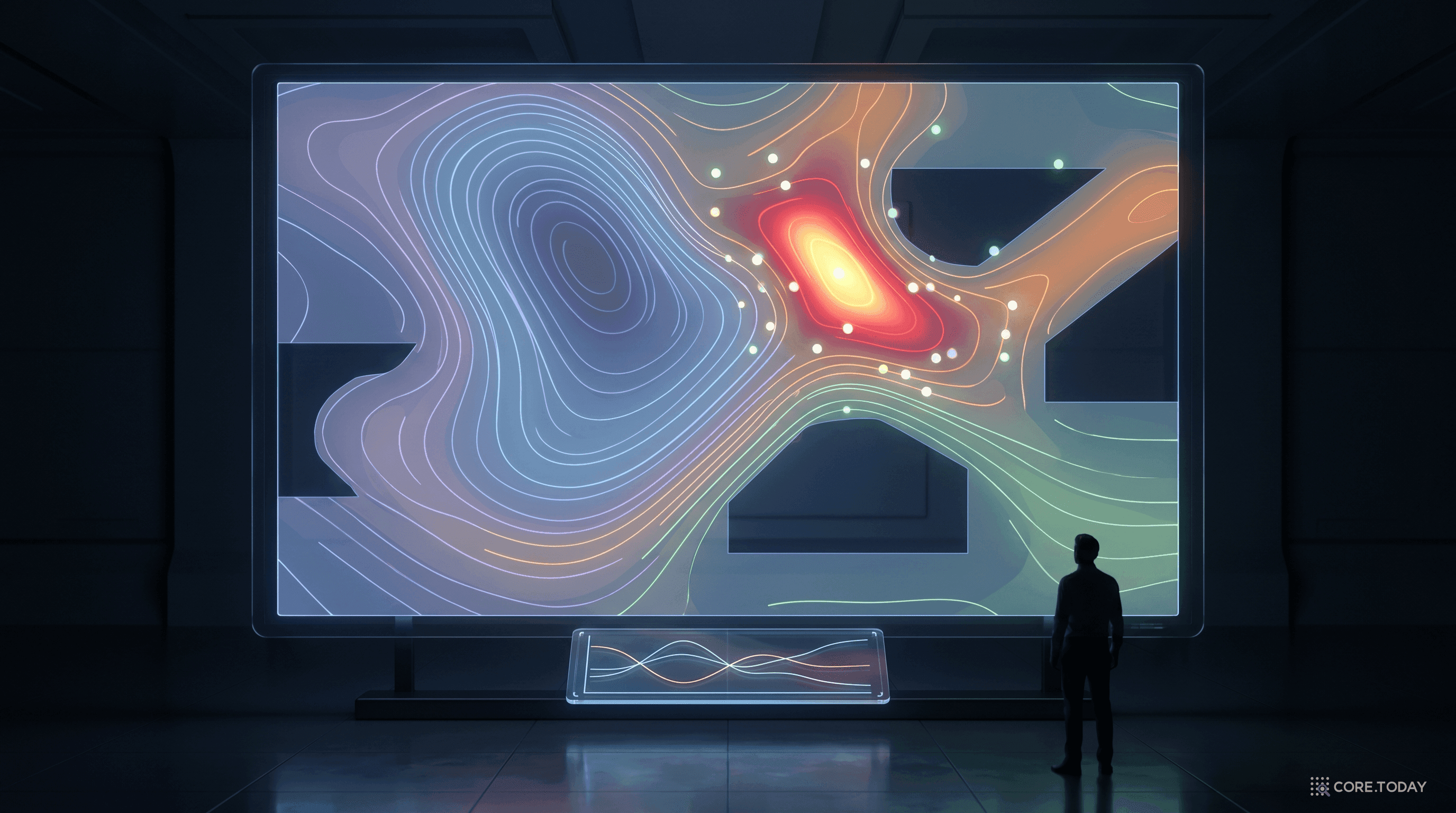

PINN의 핵심 구조는 단순하다. 신경망이 해를 예측하고, 자동미분으로 PDE residual을 계산해, 데이터 손실과 물리 손실을 함께 줄인다. 하지만 실제 학습은 단일 목표 최적화가 아니라 서로 다른 물리적 요구를 동시에 만족시키는 다목적 협상에 가깝다.

문제를 직감적으로 보자. 오염물질이 한쪽으로 쓸려 가는 advection 문제에서는 뒤쪽 시간 구간이 앞쪽보다 훨씬 어렵다. 상 분리가 일어나는 Allen-Cahn 문제에서는 초기 조건을 너무 강하게 잡으면 PDE residual이 죽고, 반대로 residual만 강조하면 경계와 초기 구조가 무너진다. 점성 유동을 푸는 Stokes 문제에서는 단위 스케일이 제멋대로면 gradient가 엉킨다. Kuramoto-Sivashinsky처럼 혼돈성이 강한 동역학은 긴 시간 구간을 한 번에 학습시키는 순간 뒤쪽이 붕괴하기 쉽다.

연구자들이 이런 현상을 묶어 부르는 말이 training pathologies, 즉 훈련 병리다. 여기에는 대표적으로 네 가지가 있다.

여기에 활성화 함수 선택까지 얹힌다. 전문가 가이드 논문이 강조하듯, ReLU는 2차 미분이 0이므로 2차 PDE residual이 핵심인 문제에는 적합하지 않다. PINN에서는 "딥러닝에서 많이 쓰이니까"가 통하지 않는다. 이미지 분류에서 잘 먹히는 습관을 그대로 들고 오면, PDE residual 계산에서 갑자기 발목을 잡힌다.

정리하면 PINN의 어려움은 물리를 모르는 데서 오지 않는다. 오히려 물리를 너무 많이 한꺼번에 반영하려다 생긴다. 잘못된 PINN은 만능 신경망처럼 보이지만, 실제로는 미세하게 조율된 훈련 레시피가 필요한 과학 계산기에 가깝다.

PINN은 갑자기 하늘에서 떨어진 개념이 아니다. 이 흐름을 이해하려면 세 번의 전환점을 봐야 한다.

첫 번째 전환점은 Lagaris et al.의 1998년 논문이다. 이 초기 계열의 아이디어는 오늘날의 PINN과 결이 조금 다르다. 신경망이 임의의 해를 내도록 두는 대신, 시행해(trial solution)를 설계해 경계 조건이나 초기 조건을 구조적으로 만족하도록 만들었다. 한마디로 "출력을 잘 고정해 물리를 지키게 하자"는 발상이다. 당시에는 계산 자원도, 자동미분 생태계도 부족해서 대규모 흐름으로 이어지지는 못했지만, "신경망을 미분방정식 해의 매개변수화로 쓸 수 있다"는 씨앗을 심었다.

두 번째 전환점은 2017년 arXiv 프리프린트와 이어지는 Raissi, Perdikaris, Karniadakis의 JCP 논문이다. 여기서 PINN은 지금 우리가 아는 형태를 얻는다. PDE residual을 손실함수에 직접 넣고, 자동미분으로 편미분을 계산해, 정문제와 역문제를 하나의 프레임워크로 다루는 방식이다. 이 시점부터 PINN은 "신경망으로 방정식을 푸는 흥미로운 발상"이 아니라 "희소 데이터와 물리 제약을 함께 다루는 과학 머신러닝 프레임워크"가 되었다.

세 번째 전환점은 2021년 5월 24일 공개된 Nature Reviews Physics 리뷰다. Physics-informed machine learning은 단지 PINN을 홍보한 논문이 아니었다. 데이터와 수학 모델의 결합, 역문제에서의 강점, 대형 문제에서의 도메인 분해 필요성을 한 자리에 정리하며, 동시에 한계도 드러냈다. 즉 "PINN이 어디에 맞는가"뿐 아니라 "아무 데나 꽂아 넣으면 안 된다" 는 감각이 정리되기 시작한 것이다.

왜 하필 2023년 논문이 중요할까? 그전까지 PINN 문헌에는 종종 같은 문제가 반복됐다. 새로운 아키텍처를 제안했는데, 사실은 샘플링 전략이나 손실 가중치가 더 큰 차이를 만들고 있었다. 어떤 실패는 PINN 자체의 한계가 아니라, 비차원화와 시간 분할이 빠진 탓이었는데도 "PINN은 이 PDE에 약하다"는 식으로 요약되곤 했다. 전문가 가이드는 이 혼란을 정리하며, 효과가 있는 PINN은 운이 좋은 PINN이 아니라 잘 조리된 PINN이라고 못 박는다.

또 하나 중요한 역사적 맥락이 있다. 2021년의 PINO(Physics-Informed Neural Operator) 같은 흐름은 이미 "PINN만이 답은 아니다"라는 메시지를 던지고 있었다. 다중 스케일 동역학에서 순수 PINN이 최적화 난제로 무너질 때, 연산자 학습과 물리 제약의 결합은 다른 길을 보여줬다. 그래서 2023년 전문가 가이드의 의미는 PINN의 왕좌를 선언한 데 있지 않다. 오히려 PINN이 살아남으려면 훈련을 과학적으로 다뤄야 한다는 현실 선언에 가깝다.

전문가 가이드 논문은 PINN 실패를 "유저가 멍청해서" 같은 식으로 설명하지 않는다. 대신 반복적으로 나타나는 병리를 세 갈래로 정리한다. 스펙트럴 바이어스, 불균형한 그래디언트, 인과성 위반이다. 그리고 이 셋을 줄이는 훈련 파이프라인을 단계별로 제안한다.

핵심 처방은 놀랄 만큼 요리책 같다.

이 순서가 중요하다. 많은 팀이 네트워크를 먼저 바꾸지만, 논문은 Stokes 사례를 통해 비차원화가 빠진 문제는 좋은 아키텍처도 살리지 못한다는 점을 보여준다. 단위를 정리해 모델이 다루기 쉬운 숫자 범위로 옮겨놓는 것이 첫 번째 처방이다.

그다음이 아키텍처다. 이 논문에서 반복적으로 강한 베이스라인으로 등장하는 것은 modified MLP + Fourier feature embedding + random weight factorization(RWF) 조합이다. Fourier feature는 고주파 구조를 더 빨리 포착하게 돕고, RWF는 optimization landscape를 부드럽게 만들어 학습 안정성을 높인다. 즉 "더 깊고 더 큰 네트워크"가 아니라 문제의 주파수 구조와 gradient 흐름에 맞춘 네트워크가 중요하다는 뜻이다.

훈련 알고리즘도 손을 봐야 한다. 논문은 self-adaptive loss balancing, gradient 기반 가중 전략, NTK 기반 weighting, causal training, curriculum training을 같은 레시피 책 안의 도구처럼 다룬다. 여기서 실전 감각이 나온다. 예를 들어 NTK weighting과 gradient 기반 weighting은 성능이 비슷할 수 있지만, NTK weighting은 더 안정적인 대신 계산 비용이 더 비싸다. 그래서 "무조건 최고"가 아니라 문제와 예산에 맞는 선택이 필요하다.

여기서 가장 가치 있는 메시지는 "PINN의 비밀 무기 하나"를 알려준 데 있지 않다. 오히려 반대로, PINN은 단일 요령이 아니라 조합 최적화 문제라는 점을 분명히 했다. PDE 종류, 시간 길이, 경계 구조, 고주파 강도, 물리량 스케일에 따라 레시피가 달라진다.

현업 관점에서 이 논문이 중요한 이유는 세 가지다.

한 줄로 줄이면 이렇다. 좋은 PINN은 물리를 많이 넣어서 생기지 않는다. 물리를 네트워크가 배울 수 있는 순서와 크기로 정렬해 주는 데서 나온다.

이제 추상적인 병리 이야기를 실제 처방으로 바꿔 보자. 전문가 가이드 논문의 미덕은 "원리"에서 멈추지 않고, PDE마다 어떤 조합이 잘 작동했는지를 꽤 구체적으로 보여준다는 데 있다.

먼저 논문이 제시한 대표 조합을 한눈에 보면 다음과 같다.

| 문제 | 추천 아키텍처 | 가중 전략 | 핵심 포인트 |

|---|---|---|---|

| Advection | Modified MLP + Fourier scale 1.0 | GradNorm | 인과적 시간 분할을 넣어야 뒤쪽 시간대 붕괴를 막기 쉽다 |

| Allen-Cahn | Modified MLP + Fourier scale 2.0 | NTK | 초기 조건과 PDE residual 균형이 핵심이다 |

| Stokes | Modified MLP + GeLU + Fourier scale 10.0 | GradNorm | 고정밀 유동 문제에서는 activation과 embedding scale이 민감하다 |

| Kuramoto-Sivashinsky | Modified MLP + windowed training | GradNorm | 긴 시간 구간은 한 번에 학습하지 말고 window로 쪼갠다 |

Advection은 겉으로는 단순하다. 한 방향으로 신호나 농도가 이동한다. 하지만 PINN 입장에서는 만만하지 않다. 앞쪽 시간 구간에서 생긴 작은 오차가 뒤쪽 시간 구간에서 누적되기 때문이다. 마치 컨베이어벨트 위에 놓인 상자를 첫 10m에서 비뚤게 놓으면, 마지막 100m에서는 완전히 다른 위치로 가는 것과 같다.

이 논문이 제안한 Advection 레시피는 4층, 폭 256의 Modified MLP, Tanh, Fourier scale 1.0, GradNorm weighting, 200,000 스텝, 배치 크기 8192, 32개 청크다. 숫자보다 중요한 것은 조합의 의미다. Fourier embedding으로 이동하는 파형의 주파수 구조를 잡고, GradNorm으로 손실 항의 크기를 맞추며, 시간 구간은 청크로 나눠 causal training에 가깝게 접근한다.

실무 비유를 들면, 이는 배터리 디지털 트윈에서 전극 내부 농도 전파를 시간 순서대로 복원할 때와 비슷하다. 현재 상태를 제대로 잡지 못하면 이후 예측도 망가진다. Advection 사례는 "시간은 한 덩어리 데이터셋이 아니라 순서가 있는 과정"이라는 점을 PINN에게 다시 가르친다.

Allen-Cahn은 상 전이, 계면 진화, 부식 전선 같은 현상을 이해할 때 자주 등장한다. 여기서는 해가 매끄럽게 보이면서도 계면에서는 급격한 변화가 생긴다. 그래서 스펙트럴 바이어스와 손실 불균형이 동시에 문제를 일으킨다.

논문이 제시한 설정은 Modified MLP, 4층, 폭 256, Tanh, Fourier scale 2.0, NTK weighting, 300,000 스텝, 배치 크기 8192, 32개 청크다. 여기서 눈여겨볼 부분은 NTK weighting이다. Allen-Cahn에서는 초기 조건과 PDE residual이 자주 싸우는데, NTK weighting은 이 둘의 학습 속도를 맞추는 데 안정적으로 작동한다. 다만 계산 비용은 더 든다. 따라서 이 처방은 "더 좋은 정답"이라기보다 안정성을 사기 위해 계산비를 지불하는 선택에 가깝다.

이 문제를 쉽게 떠올리려면 금속 표면에서 부식 경계가 이동하는 상황을 상상하면 된다. 초기 계면을 잘못 학습하면 뒤의 진화가 전부 틀어지고, residual만 세게 밀면 계면 모양은 맞는데 시점이 어긋난다. Allen-Cahn 사례는 PINN이 예쁘게 생긴 해보다 시간적으로 일관된 해를 배우게 만드는 균형의 문제다.

Stokes 흐름은 저레이놀즈 수 유동, 미세유체, 혈류 역문제 같은 곳에서 자주 만난다. 현업에서는 특히 의료 혈류 추정이나 다공성 매질 내부 유동 파라미터 추정처럼 관측은 희소하지만 물리 제약은 강한 문제에 연결된다.

전문가 가이드 논문은 Stokes를 통해 아주 중요한 사실을 강조한다. 비차원화가 우선이다. 이 사례에서 권장 설정은 Modified MLP, 4층, 폭 256, GeLU, Fourier scale 10.0, GradNorm weighting, 100,000 스텝, 배치 크기 8192다. 하지만 이 숫자는 비차원화가 된 이후에야 의미가 있다. 단위를 정리하지 않으면 embedding scale 10.0이든 GeLU든 optimizer는 여전히 허공에서 허우적댄다.

또 하나 흥미로운 점은 activation 선택이다. Stokes처럼 미분 구조가 중요한 문제에서 GeLU가 좋은 결과를 낸 것은, PINN이 일반 딥러닝의 관성을 그대로 따르지 않는다는 증거다. 앞서 말한 것처럼 ReLU는 2차 미분이 0이어서 이런 계열 PDE에 부적절할 수 있다. 혈류 역문제를 푼다고 가정해 보자. 혈관 벽 부근의 속도장, 압력 분포, 점성 계수를 한꺼번에 추정해야 하는데, 네트워크 미분 자체가 빈약하면 애초에 residual 기반 학습이 설 자리가 줄어든다.

Kuramoto-Sivashinsky는 PINN을 괴롭히는 대표적인 혼돈성 동역학 문제다. 초기에는 그럴듯해 보여도, 긴 시간 범위를 한 번에 학습시키면 뒤쪽이 빠르게 흐트러진다. 이는 마치 하루치 일정을 한 장 표로 정리하는 것은 쉽지만, 1년짜리 프로젝트의 모든 변동을 한 번에 최적화하려 드는 것과 비슷하다.

논문은 이 사례에 Modified MLP, 5층, 폭 256, Tanh, Fourier scale 1.0, GradNorm weighting, 10개 시간 창, 각 창당 200,000 스텝, 배치 크기 4096, 16개 청크를 제안한다. 핵심은 windowed training이다. 긴 시간 구간을 10개 창으로 나눠 한 구간씩 학습함으로써, 미래가 현재를 덮어버리는 현상을 줄인다.

이 전략은 기상·열전달·연소계 경계면처럼 시간이 길고 민감도가 높은 문제에 직관을 준다. 한 번에 다 먹으려 하지 말고, 문제를 시간 창으로 분해하라. Kuramoto-Sivashinsky 사례는 PINN에서 curriculum training과 causal training이 단순한 보조 기능이 아니라, 문제를 풀 수 있게 만드는 본체일 때가 있다는 사실을 보여준다.

네 사례를 관통하는 교훈은 분명하다. PINN 훈련은 "좋은 아키텍처를 골랐다"로 끝나지 않는다. 무슨 PDE인지, 어느 항이 누구와 싸우는지, 시간과 주파수 구조가 어떤지에 따라 레시피를 갈아끼워야 한다. 그래서 전문가 가이드는 하나의 논문이라기보다, PINN을 현업 도구로 쓰기 위한 디버깅 매뉴얼에 가깝다.

2026년 4월 16일 현재 PINN의 위치를 한 문장으로 요약하면 이렇다. 무대의 중심은 아니지만, 없어지지도 않았다. 오히려 역할이 더 분명해졌다.

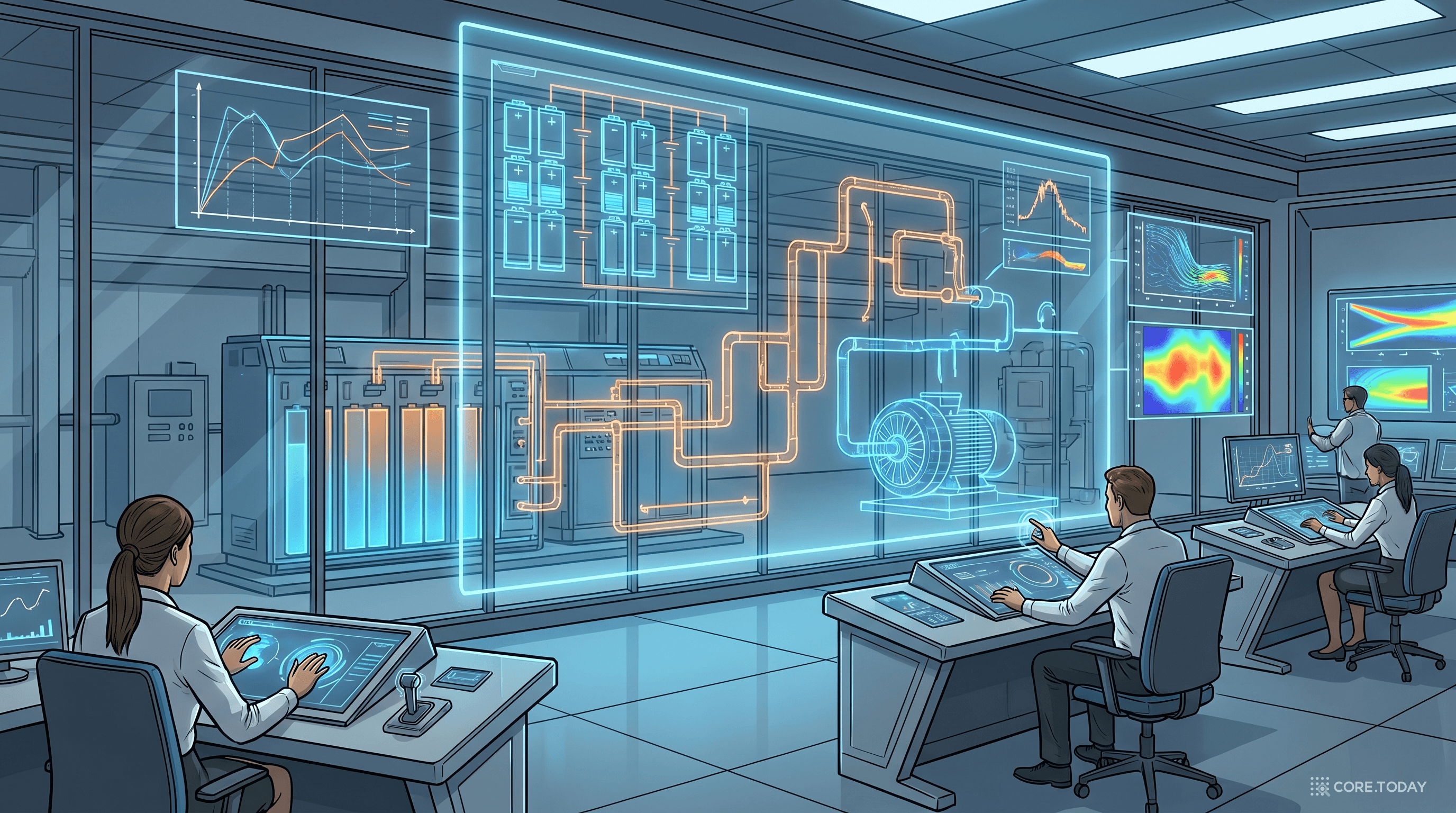

왜 중심이 아니라고 말할까? 적어도 이 글이 참고한 NVIDIA와 관련 벤더 생태계 자료를 보면, 2025년 3월 18일의 Blackwell 관련 CAE 발표와 2026년 2월 3일의 Dassault Systèmes-NVIDIA 발표는 PINN 단독 서사보다 실시간 예측, 하이브리드 스택, 디지털 트윈, science-validated industrial AI 같은 프레이밍을 더 전면에 둔다. 2026년의 NVIDIA PhysicsNeMo 공식 페이지 역시 PINN만 따로 밀기보다 neural operators, GNNs, diffusion models까지 포함한 physics AI 스택을 제시하고, CFD, 열 해석, 기후, 날씨 같은 참조 파이프라인을 함께 보여준다.

이는 곧 현실을 말해 준다. 대형 전방향 시뮬레이션, 넓은 파라미터 공간, 반복 추론이 중요한 업무에서는 신경 연산자나 고전 해석기와의 하이브리드가 더 적합한 경우가 많다. 예를 들어 초음속 또는 천이 유동이 걸린 날개 설계처럼 고충실도 CFD가 필요한 문제에서, 순수 PINN 하나로 산업 설계를 돌리겠다는 주장은 2026년 기준으로 과감하다. 이 영역은 여전히 고전 해석기와 가속기, surrogate, operator 모델의 결합이 더 현실적이다.

반대로 PINN이 여전히 강한 자리도 분명하다.

| 접근 | 2026년 강점 | 주의할 점 | 잘 맞는 장면 |

|---|---|---|---|

| 고전 해석기 | 검증된 정확도와 신뢰성 | 비용이 크고 반복 탐색이 느리다 | 인증이 중요한 고충실도 설계, 기준 해 생성 |

| PINN | 희소 데이터와 물리 제약을 함께 다루기 좋다 | 훈련 병리에 민감하고 레시피 의존적이다 | 역문제, 상태 추정, 파라미터 보정, 물리 제약 디지털 트윈 |

| Neural Operator | 넓은 분포에서 빠른 추론과 대량 반복 예측 | 학습 데이터와 분포 설계가 중요하다 | 대규모 대리모델, 반복 설계 탐색, 실시간 예측 |

| 하이브리드 디지털 트윈 | solver, sensor, AI 모델을 함께 엮을 수 있다 | 시스템 통합과 검증 체계가 더 어렵다 | 배터리 운영, 공정 제어, 산업용 virtual twin |

이 표를 현업 언어로 바꾸면 이렇다. PINN은 왕이 아니라 전문가다. 모든 문제를 지배하는 범용 모델은 아니지만, 관측이 적고 물리는 강하며 우리가 알고 싶은 것이 "해 전체"보다 "숨은 파라미터와 제약된 상태"에 가까울 때 여전히 아주 날카롭다.

PINO와 같은 neural operator 계열의 부상은 PINN의 패배 선언이 아니다. 오히려 역할 분담의 시작이다. 빠른 전방향 근사는 operator가, 엄격한 물리 제약과 역문제는 PINN이, 기준 해와 인증은 고전 solver가, 그리고 실제 산업 운영은 이 셋을 묶은 hybrid digital twin이 맡는 그림이 2026년의 현실에 더 가깝다.

PINN이 지난 몇 년 동안 준 가장 큰 교훈은 의외로 단순하다. 물리를 손실함수에 넣는 것만으로는 충분하지 않다. 물리를 어떤 순서로, 어떤 스케일로, 어떤 시간 전략으로, 어떤 아키텍처 위에 얹을지를 설계해야 한다.

그래서 앞으로의 PINN 경쟁력은 "더 복잡한 방정식을 넣었다"가 아니라 "더 잘 훈련했다"에서 갈릴 가능성이 크다. 비차원화, Fourier feature, RWF, 손실 균형, causal training, curriculum training, domain decomposition 같은 요소는 장식이 아니라 본체다. 2023년 전문가 가이드가 남긴 가치는 바로 여기 있다. PINN을 신비로운 블랙박스에서 조리법이 있는 공학 도구로 바꿔 놓았다는 점이다.

만약 누군가 "PINN은 아직도 되느냐"고 묻는다면, 2026년의 가장 정확한 답은 아마 이럴 것이다. "그냥은 잘 안 된다. 하지만 제대로 훈련하면, 아직도 꼭 필요한 곳이 있다."