OG-RAG: 온톨로지로 RAG에 '전문가의 눈'을 심다

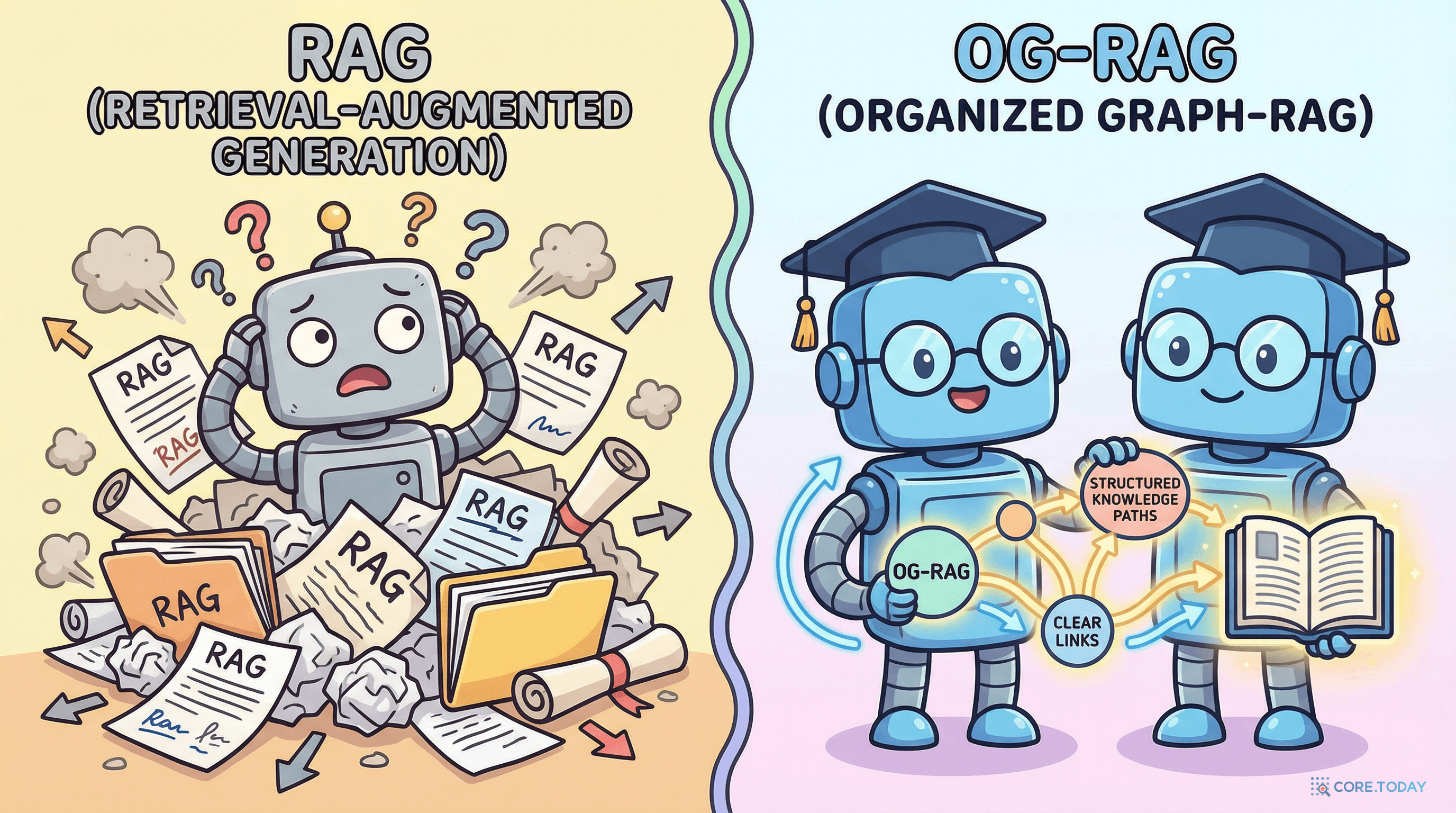

RAG가 문서를 찾아주긴 하는데, 도메인 전문가처럼 '진짜 중요한 사실'을 골라내지 못한다면? Microsoft Research가 제안한 OG-RAG는 온톨로지로 검색을 근거화하여 사실 재현율을 55% 향상시킨다.

RAG가 문서를 찾아주긴 하는데, 도메인 전문가처럼 '진짜 중요한 사실'을 골라내지 못한다면? Microsoft Research가 제안한 OG-RAG는 온톨로지로 검색을 근거화하여 사실 재현율을 55% 향상시킨다.

인도의 한 농부가 AI 농업 상담 시스템에 묻는다:

"마디아프라데시 지역에서 대두(Soybean) 파종량은 얼마나 필요한가?"

일반 RAG 시스템은 "대두"와 "파종량"이 포함된 문서 청크를 찾아 답한다:

"대두의 일반적인 파종량은 헥타르당 60~80kg입니다."

얼핏 맞아 보인다. 하지만 전문가라면 이렇게 답했을 것이다:

"마디아프라데시 지역에서 대두 품종 JS335와 JS 95-60의 권장 파종량은 헥타르당 60

80kg이며, 해당 지역의 재배 시기는 67월입니다."

차이가 보이는가? 전문가의 답에는 지역-작물-품종-파종량-시기 사이의 관계가 정확히 반영되어 있다. 일반 RAG는 "60~80kg"이라는 숫자를 맞혔지만, 어떤 품종이, 어떤 지역에서, 언제 그 양이 적용되는지는 놓쳤다.

도메인 전문 지식에서는 개별 사실이 아니라 사실들 사이의 관계가 핵심이다. 그리고 이 관계를 체계적으로 표현하는 도구가 바로 온톨로지(Ontology)다.

이 글에서는 Microsoft Research가 제안한 OG-RAG(Ontology-Grounded Retrieval-Augmented Generation)를 중심으로, RAG에 도메인 전문가의 눈을 심는 기술을 깊이 파헤친다.

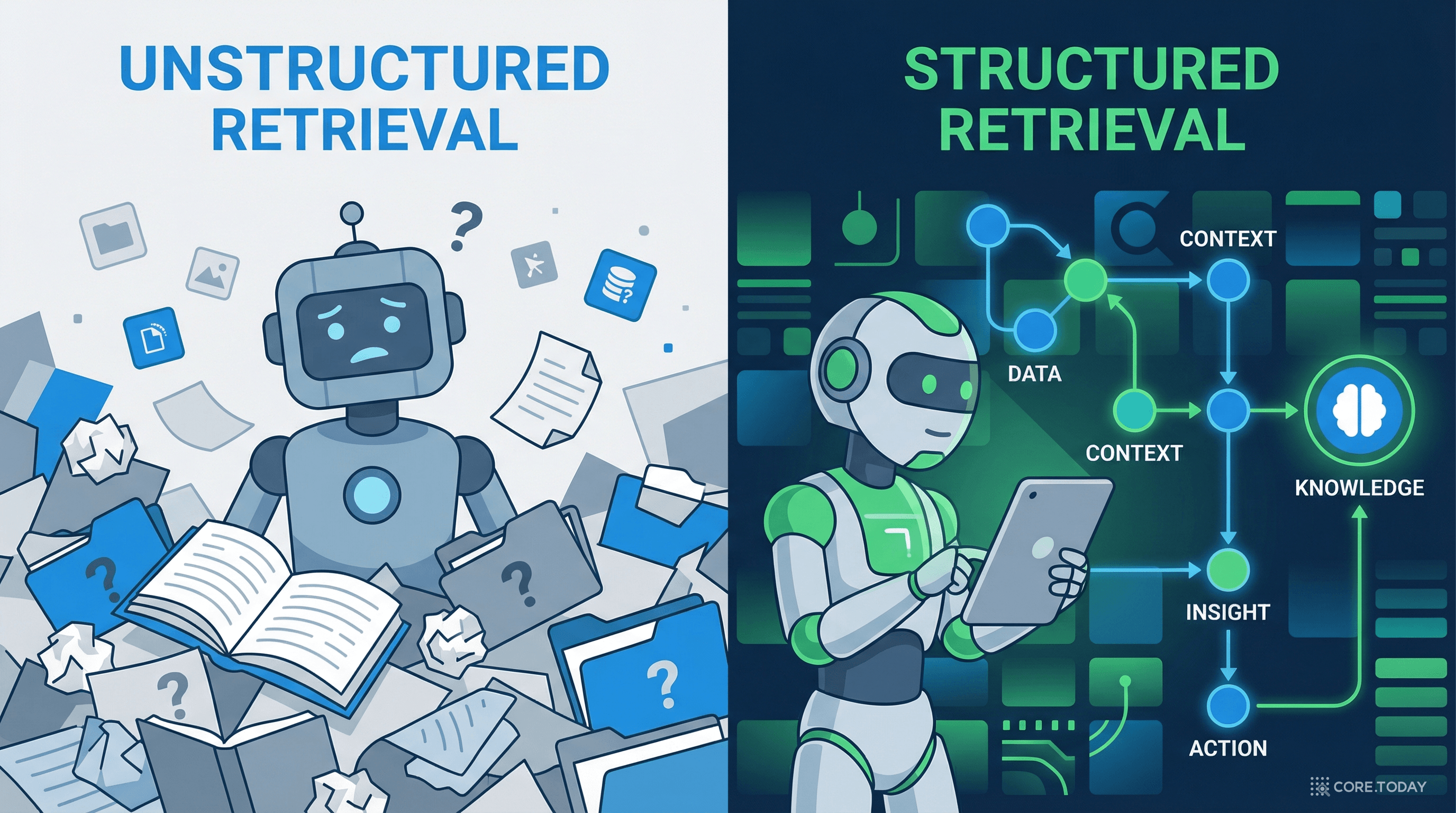

RAG는 문서를 청크로 쪼개고 임베딩하여 유사도로 검색한다. 이 과정에서 도메인 지식의 구조가 완전히 무시된다.

파인튜닝으로 도메인 지식을 주입할 수 있지만:

GraphRAG는 지식 그래프로 관계를 보존하지만:

이 세 가지 한계를 동시에 해결하는 것이 OG-RAG다.

온톨로지는 특정 도메인의 핵심 개념(엔티티)과 그들 사이의 관계를 형식적으로 정의한 것이다. 단순한 분류 체계(taxonomy)와 달리, 비계층적인 복잡한 관계도 표현할 수 있다.

온톨로지가 제공하는 것은 도메인 전문가의 사고 방식이다:

| 특성 | 일반 RAG | OG-RAG (온톨로지 기반) |

|---|---|---|

| 검색 기준 | 텍스트 유사도 | 도메인 관계 + 텍스트 유사도 |

| 정보 구조 | 평면적 청크 | 계층적 사실 클러스터 |

| 맥락 귀속 | 청크 단위 (불명확) | 사실 단위 (검증 가능) |

| 추론 능력 | 검색된 텍스트 범위 내 | 규칙 기반 연역 추론 가능 |

역사적으로 온톨로지는 1990년대 전문가 시스템(Expert Systems)에서부터 사용되어 왔다. 의료의 SNOMED CT, 법률의 법률 온톨로지, 뉴스의 SNaP(Simple News and Press) 온톨로지 등 수십 년간 축적된 도메인 온톨로지가 이미 존재한다. OG-RAG는 이 축적된 자산을 LLM 시대에 다시 활용하는 것이다.

OG-RAG의 파이프라인은 크게 전처리 단계와 검색 단계로 나뉜다.

일반 그래프에서는 하나의 엣지가 두 노드만 연결한다. 하이퍼그래프에서는 하나의 하이퍼엣지가 여러 노드를 동시에 연결할 수 있다.

이것이 OG-RAG의 핵심 혁신이다. 하이퍼엣지 하나가 곧 하나의 검증 가능한 사실이 된다. "이 답변의 근거가 무엇인가?"에 대한 답이 하이퍼엣지를 보여주는 것만으로 해결된다.

질문이 들어오면 OG-RAG는 탐욕 알고리즘(greedy algorithm)으로 최적의 맥락을 구성한다:

뉴스 도메인에서도 온톨로지가 위력을 발휘한다. SNaP(Simple News and Press) 온톨로지는 사건(Event), 인물(Person), 조직(Organization), 자산(Asset) 사이의 관계를 정의한다.

논문은 두 가지 도메인에서 OG-RAG를 평가했다:

| 도메인 | 데이터 | 온톨로지 |

|---|---|---|

| 농업 (산업 워크플로우) | 대두·밀 재배 관련 전문 문서 85건 | 농업 전문가가 검증한 자체 온톨로지 |

| 뉴스 (지식 워크) | Multi-hop RAG 데이터셋, 2,000단어 이상 심층 기사 149건 | SNaP 뉴스 온톨로지 (수정) |

비교 대상: RAG, RAPTOR, GraphRAG (모두 GPT-4o, GPT-4o-mini, Llama-3.1-8B, Llama-3.1-70B 4개 LLM에서 테스트)

OG-RAG의 맥락 재현율(Context Recall)이 0.84로, 일반 RAG(0.22)의 3.8배. 엔티티 재현율(Context Entity Recall)도 0.41로 RAG(0.08)의 5.1배. 이는 OG-RAG가 정답에 필요한 사실을 훨씬 더 정확하게 찾아낸다는 뜻이다.

4개 LLM 전체에서 일관되게 OG-RAG가 최고 성능을 보였다:

| LLM | RAG 정확도 | RAPTOR 정확도 | OG-RAG 정확도 |

|---|---|---|---|

| Llama-3.1-8B | 0.26 | 0.34 | 0.40 |

| Llama-3.1-70B | 0.27 | 0.41 | 0.54 |

| GPT-4o-mini | 0.29 | 0.34 | 0.48 |

| GPT-4o | 0.31 | 0.34 | 0.48 |

특히 Llama-3.1-70B에서 OG-RAG는 RAG 대비 답변 정확도를 2배 향상시켰다.

16명의 참가자를 대상으로 한 인간 평가에서:

OG-RAG의 가장 독특한 능력은 사전 정의된 규칙에 따른 연역 추론이다.

| 방법 | 전처리 시간 (초) | 쿼리 시간 (초) | 비고 |

|---|---|---|---|

| RAG | 11.41 | 2.49 | 가장 빠름 |

| OG-RAG | 29.61 | 3.75 | RAG의 약 2배, 정확도는 3배 |

| RAPTOR | 71.66 | 4.81 | OG-RAG의 2.4배 |

| GraphRAG | 157.04 | 5.95 | OG-RAG의 5.3배 |

OG-RAG는 RAG와 비슷한 속도를 유지하면서, 정확도는 압도적으로 높다. GraphRAG 대비 전처리 5배, 쿼리 1.6배 빠르다.

OG-RAG가 일반 지식 그래프 대신 하이퍼그래프를 사용하는 데는 명확한 이유가 있다:

| 특성 | 일반 그래프 (GraphRAG) | 하이퍼그래프 (OG-RAG) |

|---|---|---|

| 엣지가 연결하는 노드 수 | 정확히 2개 | 임의 개수 (다차원) |

| 사실 표현 | "A→관계→B" 이진 관계만 | "A+B+C+D가 함께 사실" 복합 관계 |

| 맥락 귀속 | 경로를 따라가야 함 | 하이퍼엣지 하나가 곧 검증 가능한 사실 |

| 검색 결과 | 노드+엣지의 서브그래프 | 사실 클러스터의 최소 집합 |

핵심: "대두의 마디아프라데시 재배지역에서 품종 JS335의 파종량이 60-80kg/ha이다"라는 사실은 4개 개념을 동시에 연결해야 한다. 일반 그래프로는 이를 표현하려면 여러 엣지가 필요하지만, 하이퍼그래프에서는 하나의 하이퍼엣지로 깔끔하게 표현된다.

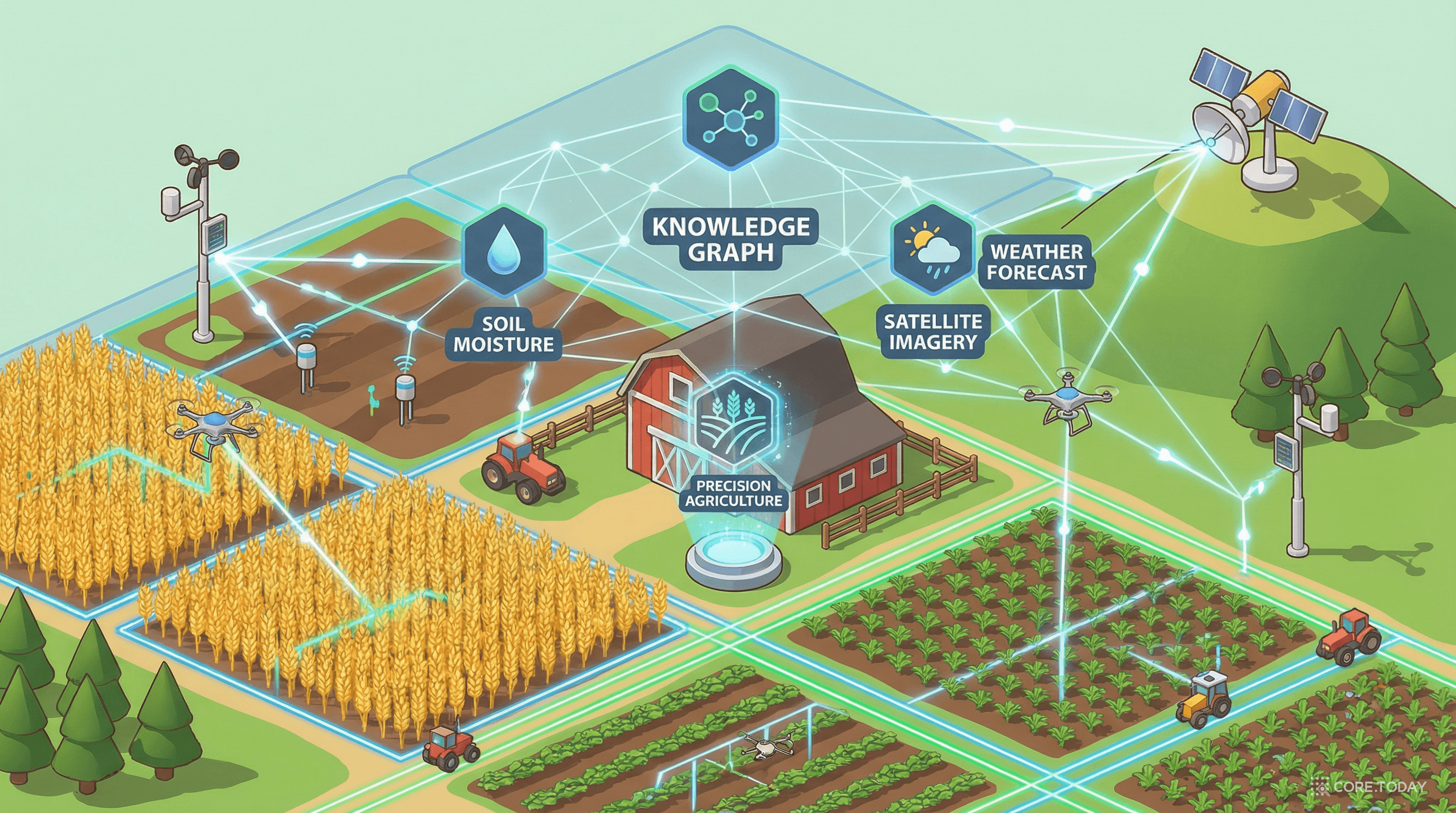

OG-RAG는 정확한 사실 기반 의사결정이 필수인 산업에서 특히 강력하다:

다시 인도의 농부에게 돌아가자. OG-RAG가 적용된 시스템이라면:

농부는 단순히 "60-80kg"이라는 숫자가 아니라, 자신의 지역, 자신의 품종, 자신의 상황에 맞는 정확한 조언을 받게 된다. 그리고 그 조언의 근거를 하이퍼엣지 하나로 바로 확인할 수 있다.

"AI에게 전문가의 지식만 주지 말고, 전문가의 사고 방식도 함께 줘라."

이것이 OG-RAG의 핵심 메시지다. 온톨로지는 단순한 데이터 구조가 아니라, 도메인 전문가가 세상을 이해하는 방식을 형식화한 것이다. OG-RAG는 이 사고 방식을 LLM에 주입함으로써, RAG를 단순한 검색 도구에서 도메인 전문 추론 시스템으로 진화시켰다.

📄 원문 논문: Kartik Sharma, Peeyush Kumar, Yunqing Li. "OG-RAG: Ontology-Grounded Retrieval Augmented Generation For Large Language Models." arXiv preprint arXiv:2412.15235, December 2024.

🏢 연구 기관: Microsoft Research, Seattle