Learning Rate Schedule의 역사: 1951년 수학 정리에서 GPT의 코사인 스케줄까지

딥러닝에서 가장 중요한 하이퍼파라미터, 학습률. 1951년 Robbins-Monro의 수렴 조건에서 시작해, AlexNet의 계단식 감소, 코사인 어닐링, 워밍업, 그리고 GPT가 사용하는 현대적 스케줄까지 — 75년의 역사를 논문과 사례로 추적한다.

딥러닝에서 가장 중요한 하이퍼파라미터, 학습률. 1951년 Robbins-Monro의 수렴 조건에서 시작해, AlexNet의 계단식 감소, 코사인 어닐링, 워밍업, 그리고 GPT가 사용하는 현대적 스케줄까지 — 75년의 역사를 논문과 사례로 추적한다.

2012년, 요슈아 벤지오(Yoshua Bengio)는 딥러닝 실전 가이드에서 이렇게 썼다:

"학습률(learning rate)은 종종 가장 중요한 단일 하이퍼파라미터이며, 항상 튜닝해야 한다."

앤드류 응(Andrew Ng)도 반복적으로 같은 말을 했다. 수십 개의 하이퍼파라미터 중에서 단 하나만 튜닝할 시간이 있다면, 그것은 학습률이어야 한다고.

왜 이 숫자 하나가 이렇게 중요한가? 학습률은 "모델이 한 번에 얼마나 크게 배울 것인가"를 결정한다.

이 글은 학습률 스케줄의 75년 역사를 추적한다. 1951년의 수학 정리에서, 2025년 GPT와 DeepSeek이 사용하는 최신 스케줄까지.

1951년, 수학자 Herbert Robbins와 Sutton Monro가 The Annals of Mathematical Statistics에 "A Stochastic Approximation Method"을 발표한다. 이 논문은 확률적 최적화에서 스텝 사이즈(= 학습률)의 수렴 조건을 증명했다.

이 정리는 "학습률을 시간에 따라 줄여야 한다"는 아이디어의 수학적 토대가 되었다. 75년이 지난 지금도, 모든 학습률 스케줄은 이 두 조건의 정신을 따른다.

Frank Rosenblatt(1958)이 퍼셉트론 논문에서 "가중치(weight)", "학습률(learning rate)", "훈련 세트(training set)"라는 현대적 용어를 도입했다. 초기 실험에서 학습률을 10⁻¹에서 10⁻⁵까지 선형적으로 변화시켰다 — 이것이 기록상 최초의 학습률 스케줄이다.

Widrow-Hoff(1960)의 ADALINE은 고정 학습률을 사용하는 LMS(Least Mean Squares) 규칙을 제안했다.

수십 년간 대부분의 신경망 훈련은 고정 학습률을 사용했다. 문제는 명확했다:

이 딜레마를 해결하려는 시도가 2012년부터 본격화된다.

2012년, Krizhevsky, Sutskever, Hinton의 AlexNet이 ImageNet 대회를 압도적으로 승리하며 딥러닝 르네상스를 시작했다. AlexNet의 학습률 스케줄은 단순했다:

VGG: 초기 LR 0.001 (AlexNet보다 10배 작음), 검증 정확도 정체 시 1/10 감소. 총 3회.

ResNet: 초기 LR 0.1 (VGG의 100배!). 에러 정체 시 1/10 감소. 60만 스텝 훈련. 주목할 점: He et al.은 처음 몇 에포크에 작은 상수 LR을 사용한 뒤 목표 LR로 전환했다 — 이것이 워밍업(warmup)의 초기 형태다.

하지만 한계도 명확했다:

"학습률을 전체적으로 줄이는 대신, 파라미터마다 개별적으로 조정하면 어떨까?"

| 방법 | 연도 | 핵심 아이디어 | 한계 |

|---|---|---|---|

| AdaGrad (Duchi et al.) | 2011 | 누적 기울기 제곱으로 LR 조정 | LR이 0으로 수렴 (학습 중단) |

| RMSprop (Hinton) | 2012 | 지수 이동 평균으로 AdaGrad 수정 | 논문 미발표 (Coursera 강의) |

| Adam (Kingma & Ba) | 2014 | 모멘텀 + 적응적 LR 결합 | L2 정규화와 궁합 불량 |

Adam(2014, arXiv:1412.6980, ICLR 2015 포스터)은 빠르게 가장 인기 있는 옵티마이저가 되었다. 기본 설정(lr=0.001, β1=0.9, β2=0.999)만으로도 대부분의 태스크에서 합리적인 성능을 냈다.

하지만 Adam에도 문제가 있었다. 이미지 분류에서 SGD+Momentum에 일반화 성능(generalization)이 뒤졌다. 이유는 나중에 밝혀진다.

2016년 8월, 프라이부르크 대학교의 Ilya Loshchilov와 Frank Hutter가 획기적인 논문을 발표한다.

"SGDR: Stochastic Gradient Descent with Warm Restarts" (arXiv:1608.03983, ICLR 2017)

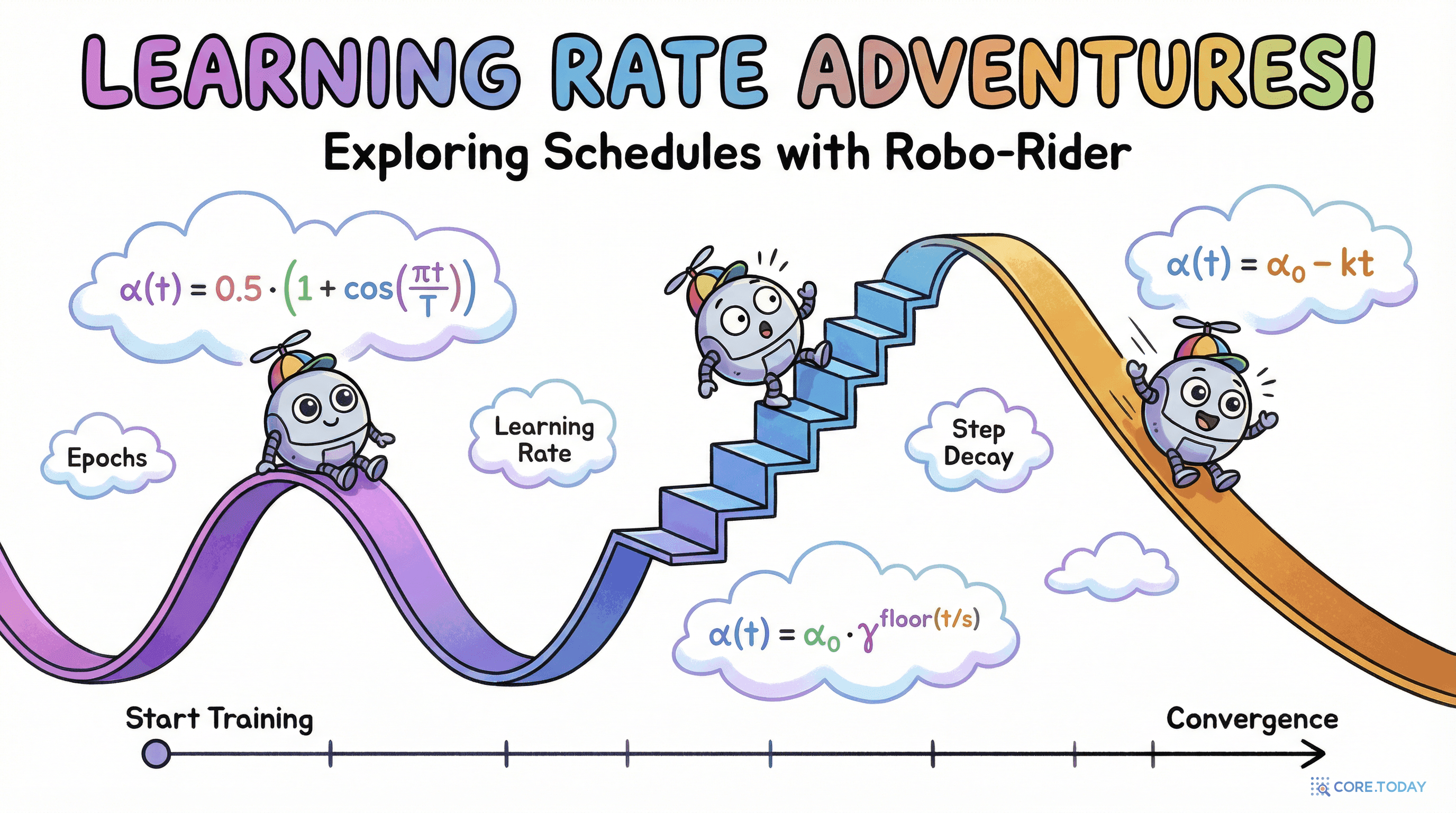

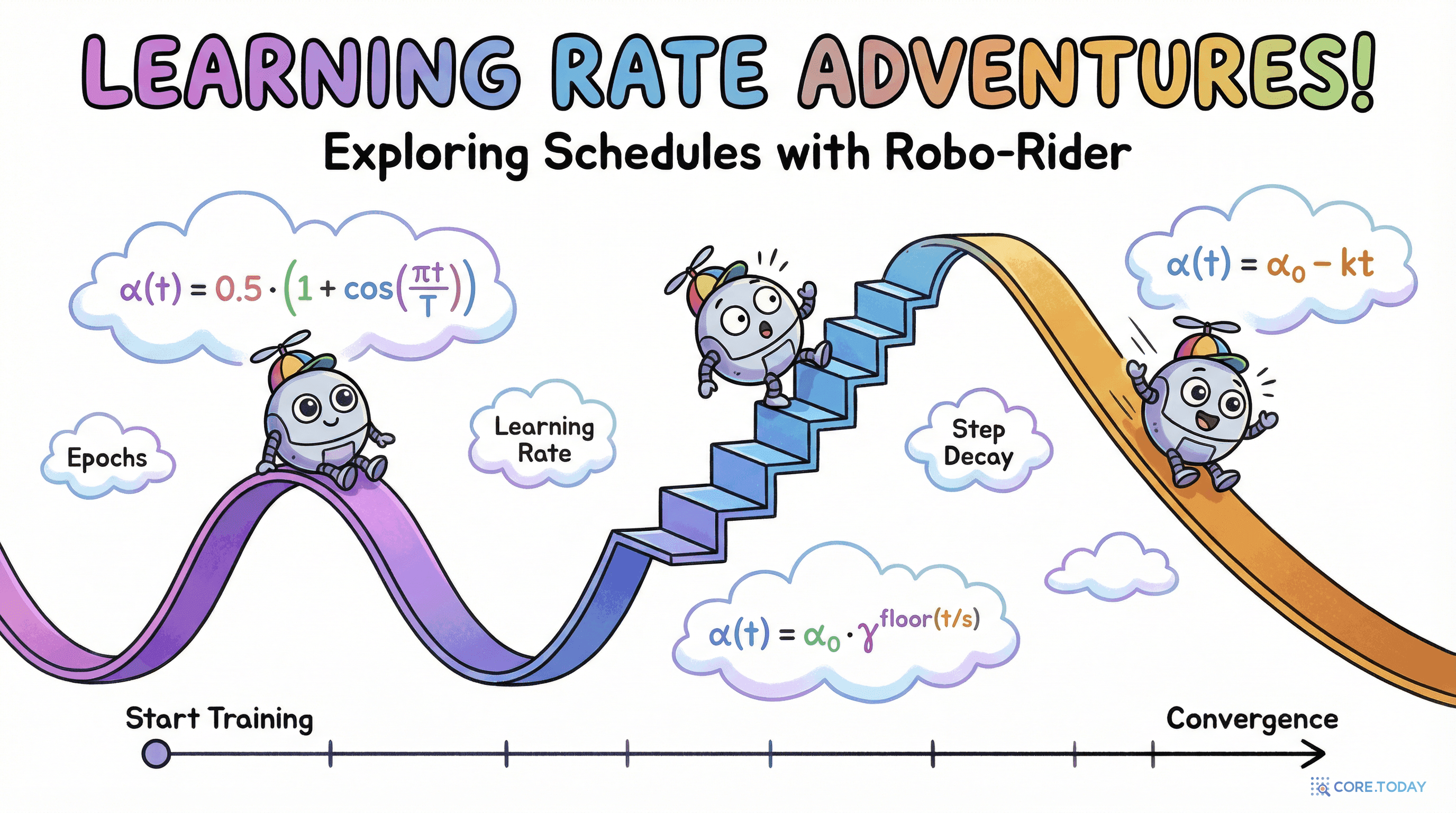

핵심 아이디어: 학습률을 코사인 함수를 따라 부드럽게 감소시킨다.

SGDR의 또 다른 혁신: 코사인이 최솟값에 도달하면 학습률을 다시 최댓값으로 올린다. 이것이 "Warm Restart"다. "Warm"인 이유 — 파라미터를 초기화하지 않고, 현재 위치에서 큰 학습률로 다시 탐색을 시작하기 때문이다.

지역 최솟값에 갇혔을 때, 갑자기 학습률을 올려 빠져나가는 효과가 있다.

| 계단식 감소 | 코사인 어닐링 |

|---|---|

| "언제 줄일지" 결정 필요 | 미리 정해진 스케줄, 튜닝 불필요 |

| 갑작스러운 감소 → 불안정 | 부드러운 감소 → 안정적 |

| 감소 횟수가 추가 하이퍼파라미터 | 자동 — 주기만 설정 |

CIFAR-10에서 3.14%, CIFAR-100에서 16.21%로 당시 SOTA를 달성. 기존 스케줄 대비 2~4배 적은 에포크로 같거나 더 나은 성능.

2017년, Facebook AI Research(현 Meta AI)의 Goyal et al.이 이례적인 논문을 발표한다.

"Accurate, Large Minibatch SGD: Training ImageNet in 1 Hour" (arXiv:1706.02677)

256개 GPU에서 배치 크기 8,192로 ResNet-50을 1시간 만에 훈련했다. 핵심 기법 두 가지:

1. 선형 스케일링 규칙: 배치 크기를 k배 늘리면 학습률도 k배. 배치 256에서 LR 0.1이면, 배치 8192(32배)에서 LR 3.2.

2. 점진적 워밍업(Gradual Warmup): 처음 5 에포크 동안 LR을 0.1에서 3.2까지 선형적으로 증가시킨다.

같은 해, Vaswani et al.의 "Attention Is All You Need"(arXiv:1706.03762)가 Transformer를 소개하며 독특한 스케줄을 사용한다:

# "Noam" 스케줄 (공동 저자 Noam Shazeer의 이름)

lr = d_model**(-0.5) * min(

step**(-0.5),

step * warmup_steps**(-1.5)

)

처음 warmup_steps(기본 4000) 동안 선형 증가, 이후 역제곱근 감소. 이것이 Transformer 시대의 첫 번째 표준 스케줄이 된다.

코사인 어닐링의 저자 Loshchilov & Hutter가 또 다른 중요한 논문을 발표한다.

"Decoupled Weight Decay Regularization" (arXiv:1711.05101, ICLR 2019)

발견: L2 정규화와 가중치 감쇠(weight decay)는 SGD에서는 동일하지만, Adam에서는 다르다. Adam의 적응적 스케일링이 L2 정규화의 의도된 효과를 왜곡한다.

해결: 가중치 감쇠를 기울기 업데이트에서 분리(decouple)하여 직접 파라미터에 적용. 이것이 AdamW.

결과: Adam이 SGD+Momentum에 뒤지던 일반화 성능 문제가 해결되었다. AdamW는 빠르게 사실상의 표준 옵티마이저가 된다.

2018~2023년, "선형 워밍업 → 코사인 감소 + AdamW"가 Transformer/LLM 훈련의 골든 레시피로 확립된다.

| 모델 | 연도 | 최대 LR | 워밍업 | 코사인 최솟값 | 옵티마이저 |

|---|---|---|---|---|---|

| BERT | 2018 | — | 2,000 스텝 | 선형 감소 0 | Adam (특수 설정) |

| GPT-2 | 2019 | — | 선형 워밍업 | 코사인 0 | — |

| GPT-3 | 2020 | 모델별 상이 | 375M 토큰 | 코사인 → 10% | — |

| Chinchilla | 2022 | 2e-3 | 3,000 스텝 | 코사인 → 0 | — |

| LLaMA | 2023 | 모델별 상이 | 2,000 스텝 | 코사인 → 10% | AdamW (β1=0.9, β2=0.95) |

| LLaMA 2 | 2023 | 1.5e-4 | 2,000 스텝 | 코사인 → 10% | AdamW |

주목할 점:

미 해군연구소(NRL)의 Leslie N. Smith는 학습률에 관한 일련의 영향력 있는 논문을 발표했다.

"Cyclical Learning Rates for Training Neural Networks" (arXiv:1506.01186, WACV 2017)

아이디어: 학습률을 수 에포크에 걸쳐 선형으로 증가시키면서 손실을 기록한다. 손실이 감소하기 시작하는 지점이 좋은 최솟값, 손실이 발산하기 시작하는 지점이 최댓값이다.

이 "LR 범위 테스트"는 fast.ai에 의해 대중화되어 실무에서 널리 사용된다.

"Super-Convergence: Very Fast Training of Neural Networks Using Large Learning Rates" (Smith & Topin, arXiv:1708.07120, SPIE 2019)

1-사이클 정책(1-Cycle Policy): 학습률을 한 번 올렸다가(→ 최대) 한 번 내리는(→ 최소) 단일 사이클. 마지막에 "소멸 단계(annihilation phase)"를 추가.

핵심 발견: 큰 학습률 자체가 정규화 역할을 한다. 따라서 학습률을 크게 올릴 때는 다른 정규화(가중치 감쇠, 드롭아웃)를 줄여야 한다.

결과: ResNet-56이 CIFAR-10에서 50 에포크만에 92.3% — 기존 대비 훈련 시간 10배 단축.

코사인 스케줄에는 하나의 전제가 있다: 총 훈련 스텝 수를 미리 알아야 한다. 코사인의 주기를 설정해야 하기 때문이다.

하지만 실전에서는:

코사인 스케줄은 이미 최솟값에 도달한 상태에서 훈련을 연장하면, 학습률이 너무 낮아 의미 있는 학습이 일어나지 않는다.

2024년, MiniCPM 팀(Hu et al., arXiv:2404.06395)이 WSD(Warmup-Stable-Decay) 스케줄을 제안한다.

핵심 장점: Stable 단계에서 총 훈련 길이를 미리 정하지 않아도 된다. 원하는 만큼 훈련하다가, 충분하다고 판단되면 Decay에 진입한다.

"강의 계곡" 해석: Stable 단계에서 큰 LR은 "언덕" 방향으로 진동을 유발하지만, "계곡"(저곡률 다양체)을 따라서는 빠르게 이동한다. Decay에서 진동이 억제되면, 축적된 진전이 드러난다.

DeepSeek-V3도 WSD의 변형을 채택했다 — 코사인 어닐링을 감소 단계에 적용하는 하이브리드 방식.

| 설정 | 일반적 값 |

|---|---|

| LLM 사전 훈련 | 전체의 1~10%, 또는 2,000~4,000 스텝 |

| 파인튜닝 | 전체의 6~10% |

| 큰 배치 훈련 | 5 에포크 (Goyal et al.) |

팁: 워밍업이 길수록 가능한 최대 LR의 범위가 넓어진다 — 튜닝이 쉬워진다. 짧은 워밍업은 최적 LR을 정확히 맞춰야 하지만, 긴 워밍업은 대략적인 값으로도 안정적으로 학습한다.

| 모델 크기 | 일반적 최대 LR |

|---|---|

| ~100M 파라미터 | 3e-4 ~ 6e-4 |

| ~1B 파라미터 | 1e-4 ~ 3e-4 |

| ~7B 파라미터 | 1e-4 ~ 1.5e-4 |

| ~65B+ 파라미터 | 5e-5 ~ 1.5e-4 |

큰 모델일수록 작은 학습률. muP(Maximal Update Parameterization, Yang et al., 2022)를 사용하면 작은 모델에서 튜닝한 최적 LR을 큰 모델에 제로샷 전이할 수 있다.

학습률 스케줄의 75년 역사가 말해주는 것:

1. 단순함이 오래간다. 코사인 어닐링은 수식 한 줄이지만, 8년째 사실상의 표준이다. 복잡한 스케줄이 논문에서 제안되어도, 실전에서 살아남는 것은 단순하고 강건한 방법이다.

2. 문제가 스케줄을 만든다. Step Decay는 수동 관찰로 충분했던 시대의 산물이고, 워밍업은 대규모 배치 훈련의 필요에서, WSD는 지속적 사전 훈련의 요구에서 탄생했다.

3. 옵티마이저와 스케줄은 한 쌍이다. Adam의 문제를 AdamW가 해결하고, AdamW에 코사인 스케줄이 결합되어 골든 레시피가 완성된 것처럼 — 옵티마이저와 스케줄은 함께 진화한다.

4. "가장 중요한 하이퍼파라미터"는 여전히 중요하다. 75년간의 연구에도 불구하고, 벤지오의 2012년 조언은 유효하다. 학습률은 여전히 가장 중요한 하이퍼파라미터이며, 스케줄의 선택은 모델의 성패를 가른다.

참고 논문 및 자료