KET-RAG: GraphRAG의 품질을 1/10 비용으로 — KDD 2025가 주목한 다중 해상도 인덱싱

GraphRAG는 강력하지만, 5GB 법률 문서 인덱싱에 $33,000이 든다. KET-RAG는 '모든 청크에 LLM을 돌릴 필요가 없다'는 통찰로, KG 스켈레톤과 키워드 이분 그래프를 결합해 비용을 한 자릿수 이상 줄이면서 더 나은 품질을 달성한다. KDD 2025 논문을 해부한다.

GraphRAG는 강력하지만, 5GB 법률 문서 인덱싱에 $33,000이 든다. KET-RAG는 '모든 청크에 LLM을 돌릴 필요가 없다'는 통찰로, KG 스켈레톤과 키워드 이분 그래프를 결합해 비용을 한 자릿수 이상 줄이면서 더 나은 품질을 달성한다. KDD 2025 논문을 해부한다.

당신은 로펌의 AI 엔지니어다. 5GB 규모의 법률 케이스 — 수만 건의 계약서, 판례, 증거 자료 — 를 지식 그래프로 변환하여 변호사들이 질문할 수 있게 만들라는 요청을 받았다.

GraphRAG를 사용하면 된다. 모든 텍스트 청크에서 LLM으로 개체와 관계를 추출하고, 커뮤니티를 탐지하고, 요약을 생성하면 된다. 품질은 검증되었다.

그런데 비용을 계산해보니 — $33,000.

한 건의 법률 케이스 인덱싱에 3천 3백만 원. 이것이 현실이다. GraphRAG의 비용 구조는 문서 규모에 비례하여 선형적으로 증가한다. 모든 청크에 LLM을 호출하기 때문이다.

"GraphRAG는 좋다. 하지만 너무 비싸다."

이것이 2024~2025년 Graph-RAG 커뮤니티에서 가장 반복된 말이다. LightRAG는 커뮤니티 계층을 제거하고, PathRAG는 경로 가지치기로 답했다. 하지만 이들도 여전히 모든 청크에서 LLM으로 개체를 추출하는 근본적 비용 구조를 그대로 유지한다.

2025년 2월, 싱가포르 국립대학교(NUS)의 연구팀이 더 근본적인 질문을 던진다:

"정말 모든 청크에 LLM을 돌려야 하는가?"

GraphRAG의 비용 구조를 다시 들여다보자. 인덱싱 과정에서 가장 비용이 큰 단계는 개체·관계 추출이다 — 전체 비용의 약 75%.

이 단계에서 벌어지는 일: 모든 텍스트 청크에 대해, LLM에게 "이 텍스트에서 개체와 관계를 추출해줘"라고 요청한다. 청크가 1만 개면 1만 번, 10만 개면 10만 번. 각 호출에 수백~수천 토큰의 입출력이 발생한다.

그런데 모든 청크가 똑같이 중요한가?

문서 컬렉션을 생각해보자. 어떤 청크는 핵심 개념을 다루고 여러 다른 청크와 연결된다(허브). 어떤 청크는 특정 세부 사항만 담고 있어 다른 문서와의 연결이 적다(말단). 허브 청크에서 추출한 개체와 관계는 지식 그래프의 뼈대를 형성하지만, 말단 청크의 정보는 이 뼈대에 크게 기여하지 못한다.

모든 청크를 동등하게 취급하는 것이 GraphRAG의 비용 비효율의 근본 원인이다.

KET-RAG의 첫 번째 통찰은 여기서 출발한다:

"먼저 저렴하게 문서 간 유사도 그래프를 만들고, 그 그래프에서 중심적인(PageRank가 높은) 청크만 골라 LLM 추출을 수행하면, 지식 그래프의 뼈대를 저비용으로 구축할 수 있다."

이것이 KG 스켈레톤(skeleton) — 뼈대만 남긴 지식 그래프다.

하지만 뼈대만으로는 커버리지가 부족하다. LLM 추출을 건너뛴 청크들의 정보도 검색에 반영되어야 한다. 여기서 두 번째 통찰이 등장한다:

"나머지 청크들은 비싼 LLM 추출 없이, 키워드만으로도 의미 있는 구조를 만들 수 있다."

이것이 텍스트-키워드 이분 그래프(bipartite graph) — LLM 호출 없이 만드는 보조 인덱스다.

"KET-RAG: A Cost-Efficient Multi-Granular Indexing Framework for Graph-RAG"

KDD(Knowledge Discovery and Data Mining)는 데이터 마이닝 분야의 최상위 학회다. 지도교수 Xiaokui Xiao는 IEEE 펠로우이자 2024년 SIGMOD Test-of-Time Award 수상자로, 그래프 데이터와 프라이버시 분야의 권위자다.

논문의 핵심 주장:

"KET-RAG는 GraphRAG와 비슷하거나 더 나은 검색 품질(coverage)을 유지하면서 인덱싱 비용을 한 자릿수 이상 줄이고, 생성 품질을 최대 32.4% 개선한다."

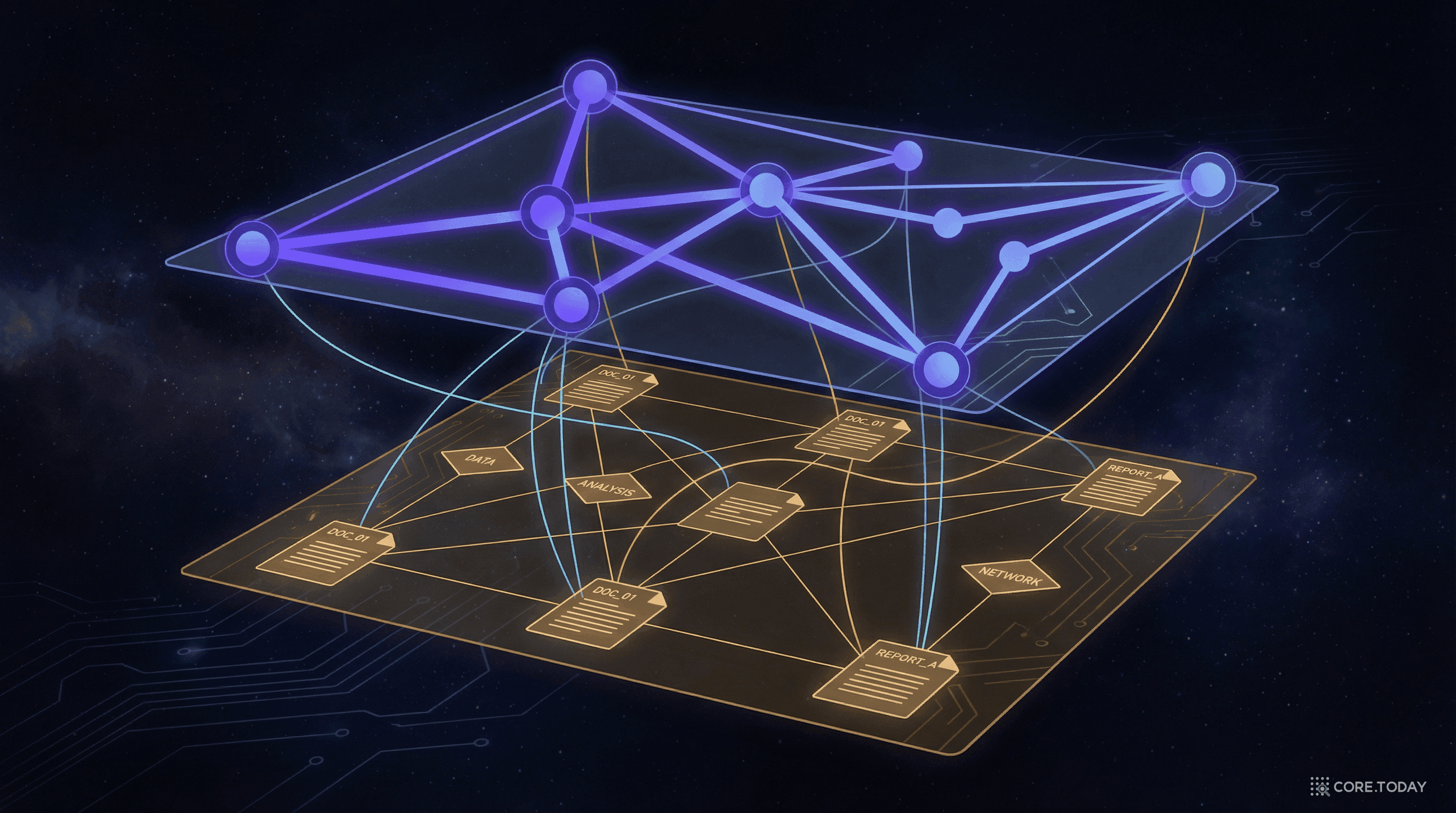

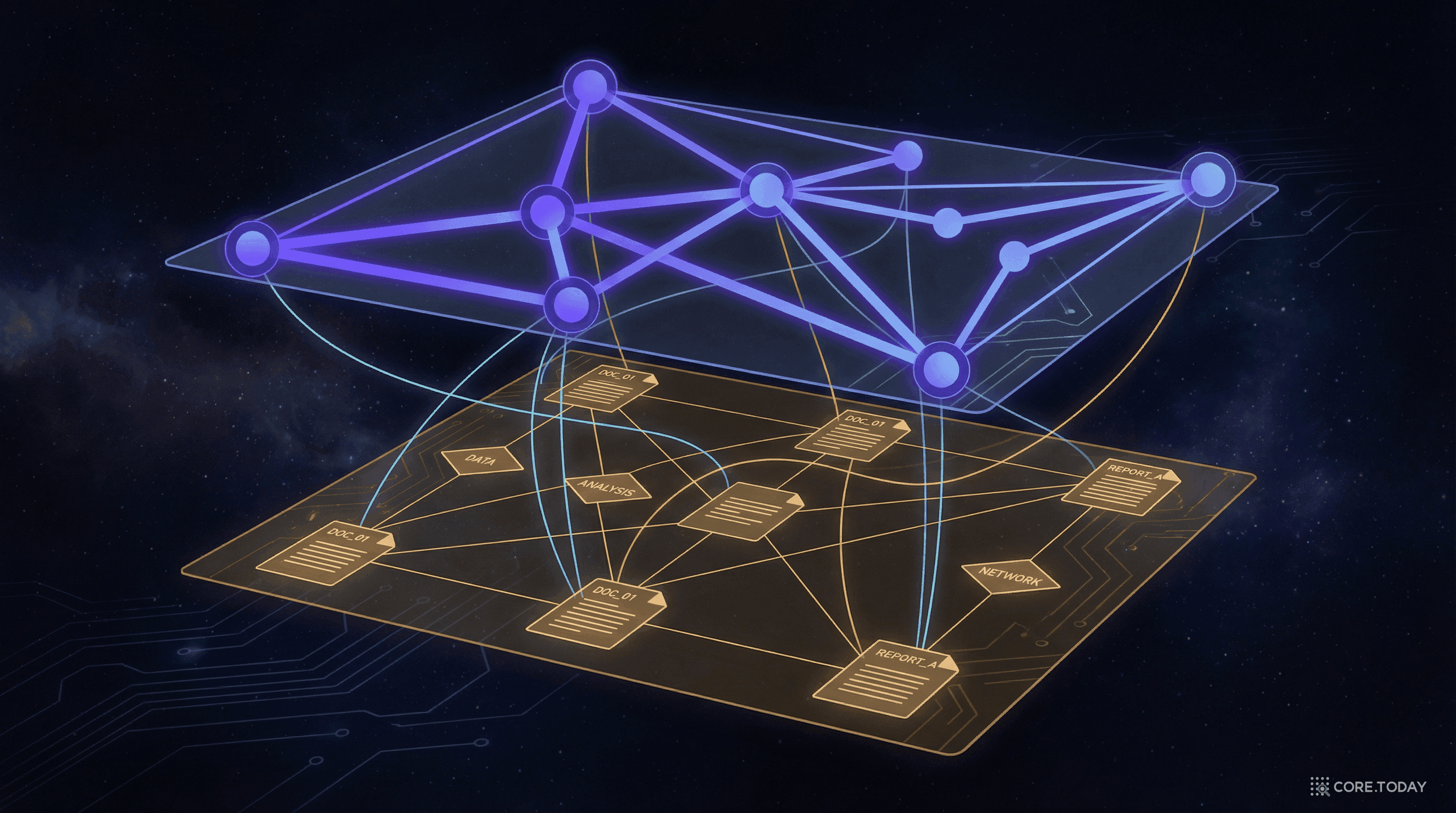

KET-RAG의 이름은 KG skEleton + Text-keyword bipartite graph의 약자다. 두 가지 인덱스를 조합하는 다중 해상도(multi-granular) 프레임워크다.

비유하자면 이렇다:

주요 도로 지도만으로는 골목길을 모르고, 전화번호부만으로는 길을 모른다. 하지만 둘을 합치면 상당히 정확하게 목적지에 도달할 수 있다.

문서를 청크로 나눈 뒤, 각 청크의 임베딩을 생성한다. 임베딩 간 유사도로 KNN 그래프를 구축한다 — 각 청크가 의미적으로 가장 가까운 K개 청크와 연결된 그래프다.

이 단계는 임베딩만 사용하므로 비용이 거의 없다.

KNN 그래프에서 PageRank 알고리즘을 실행한다. PageRank가 높은 청크 = 다른 많은 청크와 의미적으로 연결된 "허브" 청크 = 문서 컬렉션의 핵심 주제를 다루는 청크.

상위 β%(기본값 80%)를 "핵심 청크"로 선별한다.

선별된 핵심 청크에 대해서만 GraphRAG와 동일한 LLM 기반 개체·관계 추출을 수행한다. 결과물은 KG 스켈레톤 — 지식 그래프의 뼈대다.

β = 0.8이면 전체 청크의 80%에만 LLM을 호출하므로 20% 비용 절감. β를 낮추면 더 줄일 수 있지만 스켈레톤의 품질이 떨어진다.

모든 청크(핵심이든 아니든)에서 키워드를 추출하여 이분 그래프를 구축한다. 이 과정에 LLM은 전혀 사용되지 않는다. 토큰화 + 불용어 제거 + 임베딩만으로 완성된다.

키워드 이분 그래프의 비용은 임베딩 비용만 — LLM 추론 비용 대비 수 자릿수 저렴하다.

질문이 들어오면, KET-RAG는 두 개의 채널을 동시에 가동한다.

예산 파라미터 θ(기본값 0.4)가 두 채널 간 토큰 배분을 결정한다:

이것이 다중 해상도(multi-granular)의 의미다. 고해상도 렌즈(스켈레톤)와 광각 렌즈(키워드)를 동시에 사용하는 것이다.

논문은 세 개의 멀티홉 QA 데이터셋(각 500건)에서 13개 방법을 비교했다.

MuSiQue에서 KET-RAG의 커버리지 77.0%는 GraphRAG(47.6%)를 30%p 가까이 상회한다. 비용은 $1.89 vs $2.30으로 오히려 저렴하다.

| 방법 | 비용 (USD) | 커버리지 | EM | F1 |

|---|---|---|---|---|

| Text-RAG | $0.01 | 37.2% | 14.8% | 19.4% |

| GraphRAG | $2.30 | 63.0% | 21.6% | 30.2% |

| HippoRAG | $1.40 | 64.0% | 29.2% | — |

| LightRAG (고정밀) | $11.06 | 76.0% | 31.0% | 43.6% |

| KET-RAG | $1.87 | 81.6% | 28.6% | 38.7% |

KET-RAG는 $1.87로 LightRAG 고정밀 모드($11.06)의 커버리지(81.6% vs 76.0%)를 넘어선다. 약 6배 저렴하면서 더 많은 정보를 찾아낸다.

고비용을 감수하더라도 최대 품질을 원하는 경우:

| 방법 | 비용 | 커버리지 | EM | F1 | BERTScore |

|---|---|---|---|---|---|

| GraphRAG | $21.29 | 74.6% | 31.0% | 43.0% | 79.5 |

| KET-RAG | $17.10 | 82.6% | 35.2% | 47.7% | 81.5 |

동일한 고정밀 모드에서도 KET-RAG가 모든 지표에서 GraphRAG를 상회한다. 비용은 20% 저렴하고, F1은 4.7%p 높다.

핵심은 모드 간 비교에 있다. KET-RAG 저비용 모드($1.87)가 GraphRAG 고정밀 모드($21.29)보다 더 높은 커버리지를 달성한다 — 비용은 11.4배 저렴하면서.

PageRank는 웹 검색에서 "중요한 페이지"를 찾기 위해 Google이 개발한 알고리즘이다. KET-RAG는 이를 텍스트 청크에 적용한다. 많은 다른 청크와 의미적으로 연결된 청크일수록 높은 PageRank를 받고, 지식 그래프의 뼈대를 형성하는 데 더 중요하다.

이것은 80/20 법칙(파레토 원칙)과 통한다: 핵심 정보의 대부분은 소수의 중요한 청크에 집중되어 있다.

지식 그래프에서 개체(entity)는 LLM이 추출한 구조화된 정보다. "삼성전자", "HBM3E", "NVIDIA" — 이런 것들. 하지만 텍스트의 키워드도 본질적으로 같은 역할을 한다.

키워드 "삼성전자"가 포함된 청크들의 집합은, LLM이 추출한 "삼성전자" 개체의 관계 정보와 상당 부분 겹친다. 완벽하지는 않지만, LLM 호출 비용 0으로 만들 수 있다.

논문에서 이를 프록시 개체(proxy entity)와 프록시 관계(proxy relation)라고 부른다.

스켈레톤만 사용하면(Skeleton-RAG만) 핵심 청크가 아닌 부분의 정보를 놓친다. 키워드 그래프만 사용하면(Keyword-RAG만) 정밀한 개체 관계를 포착하지 못한다.

논문의 ablation 결과가 이를 확인한다:

| 구성 | MuSiQue 커버리지 | HotpotQA 커버리지 |

|---|---|---|

| Keyword-RAG만 | 50.8% | 72.0% |

| Skeleton-RAG만 | 67.0% | 79.8% |

| KET-RAG (결합) | 77.0% | 81.6% |

두 인덱스의 결합이 각각보다 일관되게 높은 성능을 보인다. 스켈레톤이 놓치는 부분을 키워드가 보완하고, 키워드가 부정확한 부분을 스켈레톤이 교정하는 상보적 관계다.

5GB 법률 문서를 GraphRAG로 인덱싱하면 ~$33,000. 같은 문서를 KET-RAG로 인덱싱하면:

그리고 검색 품질은 GraphRAG와 동등하거나 더 높다. 로펌 입장에서 $33,000 → $3,000은 POC(Proof of Concept)의 가능/불가능을 가르는 차이다.

질문: "A 약물이 B 유전자를 통해 C 질환에 미치는 영향은?"

이 질문은 A → B → C라는 멀티홉 추론이 필요하다.

스켈레톤이 정밀한 관계 구조를 제공하고, 키워드가 스켈레톤에서 누락된 추가 맥락을 보완한다.

스타트업의 기술 문서가 매주 수십 페이지씩 늘어난다. 새로운 문서가 추가될 때:

GraphRAG처럼 커뮤니티 전체를 재구축할 필요 없다. KET-RAG는 Microsoft GraphRAG v0.4.1 위에 구축되어 있지만, 커뮤니티 계층 없이 작동하므로 증분 업데이트가 자연스럽다.

2024~2025년에 "GraphRAG는 비싸다"는 문제에 여러 접근법이 등장했다. 각각이 다른 지점에서 비용을 줄인다.

| 방법 | 비용 절감 지점 | 핵심 아이디어 | 단점 |

|---|---|---|---|

| LightRAG | 검색 시 토큰 | 커뮤니티 제거, 듀얼 레벨 검색 | 인덱싱 비용은 유사 |

| PathRAG | 검색 시 노이즈 | 경로 가지치기 | 인덱싱 비용은 유사 |

| LazyGraphRAG | 인덱싱 LLM 호출 | 모든 LLM 호출을 쿼리 시점으로 지연 | 쿼리 시 비용 증가 |

| KET-RAG | 인덱싱 LLM 호출 | 핵심 청크만 추출 + 키워드 보조 인덱스 | 스켈레톤 품질이 β에 의존 |

KET-RAG의 독특한 위치: 인덱싱 비용을 줄이면서도 "검색 품질을 오히려 높인" 유일한 방법이다. LightRAG와 PathRAG는 인덱싱 비용은 GraphRAG와 동일하게 유지하면서 검색 효율만 개선했다. LazyGraphRAG는 인덱싱을 거의 0으로 줄이지만 쿼리 비용이 올라간다.

KET-RAG는 "적절한 투자(스켈레톤) + 저비용 보완(키워드)"이라는 중간 지점을 찾았다.

1. 그래프 구축 자체는 최적화하지 않았다: 스켈레톤의 개체·관계 추출 방식은 GraphRAG와 동일하다. 추출 자체를 더 효율적으로 만드는 것은 향후 과제.

2. 비파라메트릭 알고리즘: PageRank 기반 선별과 키워드 매칭에 학습된 파라미터가 없다. 도메인별 튜닝이 어려울 수 있다.

3. 데이터셋 제한: MuSiQue, HotpotQA, RAG-QA Arena — 모두 영어 기반 멀티홉 QA. 다른 언어, 다른 태스크 유형에서의 검증은 추가 필요.

β(스켈레톤 비율) 튜닝: 기본값 0.8이지만, 문서 특성에 따라 조정이 필요하다. 관계 밀도가 높은 도메인(법률, 의학)에서는 높은 β가 유리하고, FAQ 같은 독립적 콘텐츠에서는 낮은 β로 비용을 더 줄일 수 있다.

θ(채널 배분) 튜닝: 개체 채널과 키워드 채널의 배분. 정밀한 관계 추론이 중요하면 θ를 높이고, 넓은 커버리지가 중요하면 낮춘다.

커뮤니티 수준 조망 불가: GraphRAG의 글로벌 검색(전체 주제 파악)에 해당하는 기능은 없다. "이 데이터셋의 핵심 주제 5개" 같은 글로벌 질문에는 GraphRAG가 더 적합하다.

2024년 4월 GraphRAG 발표 → 2024년 10월 LightRAG → 2025년 2월 KET-RAG/PathRAG. 불과 10개월 만에 "비용" 문제에 대한 해결책이 쏟아졌다. 각각 다른 방식으로:

이 경쟁은 Graph-RAG를 실전에 배포 가능한 기술로 빠르게 성숙시키고 있다.

KET-RAG의 "고해상도 스켈레톤 + 저해상도 키워드"는 더 넓은 트렌드의 일부다. RAPTOR의 "추상화 수준별 트리", Adaptive RAG의 "질문 복잡도별 전략", Modular RAG의 "모듈 조합" — 모두 단일 해상도가 아니라 다중 해상도로 정보를 다루는 방향이다.

2026년의 RAG는 "하나의 방법"이 아니라 "상황에 맞는 해상도를 선택하는 시스템"으로 진화하고 있다.

KET-RAG는 아직 초기 단계다(GitHub 196 스타, 단일 기여자, 6 커밋). 하지만 KDD 2025 채택이라는 학술적 검증과, Microsoft GraphRAG v0.4.1 위에 구축되어 있다는 실용성을 함께 갖추고 있다.

지금 Graph-RAG 도입을 검토 중이라면:

KET-RAG는 "GraphRAG의 품질을 원하지만 비용을 감당할 수 없는" 상황에서 가장 실용적인 답 중 하나다. $33,000을 $3,000으로 줄이면서 품질은 유지하거나 높인다면, 그것은 단순한 최적화가 아니라 접근성의 민주화다.

참고 논문 및 자료