GraphRAG는 언제 써야 할까? — 그래프가 RAG를 이기는 순간과 지는 순간

GraphRAG가 만능이 아니라면, 정확히 언제 써야 할까? ICLR 2026 논문이 7개 GraphRAG 시스템을 벤치마킹하여 밝혀낸 '그래프가 빛나는 순간'과 '오히려 해가 되는 순간'을 깊이 있게 분석합니다.

GraphRAG가 만능이 아니라면, 정확히 언제 써야 할까? ICLR 2026 논문이 7개 GraphRAG 시스템을 벤치마킹하여 밝혀낸 '그래프가 빛나는 순간'과 '오히려 해가 되는 순간'을 깊이 있게 분석합니다.

당신이 AI 분석 시스템에 이렇게 물었다고 하자:

"Kjaer Weis가 특정 시장에서 실패한 이유를 분석해줘."

일반 RAG 시스템은 이렇게 동작한다:

결과? "해당 정보를 찾을 수 없습니다" 또는 단편적인 사실 나열.

왜? 이 질문의 답은 하나의 문서에 없기 때문이다. 시장 진입 시점, 공급망 문제, 규제 변화, 브랜드 인지도 하락 — 이 정보들은 서로 다른 문서에 흩어져 있고, 이들 사이의 인과관계를 연결해야만 답할 수 있다.

GraphRAG는 다르다:

하지만 여기서 중요한 질문이 생긴다: GraphRAG가 항상 더 나을까?

놀랍게도, 답은 "아니오"다.

이 글에서는 ICLR 2026에 발표된 논문 "When to use Graphs in RAG"를 중심으로, GraphRAG가 빛나는 순간과 오히려 해가 되는 순간을 체계적으로 분석한다.

RAG(Retrieval-Augmented Generation)는 2020년 Lewis et al.이 제안한 이후, LLM의 환각 문제를 해결하는 핵심 기술로 자리잡았다. 기본 원리는 단순하다:

RAG는 단순한 사실 조회에서 뛰어난 성능을 보인다. "프랑스의 몽생미셸은 어느 지역에 있나?"처럼 하나의 문서에서 답을 찾을 수 있는 질문에는 완벽하다.

하지만 현실의 질문은 대부분 이렇지 않다:

이런 질문들의 공통점은 정보들 사이의 관계(relationship)가 핵심이라는 것이다. 그런데 전통 RAG는 문서를 독립적인 청크로 쪼개어 관계를 파괴한다.

GraphRAG는 이 한계를 극복하기 위해 등장했다. 핵심 아이디어:

Microsoft가 2024년에 발표한 MS-GraphRAG를 시작으로, HippoRAG, LightRAG, RAPTOR 등 다양한 GraphRAG 시스템이 쏟아져 나왔다.

그런데 문제가 생겼다.

최근 연구들이 충격적인 결과를 보고하기 시작했다:

이론적으로 완벽해 보이는 GraphRAG가 실제로는 왜 실패할까?

이 논문의 핵심 의문이 바로 이것이다:

GraphRAG는 정말로 효과적인가? 그리고 정확히 어떤 시나리오에서 그래프 구조가 RAG 시스템에 측정 가능한 이점을 제공하는가?

논문은 기존 벤치마크(HotpotQA, MultiHopRAG, UltraDomain)가 GraphRAG를 제대로 평가하지 못하는 이유를 세 가지로 지적한다:

| 문제 | 설명 | 결과 |

|---|---|---|

| 과제 세분화 부족 | 단순 사실 검색이나 직선적 멀티홉에만 집중 | 복잡한 추론·요약·생성 능력 미평가 |

| 코퍼스 품질 문제 | 위키피디아 같은 일반 소스 — 도메인 지식과 관계가 희소 | 그래프의 계층적 지식 활용 능력 측정 불가 |

| 블랙박스 평가 | 최종 답변만 평가, 그래프 구축·검색 과정은 무시 | 그래프가 실제로 기여하는지 파악 불가 |

기존 벤치마크의 질문 분포를 보면 문제가 명확하다:

UltraDomain의 97%가 단순 사실 검색! GraphRAG의 진가를 볼 수 없는 구조다.

논문은 이 문제를 해결하기 위해 GraphRAG-Bench를 제안한다. 세 가지 핵심 설계 원칙:

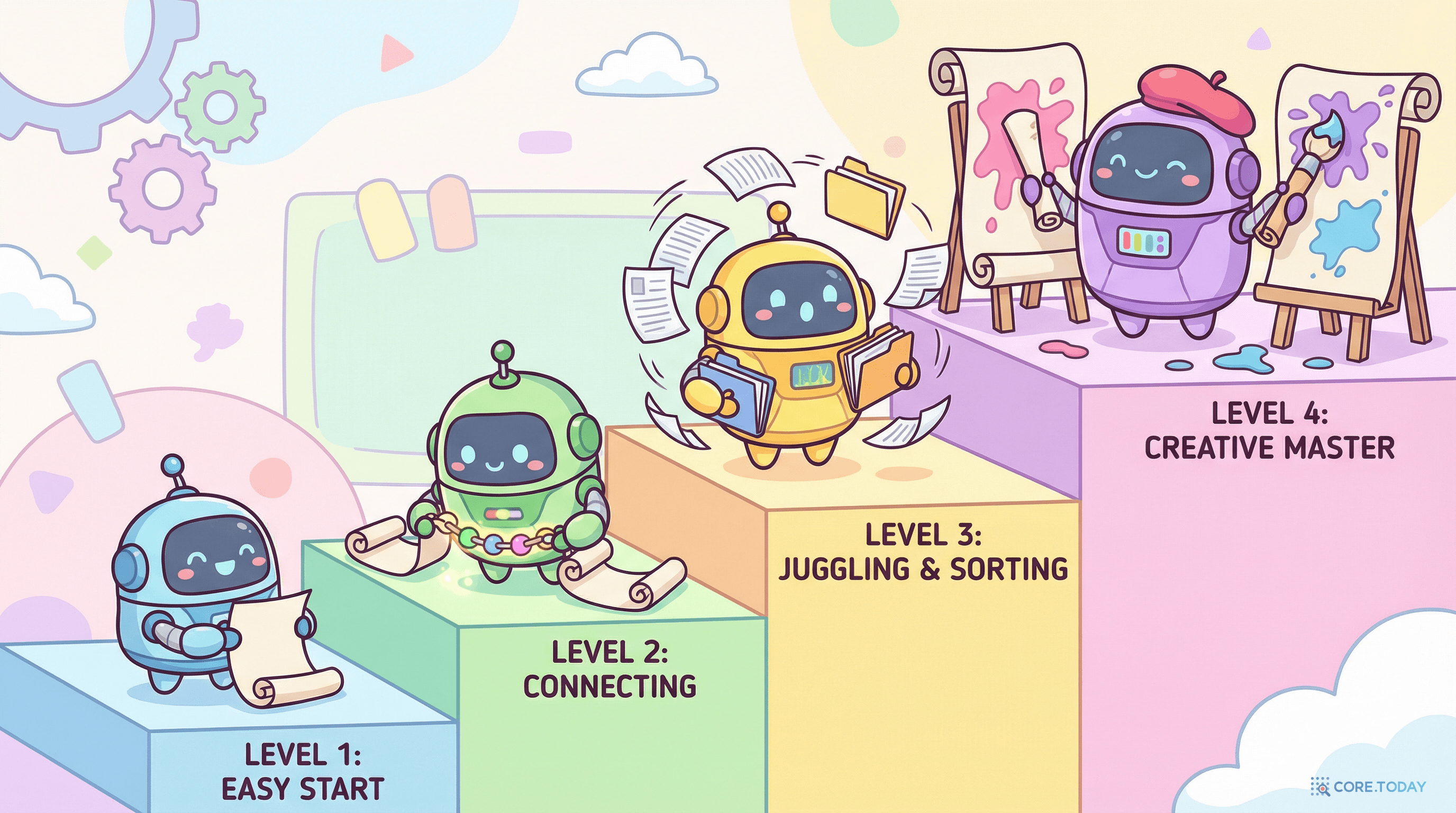

이것이 GraphRAG-Bench의 핵심 혁신이다. 난이도가 올라갈수록 그래프 구조의 필요성이 커진다:

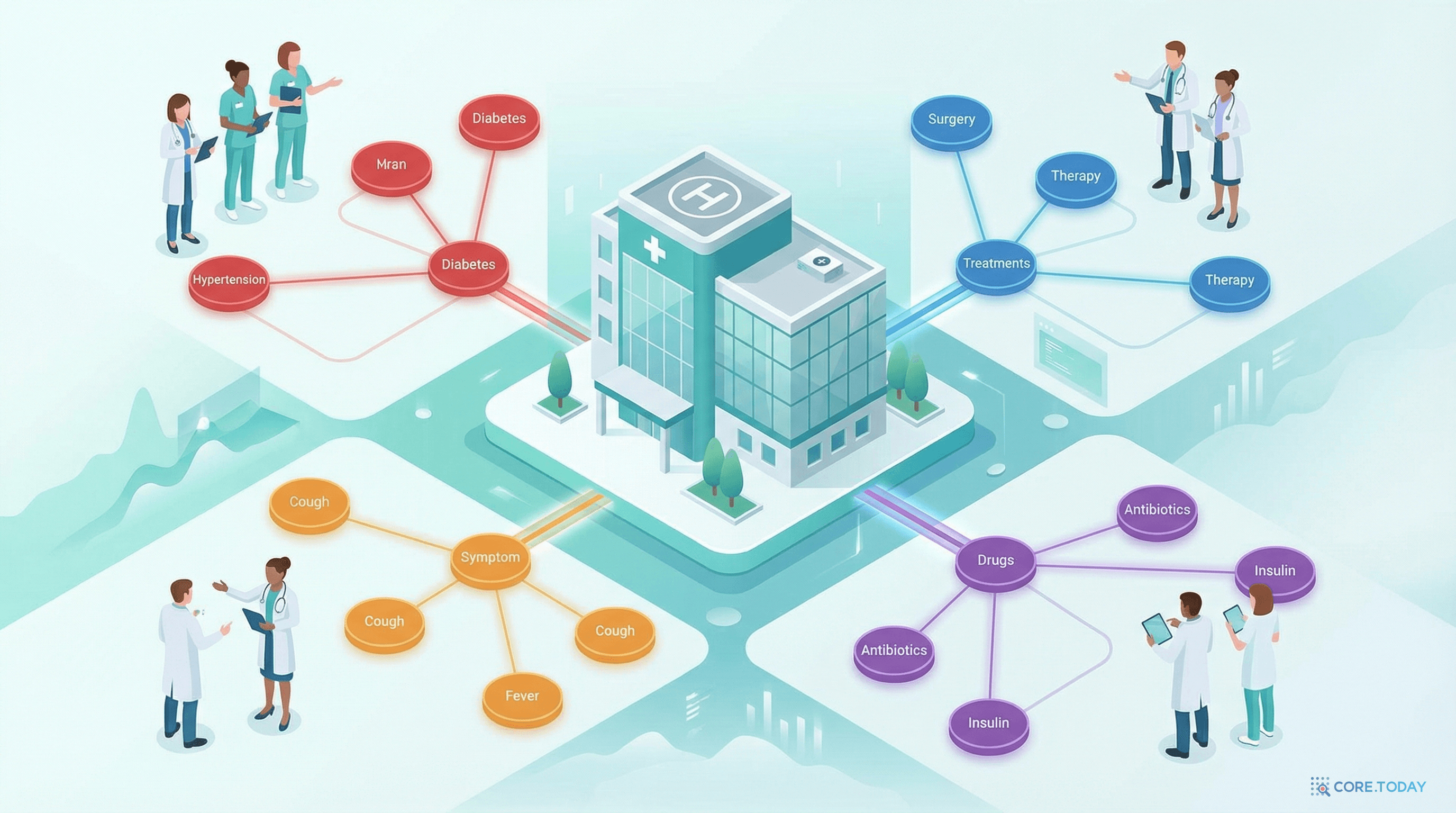

| 특성 | 소설 데이터셋 | 의료 데이터셋 |

|---|---|---|

| 출처 | 구텐베르크 프로젝트 (20세기 이전 소설) | NCCN 의료 가이드라인 |

| 정보 구조 | 느슨 — 암시적 관계, 비선형 서사 | 밀집 — 질병·치료·약물 간 명시적 계층 |

| 관계 밀도 | 낮음 (평균 관계 3.82개/문서) | 높음 (평균 관계 73.2개/문서) |

| 선택 이유 | 비구조화된 실제 문서 시뮬레이션 | 도메인 전문 지식의 계층적 관계 테스트 |

기존 벤치마크는 최종 답변만 봤다. GraphRAG-Bench는 세 단계를 모두 평가한다:

논문은 7개의 대표적인 GraphRAG 시스템을 일반 RAG와 비교한다:

| 시스템 | 개발 | 핵심 특징 |

|---|---|---|

| MS-GraphRAG | Microsoft (2024) | 커뮤니티 기반 계층적 검색. 로컬+글로벌 탐색 결합 |

| HippoRAG | Gutierrez et al. (2024) | 인간 기억 체계 모방. 개인화된 지식 탐색 |

| HippoRAG2 | Gutierrez et al. (2025) | HippoRAG 개선판. 밀도 높은 그래프 구축 |

| LightRAG | Guo et al. (2024) | 이중 레벨 검색. 그래프 향상 인덱싱으로 확장성 개선 |

| Fast-GraphRAG | CircleMind-AI (2024) | 소프트 프루닝으로 불필요 엔티티 제거. 토폴로지 인식 프롬프트 |

| RAPTOR | Sarthi et al. (2024) | 재귀적 요약 기반 트리 구조. 계층적 검색 |

| Lazy-GraphRAG | Darren Edge (2024) | MS-GraphRAG의 경량 변형. 최소 전처리 비용 |

아래 시뮬레이터에서 과제 유형별로 RAG와 GraphRAG의 성능을 비교해 보자.

소설 데이터셋에서 일반 RAG(rerank 포함)의 사실 검색 정확도는 60.92%로, 대부분의 GraphRAG 시스템(49~57%)을 앞섰다. 증거 재현율에서도 일반 RAG가 83.2%로 HippoRAG2의 70.29%를 크게 앞질렀다.

이유: 단순 사실은 하나의 문서 청크에 대부분 포함되어 있다. 그래프를 거치면 관련 있지만 불필요한 정보까지 끌어오게 된다.

복잡 추론, 맥락적 요약, 창의적 생성 — 관계를 연결해야 하는 과제에서 GraphRAG가 명확히 우수하다. 이 과제들은 여러 개념 사이의 복잡한 관계를 연결해야 하는데, 이것이 바로 그래프 구조의 존재 이유다.

여기서 가장 흥미로운 패턴이 나타난다:

| 지표 | 사실 검색 | 복잡 추론 | 맥락 요약 |

|---|---|---|---|

| 증거 재현율 우위 | RAG (83.2%) | GraphRAG (90.9%) | GraphRAG (82.0%) |

| 맥락 관련성 우위 | RAG (64.5%) | GraphRAG (87.8%) | RAG (80.1%) |

Level 1에서는 RAG가, Level 2-3에서는 GraphRAG가 검색 성능에서 앞선다. 질문이 복잡해질수록 그래프의 관계 탐색 능력이 빛을 발한다.

창의적 생성(Level 4)에서는 GraphRAG가 증거 재현율(83.1%)에서 우세하지만, RAG가 맥락 관련성(78.8%)에서 우세하다. GraphRAG는 더 많은 관련 정보를 가져오지만, 동시에 불필요한 정보도 함께 가져온다.

HippoRAG2는 다른 시스템보다 5~13배 더 밀도 높은 그래프를 만든다. 이 밀도가 높은 검색 성능(증거 재현율 1위)으로 이어지지만, 동시에 비용도 높아진다.

| 시스템 | 소설 평균 토큰 | 의료 평균 토큰 | 비고 |

|---|---|---|---|

| 일반 RAG | 879 | 954 | 기준선 |

| HippoRAG2 | 1,008 | 1,020 | ~1.1x |

| Fast-GraphRAG | 4,204 | 4,298 | ~4.8x |

| LightRAG | 100,832 | 100,310 | ~115x! |

| MS-GraphRAG(글로벌) | 331,375 | 332,881 | ~377x!! |

MS-GraphRAG의 글로벌 검색은 일반 RAG의 377배 토큰을 사용! 커뮤니티 요약 메커니즘이 최대 4만 토큰의 프롬프트를 생성한다. 과제 복잡도가 올라갈수록 토큰 사용량도 급증한다 (MS-GraphRAG: 7,800 → 40,000 토큰).

이 결과는 중요한 트레이드오프를 보여준다: GraphRAG는 검색 범위를 넓히지만, 프롬프트 인플레이션으로 인해 노이즈 컨텍스트도 함께 증가한다.

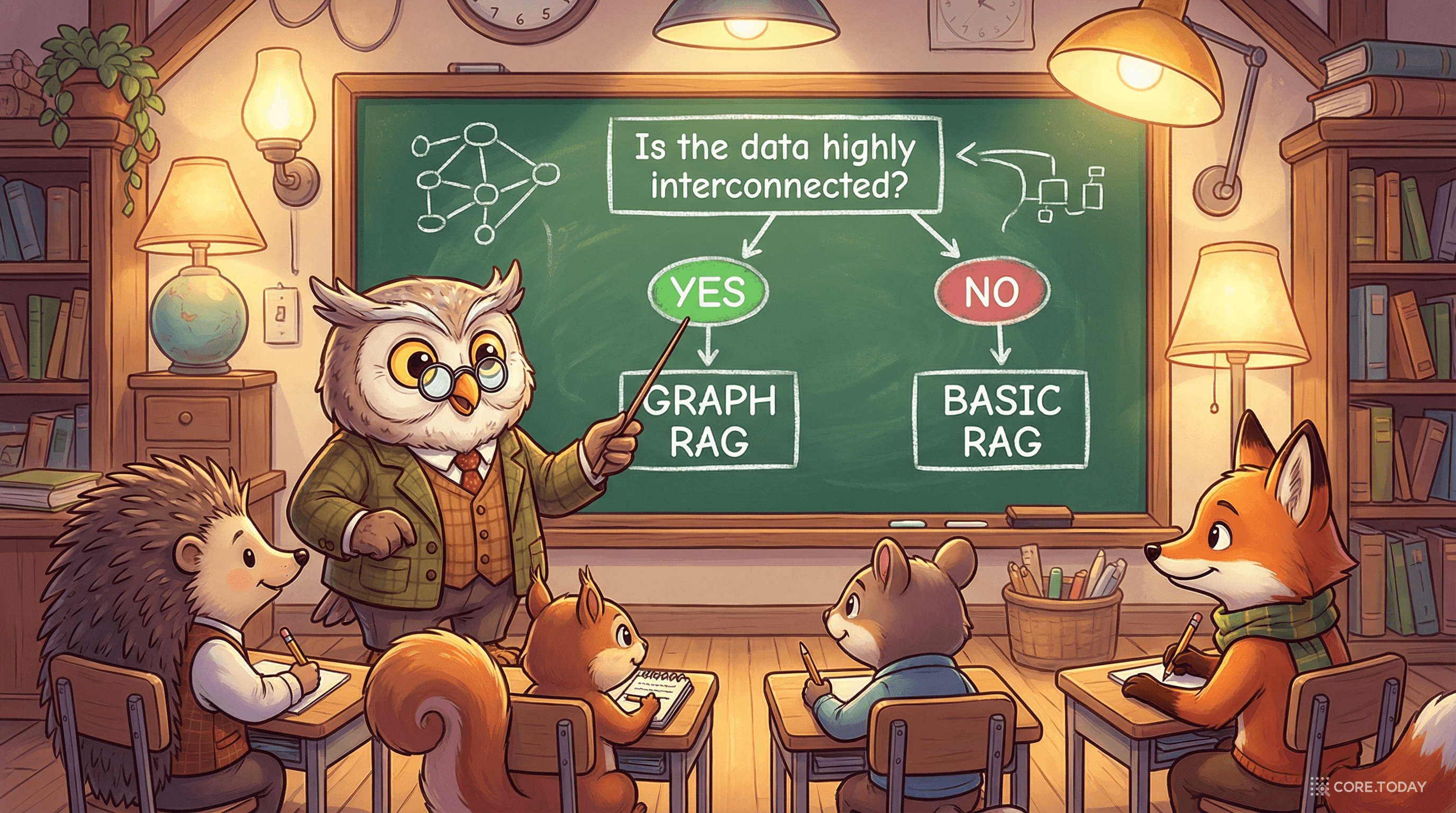

논문의 9가지 관찰을 종합하면, 명확한 의사결정 프레임워크가 도출된다:

모든 GraphRAG가 같지 않다. 어떤 시스템을 선택할지도 중요하다:

| 시스템 | 강점 | 약점 | 추천 상황 |

|---|---|---|---|

| HippoRAG2 | 최고 검색 성능 (재현율 90.9%) | 높은 그래프 밀도 → 비용 증가 | 정확도가 최우선인 경우 |

| MS-GraphRAG | 글로벌+로컬 통합 검색 | 극심한 토큰 인플레이션 (377x) | 대규모 코퍼스의 전체 맥락 파악 |

| LightRAG | 이중 레벨 검색으로 확장성 좋음 | 높은 토큰 비용 (115x) | 확장성이 필요한 중간 규모 프로젝트 |

| Fast-GraphRAG | 효율적 (4.8x), 노이즈 제거 | 검색 성능 보통 | 비용 대비 성능 균형 |

| RAPTOR | 최고 사실 충실도 (70.9%) | 트리 구조 한계 | 사실 정확도가 핵심인 경우 |

논문의 의료 데이터셋 결과는 특히 주목할 만하다. NCCN 의료 가이드라인에서 GraphRAG는 질병-증상-치료-약물 간의 계층적 관계를 활용하여 단순 RAG보다 우수한 성능을 보였다.

2026년 현재, 이 기술은 이미 실전에 투입되고 있다:

이 논문이 주는 가장 중요한 교훈은 단순하다:

GraphRAG는 만능이 아니다. 하지만 제대로 된 상황에서 쓰면 강력하다.

"그래프를 써야 할까?"라는 질문에 대한 답은 항상 "무엇을 하려고 하는가?"에서 시작해야 한다:

망치를 들고 있으면 모든 것이 못으로 보인다. GraphRAG라는 강력한 도구를 손에 쥐었다고 모든 문제에 쓸 필요는 없다. 이 논문은 그 도구가 진정으로 빛나는 순간이 언제인지를 처음으로 체계적으로 보여주었다.

📄 원문 논문: Zhishang Xiang et al. "When to use Graphs in RAG: A Comprehensive Analysis for Graph Retrieval-Augmented Generation." Published as a conference paper at ICLR 2026.

🔗 코드 & 데이터: https://github.com/GraphRAG-Bench/GraphRAG-Benchmark