활성화 함수의 모든 것: 전등 스위치에서 SwiGLU까지

1943년 '뉴런은 전등 스위치다'라는 모델에서 시작해, 시그모이드의 기울기 소실을 넘고, ReLU의 단순한 혁명을 거쳐, AI가 스스로 발견한 Swish까지 — 활성화 함수 80년의 역사를 추적한다.

1943년 '뉴런은 전등 스위치다'라는 모델에서 시작해, 시그모이드의 기울기 소실을 넘고, ReLU의 단순한 혁명을 거쳐, AI가 스스로 발견한 Swish까지 — 활성화 함수 80년의 역사를 추적한다.

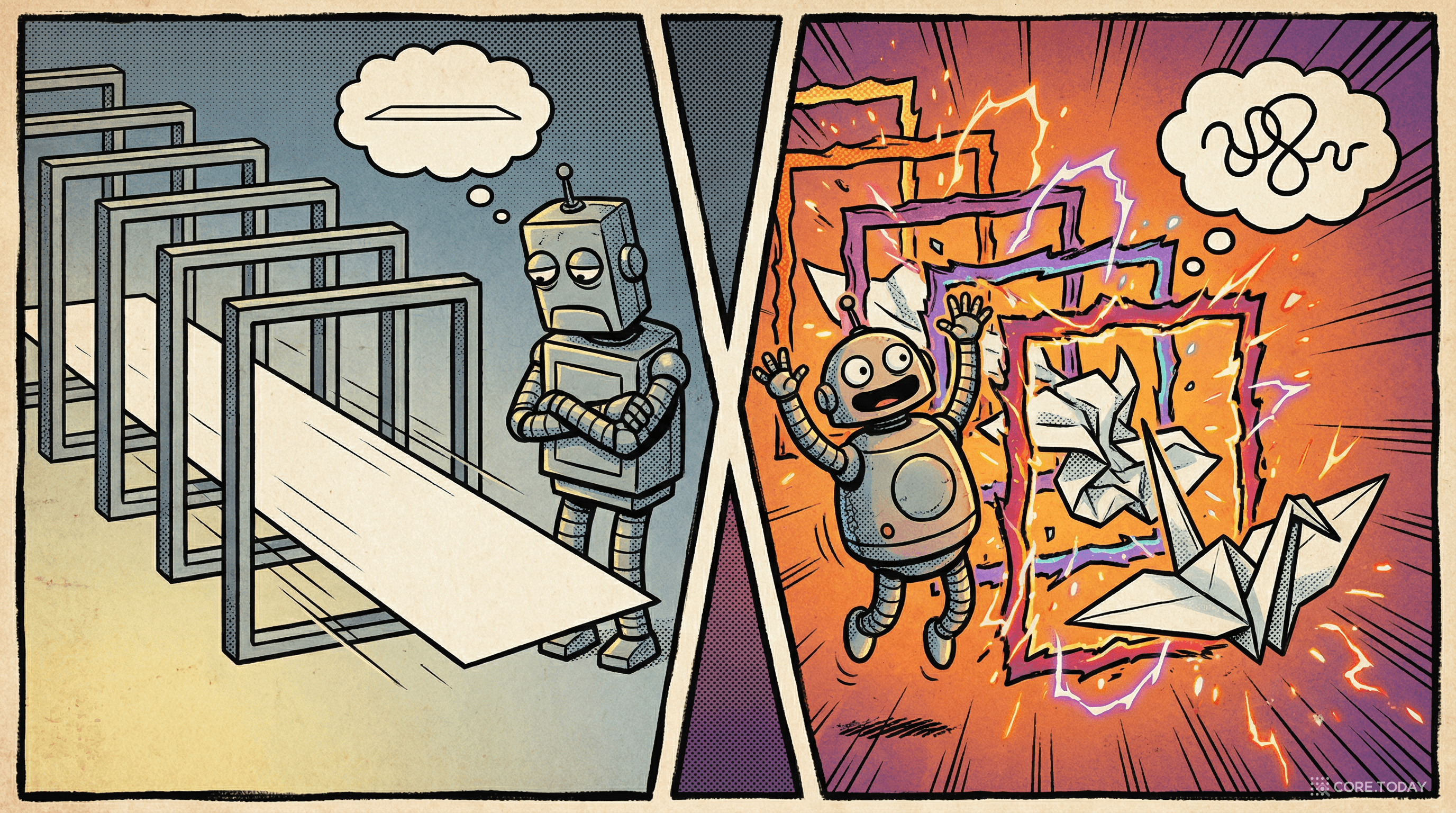

신경망에 대한 가장 흔한 오해 중 하나: "층을 많이 쌓으면 복잡한 것도 배울 수 있다."

틀렸다. 활성화 함수가 없으면 아무리 100층을 쌓아도 신경망은 단 하나의 선형 함수에 불과하다. 선형 함수에 선형 함수를 합성하면? 또 선형 함수다. f(g(h(x))) = Ax + b. 복잡한 곡선, 이미지 인식, 언어 이해 — 이런 것은 절대 배울 수 없다.

활성화 함수는 비선형성(nonlinearity) 을 도입해 이 한계를 깨뜨리는 장치다. 선형의 세계를 접고, 구부리고, 비틀어서 복잡한 표현을 가능하게 만든다.

이 글은 1943년 "뉴런은 전등 스위치"라는 모델에서 시작해, 80년에 걸친 활성화 함수의 진화를 추적한다. 그리고 그 진화가 "신경망은 의미 있는 모델인가?"라는 근본적 질문에 어떻게 답했는지를 풀어본다.

스페인 신경과학자 산티아고 라몬 이 카할(Santiago Ramón y Cajal, 1852~1934) 은 골지의 은 염색법을 개량하여 신경계가 연속적 그물망이 아니라 개별적인 세포(뉴런) 로 구성되어 있다는 뉴런 독트린을 확립했다. 1906년 노벨 생리의학상 수상. 아이러니하게도, 공동 수상자 골지는 수상 연설에서 카할의 이론을 비판했다.

생물학적 뉴런의 핵심 특성은 "전부 아니면 전무(all-or-nothing)" 다. 입력 신호의 합이 역치를 넘으면 뉴런이 발화하고, 넘지 못하면 침묵한다. 호지킨(Hodgkin) 과 헉슬리(Huxley) 는 1952년 오징어 거대 축삭의 이온 메커니즘을 수학적으로 모델링하여 이를 설명했고, 1963년 노벨 생리의학상을 받았다.

이 "전부 아니면 전무"가 바로 인류 최초의 활성화 함수 — 계단 함수(step function) — 의 생물학적 근거다.

워런 매컬록(Warren McCulloch) 과 월터 피츠(Walter Pitts) 는 1943년 "A Logical Calculus of the Ideas Immanent in Nervous Activity"를 발표했다. 이 논문은 뉴런을 단순한 논리 게이트로 모델링했다:

입력의 가중합이 역치를 넘으면 1(발화), 넘지 못하면 0(침묵)

이것이 계단 함수(Heaviside step function) — 인류 최초의 활성화 함수다.

월터 피츠의 이야기는 AI 역사에서 가장 비극적이다.

1923년 디트로이트의 노동자 가정에서 태어난 그는 동네 아이들의 괴롭힘을 피해 도서관에 숨어 살았다. 12세 때 도서관에서 러셀과 화이트헤드의 Principia Mathematica — 수학 역사상 가장 어려운 저작 중 하나 — 를 발견하고, 3일 만에 읽고 오류를 찾아냈다. 그는 버트런드 러셀에게 편지를 보내 이 오류를 지적했고, 러셀은 감탄하여 캠브리지로 초청했다(피츠는 갈 형편이 되지 않았다).

15세에 학대하는 가정에서 도망친 피츠는 시카고 대학교에서 비공식적으로 수학을 공부하며, 매컬록을 만났다. 이 만남에서 탄생한 1943년 논문이 모든 인공 신경망의 직접적 조상이다.

그러나 피츠의 삶은 비극으로 끝났다. MIT에서 사이버네틱스의 창시자 노버트 위너(Norbert Wiener) 와 함께 연구하던 중, 위너의 아내가 피츠에 대한 거짓 소문을 퍼뜨렸다. 위너는 피츠와의 모든 연락을 끊었다. 멘토의 배신에 절망한 피츠는 미발표 박사 논문과 수년간의 연구 노트를 모두 불태우고 학계에서 물러났다. 알코올 중독에 빠진 그는 1969년 5월 14일, 46세에 세상을 떠났다. 정식 학위는 끝내 받지 못했다.

계단 함수의 비유는 전등 스위치다 — ON(1) 아니면 OFF(0). 단순하지만 치명적 결함이 있다:

더 나은 것이 필요했다.

시그모이드의 수학적 기원은 놀라울 정도로 오래되었다. 벨기에 수학자 피에르 프랑수아 페르훌스트(Pierre François Verhulst) 가 1838년에 인구 성장 모델로 로지스틱 함수를 제안했다. 맬서스의 인구론을 읽고, 인구가 자원의 한계에 따라 S자 곡선으로 성장한다는 모델이었다. "로지스틱(logistique)"이라는 이름을 붙인 것은 1845년이다.

1986년 루멜하트, 힌턴, 윌리엄스가 Nature에 역전파를 발표하면서 시그모이드를 활성화 함수로 사용했고, 이후 약 25년간 표준으로 군림했다.

| 시그모이드의 장점 | 시그모이드의 비유 |

|---|---|

| 매끄럽고 미분 가능 → 경사하강법 가능 | 디머 스위치: 밝기를 0~1 사이에서 부드럽게 조절 |

| 출력 [0, 1] → 확률로 해석 가능 | 확신의 정도를 표현 가능 |

| 단조 증가 | 입력이 클수록 출력이 큼 |

그러나 시그모이드에는 치명적 결함이 숨어 있었다. 호크라이터(Sepp Hochreiter) 가 1991년 뮌헨 공과대학교 졸업논문에서 처음 공식 증명한 기울기 소실 문제(vanishing gradient problem) 다.

전화 게임 비유가 정확하다: 속삭임이 사람에서 사람으로 전달될수록 원래 메시지가 사라진다. 시그모이드 신경망에서 오류 신호도 층에서 층으로 전달될수록 소멸한다.

이 문제 때문에 "깊은" 신경망은 사실상 불가능했다. 해법은 두 가지 방향에서 왔다 — LSTM(1997, 구조적 해법)과 ReLU(2010, 활성화 함수 해법).

르쿤(LeCun) 은 1998년 "Efficient BackProp"에서 tanh을 권장했다. 출력이 [-1, 1]로 영중심(zero-centered) 이라 시그모이드보다 최적화에 유리하다. 그러나 기울기 소실 문제는 여전했다.

ReLU의 수식은 이보다 단순할 수 없다:

f(x) = max(0, x)

음수면 0, 양수면 그대로 통과. 그런데 이 단순한 함수가 딥러닝의 역사를 바꿨다.

사실 ReLU의 아이디어는 오래전부터 존재했다:

크리제프스키(Krizhevsky), 수츠케버(Sutskever), 힌턴(Hinton) 의 AlexNet은 ILSVRC-2012에서 top-5 에러율 15.3% 를 달성했다 — 2위(26.2%)와 10.9%p 차이. 논문에서 ReLU는 첫 번째이자 가장 중요한 혁신으로 소개된다:

"tanh 뉴런을 사용했다면, 이렇게 큰 신경망으로 실험하는 것 자체가 불가능했을 것이다."

ReLU의 약점: 뉴런의 입력이 항상 음수면 출력이 영구적으로 0이 되고, 기울기도 0이라 회복이 불가능하다. 스탠퍼드 CS231n 과정에 따르면, 학습률이 너무 높으면 네트워크의 40%가 죽은 뉴런이 될 수 있다.

Maas, Hannun & Ng (ICML 2013): 음수 영역에 고정 기울기 0.01을 부여. 죽은 ReLU 문제를 해결하되, 양수 영역의 단순함은 유지.

허카이밍(He Kaiming) 등이 ICCV 2015에서 발표한 PReLU(Parametric ReLU) 는 음수 기울기를 학습 가능한 파라미터로 만들었다. ImageNet에서 top-5 에러율 4.94% — 인간 수준(5.1%)을 최초로 초과했다.

클레버트(Clevert) 등의 ELU는 음수 영역에 지수함수를 적용해 평균 활성화를 0에 가깝게 유지했다. 클람바우어(Klambauer) 등의 SELU는 여기에 스케일링을 더해 자기 정규화(self-normalizing) 특성을 달성했다.

핸드릭스(Hendrycks) 와 김펠(Gimpel) 이 2016년 제안한 GELU(Gaussian Error Linear Unit) 는 입력을 부호가 아니라 크기(magnitude) 에 따라 가중한다:

GELU(x) = x · Φ(x) (Φ: 가우시안 누적분포함수)

GPT-1에서 최초 채택 → BERT(2018) → GPT-2, GPT-3, T5, ViT로 확산. 현대 NLP의 기본 활성화 함수가 되었다.

2017년, Google Brain의 라마찬드란(Ramachandran), 조프(Zoph), 레(Le) 가 이례적인 접근을 취했다. 인간이 직접 설계하는 대신, 강화학습과 조합적 탐색을 결합해 가능한 활성화 함수 공간을 자동으로 탐색한 것이다.

승자: Swish(x) = x · sigmoid(x)

트랜스포머 논문의 공저자 노암 샤지어(Noam Shazeer) 가 2020년에 제안한 GLU 변형들 중 SwiGLU가 최고 성능을 보였다. SwiGLU는 Swish 활성화와 게이팅 메커니즘을 결합한 것이다.

현재 PaLM (Google), LLaMA (Meta), DeepSeek 등 주요 LLM이 SwiGLU를 표준으로 사용한다. Meta의 LLaMA 논문에서 직접 인용:

"ReLU를 SwiGLU 활성화 함수로 대체했다."

이제 질문에 답할 차례다: "신경망이 진짜 의미 있는 모델인가?"

레슈노(Leshno) 등이 1993년 증명한 결과가 가장 깔끔한 답이다:

다층 피드포워드 네트워크가 어떤 연속 함수든 근사할 수 있는 필요충분조건: 활성화 함수가 다항식이 아닐 것.

ReLU? 다항식 아님 ✅. 시그모이드? 다항식 아님 ✅. GELU? 다항식 아님 ✅.

사실상 실제로 사용되는 모든 활성화 함수가 이 조건을 만족한다. 다항식만이 보편 근사 능력을 잃는 유일한 활성화 함수다.

활성화 함수의 역할은 종이접기와 같다:

활성화 함수는 단순히 "있으면 좋은" 부품이 아니다. 활성화 함수가 곧 표현력이다. 활성화 함수가 없으면 신경망은 의미 있는 모델이 아니다. 활성화 함수가 있으면 — 어떤 것이든 표현할 수 있다.

소프트맥스는 은닉층 활성화가 아니라 출력층과 어텐션 메커니즘에서 사용되는 특수한 함수다. 통계역학의 볼츠만 분포(1868) 에서 기원하며, 1989~1990년 존 브리들(John Bridle) 이 신경망의 argmax를 소프트맥스로 대체할 것을 제안하면서 머신러닝에 도입되었다. 2017년 트랜스포머의 스케일드 내적 어텐션에서 핵심 역할을 맡으며 현대 AI의 필수 구성 요소가 되었다.

1943년 매컬록과 피츠는 "뉴런은 ON 아니면 OFF"라고 했다. 83년이 지난 2026년, 수조 개의 파라미터를 가진 언어 모델은 SwiGLU라는 세련된 활성화 함수로 인간의 언어를 이해한다.

이 여정에서 활성화 함수가 해온 역할은 일관된다: 비선형성을 도입하여 신경망에 표현력을 부여하는 것.

계단 함수는 너무 거칠었다. 시그모이드는 속삭임을 삼켰다. ReLU는 단순함으로 혁명을 일으켰지만 뉴런을 죽였다. GELU와 Swish는 매끄러움과 성능을 모두 잡았고, SwiGLU는 게이팅까지 결합했다.

그리고 레슈노 등이 1993년에 증명한 것처럼, 이 모든 함수가 공유하는 본질적 특성은 하나다 — 다항식이 아니라는 것. 그것만으로 충분하다. 다항식이 아닌 어떤 활성화 함수든, 충분한 뉴런과 결합하면, 어떤 연속 함수든 근사할 수 있다.

월터 피츠가 12세에 도서관에서 발견한 논리의 아름다움은, 80년 뒤 수십억 개의 뉴런이 구사하는 언어의 유창함으로 꽃피었다. 비록 피츠 자신은 그 꽃을 보지 못했지만.