TECH BLOG

기술 블로그

AI 기술 인사이트와 엔지니어링 경험을 공유합니다.

ALL POSTS

모든 포스트

AutoHarness 논문 해설 — AI가 스스로 '규칙 위반 방지 코드'를 만든다

Gemini-2.5-Flash 체스 대회 패배의 78%가 '반칙'이었다. Google DeepMind의 AutoHarness 논문은 LLM이 스스로 규칙 검증 코드를 작성해 이 문제를 해결한다. 작은 모델이 큰 모델을 이기는 역전극의 비밀.

NAT Gateway 완전 정복: '나는 나갈 수 있지만, 넌 들어올 수 없어'의 원리

프라이빗 서브넷의 서버가 인터넷에서 업데이트를 받아야 한다. 하지만 외부에서는 접근할 수 없어야 한다. 이 모순을 해결하는 NAT Gateway — 작동 원리, 비용 함정, 대안까지를 쉽고 자세하게 풀어본다.

Claude Code 소스 유출 사건 — AI 에이전트 보안의 판도라 상자가 열리다

2026년 3월 31일, Anthropic의 Claude Code 소스코드 51만 줄이 npm 패키지 실수로 유출되었습니다. .npmignore 하나의 부재가 AI 보안 역사상 가장 큰 사건을 만들었습니다. 시스템 프롬프트란 무엇이고, 왜 보호가 근본적으로 불가능하며, 유출이 드러낸 AI 에이전트의 내부 구조는 어떤 의미를 갖는지 — 역사부터 기술까지 완전 해부합니다.

CNN 완전 이해: 고양이 한 마리가 바꾼 컴퓨터 비전의 역사

고양이 뉴런 실험에서 자율주행까지 — 합성곱 신경망이 어떻게 탄생했고, 왜 작동하며, 2026년에도 여전히 중요한지를 논문과 사례로 풀어본다.

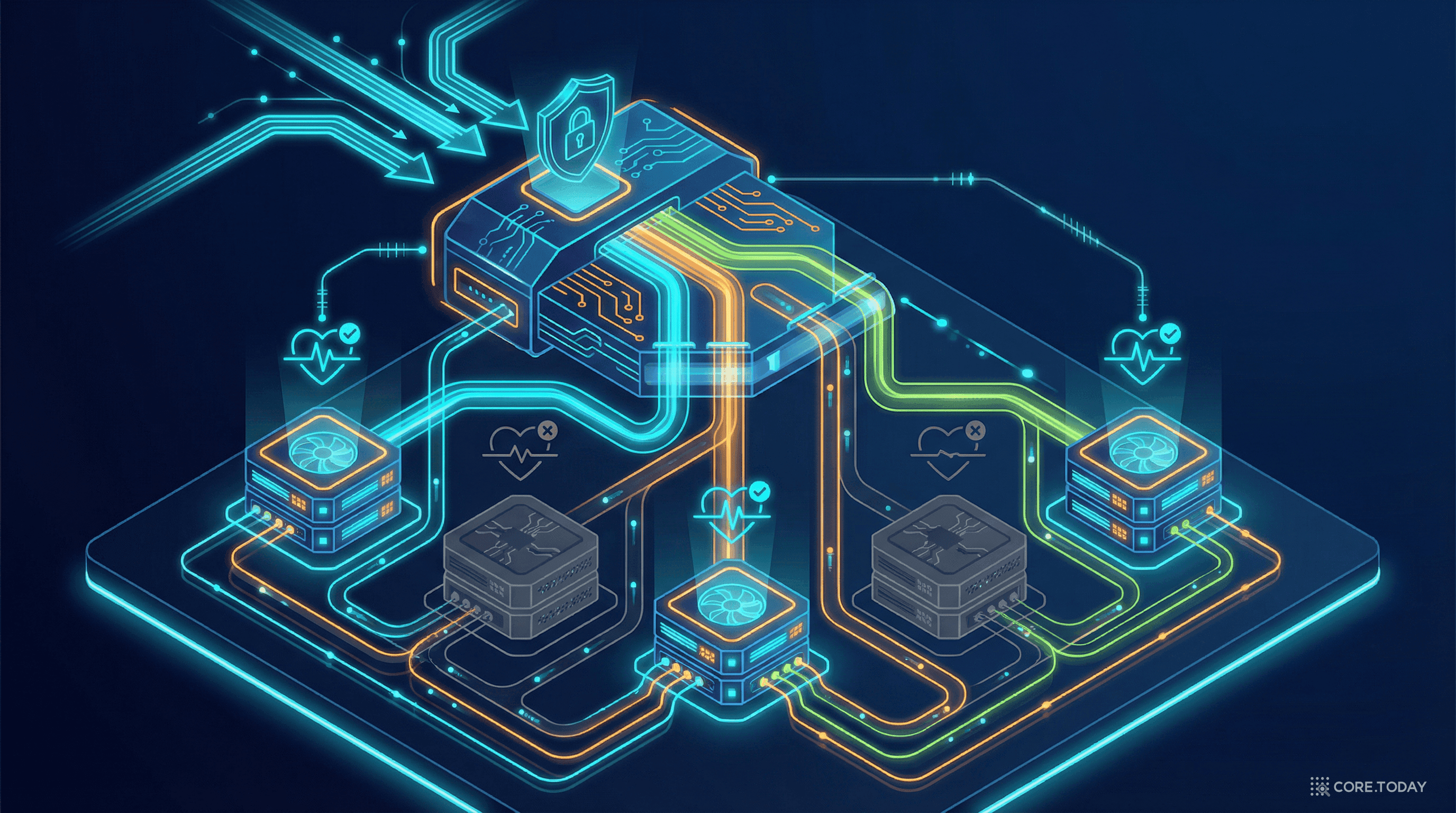

AWS 로드밸런서 완전 정복: CLB, ALB, NLB — 트래픽 분배의 모든 것

서버 1대로 버티던 시절은 끝났다. 사용자가 늘면 서버를 늘려야 하고, 서버를 늘리면 트래픽을 나눠야 한다. CLB에서 ALB, NLB까지 — 로드밸런서의 역사, 작동 원리, 세 가지 타입의 차이, 실전 선택 가이드를 비유와 사례로 풀어본다.

HTTPS와 SSL/TLS: '자물쇠 아이콘' 뒤에 숨겨진 암호화의 원리

브라우저 주소창의 자물쇠 아이콘을 매일 보지만, 그 뒤에서 어떤 일이 벌어지는지 아는 사람은 드물다. 카페 Wi-Fi에서 로그인할 때 비밀번호가 안전한 이유, TLS 핸드셰이크의 동작 원리, 인증서의 신뢰 체계, 그리고 클라우드에서의 HTTPS 운영까지.

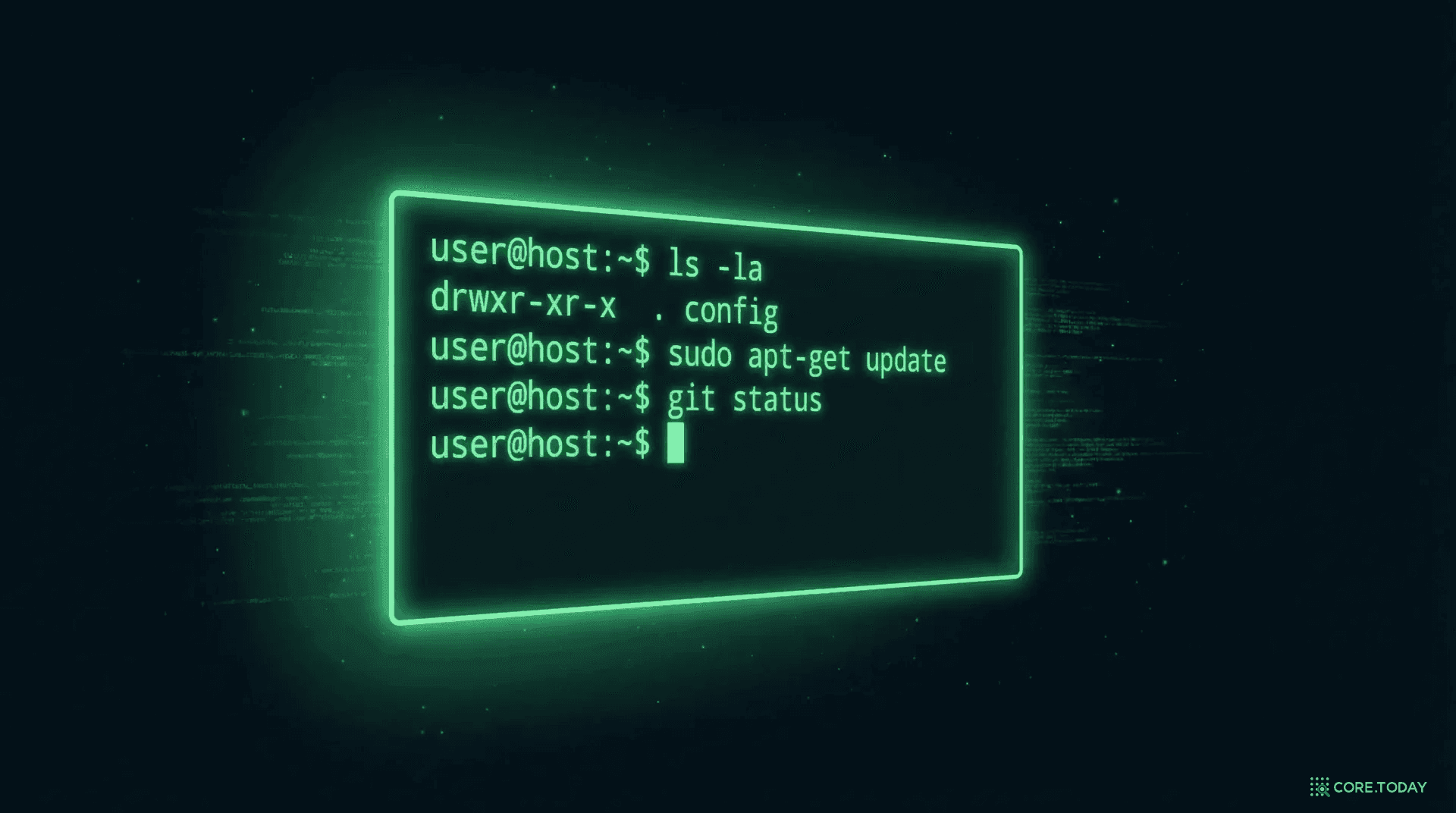

Linux 터미널 입문: 마우스 없이 컴퓨터를 다루는 법

클라우드 서버의 96%는 Linux다. GUI 없이 텍스트만으로 서버를 제어하는 터미널 사용법을, 역사부터 실전 명령어까지 완전히 풀어본다. DX 전문가로 가는 첫 번째 관문.

Transformer 특집: 순서를 기억하는 기계에서 모든 것을 한눈에 보는 기계로

RNN의 순차 처리 한계에서 Attention의 탄생, 그리고 'Attention Is All You Need' 한 편의 논문이 GPT, BERT, 오늘의 LLM 시대 전부를 만들어낸 이야기를 수식과 사례로 풀어본다.

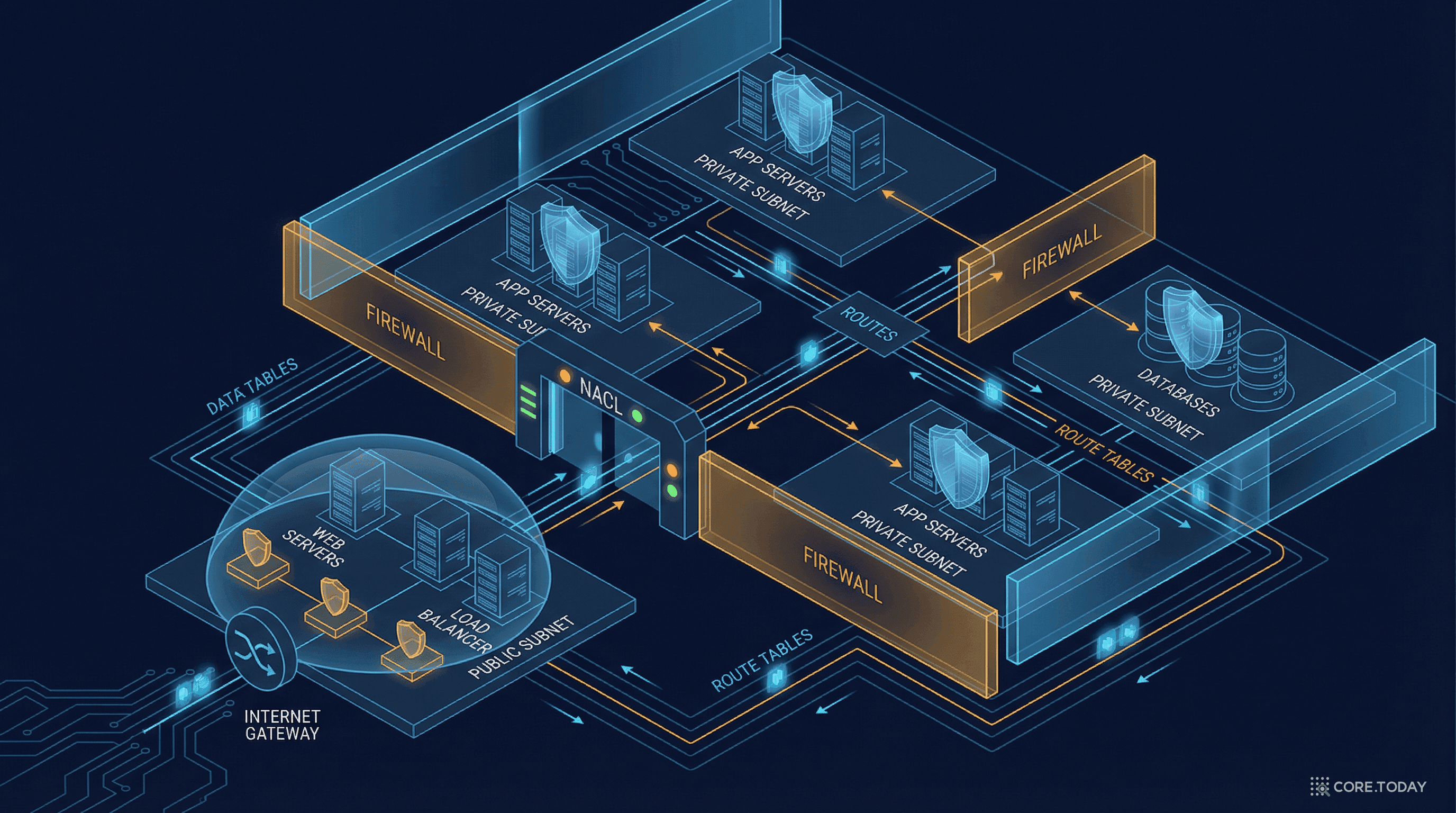

VPC 완전 정복: 클라우드 안에 '나만의 네트워크'를 짓는 법

왜 클라우드에서 '가상 사설 네트워크'가 필요한가? 아파트 비유로 서브넷·라우팅·보안 그룹·NAT를 이해하고, Capital One 사고에서 VPC 설정의 중요성을 배우며, 실전 아키텍처를 설계해 본다.