Yann LeCun의 1조원짜리 반란: World Model, JEPA, 그리고 AMI Labs — LLM 시대의 종말을 선언한 남자

튜링상 수상자 얀 르쿤이 12년간 이끌던 Meta FAIR을 떠나 10억 달러를 모아 AMI Labs를 세웠다. 그의 주장: 'LLM으로는 절대 인간 수준 AI에 도달할 수 없다.' 그가 내놓은 대안 — 세계 모델과 JEPA 아키텍처의 원리를, 케이크 비유부터 로봇 제어까지 깊이 있게 풀어본다.

튜링상 수상자 얀 르쿤이 12년간 이끌던 Meta FAIR을 떠나 10억 달러를 모아 AMI Labs를 세웠다. 그의 주장: 'LLM으로는 절대 인간 수준 AI에 도달할 수 없다.' 그가 내놓은 대안 — 세계 모델과 JEPA 아키텍처의 원리를, 케이크 비유부터 로봇 제어까지 깊이 있게 풀어본다.

2026년 3월 10일, AI 업계에 지진이 일었다.

얀 르쿤(Yann LeCun) — 딥러닝의 아버지 중 한 명이자 2018년 튜링상 수상자, 12년간 Meta의 수석 AI 과학자였던 이 남자가 10억 3천만 달러(약 1조 4천억 원)를 모아 AMI Labs를 설립한 것이다. 기업 가치 35억 달러(약 4조 9천억 원). 유럽 스타트업 역사상 최대 시드 라운드.

하지만 돈보다 더 충격적인 것은 그의 선언이었다:

"LLM으로는 절대 인간 수준 AI에 도달할 수 없다. 지금의 접근법은 과학적 막다른 골목이다."

ChatGPT, Claude, Gemini — 전 세계가 LLM에 수십조 원을 쏟아붓고 있는 상황에서, AI 역사상 가장 영향력 있는 연구자 중 한 명이 정반대 방향으로 걸어가기 시작한 것이다.

르쿤이 LLM 대신 제시한 대안은 "세계 모델(World Model)"과 JEPA(Joint Embedding Predictive Architecture)라는 아키텍처다. 이 글에서는 르쿤이 왜 이런 주장을 하게 되었는지, 세계 모델과 JEPA가 정확히 무엇인지, 그리고 이것이 AI의 미래에 어떤 의미인지를 역사적 맥락부터 최신 동향까지 깊이 풀어본다.

AI 역사에서 "딥러닝의 아버지"로 불리는 세 명이 있다. 2018년 튜링상을 공동 수상한 제프리 힌턴, 요슈아 벤지오, 그리고 얀 르쿤이다.

| 인물 | 대표 기여 | 현재 위치 |

|---|---|---|

| 제프리 힌턴 | 역전파 알고리즘, 볼츠만 머신 | 전 구글, AI 위험 경고 활동 |

| 요슈아 벤지오 | GAN, 어텐션 메커니즘 기초 | 몬트리올대, Mila 연구소 |

| 얀 르쿤 | 합성곱 신경망(CNN), 자기지도학습 | AMI Labs 설립자 |

르쿤의 가장 유명한 업적은 합성곱 신경망(CNN)이다. 1990년대에 손글씨 숫자를 인식하는 LeNet을 개발했고, 이 아키텍처가 이후 ImageNet 혁명(2012)의 기반이 되었다. 이미지 인식, 자율주행, 의료 영상 분석 — 오늘날 컴퓨터 비전의 거의 모든 것이 그의 연구에서 시작되었다.

2013년, 르쿤은 Facebook(현 Meta)의 AI 연구소 FAIR(Fundamental AI Research)의 설립 디렉터로 합류했다. 12년간 FAIR을 세계 최고의 AI 연구소 중 하나로 키웠다.

하지만 2025년 들어 갈등이 시작되었다. Meta가 Llama 시리즈의 상업적 성공에 집중하면서 LLM 중심의 조직 개편을 추진했고, 2025년 10월 FAIR 관련 600명이 해고되었다. 르쿤의 보고 라인도 격하되었다.

2025년 11월 18일, 르쿤은 12년간의 Meta를 떠났다. 그의 설명:

"실리콘밸리는 현재의 생성 AI 모델에 완전히 최면에 걸려 있다. 이런 새로운 연구를 추구하려면 밸리 밖으로 나가야 한다 — 파리로."

AMI Labs (Advanced Machine Intelligence Labs)의 투자자 면면이 화려하다:

마크롱 프랑스 대통령도 "프랑스 연구자들의 시대"라며 축하했다. 본사는 파리, 지사는 뉴욕(르쿤의 NYU 교수직), 몬트리올, 싱가포르에 둔다.

AMI Labs의 핵심 리더십:

설립자 & 회장

튜링상 수상자, NYU 교수CEO

전 Wit.ai 창업자 (FB 인수), 전 Nabla CEO최고과학책임자 (CSO)

Diffusion Transformer(DiT) 설계자. OpenAI Sora의 기반 아키텍처를 만든 인물.최고연구혁신책임자

HKUST 석좌교수, 최초 중국어 NLP 검색엔진·가상비서 개발CEO 르브룅의 예측이 인상적이다:

"'세계 모델'이 다음 버즈워드가 될 것이다. 6개월 안에 모든 회사가 자금을 모으려고 자기들을 세계 모델 회사라고 부를 것이다."

2025년 2월 파리 AI Action Summit에서 르쿤은 자신의 주장을 가장 직설적으로 펼쳤다:

"자기회귀적 LLM은 운명이 다했다(doomed)."

그의 핵심 논거는 지수적 오류 축적(exponential error accumulation)이다.

LLM은 토큰을 하나씩 순서대로 생성한다. 각 토큰이 정확할 확률이 99%라고 해도, 1,000 토큰을 생성하면 전체가 정확할 확률은 0.99^1000 ≈ 0.004%다. 토큰 수가 늘어날수록 오류 확률이 지수적으로 증가한다.

직접 체험해 보자 — 아래 슬라이더를 움직여서 토큰당 정확도와 생성 길이를 바꿔 보면 오류가 얼마나 빠르게 축적되는지 실감할 수 있다:

물론 실제 LLM은 컨텍스트와 어텐션 메커니즘으로 이를 완화하지만, 르쿤의 요점은 구조적 한계가 있다는 것이다.

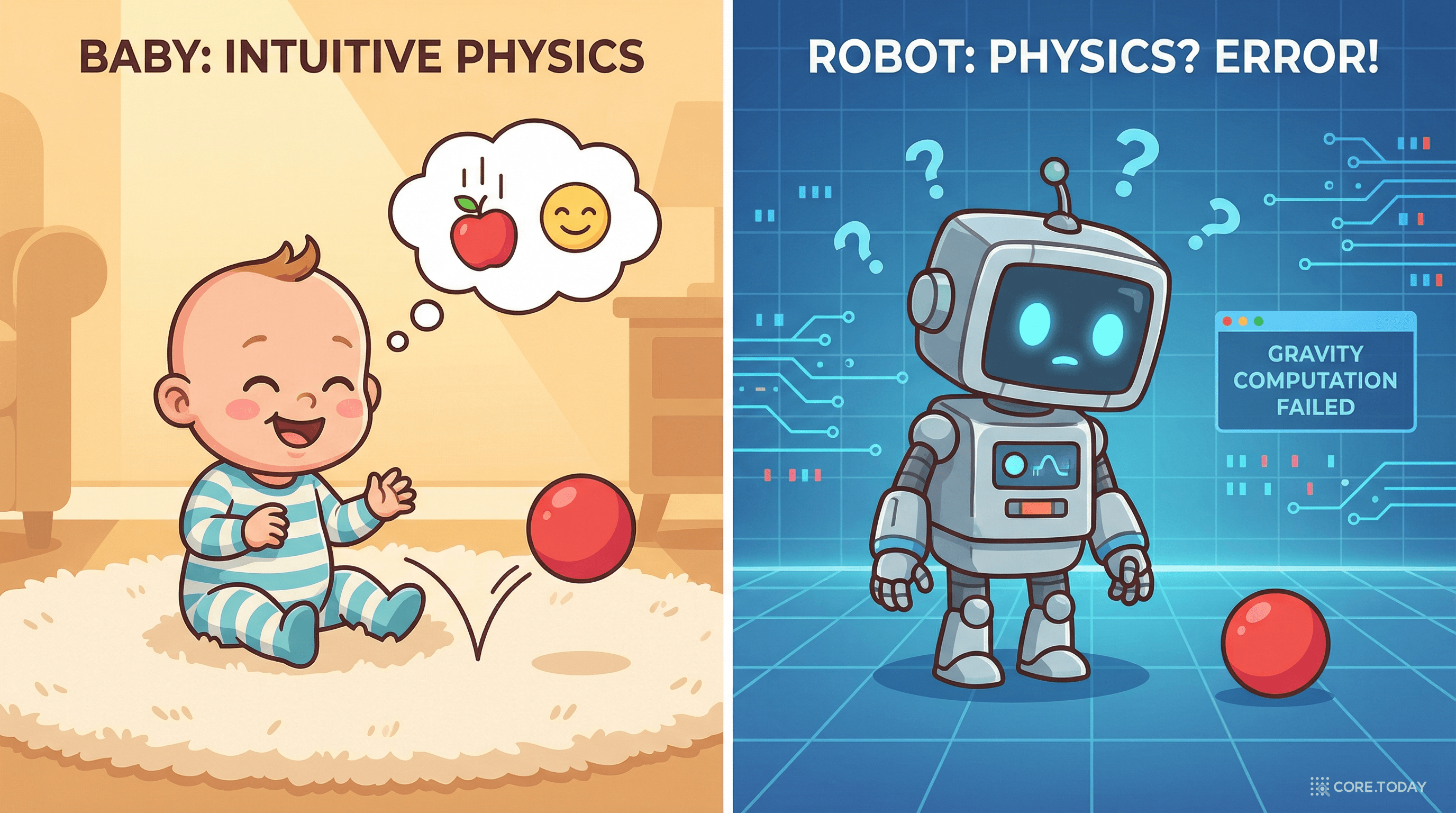

르쿤의 두 번째 논거: LLM은 세상을 텍스트로만 이해한다. 하지만 현실 세계는 연속적이고 고차원이다.

텍스트 — 이산적, 저차원

"유리컵을 테이블 끝으로 밀면" → 다음 단어 예측물리 세계 — 연속적, 고차원

유리컵의 무게, 마찰력, 깨지는 소리, 파편의 궤적LLM은 "유리컵을 밀면 떨어진다"는 텍스트 패턴을 학습할 수 있다. 하지만 왜 떨어지는지(중력), 어떻게 깨지는지(재질 역학), 파편이 어디로 튀는지(운동학)를 이해하지 못한다. 이것은 단어를 더 많이 학습해도 해결되지 않는 근본적 한계다.

"LLM은 유용하다. 하지만 인간 수준 AI로 가는 길에서 벗어나는 출구(off-ramp)다."

"박사 학생이라면 LLM 연구를 하지 마라. LLM의 한계를 극복하는 방법을 발견하라."

"5년 안에, 제정신인 사람은 아무도 자기회귀적 LLM을 쓰지 않을 것이다."

"실리콘밸리는 완전히 'LLM에 중독'되어 있다(LLM-pilled)."

이 발언들은 AI 커뮤니티에서 격렬한 논쟁을 촉발했다.

르쿤은 2016년 NIPS(현 NeurIPS) 학회에서 유명한 케이크 비유를 제시했다:

"지능이 케이크라면, 케이크의 대부분은 비지도 학습이고, 아이싱은 지도 학습이고, 꼭대기의 체리는 강화학습이다."

2019년 ISSCC에서 르쿤은 "비지도 학습"을 "자기지도학습(self-supervised learning)"으로 수정했다:

라벨 없는 대량의 데이터에서 세상의 구조를 학습. 지능의 90% 이상을 차지.

아기가 수백만 번의 관찰로 물리법칙을 배우는 것사람이 라벨을 붙인 소량의 데이터로 미세 조정.

"이것은 고양이야"라고 알려주는 것시행착오를 통한 행동 최적화. 극히 적은 정보.

게임에서 점수를 높이는 법을 배우는 것이 비유의 핵심: 지능의 대부분은 라벨 없는 데이터에서 세상의 구조를 학습하는 것이다. 인간 아이는 부모가 "이것은 고양이야"라고 알려주기 전에도, 수백만 번의 시각 경험을 통해 이미 물체, 중력, 거리 같은 세상의 기본 구조를 파악한다.

LLM의 다음 토큰 예측(텍스트 공간)이 아니라, 현실 세계의 구조를 잠재 공간에서 예측하는 것이 진정한 자기지도학습이라는 것이 르쿤의 신념이다. 이것이 JEPA의 출발점이다.

2022년 6월, 르쿤은 60페이지짜리 포지션 페이퍼를 발표한다: "A Path Towards Autonomous Machine Intelligence". 이 논문은 JEPA와 세계 모델의 청사진을 제시한 핵심 문서다.

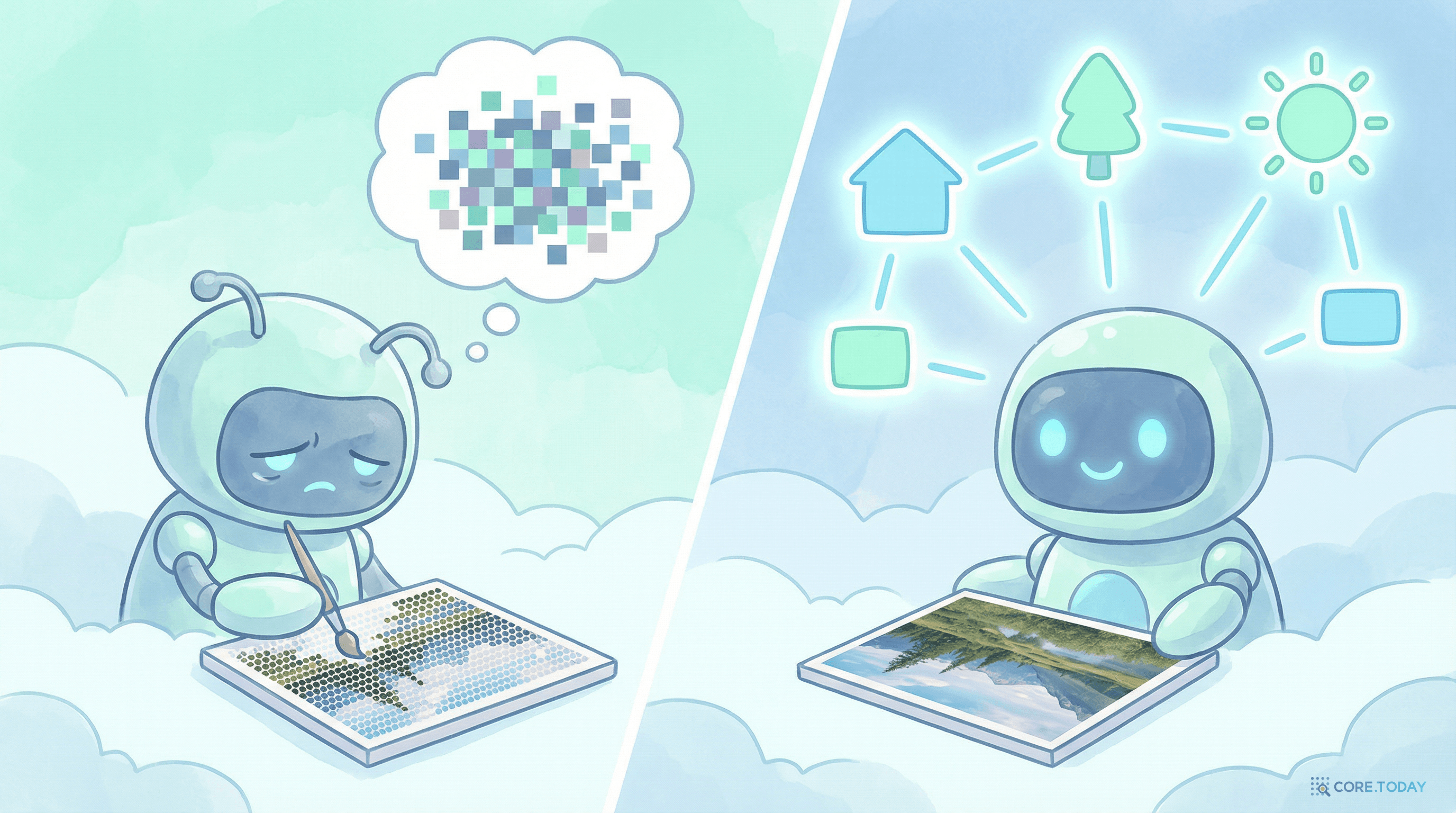

왜 JEPA가 LLM이나 확산 모델(Stable Diffusion)과 근본적으로 다른지, 비유로 이해해 보자.

생성 모델(LLM, 확산 모델)의 방식:

"내일 공원의 모습을 예측해봐"라고 하면, 생성 모델은 모든 픽셀/토큰을 하나하나 예측한다. 나뭇잎이 바람에 어떻게 흔들리는지, 구름의 정확한 모양, 벤치 위 비둘기의 깃털 하나하나까지. 이것은 불가능에 가까운 작업이다. 세상에는 예측할 수 없는 디테일이 무한히 많기 때문이다.

JEPA의 방식:

같은 질문에 JEPA는 추상적 표현(latent representation) 수준에서 예측한다. "내일 공원은 오늘과 비슷하겠지만, 비가 올 확률이 높으니 사람이 적고 벤치가 젖어 있을 것"이라는 고수준의 의미적 예측을 한다. 나뭇잎 하나하나의 위치는 예측하지 않는다 — 그것은 중요하지 않으니까.

픽셀/토큰 공간에서 예측

"나뭇잎이 이렇게 움직이고, 구름이 저렇게 변하고..."

예측 불가능한 디테일까지 시도 → 비효율적잠재 공간(latent space)에서 예측

"비가 오니까 공원이 한산하겠지"

의미적 핵심만 예측 → 효율적, 강건이것은 인간의 사고 방식과 같다. 우리는 내일을 예측할 때 모든 시각적 디테일을 상상하지 않는다. 추상적 수준에서 예측한다.

JEPA의 핵심 구성 요소는 세 가지다:

학습 과정:

핵심: 픽셀을 복원하는 것이 아니라, 임베딩을 예측한다. 나뭇잎의 정확한 색깔이 아니라, "여기에 나무가 있다"는 의미적 정보를 예측하는 것이다.

JEPA는 에너지 기반 모델(Energy-Based Model, EBM) 프레임워크 위에 구축된다. 에너지 함수 F(x, y)는:

잠재 변수 z는 "y에 대해 x에서 빠져 있는 정보"를 나타낸다. 시스템은 z의 정보량(엔트로피)을 최소화하려 한다 — 즉, 미래를 예측하는 데 필요한 최소한의 정보만 사용하는 것이다.

르쿤의 2022년 논문에서 가장 야심 찬 부분은 6개 모듈로 구성된 인지 아키텍처다. 이것은 단순히 이미지를 이해하는 모델이 아니라, 자율적으로 사고하고 행동하는 AI 시스템의 청사진이다.

오케스트라 지휘자. 현재 과제에 맞게 다른 모듈을 사전 설정.

현재 세계 상태를 계층적 표현으로 추정. 센서 입력 처리.

핵심 모듈. 세계의 빠진 정보를 추정하고, 미래 상태를 예측. 행동의 결과를 시뮬레이션.

"불편함"을 에너지로 측정. 내재적 비용(배고픔, 고통) + 학습된 비평가.

미래 에너지를 최소화하는 최적 행동 시퀀스를 탐색.

현재 및 예측된 세계 상태와 관련 비용을 추적.

세계 모델은 계층적으로 쌓인 JEPA로 구성된다. 서로 다른 시간 척도와 추상화 수준에서 예측한다.

르쿤이 논문에서 든 예시: "셰프가 크레페를 만드는 과정을 예측하라"

인간은 이 모든 수준을 동시에 처리한다. 크레페를 만들 때 "밀가루를 가져와야지"(고수준)와 "손을 이렇게 움직여야지"(저수준)를 동시에 생각한다. LLM은 이 중 어떤 것도 할 수 없다 — 텍스트로 설명할 수는 있지만, 실제로 세상을 시뮬레이션하는 것은 아니기 때문이다.

르쿤의 비전은 점진적으로 실체를 갖춰왔다:

V-JEPA 2는 JEPA 철학이 처음으로 실용적 세계 모델로 구현된 모델이다.

규모: 12억 파라미터. 100만 시간 이상의 인터넷 비디오 + 100만 장의 이미지로 학습.

비디오 이해 성능:

가장 놀라운 결과 — 로봇 제어:

V-JEPA 2를 라벨 없는 로봇 비디오 62시간만으로 파인튜닝했더니, 한 번도 본 적 없는 환경에서 65~80%의 성공률로 물건을 집어 옮겼다.

라벨 없이. 로봇 팔이 물건을 잡는 비디오를 그냥 보여줬을 뿐인데, 새로운 환경에서 스스로 물건을 잡을 수 있게 된 것이다. 이것이 세계 모델의 핵심 가치다 — 물리적 세계에 대한 이해가 있기 때문에, 새로운 상황에서도 일반화(generalize)할 수 있다.

V-JEPA 2와 함께 3개의 새로운 벤치마크가 공개되었다:

| 벤치마크 | 측정 대상 | 인간 | 현재 AI |

|---|---|---|---|

| IntPhys 2 | 물리 법칙 이해 (공이 떨어지면 어떻게 되나?) | 85-95% | 거의 찍기 수준 |

| MVPBench | 비디오 쌍 비교 (미세한 차이 포착) | — | 대부분 실패 |

| CausalVQA | 인과 추론 (왜 이것이 일어났나?) | — | 매우 낮음 |

IntPhys 2가 특히 의미 있다. 아기도 생후 수개월이면 "공이 벽을 뚫고 지나가면 이상하다"는 것을 안다. 하지만 현재 최고의 AI 모델도 이 "물리 상식" 테스트에서 찍기 수준이다. 이것이 르쿤이 말하는 "LLM의 한계"의 구체적 증거다.

C-JEPA (Causal JEPA): JEPA에 인과적 귀납 편향(causal inductive bias)을 내장한 모델. 객체 중심 인코더로 비디오를 독립된 엔티티로 분해하고, 반사실적 추론(counterfactual reasoning)이 가능하다. "배트가 공을 빗맞으면 어떻게 되나?"라는 질문에 답할 수 있다. 일반 모델 대비 8배 빠른 예측 제어.

LeWM (Le World Model): 르쿤이 공동 저자로 참여한 최신 논문(2026년 3월 23일). JEPA의 오래된 문제 — 표현 붕괴(representation collapse) — 를 해결했다. ~1,500만 파라미터로 단일 GPU에서 수 시간 만에 훈련 가능하며, 파운데이션 모델 기반 세계 모델 대비 48배 빠른 계획 수립.

2026년 1월 다보스 세계경제포럼에서 AI의 미래를 놓고 세 거장이 격돌했다:

"LLM으로는 절대 AGI 불가. 세계 모델이 필요. 주요 개념적 돌파구가 아직 필요하다."

"현재 AI는 AGI에 '전혀 가깝지 않다.' 1~2개의 추가 돌파구 필요. 5~10년."

"현재 아키텍처로 인간 지능에 곧 도달. 1년 안에 모든 SW 개발자 대체. 2년 안에 노벨상급 연구."

르쿤과 아모데이의 견해는 정반대다. 아모데이가 "데이터센터에 천재들의 나라"를 약속하는 동안, 르쿤은 근본적으로 다른 패러다임이 필요하다고 주장한다.

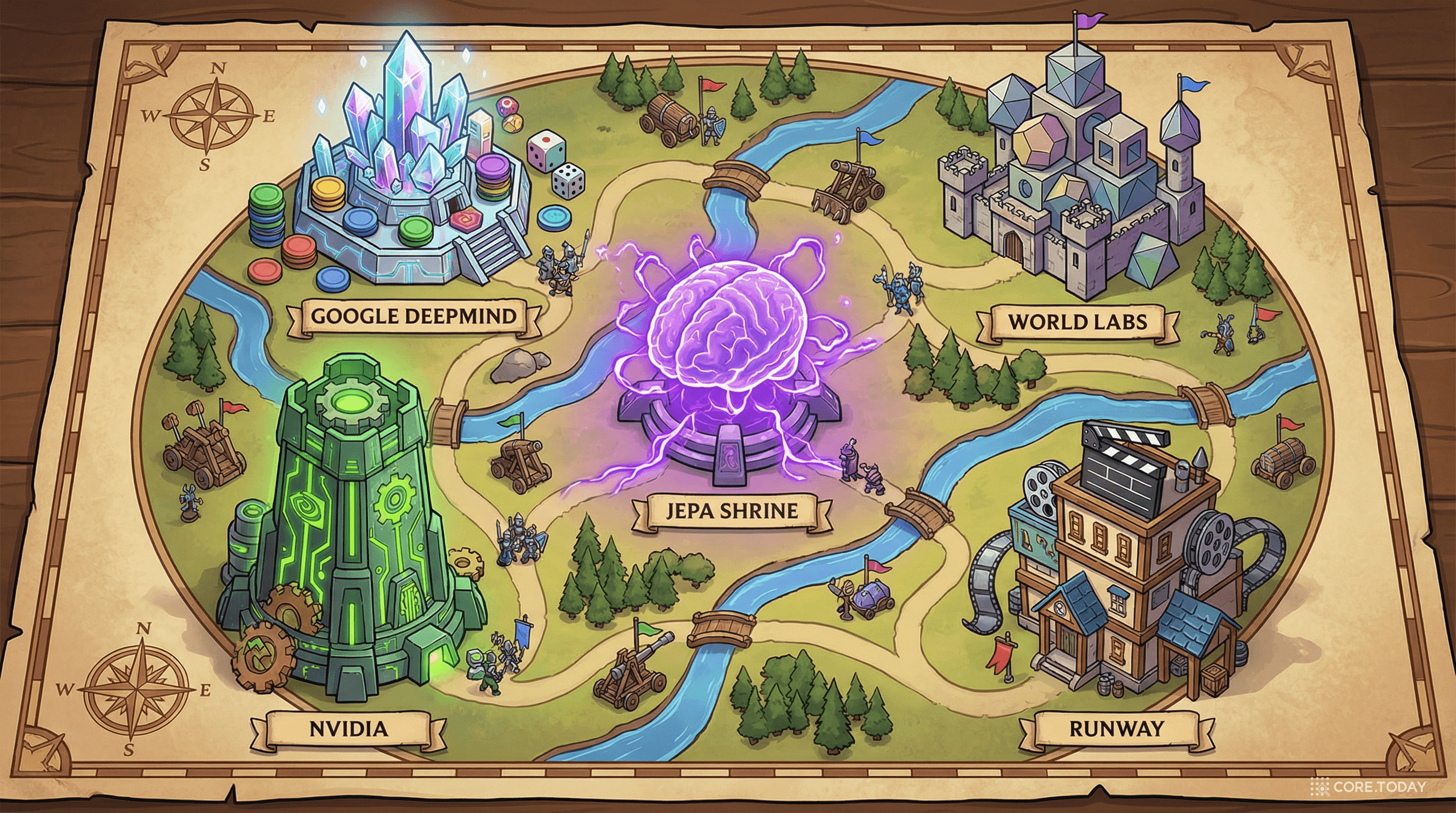

2026년 현재, "세계 모델"을 표방하는 주요 진영이 다섯 개다:

| 진영 | 접근법 | 핵심 특징 |

|---|---|---|

| AMI Labs (JEPA) | 잠재 공간 예측, 비생성적 | 물리 이해·계획에 집중, 로봇·자율주행 |

| 구글 딥마인드 (Genie 3) | 자기회귀 프레임 생성 | 24fps 실시간 3D 세계 생성, 자체 물리 학습 |

| World Labs / 페이페이 리 (Marble) | 지속적 3D 환경 | 편집·다운로드 가능한 3D 세계, VR 호환 |

| NVIDIA (Cosmos) | 물리 AI 플랫폼 | 자율주행·로봇용, 2천만 시간 실제 데이터 |

| Runway (Gen-4.5) | 비디오 생성 기반 | Video Arena 1위, 크리에이티브 산업 |

AMI Labs가 다른 진영과 가장 크게 다른 점: 다른 모델들은 대부분 생성적(generative) — 실제 이미지나 비디오를 생성한다. AMI Labs의 JEPA는 비생성적 — 추상적 표현만 예측한다. 르쿤은 이것이 더 근본적이고 효율적인 접근이라고 주장한다.

르쿤의 비전에 대한 비판도 만만치 않다:

게리 마커스 (NYU 교수, AI 비평가):

"JEPA에는 기하학도 없고, 구조도 없고, 물리학도 없고, 인과 맵도 없다. '보는 것'이 '이해하는 것'은 아니다."

마커스는 르쿤의 LLM 비판에는 부분적으로 동의하지만, JEPA가 기호적 AI(symbolic AI)의 중요성을 무시하고 있다고 지적한다.

LLM 옹호론:

실행 리스크:

르쿤은 이러한 비판에 대해 일관된 입장을 유지한다:

"유용하다는 것과 올바른 방향이라는 것은 다르다. 증기기관도 유용했지만, 내연기관이 등장하면 사라졌다. LLM은 AI의 증기기관이다."

그는 LLM이 "현재 유용한 도구"임을 인정하지만, 인간 수준 AI(AGI)로 가는 길은 아니라고 확신한다.

새로운 환경에서 제로샷 물체 조작. V-JEPA 2가 62시간의 비디오만으로 로봇 팔 제어를 학습한 사례.

물리 법칙 이해 기반의 주행 판단. "빗길에서 브레이크를 밟으면 미끄러진다"는 것을 시뮬레이션.

공정 변경의 결과를 사전 시뮬레이션. "이 온도를 10도 올리면 제품에 어떤 영향?"

신체 시뮬레이션 기반 진단. "이 약을 투여하면 환자의 상태가 어떻게 변할까?"

CEO 르브룅에 따르면:

LLM은 텍스트(이산적·저차원)에서만 작동하므로, 연속적·고차원인 현실 세계를 이해할 수 없다. 인간 수준 AI에는 세계 모델이 필요하다.

잠재 공간에서 예측하는 비생성적 아키텍처. 픽셀/토큰이 아닌 추상적 표현을 예측해, 의미적 핵심에 집중하고 예측 불가능한 디테일은 무시.

현실 세계의 내부 시뮬레이션. 계층적 JEPA로 구성되어, 밀리초~분 단위의 다양한 시간 척도에서 미래를 예측하고 행동의 결과를 시뮬레이션.

$10.3억 시드. NVIDIA·삼성·베이조스 투자. 파리 본사. 2027년 첫 제품 목표. 로봇·자율주행·제조·의료 타깃.

지능의 대부분(케이크 본체)은 자기지도학습. 라벨 없는 대량의 데이터에서 세상의 구조를 학습하는 것이 지능의 본질.

AI 역사에서 "주류에 반기를 든 사람"이 옳았던 경우는 적지 않다.

1980년대, 신경망이 "죽은 분야"로 취급받을 때 르쿤과 힌턴은 계속 연구했다. 2012년 ImageNet 혁명이 그들의 정당성을 증명했다. 2023년, 거의 모든 AI 연구자가 LLM에 몰려 있을 때 르쿤은 "이것은 막다른 길"이라고 주장했다. 3년이 지난 2026년, 그는 10억 달러를 모아 자신의 비전을 실현하기 시작했다.

물론 이번에도 르쿤이 옳을지는 아무도 모른다. LLM이 계속 발전하며 한계를 극복할 수도 있고, 세계 모델이 상용화에 실패할 수도 있다. 다리오 아모데이의 "데이터센터의 천재들"이 먼저 실현될 수도 있다.

하지만 한 가지는 확실하다: AI의 미래가 단일 패러다임으로 정해지지 않았다는 것. LLM이 전부라고 생각했던 세계에, 르쿤은 "아직 시작도 안 했다"고 말하며 새로운 길을 열고 있다.

그가 옳은지 틀린지는 시간이 증명할 것이다. 하지만 그의 반란 자체가, AI를 더 풍부하고 다양한 방향으로 발전시키는 원동력이 되고 있다.

여기까지 읽었다면, 아래 퀴즈로 핵심 개념을 점검해 보자. 6문제로 르쿤의 비전을 얼마나 이해했는지 확인할 수 있다.

참고 자료