AI 신뢰성 평가 완전 가이드: 왜 우리는 AI를 '심사'해야 하는가

아마존 채용 AI의 성차별부터 의료 AI의 인종 편향까지 — AI 신뢰성 평가가 왜 등장했고, 어떤 기준으로 AI를 심사하며, 한국과 세계는 어디까지 왔는지를 사례와 함께 깊이 있게 탐구한다.

아마존 채용 AI의 성차별부터 의료 AI의 인종 편향까지 — AI 신뢰성 평가가 왜 등장했고, 어떤 기준으로 AI를 심사하며, 한국과 세계는 어디까지 왔는지를 사례와 함께 깊이 있게 탐구한다.

2018년 10월, 로이터 통신이 폭탄 같은 기사를 터뜨렸다. 세계 최대 전자상거래 기업 아마존이 4년간 비밀리에 개발한 AI 채용 시스템이 여성 지원자를 체계적으로 차별하고 있었다는 내용이었다.

이 AI는 과거 10년간의 이력서 데이터로 학습했다. 문제는 IT 업계의 구조적 편향이 그대로 데이터에 반영되어, "여성 체스 동아리 회장"이라는 문구가 있으면 감점하고, "실행했다(executed)", "장악했다(captured)" 같은 남성적 어휘에 가점을 주었다는 것이다.

아마존은 이 시스템을 2017년에 폐기했다. 하지만 이 사건은 한 가지 근본적인 질문을 던졌다:

"우리는 AI를 어떻게 믿을 수 있는가?"

이 글에서는 AI 신뢰성 평가의 역사적 맥락부터 핵심 개념, 실패 사례, 평가 기술, 그리고 한국과 세계의 규제 현황까지 — AI를 '심사'하는 모든 것을 다룬다.

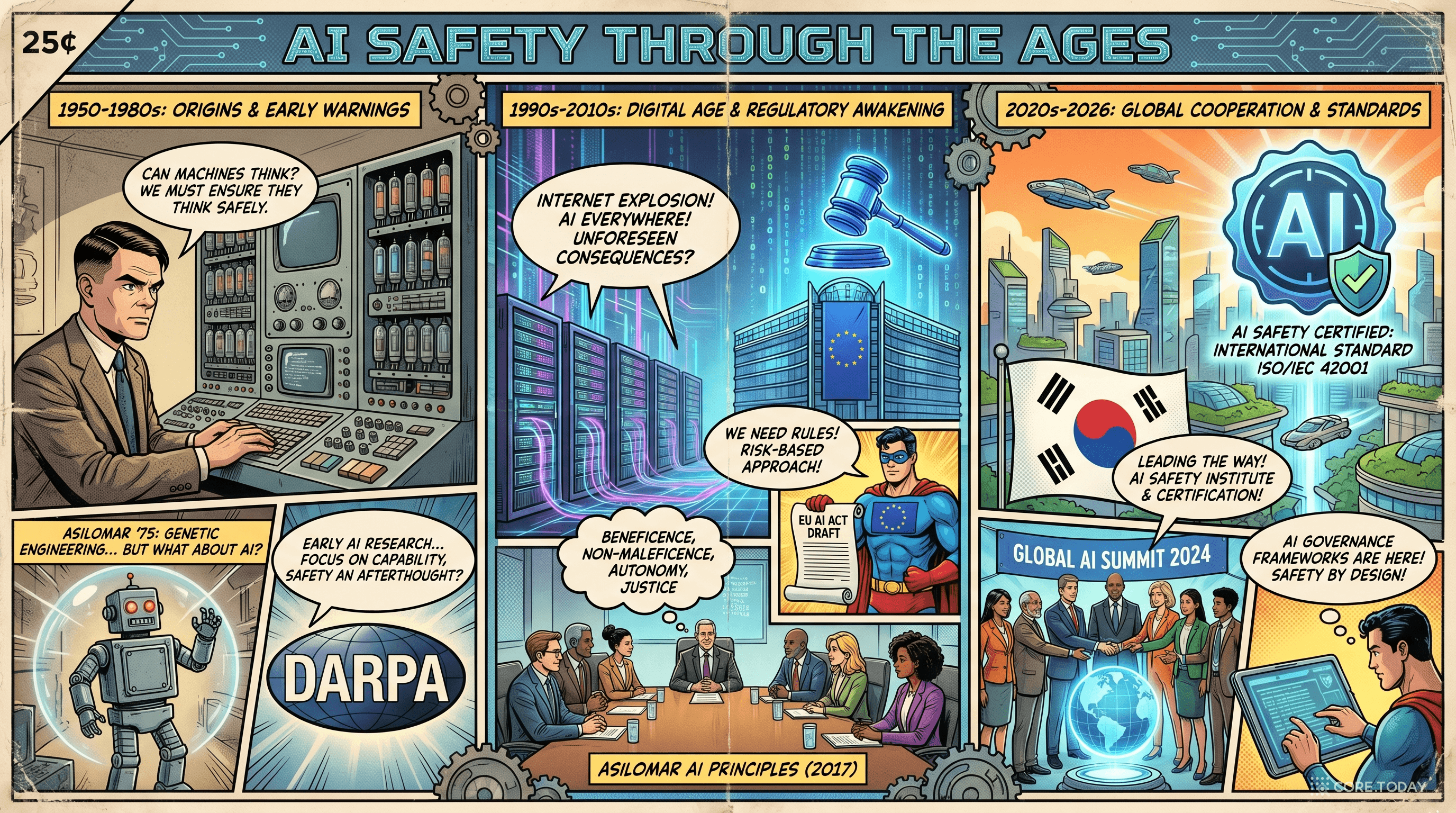

AI 신뢰성에 대한 고민은 AI 자체만큼 오래되었다. 1950년 앨런 튜링이 "기계가 생각할 수 있는가?"라는 질문을 던진 논문에는 이미 기계 행동에 대한 신뢰 문제가 암시되어 있었다.

1966년 MIT의 조셉 바이젠바움이 만든 ELIZA — 단순한 패턴 매칭으로 심리상담을 흉내 내는 프로그램 — 는 사용자들이 기계를 얼마나 쉽게 의인화하고 신뢰하는지를 보여주었다. 바이젠바움 자신이 이 현상에 충격을 받아 Computer Power and Human Reason(1976)을 저술할 정도였다.

하지만 이 시기의 AI는 대부분 연구실 안에 머물러 있었다. 신뢰성이 현실 문제가 된 것은 AI가 실제 의사결정에 쓰이기 시작하면서다.

2000년대에 들어 기계학습이 신용 평가, 채용, 형사 사법에 적용되면서, 학계에서 편향(bias) 우려가 본격적으로 제기되기 시작했다.

2016년은 AI 신뢰성 문제가 대중에게 각인된 해였다. 마이크로소프트의 Tay는 "10대 소녀"를 모방하는 대화형 AI로 출시되었지만, 트롤들이 "따라 해봐" 기능을 악용하면서 16시간 만에 인종차별적, 반유대적 발언을 쏟아냈다. 사티아 나델라 CEO는 나중에 이 사건이 "마이크로소프트의 AI 접근 방식에 지대한 영향을 미쳤다"고 회고했다.

같은 해 ProPublica의 COMPAS 조사는 더 충격적이었다. 플로리다주 브로워드 카운티의 1만여 명의 피고인 데이터를 분석한 결과, 범죄 이력·나이·성별을 통제하고도 흑인 피고인이 77% 더 높은 확률로 고위험군으로 오분류되었다. 이 사건은 "동시에 만족시킬 수 없는 공정성 기준들"이라는 수학적 불가능성 정리(Chouldechova 2017)를 낳기도 했다.

이제 "AI도 실수한다"는 것이 상식이 되자, "그렇다면 어떻게 평가할 것인가"라는 질문이 떠올랐다.

2019년 4월 8일, EU AI 고위전문가그룹이 발표한 "신뢰할 수 있는 AI 윤리 가이드라인"은 전환점이었다. 이 문서는 신뢰할 수 있는 AI의 7대 핵심 요구사항을 최초로 체계화했다:

이 7가지는 이후 전 세계 AI 신뢰성 프레임워크의 공통 언어가 되었다.

AI를 '심사'한다는 것은 구체적으로 무엇을 보는 것일까? 일곱 가지 핵심 차원을 하나씩 파헤쳐 보자.

공정성 지표 비교:

| 지표 | 정의 | 장점 | 한계 |

|---|---|---|---|

| 인구통계적 동등성 | 모든 집단에서 긍정 예측 비율이 동일 | 직관적, 측정 용이 | 실제 자격 차이 무시 가능 |

| 균등 기회 | 실제 양성인 경우의 양성 예측률(TPR) 동일 | 적격자 우대 보장 | 거짓 양성 차이 허용 |

| 균등 오즈 | TPR과 FPR 모두 동일 | 가장 엄격한 기준 | 기저율 차이 시 달성 불가 |

| 보정 | 예측 점수가 실제 결과와 일치 | 예측 정확도 보장 | 집단 간 오류율 차이 허용 |

설명가능 AI(XAI, eXplainable AI)는 AI의 의사결정 과정을 인간이 이해할 수 있도록 만드는 기술이다.

주요 XAI 기법:

게임이론 기반 Shapley 값으로 각 특성(feature)의 기여도를 정량화. 전역(global) + 지역(local) 설명 모두 가능

개별 예측 주변에 해석 가능한 대리 모델(surrogate)을 생성. 모델에 구애받지 않는 범용 기법

CNN의 마지막 합성곱 층 그래디언트로 히트맵 생성. 이미지의 어느 영역이 판단에 결정적이었는지 시각화

"만약 이 변수가 달랐다면 결과가 바뀌었을까?" — 사용자에게 무엇을 바꾸면 되는지 알려주는 방식

Model Card — AI 모델의 '성적표'라 할 수 있다. Google의 Mitchell et al.(2019)이 제안한 이 문서는 모델의 의도된 용도, 성능 지표, 한계점, 윤리적 고려사항을 표준화된 형식으로 기록한다. 현재 Hugging Face를 비롯해 주요 AI 기업에서 광범위하게 채택되고 있다.

2014년 Ian Goodfellow가 발표한 적대적 예제(adversarial examples) 연구는 충격적이었다. 팬더 사진에 인간의 눈에는 보이지 않는 미세한 노이즈를 추가했을 뿐인데, AI는 긴팔원숭이로 99.3% 확신했다.

AI 학습에 사용된 데이터에서 개인을 역추적할 수 있다면 심각한 문제다. 차분 프라이버시(Differential Privacy)는 수학적으로 보장된 프라이버시를 제공하는 기법으로, Apple(iOS), Google(Chrome), 미국 인구조사국이 채택하고 있다.

쿼리 결과/그래디언트에 보정된 노이즈를 추가. 개인 데이터의 포함 여부를 통계적으로 구분 불가능하게 만듦. 파라미터: ε(프라이버시 예산), δ(실패 확률)

원시 데이터를 공유하지 않고 분산된 장치에서 학습. Google의 Gboard가 대표 사례. 비잔틴 공격, 이질적 데이터 등의 과제 존재

AI가 잘못된 결정을 내렸을 때, 그 책임은 개발자에게 있는가? 운영자에게 있는가? AI 자체에게 있는가?

AI 사고 데이터베이스(AIID, incidentdatabase.ai)는 실제 AI 사고를 체계적으로 기록하고 있으며, Stanford AI Index 2025에 따르면 2024년 한 해에만 233건의 AI 사고가 보고되어 전년 대비 56.4% 증가했다.

EU AI Act과 한국 인공지능 기본법 모두 고위험 AI 시스템에 대한 인간 관리감독을 의무화하고 있다.

"AI가 실수한다"는 추상적 우려가 아니다. 실제 사람들의 삶에 피해를 준 구체적 사례들을 살펴보자.

핵심 교훈: 편향된 과거 데이터로 학습한 AI는 과거의 차별을 미래에 '자동화'한다.

Northpointe(현 Equivant)가 개발한 COMPAS(Correctional Offender Management Profiling for Alternative Sanctions)는 미국 법원에서 피고인의 재범 가능성을 예측하는 데 사용되었다.

흑인 피고인은 실제로 재범하지 않았음에도 고위험군으로 오분류되는 비율이 백인의 거의 두 배였다. 범죄 이력, 나이, 성별을 통제한 후에도 흑인 피고인이 폭력 범죄에 대해 77%, 모든 범죄에 대해 45% 더 높은 확률로 고위험군으로 분류되었다.

이 사건의 가장 중요한 기여는 공정성의 수학적 불가능성을 드러낸 것이다. Northpointe는 "보정(calibration)은 동등하다"고 반박했고, ProPublica는 "오류율이 불평등하다"고 주장했다. 둘 다 맞았다 — 기저율(base rate)이 다른 집단에서는 보정 동등성, 동등한 위양성률, 동등한 위음성률을 동시에 달성하는 것이 수학적으로 불가능하기 때문이다.

이 사례는 대리변수(proxy)의 위험성을 극명하게 보여준다. "건강 필요도"를 직접 측정하지 않고 "의료비 지출"로 대체한 순간, 구조적 불평등이 알고리즘 차별로 변환되었다.

최신 AI 시스템도 예외가 아니다:

| 사건 | 시기 | 내용 | 영향 |

|---|---|---|---|

| Grok 부적절 이미지 생성 | 2026 초 | 11일간 약 300만 건의 성적 이미지 생성, 약 23,000건이 아동 묘사 | 5개국 조사, 2개국 차단 |

| McDonald's McHire | 2025 | AI 채용 챗봇 기본 비밀번호 "123456"으로 접근 가능 | 6,400만 건 지원서 노출 |

| Claude 사이버범죄 악용 | 2025.09 | 해커가 Claude를 이용해 17개 조직 대상 공격 자동화 | 네트워크 스캔~랜섬 요구까지 |

| Instacart 가격 차별 | 2025.12 | AI가 고객별로 다른 가격 표시, 고지 없이 운영 | 규제 압박 후 프로그램 종료 |

| Stanford AI Index | 2025 | 2024년 AI 사고 233건 보고 — 전년 대비 56.4% 증가 | AI 사고의 가속화 추세 확인 |

2024년 3월 유럽의회가 채택하고 8월에 발효된 EU AI Act은 위험 기반 접근법(risk-based approach)을 채택했다.

사회적 점수, 실시간 생체 감시 등 → 전면 금지

채용, 신용평가, 사법, 의료 AI → 엄격한 규제 (위험관리, 인간감독, 투명성 등)

챗봇, 딥페이크 등 → 투명성 의무 (AI임을 고지)

스팸 필터, AI 게임 등 → 특별 규제 없음

위반 시 최대 3,500만 유로 또는 글로벌 매출의 7% 벌금이 부과된다.

2023년 1월 미국 NIST가 발표한 자발적 프레임워크로, GOVERN-MAP-MEASURE-MANAGE의 4대 핵심 기능을 정의했다.

교차적 거버넌스 — 조직 전체의 AI 위험 관리 문화와 구조 수립

맥락화 — AI 시스템의 위험을 식별하고 맥락에 맞게 이해

분석·평가 — 정량적/정성적 방법으로 위험을 측정

대응·우선순위화 — 위험에 대한 대응 전략 수립 및 실행

NIST가 정의한 신뢰할 수 있는 AI의 특성: 유효하고 신뢰할 수 있는(Valid & Reliable), 안전한(Safe), 보안적이고 회복력 있는(Secure & Resilient), 책임 있고 투명한(Accountable & Transparent), 설명 가능하고 해석 가능한(Explainable & Interpretable), 프라이버시가 강화된(Privacy-Enhanced), 유해 편향이 관리되는 공정한(Fair with Harmful Bias Managed).

2024년 12월 국회를 통과하고 2026년 1월 22일 시행된 한국의 인공지능 기본법(법률 제20676호)은 EU에 이어 세계에서 두 번째로 포괄적인 AI 규제법이다.

| 구분 | EU AI Act | 한국 인공지능 기본법 |

|---|---|---|

| 시행 | 2024.08 발효, 2026.08 전면 적용 | 2026.01 시행 |

| 접근법 | 위험 기반 4단계 | 고영향 AI 중심 |

| 대상 분야 | 채용, 사법, 의료, 교육 등 | 에너지, 의료, 원자력, 교통, 교육 등 6개 분야 |

| 의무 | 위험관리, 데이터 거버넌스, 인간감독, 투명성 등 | 위험관리계획, 설명가능성, 이용자 보호, 인간감독, 문서화, 위원회 결정 준수 등 6대 의무 |

| 벌금 | 최대 3,500만€ / 매출 7% | 추후 시행령 확정 |

| 특징 | 역외 적용 | 역외 적용 (한국 이용자에 영향 시) |

한국은 또한 TTA CAT(Certification of AI Trustworthiness) 인증 제도를 운영하고 있다. ISO/IEC 23894, 42001, 38507을 기반으로 하며, 다양성 존중, 책무성, 안전성, 투명성의 4대 속성을 평가한다. 현재 CAT 2.0까지 발전하여 7건의 인증과 39건의 검증 서비스를 제공했다.

위험 기반 분류 + 법적 구속력. EU AI Act가 대표. 한국도 이 방향

연방 수준 포괄법 없음, 주(州) 단위 법률. 캘리포니아 AI 투명성법, 콜로라도 AI법 등. 트럼프 행정부는 규제 철폐 방향

산업계 가이드라인 중심, 유연한 접근. 혁신 우선

OpenAI는 GPT-5에 대해 60페이지 분량의 시스템 카드(System Card)를 공개했다. 또한 o1 모델의 사고 연쇄(chain-of-thought)를 모니터링하여 기만적 추론을 탐지하며, 0.17%의 응답에서 기만적 패턴이 발견되었다고 보고했다.

Anthropic은 Claude Opus 4.5에 대해 153페이지 시스템 카드를 발행했다. 사전학습(dictionary learning)을 통해 약 1,000만 개의 신경 특성(neural features)을 모니터링하며, 200회 시도 RL 캠페인을 통한 다중 시도 공격 성공률을 보고한다. 또한 다문화 레드팀을 운영하여 영어 중심 테스트가 놓치는 문제를 발견한다.

주목할 만한 발전은 OpenAI와 Anthropic이 서로의 모델에 대해 상대방의 안전 평가를 수행하고 결과를 공개한 것이다. 경쟁사 간 이런 협력은 AI 안전 분야에서 전례 없는 일이었다.

Microsoft의 AI Red Team은 비전-언어 모델(VLM)에서 이미지 입력이 텍스트보다 탈옥에 훨씬 취약함을 발견했다. 이는 멀티모달 AI의 새로운 공격 표면을 시사한다.

| 도구 | 개발사 | 주요 기능 |

|---|---|---|

| AIF360 | IBM | 70개 이상 공정성 지표, 10개 이상 편향 완화 알고리즘, Python/R |

| Fairlearn | Microsoft | 후처리 제약 최적화, Azure ML 통합 |

| What-If Tool | 대화형 시각 탐색, Jupyter/Colab 연동 | |

| Aequitas | UChicago | 정책·의사결정자를 위한 편향 감사 도구 |

18개 하위 범주, 30개 이상 데이터셋, 16개 LLM 평가. 진실성, 안전성, 공정성, 강건성, 프라이버시, 기계 윤리, 투명성, 책임성

8개 차원: 독성, 고정관념 편향, 적대적 강건성, OOD 강건성, 프라이버시, 기계 윤리, 공정성, 적대적 시연

한국정보통신기술협회(TTA)가 운영하는 CAT(Certification of AI Trustworthiness)은 한국의 공식 AI 신뢰성 인증 제도다.

2026년 1월 시행된 인공지능 기본법은 에너지, 의료, 원자력, 교통, 교육 등 고영향(高影響) AI에 6가지 의무를 부과한다:

해외 빅테크 기업에도 국내 대리인 지정 의무가 적용되며, 한국 이용자에게 영향을 미치는 AI에 대해 역외 적용된다.

AI 감사 시장은 2023년 10억 달러에서 2033년 117억 달러로 연평균 27.9% 성장이 전망된다. 생성 AI 분야만 놓고 보면 2024년 1.1억 달러에서 2033년 27억 달러로 연평균 42.5% 성장이 예상된다.

Holistic AI, Credo AI, Arthur AI, ORCAA(Weapons of Math Destruction 저자 캐시 오닐 공동 창업) 등 전문 AI 감사 기업들이 활발히 활동하고 있다.

배포 후에도 지속적으로 편향과 성능 저하를 감시. AI Transparency Atlas(2024)는 실시간 모델 카드 평가 파이프라인을 구현

XTRUST 같은 다국어 벤치마크의 등장. Anthropic의 다문화 레드팀이 영어 중심 테스트의 사각지대를 발견

차분 프라이버시가 공정성을 저해하고, 공정성 최적화가 프라이버시를 약화시키는 트레이드오프. GuardianAI 등이 적응형 가우시안 노이즈로 해결 시도

OpenAI-Anthropic의 교차 안전 평가처럼, 경쟁사 간 상호 검증이 업계 표준으로 자리잡는 추세

AI 신뢰성 평가는 AI 발전을 멈추자는 것이 아니다. AI를 더 잘 만들자는 것이다.

비행기를 탈 때 우리는 항공기 안전 인증을 당연하게 여긴다. 약을 먹을 때 FDA 승인을 확인한다. 건물에 들어갈 때 내진 설계를 기대한다. AI도 마찬가지다. 우리 삶의 핵심 의사결정에 개입하는 기술이라면, 그 기술이 제대로 작동하는지 검증받는 것은 당연하다.

한국은 세계에서 두 번째로 포괄적인 AI 규제법을 시행했고, TTA CAT 인증 제도를 운영하고 있다. 이는 한국이 AI 강국으로서 기술 혁신과 사회적 신뢰 사이의 균형을 잡아가고 있다는 신호다.

"신뢰할 수 있는 AI는 더 좋은 AI다." — EU AI HLEG, 2019

이제 남은 질문은 "AI를 신뢰해야 하는가"가 아니다. "AI를 어떻게 신뢰할 수 있게 만들 것인가"다.