들어가며: AI 셰프의 화력 조절

요리를 생각해보자. 스테이크를 구울 때 불이 너무 약하면 고기가 질겨지고, 너무 강하면 겉은 타고 속은 안 익는다. 딱 맞는 온도를 찾아야 겉은 바삭하고 속은 촉촉한 완벽한 결과가 나온다. 그런데 소고기와 닭고기의 최적 온도가 다르고, 그릴과 오븐의 최적 온도가 다르다.

AI도 마찬가지다.

대규모 언어 모델(LLM)에는 Temperature라는 파라미터가 있다. 이 값을 낮추면 AI는 가장 확률 높은 답만 반복하고, 높이면 예상 밖의 창의적인(때로는 엉뚱한) 답을 내놓는다. ChatGPT에 같은 질문을 10번 하면 매번 조금씩 다른 답이 나오는 이유가 바로 이 Temperature 때문이다.

문제는 "최적 Temperature가 얼마인가?"라는 질문에 아직 좋은 답이 없었다는 것이다. OpenAI API의 기본값은 1.0이지만, 그것이 모든 모델, 모든 태스크에서 최선일까? 수학 문제를 풀 때와 창작 글을 쓸 때 같은 Temperature를 쓰는 게 맞을까?

2025년 ICML(세계 최고 권위의 머신러닝 학회)에서 카네기멜론 대학교(CMU)의 Weihua Du, Yiming Yang, Sean Welleck가 이 질문에 답하는 논문을 발표했다. TURN(Turning Point Temperature Selection) — 라벨 데이터 없이도 모델별 최적 Temperature를 자동으로 찾아내는 알고리즘이다.

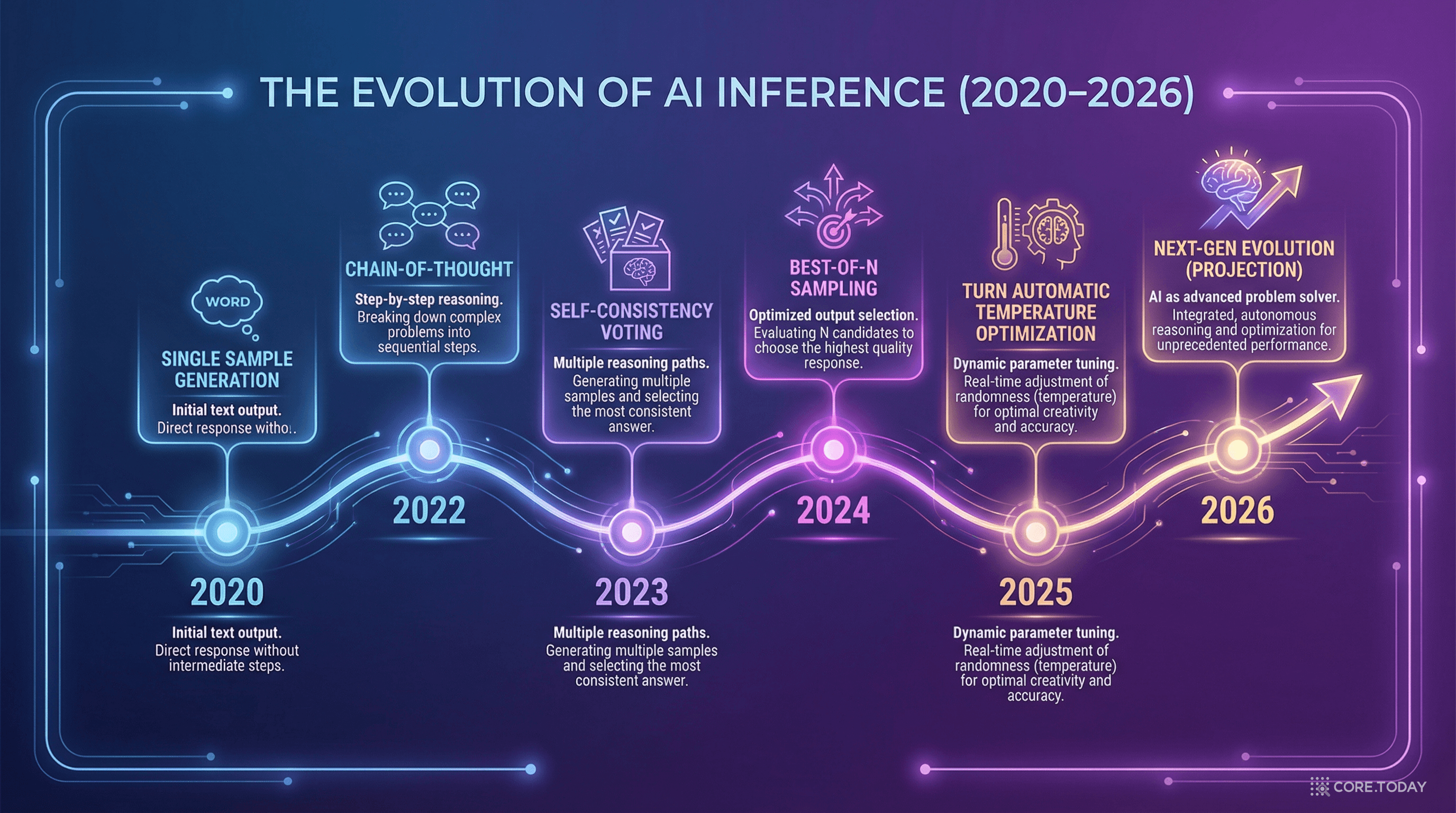

이 글에서는 Temperature가 무엇이고 왜 중요한지(제1장), 멀티샘플 추론이 무엇인지(제2장), 왜 Temperature 최적화가 어려운지(제3장), TURN이 발견한 핵심 현상인 엔트로피 전환점(제4장), TURN 알고리즘의 작동 원리(제5장), 실험 결과(제6장), 이론적 근거(제7장), 그리고 2026년 현재 이 기술이 어떻게 활용되고 있는지(제8장)까지 풀어본다.

제1장: Temperature란 무엇인가 — 확률 분포의 '온도계'

언어 모델이 다음 단어를 고르는 방법

언어 모델은 텍스트를 한 토큰씩 생성한다. "서울의 인구는"이라는 입력이 들어오면, 모델은 다음에 올 수 있는 모든 토큰의 점수(logit)를 계산한다. 이 점수를 확률로 변환하는 함수가 바로 소프트맥스(softmax)다:

P(yi∣y<i,X)=F(softmax(Tzi))

여기서 zi는 토큰 yi의 logit, T는 Temperature다. F는 Top-k, Top-p 같은 추가 필터링 함수다.

핵심은 나누기 T 부분이다. Temperature가 이 식에서 하는 역할을 직관적으로 이해해보자.

Temperature의 3가지 모드

Temperature가 확률 분포에 미치는 영향

T → 0 (극저온)

logit을 매우 크게 만듦 → 1등 토큰이 거의 100% 확률 → 항상 같은 답 (greedy decoding)

T = 1.0 (기본값)

원래 학습된 확률 분포 그대로 사용 → 자연스러운 다양성

T → ∞ (극고온)

모든 logit이 0에 수렴 → 균등 분포 → 완전 랜덤 (주사위 던지기)

구체적인 예를 들어보자. 모델이 "서울", "부산", "대전", "제주", "인천" 다섯 후보에 대해 logit [5.0, 3.0, 2.0, 1.5, 0.5]를 내놓았다고 하자.

위 시뮬레이터에서 직접 확인할 수 있듯이:

- T=0.1이면 "서울"이 99% 이상을 차지한다. 사실상 항상 "서울"만 출력된다.

- T=1.0이면 "서울"이 약 65%로 가장 높지만, "부산"이나 "대전"도 가끔 선택된다.

- T=2.0이면 확률이 비슷해져서 어떤 토큰이든 나올 수 있다.

왜 "딱 맞는 온도"가 중요한가

"그냥 T=1로 두면 되는 거 아닌가?" — 아니다. 상황에 따라 최적 Temperature가 극적으로 달라진다.

| 태스크 | 낮은 T가 유리 | 높은 T가 유리 |

|---|

| 코드 생성 | 정확한 문법, 로직 필요 | 다양한 풀이법 탐색 |

| 수학 풀이 | 정확한 계산 과정 필요 | 창의적 접근법 탐색 |

| 창작 글쓰기 | 진부한 표현만 반복 | 다채로운 표현, 독창적 전개 |

| 번역 | 원문에 충실한 번역 | 의역, 자연스러운 표현 |

여기에 모델 종류까지 더하면 문제는 더 복잡해진다. 같은 수학 문제라도 범용 모델(Llama)과 수학 특화 모델(Llemma)의 최적 Temperature가 다르다. 이 논문의 핵심 발견 중 하나다.

제2장: 멀티샘플 추론의 시대 — "여러 번 물어보면 더 똑똑해진다"

한 번 물어보기 vs 여러 번 물어보기

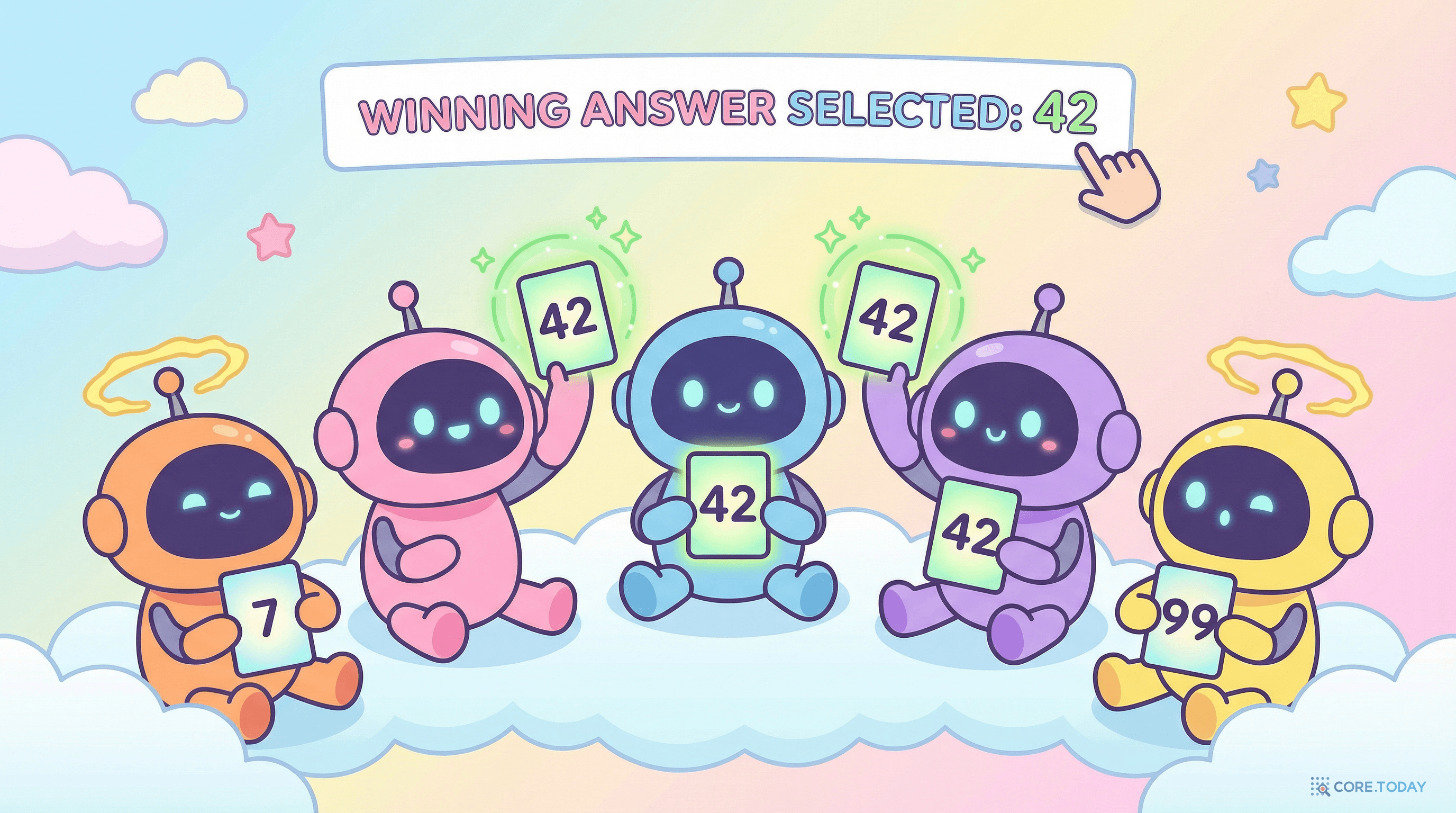

2022년, 구글 연구팀의 Self-Consistency 논문(Wang et al., 2022)이 간단하면서도 강력한 아이디어를 제시했다: 같은 질문을 여러 번 하고, 가장 많이 나온 답을 선택하자.

이것이 멀티샘플 추론(Multi-Sample Inference)의 핵심이다. 한 번 물어봐서 틀릴 수 있지만, 100번 물어보면 다수결로 더 정확한 답을 찾을 수 있다.

두 가지 핵심 전략

🗳️

Majority Voting (다수결 투표)

N개의 답변을 생성하고, 가장 많이 나온 답을 최종 답으로 선택한다. Self-Consistency라고도 불린다. 수학 문제처럼 정답이 명확한 태스크에 강력하다.

🏆

Best-of-N (N개 중 최고 선택)

N개의 답변을 생성하고, 보상 함수(reward model)로 점수를 매겨 가장 높은 점수의 답을 선택한다. 코드 생성처럼 유닛 테스트로 검증 가능한 태스크에 효과적이다.

수식으로 표현하면:

Majority Voting:

y^=argmaxy∈{Y1,...,YN}∑i=1NI(Yi=y)

Best-of-N:

y^=argmaxy∈{Y1,...,YN}G(y)

여기서 G(y)는 보상 함수다.

멀티샘플 추론과 Temperature의 관계

여기서 Temperature가 핵심적으로 작용한다. 직관적으로 생각해보자:

- Temperature가 너무 낮으면: 256번 물어봐도 거의 같은 답만 나온다. 투표해봤자 의미 없다. 다양성이 0이니까.

- Temperature가 너무 높으면: 256개의 답이 전부 다른데, 대부분이 쓸데없는 쓰레기다. 투표해봤자 맞는 답이 없다.

- Temperature가 딱 맞으면: 다양한 답이 나오되, 그중 상당수가 정답을 포함한다. 투표하면 정답이 다수를 차지한다.

T=0.1

256개 답 중 250개가 동일 → 다양성 부족 → 틀리면 전부 틀림

T=0.7

256개 답 중 180개 정답, 76개 오답 → 다수결로 정답 선택! 🎯

T=1.5

256개 답 중 50개 정답, 나머지 전부 다른 오답 → 정답이 묻힘

이것이 TURN 논문의 출발점이다: 멀티샘플 추론에서 Temperature는 '다양성'과 '품질' 사이의 균형을 결정하는 가장 중요한 파라미터다. 그런데 이 균형점을 찾는 체계적인 방법이 없었다.

제3장: 왜 Temperature 최적화가 어려운가 — 모델마다 다르고, 태스크마다 다르다

현실: "T=0.7이면 대충 괜찮다"의 문제

지금까지 업계의 관행은 단순했다. 대부분 모든 모델, 모든 태스크에 같은 Temperature를 사용했다. OpenAI o1 시스템 카드에는 T=1.0이 명시되어 있고, 많은 벤치마크에서 T=0.7이나 T=0.8이 관례적으로 쓰인다.

하지만 이것은 소고기든 생선이든 180°C 오븐에 넣는 것과 같다.

실험: 최적 Temperature는 정말 다를까?

TURN 논문의 저자들은 Mistral-7B의 세 가지 변형(사전학습, 지시학습, 태스크 파인튜닝)을 MATH 데이터셋에서 테스트했다. 결과는 놀라웠다.

Mistral-7B 변형별 최적 Temperature (MATH, 128샘플)

💡

핵심 발견: 태스크에 특화된 모델일수록 높은 Temperature가 최적이다. 범용 모델은 낮은 Temperature가 안전하다. 이유가 직관적이다: 태스크에 특화된 모델은 "올바른 토큰"을 이미 잘 알고 있기 때문에, Temperature를 올려도 품질이 잘 유지된다.

모델-태스크 거리: 핵심 통찰

저자들은 이 관계를 정량화했다. 모델-태스크 거리(Distance)를 토큰 수준 엔트로피의 평균으로 정의한다:

D(M,T)=k1∑i=1k[∣Yi∣1∑j=1∣Yi∣H(pM(⋅∣Xi,Yi,<j))]

여기서 H(p)=−∑v∈pp(v)logp(v)는 Shannon 엔트로피다.

결과: 13개 모델을 분석한 결과, 모델-태스크 거리와 최적 Temperature 사이에 강한 음의 상관관계가 나타났다:

| 데이터셋 | 상관계수 | 해석 |

|---|

| MATH | -0.895 | 매우 강한 음의 상관 |

| MBPP (코드) | -0.777 | 강한 음의 상관 |

음의 상관관계의 의미: 모델이 태스크에 가까울수록(거리가 작을수록) 최적 Temperature가 높다. 모델이 태스크에 멀수록(거리가 클수록) 최적 Temperature가 낮다.

이것은 실무에서 중요한 가이드라인을 제공한다:

🔍

실무 가이드라인

태스크 특화 파인튜닝 모델 → T = 0.9~1.1로 높게. 범용 지시학습 모델 → T = 0.5~0.7로 낮게. 사전학습 모델(raw) → T = 0.3~0.5로 더 낮게.

하지만 이것은 대략적인 가이드일 뿐이다. 모델마다, 태스크마다 최적값이 미묘하게 다르다. 각각에 대해 grid search를 하려면 엄청난 비용이 든다. 라벨 데이터 없이 자동으로 최적 Temperature를 찾을 수 있다면?

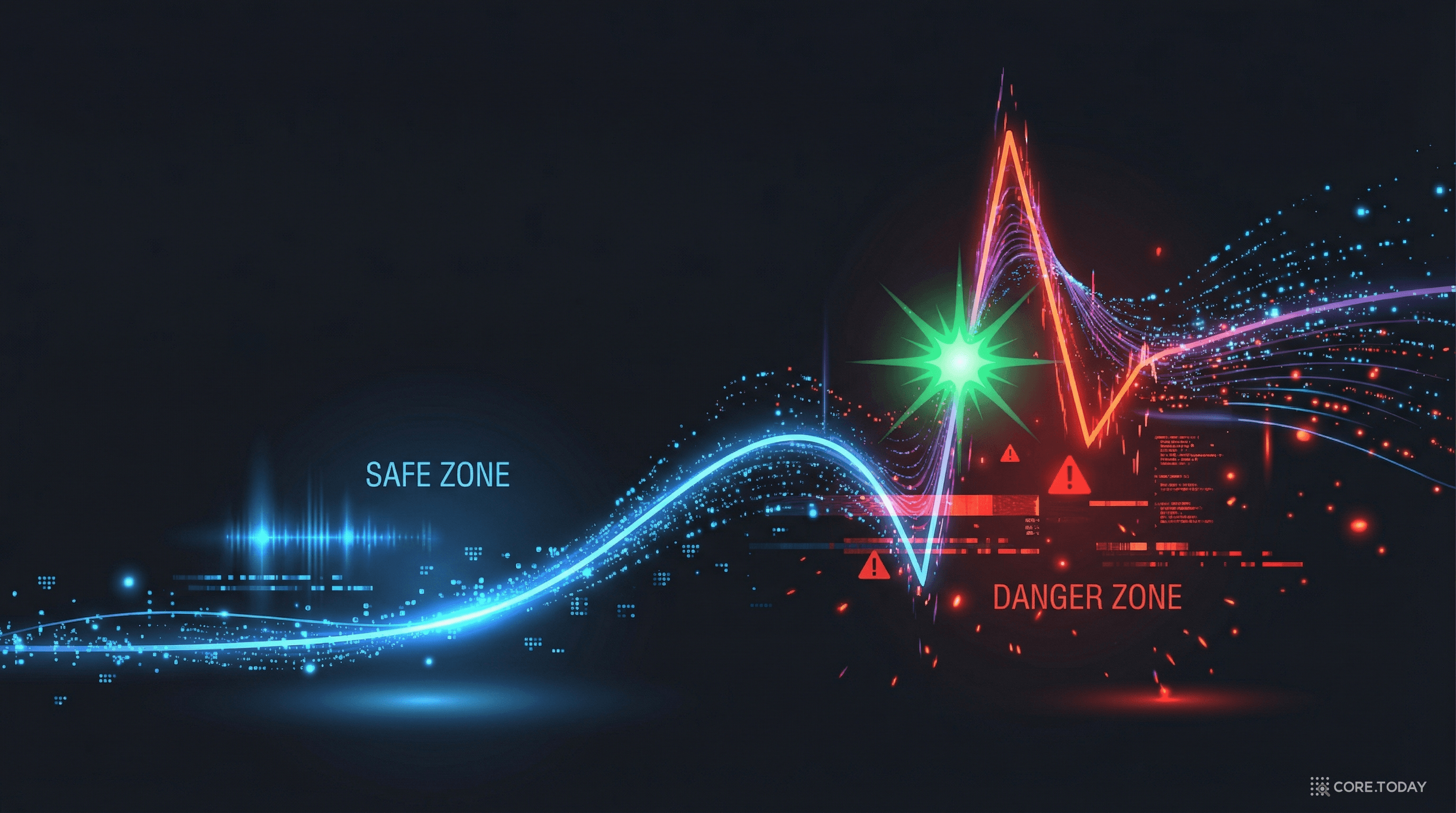

제4장: 엔트로피 전환점(EntP) — "이 온도를 넘으면 품질이 무너진다"

놀라운 발견: 엔트로피 스파이크

TURN 논문의 가장 핵심적인 발견은 엔트로피 스파이크(entropy spike) 현상이다.

Temperature를 0.1부터 점점 올리면서 모델의 토큰 수준 엔트로피를 측정하면, 놀라운 패턴이 나타난다:

- 낮은 Temperature (0.1~0.6): 엔트로피가 천천히, 완만하게 증가한다.

- 임계점 부근 (0.6~0.9): 엔트로피가 급격히 증가하기 시작한다.

- 높은 Temperature (0.9~1.5): 엔트로피가 폭발적으로 치솟는다.

로그 스케일로 보면 이 패턴이 더 선명해진다. log(H) 곡선은:

- 전환점 전: 오목(concave) — 완만한 증가

- 전환점 후: 볼록(convex) — 폭발적 증가

이 오목에서 볼록으로 바뀌는 지점을 엔트로피 전환점(Entropy Turning Point, EntP)이라 정의한다.

왜 이것이 중요한가: 품질 붕괴의 신호

엔트로피 스파이크는 단순한 수학적 현상이 아니다. 이것은 샘플 품질 붕괴(quality collapse)의 직접적 신호다.

저자들은 이것을 입증하기 위해 교묘한 실험을 설계했다. 만약 엔트로피 증가가 단순히 Temperature에 의한 확률 분포 평탄화 때문이라면, 고정된 텍스트(greedy decoding으로 생성)의 엔트로피도 비슷하게 높아져야 한다.

하지만 실험 결과, 고정 텍스트의 엔트로피(점선)와 실제 샘플링 텍스트의 엔트로피(실선) 사이에 큰 격차(gap)가 나타났다. 이것은 스파이크가 단순히 Temperature의 수학적 효과가 아니라, 모델의 다음 토큰 분포 자체가 변화했음을 의미한다.

🔴

품질 붕괴의 메커니즘

Temperature가 EntP를 넘어가면, 부적절한 토큰이 선택되기 시작한다. 한 번 잘못된 토큰이 들어가면 이후 생성도 연쇄적으로 나빠진다. 마치 도미노처럼 — 하나가 넘어지면 전체가 무너진다.

🟢

EntP의 실전적 의미

EntP 근처가 "다양성은 최대, 품질은 유지"되는 최적 지점이다. EntP보다 낮으면 다양성이 부족하고, EntP보다 높으면 품질이 급락한다. 이 균형점이 멀티샘플 추론에서 최적 Temperature다.

EntP와 실제 최적 Temperature의 상관관계

논문의 Figure 1(b)가 이것을 극적으로 보여준다. 13개 모델에 대해 EntP에서의 정확도와 grid search로 찾은 최고 정확도를 비교했더니:

- MATH 데이터셋: 상관계수 0.9998 (거의 완벽한 상관!)

- MBPP 데이터셋: 상관계수 0.9913

이것은 EntP가 최적 Temperature의 사실상 완벽한 대리 지표라는 뜻이다.

제5장: TURN 알고리즘 — 라벨 없이 최적 온도를 자동으로 찾다

알고리즘의 핵심 아이디어

TURN의 아이디어는 우아하게 단순하다:

"엔트로피 곡선의 로그를 취하고, 그 곡선이 오목에서 볼록으로 바뀌는 지점(EntP)을 찾으면, 그것이 최적 Temperature다."

라벨 데이터가 필요 없다. 정답을 몰라도 된다. 모델 자체의 엔트로피만으로 최적 Temperature를 예측할 수 있다.

TURN의 5단계

알고리즘을 단계별로 풀어보면:

Step 1

샘플 생성: 다양한 Temperature 값(0.1, 0.2, ..., 1.5)에서 각각 N개의 샘플을 생성하고, 각 토큰의 엔트로피를 계산한다.

Step 2

평균 엔트로피 계산: 각 Temperature에서의 평균 엔트로피 H(j)를 구한다.

Step 3

로그 변환: ℓ(j)=logH(j) — 로그를 취하면 오목/볼록 전환이 선명해진다.

Step 4

전환점 탐지: 이계도함수 dt2d2ℓ이 음에서 양으로 바뀌는 지점 j∗를 찾는다. t∗=j∗⋅t (간격).

Step 5

보정: 집계 방법에 따라 보정 계수 β를 더한다. Majority Voting: β=0, Best-of-N: β=+0.1.

알고리즘의 의사코드

hljs language-python

def TURN(model, task, t_interval=0.1, t_max=1.5, N=40, strategy="majority_voting"):

J = int(t_max / t_interval)

entropies = []

for j in range(J + 1):

T = j * t_interval

H_samples = []

for _ in range(N):

x = random.choice(task)

y = model.generate(x, T=T)

H = token_level_entropy(y)

H_samples.append(H)

entropies.append(mean(H_samples))

log_entropies = [log(h) for h in entropies]

j_star = find_inflection_point(log_entropies)

t_star = j_star * t_interval

beta = 0.0 if strategy == "majority_voting" else 0.1

return t_star + beta

왜 40개 샘플이면 충분한가

비용이 걱정될 수 있다. "각 Temperature마다 N개 샘플을 뽑아야 한다고? 비용 폭탄 아닌가?"

놀랍게도, N=40이면 충분하다.

| 샘플 수 (N) | 엔트로피 분산 | 예측 Temperature 분산 | 성능 손실 |

|---|

| 10 | 0.084 | 0.020 | 0.9% |

| 40 | 0.022 | 0.005 | 0.2% |

| 100 | 0.010 | 0.003 | 0.1% |

| 800 | 0.001 | 0.001 | 0.0% |

40개 샘플의 성능 손실은 0.2%에 불과하다. grid search(수백~수천 회 추론)와 비교하면 비용이 1/10 이하로 줄어든다.

제6장: 실험 결과 — "정말 작동하는가?"

실험 설정

저자들은 두 가지 시나리오에서 TURN을 검증했다:

- 수학 문제 풀이: MATH 데이터셋 200문항 + Majority Voting + 13개 모델

- 코드 생성: MBPP 데이터셋 100문항 + Best-of-N + 13개 모델

모든 실험에서 256개 샘플을 생성하여 집계했다.

핵심 결과 1: TURN의 적중률

TURN 적중률 (예측 Temperature가 최적 구간에 포함된 비율)

MATH (Majority Voting)

12/13 모델

MBPP (Best-of-N)

11/13 모델

핵심 결과 2: 모델별 상세 결과 (MATH + Majority Voting)

| 모델 | TURN 예측 | 최적 구간 | 성능 손실 |

|---|

| mistral-7b-sft | 0.9 | 0.5–1.5 | 0.75% |

| math-shepherd-mistral-7b-rl | 0.9 | 0.5–1.3 | 0% |

| Mistral-7B-v0.3 | 0.7 | 0.3–0.7 | 0.37% |

| llemma-7b | 0.7 | 0.3–0.7 | 0% |

| llemma-7b-sft-metamath-hf | 1.1 | 0.7–1.5 | 0% |

| Llama-3.1-8B | 0.6 | 0.5–0.7 | 0.5% |

| Llama-3.2-3B | 0.6 | 0.3 | 1% |

| OpenMath2-Llama3.1-8B | 0.8 | 0.5–1.1 | 0.25% |

핵심 결과 3: 고정 Temperature와의 비교

이것이 가장 의미 있는 비교다. "그냥 T=0.7로 통일하면 안 되나?"에 대한 답이다.

| 지표 | T=0.1 | T=0.3 | T=0.5 | T=0.7 | T=0.9 | T=1.1 | TURN |

|---|

| 합산 Temperature Gap ↓ | 6.4 | 3.8 | 1.7 | 0.6 | 1.1 | 2.4 | 0.25 |

| 평균 성능 손실 ↓ | 15.55% | 7.1% | 3.05% | 1.15% | 2.0% | 5.7% | 0.4% |

T=0.7이 그나마 가장 나은 고정 Temperature였지만, TURN은 그보다도 2.4배 낮은 Temperature Gap과 2.9배 낮은 성능 손실을 달성했다. 특히 어떤 고정 Temperature도 모든 데이터셋에서 동시에 최고 성능을 달성하지 못하지만, TURN은 양쪽 모두에서 우수했다.

제7장: 확률 과정 모델 — "왜 엔트로피가 갑자기 치솟을까?"

도미노 효과의 수학적 모델

저자들은 엔트로피 스파이크가 왜 발생하는지를 설명하기 위해 확률 과정(stochastic process) 모델을 도입했다. 이 모델은 놀라울 정도로 직관적이다.

모델의 핵심 아이디어

언어 모델이 토큰을 순차적으로 생성하는 과정을 이렇게 추상화한다:

가정 1

적절한 토큰 vs 부적절한 토큰: 전체 어휘(N0+N1)에서 적절한 토큰(N0)은 소수이고, 부적절한 토큰(N1)은 다수다. (N1=30000≫N0=10)

가정 2

오류의 전파: 부적절한 토큰이 한 번 선택되면, 이후 오류 확률이 $1 - (1-p)^\alpha로증가한다(\alpha > 1).올바른토큰이선택되면오류확률이p^\alpha$로 감소한다.

가정 3

Temperature와 초기 오류율의 관계: Temperature가 올라가면 초기 오류 확률 pinit이 증가한다. 적절한 토큰의 logit은 높고(N(0,σ02)), 부적절한 토큰의 logit은 균일하게 낮다(L1).

시뮬레이션 결과가 실제와 일치

이 단순한 모델(N0=10, N1=30000, α=2)로 시뮬레이션하면:

- 엔트로피 커브: 실제 LLM과 거의 동일한 모양이 나온다. 낮은 Temperature에서 완만하게 증가하다가, 특정 지점에서 급증한다.

- 부적절한 토큰 비율: EntP 이후 급격히 증가한다. EntP 전에는 거의 0%이던 부적절 토큰이, EntP 이후 빠르게 5%, 10%, 20%로 치솟는다.

🎯

핵심 메시지

EntP 전: Temperature를 올리면 적절한 토큰들 사이의 다양성이 증가한다 (좋은 일). EntP 후: Temperature를 올리면 부적절한 토큰이 선택되기 시작하고, 한 번 시작되면 연쇄적으로 악화된다 (나쁜 일). 따라서 EntP 근처가 "다양성 최대 + 품질 유지"의 최적 지점이다.

제8장: 2026년, Temperature 최적화의 현재와 미래

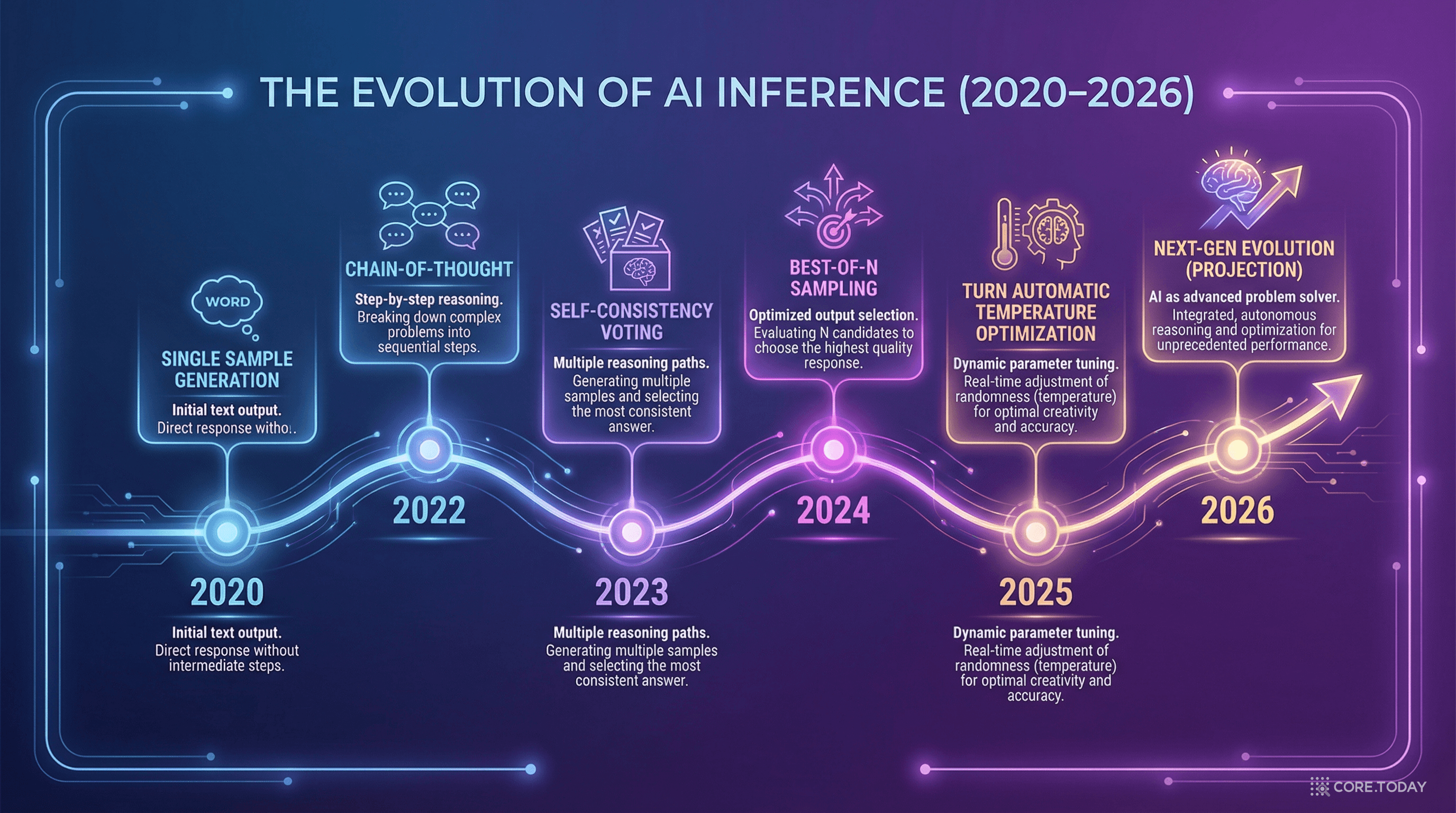

역사적 맥락: Temperature의 여정

Temperature라는 개념은 원래 통계 물리학에서 왔다. 볼츠만 분포에서 온도 T가 입자 에너지 분포를 결정하는 것과 정확히 같은 수학적 구조다. 신경망에 처음 도입된 것은 1980년대 Simulated Annealing과 Boltzmann Machine 시절이다.

1980s

Boltzmann Machine / Simulated Annealing: 통계물리의 Temperature 개념이 신경망에 도입. 높은 T로 시작해 서서히 낮추는 "어닐링" 기법.

2019

Top-k / Top-p (Holtzman et al.): Temperature 외에 Top-k, Top-p(nucleus) 샘플링 등 추가 필터링 방법 등장. "Neural Text Degeneration" 문제 제기.

2022

Self-Consistency (Wang et al.): 멀티샘플 + 다수결 투표로 추론 성능 대폭 향상. Temperature의 역할이 "단일 출력 품질"에서 "다양성-품질 균형"으로 전환.

2024

Test-Time Compute Scaling (Snell et al.): 추론 시 더 많은 연산을 투입하면 성능이 향상된다는 "추론 스케일링" 패러다임 확립. Temperature가 핵심 변수로 부상.

2025

TURN (Du et al., ICML 2025): 최초의 자동 Temperature 최적화 알고리즘. 라벨 데이터 없이 모델별 최적 Temperature를 예측. 엔트로피 전환점 발견.

2026년 현재: 추론 스케일링 시대의 Temperature

2026년 현재, AI 업계는 추론 시점 연산 스케일링(inference-time compute scaling)의 시대에 돌입했다. OpenAI의 o-시리즈, Google의 Gemini Thinking, Anthropic의 Claude의 확장된 사고 등 — 모두 "추론 시 더 많이 생각하면 더 좋은 답이 나온다"는 패러다임이다.

이 맥락에서 TURN의 기여가 빛난다:

2026년 추론 파이프라인에서 TURN의 위치

1. 모델 선택

태스크에 맞는 LLM 선택

2. TURN

모델-태스크에 최적화된 Temperature 자동 설정

3. 멀티샘플 생성

최적 T로 N개 후보 생성

4. 집계/검증

Majority Voting 또는 Best-of-N으로 최종 답 선택

실전 활용 시나리오

| 시나리오 | 기존 방식 | TURN 적용 |

|---|

| AI 코딩 어시스턴트 | T=0.7 고정. 간단한 코드는 OK, 복잡한 알고리즘은 실패율 높음 | 모델-태스크별 최적 T 자동 설정. 복잡한 문제일수록 T를 낮춰 정확도 ↑ |

| 수학 튜터 AI | T=1.0 고정. 기초 문제와 올림피아드 문제에 같은 설정 | 기초 문제는 높은 T (다양한 풀이법), 고난도는 낮은 T (정확한 논리) |

| LLM 벤치마크 평가 | 모든 모델에 T=0.7 적용. 일부 모델이 불리 | 모델별 최적 T로 공정한 비교. 각 모델의 진정한 능력 측정 |

| 프로덕션 API 서빙 | 사용자가 T를 수동으로 설정. 대부분 기본값 사용 | 요청별로 자동 최적화. 40개 프로브 샘플로 최적 T 예측 후 적용 |

미래 연구 방향

TURN이 열어놓은 길은 넓다:

- 동적 Temperature: 생성 도중에도 Temperature를 조절하는 방법. 수식 풀이의 전반부(탐색)는 높게, 후반부(계산)는 낮게.

- 더 큰 모델에서의 검증: 현재 7B~9B 모델에서 검증되었으나, 70B+ 모델에서도 동일하게 작동하는지.

- 다양한 태스크 확장: 수학, 코드 외에 추론, 요약, 번역 등 더 다양한 태스크.

- 추론 스케일링과의 통합: TURN + Chain-of-Thought + Self-Consistency의 최적 조합.

마무리: Temperature는 단순한 숫자가 아니다

이 논문이 우리에게 말하는 것은 명확하다:

Temperature는 "그냥 0.7로 두면 되는" 단순한 하이퍼파라미터가 아니다. 모델의 학습 이력, 태스크의 특성, 집계 전략에 따라 최적값이 달라지는 핵심 변수다.

그리고 TURN은 이 변수를 과학적으로, 자동으로, 효율적으로 최적화하는 첫 번째 방법을 제시했다. 라벨 데이터 없이, 40개 샘플만으로, 92% 이상의 적중률로.

2026년 현재, AI 시스템은 갈수록 복잡해지고 있다. 에이전트, 멀티모달, 추론 체인 — 이 모든 것의 기반에 "다음 토큰을 어떻게 뽑을 것인가"라는 근본적 질문이 있다. TURN은 그 질문에 대한 가장 과학적인 답 중 하나다.

마치 좋은 셰프가 재료와 조리법에 따라 불 세기를 조절하듯, 좋은 AI 시스템도 모델과 태스크에 따라 Temperature를 조절해야 한다. TURN은 그 조절을 자동으로 해주는 AI 셰프의 온도계다.

📖

논문 정보: Weihua Du, Yiming Yang, Sean Welleck. "Optimizing Temperature for Language Models with Multi-Sample Inference." ICML 2025 (42nd International Conference on Machine Learning).

arXiv:2502.05234 |

GitHub