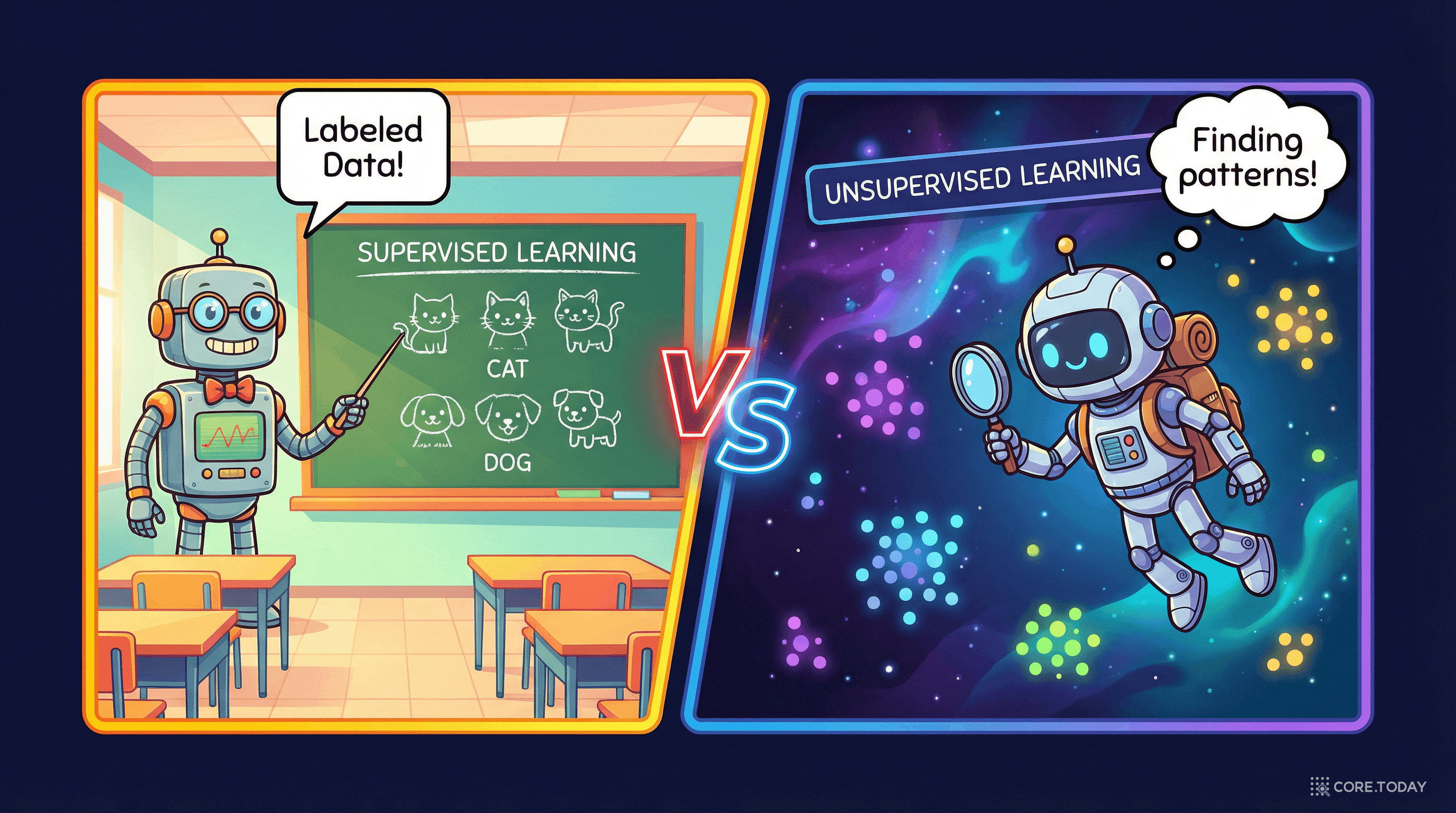

지도학습 vs 비지도학습: 라벨 하나가 만드는 완전히 다른 세계

정답지가 있으면 지도학습, 없으면 비지도학습? 그렇게 단순하지 않습니다. 역사와 사례와 코드로, ML의 두 큰 축을 제대로 이해합니다.

정답지가 있으면 지도학습, 없으면 비지도학습? 그렇게 단순하지 않습니다. 역사와 사례와 코드로, ML의 두 큰 축을 제대로 이해합니다.

머신러닝을 처음 배울 때 가장 먼저 만나는 분류가 있습니다:

"지도학습(Supervised Learning)이란 라벨이 있는 데이터로 학습하는 것이고, 비지도학습(Unsupervised Learning)이란 라벨이 없는 데이터로 학습하는 것이다."

맞는 말이지만, 이것만으로는 왜 이 구분이 중요한지, 실무에서 어떤 차이를 만드는지 전혀 감이 오지 않습니다. "라벨"이 뭐길래 있고 없고가 그렇게 큰 차이를 만드는 걸까요?

이 글에서는 교실과 정글이라는 비유를 따라가며, 역사와 논문과 실전 사례로 이 두 세계의 차이를 진짜로 이해해 봅시다.

본격적인 설명에 앞서, 라벨(Label)이 뭔지 확실히 짚고 갑시다. 라벨은 데이터에 붙은 정답 태그입니다.

라벨이 있는 데이터 (Labeled):

• 이메일 본문 → "스팸" 또는 "정상"

• 고양이 사진 → "고양이"

• 환자 검사 수치 → "당뇨" 또는 "정상"

• 집 정보(면적, 위치, 층수) → "매매가 5억"

라벨이 없는 데이터 (Unlabeled):

• 쇼핑몰 고객들의 구매 이력 → ???

• 수백만 개의 뉴스 기사 → ???

• 공장 센서 로그 → ???

• SNS 사용자 행동 데이터 → ???

라벨을 만드는 건 비싸고 느립니다. 의사가 X-ray 사진 10만 장에 하나하나 "폐렴", "정상"이라고 표시해야 한다고 상상해보세요. 전문가의 시간, 비용, 그리고 "정답이 애매한 경우"의 판단까지 — 라벨링은 ML 프로젝트에서 가장 큰 병목 중 하나입니다.

이것이 바로 비지도학습이 존재하는 이유입니다. 세상의 대부분의 데이터에는 라벨이 없으니까요.

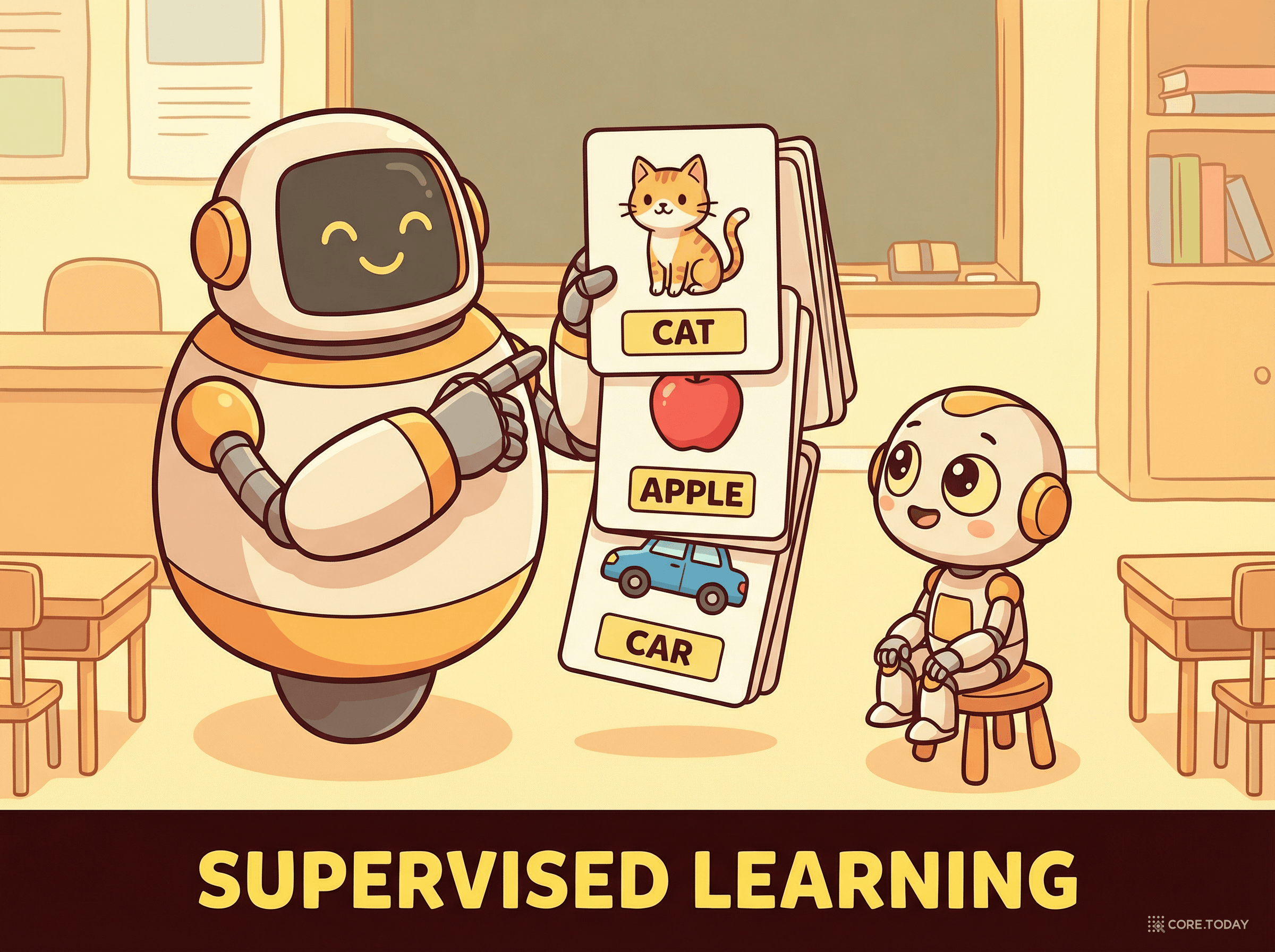

지도학습은 입력(X)과 정답(Y)의 쌍으로 학습합니다. 모델은 X를 보고 Y를 맞추는 함수를 배우는 것이죠.

입력(X) → 모델 → 예측(Ŷ)

고양이 사진 "고양이"

↕ 비교

정답(Y): "고양이" ✅

오차가 있으면 → 가중치 조정 → 다시 시도 (반복)

요리사 비유를 이어가면: 레시피(입력)와 완성된 요리 사진(정답)을 함께 주고, "이 레시피로 이 결과물을 만들어"라고 가르치는 것입니다. 학생은 자기가 만든 요리를 사진과 비교하며 점점 실력을 키웁니다.

지도학습은 크게 분류(Classification)와 회귀(Regression)로 나뉩니다:

지도학습의 역사는 통계학과 함께 시작됩니다:

* 바 길이는 절대적 성능이 아니라, 최근 실무에서의 활용 범위를 직관적으로 표현한 것입니다.

사례 1 — 이메일 스팸 필터

가장 고전적인 지도학습 사례입니다. 수만 개의 이메일에 "스팸/정상" 라벨을 붙이고, 나이브 베이즈(Naive Bayes)나 로지스틱 회귀로 학습시킵니다. 1998년 Sahami et al.의 논문 "A Bayesian Approach to Filtering Junk E-Mail"이 이 분야의 시초이며, 지금도 Gmail의 스팸 필터는 지도학습이 핵심입니다.

사례 2 — 의료 영상 진단

X-ray, CT, MRI 이미지에 전문의가 "폐렴", "종양", "정상" 등의 라벨을 붙이고 CNN으로 학습시킵니다. 2017년 CheXNet(Rajpurkar et al.)은 10만 장의 흉부 X-ray로 학습하여 14가지 흉부 질환 진단에서 전문의 수준을 달성했습니다.

사례 3 — 자율주행의 객체 인식

도로 이미지에서 "보행자", "차량", "신호등", "차선" 등을 라벨링한 데이터로 학습합니다. KITTI, nuScenes 같은 대규모 라벨 데이터셋이 이 분야의 발전을 이끌었고, 수십만 시간의 인간 라벨러 작업이 투입된 결과물입니다.

ImageNet 데이터셋(1,400만 장)의 라벨링에는 Amazon Mechanical Turk를 통해 약 25,000명의 작업자가 참여했습니다. 의료 데이터는 더 힘듭니다 — 흉부 X-ray 하나에 대한 라벨을 만들려면 영상의학과 전문의가 직접 봐야 합니다.

2024년 기준, 데이터 라벨링 시장 규모는 약 30억 달러에 이릅니다. Scale AI, Labelbox, Appen 같은 기업들이 라벨링 자동화와 품질 관리에 투자하고 있지만, 고품질 라벨은 여전히 비싸고 느립니다.

이 비용 문제가 바로 비지도학습과 자기지도학습이 각광받는 핵심 이유입니다.

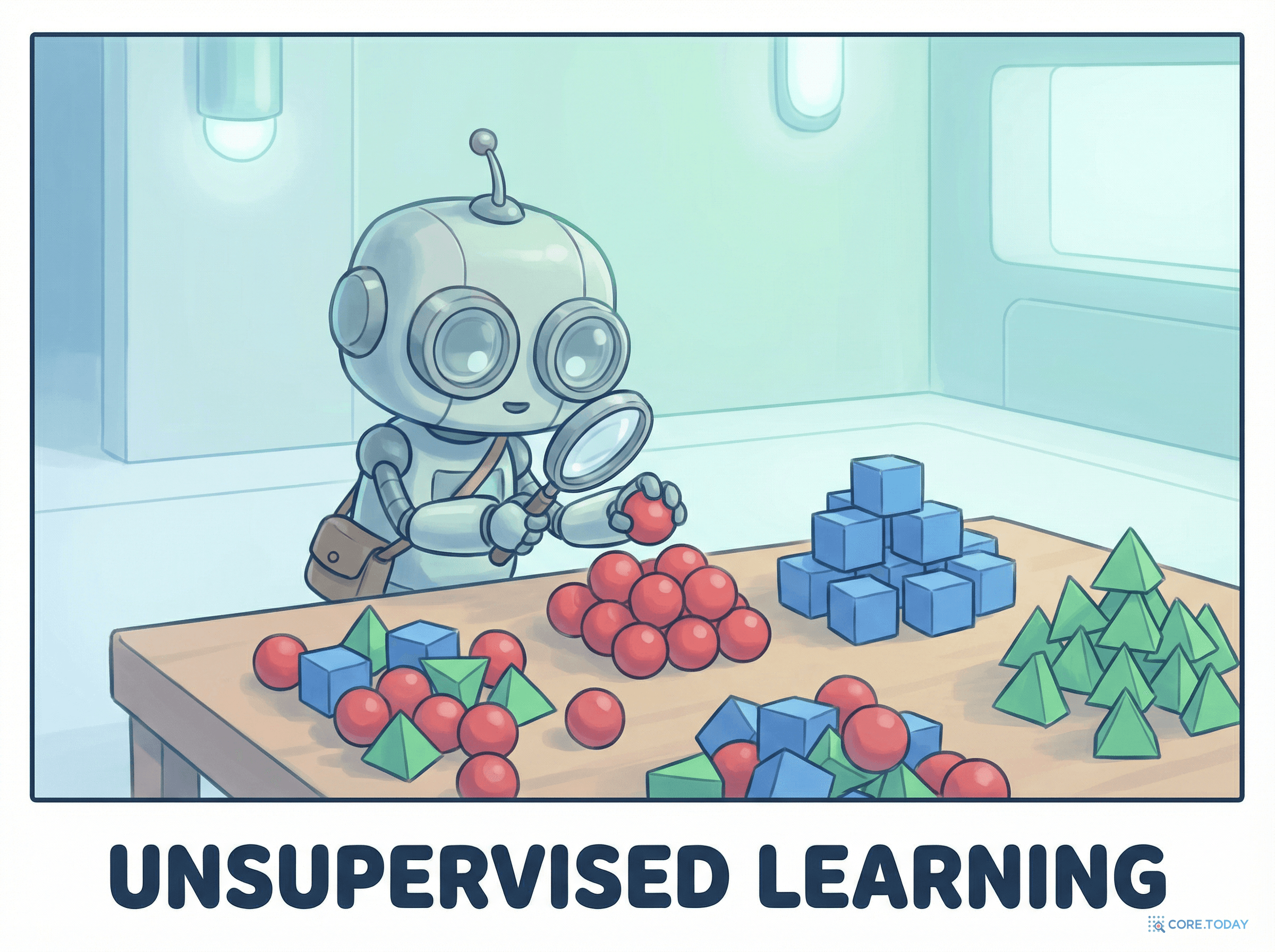

비지도학습은 라벨 없이 데이터의 숨겨진 구조와 패턴을 찾습니다. "정답"을 알려주지 않아도, 데이터 자체에서 의미 있는 정보를 추출하는 것이죠.

입력(X) → 모델 → 발견

고객 100만 명의 구매 이력 "5개 그룹으로 나뉘네!"

(정답 없이 스스로 발견)

비유하면: 아프리카 정글에 혼자 떨어진 탐험가입니다. 가이드(선생님)도 없고, 지도(라벨)도 없습니다. 하지만 주변을 관찰하며 "이 식물들은 비슷하네", "이 동물들은 항상 같이 다니네", "이 지역은 뭔가 이상하네"라는 패턴을 스스로 발견합니다.

| 알고리즘 | 태스크 | 핵심 아이디어 | 장점 |

|---|---|---|---|

| K-means | 군집화 | K개 중심점으로 그룹화 | 빠르고 직관적 |

| DBSCAN | 군집화 | 밀도 기반 그룹화 | 그룹 수 자동, 이상치 탐지 |

| 계층적 군집화 | 군집화 | 트리 구조로 점진적 병합 | 덴드로그램 시각화 |

| PCA | 차원 축소 | 분산 최대 방향 추출 | 빠르고 해석 가능 |

| t-SNE | 차원 축소 | 이웃 구조 보존 시각화 | 아름다운 시각화 |

| UMAP | 차원 축소 | 위상 구조 보존 | 빠르고 확장 가능 |

| Isolation Forest | 이상 탐지 | 고립 쉬운 점 = 이상치 | 대규모 데이터 적합 |

| 오토인코더 | 여러 가지 | 압축 → 복원 학습 | 딥러닝 기반 유연함 |

사례 1 — 넷플릭스의 고객 세분화

넷플릭스는 2억 명 이상의 가입자를 수천 개의 "취향 클러스터"로 분류합니다. "한국 드라마를 좋아하는 미국 20대", "다큐멘터리 마니아인 일본 40대" 같은 그룹이 자동으로 형성됩니다. 이 클러스터링은 라벨 없이, 순전히 시청 행동 패턴에서 도출됩니다. 그리고 이 그룹이 추천 시스템과 심지어 오리지널 콘텐츠 기획에까지 영향을 미칩니다.

사례 2 — 신용카드 이상 거래 탐지

"정상 거래"는 많지만 "사기 거래" 라벨은 극히 드뭅니다(전체의 0.1% 미만). 이런 극단적 불균형 상황에서는 비지도학습 기반 이상 탐지가 효과적입니다. Isolation Forest나 오토인코더로 "정상 패턴"을 학습한 뒤, 거기서 벗어나는 거래를 자동으로 플래그합니다.

사례 3 — 유전체학의 유전자 발현 분석

수만 개의 유전자 발현 데이터를 PCA와 클러스터링으로 분석하면, 비슷한 발현 패턴을 보이는 유전자 그룹을 발견할 수 있습니다. 2002년 논문 "Molecular Classification of Cancer"(Golub et al.)는 유전자 발현 클러스터링만으로 백혈병의 아형을 구분할 수 있음을 보여줬고, 정밀 의학의 문을 열었습니다.

사례 4 — 자연어 처리의 Word2Vec

2013년 미콜로프(Mikolov et al.)의 Word2Vec은 비지도학습의 아름다운 예시입니다. 라벨 없이 대량의 텍스트만 주었는데, 모델이 스스로 "왕 - 남자 + 여자 = 여왕"이라는 의미적 관계를 학습합니다. 단어의 의미를 벡터 공간에 배치하는 이 발견은 이후 모든 NLP 발전의 토대가 됩니다.

같은 쇼핑몰 데이터가 있다고 합시다. 어떤 질문을 하느냐에 따라 접근법이 완전히 달라집니다:

지도학습으로 풀 수 있는 질문:

• "이 고객은 이탈할까, 남을까?" → 분류 (과거 이탈/유지 라벨 필요)

• "이 상품은 얼마에 팔릴까?" → 회귀 (과거 판매가 데이터 필요)

• "이 리뷰는 긍정일까, 부정일까?" → 분류 (라벨링된 리뷰 필요)

비지도학습으로 풀 수 있는 질문:

• "우리 고객은 몇 가지 유형으로 나뉠까?" → 군집화 (라벨 불필요)

• "어떤 상품들이 같이 팔릴까?" → 연관 규칙 (라벨 불필요)

• "이 거래는 비정상인가?" → 이상 탐지 (라벨 불필요)

현실은 "지도 vs 비지도"의 이분법보다 복잡합니다. 그 사이를 채우는 중요한 학습 방식들이 있습니다.

라벨이 있는 데이터 소량 + 라벨이 없는 데이터 대량을 함께 사용합니다.

현실에서 가장 흔한 상황입니다. 의료 이미지 100만 장이 있는데, 전문의가 라벨을 붙인 건 1,000장뿐인 경우. 반지도학습은 소량의 라벨 데이터로 대략적인 패턴을 잡고, 대량의 비라벨 데이터로 그 패턴을 보강합니다.

2013년 논문 "Pseudo-Label: The Simple and Efficient Semi-Supervised Learning Method"(Lee)은 모델이 비라벨 데이터에 스스로 "가짜 라벨"을 붙이고 이를 활용하는 간단하면서도 강력한 방법을 제시합니다.

자기지도학습은 데이터 자체에서 라벨을 만들어냅니다. 사람이 라벨을 안 붙여도, 데이터의 구조를 활용해 스스로 학습 과제를 만드는 것이죠.

자기지도학습이 2026년 AI의 핵심 패러다임이 된 이유는 간단합니다:

GPT, BERT, Claude, Gemini — 2026년을 정의하는 거의 모든 파운데이션 모델이 자기지도학습으로 사전학습됩니다. 얀 르쿤(Yann LeCun)은 자기지도학습을 "AI의 다크 매터"라고 부르며, 이것이 인간 수준 AI를 향한 열쇠라고 주장합니다.

강화학습(Reinforcement Learning)은 지도/비지도 어디에도 깔끔하게 들어맞지 않는 제3의 패러다임입니다.

에이전트가 환경과 상호작용하며 보상을 최대화하는 행동을 학습합니다. AlphaGo, 로봇 제어, ChatGPT의 RLHF(인간 피드백 기반 강화학습)가 대표적입니다.

ML의 학습 패러다임을 완전히 정리하면:

| 패러다임 | 피드백 | 예시 |

|---|---|---|

| 지도학습 | 정답 라벨 | 스팸 분류, 이미지 인식 |

| 비지도학습 | 없음 | 클러스터링, 차원 축소 |

| 자기지도학습 | 데이터에서 자동 생성 | BERT, GPT |

| 강화학습 | 보상/벌점 | AlphaGo, RLHF |

하지만 실무에서는 이 흐름이 순차적이 아니라 순환적입니다:

비지도학습은 종종 지도학습의 전처리 단계입니다. PCA로 차원을 줄인 뒤 분류 모델을 학습시키거나, 클러스터링으로 데이터를 탐색한 뒤 라벨링 전략을 세우는 것이 흔한 패턴입니다.

2026년 현재, 가장 강력한 AI 모델들은 자기지도학습으로 사전학습 → 지도학습으로 미세조정하는 2단계 패턴을 따릅니다.

GPT, Claude, Gemini 모두 이 패턴입니다. 결국 지도학습과 비지도학습은 대립이 아니라, 하나의 파이프라인 안에서 각자의 역할을 수행하고 있는 것이죠.

자기지도학습의 발전으로 "라벨 없이도 엄청난 성능"이 가능해졌지만, 라벨은 여전히 중요합니다. 특히:

비지도학습은 "어떤 질문을 해야 할지 모를 때"의 도구이고, 지도학습은 "어떤 답을 원하는지 알 때"의 도구입니다.

실무 프로젝트의 흐름은 대개 이렇습니다:

세상의 데이터 대부분에는 라벨이 없습니다. 사람이 라벨을 붙이는 건 비싸고 느립니다. 이 현실적 제약이 비지도학습과 자기지도학습을 탄생시켰고, 결국 GPT와 Claude 같은 파운데이션 모델의 시대를 열었습니다.

하지만 지도학습이 구식이 된 건 아닙니다. 파운데이션 모델도 결국 특정 태스크에 적용될 때는 라벨 데이터로 미세조정됩니다. 의료 진단, 자율주행, 사기 탐지 — 정확성이 생명인 분야에서 지도학습은 여전히 핵심입니다.

좋은 ML 엔지니어는 이 도구들을 상황에 맞게 조합합니다. 데이터에 라벨이 있으면 지도학습, 없으면 비지도학습, 그리고 가능하다면 자기지도학습으로 사전학습된 모델을 활용하는 것. 결국 "어떤 데이터가 있고, 어떤 질문에 답하고 싶은가?"가 모든 선택의 출발점입니다.