Palantir 후속 특집 — 2026, 엔지니어들이 거울을 들여다보기 시작했다

Pretti 간호사의 죽음, 미납(Minab) 초등학교에 떨어진 미사일, CEO가 스스로 공개한 매니페스토. 2026년 Palantir 내부에서 벌어지는 윤리적 반란은 한 회사의 위기가 아니라 AI 시대 테크 노동자 전체가 직면한 질문이다. '나는 지금 빌런이 되고 있는가?' — Wired 보도를 기점으로 터져나온 이 질문을, 1차 자료 중심으로 풀어낸다.

Pretti 간호사의 죽음, 미납(Minab) 초등학교에 떨어진 미사일, CEO가 스스로 공개한 매니페스토. 2026년 Palantir 내부에서 벌어지는 윤리적 반란은 한 회사의 위기가 아니라 AI 시대 테크 노동자 전체가 직면한 질문이다. '나는 지금 빌런이 되고 있는가?' — Wired 보도를 기점으로 터져나온 이 질문을, 1차 자료 중심으로 풀어낸다.

2026년 1월 말, 한 기술 전문 매체의 기사 제목은 그대로 밈이 됐다. "Palantir Employees Are Starting to Wonder if They're the Bad Guys"(Wired). 회사 슬랙에서 한 엔지니어가 남긴 문장이 그 질문을 요약했다. "내 생각엔 ICE는 악당이다. 내가 이 회사에서 일한다는 사실이 자랑스럽지 않다." (Futurism)

같은 문장에 "+1" 이모지 반응이 수십 개 달렸다. 이것은 변두리의 반체제 정서가 아니라, 회사의 중심부에서 번진 감정이다. 불과 몇 주 뒤 — Alex Pretti 간호사의 죽음, Minab(미납) 초등학교에 떨어진 토마호크, CEO Alex Karp의 매니페스토와 정치 권력 발언 — 이 연이어 터지면서, Palantir 내부의 윤리적 의심은 더 이상 조용한 슬랙 메시지로 머물지 않게 됐다.

이 글은 앞서 발행한 Palantir 완전 해부 — Ontology, Foundry, AIP 특집의 후속편이다. 기술 구조를 설명한 1편과 달리, 이번 2편은 2026년 상반기에 벌어진 일들과 그것이 테크 산업 전체에 던지는 윤리적 질문을 다룬다. 핵심 사건을 시간 순서대로, 1차 자료 위주로 정리한다.

2025년 12월, ICE와 CBP(관세국경보호청)는 Operation Metro Surge를 시작해 미네소타 일대에서 3,000건 이상의 체포를 집행했다. 영장 없는 체포, 시위대와의 충돌, 미국 시민의 구금, 그리고 총격 사건들이 연이어 보도됐다(Wikipedia: Killing of Alex Pretti).

Alex Pretti(37세)는 미 보훈부 소속 ICU 간호사였다. 2026년 1월 24일, 미니애폴리스에서 그는 CBP 요원 두 명의 총격을 받고 사망했다. 로이터가 검증한 시민 영상에 따르면 Pretti는 총이 아니라 휴대폰을 손에 들고 있었고, 요원들에게 밀린 다른 시위대를 돕다가 총격을 받았다(Al Jazeera, NBC News, Democracy Now!).

Pretti 사망 직후, Palantir의 전사 슬랙 채널은 직원들의 질문으로 채워졌다. Futurism과 Wired의 보도, Fortune 후속 보도를 종합하면 내부 분위기는 세 갈래였다.

| 질문의 유형 | 대표 표현 (보도 인용) |

|---|---|

| 정보 공개 요구 | "트럼프 2기 동안 ICE와의 협력 구조가 너무 숨겨져 있다. 우리는 이해할 필요가 있다." |

| 윤리적 거부 | "내 생각엔 ICE는 악당이다. 자랑스럽지 않다." |

| 회사 레버리지 질문 | "Palantir가 ICE에 어떤 형태로든 압력을 넣을 수 있는가?" |

출처: Futurism, Fortune, BizTech Weekly.

2026년 1월 말~2월 초, Palantir는 내부 슬랙 메시지의 7일 자동 삭제 정책을 도입했다. 공식 사유는 "정보 유출 방지"였지만, 공교롭게도 Pretti 사건 이후의 내부 논쟁이 정점에 달하던 시점이었다는 점에서 직원들은 이 조치를 "입막음으로 읽었다"고 여러 보도가 전한다(Futurism).

이어 회사의 Civil Liberties 팀이 사내 위키를 업데이트해 ICE 협력을 옹호하는 문서를 올렸다. 핵심 논지는 "우리 기술은 위험을 완화하고 목표지향적 결과를 가능하게 한다"는 것. 흥미로운 점은 이 문서가 ICE의 인종 프로파일링·시민 오체포에 대한 보도를 명시적으로 인지하면서도, "평판 리스크를 감수하더라도 계속한다"는 결론으로 닫혔다는 것이다(Futurism).

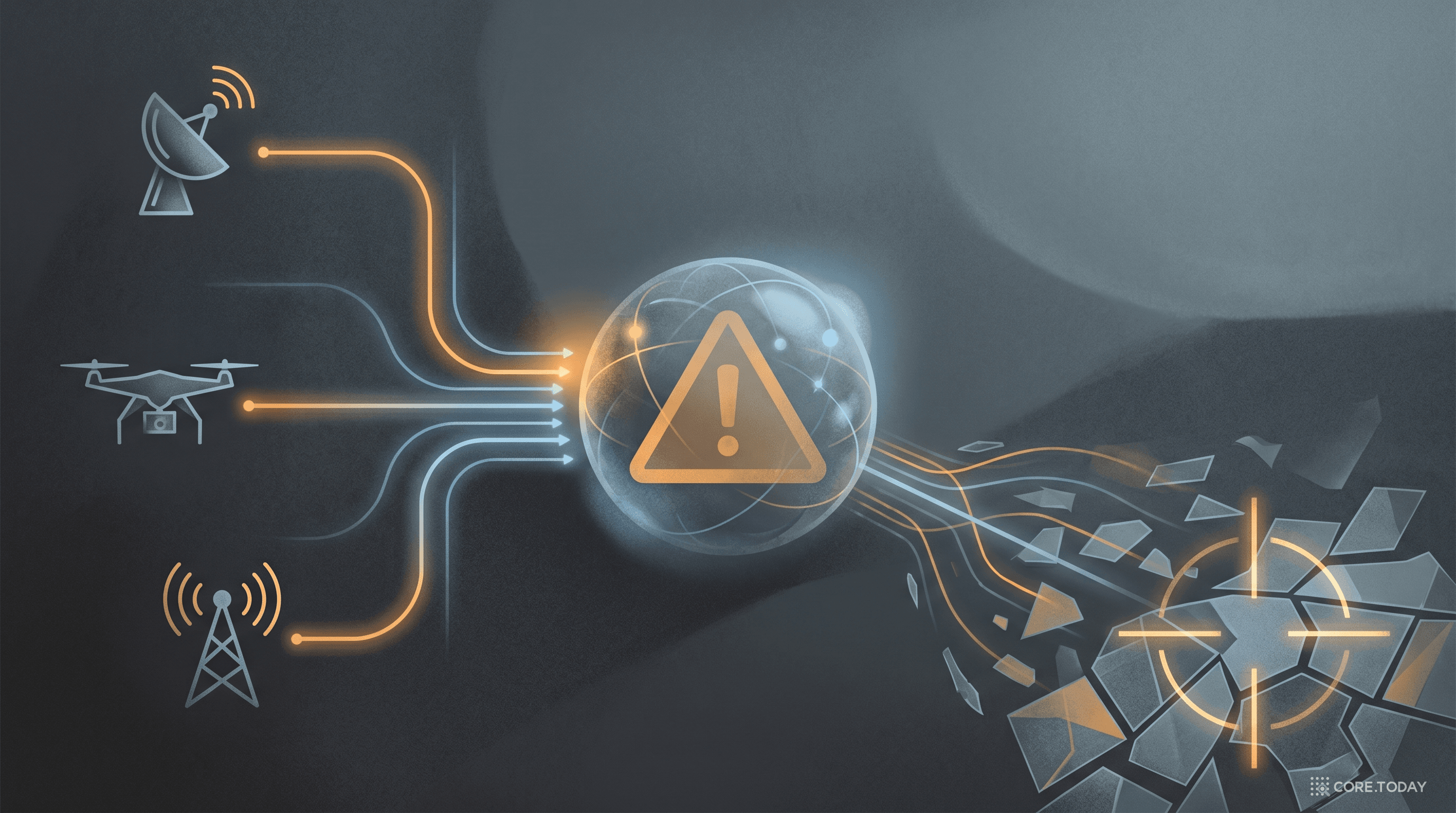

2026년 1월 15일, EFF(전자프런티어재단)는 Palantir의 ELITE(Enhanced Leads Identification & Targeting for Enforcement) 도구가 HHS(보건복지부) Medicaid 데이터를 끌어 쓴다는 보도를 냈다(EFF). 도구의 작동 방식은 대략 이렇다.

출처: State of Surveillance, Congressman Goldman 공개서한.

ELITE가 표적 식별이라면, ImmigrationOS(2025년 4월 계약, 약 $3,000만 규모)는 체포·구금·추방의 전 생애주기를 조율한다. 트럼프 행정부가 공표한 대규모 추방 의제를 위해 자진 출국 실시간 가시성, 체포·기소 우선순위 자동화, 이민 기록·전과·소속 이력에 기반한 타게팅을 한 플랫폼에서 처리한다는 목적이다(American Immigration Council, CorpWatch).

1편에서 본 Palantir Ontology의 구조로 해석하면, ImmigrationOS는 이민자라는 객체(Object Type)와 체포·이송·출국(Action Type)을 하나의 의미 모델로 묶어 움직인다. 기술 관점의 우아함과 인권 관점의 위험은 같은 구조에서 온다.

2026년 2월 초, Karp는 사내 AMA(Ask-Me-Anything) 세션을 열었다. 앞서 ICE 질문이 쏟아지던 슬랙을 의식한 자리였다. 복수 매체의 보도에 따르면 Karp는 처음 약 40분 동안 ICE·DHS 이슈를 직접 거론하지 않고 서구 권력 구조와 Palantir의 사명에 대한 총론으로 시간을 보냈다(Futurism, DNYUZ: Karp Video).

질의응답이 시작되자 직원들이 던진 질문은 구체적이고 실무적이었다.

ICE 프로젝트에 참여했던 한 엔지니어의 답은 기술자의 정직함과 함께 심각한 고백이었다. "지금 상태에서 악의적 고객을 사전에 완전히 막을 방법은 없다." 통제 수단은 사후 감사와 법적 대응뿐이라는 설명이었다(Futurism).

Ontology Dynamic Layer에 정책을 코드화한다는 설계 철학 — 1편에서 다룬 바로 그 개념 — 이 고객의 권한·의지 앞에서 한계를 드러내는 순간이다.

2026년 2월 28일 오전, 이란 호르모즈간 주 Minab의 한 여자 초등학교에 미사일이 떨어졌다. 위키피디아 정리 기준 민간인 156명 사망, 그중 어린이 120명. Operation Epic Fury라 명명된 미국 군사 작전의 일부였다(Wikipedia: 2026 Minab school attack, TIME).

Washington Post, NBC News, Military Times, Democracy Now!가 각기 확인한 바에 따르면, Operation Epic Fury의 타깃 리스트 생성·검토 프로세스에는 Palantir의 Maven Smart System(국방부와 체결한 약 13억 달러 규모 계약)이 활용됐다(Washington Post, Democracy Now!, Military Times).

Semafor의 후속 보도는 "AI가 아니라 사람이 문제였다"고 전했다. 구체적으로는 "학교 건물로 표시된 대상이 몇 년 전 군사시설로 분류된 오래된 인텔을 타고 들어와 현재 타깃 리스트에 남았다"는 분석(Semafor, NBC News). 즉, 표적 결정의 실패는 데이터 노후화와 인적 검증의 부실이며, Maven은 그 속도를 극적으로 가속시킨 촉매에 가깝다는 주장이다.

Minab 이후 사내 분위기는 바뀌었다. BizTech Weekly와 Futurism 보도에 따르면 엔지니어들은 두 가지 질문을 제기했다.

기술자들이 가장 두려워하는 것은 "책임의 분산(diffusion of responsibility)"이다. 수천 명의 분석관, 수십 개의 시스템, 여러 지휘체계가 만드는 타깃 리스트에서 — "누구도 아무것도 결정하지 않았지만 결과는 일어났다"는 구조는 AI가 가속할수록 위험해진다.

Military Times의 표현대로, Minab은 "Pentagon의 AI 타게팅 추진에 드리운 그림자"가 됐다.

Minab 사건이 정리되기 전인 3월, Karp는 또 다른 논란을 만들었다. 한 공개 인터뷰와 후속 기고에서 그는 "AI 기술이 고학력, 주로 여성이며 민주당을 지지하는 유권자의 정치적 영향력을 약화시키고, 직업교육을 받은 노동계급, 주로 남성 유권자의 영향력을 높일 것"이라고 말한 것으로 전해졌다(The New Republic).

Palantir 직원들 사이에서 이 발언은 "회사의 기술을 특정 정치 진영에 유리한 무기로 포지셔닝한다"는 해석을 낳았다. 엔지니어가 자기 업무의 중립성을 잃는 순간, 실무적 반발은 윤리적 반발로 전환된다.

New Republic의 기사 제목은 단도직입이었다. "Palantir CEO Makes Shocking Confession on Disrupting Democratic Power."

4월 19일, Palantir 공식 계정은 Karp와 대외담당 Nicholas Zamiska 공저 The Technological Republic에서 추린 22개조 매니페스토를 공개했다. 주요 논지 요약:

| 매니페스토 주장 (요약) | 쟁점 |

|---|---|

| 서구가 "하드 파워"를 재건해야 한다 | 국방·군사 프로젝트 확장 정당화 |

| 실리콘밸리가 국가안보에 "도덕적 부채(moral debt)"가 있다 | 테크 인재의 방산 참여 촉구 |

| 일부 문화는 "진보", 일부는 "기능장애·퇴행" | 문명 서열화 — 비평가들이 "supremacist" 표현이라 지적 |

| 보편 국민 복무(National Service) 제안 | 징병 재도입 토론 촉발 |

| DEI·"공허한 다원주의" 배격 | 포용성 정책에 대한 공개적 반대 |

출처: Fortune, Al Jazeera 1, Al Jazeera 2, TechCrunch, Euronews, Newsweek.

같은 주, Palantir 사옥 앞에서 시민들이 "die-in"(죽은 척 눕는 시위)을 벌이며 "Palantir: ICE and war enabler and profiteer"라는 문구의 팻말을 들었다(Fortune).

내부에서는 실무적 우려가 번졌다. 해외 고객들(특히 유럽·아시아의 민간 기업)은 CEO의 매니페스토적 태도를 회사 전체의 태도로 읽는다. "이런 글이 올라올 때마다 해외 세일즈가 어려워진다"는 내부 증언이 여러 매체에 인용됐다(Futurism, Fortune).

매니페스토에 대한 Karp의 공개적 입장은 일관된다. 여러 매체에 인용된 발언의 요지는 이것이다.

"잃을 직원 한 명도 없는 입장은 진짜 입장이 아니다(A position that doesn't risk losing employees isn't a real position)."

즉, 직원 이탈은 감수할 비용이라는 선언이다. Palantir의 채용 지침에도 "우리는 여러 신념이 공존하는 조직이며, 복잡한 문제에 대한 격렬한 내부 토론을 자랑스럽게 여긴다"는 취지의 입장이 붙어 있다.

두 가지를 구분해야 한다.

Wired 보도가 전한 복수의 전직 직원 인터뷰의 공통점은 "의견이 달라도 방향이 바뀌지 않는다는 감각이 새로 생겼다"는 것이다. 토론은 허용되지만 결정은 이미 내려져 있다는 체감.

Palantir는 2003년, 9/11 이후의 미국적 합의 속에서 태어났다. "해외에서 테러를 막는 것이 우선이다, 그 과정에서 데이터 기술은 애국적 도구가 될 수 있다" — 이것이 20년간 회사의 정체성 기반이었다. 한 전직 직원이 여러 매체에서 반복한 문장이 있다.

"9/11 이후 우리가 배운 것은, 안보를 강화하되 시민의 자유를 침해하지 않는다는 것이었다. 그런데 지금의 위협은 내부에서 오고 있다. 원래 우리는 그런 남용을 막는 방벽이어야 했는데, 지금은 남용을 가능케 하는 기반처럼 보인다."

이 문장이 Palantir 내부 균열의 핵심이다. 기술 자체의 문제가 아니라, 기술이 복무하는 정치 구조가 바뀌었을 때 회사가 원래의 사회계약을 유지하는가라는 질문이다.

Palantir 사건이 던지는 보편적 질문은 이것이다. "AI 시대, 엔지니어 한 명의 양심이 시스템의 안전장치로 제도화될 수 있는가?" 1편에서 다룬 Ontology의 Dynamic Layer가 지적 구조로는 답을 갖고 있지만, 고객사가 악의적 의도를 가지면 그 레이어도 우회된다는 점을 이번 사건이 보여줬다.

이 다섯 가지는 Palantir만의 과제가 아니다. 한국의 대형 SI, 공공 AI 공급사, 군·경 협력 스타트업에 모두 바로 적용 가능한 체크리스트다.

| 층위 | 기술적 장치 | 조직적 장치 |

|---|---|---|

| 설계 | Action Type마다 목적·합법성·철회 가능성 선언 | 제안서·RFP 단계의 윤리 검토 위원회 |

| 실행 | 모든 AI 호출의 감사 로그 불변 저장 | 실무 엔지니어의 "no-go" 거부권 |

| 사후 | 3자 감사 가능한 로그 인터페이스 | 내부 고발자 보호 + 대외 투명성 보고서 |

Palantir 내부의 혼란은 어떻게 보면 건강한 신호이기도 하다. 질문이 사라진 조직이 더 무섭다. 위험한 건 "우리가 악당인가?"라는 질문 자체가 아니라, 그 질문이 반복되는데도 시스템이 바뀌지 않는 상황이다.

2026년 상반기, 테크 산업 전체는 거울을 들여다보게 됐다. LLM은 Opus 4.7까지 왔고, Ontology는 의사결정을 자동화하고, AI 타게팅은 전쟁의 킬 체인을 가속한다. 이 모든 속도는 윤리적 판단의 속도를 넘어섰다.

결국 남는 것은 개별 엔지니어, 개별 회사, 개별 사회의 선택이다. 한국 기술자들에게도 같은 질문이 와 있다.

"우리의 기술이 누구에게, 어떤 규칙 아래, 어떤 위험을 만드는가?"

"그 위험을 되돌릴 수 있는 장치를 우리가 지금 만들고 있는가?"

이 질문을 실제 시스템 안에 코드로 선언하는 조직이, AI 시대의 다음 10년을 정의할 것이다.

원사건 보도

Alex Pretti 사건

ELITE / ImmigrationOS

Minab 초등학교 / Maven

매니페스토 · Karp 발언

Palantir 공식 입장

코어닷투데이 1편