프롤로그: 1조 원 매출 물류 회사의 송장 처리실 — 인원 7명에서 2명으로

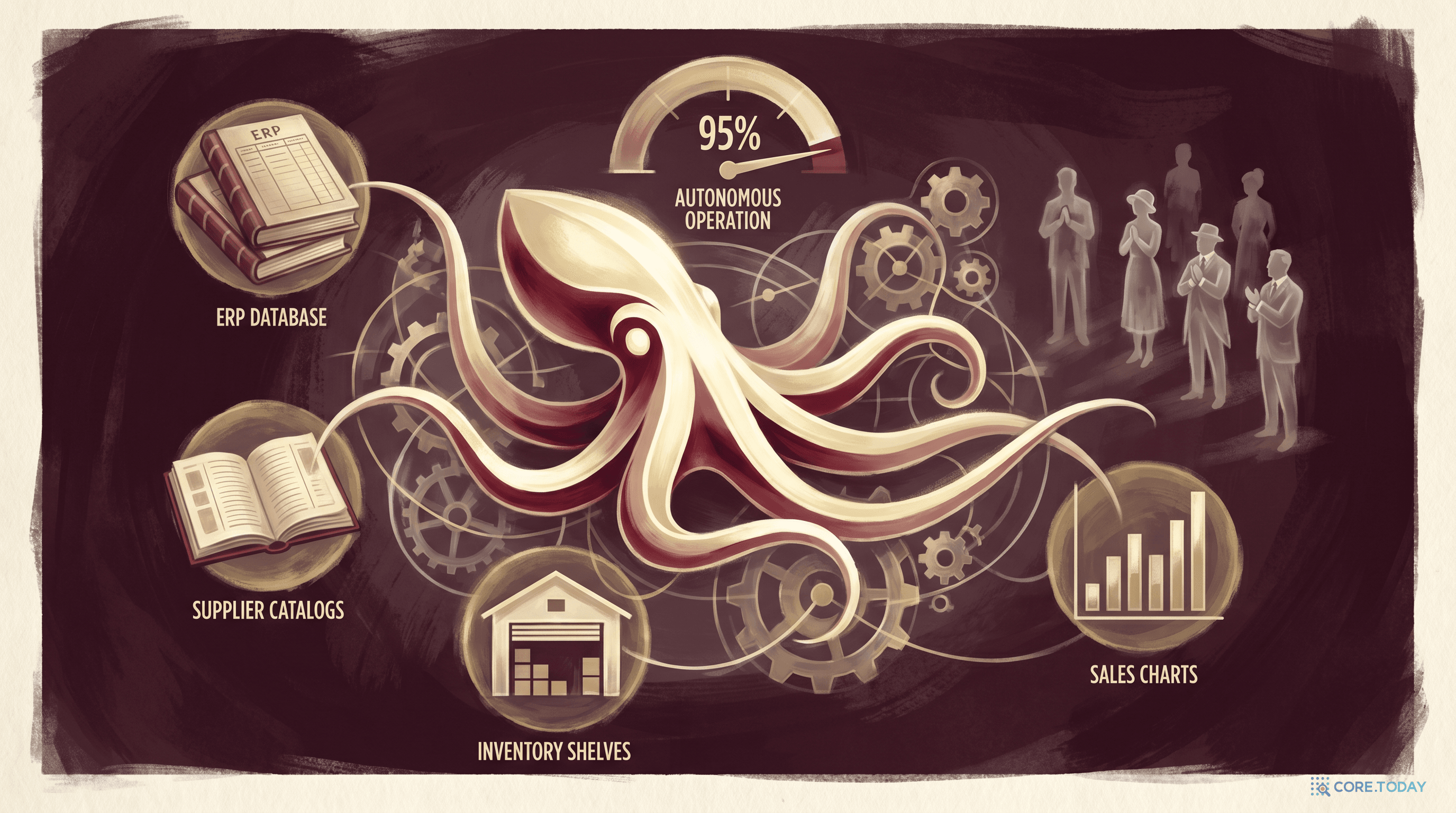

미국 어느 10억 달러(1.3조 원) 규모 냉동 트레일러 물류 회사. 사무실 한쪽 송장 처리실에는 정직원 7명이 앉아 있었다. 그들이 하는 일은 — 연간 10만 건이 넘는 송장을 받아 내부 템플릿과 맞춰 보고, ERP에 입력하고, 고객용 청구서를 만드는 것뿐. 지방 정비소에서 팩스로 오는 수리 영수증, 전화로 받는 음성 청구, 이메일에 무작위로 첨부된 PDF — 채널은 제멋대로였다.

회사 사장은 8주 동안 이 시스템에 AI를 입혔다. 750개의 송장 템플릿을 수백 개로 정리하고, Azure Document Intelligence + Azure OpenAI로 OCR과 의미 매핑을 결합했다. 주 1회 사장이 직접 진행 상황을 챙겼다. 주니어 IT 두 명은 첫날부터 프로젝트에 들어가 AI 결과물을 매일 검토했다.

결과:

인원

7명 → 2명

정확도

85%

처리 시간

< 24시간

가치 창출

> 100만 달러

사장은 인터뷰에서 이렇게 말했다. "여러분, 85%면 충분합니다. 95%까지 올릴 수 있다는 거 알지만 — 우린 지금 당장의 비용 절감과 백로그 해소가 더 중요해요. 80%면 완벽합니다."

이게 — 2026년 4월 스탠퍼드 디지털 경제 연구소가 발표한 "엔터프라이즈 AI 플레이북"에 실린 51개 성공 사례 중 단 한 건이다. 이 보고서는 Reddit /r/artificial에서 화제가 됐고, 그날 밤 수천 개의 댓글이 달렸다. 사람들이 충격받은 이유는 단순했다.

"기술이 어려운 게 아니라 — 조직이 어렵다는 걸, 스탠퍼드가 데이터로 증명했기 때문이다."

본 글은 2026년 4월 발표된 The Enterprise AI Playbook: Lessons from 51 Successful Deployments (Elisa Pereira, Alvin Wang Graylin, Erik Brynjolfsson, Stanford Digital Economy Lab) 원문 전체를 분석하고 한국 독자의 시각에서 재구성한 특집입니다. 인용된 수치와 사례는 모두 원본에서 가져왔습니다.

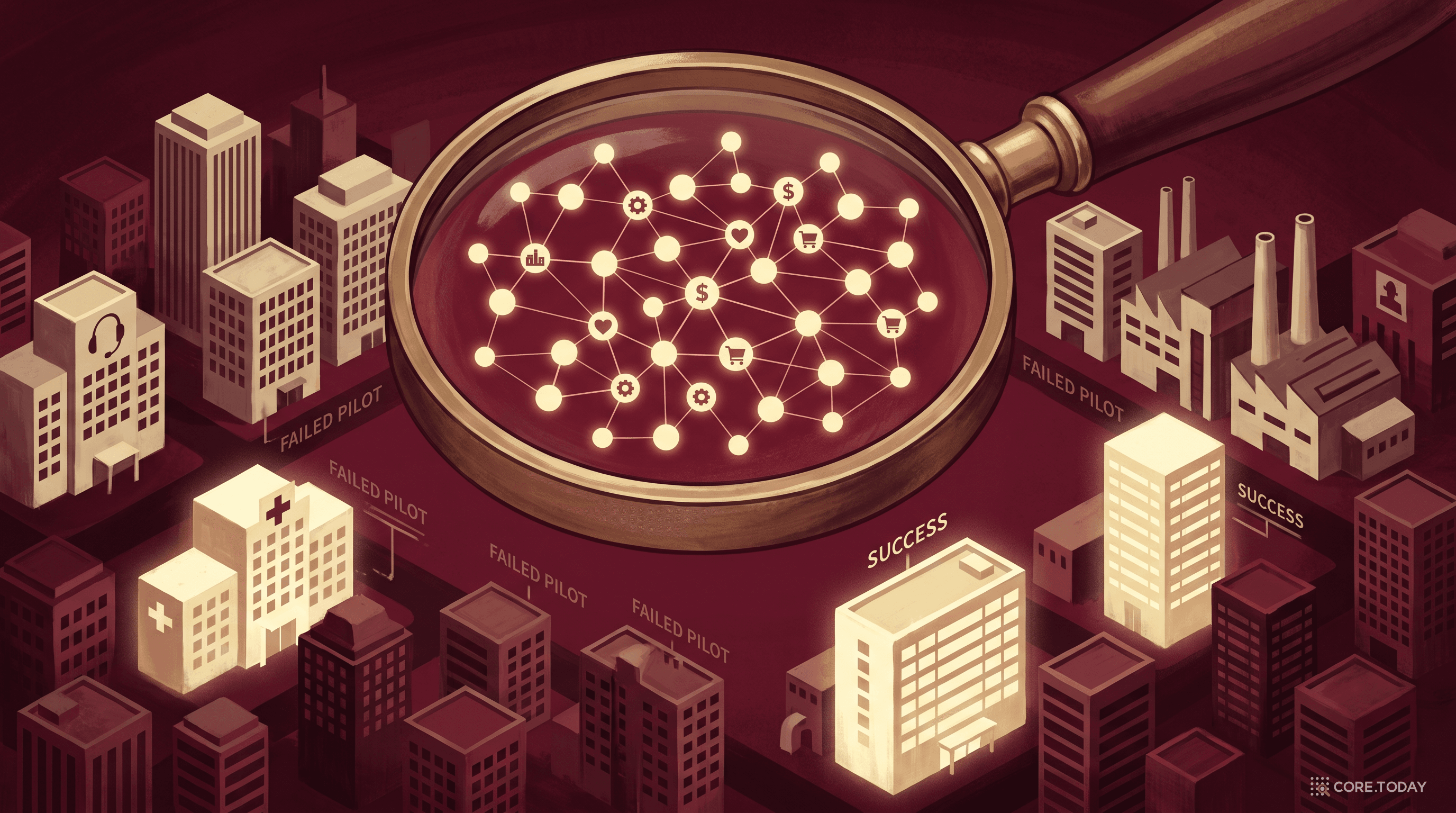

1장. 왜 이 보고서가 화제가 됐나 — MIT의 "95% 실패" 충격 다음 날

2025년 7월, MIT가 던진 폭탄

이 보고서가 화제가 된 진짜 이유는 — 2025년 7월에 MIT NANDA Initiative가 발표한 충격적인 연구 때문이다.

"기업의 생성형 AI 파일럿 중 95%는 측정 가능한 재무 임팩트를 만들지 못한다."

수십억 달러가 엔터프라이즈 AI에 쏟아지는데, 95%가 실패. 이 한 줄이 월스트리트저널·이코노미스트·블룸버그 1면을 장식했다. 주가가 흔들렸다. AI 회의론자들은 환호했다. AI 옹호자들은 반박할 데이터가 없다는 사실에 침묵했다.

MIT의 분석은 원인이 모델 품질이 아니라고 적시했다. 워크플로우 통합 부재, 조직 인센티브 불일치. 즉 AI 그 자체가 약한 게 아니라, 기업이 그것을 다루지 못한 것이다.

95% of generative AI pilot programs fail to produce measurable financial impact.

The failures stem not from model quality but from poor workflow integration

and misaligned organizational incentives.

그래서 스탠퍼드가 한 일

2025년 8월부터 2026년 2월까지 — Stanford Digital Economy Lab의 Erik Brynjolfsson 교수(Second Machine Age 저자, AI 경제학 최고 권위자 중 한 명)와 Elisa Pereira(MSx 후보, 라틴아메리카 엔터프라이즈 AI 솔루션 구축 경험), Alvin Wang Graylin(35년 경력의 AI·XR 시니어)이 함께 — 5개월에 걸쳐 51개 성공 사례를 인터뷰로 해부했다.

선정 기준은 까다로웠다.

운영 안정성

실제 워크플로우에 통합, 일관되게 사용

지속 사용

3개월 이상 여러 팀이 일상적으로 AI 시스템에 의존

정량화 가치

생산성·매출·고객 만족도 등 명확한 비즈니스 성과

확장성

다른 팀·지역·사업부로 확장 가능

51 케이스 · 41 조직 · 7 국가 · 5 대륙 · 100만 명 이상의 종업원. 9개 산업, 14개 직군. 60분 이상 구조화된 임원 인터뷰. 내부 지표·재무 자료·프로젝트 리뷰 문서 보완.

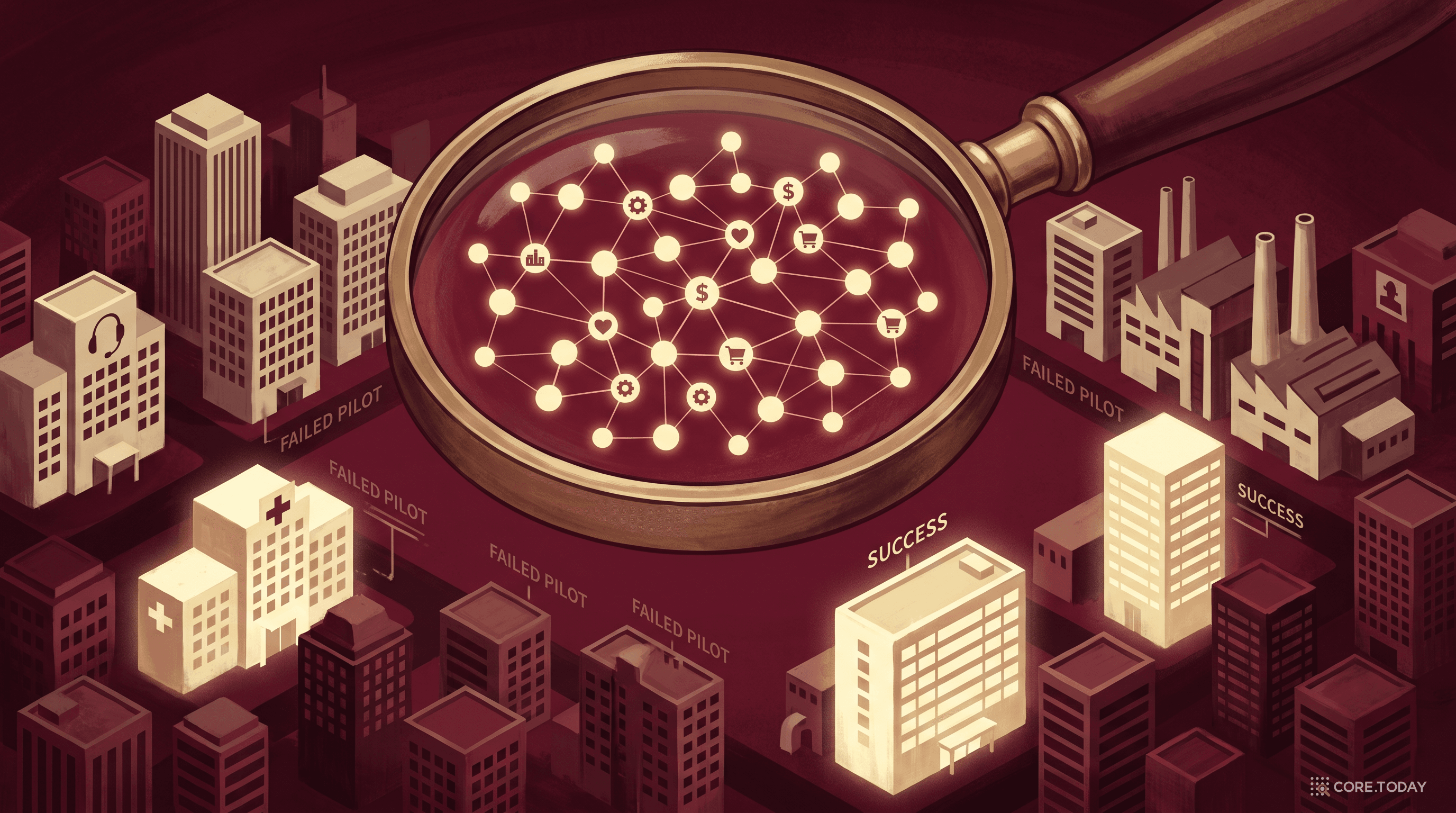

그리고 — 이 책의 가장 충격적인 부분은 2/3의 회사가 현재 성공 이전에 의미 있는 실패를 겪었다고 인정한 사실이다.

"행복한 가정은 모두 비슷하다. 불행한 가정은 저마다의 이유로 불행하다." — 톨스토이 (스탠퍼드 연구진이 보고서에 직접 인용한 문장)

스탠퍼드는 성공의 정원만 보여주지 않았다. 모든 인터뷰에서 과거의 실패·중단된 파일럿·잘못된 시작에 대해 명시적으로 물었다. 무엇을 먼저 시도했고, 왜 안 됐고, 무엇을 바꿨는가. 이 데이터가 — 이 보고서를 마케팅 백서가 아닌 진짜 플레이북으로 만든다.

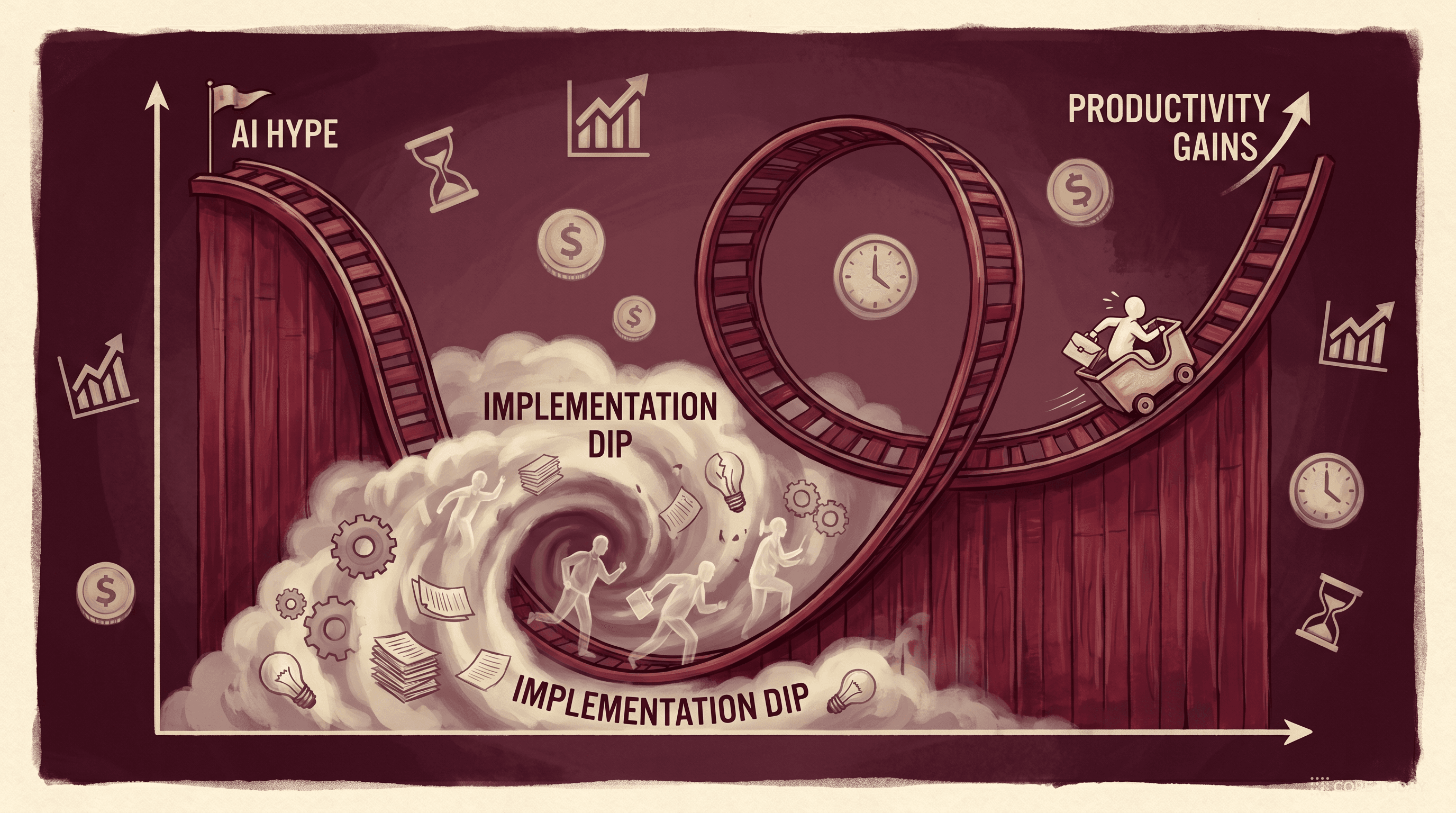

2장. Brynjolfsson의 생산성 J-Curve — 왜 AI는 처음엔 늦게 빛나는가

일반목적기술(General Purpose Technology)의 역사적 패턴

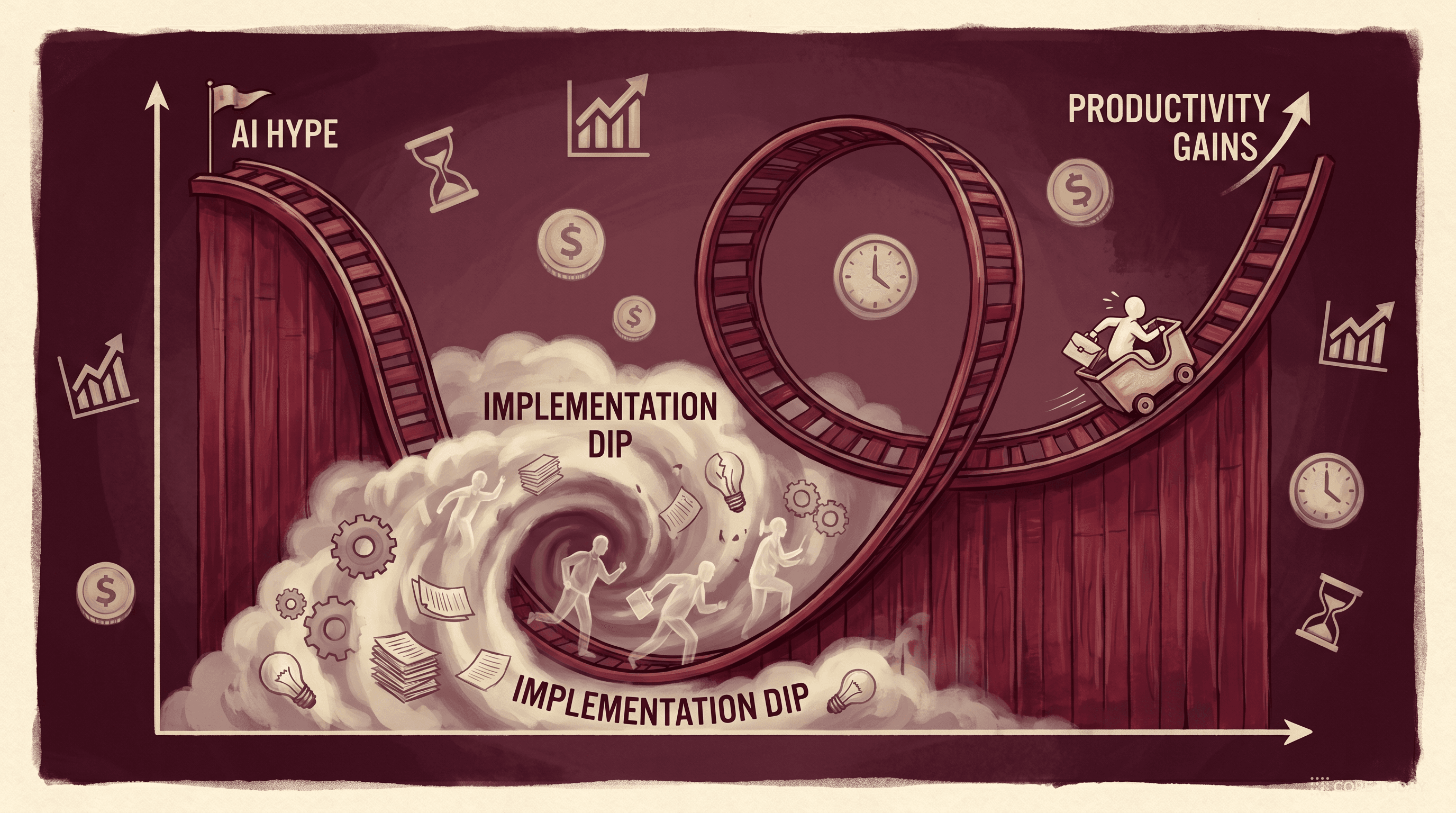

이 보고서의 지적 뿌리를 이해하려면 — Erik Brynjolfsson의 2021년 논문 "Productivity J-Curve"를 알아야 한다.

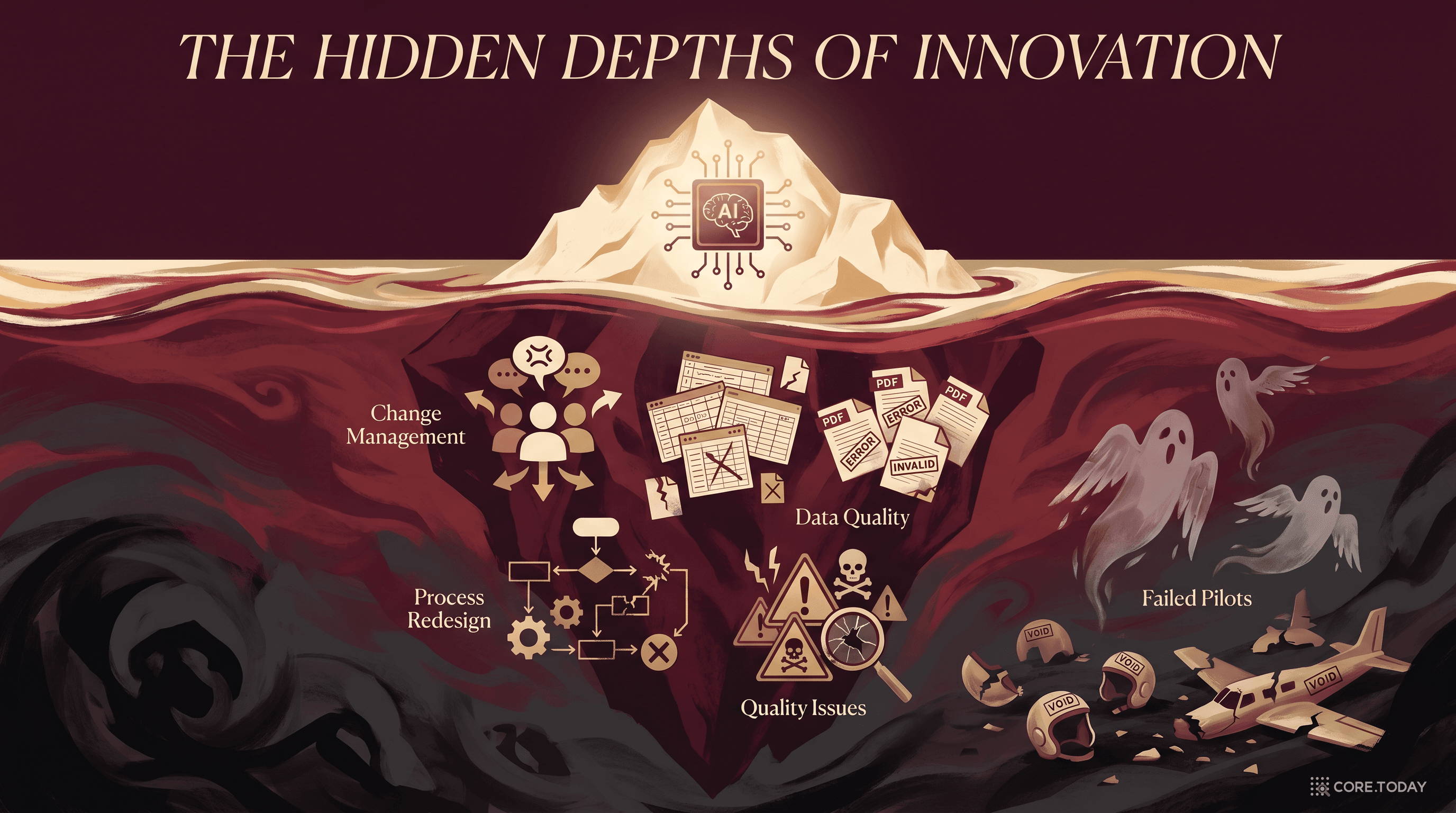

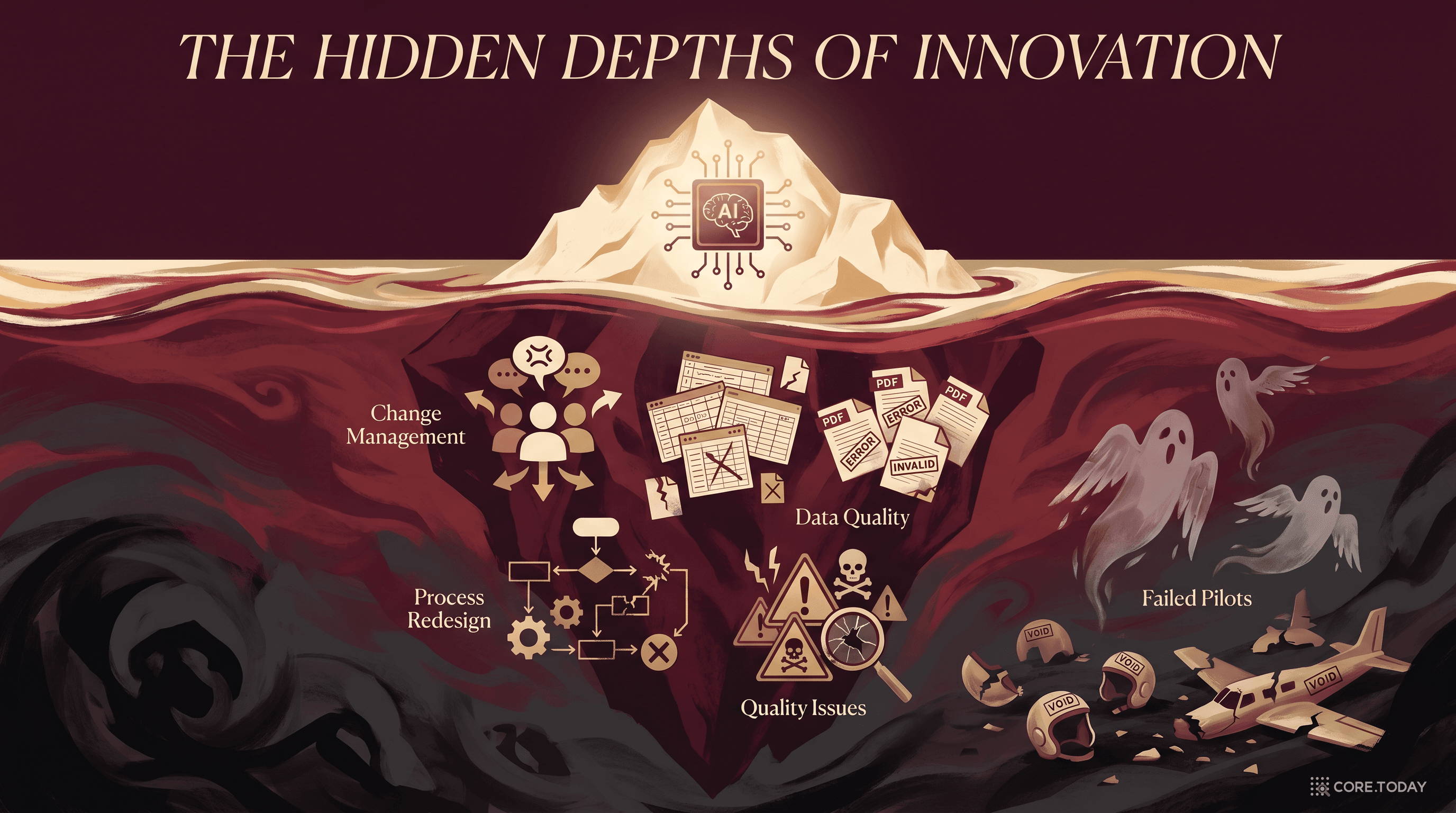

전기·증기기관·컴퓨터 같은 일반목적기술(GPT)은 — 도입 초기에 생산성이 오르는 게 아니라 오히려 떨어진다. 왜? 기술 자체보다 그것을 활용하기 위한 보완 투자(프로세스 재설계, 인력 재훈련, 조직 구조 개편)가 훨씬 더 크고 무형적이기 때문이다.

1달러의 가시적 기술 투자당, 기업은 평균 10달러를 무형 투자에 쓴다. 이 무형 투자는 국민 회계에 잡히지 않는다. 그래서 경제학적으로 측정된 생산성은 기술 도입 초기엔 떨어졌다가, 나중에 가파르게 상승한다. 마치 J자 모양처럼.

AI 시대의 J-Curve

이 51개 사례에서 — 스탠퍼드는 J-Curve의 메커니즘이 정확히 작동하고 있음을 발견했다.

실무자가 답한 "가장 어려웠던 것" — 비가시 비용이 77%

비가시 비용 77%. 기술적·가시적 비용 23%. 딱 J-Curve의 1:10 무형/유형 비율과 일치한다.

"가장 힘든 일은 프로세스 문서화와 데이터 아키텍처에 있다. 그 둘만 할 수 있다면 — 나머지는 다 쉽다." — Telecom 회사 임원

"기술은 병목이 아니었다. 조직 수용이 실패 지점이었다." — Professional Services 회사 임원

한 번 실패한 회사가 두 번째에 성공한다 — 61%의 생존자 패턴

스탠퍼드가 발견한 두 번째 충격은 — 현재 성공한 51개 케이스 중 61%가 과거에 한 번 이상 AI 프로젝트를 실패한 경험이 있다는 사실이었다.

⚠️

첫 시도가 실패한 이유 (공통 패턴)

팀이 AI를 기술 프로젝트로 다뤘다. 망가진 워크플로우 위에 그대로 모델을 얹었다. 기술팀이 비즈니스 오너십 없이 리드했다. "AI가 알아서 해결해 줄 것"이라 가정했다.

🔧

두 번째 시도에서 바뀐 것

CEO가 직접 오너십을 가져갔다. AI 적용 전에 프로세스부터 고쳤다. 진짜 고통을 타깃했다 — 사용자가 "이게 좋겠다"가 아니라 "나 죽는다"고 느끼는 영역.

✨

결과

같은 회사·같은 기능·같은 목표 — 하지만 결과는 극단적으로 달랐다. 한 전문서비스 회사의 채용 AI 케이스에선 두 번째 시도가 1개월에 83% 효율 개선·후보자 전환률 +75%를 달성했다.

"이건 그들에게 진통제였다. '이거 있으면 좋겠다'가 아니라 '나 익사하고 있다'였다." — Professional Services 회사 임원

기억하자. AI 성공의 진짜 비용은 — 공식 ROI 계산서에 등장하지 않는 한 번의 실패 비용까지 포함해야 한다는 것을. 61%의 성공이 그 사실을 증명한다.

3장. 11가지 핵심 발견 — 한 장 요약

스탠퍼드의 Key Findings는 11개다. 한국 독자를 위해 핵심만 가장 압축적으로 정리한다.

| 발견 | 한 줄 요약 | 한국 기업의 현실 |

|---|

| 1. 기술은 가장 쉬운 부분 | 어려운 과제의 77%는 비가시 비용. 61%가 한 번 이상 실패 경험. | 대기업의 LLM 도입 회의에서 모델 성능만 30분 토론한다면 — 70%는 헛소리하는 중. |

| 2. 일정 차이는 조직, 기술 아님 | 같은 유스케이스가 한 회사는 몇 주, 다른 회사는 수년. | 한국 대기업의 "PoC 무한 루프" 정확히 이거다. |

| 3. 에스컬레이션 모델이 71% 생산성 | AI 80%+ 자율, 인간은 예외만 검토 → 71% vs 승인 모델 30%. | "AI가 만들면 사람이 다 검토"하는 한국 패턴이 가장 낮은 효과. |

| 4. 임원 스폰서십은 행동, 결재 아님 | 주 1회 블로커 직접 제거, AI를 회사 OKR에 묶음, 실패 허용 문화. | 예산 도장만 찍고 사라지는 임원 = 실패 코스. |

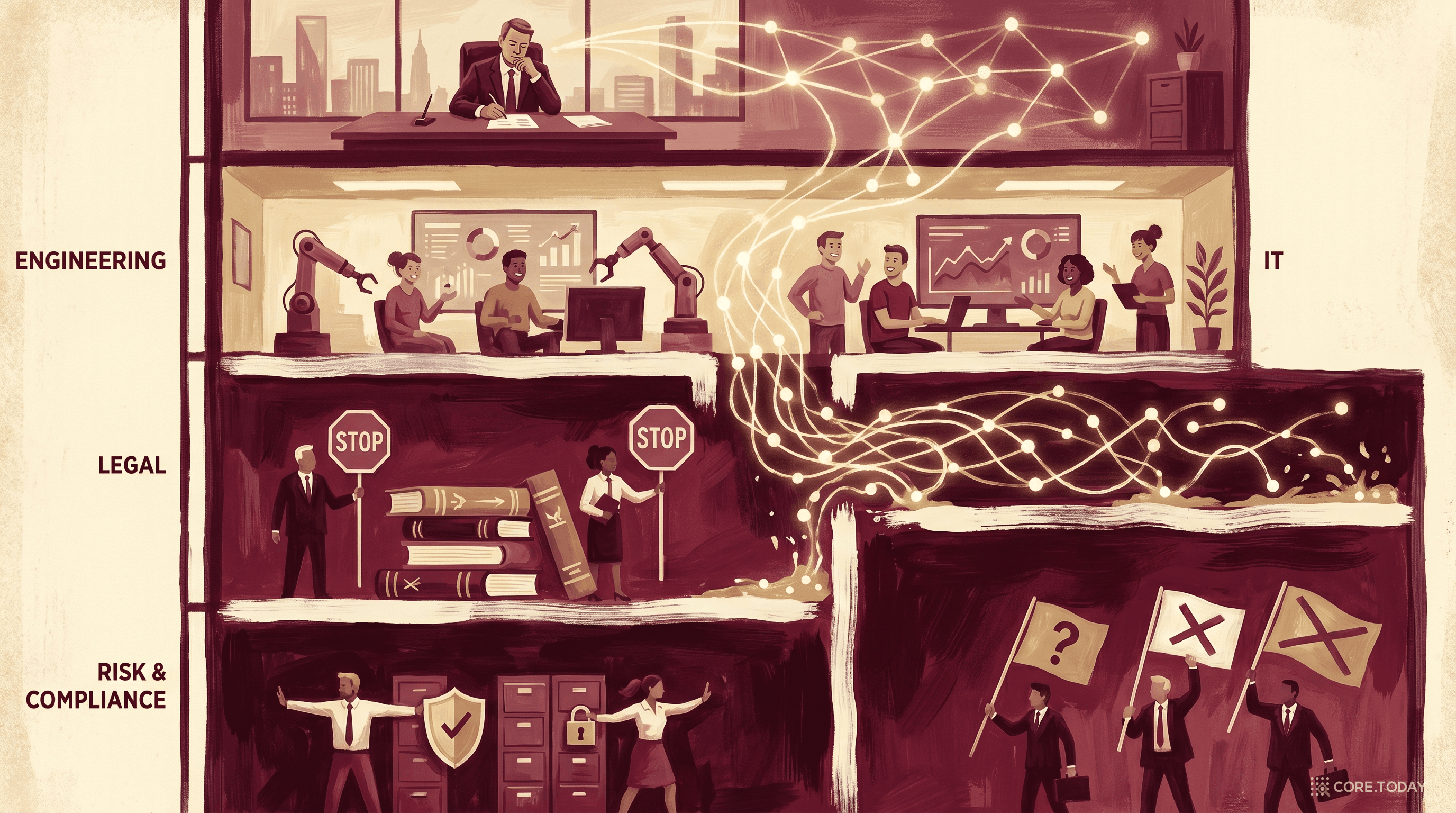

| 5. 치명적 저항은 법무·HR·리스크 (35%) | 현장 사용자(23%) · 외부(23%) · C-Level(15%)보다 압도적. | 한국 대기업도 같다. 법무·인사·감사가 막으면 끝. |

| 6. 인원 감축은 흔하지만 불가피 아님 | 감축 45% · 채용 회피 19% · 무감축 19% · 재배치 17%. | 대기업은 채용 회피, 중견기업은 직접 감축 경향. |

| 7. AI발 매출은 진짜지만 드물다 | 3가지 패턴: 개인화·속도가 거래 성사·내부 도구 외판화. | 한국 기업은 압도적으로 비용 절감만 측정 — 매출 사이드 측정 시급. |

| 8. 에이전틱 AI는 작동, 그러나 소수 | 20%만 에이전틱, 그러나 생산성 중앙값 71% vs 자동화 40%. | 대부분 한국 회사는 "AI 챗봇" 수준 — 에이전트 도입 곡선의 초입. |

| 9. 더러운 데이터는 LLM이 직접 청소 | 완벽한 데이터를 갖춘 곳은 6%. 나머지는 LLM이 청소 수행. | "우리 데이터가 더러워서 AI 못 한다"는 핑계는 끝. |

| 10. 보안은 막는 게 아니라 더 큰 길 | 51개 케이스 중 보안이 프로젝트를 죽인 사례 0건. | 금융권·의료의 "보안 때문에 못 한다"는 정확히 반대. |

| 11. 모델 선택은 42%가 커머디티 | 일상 업무에선 모델 교체 가능. 진짜 해자는 오케스트레이션 레이어. | "GPT-5냐 Claude냐"보다 "어떤 RAG·어떤 멀티 게이트웨이냐"가 본질. |

이제 — 각 발견을 사례와 함께 깊이 들여다보자.

4장. 발견 3 — 에스컬레이션 모델이 71% 생산성을 낳는다

인간 감독 3단계 모델

스탠퍼드는 모든 케이스를 인간 개입 정도(Human-in-the-Loop, HITL)에 따라 3단계로 분류했다.

| 레벨 | 정의 | 생산성 중앙값 | 대표 유스케이스 |

|---|

| 에스컬레이션 | AI가 80% 이상 자율 처리, 인간은 예외만 검토 (≤20%) | 71% | IT 운영 90%, 고객 지원 71%, 클레임 처리 50% |

| 승인 | AI가 작업 수행, 인간이 모든 출력을 사전 승인 | 30% | 현장 서비스 80%, 임상 문서 66% |

| 협업 | 인간과 AI가 모든 작업에서 지속적으로 함께 작업 | 30% | 코딩 54% |

71% vs 30% — 무려 2.4배 차이다.

음식 배달 회사의 자동 응대 — 90~95%가 풀 자동화

음식 배달 회사의 AI 책임자는 이렇게 말한다. "음식이 안 왔거나, 주문에 뭐가 잘못됐다고 누가 말하면 — 그 중 90~95%는 지금 에이전트가 완전히 자동으로 처리합니다."

이게 — 에스컬레이션 모델의 정수다. AI가 대부분의 사례를 끝까지 해결하고, 인간 분석가는 진짜로 판단이 필요한 예외만 본다. 그러면 희소한 인간 자원을 가장 가치 있는 곳에 배치할 수 있다.

그런데 — 임상 문서·코딩에선 왜 협업·승인 모델인가?

스탠퍼드는 모델 선택이 작업의 본질에 달려 있다고 명확히 지적한다.

대량·반복·복구 가능 작업

(고객 지원 트리아지)

→

에스컬레이션 모델

(71% 생산성)

규제·법적 책임

(임상 문서, 마케팅 콘텐츠)

→

승인 모델

(30% 생산성)

고도 판단·전문성

(코딩, 컨설팅)

→

협업 모델

(30% 생산성)

핵심: 생산성 71%를 좇아 의료·법무에 무리한 에스컬레이션을 적용하면 — 법적 책임으로 회사가 죽는다. 반대로 고객 지원에 승인 모델을 고집하면 — 경쟁사에 따라잡힌다. 작업의 오류 허용도·규제 요구·복잡도가 모델을 결정한다.

"엔지니어가 전체 마이그레이션 작업을 완료하는 게 아니라, 변경 사항만 리뷰하고 PR을 머지합니다." — 라틴아메리카 핀테크 엔지니어링 책임자

"엔터프라이즈 레벨로 돌리려면 80% 기술 + 20% 인간 정제가 필요합니다. AI 산업은 아직 마지막 20%를 완벽히 못 합니다." — Enterprise AI 회사 전략 책임자

Case Study: 금융 서비스 회사의 80/20 마케팅 콘텐츠 모델

한 금융사는 — 고객 데이터로 초개인화 콘텐츠를 만들고 싶었지만, 기존 에이전시 방식은 캠페인당 7주가 걸렸다. 80/20 모델을 채택했다. AI가 80% 생성, 인간이 20% 정제·QA.

출시 시간

7주 → 6시간

클릭률

2배 개선

생산 효율

> 80% 시간 감소

핵심 교훈: "인간 감독은 생산성 세금이 아니다." 80/20이 97.6% 출시 시간 단축과 제로 오류를 동시에 달성했다.

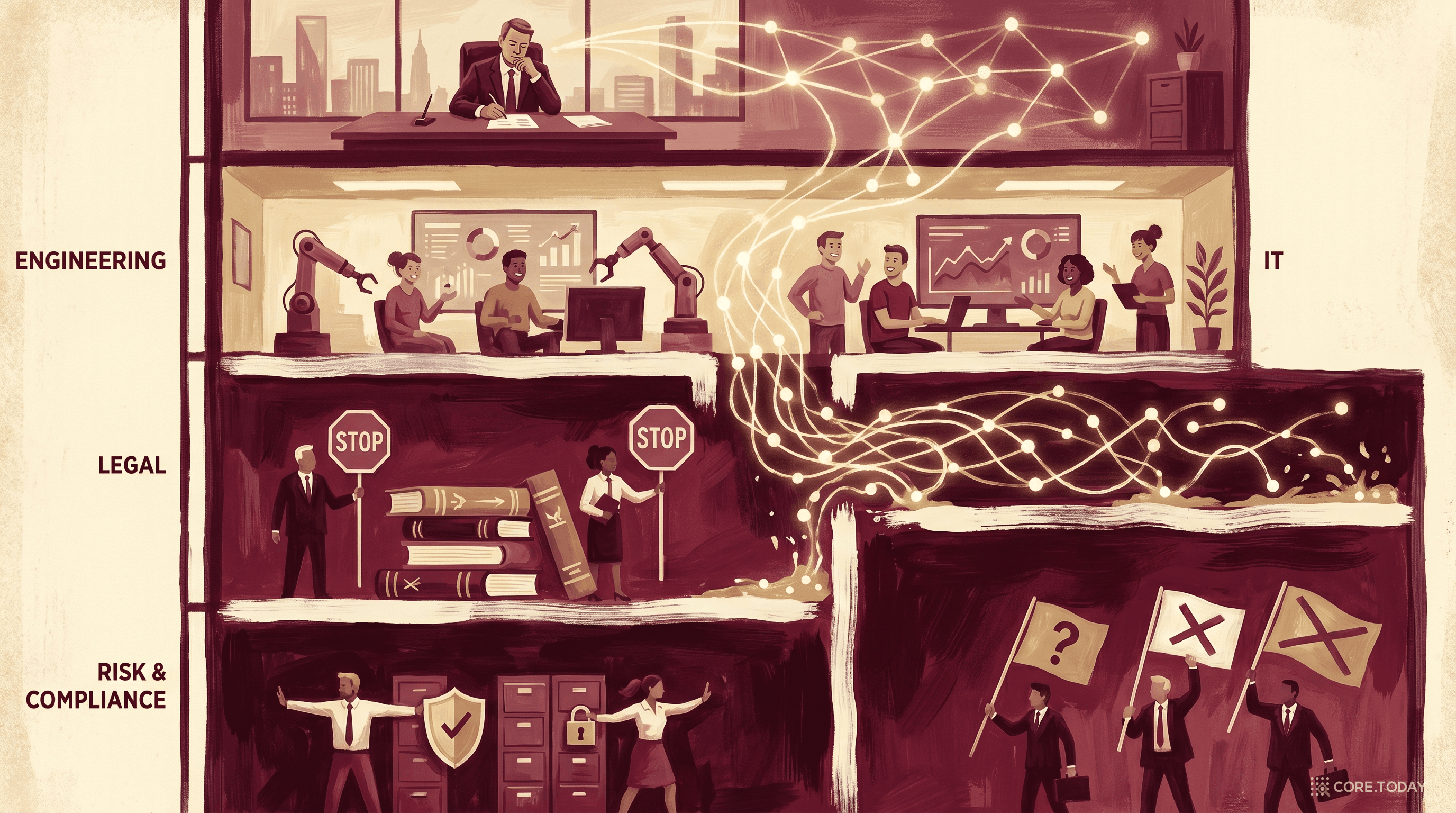

5장. 발견 5 — 치명적 저항은 현장이 아니라 법무·HR이다

통념과 실제 사이

AI 도입 책으로 통하는 통념은 — "현장 직원들의 일자리 두려움이 가장 큰 장벽"이다. 스탠퍼드는 이 통념을 데이터로 부숴버렸다.

프로젝트 저항의 주요 출처 (N=51)

스태프 기능 (법무·HR·리스크·컴플라이언스)

35%

압도적

C-Level (CFO, CTO)

15%

중간

35% vs 23%. 법무·HR·리스크가 현장 직원보다 더 자주 AI 프로젝트를 멈춘다.

각 저항의 이유와 해결책이 다르다

스탠퍼드의 가장 실용적인 발견은 — 그룹마다 저항의 동기가 다르고, 따라서 해결책도 다르다는 것이다.

| 저항 그룹 | 진짜 두려워하는 것 | 맞는 해결책 |

|---|

| 스태프 기능 (법무·HR·리스크) | 책임. 규제 노출. 비난. | 설득이 아니라 명령(mandate). AI 도입을 회사 OKR에 묶고, 비난 책임을 분산. |

| C-Level (CFO 중심) | ROI 증명 없는 투자. | 측정된 작은 파일럿으로 가치 시연 후 확장. |

| 현장 사용자 | AI의 불확실성·일관성 부족. | 기대치 설정. "80%면 충분"이라는 패러다임 전환. |

| 일선 직원 | 대체 두려움 (가장 자주 언급되나 실제로는 51개 중 2건만) | 구체적 로드맵 제시. 어떤 일이 사라지고, 어떤 일이 남고, 어떤 새 일이 생기는가. |

"제 시간의 거의 전부를 리스크와 통제에 썼습니다. 누구도 뭘 하기를 무서워하는 환경에서요." — 대형 은행 임원

Case Study: 기술 서비스 회사 SOC 팀의 두려움 해체

월간 보안 알람 1,500건을 6명 분석가가 처리하던 SOC 팀. 리더십이 AI 자동 트리아지 도입을 제안했을 때 — 예상된 우려는 일자리였다. 6명 팀, AI가 대부분의 업무를 대체 가능, 저항의 위험은 실재했다.

스폰서가 세 가지를 했다.

1

맥락이 먼저 일했다. 팀은 이미 과부하 상태였고 저우선순위 알람을 처리하지 못하고 있었다. AI는 대체가 아니라 구조로 자리매김됐다.

2

업무 분담이 직관적이었다. AI가 기계적 트리아지(분류·오탐 필터링)를 가져갔다. 분석가는 판단이 필요한 전문 영역을 유지했다.

3

해방된 역량을 위로 가는 길로 프레이밍했다. "AI는 당신을 대체하는 게 아니라, 회사가 추가로 채용하지 않아도 되게 만드는 사람을 대체합니다."

결과:

알람 처리량

1,500 → 40,000/월

고우선 알람 커버

0% → 100%

필요 인원

6 → 1.5 FTE

해고

0명

해방된 4.5 FTE는 위협 헌팅, 보안 아키텍처, 역량 개발에 재배치됐다. 단 한 명도 해고되지 않았다. 팀은 저항에서 옹호로 이동했다.

"AI는 당신을 대체하는 게 아닙니다. AI는 회사가 추가로 채용해야 할 사람을 대체합니다." — Technology Services 회사 임원

6장. 발견 6 — 인원 감축은 흔하지만, 절반도 안 된다

통념과 실제 사이 (다시)

"AI가 일자리를 다 없앤다"는 두려움. 실제 데이터는 어떤가?

AI 도입 후 인원 변화 (N=51)

채용 회피 (Hiring Avoided)

19%

중요

감축 없음 (No Reduction)

19%

유지

재배치 (Redeployment)

17%

긍정

45% 감축은 가장 큰 단일 결과지만 — 51개 케이스 중 55%는 감축 외의 다른 길을 선택했다.

세 가지 전략

1. 가속화 (Accelerate)

해고 대신 더 많은 기능을 더 빠르게 출시

2. 재배치 (Redeploy)

자동화된 작업에서 판단이 필요한 작업으로 이동

3. 직접 감축 (Reduce)

비용 중심 소유주(PE·턴어라운드)가 주로 선택

기술이 결과를 정하지 않는다. 소유 구조·전략적 맥락이 정한다.

그러나 — 미래는 더 어두울 수 있다

스탠퍼드는 솔직하게 경고한다. 위의 데이터는 2025년 초까지의 회고적 결과다.

ADP 페이롤 데이터에 따르면 — 22~25세 AI 노출 직군 신입의 고용이 2022년 말 이후 상대적으로 16% 감소했다. Anthropic 분석은 체계적 실업 증가는 아직 없지만 — AI 노출 분야의 청년 채용이 이미 둔화되고 있다고 명시했다.

"45% 감축률은 천장이 아니라 바닥일 수 있다. 오늘 가속화·재배치를 선택한 회사들도 — 다음 세대 모델이 도착하면 다른 계산에 직면할 것이다." — 보고서 결론부

이게 Brynjolfsson이 명명한 "생산성 분기점(Productivity Fork)"이다. AI는 두 갈래로 갈라진다.

AI 도입

→

노동자 증강 + 새 업무 창출

→ 광범위 번영

AI 도입

→

기존 업무 자동화 + 인원 감축

→ 집중적 이득 · 사회 불안

어느 길을 갈지는 — 기술이 아니라 조직과 정부의 선택에 달려 있다.

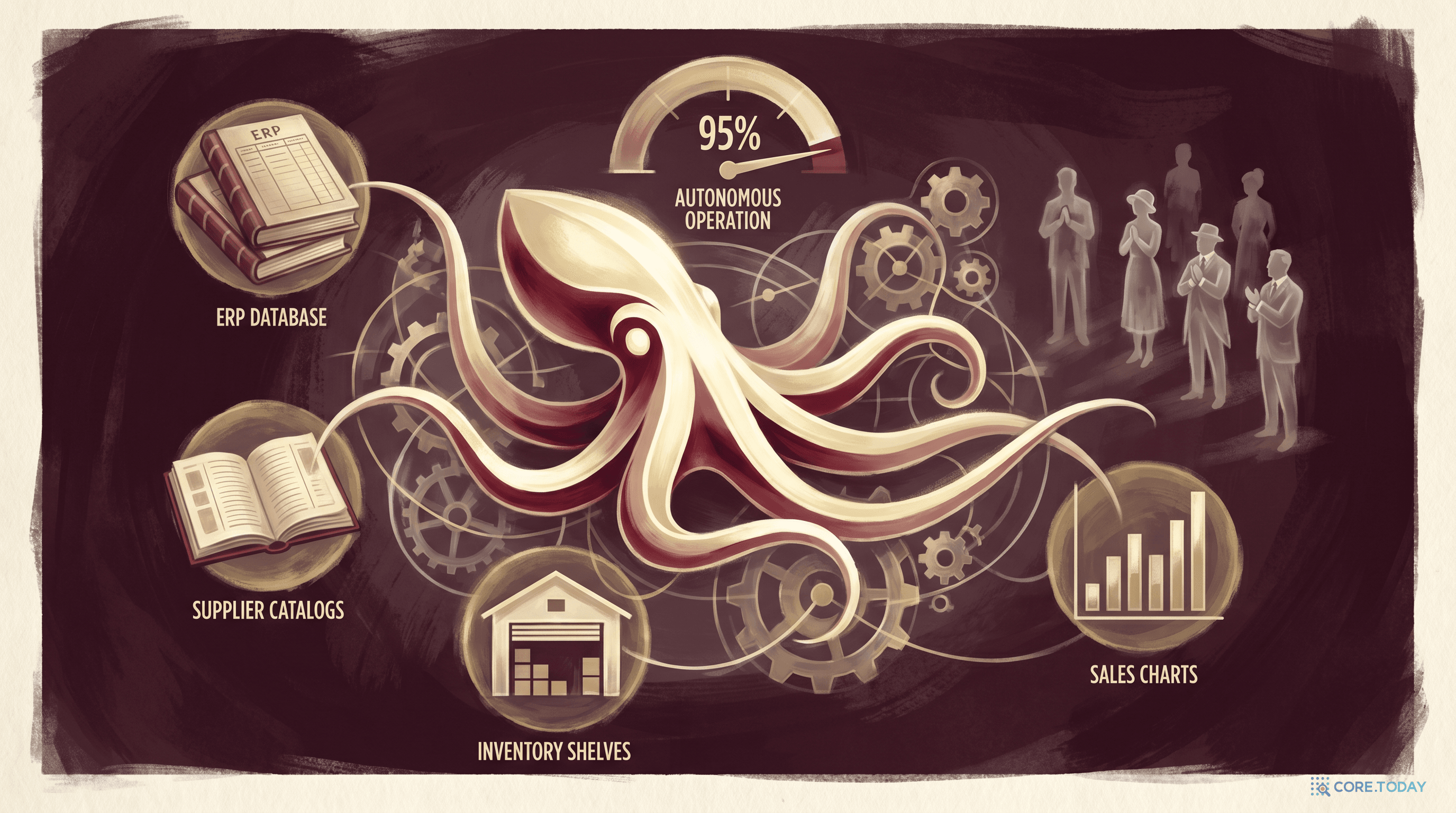

7장. 발견 8 — 에이전틱 AI는 71%, 그러나 아직 20%만

새로운 패러다임의 정의

에이전틱 AI(Agentic AI)는 2025년에야 본격 대중적 시야에 들어온 개념이다. 툴이 아니라 — 팀의 확장. 인간의 가이드와 감독을 받지만, 점점 더 인간을 대신해 행동하고 인간 역량을 증폭하는 AI 시스템.

스탠퍼드는 보고서에서 METR(독립 AI 평가 기관)의 데이터를 인용했다.

프론티어 모델이 인간의 개입 없이 신뢰성 있게 끝낼 수 있는 소프트웨어 작업의 길이는

2019년 이후 약 7개월마다 두 배로 늘어났다.

2026년 초: 가장 유능한 모델은 약 15시간의 인간 전문가 작업을 자율로 완료.

2024년: ~30분 · 2022년: ~5분 · 2020년: 수십 초.

7개월마다 두 배. 5년 뒤엔 인간 전문가 1주일치 작업을 AI가 단번에 끝낸다는 뜻이다.

그런데 51개 중 에이전틱은 단 20%

| 레벨 | 정의 | 생산성 중앙값 | 비중 |

|---|

| 에이전틱 | AI가 자율 행동, 인간 개입 없이 멀티스텝 작업을 end-to-end | 71% | 20% |

| 고자동화 | AI가 80%+ 자율, 인간이 예외·최종 출력만 검토 | 40% | 34% |

| 휴먼 인 더 루프 | AI·인간 협업, 인간이 각 출력을 검토·승인 | 22% | 46% |

20%만 에이전틱이지만 — 생산성 중앙값 71%는 다른 모든 모델을 압도한다.

Case Study: 슈퍼마켓 체인의 "인간 구매담당 대체" — EBITDA 두 배

24개 매장을 운영하는 지역 슈퍼마켓 체인. 시장 리더 대비 마진의 절반에서 운영하며 공급업체 협상력 거의 없음. 세 가지 문제:

- 낭비 — 신선 식품이 진열대에서 만료, 시즌 상품 잘못 발주

- 품절 — 빈 진열대는 매출 1건 손실이 아니라 고객 영구 이탈

- 타이밍 — 인간 구매담당은 직감과 인맥에 의존, 25개 매장 수천 SKU 최적화 불가능

회사가 에이전트 AI를 인간 구매 기능 전체에 투입했다. AI는 추천을 만들지 않는다. 직접 구매 결정을 내린다.

행동

자율 구매 에이전트: 무엇·언제·누구에게서 구매할지 결정

관찰

판매·만료·품절 결과 측정 → 다음 사이클에 피드백

결과:

낭비 감소

40%

품절 감소

80%

EBITDA 마진

두 배

"시장 리더는 마진이 훨씬 높지만 — 이 친구들은 구매 협상력이 거대 기업 대비 제로입니다. 그런데도 이제 거의 비슷한 성과를 냅니다. 그들이 가진 건 — 낭비가 없다는 사실입니다." — 프로젝트 리드, Retail 회사

에이전틱 AI는 작은 회사가 거대 회사의 규모를 — 지능으로 대체할 수 있게 한다. 슈퍼마켓 사례가 그 증명이다.

어떤 작업이 에이전틱에 맞나? 3가지 공통점

스탠퍼드는 성공한 에이전틱 케이스 10건의 공통점을 추출했다.

📦

대량·반복 업무

보안 알람 수천 건, 조달 결정 수백 건, 고객 지원 티켓 수만 건. 볼륨이 자율 시스템 구축 투자를 정당화한다.

🎯

명확한 성공 기준

알람이 유효한가/아닌가. 조달 결정이 맞나/틀리나. 티켓이 해결됐나/아닌가. AI가 객관 기준으로 자기 출력을 평가할 수 있어야 한다.

🔄

복구 가능한 오류

놓친 알람은 나중에 잡을 수 있다. 잘못된 조달 추천은 무효화할 수 있다. 실패한 티켓은 인간에게 에스컬레이션된다. 오류가 비싸도 — 치명적이지 않다.

이 세 조건을 만족하면 — 에이전틱이 답이다. 임상 진단·법적 자문 같은 치명적 영역은 아직 협업·승인 모델이 정답이다.

8장. 발견 9 — 더러운 데이터는 LLM이 직접 청소한다

통념의 또 다른 사망

"우리 회사 데이터가 더러워서 AI 못 한다". 이게 한국 대기업 IT 회의에서 가장 자주 등장하는 변명 중 하나다. 스탠퍼드 데이터는 이것도 부순다.

완벽한 데이터를 갖춘 곳: 단 6%

나머지 94%는 — 데이터 문제가 있었다.

88%의 케이스에서 LLM이 이전엔 접근 불가능했던 데이터를 풀었다.

91%가 비구조 데이터를 성공적으로 처리했다 (음성·스캔 문서·이미지·채팅 로그·레거시 코드).

LLM이 풀어준 데이터 종류

LLM이 해결한 데이터 챌린지 유형

복합 솔루션 (추출+청소+구조화+매칭)

53%

최다

번역 (COBOL → Java 등)

6%

소수

분류 (대량 데이터에서 시그널 추출)

3%

소수

"파트너들이 '두 달은 걸려야 정리할 줄 알았는데, 너희가 하루 만에 데이터 이슈를 다 잡았네' 라고 말합니다." — Professional Services 회사 AI 부사장

새롭게 열린 데이터 종류

1. 음성·대화 데이터. 의료의 ambient transcription이 의사-환자 대화를 코딩 팀에 처음으로 접근 가능하게 만들었다. 콜센터 transcript가 실시간 코칭 자료가 됐다.

2. 분산된 문서·지식 베이스. 반도체 회사가 데이터 수집 시간을 10배 이상 단축했다 — 5~6개 다른 저장소에서 자동 풀링하는 멀티 에이전트 프레임워크로.

3. 시각·멀티모달 데이터. 현장 기술자가 장비 사진을 찍으면 AI가 즉시 수리 방법을 제시한다.

"Save Everything" — 새로운 격언

스탠퍼드의 가장 실용적인 조언은 한 문장이다.

"모든 걸 저장하라. 데이터 저장 비용은 — 적절한 유스케이스가 도착했을 때 데이터가 없는 비용보다 훨씬 적다."

스탠퍼드 사례의 75%가 독점 데이터를 AI 전략의 핵심 요인으로 언급했고, 47%는 축적된 데이터를 경쟁 해자(moat)로 명시했다.

"우리 차별화 — 우리에게서 사람들이 사는 이유 — 는 지난 13년간 만든 지식 그래프입니다. 200억 데이터 포인트가 넘습니다." — HR Tech 회사 임원

9장. 발견 10 & 11 — 보안과 모델 선택의 진실

보안: 막는 게 아니라, 더 큰 길을 연다

스탠퍼드 51개 케이스 중 — 보안 때문에 죽은 프로젝트는 0건이다.

그러나 그림자 AI(Shadow AI)는 15% 케이스에서 명시적으로 언급됐다. 그림자 AI란 — 공식 승인 없이 직원들이 사용하는 AI 도구. 업계 조사에 따르면 AI를 업무에 쓰는 직원의 70~80%가 비공인 도구에 의존한다. IBM 조사는 80%가 AI를 쓰지만 22%만이 회사 제공 도구만 쓴다고 밝혔다. 57%가 민감한 회사 정보를 입력했다고 자백했다. AI 관련 데이터 유출 평균 비용은 1건당 400만 달러 이상이다.

🌑

패턴 A: 열정이 거버넌스를 추월

반도체 회사가 보안 분석 시 직원들이 1,500~1,600개의 다른 AI 도구를 쓰고 있는 걸 발견했다. 직원들은 악의가 없었다. 리더십이 "AI 써"라고 했지만 — 플랫폼이 없었던 것뿐.

🚑

패턴 B: 절박함이 관료제를 이긴다

병원 시스템이 ambient transcription 도구 평가가 너무 느리자 — 의사들이 비공식 승인으로 도구를 자체 도입했다. 의사들은 번아웃 상태였고, 기술은 존재했고, 공식 프로세스는 너무 오래 걸렸다.

💡

통찰

그림자 AI는 좋고 나쁨이 아니라 — 정책이 기술보다 느리다는 증상이다. 공식 채널이 수요를 못 따라잡으면 사용자들은 우회로를 찾는다. 의료·금융·정부에선 — 법적·규제적 책임이 거대해질 수 있다.

Case Study: 대형 리테일 은행의 "방화벽 안에서 클라우드로"

미국의 한 대형 리테일 은행. 과거 컴플라이언스 이슈로 consent order가 걸려 있어 — 지독하게 리스크 회피적 문화. 정책은 "모든 소프트웨어·하드웨어는 방화벽 안에 있어야 한다". 현대 AI는 클라우드 기반. 정책이 AI를 불가능하게 만들었다.

팀이 4단계 데이터 보호 아키텍처를 만들었다.

1

PII 스크러빙 (출구): 고객 발화에서 이름·계좌·금액 제거 후 방화벽 밖으로

2

합성 데이터 치환: 외부 처리 동안 진짜 값을 가짜 값으로 교체

3

외부 의도 처리: 클라우드 모델이 고객 의도를 파악 → 워크플로우 선택

4

재조립 (반환): 응답이 내부로 돌아오면 진짜 값을 다시 끼워 넣음

결과: 최저 채널 비용, 48~72시간 콜 컨테인먼트 감소, 다음 단계로 에이전틱 스케줄링 AI 진행 중. 보안에 쓴 수년의 시간이 경쟁사가 따라할 수 없는 인프라가 됐다.

모델 선택: 42%는 커머디티, 나머지는 차별화 요소

엔터프라이즈 유스케이스별 모델 중요도

중간 (모델이 중요하지만 결정적 아님)

39%

상당

루틴 작업에선 71%가 커머디티. 고급 작업에선 18%만 커머디티. 즉 — 어려운 일일수록 모델이 중요하고, 일상적 일에선 어떤 모델을 쓰는지가 거의 무의미하다.

멀티모델 게이트웨이가 신흥 표준

기술 회사의 한 운영 책임자는 이렇게 말한다. "우리는 Claude를 쓰고, OpenAI를 쓰고, Llama를 쓰고, Bedrock도 쓰고요. 작업마다 다릅니다."

음식 배달 회사는 AI 챗봇을 OpenAI + Gemini + Claude 위에 멀티 게이트웨이로 구축했다. 어떤 단일 프로바이더에도 종속되지 않고 90~95% 고객 서비스 자동화를 달성했다.

"내 초점은 도구가 아닙니다. 플랫폼을 만드는 거예요. 그리고 일단 플랫폼이 있으면 — 사람들은 그걸 쓰고, 우리는 모델이 더 좋아지거나 더 싸지면 피벗할 유연성을 갖죠." — Technology 회사 운영 책임자

지속 가능한 경쟁 우위는 — Foundation Model이 아니라 Orchestration Layer에 있다.

2026년 — 중국 오픈소스의 부상

스탠퍼드는 보고서에서 2026년 초의 흥미로운 변화를 짚었다. OpenRouter(400+ 모델 API 라우팅 플랫폼)의 2월 16일자 데이터:

1. MiniMax M2.5 — 2.57T (중국 오픈소스)

2. Kimi K2.5 — 1.04T (중국 오픈소스)

3. Gemini 3 Flash Preview — 859B

4. GLM 5 — 803B (중국 오픈소스)

5. DeepSeek V3.2 — 745B (중국 오픈소스)

6. Grok 4.1 Fast — 669B

7. Claude Opus 4.6 — 643B

8. Claude Sonnet 4.5 — 534B

9. Trinity Large Preview (free) — 449B

10. Gemini 2.5 Flash — 431B

Top 5 중 4개가 중국 오픈소스 모델이다. 이는 2025년에 비해 극적인 변화다. 미국 엔터프라이즈는 여전히 컴플라이언스·지원·벤더 자격 때문에 OpenAI·Anthropic·Google·Meta(Llama)에 의존하지만 — 에이전트 워크로드가 토큰을 기하급수로 소비하면서 비용 압력이 오픈소스 채택 가속 요인이 되고 있다.

"오픈소스 모델은 폐쇄 모델 성능의 90%에 도달했고 빠르게 수렴하고 있다. 그러나 폐쇄 모델이 여전히 토큰 사용량의 약 80%를 차지한다." — MIT, 2025년 11월 OpenRouter 추론 데이터 분석

10장. 임원 스폰서십 — 결재가 아니라 행동이다

4단계 스폰서십 모델

스탠퍼드는 임원 스폰서십을 4단계로 분류했다.

| 레벨 | 정의 | 비중 |

|---|

| 1. Passive Approval | 예산 승인, 완전 위임, 거의 무관여 | 0% (성공 사례에 없음) |

| 2. Periodic Oversight | 월간 리뷰, 에스컬레이션 시 블로커 제거, 반응적 | 12% |

| 3. Active Steering | 주 1회 체크인, 선제적 블로커 제거, 의사결정 참여 | 58% |

| 4. Strategic Integration | AI가 회사 OKR에 직접 묶임, 인센티브가 도입에 연동, 문화 변화 | 29% |

조직 전체 변혁을 이룬 7개 케이스 전부가 레벨 4(전략적 통합)에 도달했다. 레벨 4를 향해 갈수록 — 단일 프로젝트가 아니라 회사 전체 체질이 바뀐다.

효과적인 스폰서가 실제로 하는 4가지 활동

효과적 스폰서의 활동 (N=51, 다중 답변)

자원 배분 (예산·인력·인프라)

59%

테이블 스테이크

전략 통합 (AI를 OKR에 연결)

49%

차별화

조직 커뮤니케이션 (전사 메시징)

32%

중요

블로커 제거 (선제적 장애물 청소)

20%

진짜 차이

자원 배분은 기본기. 진짜 차이는 블로커 제거에 있다. 팀이 에스컬레이션할 이전에 장애물을 미리 청소해주는 것.

Strategic Integration 사례 — 반도체 회사의 OKR 강제

대형 반도체 회사. 처음엔 부서별로 LLM 에이전트를 따로따로 만들어 데모는 됐지만 생산엔 못 갔다. 코디네이션 부재, 공유 표준 부재. AI 리더는 이게 부서 스폰서십의 한계임을 인식했다.

그가 한 세 가지:

- 모든 부서에 AI 챔피언 임명 — 엔지니어링·IT는 빨리 수용. 법무·HR 등 비기술 부서가 늦었다. 각 부서 챔피언이 동료 압력으로 도입을 끌었다.

- AI 도입을 회사 OKR에 만듦 — 동료 압력이 부족하자 CEO에게 에스컬레이션해 AI 도입을 회사 성공 측정 지표로 만들었다.

- AI Demo Days 개최 — CEO가 직접 시상하고 도입 팀에 인지를 줬다. AI는 IT 실험이 아니라 전략 우선순위임을 신호.

결과:

데이터 수집 시간

40+ 시간 → < 1시간

완전 데이터로 이슈 처리

0% → 95%+

제품 테스팅 사이클

20% 단축

"AI는 마음가짐 변화입니다. 그 이상이 아닙니다. 완전히 변화 관리에 의해 추동되는 일이에요." — 제조 회사 AI 리더

4번째 발견 — 실패 허용 문화

스탠퍼드 보고서의 Finding 4는 섬뜩한 통계로 시작한다.

"우리가 검토한 케이스 중 실패한 AI 이니셔티브 때문에 누가 처벌받은 사례는 단 한 건도 없었다."

성공한 회사의 73%가 의도적으로 작게 시작했고, 63%가 파일럿을 명시적 실험으로 프레이밍했다. 작은 파일럿은 값싸게 실패한다. 값싼 실패는 커리어를 끝내지 않는다. 그리고 실패가 학습이 되려면 — 다음 시도에서 같은 스폰서가 계속 책임져야 한다. 스탠퍼드 데이터에 따르면 실패 후 스폰서가 바뀌면 — 조직 기억이 함께 사라진다. 무엇을 하지 말아야 할지, 누구를 끌어들여야 할지, 진짜 병목이 어디였는지가 함께 사라진다.

11장. 한국 기업이 지금 당장 적용해야 할 7가지

스탠퍼드 보고서는 미국·라틴아메리카·유럽·아시아의 51개 케이스를 분석했다. 한국 기업 한 곳도 포함돼 있다 (제조업 채용·보상 사례). 그러나 발견은 산업·국가를 초월한다. 한국 기업이 지금 당장 적용해야 할 액션을 정리한다.

| 한국 기업의 흔한 패턴 | 스탠퍼드의 발견 | 즉시 액션 |

|---|

| 대기업 회의에서 "어떤 모델 쓸까" 30분 토론 | 42%는 모델이 커머디티 | 모델 비교가 아니라 멀티-게이트웨이부터 깔아라 |

| "우리 데이터가 더러워서 AI 못 한다" | 완전 깨끗한 데이터는 6%, LLM이 88%의 더러운 데이터 해결 | 일단 모든 데이터를 저장하라. 완벽함 기다리지 마라 |

| 법무·HR이 멈춰서 1년째 못 가는 PoC | 35%가 스태프 기능 저항이 원인 | 설득 아닌 강제(mandate): AI 도입을 회사 OKR에 묶어라 |

| "AI가 만들면 사람이 다 검토"하는 협업 모델 | 에스컬레이션 모델 71% vs 협업 모델 30% 생산성 | 오류 허용도가 높은 영역엔 자율을 줘라. 80%가 충분하다 |

| "AI로 비용 절감"만 측정 | 매출형 적용이 최고 ROI 케이스들 (인슈어런스 4시간 계약서 = 거래 성사) | "AI로 우리가 이전에 못 따던 거래를 어떻게 따나"로 질문을 바꿔라 |

| 임원이 분기에 한 번 들어와 진척 확인 | 주 1회 직접 블로커 제거가 차이 | 스폰서십은 결재가 아니라 행동. 매주 1시간 확보하라 |

| "신입 채용은 그대로 유지하면서 AI 도입" | 22~25세 AI 노출 직군 신입 고용 16% 감소 (이미 진행 중) | 채용 회피·재배치 전략으로 가속화하면 사회적 비용 최소화 |

한국 산업별 우선 적용 영역

제조업: 슈퍼마켓 사례처럼 조달·재고를 에이전트가 전담. 24개 매장에서 EBITDA 두 배. 한국 제조 SCM에 그대로 적용 가능.

금융업: 대형 은행 사례처럼 PII 스크러빙 + 클라우드 LLM. 한국 금융권 망분리 정책과의 협상에서 정확히 같은 아키텍처 가능.

물류·유통: 송장 처리 사례 — 7명 → 2명, 100만 달러 가치. 한국 3PL·유통 회사가 가장 즉시 효과를 볼 수 있는 영역.

의료·헬스케어: ambient transcription. 번아웃 의사가 AI를 비공식 도입하는 그림자 AI 패턴이 이미 한국 의료계에서 진행 중. 공식 채널 가속 필요.

전문서비스: 채용 AI (3시간 → 3분/포지션, +75% 후보자 전환). 한국 법무·회계·컨설팅 펌의 시니어 시간 가장 비싸게 새는 곳이다.

12장. 결론 — 기술이 아니라 조직이 답이다

보고서가 말하는 단 하나의 메시지

스탠퍼드 51개 케이스가 7개 국가, 9개 산업, 14개 직군에서 발견한 변하지 않는 사실은 단 하나다.

"동일한 기술, 동일한 유스케이스 — 그러나 결과는 극단적으로 다르다. 차이는 AI 모델이 아니었다. 차이는 조직이었다. 그 준비도, 그 프로세스, 그 리더십, 그 변하려는 의지, 그 실패하려는 의지." — 보고서 서문

기술은 가장 쉬운 부분이다. 그 다음 길은 모두 — 사람·프로세스·문화의 길이다.

2026년에 살고 있는 우리에게

스탠퍼드 보고서가 2026년 4월 — 지금 — 발표된 의미는 분명하다.

2025년은 에이전틱 AI가 대중적 시야에 들어온 해였다. METR 데이터는 — 7개월마다 두 배로 AI 자율 작업 능력이 늘고 있다고 말한다. 2026년 초에는 15시간 인간 전문가 작업을 AI가 자율 완수한다. 이 곡선이 계속된다면 — 2027년이면 약 30시간, 2028년이면 60시간, 2029년이면 한 주, 2030년이면 한 달 분의 인간 전문가 작업을 AI가 단번에 끝낸다는 의미다.

스탠퍼드의 51개 사례에서 에이전틱은 아직 20%에 불과하지만, 생산성은 71%다. 3년 뒤엔 — 이 20%가 다수가 될 것이다. 그리고 그 회사들은 지금 도입을 시작한 회사들이다.

"실험의 창은 닫히고 있다. 질문은 더 이상 AI가 가치를 줄 것이냐가 아니다. 조직이 그것을 잡을 만큼 빠르게 진화할 수 있느냐다 — 그리고 효율이 실현되는 동안 노동자와 공동체에 전환을 부드럽게 해줄 사회적 책임이 무엇이냐다." — 보고서 결론

한국에서 일하는 사람에게

당신이 대기업 IT 부서장이라면 — 다음 주 회의에서 모델 비교 PPT 대신 현재 PoC가 멈춰 있는 비기술적 이유 (조직 저항)를 적어 가져가라.

당신이 스타트업 창업자라면 — 51개 케이스가 보여주듯 작은 회사가 큰 회사를 지능으로 대체할 수 있는 시대다. 한국에서 그 격차는 더 크다.

당신이 임원이라면 — 결재 도장이 스폰서십이 아니다. 주 1회 1시간이 스폰서십이다. 팀에 실패할 권리를 주는 게 스폰서십이다.

당신이 현장 직원이라면 — AI는 당신을 대체하지 않는다. AI는 회사가 추가로 채용할 사람을 대체한다. 당신이 해방된 4.5 FTE가 될지, 대체된 7명 중 한 명이 될지는 — 당신이 새 가치를 만들어내느냐에 달려 있다.

Stanford Digital Economy Lab의 Brynjolfsson 교수가 보고서 마지막에 쓴 문장이 — 가장 압축적인 결론이다.

"기술이 어려운 게 아니다. 다른 모든 것이 어렵다."

그리고 — 그 "다른 모든 것"이 — 오늘 한국 기업이 들여다봐야 할 거울이다.

부록: 51개 케이스를 직접 읽고 싶은 분께

스탠퍼드 디지털 경제 연구소의 The Enterprise AI Playbook: Lessons from 51 Successful Deployments는 — Elisa Pereira · Alvin Wang Graylin · Erik Brynjolfsson이 2026년 4월에 발표했다. 116페이지. 11개 챕터 + 부록(KPI 가이드 + 6가지 실패 원인 분석 + 41개 익명 조직 리스트). 학술 보고서지만 경영진을 위한 실용서로 읽힌다. 한국 기업의 모든 IT·전략·인사 임원의 필독서다.

본 글에서 분석한 주요 케이스 스터디 8건은 — 원문에서 더 깊은 디테일을 확인할 수 있다.

| 케이스 | 핵심 결과 | 교훈 |

|---|

| 물류 송장 처리 (1.3조 원 회사) | 7→2명, $1M+, 8주 구축, 정확도 85% | "80%면 충분하다" 패러다임 |

| 번역 서비스 채용 AI | 3시간 → 3분/포지션, +75% 후보자 전환, 1개월 구축 | 실패한 첫 시도 후 CEO가 직접 오너십 |

| 금융 서비스 마케팅 | 7주 → 6시간, 2배 CTR, 80/20 모델 | 인간 감독은 생산성 세금이 아니다 |

| 반도체 현장 서비스 | 40시간 → 1시간 데이터 수집, 95%+ 완전 데이터 | OKR + AI 챔피언 + Demo Days로 cross-functional 돌파 |

| 기술 서비스 SOC | 1,500 → 40,000 알람/월, 6→1.5 FTE, 0명 해고 | "대체할 사람은 채용 안 한 사람" 프레임 |

| 에듀테크 엔지니어링 | 20~30% 시간 단축, 인원 무감축, 로드맵 가속 | 같은 생산성 이득 — 감축이 아닌 가속화 |

| 콜센터 (CCaaS) | 20+ 신규 프로젝트 수주, Top 4 AI for CX | AI = 비용 절감 아니라 경쟁 위치 변경 |

| 슈퍼마켓 조달 (24개 매장) | 낭비 40% 감소, 품절 80% 감소, EBITDA 두 배 | 완전 자율 에이전트가 작은 회사에 큰 회사 스케일을 준다 |

"기술이 어려운 게 아니라 조직이 어렵다" — 이 한 문장이, 오늘 한국 기업이 AI 시대에 살아남는 유일한 진실이다.

코어닷투데이는 기술뿐 아니라 — 조직과 함께 일한다. 한국 기업이 51개 케이스 중 어느 길을 갈지는 — 오늘의 결정에 달려 있다.

함께 읽으면 좋은 글

- 에이전틱 AI 심층 가이드 — 본 글의 8장에서 다룬 에이전트 AI의 기술적 디테일

- AI 트러스트워디네스 평가 — 보고서의 보안·HITL 장과 연결되는 신뢰성 평가 체계

- AI 인지 아웃소싱의 위기 — 인력 감축 vs 재배치 논쟁의 사회적 함의