기계는 괜찮다, 나는 우리가 걱정된다 — AI 시대의 '인지적 외주화' 위기

AI가 논문을 쓰고 코드를 짜는 시대. 하지만 정말 위험한 건 기계가 아니라, 생각하는 법을 잊어가는 우리 자신이다. '인지적 외주화'의 역사와 과학, 그리고 2026년의 현실.

AI가 논문을 쓰고 코드를 짜는 시대. 하지만 정말 위험한 건 기계가 아니라, 생각하는 법을 잊어가는 우리 자신이다. '인지적 외주화'의 역사와 과학, 그리고 2026년의 현실.

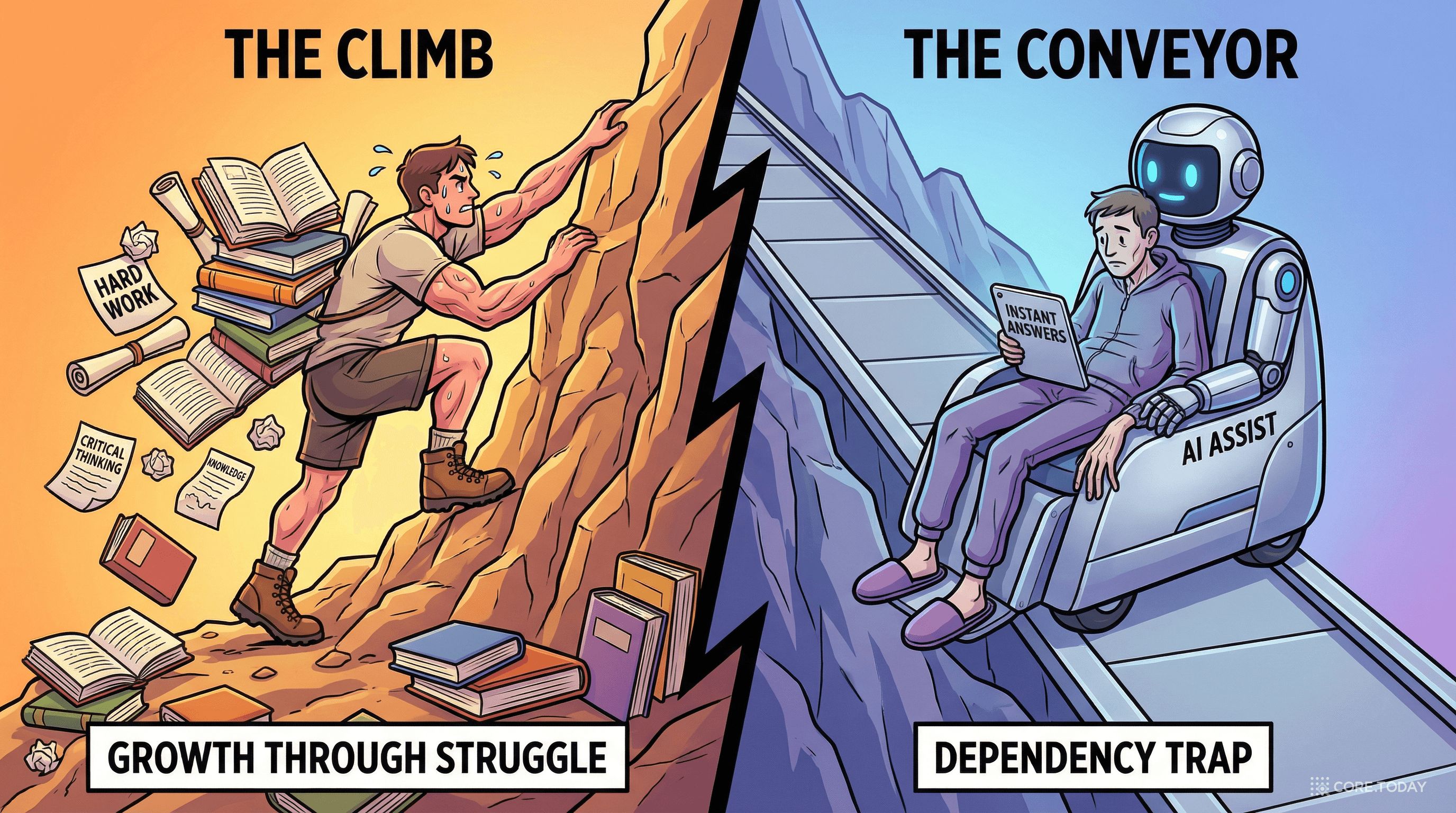

2026년 봄, 한 물리학과 대학원에 두 명의 박사과정 학생이 있다. 앨리스와 밥이라고 부르자.

앨리스는 논문을 읽을 때 펜으로 밑줄을 긋고, 수식을 직접 유도해 본다. 코드가 안 돌아가면 에러 메시지를 하나하나 추적한다. Matplotlib의 좌표계가 왜 그렇게 설계되었는지 화가 나서 3시간을 보낸 적도 있다. 논문 한 편을 쓰는 데 8개월이 걸렸다.

밥도 논문을 냈다. 같은 학회, 같은 수준의 결과. 하지만 밥은 AI 에이전트에게 문헌 조사를 시키고, 코드 작성을 맡기고, 수식 유도를 검증받았다. 에러가 나면 "이 에러 고쳐줘"라고 입력했다. 논문은 3개월 만에 나왔다.

지도교수는 둘의 차이를 구분할 수 없다. 학회 심사위원도, 취업위원회도, 이력서를 보는 누구도. 두 사람의 출판 실적은 동일하다. 하지만 5년 후, 10년 후 — 이 둘은 같은 과학자일까?

"인센티브 구조는 앨리스와 밥을 구분하지 못할 뿐 아니라, 구분하려고 시도할 이유조차 없다." — ergosphere, "The Machines Are Fine"

이 글은 2026년 학술계와 기술 커뮤니티를 뒤흔든 한 에세이에서 출발한다. 물리학자 ergosphere가 쓴 "The Machines Are Fine. I'm Worried About Us."는 AI의 능력이 아니라 AI가 인간의 지적 발달에 미치는 영향을 정면으로 다룬다. 기계는 점점 좋아지고 있다. 문제는 우리가 점점 나빠지고 있을 수 있다는 것이다.

이 문제를 깊이 이해하기 위해, 우리는 멀리 돌아가야 한다. 1966년의 철학자, 1994년의 심리학자, 그리고 1965년의 SF 소설가까지.

ergosphere의 에세이에서 가장 강력한 부분은 앨리스와 밥의 우화다. 이 우화가 무서운 이유는, 기존의 평가 시스템이 두 사람을 전혀 구분하지 못한다는 점이다.

| 앨리스 | 밥 | |

|---|---|---|

| 논문 수 | 3편 | 4편 |

| 학회 발표 | 2회 | 3회 |

| 코딩 능력 (외견상) | Python 능숙 | Python 능숙 |

| 지도교수 평가 | "꼼꼼하고 성실함" | "빠르고 생산적" |

| 에러 디버깅 | 직접 추적, 3시간 소요 | AI에게 전달, 5분 해결 |

| 수식 이해 | 유도 과정 체득 | 결과값만 확인 |

| 암묵적 직관 | 축적 중 | 부재 |

여기서 핵심적인 통찰이 있다. "잡일(grunt work)"이라고 불리는 것들 — 디버깅, 문헌 조사, 수식 유도, 데이터 탐색 — 이것들이 실은 학습 그 자체다. 지루한 부분과 중요한 부분은 사전에 분리할 수 없는 방식으로 뒤엉켜 있다.

물리 교과서에 연습 문제가 있는 이유는, 누가 물리를 하는 것을 구경만 해서는 물리를 배울 수 없기 때문이다.

이 논의를 이해하려면 마이클 폴라니(Michael Polanyi)에서 시작해야 한다. 1966년, 헝가리 출신의 과학철학자 폴라니는 『암묵적 차원(The Tacit Dimension)』을 출간하면서 유명한 명제를 제시한다:

"우리는 말할 수 있는 것보다 더 많이 알고 있다." — Michael Polanyi, The Tacit Dimension (1966)

자전거를 타는 법을 안다. 하지만 "몸을 왼쪽으로 1.3도 기울이면서 핸들을 오른쪽으로 0.7도 꺾어라"라고 설명할 수는 없다. 과학 연구도 마찬가지다. 숙련된 물리학자가 그래프를 보고 "뭔가 이상하다"고 느끼는 직관, 실험에서 "이 데이터는 믿을 수 없다"고 판단하는 감각 — 이것이 암묵지(tacit knowledge)다.

1970년대, 전자 계산기가 교실에 들어오기 시작했을 때 교육자들은 격렬하게 논쟁했다. "학생들이 구구단을 외울 필요가 없어지면 수학적 사고가 퇴화하는 것 아닌가?" 미국수학교사협의회(NCTM)는 1989년 계산기 사용을 공식 승인했고, 연구 결과(Hembree & Dessart, 1986)도 계산기가 문제 해결력을 향상시킨다고 보고했다.

하지만 결정적인 조건이 있었다: 수동 계산 연습을 대체하지 않고 보완할 때만. 계산기에 의존한 학생들은 수 감각(number sense)과 추정 능력이 약화되었다는 후속 보고가 꾸준히 나왔다.

더 놀라운 사례는 GPS다.

Ishikawa et al. (2008)의 연구에 따르면, GPS로 성공적으로 목적지에 도착한 사람들은 자신이 지나온 경로의 정확한 지도를 그릴 수 없었다. 더 충격적인 건 Dahmani & Bherer (2018)의 연구다: GPS를 습관적으로 사용하는 사람들은 해마(hippocampus)의 회백질이 줄어들어 있었다. 도구가 뇌의 물리적 구조를 바꾼 것이다.

항공 분야에서는 이 현상이 생사를 가른다. Casner et al. (2014)은 자동항법(autopilot)에 주로 의존하는 항공기 조종사들이 수동 조종이 필요한 비상 상황에서 유의미한 기술 저하를 보인다는 것을 발견했다. 오토파일럿이 조종사를 더 안전하게 만들었지만, 오토파일럿이 실패할 때 조종사는 더 위험해졌다.

계산기, GPS, 자동항법 — 패턴은 동일하다. 인지적 노력을 제거하는 도구는 해당 영역의 능력을 퇴화시킨다. 이것이 지금 AI와 함께 학술 연구에서 벌어지고 있는 일이다.

1994년, UCLA의 인지심리학자 로버트 비요크(Robert Bjork)는 학습 과학의 상식을 뒤집는 개념을 제시한다: "바람직한 어려움(desirable difficulties)."

비요크의 발견을 한 문장으로 요약하면 이렇다:

단기적으로 학습을 어렵게 만드는 조건이, 장기적으로는 더 나은 기억과 전이(transfer)를 만든다.

이것은 직관에 반한다. 우리는 쉽게 배우면 잘 배운 것이라고 느낀다. 하지만 비요크는 이 느낌이 착각(illusion of competence)이라는 것을 실험으로 증명했다.

| 쉬운 학습 | 어려운 학습 | |

|---|---|---|

| 학습 중 느낌 | "잘 이해됐다!" | "힘들다, 모르겠다" |

| 직후 테스트 | 높은 점수 | 낮은 점수 |

| 1주 후 테스트 | 급격한 하락 | 유지 또는 상승 |

| 새로운 상황 적용 | 잘 안 됨 | 잘 됨 |

| AI 비유 | AI가 답을 바로 제공 | AI 없이 직접 해결 |

비요크가 발견한 핵심적인 어려움들은 이렇다:

비요크 연구 프로그램의 결정판은 2015년에 나온다. Soderstrom & Bjork는 "수행(performance)"과 "학습(learning)"은 다르다는 것을 체계적으로 정리한다.

AI 도구는 수행을 극적으로 향상시킨다. 하지만 그것이 학습을 향상시키는 것은 아니다. 오히려 어려움을 제거함으로써 학습을 저해할 수 있다.

이론이 아니라 실험 데이터가 있다. 와튼스쿨의 Bastani et al. (2024)는 터키 고등학생들을 대상으로 무작위 대조 시험을 수행했다.

결과는 충격적이었다:

이것은 비요크의 "수행 vs 학습" 구분을 거의 완벽하게 재현한 결과다. AI가 답을 직접 주면 수행은 올라가지만 학습은 떨어진다. AI가 생각하게 만들면 해가 되지 않는다.

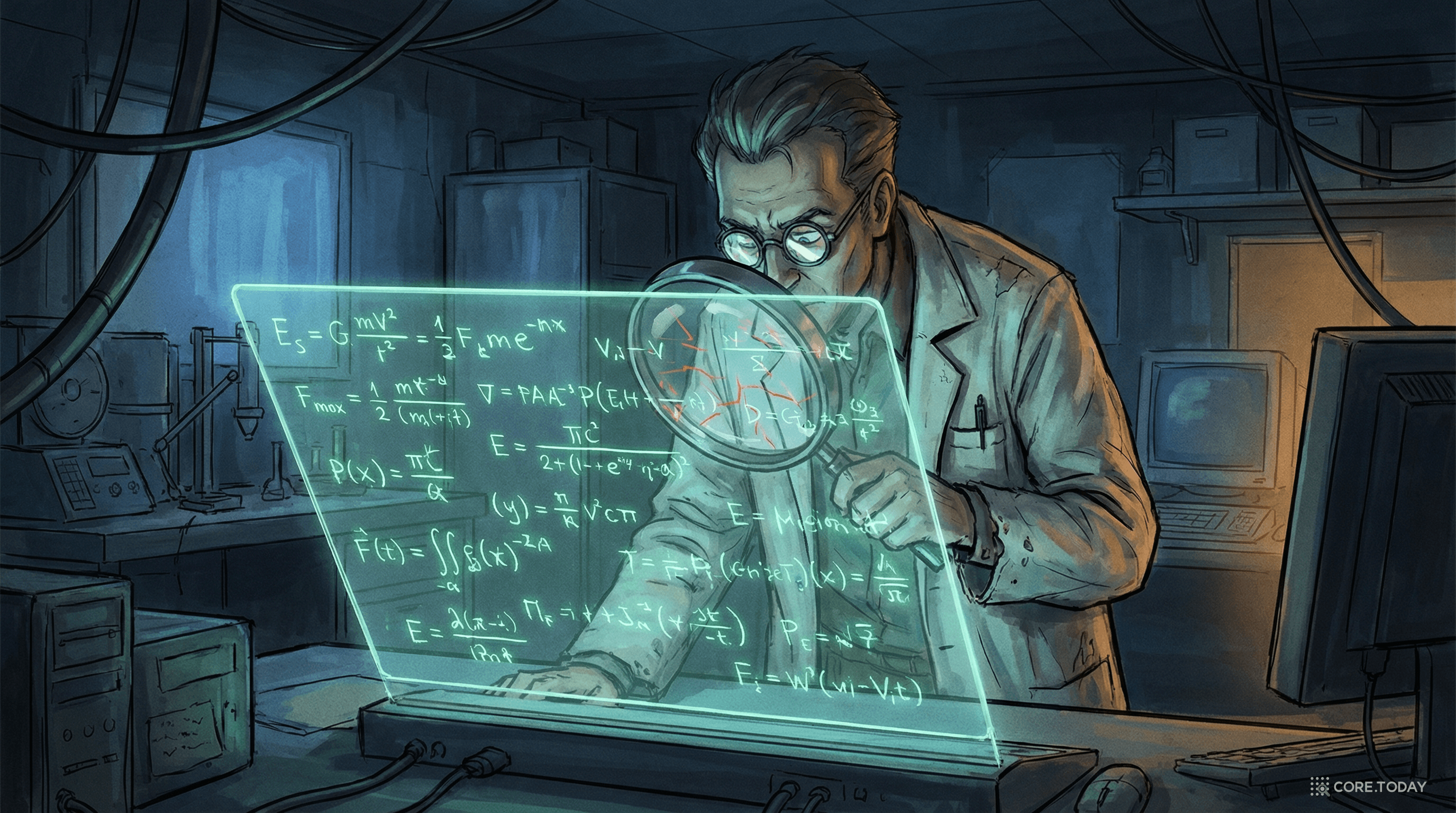

2025년 초, 하버드의 이론물리학자 매튜 슈워츠(Matthew Schwartz)는 대담한 실험을 했다. Anthropic의 Claude에게 이론물리학 계산을 시키고, 자신이 감독하여 논문을 완성한 것이다.

결과는 놀라웠다. 통상 1년이 걸리는 작업이 2주 만에 완료되었다. 논문은 표면적으로 출판 가능한 수준이었다.

하지만 슈워츠가 발견한 것은 그 이면의 이야기다.

슈워츠 실험의 가장 중요한 교훈은 이것이다:

"감독(supervision)이 곧 물리학이다."

더 강력한 모델이 나온다고 전문가 감독이 불필요해지는 것이 아니다. 더 강력한 모델은 감독되는 에이전트가 다룰 수 있는 영역을 확장할 뿐이다. 감독 자체를 대체하지는 않는다.

그런데 문제가 있다. 감독할 능력은 직접 그 일을 해본 사람만 갖고 있다. 밥처럼 처음부터 AI에게 작업을 맡겨온 사람은, 설령 자리를 잡더라도, AI가 만든 "아름다운 거짓말"을 감지할 직관이 없다.

2024년 Nature의 연구자 설문조사에 따르면, 약 30%의 연구자가 AI 도구를 연구에 활용한다고 응답했다. 하지만 익명 자가 보고와 실제 논문 공시 사이에 큰 격차가 있어, 실제 사용률은 훨씬 높을 것으로 추정된다.

Andrew Gray (UCL, 2024)의 계량서지학 분석은 더 직접적인 증거를 제시한다. 2024년 출판된 논문에서 "delve", "meticulous", "commendable", "intricate" 같은 LLM 특유의 어휘 사용이 급증했으며, 최소 10% 이상의 논문에서 LLM 보조의 흔적이 감지되었다.

2024년 Wiley는 산하 Hindawi 저널에서 11,000편 이상의 논문을 철회하고 19개 저널을 폐간했다. AI가 논문 공장의 생산 속도와 품질을 모두 높인 결과다.

| 학술지 | AI 저자 허용 | 사용 공시 | 비고 |

|---|---|---|---|

| Nature | ❌ | 필수 | AI 생성 이미지도 공시 필요 |

| Science | ❌ | 필수 | 편집장이 가장 엄격한 입장 |

| The Lancet | ❌ | 필수 | 인간이 모든 내용에 책임 |

| IEEE | ❌ | 필수 | 2024년 정책 업데이트 |

| arXiv | — | 권장 | 사전심사 없이 제출자 책임 |

모든 주요 학술지가 동의하는 원칙은 세 가지다: (1) AI는 저자가 될 수 없다 — 책임을 질 수 없으므로, (2) AI 사용은 반드시 공시해야 한다, (3) 인간이 모든 내용에 전적으로 책임진다.

하지만 ergosphere가 지적하듯, 이 정책들은 논문의 품질은 관리할 수 있어도, 연구자의 발달은 관리하지 못한다. 밥의 논문도 정책을 완벽히 준수할 수 있다.

1965년, SF의 거장 프랭크 허버트(Frank Herbert)는 『듄(Dune)』을 출간한다. 이 소설의 세계에서는 "사고하는 기계(thinking machines)"가 전면 금지되어 있다. 오렌지 가톨릭 성경의 계명은 이렇게 선언한다:

"인간의 정신을 닮은 기계를 만들지 말라." — 오렌지 가톨릭 성경, 『듄』 (1965)

많은 사람이 이것을 터미네이터식 "기계 반란" 이야기로 오해한다. 하지만 허버트의 진짜 관심사는 기계가 아니라 인간이었다.

"인간은 한때 생각하는 일을 기계에 넘겼다. 그것이 자신을 자유롭게 해줄 것이라 희망하며. 하지만 그것은 다른 인간이 기계를 사용해 그들을 지배하는 것만을 허용했다." — 『듄』 부록 II

듄 세계에서 사고하는 기계를 금지한 결과, 인류는 멘탯(Mentat) — 인간 컴퓨터 — 을 훈련시킨다. 극한의 인지 훈련을 받은 인간이 기계의 역할을 대신하는 것이다. 허버트의 암묵적 주장은 이렇다: 기계라는 목발을 제거하면, 인간의 인지적 잠재력이 극대화된다.

1981년 『듄의 신황제(God Emperor of Dune)』에서 허버트는 더 날카로운 통찰을 남긴다:

"그런 기계가 실제로 하는 일이 뭔가? 생각하지 않고도 할 수 있는 일의 수를 늘리는 것이다. 생각하지 않고 하는 일, 거기에 진짜 위험이 있다."

그리고 허버트의 가장 유명한 경고:

"컴퓨터의 위험은 그것이 인간만큼 지능적이 되는 것이 아니라, 우리가 그것을 만나기 위해 반쯤 내려가는 데 동의하는 것이다."

이 말을 2026년의 맥락에 놓으면 소름이 돋는다. AI가 인간을 지배하는 디스토피아가 아니라, 인간이 자발적으로 사고를 포기하는 디스토피아 — 허버트는 60년 전에 이것을 정확히 예견했다.

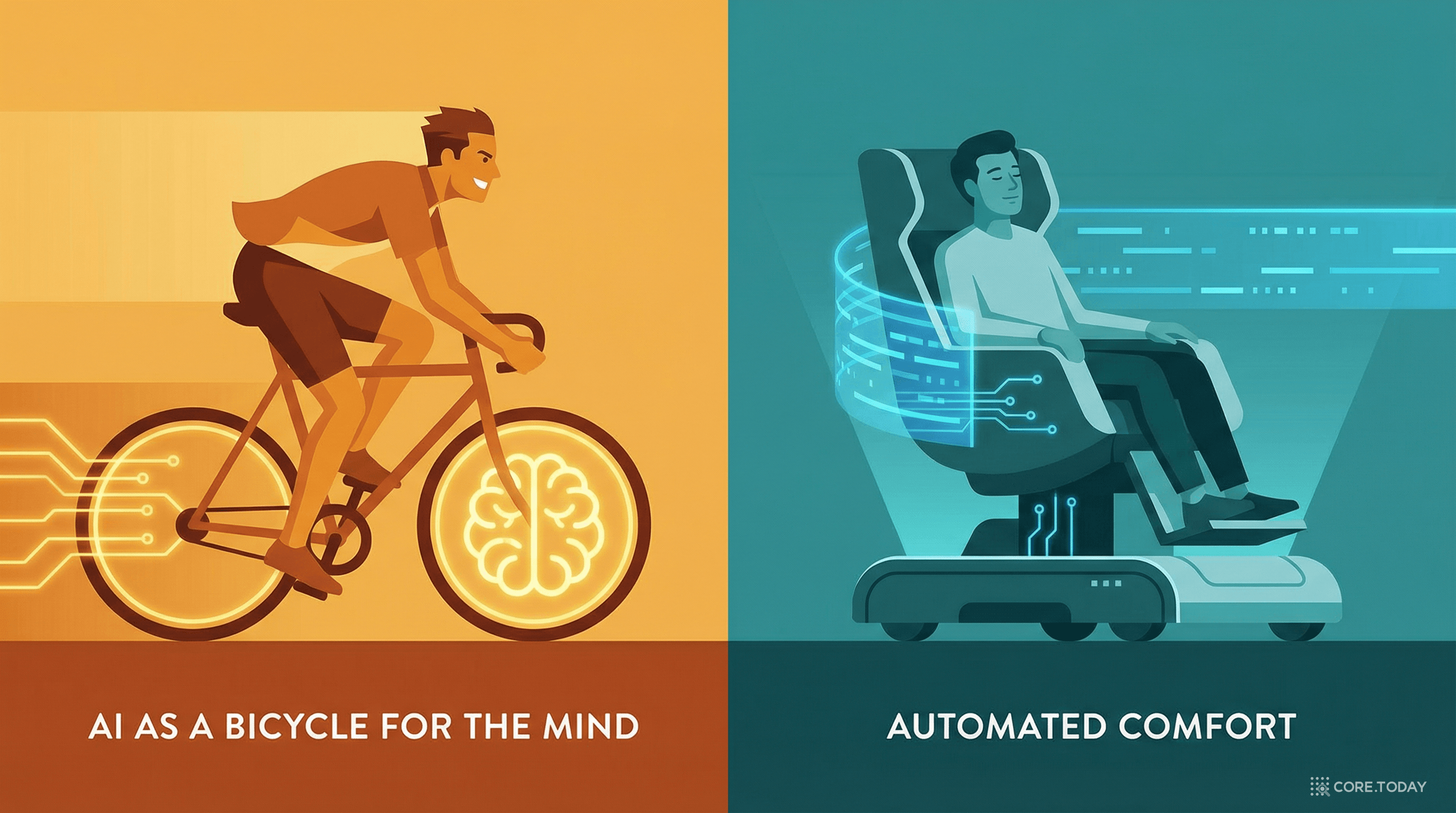

1990년, 스티브 잡스는 유명한 비유를 했다: "컴퓨터는 마음의 자전거"라고. 자전거가 인간의 이동 효율을 콘돌보다 높이듯, 컴퓨터는 인간의 사고 효율을 높인다는 것이다.

하지만 2025–2026년의 연구들은 이 비유를 두 가지 모드로 분화시켰다:

| 마음의 자전거 | 마음의 휠체어 | |

|---|---|---|

| 핵심 | 인간이 여전히 "페달을 밟는다" | 인지적 노력이 제거된다 |

| AI의 역할 | 소크라테스식 질문, 힌트, 피드백 | 직접 답 제공, 코드 작성, 글 생성 |

| 학습 효과 | 향상 또는 유지 | 저하 (Bastani et al., -17%) |

| 비유 | 검색 엔진으로 단서 찾기 | ChatGPT에게 에세이 쓰라고 하기 |

| 사용자의 상태 | 더 강해진다 | 의존성이 생긴다 |

| 예시 | "이 에러의 원인이 뭘까?" | "이 에러 고쳐줘" |

와튼스쿨의 에단 몰릭(Ethan Mollick)은 AI 교육의 낙관론자다. 그는 AI가 소크라테스식 튜터, 토론 상대, 피드백 생성기로 사용될 때 학습을 향상시킬 수 있다고 주장한다. 하지만 같은 와튼스쿨의 Bastani et al.은 제약 없는 AI 접근이 학습을 해친다는 것을 보여주었다.

결론은 "AI가 좋은가 나쁜가"가 아니라, "어떻게 사용하는가"다.

ergosphere의 에세이에는 우주론자 나탈리 호그(Natalie Hogg)의 진솔한 고백이 인용된다. 처음에는 LLM의 열렬한 회의론자였던 그녀는, 어느새 매일 사용하는 사용자가 되어 있었다. 그녀는 이렇게 인정한다:

"내 확고한 원칙들이 생각보다 맥락 의존적이었다는 것이 드러났다."

그리고 가장 솔직한 부분: 기계가 자신감 있고 깔끔하게 포맷된 답을 제시할 때, 신중하게 검증하려는 의지가 약해지는 유혹을 느낀다고.

이것이 ergosphere가 말하는 "조용한 위험"이다:

"문제는 우리가 생각하기를 그만둘 것이라는 게 아니다. 문제는 우리가 그만두고 있다는 것을 거의 알아차리지 못할 것이라는 점이다."

AI 활용의 또 다른 위험은 잘 보이지 않는 곳에 있다. Doshi & Hauser (2024)의 Science Advances 논문은 이런 결과를 보여준다:

이것은 생태학에서 말하는 모노컬처(monoculture)의 위험과 같다. 단일 품종의 작물이 효율적이지만 한 가지 병에 전멸하듯, 모든 연구가 AI가 제안하는 "최적" 경로를 따르면 집단적 취약성이 생긴다.

ergosphere의 에세이는 두 극단을 모두 거부한다:

| 금지 | 중간 지대 | 무제한 | |

|---|---|---|---|

| 주장 | AI 연구 도구 사용 금지 | 도구 사용 ↔ 인지적 외주화 구분 | 모든 AI 사용 허용 |

| 문제점 | 집행 불가능, 반민주적 | 경계가 모호, 지속적 판단 필요 | 논문 공장 범람, 학습 저해 |

| 지지자 | 소수 보수파 | David Hogg, ergosphere | 실리콘밸리 생산성론 |

David Hogg(NYU 천체물리학자)의 백서는 중요한 원칙을 제시한다:

"천체물리학에서 사람은 수단이 아니라 목적이다." 대학원생을 특정 결과를 내기 위해 고용하는 것이 아니라, 그들의 발달을 위해 연구에 참여시키는 것이다.

| 도구 사용 (Tool Use) | 인지적 외주화 (Cognitive Outsourcing) | |

|---|---|---|

| 문법 검사 | ✅ | |

| 참고문헌 포맷 | ✅ | |

| Matplotlib 문법 확인 | ✅ | |

| 코드 자동완성 (인텔리센스) | ✅ | |

| 연구 방법론 선택 | ❌ | |

| 데이터 해석 | ❌ | |

| 논증 구성 | ❌ | |

| 연구 질문 설정 | ❌ |

경험 많은 연구자들이 AI로 좋은 결과를 내는 이유는, 그들이 코드가 무엇을 해야 하는지 알고 난 후에 AI에게 시키기 때문이다. 이들의 전문성이 AI 환각과 오류에 대한 면역 체계 역할을 한다. 초보 연구자에게는 이 면역 체계가 없다.

이 글에서 우리는 먼 길을 왔다.

1966년 폴라니가 "말할 수 있는 것보다 더 많이 안다"고 했을 때, 그는 인간 전문성의 핵심이 코드화할 수 없는 암묵적 차원에 있음을 보여주었다. 1994년 비요크가 "바람직한 어려움"을 발견했을 때, 그는 고통이 학습의 부산물이 아니라 학습 자체임을 증명했다. 1965년 허버트가 "생각하지 않고도 할 수 있는 일의 수를 늘린다"고 경고했을 때, 그는 60년 후의 세계를 정확히 묘사했다.

2026년인 지금, 이 모든 통찰이 하나의 현실로 수렴하고 있다.

AI는 놀라운 도구다. 숙련된 과학자의 손에서 AI는 1년짜리 작업을 2주로 줄이고, 새로운 연구 영역을 열고, 비영어권 연구자의 접근성을 높인다. 하지만 이 도구가 훈련 과정 자체를 대체할 때, 우리는 다음 세대의 숙련된 과학자 자체를 잃게 된다.

진짜 위기는 드라마틱하지 않다. AI가 인류를 지배하는 영화 같은 시나리오가 아니다. 그것은 조용하고 점진적인 인지적 표류(cognitive drift) — 결과는 낼 수 있지만 이해는 못하는 연구자 세대, 어떤 버튼을 눌러야 하는지는 알지만 왜 그 버튼이 존재하는지는 모르는 사람들의 세상이다.

이것은 악의의 결과가 아니다. 피곤할 때, 마감이 다가올 때, 기계가 자신감 있는 답을 줄 때 그럴듯한 답변을 받아들이고 넘어가려는 지극히 인간적인 경향의 결과다.

그래서 이 글의 제목은 이렇다:

기계는 괜찮다. 나는 우리가 걱정된다.