Scaling Laws 특집: AI에 돈을 쏟으면 얼마나 똑똑해질까 — 예측 가능해진 AI의 성장 법칙

AI 모델에 10배의 자원을 투입하면 성능이 얼마나 오를까? 2020년 Kaplan의 법칙은 '모델을 키워라'고 답했고, 2022년 Chinchilla는 '데이터를 키워라'로 뒤집었다. 수십억 달러 투자를 좌우하는 두 법칙의 탄생, 충돌, 그리고 2026년의 새로운 스케일링까지를 추적한다.

AI 모델에 10배의 자원을 투입하면 성능이 얼마나 오를까? 2020년 Kaplan의 법칙은 '모델을 키워라'고 답했고, 2022년 Chinchilla는 '데이터를 키워라'로 뒤집었다. 수십억 달러 투자를 좌우하는 두 법칙의 탄생, 충돌, 그리고 2026년의 새로운 스케일링까지를 추적한다.

2024년, 세계 최대 기술 기업들이 AI 데이터센터에 쏟아부은 투자 계획을 들여다보면 숫자가 비현실적이다. Meta는 650~720억 달러, Microsoft는 800억 달러 이상, Google은 750억 달러 이상을 AI 인프라에 투입하겠다고 발표했다. 합치면 2,200억 달러 — 한화로 약 320조 원이다. 대한민국 1년 국가 예산의 절반에 육박하는 돈이 GPU와 냉각 시스템과 전력 케이블에 묻히고 있다.

이 천문학적 투자의 이론적 근거가 되는 것이 있다. Scaling Laws(스케일링 법칙)다.

"모델에 10배의 자원을 넣으면, 성능이 얼마나 오를까?"

이 질문에 대해 정량적 답을 준 것이 스케일링 법칙이다. "많이 넣으면 좋아진다"는 막연한 직감이 아니라, "이만큼 넣으면 저만큼 좋아진다"는 수식으로 표현된 예측. 이 예측이 맞았기 때문에 수천억 달러가 움직였다. GPT-3가 탄생했고, GPT-4가 가능했고, 지금 이 순간에도 수만 장의 GPU가 다음 세대 모델을 학습하고 있다.

하지만 문제가 있다. 두 개의 법칙이 서로 다른 답을 내놓았다. 2020년 OpenAI의 Kaplan은 "모델을 키워라"고 말했고, 2022년 DeepMind의 Chinchilla는 "데이터를 키워라"로 뒤집었다. 한쪽은 GPT-3의 설계 근거가 되었고, 다른 한쪽은 그 GPT-3가 "11배나 과소학습됐다"고 선고했다.

이 글에서는 그 이야기를 처음부터 풀어본다. 멱법칙이란 무엇인지(제1장), Kaplan이 무엇을 발견했는지(제2장), Chinchilla가 왜 뒤집었는지(제3장), 이 법칙들이 산업을 어떻게 바꿨는지(제4장), 스케일링의 한계와 새로운 차원(제5장), 그리고 2026년 현재 이 모든 것을 어떻게 읽어야 하는지(제6장)까지.

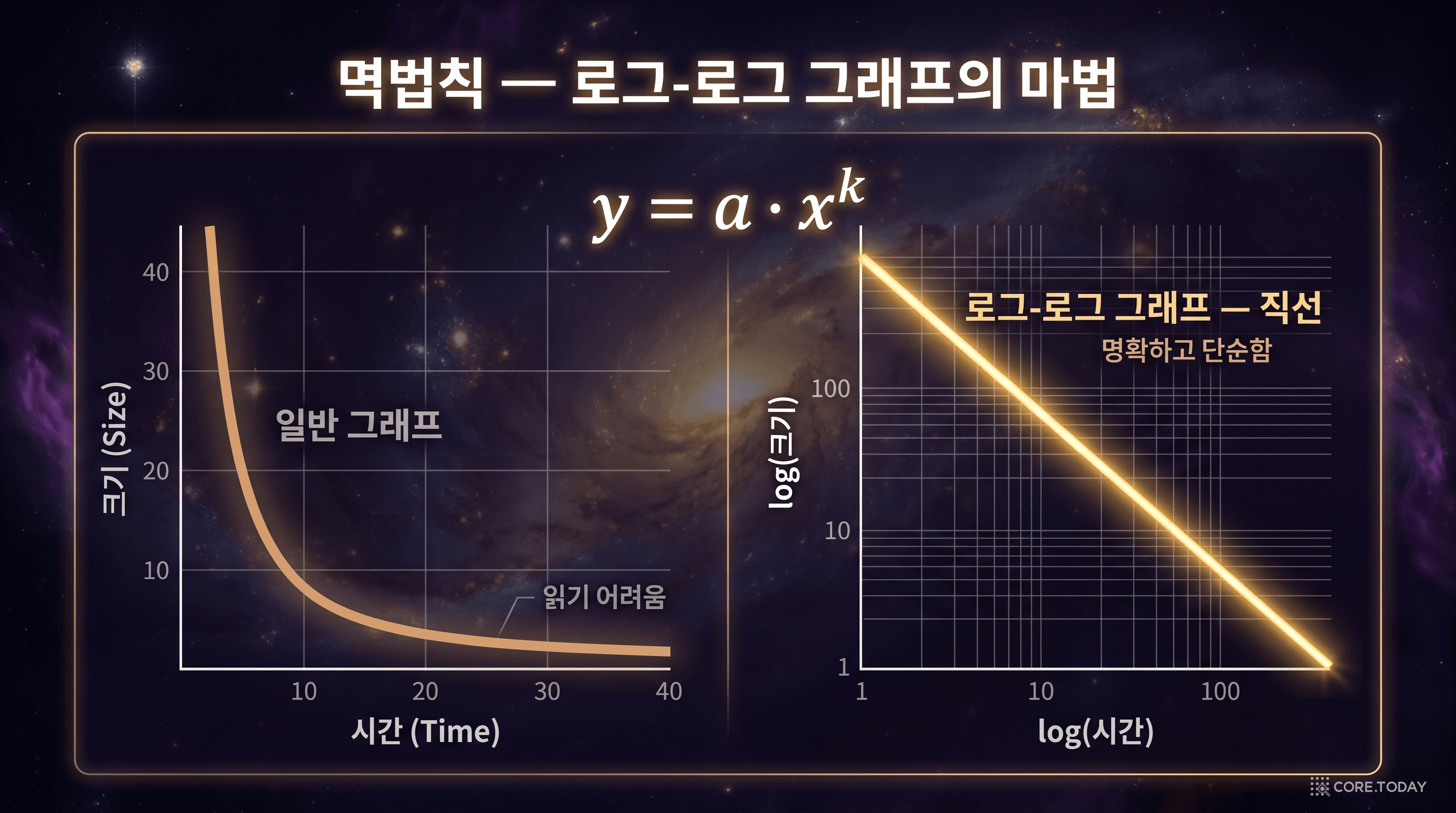

스케일링 법칙을 이해하려면, 먼저 멱법칙(power law)이 뭔지 알아야 한다. 이름은 무섭게 들리지만, 우리가 이미 알고 있는 패턴이다.

지진을 생각해보자. 규모 4.0 지진은 비교적 자주 발생한다. 규모 5.0 지진은 약 10배 드물다. 규모 6.0은 또 10배 드물다. 규모가 1 올라갈 때마다 빈도가 일정한 비율로 줄어든다. 이것이 멱법칙이다. 도시 인구 분포도 같은 패턴을 따른다. 인구 100만 이상 도시는 10만 이상 도시보다 대략 일정한 비율로 적다. 부의 분포, 웹사이트 방문자 수, 단어 사용 빈도 — 자연과 사회의 놀라울 정도로 많은 현상이 이 패턴을 따른다.

수식으로 쓰면 이렇다:

여기서 는 지수(exponent)로, 관계의 강도를 결정한다. 이 식의 마법은 양변에 로그를 씌우면 드러난다:

로그-로그 그래프에서 직선이 된다. 왜 이것이 중요할까? 직선은 예측이 가능하다는 뜻이기 때문이다. 데이터 점 몇 개만 찍으면 기울기()를 알 수 있고, 그 기울기로 아직 실험하지 않은 영역의 결과를 예측할 수 있다.

2020년 이전, 딥러닝은 본질적으로 "주사위 던지기"에 가까웠다. 새로운 아키텍처를 설계하고, 학습시켜보고, 결과를 확인한다. 잘 되면 논문을 쓰고, 안 되면 다시 돌아간다. 무엇이 작동할지 미리 알 수 없었다. 더 큰 모델이 항상 더 좋은 것도 아니었고, 더 많은 데이터가 항상 도움이 되는 것도 아니었다. 적어도 정량적으로 예측할 수는 없었다.

그런데 갑자기, 누군가가 이런 사실을 발견했다. 모델 크기(, 파라미터 수), 데이터 양(, 토큰 수), 연산량(, FLOP)과 모델 성능(손실, Loss) 사이에 멱법칙 관계가 성립한다는 것이다. 로그-로그 그래프에 점을 찍으면 놀라울 정도로 깔끔한 직선이 나타났다.

이것은 패러다임의 전환이었다. "주사위를 던져봐야 아는" 도박에서, "그래프를 그려서 결과를 예측하는" 공학으로의 전환. 마치 연금술이 화학으로 바뀐 것과 같았다. 물질을 섞어보고 기도하는 대신, 주기율표를 보고 결과를 계산할 수 있게 된 것이다.

하지만 "멱법칙이 존재한다"는 것만으로는 부족했다. 핵심 질문은 이것이었다: "모델, 데이터, 연산 — 이 셋 중에 어디에 돈을 집중해야 가장 효율적인가?" 이 질문에 답한 최초의 논문이 다음 장의 주인공이다.

2020년 1월, OpenAI에서 한 편의 논문이 공개됐다. "Scaling Laws for Neural Language Models" — Jared Kaplan, Sam McCandlish, Tom Henighan, Tom B. Brown 등이 공저했다. 저자 목록에서 눈에 띄는 이름이 있다. Dario Amodei와 Tom Brown. Dario Amodei는 이후 OpenAI를 떠나 Anthropic을 설립한 인물이고, Tom Brown은 몇 달 뒤 나올 GPT-3 논문의 제1저자다.

이 논문은 Transformer 기반 언어 모델의 성능이 세 가지 변수 — 모델 크기(), 데이터셋 크기(), 학습에 사용된 연산량() — 에 대해 멱법칙을 따른다는 것을 실증적으로 보여줬다. 단순히 "관계가 있다" 수준이 아니라, 구체적인 지수(exponent)를 측정했다.

Kaplan이 발견한 관계를 수식으로 정리하면 이렇다:

여기서 은 손실(loss) — 모델이 다음 토큰을 얼마나 잘 예측하는지를 나타내는 수치로, 낮을수록 좋다. , , 는 상수다.

지수를 직관적으로 이해하는 것이 중요하다. 이 무슨 뜻일까?

모델 크기를 2배로 늘리면 손실이 약 5.4% 감소한다. "고작 5%?"라고 생각할 수 있지만, 이건 로그 스케일에서의 이야기다. 모델 크기를 10배로 늘리면 약 19% 감소한다.

비유하면 이렇다. 수능 공부를 한다고 상상해보자. 공부 시간을 2배로 늘리면 성적이 한 등급의 5% 정도 오른다. 10배로 늘려야 비로소 한 등급 가까이 오른다. 이것이 수확 체감(diminishing returns)의 정량적 표현이다. 자원을 투입할수록 성능은 오르지만, 같은 만큼의 향상을 얻기 위해 필요한 자원은 기하급수적으로 늘어난다.

그런데 세 지수를 비교하면 흥미로운 서열이 보인다:

데이터의 지수(0.095)가 가장 크다. 즉, 다른 조건이 같다면 데이터를 늘리는 것이 가장 효율적이다. 그런데 Kaplan의 핵심 결론은 여기가 아니었다.

Kaplan이 진짜 답하고 싶었던 질문은 이것이다: "연산 예산(compute budget)이 고정되어 있을 때, 모델 크기와 데이터 양을 어떻게 배분해야 최적인가?"

연산량 는 모델 크기 과 데이터 의 함수다. 대략적으로:

이 6ND 공식은 스케일링 법칙의 기본 도구다. 6은 어디서 나왔을까? 하나의 토큰을 처리할 때, 순전파(forward pass)에 약 의 연산이 필요하고, 역전파(backward pass)에 약 의 연산이 필요하다. 합치면 다. 이 공식이 의미하는 바는 명확하다 — 연산 예산이 정해지면, 모델을 키우면 데이터를 줄여야 하고, 데이터를 늘리면 모델을 줄여야 한다. 트레이드오프가 존재한다.

Kaplan은 이 트레이드오프를 분석해서 최적 배분 비율을 도출했다:

직관적으로 이해하면 이렇다. 100만 원어치의 GPU 시간이 주어졌을 때, 모델을 크게 만들고 데이터를 적게 보여주는 것이 최선이라는 것이다. 바보같이 들릴 수도 있다 — "데이터를 많이 보여줘야 잘 배우는 거 아냐?" 하지만 Kaplan의 실험 결과는 일관되게 같은 방향을 가리켰다. 같은 연산 예산이면, 작은 모델을 오래 학습시키는 것보다 큰 모델을 짧게 학습시키는 것이 낫다.

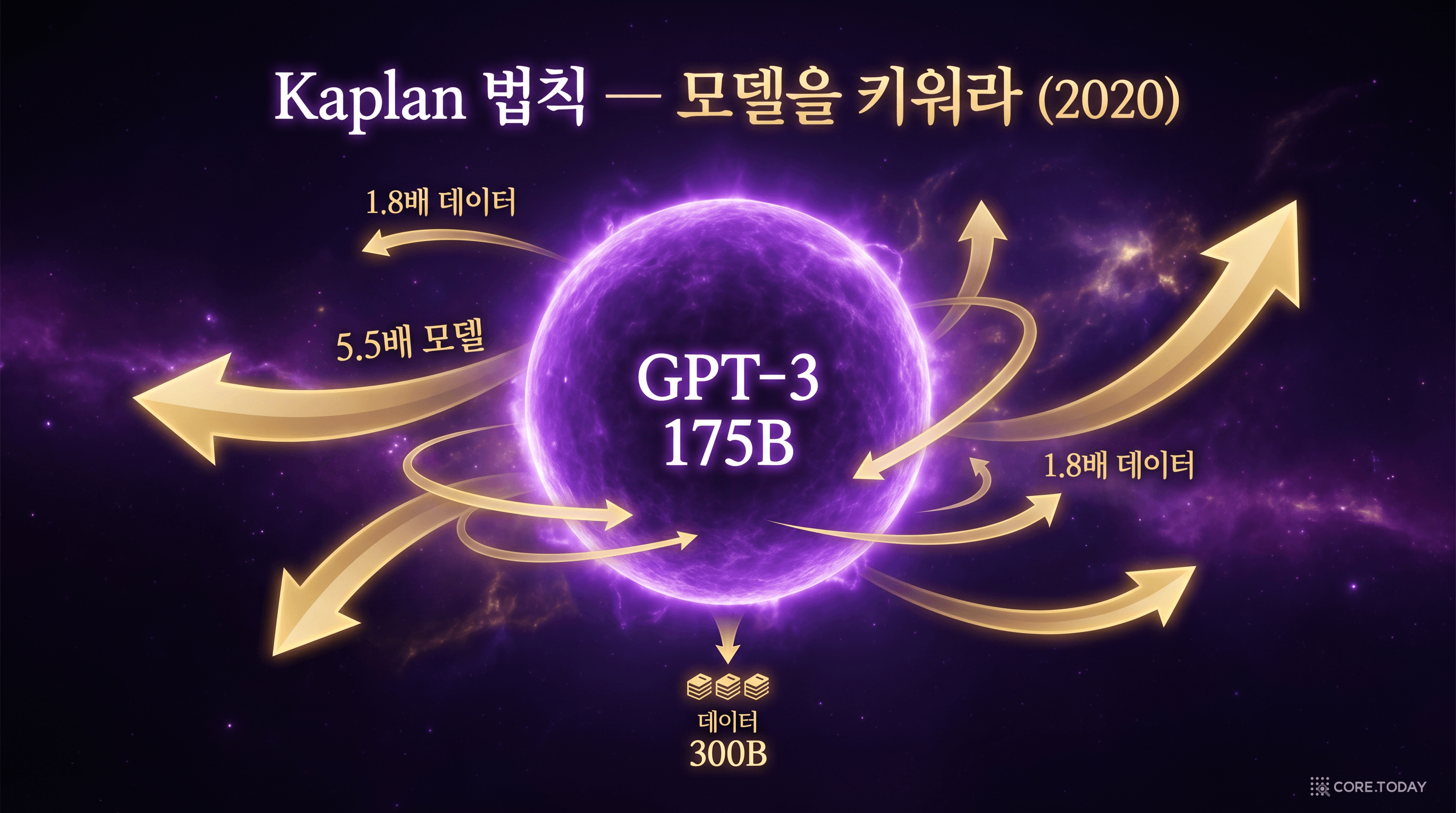

이 결론이 직접 적용된 것이 바로 GPT-3(2020.5)다. 논문 제1저자 Tom Brown은 Kaplan 논문의 공저자이기도 했다.

GPT-3의 스펙을 보자:

파라미터당 겨우 1.7개의 토큰. 이것이 Kaplan의 법칙을 충실히 따른 설계다. 모델은 최대한 크게, 데이터는 상대적으로 적게. 학습 비용은 약 500만 달러, A100 GPU 수천 장 규모였다.

결과는 성공적이었다. GPT-3는 few-shot 학습 능력에서 이전 모델들을 압도했고, "큰 모델이 답이다"라는 서사를 확고히 했다. 학계와 산업계 모두 Kaplan의 법칙을 표준으로 받아들였다.

하지만 2년 뒤, 런던에서 날아온 논문 한 편이 이 모든 것을 뒤집는다.

2022년 3월, DeepMind에서 "Training Compute-Optimal Large Language Models"이라는 제목의 논문이 발표됐다. 제1저자는 Jordan Hoffmann. 흔히 Chinchilla 논문이라고 불린다 — 논문에서 학습한 모델의 이름이 Chinchilla(친칠라)였기 때문이다.

이 논문의 배경을 이해하려면 DeepMind의 상황을 알아야 한다. DeepMind은 2021년 말에 Gopher라는 280B 파라미터 모델을 발표했다. 학습에 사용된 토큰은 약 300B — GPT-3와 거의 같은 수준이다. Kaplan의 법칙을 따른 설계였다. 모델은 크게, 데이터는 (상대적으로) 적게.

그런데 Chinchilla 논문에서 DeepMind은 스스로 "우리가 틀렸다"고 인정한다. Gopher는 최적이 아니었다. 같은 연산 예산으로 훨씬 더 좋은 모델을 만들 수 있었다. 어떻게? 모델을 줄이고 데이터를 늘려서.

Chinchilla 논문의 설득력은 세 가지 완전히 다른 접근법으로 같은 결론에 도달했다는 데 있다.

접근법 1: 손실 엔벨로프(Loss Envelope)

모델 크기를 고정하고 학습 토큰 수를 변화시키면서 손실을 측정한다. 67M에서 16B까지 다양한 크기의 모델을 각각 여러 데이터 양으로 학습시킨다. 각 연산 예산(FLOP)에서 최소 손실을 달성하는 점들을 연결하면 "엔벨로프(포락선)"가 그려진다. 이 엔벨로프에서 최적점을 추출하면, Kaplan과 다른 최적 비율이 나타난다.

접근법 2: IsoFLOP 곡선

같은 연산량(FLOP)을 쓰되, 모델 크기를 변화시킨다. 예를 들어, FLOP이라는 예산이 있으면, 1B 모델을 많은 데이터로 학습시킬 수도 있고, 10B 모델을 적은 데이터로 학습시킬 수도 있다. 각 경우의 손실을 그래프로 그리면 U자 곡선이 나타난다 — 모델이 너무 작아도 손실이 크고, 너무 커도 (데이터가 부족해서) 손실이 크다. U자의 최솟값이 최적 모델 크기다.

접근법 3: 파라메트릭 손실 함수 피팅

가장 이론적인 접근이다. 손실을 모델 크기와 데이터의 함수로 직접 모델링한다:

여기서 각 항의 의미:

세 접근법 모두 같은 결론을 가리켰다.

Kaplan은 "모델 5.5배, 데이터 1.8배"라고 했다. Chinchilla는 "모델 3.16배(), 데이터 3.16배"라고 했다. 완전히 다른 배분이다.

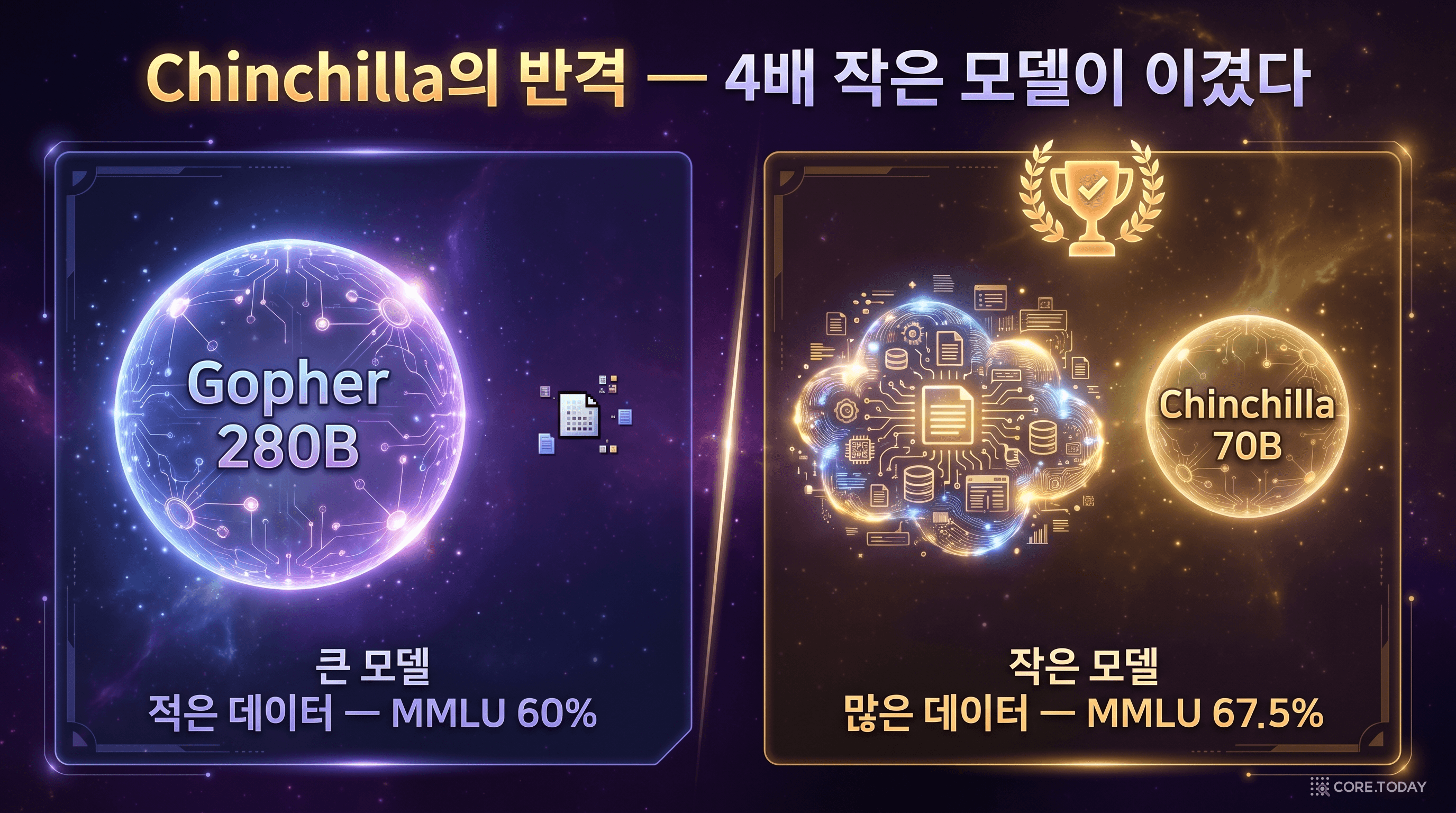

DeepMind은 말로만 주장한 것이 아니라 직접 증명했다. Gopher와 동일한 연산 예산(약 $5.76 \times 10^{23}$ FLOP)으로 Chinchilla를 학습시킨 것이다.

결과는 충격적이었다. 4배 작은 모델이 모든 벤치마크에서 4배 큰 모델을 이겼다. MMLU에서 Chinchilla 67.5% vs Gopher ~60%. 작은 모델이 더 똑똑했다. 게다가 Chinchilla는 모델이 작으니 추론 비용도 4배 저렴했다. 학습 비용은 같은데, 결과가 더 좋고, 서빙 비용도 더 싸다.

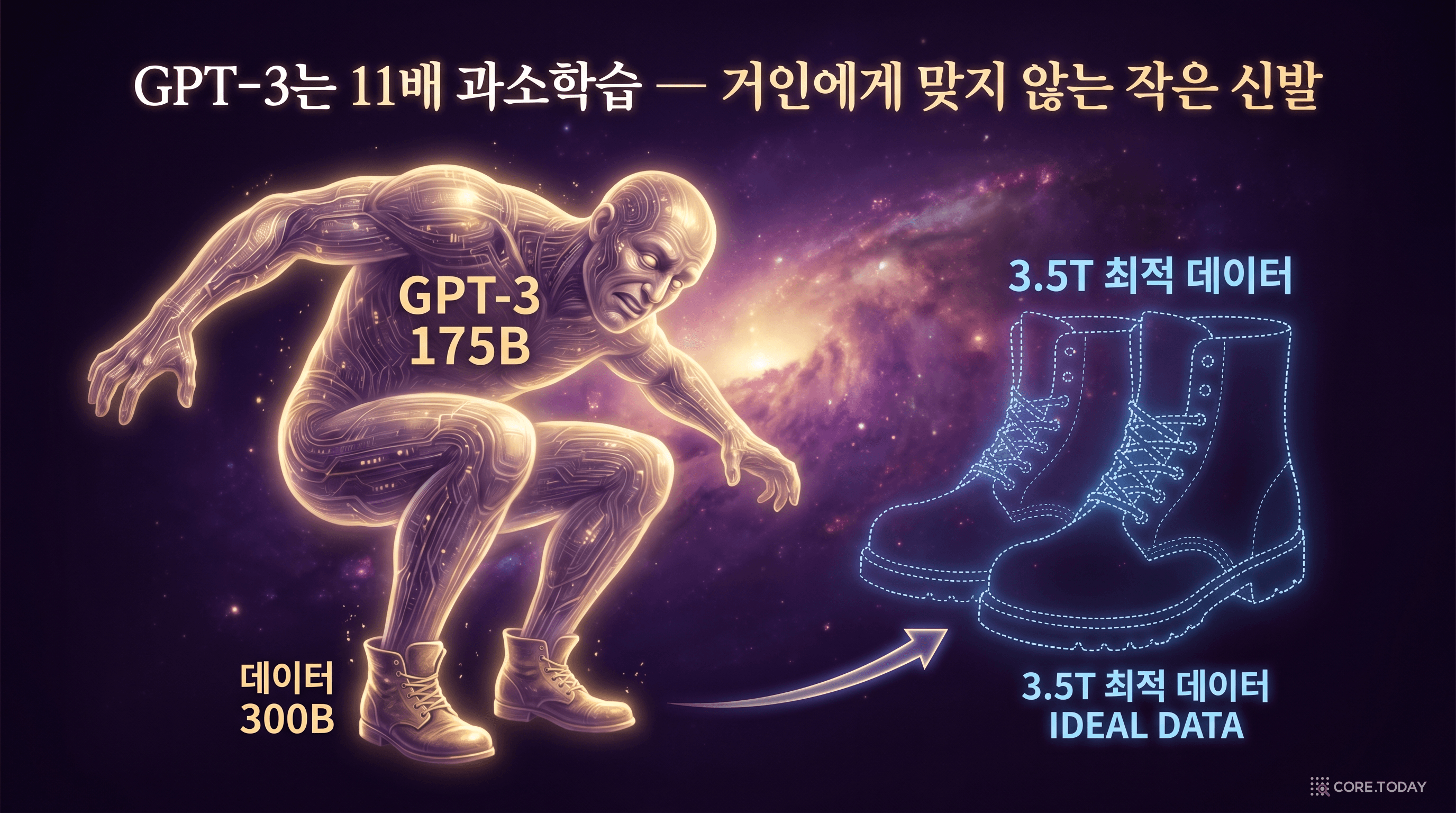

Chinchilla의 기준을 GPT-3에 적용하면 어떻게 될까? 175B 파라미터 모델의 최적 학습 토큰 수는:

실제 GPT-3가 학습한 토큰은 300B. 3.5T 대비 약 11.7배 부족하다. Chinchilla 기준으로 GPT-3는 심각하게 과소학습(undertrained)된 모델이었다.

비유하면 이렇다. 키가 2미터인 거인에게 발 사이즈 230mm 신발을 신긴 꼴이다. 몸집(모델)은 거대한데, 발(데이터)이 턱없이 작다. 제대로 걸을 수는 있지만, 제 실력을 발휘하지 못한다. 발에 맞는 300mm 신발을 신기면 — 즉, 3.5T 토큰으로 학습시키면 — 같은 모델이 훨씬 더 좋은 성능을 냈을 것이다.

같은 현상을 분석했는데 왜 결론이 달랐을까? 핵심적인 차이가 세 가지 있다.

첫째, 파라미터 정의가 달랐다. Kaplan은 비임베딩 파라미터(non-embedding parameters)만 으로 사용했다. Chinchilla는 임베딩을 포함한 전체 파라미터를 사용했다. 작은 모델에서는 임베딩이 전체 파라미터의 상당 부분을 차지하므로, 이 차이가 결과에 영향을 줬다.

둘째, 실험 스케일이 달랐다. Kaplan의 실험은 상대적으로 더 작은 모델들에서 수행됐다. 스케일링 법칙의 본질이 "큰 스케일에서의 행동을 예측하는 것"인데, 작은 스케일에서 측정한 지수로 큰 스케일을 예측하면 오차가 누적될 수 있다.

셋째, 그리고 가장 중요한 차이: 불가축 손실() 항의 유무. Kaplan의 손실 함수에는 항이 없었다. 불가축 손실을 무시하면, 모델 크기의 효과가 과대평가된다. 왜냐하면 데이터를 아무리 늘려도 줄어들지 않는 바닥(floor)이 있다는 사실을 반영하지 못하기 때문이다. nats라는 바닥을 고려하면, 모델을 키우는 것의 한계 효용이 Kaplan이 측정한 것보다 더 빨리 감소한다.

Chinchilla 논문 이후, AI 업계의 패러다임이 바뀌었다. "모델을 키워라"에서 "데이터를 키워라"로. 하지만 이야기는 여기서 끝나지 않는다. 현실은 언제나 이론보다 복잡하다.

Chinchilla 논문의 영향을 가장 극적으로 보여주는 사례가 Meta의 LLaMA 시리즈다. LLaMA의 세대별 설계 변화를 추적하면, 업계의 사고방식이 어떻게 진화했는지가 선명하게 드러난다.

LLaMA 1 (2023.2): Chinchilla 논문을 충실히 따랐다. 7B 모델에 약 1T 토큰 — 파라미터당 약 142개 토큰. Chinchilla 기준(20 토큰)보다 이미 넉넉하지만, 의도적으로 더 많은 데이터를 사용했다. 결과는 인상적이었다. 13B 모델이 175B GPT-3를 대부분의 벤치마크에서 이겼다.

LLaMA 2 (2023.7): 약간 더 밀어붙였다. 7B 모델에 약 2T 토큰 — 파라미터당 284개 토큰. Chinchilla 최적의 14배.

LLaMA 3 (2024.4): 극단적으로 밀어붙였다. 8B 모델에 15T 토큰 — 파라미터당 1,875개 토큰. Chinchilla 최적의 94배다.

잠깐 — Chinchilla가 "최적 비율"을 알려줬는데, 왜 LLaMA 3는 그 비율을 94배나 초과해서 학습시켰을까? Chinchilla가 틀렸던 걸까?

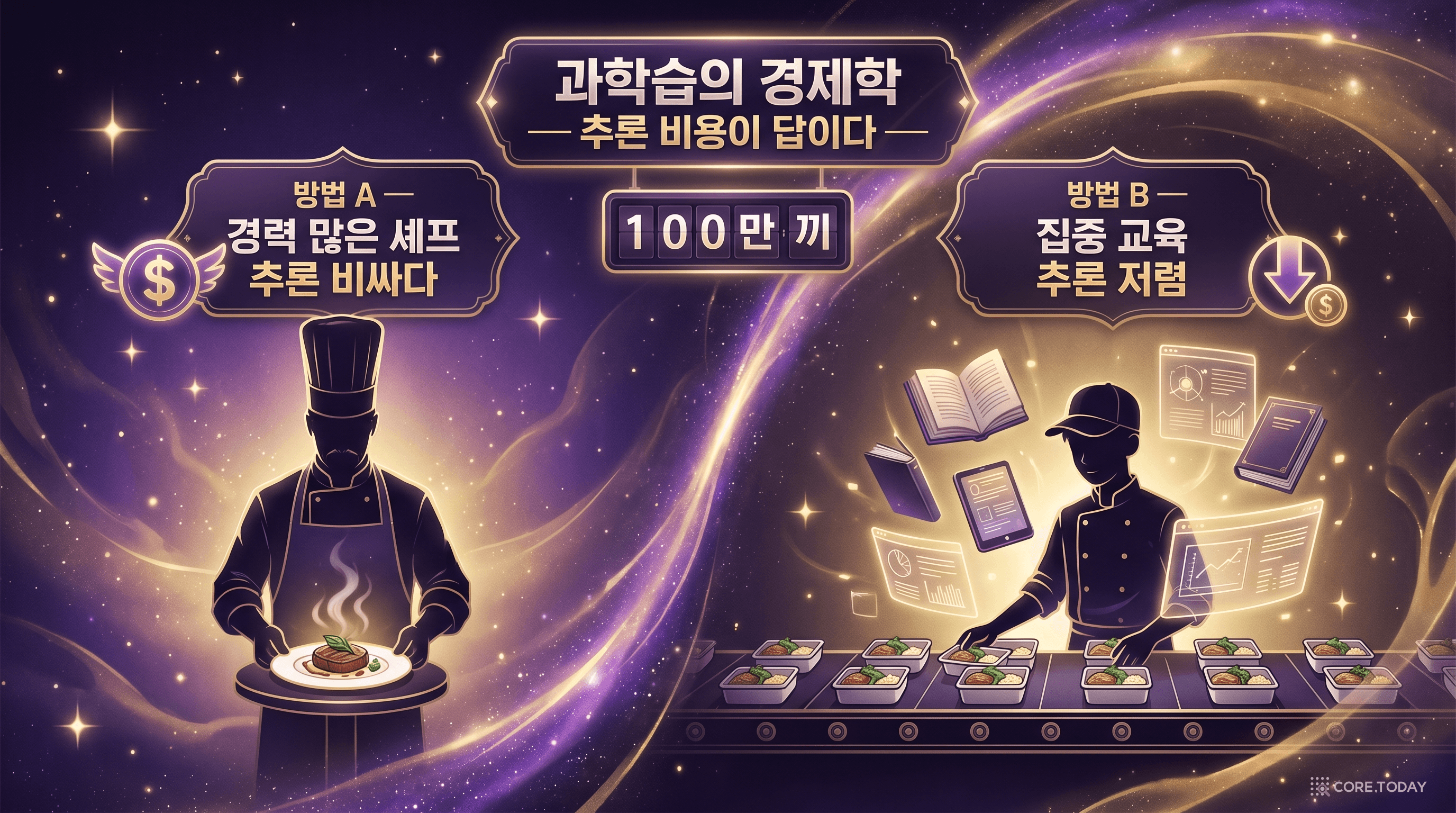

아니다. Chinchilla가 말한 "최적"은 학습 연산량 대비 최적이다. 같은 FLOP으로 가장 낮은 손실을 달성하는 배분. 하지만 현실에는 Chinchilla가 고려하지 않은 변수가 있다: 추론 비용.

모델 학습은 1번이다. 하지만 학습된 모델로 추론하는 것은 수십억 번이다. ChatGPT에 질문이 들어올 때마다, 모델의 모든 파라미터를 거쳐 답변이 생성된다. 모델이 크면 매번 더 많은 연산이 필요하다. 70B 모델의 추론 비용은 8B 모델의 약 8.75배다.

이것이 과학습(over-training)의 경제적 논리다. 학습 비용을 더 쓰더라도, 모델을 작게 만들고 오래 학습시키면 — 즉, 데이터를 Chinchilla 최적보다 훨씬 많이 사용하면 — 추론 비용이 극적으로 감소한다. 학습은 1회 비용이지만, 추론은 모델의 전 생애에 걸친 누적 비용이다.

Sardana et al.의 연구에 따르면, 파라미터당 10,000 토큰까지도 성능 향상이 지속된다. 물론 수확 체감은 있지만, 추론 비용 절감이 이를 상쇄한다. 수백만 사용자가 매일 쓰는 서비스라면, 학습에 2배를 더 쓰고 추론에서 8배를 아끼는 것이 합리적이다.

비유하면 이렇다. 레스토랑을 연다고 해보자. 셰프(모델)를 고용하는 방법이 두 가지다.

하루에 100끼를 팔면 방법 A가 낫다. 하루에 100만 끼를 팔면? 방법 B가 압도적으로 유리하다. ChatGPT 급의 서비스는 하루에 수억 건의 추론을 처리한다.

스케일링 법칙이 만든 또 다른 현실은 GPU 군비 경쟁이다.

AI에 사용된 연산량의 증가 속도는 경이롭다. 2012년 AlexNet 이후, AI 학습에 투입된 연산량은 약 300,000배 증가했다. 같은 기간 무어의 법칙에 따른 칩 성능 향상은 약 7배. AI 연산 증가가 무어의 법칙보다 4만 배 이상 빠르다.

AI 연산량이 3.4개월마다 2배로 증가하고 있다. 무어의 법칙은 24개월에 2배. 이 격차가 GPU 수요 폭발의 원인이다. 칩 하나의 성능이 올라가는 속도보다 필요한 연산량이 올라가는 속도가 훨씬 빠르니, 더 많은 칩이 필요하다.

결과는 거대 클러스터의 시대다. xAI의 Colossus는 H100 GPU 10만 장으로 구성된 단일 학습 클러스터다. Meta는 35만 장의 GPU 인프라를 구축 중이다. 이 규모의 시설은 수 기가와트의 전력을 소비하며, 하나의 소형 도시에 맞먹는 에너지가 필요하다.

스케일링 법칙이 "더 많은 데이터"를 요구하는데, 데이터에도 한계가 있다. Epoch AI의 분석에 따르면:

인터넷에 존재하는 공개 텍스트의 총량은 약 300조 토큰(300T)으로 추정된다. 이 중 학습에 적합한 고품질 언어 데이터는 훨씬 적으며, 2026년 이전에 고갈될 것으로 예측되고 있다 — 즉, 지금 이 시점이다. 저품질 데이터를 포함해도 2030~2050년 사이에 한계에 도달한다.

이미 대응이 시작됐다. 합성 데이터(synthetic data) — AI가 만든 데이터로 AI를 학습시키는 방식 — 가 주류가 되고 있다. LLaMA 3는 학습 데이터의 상당 부분을 합성으로 생성했다. 또한 멀티모달 데이터 (이미지, 비디오, 오디오)를 텍스트 학습에 활용하면 데이터 풀을 약 3배 확장할 수 있다.

스케일링에는 환경적 대가도 따른다.

GPT-3 학습의 에너지 소비는 약 1,287,000 kWh, 이산화탄소 배출량은 약 552톤이다. 한국 일반 가정의 연간 전력 소비가 약 3,500 kWh이니, GPT-3 하나를 학습시키는 데 370가구의 1년 치 전기가 들었다.

GPT-4의 학습 탄소 배출량은 미국인 약 938명의 연간 배출량에 해당하는 것으로 추정된다. 그리고 이것은 학습만의 비용이다. 수억 명이 매일 사용하는 추론까지 합치면 에너지 소비는 기하급수적으로 늘어난다.

이 모든 것 — GPU 군비 경쟁, 데이터 고갈, 환경 비용 — 이 하나의 질문으로 수렴한다. "사전학습 스케일링만으로 계속 갈 수 있는가?" 다음 장에서 이 질문에 답한다.

스케일링 법칙의 가장 매력적인 서사 중 하나는 "창발 능력(emergent abilities)"이었다. 모델이 일정 크기를 넘으면 갑자기 새로운 능력이 "톡" 하고 나타난다는 이야기. 덧셈을 못하던 모델이 크기를 10배로 키우자 갑자기 덧셈을 한다든지, 번역을 못하던 모델이 갑자기 번역을 한다든지.

2023년 NeurIPS에서 Rylan Schaeffer 등이 발표한 논문은 이 서사에 찬물을 끼얹었다. "Are Emergent Abilities of Large Language Models a Mirage?" — "대규모 언어 모델의 창발 능력은 신기루인가?"

핵심 주장은 이렇다. "창발"처럼 보이는 급변 현상의 상당 부분은 측정 방식의 인위적 결과라는 것이다. 예를 들어, exact-match accuracy(정확 일치 정확도)라는 메트릭은 이진적이다 — 답이 완전히 맞으면 1, 조금이라도 틀리면 0. 이런 비선형 메트릭을 사용하면, 실제로는 부드럽게 향상되고 있는 능력이 "갑자기 나타나는" 것처럼 보인다.

비유하면 이렇다. 아이가 "사과"라는 단어를 배우는 과정을 상상해보자. 처음에는 "사꽈"라고 하고, 다음에는 "사과"에 가까워지고, 마침내 정확하게 "사과"라고 한다. 부분 점수를 주면, 능력이 서서히 향상되는 그래프가 그려진다. 하지만 정확 일치만 점수로 인정하면? 0-0-0-0-0-1. 갑자기 "창발"한 것처럼 보인다.

Schaeffer의 실험에서, exact-match accuracy를 연속 메트릭(Brier score, token-level accuracy 등)으로 교체하자, 많은 "창발" 현상이 사라지고 부드러운 향상 곡선으로 바뀌었다. 하지만 전부 사라진 것은 아니다 — 일부 능력은 연속 메트릭에서도 여전히 급변을 보였다. 논쟁은 아직 진행 중이다.

스케일링 법칙이 예측하는 것은 엄밀히 말하면 "다음 토큰 예측 손실(pre-training loss)"이다. 이건 잘 맞는다. 로그-로그 그래프에서 깔끔한 직선이 나온다.

하지만 우리가 진짜 관심 있는 것은 "다음 토큰 예측"이 아니라 "이 모델이 실제 태스크를 얼마나 잘 수행하는가"다. 코딩, 수학, 요약, 번역 같은 다운스트림 태스크. 그리고 여기서 스케일링 법칙은 훨씬 불안정해진다.

연구에 따르면, 다운스트림 태스크 중 사전학습 손실 감소에 비례해 선형적으로 성능이 향상되는 것은 약 39%에 불과하다. 나머지 61%는:

스케일링 법칙은 "엔진의 출력"은 예측하지만, "이 차가 서울에서 부산까지 얼마나 빨리 갈 수 있는지"는 예측하지 못한다. 도로 상태, 교통 상황, 운전자의 실력 같은 변수가 개입하기 때문이다.

2023년 6월, Microsoft Research에서 발표된 "Textbooks Are All You Need"는 스케일링의 새로운 차원을 열었다. 이 논문이 만든 phi-1 모델은 불과 1.3B 파라미터에 7B 토큰으로 학습했는데, 코딩 벤치마크(HumanEval)에서 당시 수십 배 큰 모델들과 경쟁했다.

비결은 데이터 품질이었다. 인터넷에서 긁어모은 잡다한 데이터 대신, "대학 교재 수준"의 체계적이고 정확한 데이터만 골라서(그리고 합성으로 생성해서) 학습시킨 것이다. 양을 극적으로 줄이고 질을 극적으로 높였더니, 작은 모델이 거대한 모델을 이겼다.

이것은 Kaplan과 Chinchilla가 모두 놓친 차원이다. 두 논문 모두 "데이터의 양"만 변수로 다뤘다. "데이터의 질"은 고려하지 않았다. 마치 운동 선수의 성장을 "운동 시간"으로만 예측한 것과 같다 — 같은 3시간이라도 체계적인 코치 밑에서 하는 3시간과 혼자 아무렇게나 하는 3시간은 완전히 다르다.

2024년 9월, OpenAI의 o1은 또 다른 차원을 열었다. 추론 시간 스케일링(test-time compute scaling)이다.

기존 스케일링은 모두 학습 시간(train-time)에 관한 것이었다. "학습에 더 많은 연산/데이터/파라미터를 넣으면 성능이 오른다." o1이 보여준 것은 다르다. 추론할 때 더 오래 생각하게 하면 성능이 오른다.

o3의 사례가 이를 극적으로 보여준다. o3는 문제의 난이도에 따라 추론에 사용하는 토큰 수를 조절한다. 쉬운 문제에는 약 330,000 토큰, 어려운 문제에는 최대 57,000,000 토큰(5,700만)을 사용한다. 172배의 차이다. 그리고 ARC-AGI 벤치마크에서 87.5%를 달성했다 — GPT-4o는 같은 벤치마크에서 5%였다.

핵심은 이것이다. 같은 모델이 추론에 더 많은 연산을 쓰는 것만으로 17.5배 더 좋은 성능을 낸다. 모델을 더 크게 학습시킨 것이 아니다. 데이터를 더 넣은 것이 아니다. 단지 "더 오래 생각"했을 뿐이다.

세 번째 새로운 차원은 정렬(alignment)이다. RLHF, DPO 같은 기법으로 "모델이 어떻게 행동해야 하는지"를 학습시키는 것.

가장 극적인 사례는 InstructGPT(2022)다. OpenAI가 RLHF로 정렬한 1.3B 파라미터 InstructGPT 모델이, 정렬 없는 175B 파라미터 GPT-3보다 인간 평가에서 더 선호됐다. 135배 작은 모델이 정렬만으로 거대 모델을 이긴 것이다.

이것은 "모델 크기"라는 단일 차원으로는 설명할 수 없다. 같은 크기의 모델이라도 "어떻게 학습시키느냐"에 따라 성능이 극적으로 달라진다.

이 세 가지 스케일링 차원의 관계를 운동선수의 성장에 비유하면 직관적으로 이해할 수 있다.

초보 단계: "운동량(데이터/모델 크기)"을 늘리면 빠르게 성장한다. 마라톤 초보가 주 3회에서 주 6회로 연습량을 늘리면 기록이 확 준다. 이것이 Kaplan/Chinchilla의 사전학습 스케일링이다.

중급 단계: 단순히 양을 늘리는 것만으로는 정체된다. "훈련 방법"이 중요해진다. 인터벌 훈련, 고지 훈련, 근력 보강 — 같은 시간을 쓰더라도 어떻게 쓰느냐가 결과를 좌우한다. 이것이 데이터 품질 스케일링과 정렬 스케일링이다.

엘리트 단계: 훈련 방법도 최적화된 상태. 이제는 "경기 중 전략"이 승부를 가른다. 페이스 조절, 상대 분석, 결정적 순간의 스퍼트. 같은 선수가 경기에서 어떤 전략을 쓰느냐에 따라 금메달과 4위의 차이가 난다. 이것이 추론 시간 스케일링이다.

2026년 현재, AI 업계에는 두 가지 상반된 목소리가 공존한다.

낙관론. Anthropic의 CEO Dario Amodei는 "아마도 스케일링은 계속될 것"이라고 말했다. OpenAI의 Sam Altman은 "벽은 없다(there is no wall)"고 단언했다. 이들의 근거는 명확하다 — 지금까지 스케일링 법칙이 예측한 방향으로 성능이 향상됐고, 아직 물리적 한계에 도달했다는 증거는 없다.

회의론. Chinchilla가 측정한 불가축 손실 nats는 자연어의 본질적 불확실성이다. 이 바닥에 가까워질수록 같은 양의 자원으로 얻는 향상은 줄어든다. 수확 체감의 법칙(law of diminishing returns)은 멱법칙 자체에 내장되어 있다. 더 넣으면 더 좋아지긴 하지만, "더 좋아지는 폭"이 계속 줄어든다. 게다가 고품질 텍스트 데이터는 이미 고갈 직전이고, GPU 클러스터의 규모는 물리적, 경제적 한계에 다가가고 있다.

현실. 순수 사전학습 스케일링 — 더 큰 모델에 더 많은 데이터를 넣는 전통적 방식 — 은 포화 조짐을 보이고 있다. 하지만 그것이 "AI 발전의 끝"은 아니다. 추론 시간 스케일링과 데이터 품질 스케일링이라는 새로운 전선이 열렸기 때문이다.

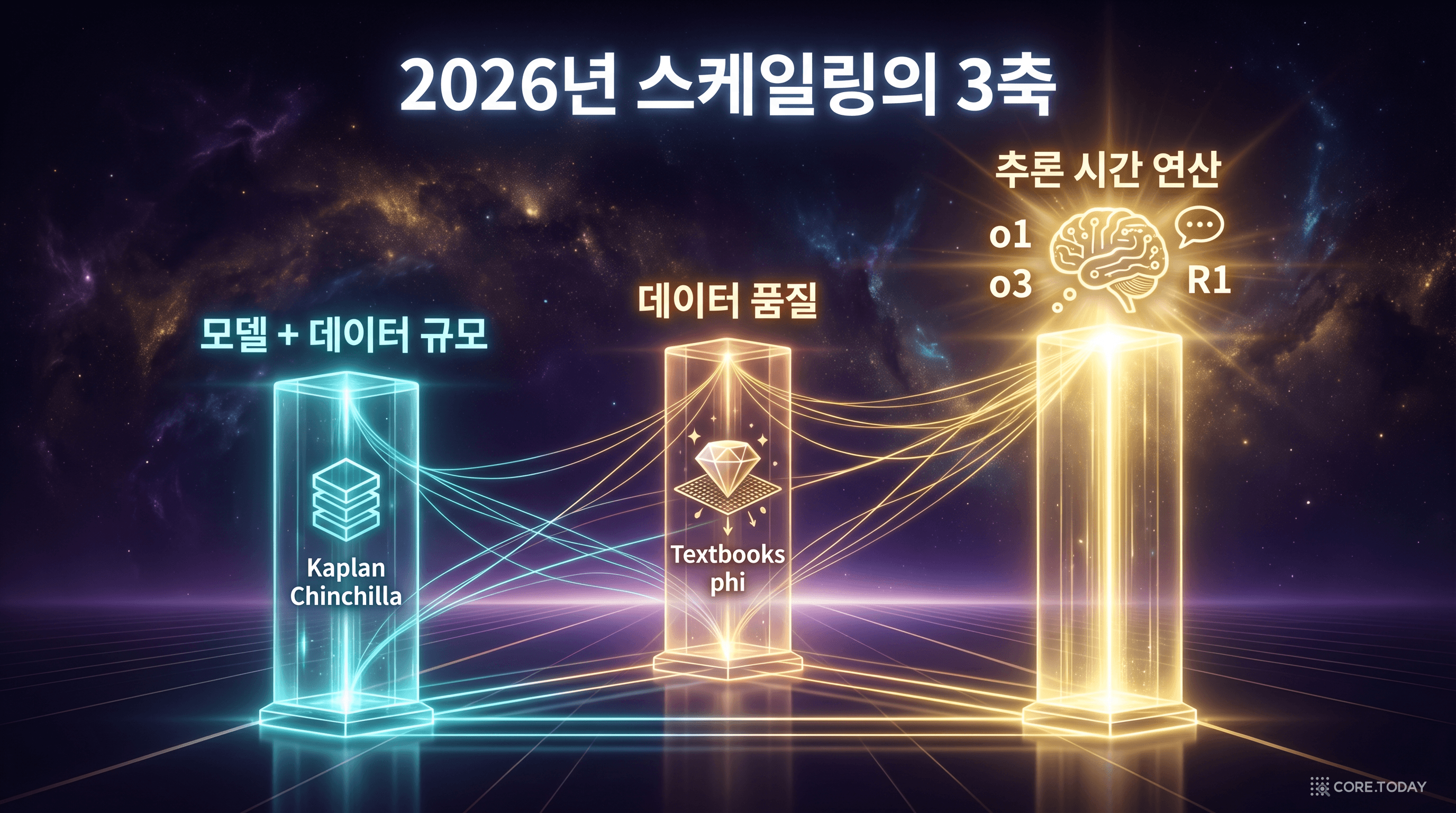

2026년의 AI 발전은 단일 축이 아닌 3개의 축으로 이해해야 한다.

축 1: 모델 크기 + 데이터 양. Kaplan과 Chinchilla가 정립한 전통적 스케일링이다. 여전히 AI의 기초 체력에 해당한다. 기초 체력이 약한 모델은 아무리 좋은 데이터로, 아무리 오래 생각하게 해도 한계가 있다. 하지만 이 축에서의 투자 대비 수익은 점점 줄어들고 있다. 거대 클러스터의 경제적, 환경적 비용이 천정을 향해 치솟는 반면, 성능 향상 폭은 줄어든다.

축 2: 데이터 품질. "같은 양이라도 어떤 데이터냐"가 성능을 좌우한다. phi-1이 1.3B로 수십 B 모델을 이긴 것이 증거다. 합성 데이터 생성, 데이터 큐레이션, 커리큘럼 학습(쉬운 것부터 어려운 순서로)이 이 축의 핵심 기법이다. 이 축은 아직 초기 단계에 있으며, 최적화의 여지가 크다.

축 3: 추론 시간 연산. 학습이 끝난 모델이 문제를 풀 때, 얼마나 많은 연산을 쓸 수 있느냐. o1, o3, DeepSeek-R1이 이 축의 선두 주자다. 흥미로운 점은, 이 축은 문제별로 동적으로 조절할 수 있다는 것이다. 쉬운 질문에는 빠르게 답하고, 어려운 문제에는 오래 생각한다. 학습 시간 스케일링은 "모든 문제에 균일하게" 적용되지만, 추론 시간 스케일링은 "필요한 곳에 집중"할 수 있다.

스케일링 법칙의 역사가 2026년의 AI 실무자에게 말해주는 것은 무엇일까?

"무조건 크게"가 아니라 "어디에 자원을 투입할 것인가." Kaplan은 모델을 키우라고 했고, Chinchilla는 데이터를 키우라고 했고, Textbooks는 데이터 품질을 높이라고 했고, o1은 추론에 투자하라고 했다. 매번 "어디에"가 바뀌었다. 하지만 공통된 메시지가 있다 — 자원 배분이 자원 총량보다 중요하다.

같은 비용이 주어졌을 때:

2020년에는 전략 A가 거의 유일한 선택이었다. 2026년에는 전략 B가 많은 상황에서 더 효율적이다. InstructGPT(1.3B RLHF)가 GPT-3(175B)를 이겼고, phi-1(1.3B)이 코딩에서 거대 모델과 경쟁했고, DeepSeek-R1은 추론에서 o1에 필적하면서도 훨씬 적은 비용으로 학습됐다.

핵심은 "돈을 어디에 쓸 것인가"라는 질문이 더 이상 단일 차원이 아니라는 것이다. 모델 크기, 데이터 양, 데이터 품질, 정렬 방법, 추론 연산 — 이 다섯 개의 놉(knob)을 어떻게 조합할 것인가가 2026년 AI 엔지니어링의 핵심 역량이다.

Kaplan의 법칙(2020)은 "돈을 쏟으면 AI가 얼마나 똑똑해지는지"를 처음으로 예측 가능하게 만들었다. 주사위 던지기에서 공학으로의 전환. 이 발견이 GPT-3를 낳았고, 수천억 달러 투자의 이론적 근거가 되었다.

Chinchilla(2022)는 "같은 돈이면 어디에 써야 하는지"를 교정했다. 모델이 아니라 데이터에. 같은 연산 예산으로 4배 작은 모델이 4배 큰 모델을 이기는 것을 증명했다. 이후 모든 LLM의 설계가 바뀌었다.

그리고 2023년 이후, 세 가지 논문이 "돈만이 답이 아니다"를 각각의 방식으로 증명했다:

Textbooks는 1.3B 모델로 데이터 품질의 위력을 보여줬다. DPO와 RLHF는 1.3B 정렬 모델이 175B 기본 모델을 이길 수 있음을 증명했다. DeepSeek-R1은 추론 시간에 더 많이 생각하는 것만으로 수학 올림피아드 수준의 문제를 푸는 AI를 만들었다.

이 이야기들은 결국 하나의 질문으로 수렴한다:

"AI를 더 좋게 만들려면, 무엇을 스케일해야 하는가?"

2020년의 답: 모델 크기. 2022년의 답: 데이터. 2023년의 답: 데이터 품질. 2024년의 답: 추론 시간. 2025년의 답: 위의 모든 것을, 문제에 맞게.

답은 계속 진화하고 있다. 그리고 그것이 이 분야가 여전히 흥미로운 이유다.