친칠라 스케일링 법칙: '더 크게'가 정답이 아니었다 — AI 훈련 패러다임을 뒤집은 논문

GPT-3는 '과소 훈련'된 모델이었다? 2022년 DeepMind의 친칠라 논문이 밝힌 '모델 크기 vs 데이터 양'의 최적 비율, 그리고 업계가 이를 넘어선 이유까지 — AI 스케일링의 역사를 총정리합니다.

GPT-3는 '과소 훈련'된 모델이었다? 2022년 DeepMind의 친칠라 논문이 밝힌 '모델 크기 vs 데이터 양'의 최적 비율, 그리고 업계가 이를 넘어선 이유까지 — AI 스케일링의 역사를 총정리합니다.

2022년 3월, DeepMind가 논문 하나를 공개합니다. 제목은 점잖았지만, 결론은 충격적이었습니다:

GPT-3(1,750억 파라미터)는 심각하게 과소 훈련(undertrained)되었다.

더 정확히 말하면: GPT-3에 투입된 연산(compute)으로, 4배 작은 모델을 4배 많은 데이터로 훈련시켰다면 더 좋은 성능을 냈을 것이라는 주장입니다.

이 논문의 이름이 "Training Compute-Optimal Large Language Models"(Hoffmann et al., 2022), 통칭 친칠라 논문(Chinchilla Paper)입니다. 이 한 편의 논문이 이후 Llama, Mistral, Gemma — 2023년 이후 등장한 거의 모든 주요 LLM의 설계 철학을 바꿔놓습니다.

토큰 버짓(Token Budget)이라는 개념, 그리고 "모델을 얼마나 크게 만들고, 데이터를 얼마나 먹일 것인가"라는 질문의 역사를 처음부터 끝까지 추적해 봅시다.

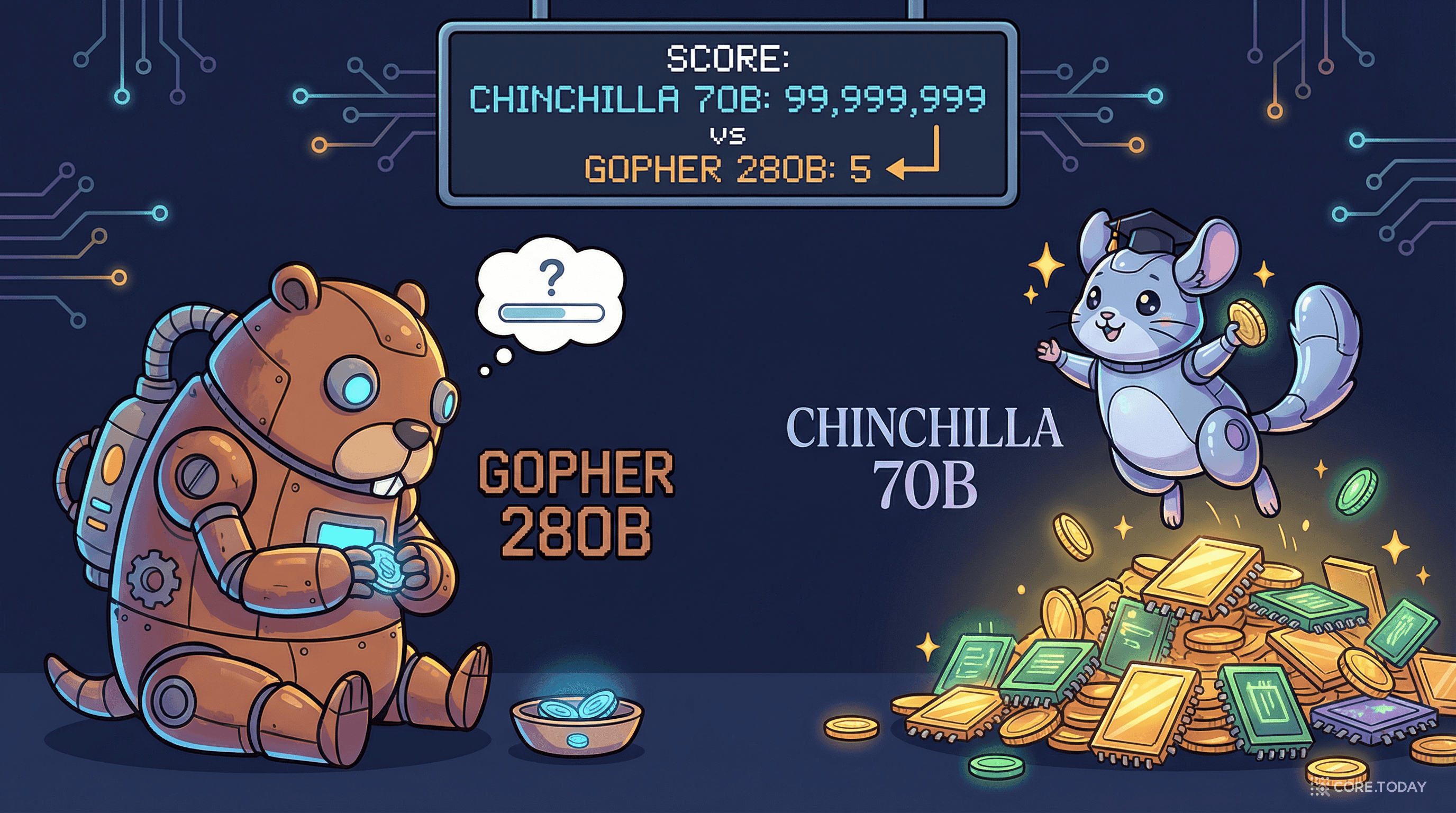

모든 것은 2020년 1월, OpenAI의 카플란 등(Jared Kaplan et al.)이 발표한 "Scaling Laws for Neural Language Models"에서 시작합니다.

이 논문은 AI 역사에서 가장 영향력 있는 발견 중 하나를 보여줍니다: LLM의 성능은 세 가지 변수에 대해 매끄러운 멱법칙(power law)을 따른다.

카플란의 핵심 결론:

고정된 연산 예산이 있다면, 모델을 최대한 크게 만들고 데이터는 상대적으로 적게 써라.

구체적으로: 연산을 10배 늘리면, 모델 크기는 ~5.5배 키우되 데이터는 ~1.8배만 늘리라는 것이었습니다. 모델 크기 >>> 데이터 양이라는 처방이었죠.

이 논문이 직접적으로 영향을 준 것이 바로 GPT-3입니다:

모델 크기: 1,750억 파라미터 (당시 최대)

학습 데이터: 3,000억 토큰

토큰/파라미터 비율: ~1.7

카플란의 처방대로: 거대한 모델 + 상대적으로 적은 데이터

2020~2021년, 업계 전체가 이 패러다임을 따릅니다. "더 크게 만들면 더 똑똑해진다"는 믿음으로, 모델 크기 경쟁이 벌어집니다.

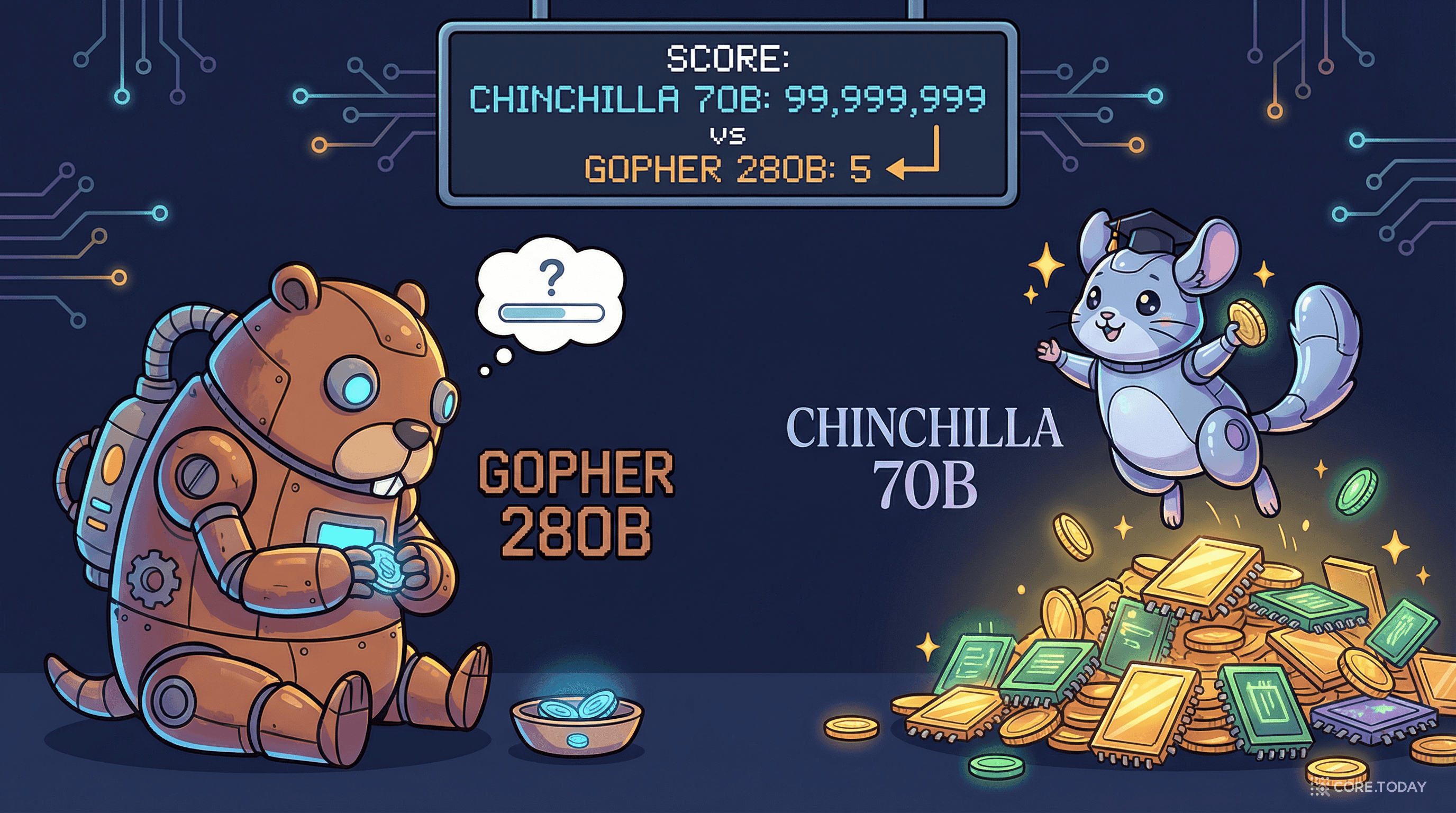

DeepMind도 같은 경쟁에 참여합니다. 2021년 12월, Gopher(2,800억 파라미터, 3,000억 토큰)를 발표합니다. 카플란 법칙을 충실히 따른 설계였죠.

하지만 DeepMind 연구팀은 의문을 가집니다: "정말 모델 크기가 가장 중요한 변수일까?"

이들은 체계적인 실험을 설계합니다. 400개 이상의 모델(7천만~160억 파라미터)을 다양한 데이터 양(50억~4,000억 토큰)으로 훈련시키며, 세 가지 독립적인 방법으로 최적 비율을 분석합니다.

연산을 최적으로 사용하려면:

모델 크기(N)와 데이터 양(D)을 같은 비율로 확장하라.

구체적 비율: 파라미터 1개당 약 20개의 학습 토큰

연산 10배 증가 시: N을 ~3.16배, D도 ~3.16배 증가 (√10 ≈ 3.16)

카플란: N을 5.5배, D를 1.8배 → 모델 크기 편향

친칠라: N을 3.16배, D도 3.16배 → 균형 성장

이 이론을 증명하기 위해, DeepMind는 Gopher와 정확히 같은 연산 예산으로 새 모델을 훈련시킵니다:

결과:

4배 작은 모델이 4배 많은 데이터로 훈련했을 뿐인데, 거의 모든 벤치마크에서 승리합니다. 심지어 1,750억 파라미터의 GPT-3보다도 나았습니다.

이 결과가 의미하는 것: GPT-3, Gopher 등 기존 거대 모델들은 모두 "과소 훈련"되었다. 같은 연산으로 더 작은 모델을 더 많은 데이터로 훈련시켰다면 더 좋았을 것이다.

카플란 팀의 실험에는 방법론적 차이가 있었습니다:

학습률 스케줄: 카플란 팀은 고정된 학습률 스케줄을 사용했습니다. 하지만 최적의 학습률은 학습 기간(토큰 수)에 따라 달라져야 합니다. 코사인 감쇠 스케줄을 학습 기간에 맞게 조정하면, 더 많은 데이터의 가치가 정확히 반영됩니다.

조기 종료 기준: 카플란 팀은 충분히 긴 학습을 수행하지 않은 상태에서 외삽(extrapolation)했습니다. 짧은 학습에서는 모델 크기의 영향이 과대평가됩니다.

모델 크기 범위: 카플란 팀의 실험은 상대적으로 작은 모델에서 진행되었고, 큰 모델로의 외삽 과정에서 오차가 누적되었습니다.

핵심: 카플란 법칙이 "완전히 틀린" 것은 아니지만, 실험 설계의 한계로 모델 크기의 중요성을 과대평가했습니다.

친칠라 논문은 업계를 즉각적으로 변화시킵니다.

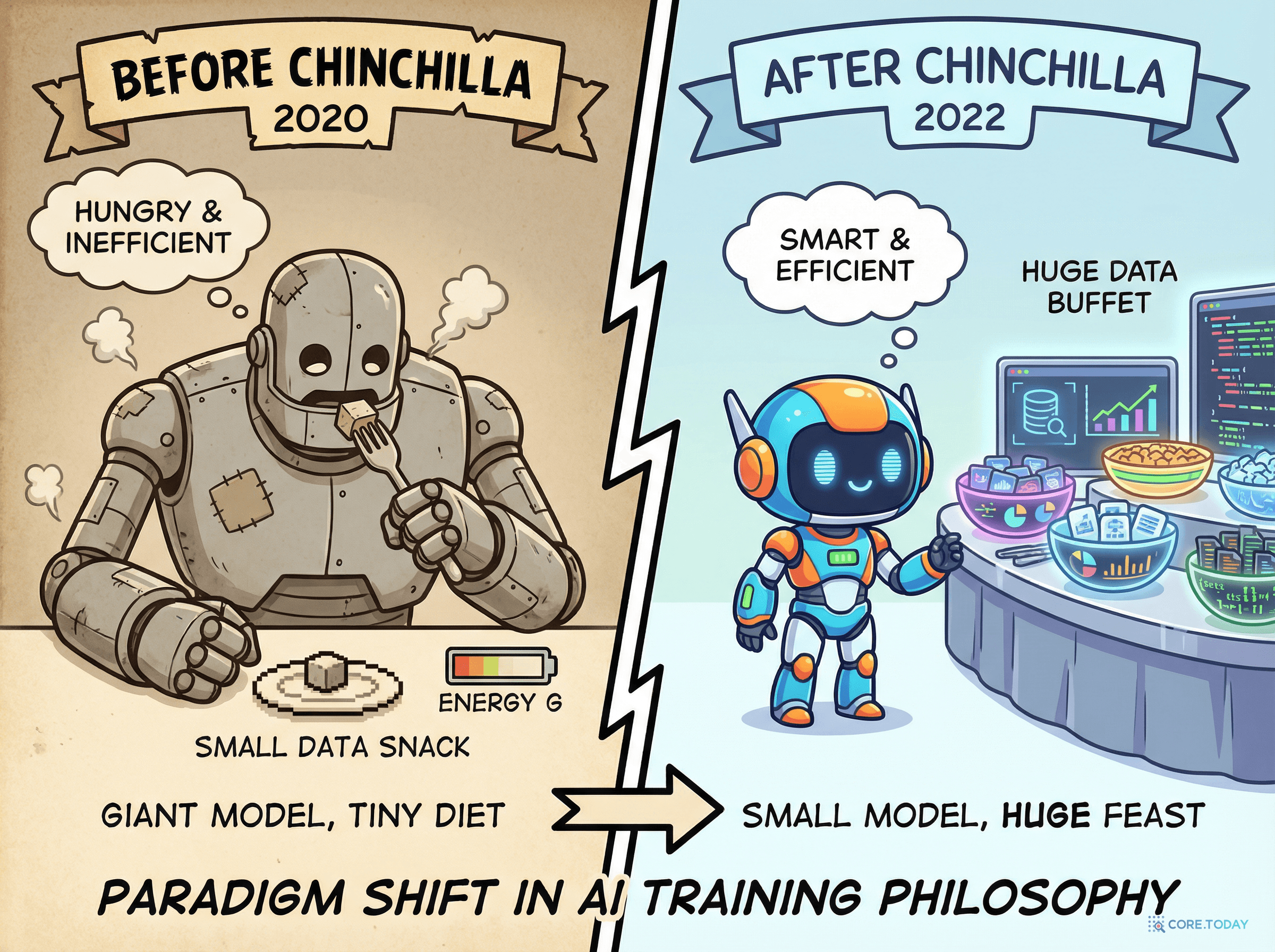

Meta의 Llama 1(Touvron et al.)은 친칠라를 인용하면서도, 한 걸음 더 나아갑니다:

"친칠라 최적은 '훈련 비용'을 최소화한다. 하지만 실전에서 중요한 건 '추론 비용'이다."

모델은 한 번 훈련하지만, 추론은 수백만 번 실행됩니다. 작은 모델이 서빙 비용이 적으므로, 훈련을 조금 더 오래 해서라도 작은 모델의 성능을 끌어올리는 것이 경제적입니다.

결과: Llama 13B가 GPT-3(175B)를 대부분의 벤치마크에서 능가. 13배 작은 모델이 이긴 것입니다. 비결은 간단했습니다 — 데이터를 훨씬 많이 먹였습니다.

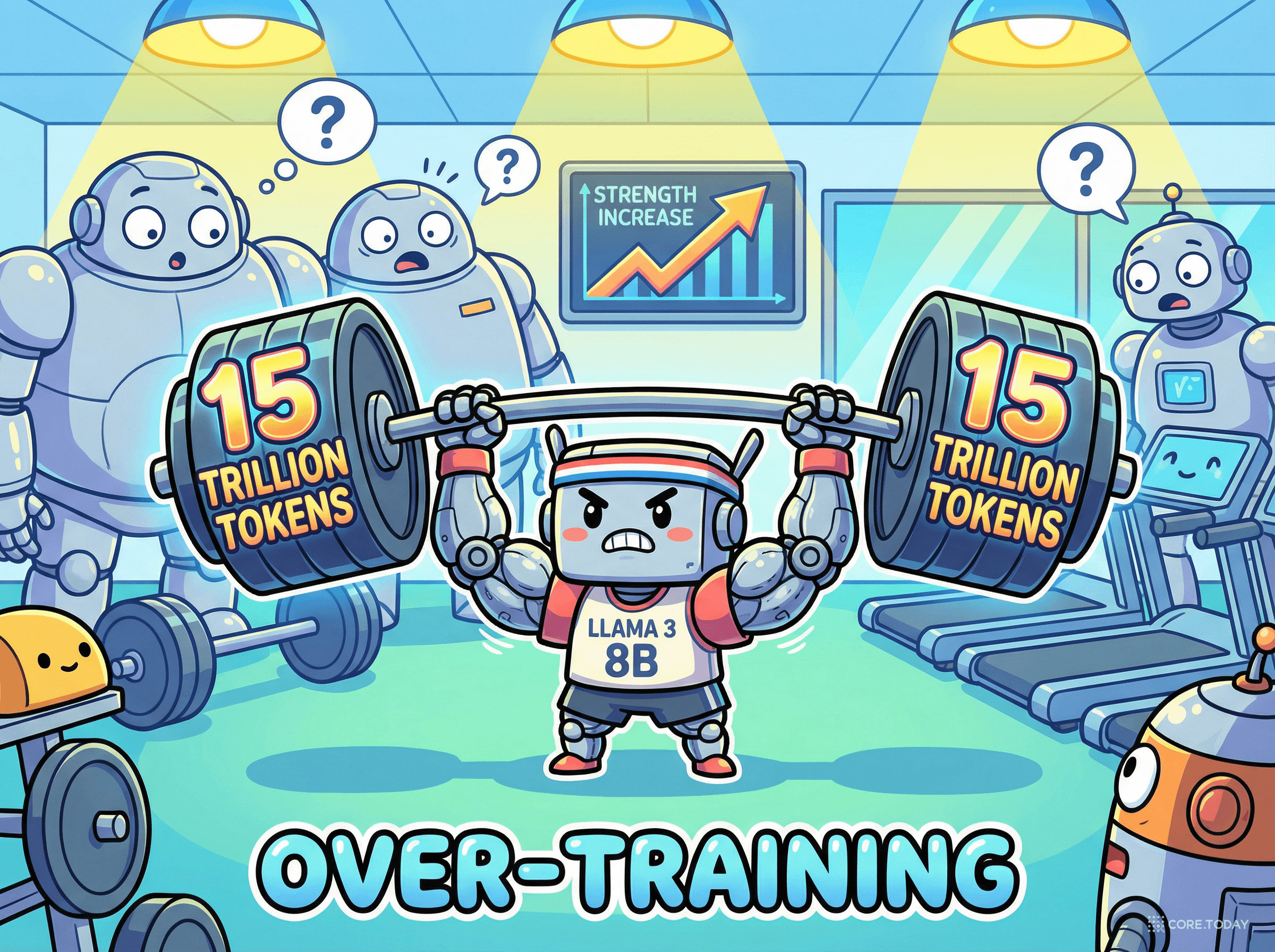

Llama 1 이후, 업계는 의도적 오버트레이닝(Over-training)이라는 새 패러다임을 채택합니다:

친칠라 최적: 파라미터당 ~20토큰

Llama 2 7B (2023): 2T 토큰 → 286 tok/param (14×)

Mistral 7B (2023): ~2T+ 토큰 → ~286+ tok/param (14×+)

Gemma 7B (2024): 6T 토큰 → 857 tok/param (43×)

Llama 3 8B (2024): 15T 토큰 → 1,875 tok/param (94×!)

Llama 3 8B는 친칠라 최적 대비 94배 더 많은 데이터로 훈련되었습니다. 그리고 이전 세대 70B 모델에 필적하는 성능을 보여줍니다.

친칠라 법칙과 오버트레이닝 트렌드가 함께 만드는 불편한 진실이 있습니다: 모델이 원하는 만큼의 고품질 텍스트 데이터가 존재하는가?

Epoch AI의 비야로보스 등(Villalobos et al., "Will we run out of data?", 2022)은 충격적인 분석을 발표합니다:

인터넷의 고품질 텍스트: 추정 ~4.6조~17조 토큰 (영어 기준)

전체 인터넷 텍스트: 추정 ~수십조 토큰

Llama 3 8B 하나가 이미 15조 토큰을 소비.

다음 세대 모델이 100조 토큰을 필요로 한다면?

예상 고갈 시점: 2026~2028년 사이 고품질 텍스트 데이터 소진 가능

물론 다국어 데이터, 코드, 과학 문헌 등을 포함하면 확장 가능하지만, 한계는 존재

2024년, Epoch AI의 베시로글루, 에르딜 등(Besiroglu, Erdil et al.)이 "Chinchilla Scaling: A Replication Attempt"을 발표하며 원 논문의 재현을 시도합니다:

친칠라 법칙은 모든 토큰이 동일한 가치를 가진다고 가정합니다. 하지만 현실은 다릅니다.

Microsoft의 Phi 시리즈가 이를 극적으로 보여줍니다:

"좋은 데이터 1토큰은 나쁜 데이터 10토큰의 가치가 있다" — 이것은 친칠라가 다루지 않은 차원입니다.

친칠라가 연 "모델 크기 vs 데이터 양" 논쟁은 이제 더 넓은 맥락으로 확장되었습니다:

2025년의 핵심 인사이트: 스케일링은 더 이상 "모델을 키우는 것"만이 아닙니다. 사전학습, 사후학습, 추론 시간, 아키텍처, 데이터 품질, 도구 사용 — 여러 축에서 동시에 스케일링하는 것이 현대 LLM의 전략입니다.

친칠라 논문의 가장 큰 공헌은 "파라미터당 20토큰"이라는 숫자가 아닙니다. "더 크게"가 유일한 답이 아니라는 것을 증명한 것입니다.

이 발견 하나가 Llama의 탄생을, Mistral의 성공을, 그리고 "작지만 강한" 오픈소스 모델 생태계의 폭발을 가능하게 했습니다. A100 수천 장이 아니어도, 좋은 데이터와 올바른 비율만 있으면 경쟁력 있는 모델을 만들 수 있다는 것.

그리고 이제 우리는 알고 있습니다: 정답은 하나의 축에 있지 않다. 모델 크기, 데이터 양, 데이터 품질, 사후 학습, 추론 시간 연산 — 이 모든 축의 균형을 찾는 것이 2025년 AI 엔지니어의 진짜 과제입니다.

친칠라가 가르쳐준 것: AI에서도, 무조건 크게가 아니라 균형 있게.