OpenClaw — 주말 프로젝트가 AI의 다음 챕터가 되기까지

오스트리아의 한 개발자가 WhatsApp으로 AI와 대화하고 싶었다. 6개월 뒤, 그 주말 프로젝트는 GitHub 역사상 가장 빠르게 성장한 오픈소스 프로젝트가 되었다. OpenClaw의 탄생부터 기술 원리, 글로벌 열풍, 그리고 보안의 그림자까지.

오스트리아의 한 개발자가 WhatsApp으로 AI와 대화하고 싶었다. 6개월 뒤, 그 주말 프로젝트는 GitHub 역사상 가장 빠르게 성장한 오픈소스 프로젝트가 되었다. OpenClaw의 탄생부터 기술 원리, 글로벌 열풍, 그리고 보안의 그림자까지.

2025년 11월의 어느 주말. 오스트리아 빈에 사는 개발자 Peter Steinberger는 간단한 소망이 있었다. 매일 쓰는 WhatsApp으로 AI와 대화하면서, AI가 내 컴퓨터에서 실제로 일을 해줬으면 좋겠다. 파일을 정리하고, 코드를 실행하고, 이메일을 보내고, 웹을 검색하는 — 진짜 비서 말이다.

그는 주말 동안 프로토타입을 만들었다. 6개월 뒤인 2026년 3월, 그 프로젝트는 GitHub 스타 32만 개를 넘기며 React를 제치고 역대 가장 빠르게 성장한 오픈소스 프로젝트가 되었다. NVIDIA CEO 젠슨 황은 이것을 "다음 ChatGPT"라 불렀고, 중국에서는 "랍스터 키우기" 열풍이 불었으며, Sam Altman과 Mark Zuckerberg가 동시에 러브콜을 보냈다.

그 프로젝트의 이름은 OpenClaw다.

이 글은 두 파트로 나뉜다.

OpenClaw를 이해하려면 먼저 만든 사람을 알아야 한다.

Peter Steinberger는 오스트리아 출신의 iOS/macOS 개발자다. 그가 2011년에 창업한 PSPDFKit은 PDF 처리 SDK로, Apple, Dropbox, Autodesk 등이 채택했고 전 세계 10억 대 이상의 기기에서 구동되었다. 2023년, PSPDFKit은 약 1억 유로(약 1,400억 원)에 매각되었다.

| 시기 | 이력 |

|---|---|

| 2011 | PSPDFKit 창업 |

| 2023 | PSPDFKit 매각 (~€100M) |

| 2025.11 | Clawdbot 첫 공개 |

| 2026.02 | OpenAI 합류 |

수천만 사용자를 가진 제품을 만들고 운영한 경험. 이것이 중요한 이유는, OpenClaw의 설계 곳곳에 "실제로 대규모 소프트웨어를 운영해 본 사람의 판단"이 녹아 있기 때문이다.

Steinberger의 핵심 철학은 세 단어로 요약된다:

"Your assistant. Your machine. Your rules." 당신의 비서. 당신의 기기. 당신의 규칙.

기존 AI 비서들 — Siri, Alexa, ChatGPT — 은 모두 클라우드에 종속되어 있다. 대화 기록은 기업 서버에 저장되고, 기능은 회사가 정한 범위 안에서만 작동하며, 인터넷이 끊기면 아무것도 할 수 없다.

Steinberger는 다른 것을 원했다:

그리고 2025년 11월의 그 주말, 그는 첫 번째 프로토타입을 만들었다. 이름은 Clawdbot — Anthropic의 AI 모델 Claude에 대한 말장난이었다.

처음에 Clawdbot은 Steinberger의 개인 프로젝트였다. GitHub에 올렸지만 큰 반향은 없었다. 하지만 AI 개발자 커뮤니티에서 조금씩 입소문이 퍼지기 시작했다. "WhatsApp으로 AI 에이전트를 조종할 수 있다"는 컨셉 자체가 새로웠다.

2026년 1월, 프로젝트가 빠르게 성장하자 Anthropic이 상표권 문제를 제기했다. "Clawdbot"이 자사 AI 모델 "Claude"와 혼동을 줄 수 있다는 이유였다. Steinberger는 즉시 이름을 Moltbot으로 변경했다.

불과 3일 뒤, 이름은 다시 OpenClaw로 바뀌었다. 이번에는 단순한 개명이 아니라, 오픈소스 철학을 이름에 담겠다는 선언이었다. MIT 라이선스, 완전 무료, 누구나 자유롭게 사용·수정·배포할 수 있다.

이름이 OpenClaw로 정착된 직후, 바이럴이 시작됐다.

1주일 만에 10만 스타, 웹사이트 방문자 200만 명. React(23만 스타)를 넘어 GitHub 역대 최다 스타 프로젝트가 되었다.

이 폭발적 성장 앞에서 Steinberger의 선택이 놀라웠다. 상업화 대신, 그는 이렇게 선언했다:

"What I want is to change the world, not build a large company."

그리고 2026년 2월 14일, 예상치 못한 발표가 나왔다. Sam Altman(OpenAI)과 Mark Zuckerberg(Meta) 모두가 직접 연락을 해왔고, Steinberger는 OpenAI에 합류하기로 결정했다. OpenClaw는 OpenAI의 후원을 받는 독립 오픈소스 재단으로 전환되었다.

주말 프로젝트 → 4개월 만에 AI 업계 최대 오픈소스 프로젝트 → 창업자 OpenAI 합류. 소프트웨어 역사에서도 유례를 찾기 어려운 궤적이다.

2026년 3월 17일, NVIDIA CEO 젠슨 황이 공개 석상에서 OpenClaw를 언급했다:

"OpenClaw is definitely the next ChatGPT." — Jensen Huang, NVIDIA CEO

"개인 AI의 운영체제"라는 표현까지 덧붙였다. 이 발언 직후, OpenClaw 관련 중국 AI 주식이 일제히 급등했다.

중국에서 벌어진 일은 기술 트렌드를 넘어 사회 현상이었다. OpenClaw의 마스코트가 랍스터(🦞)인 데서 유래하여, AI 에이전트를 설치하고 토큰을 먹이며 스킬을 가르치는 과정을 랍스터 사육에 비유한 "养龙虾(yǎng lóng xiā, 양룽샤)" — 즉 "랍스터 키우기"라는 밈이 탄생했다.

2026년 3월 16일, NVIDIA는 GTC 컨퍼런스에서 NemoClaw를 발표했다. OpenClaw의 엔터프라이즈 버전이다:

2026년 1월 28일, Matt Schlicht가 Moltbook을 출시했다. Reddit과 비슷한 소셜 네트워크인데, 오직 AI 에이전트만 글을 쓸 수 있고 인간은 열람만 가능하다는 규칙이었다. 2026년 2월까지 160만 에이전트가 등록되었고, 3월 10일 Meta가 인수했다.

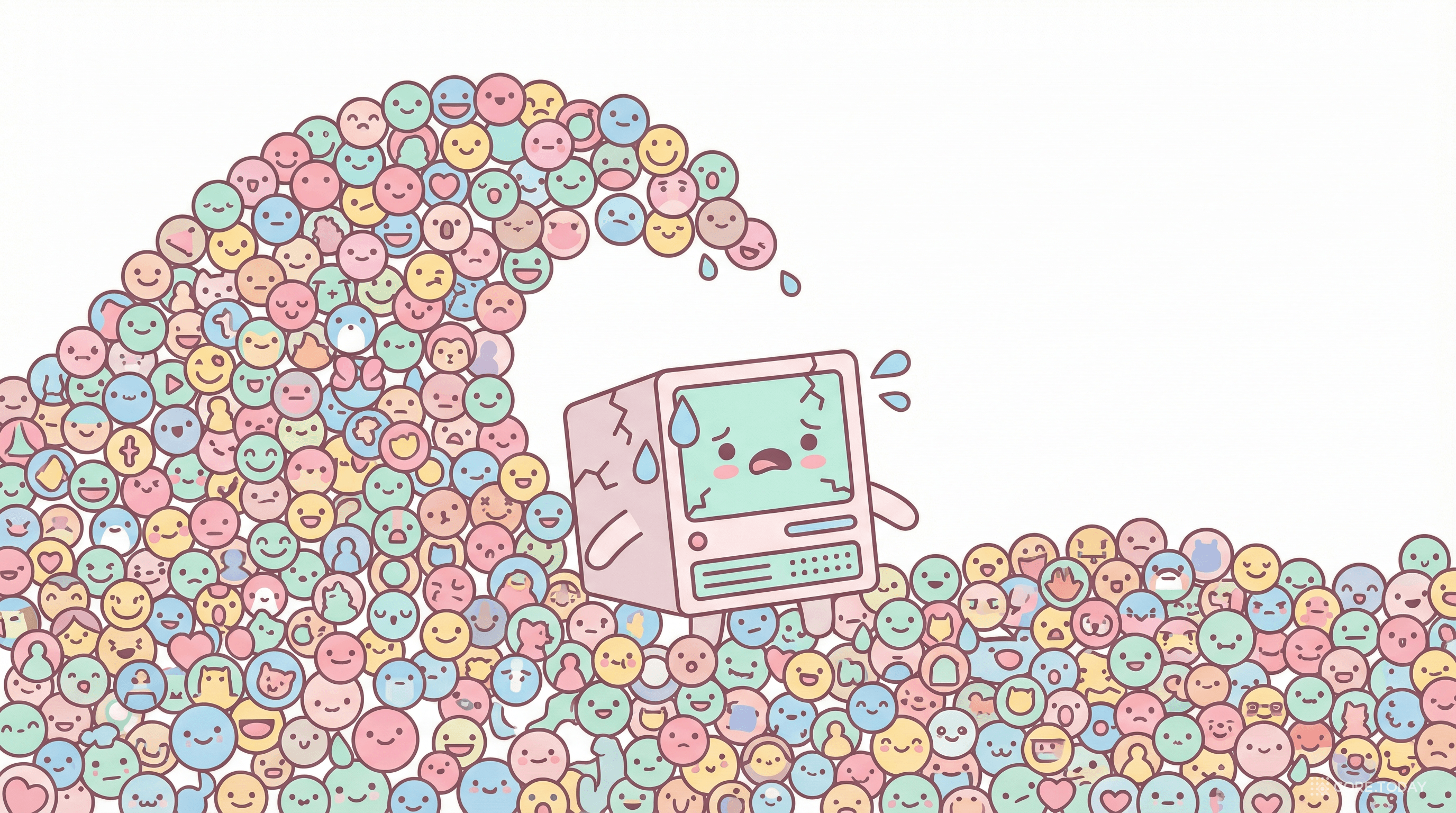

2023년 3월, AutoGPT가 등장하며 "자율 AI 에이전트" 개념이 처음으로 대중화되었다. AI가 스스로 계획을 세우고, 인터넷을 검색하고, 코드를 실행한다는 비전은 매력적이었다. GitHub 스타가 빠르게 16만 개를 넘겼다.

하지만 실제로는 작동하지 않았다. 2023년의 LLM(GPT-3.5, 초기 GPT-4)은 멀티스텝 도구 사용에서 빈번하게 실패했다. 에이전트가 무한 루프에 빠지거나, 엉뚱한 도구를 호출하거나, 중간 단계에서 맥락을 잃어버렸다.

AutoGPT는 시대를 앞서간 프로젝트였다. 아이디어는 맞았지만, 기반 기술이 준비되지 않았다.

2025년에 이르러 상황이 근본적으로 달라졌다:

| 영역 | 2023년 ❌ | 2025년 ✅ |

|---|---|---|

| 모델 | GPT-3.5 / 초기 GPT-4 | Claude 3.5+, GPT-4o+, DeepSeek V3 |

| 도구 호출 | 성공률 낮음, 불안정 | 구조화된 도구 사용 안정화 |

| 표준 | Function Calling만 존재 | MCP 표준 생태계 형성 |

| 에이전트 | 데모 수준 | 실무 투입 가능 🚀 |

핵심 변화는 LLM의 도구 사용 신뢰도다. 2023년에는 에이전트가 도구를 10번 연속 정확히 호출하는 것 자체가 불안정했다. 2025년에는 수십 단계의 복잡한 워크플로우를 안정적으로 수행할 수 있게 되었다.

OpenClaw는 하늘에서 뚝 떨어진 것이 아니다. 3년간의 시행착오 위에 서 있다:

OpenClaw가 이 계보에서 성공한 이유를 다섯 가지로 정리할 수 있다:

| 성공 요인 | 설명 |

|---|---|

| 신뢰할 수 있는 LLM | Claude 3.5+, GPT-4+ 등 도구 사용이 안정적인 모델 백엔드 |

| 메신저 인터페이스 | WhatsApp, Telegram 등 이미 익숙한 앱으로 접근 |

| 로컬 우선 아키텍처 | 모든 데이터가 내 기기에 저장, 프라이버시 보장 |

| 모듈형 스킬 시스템 | VS Code 확장처럼 기능을 자유롭게 추가·제거 |

| 오픈소스 커뮤니티 | MIT 라이선스, 6만 2천 포크, 2만 커밋 |

OpenClaw는 네 개의 계층으로 구성된다. 각 계층은 독립적이며, 명확한 역할을 가진다.

채널 계층은 "귀"다. 사용자가 WhatsApp에서 보낸 메시지든, Slack에서 보낸 메시지든, 동일한 형식으로 변환해 게이트웨이에 전달한다. 게이트웨이는 "두뇌의 교환대"다. 어떤 에이전트가 어떤 요청을 처리할지 결정하고, 세션을 관리한다. 에이전트 계층은 "두뇌" 자체다. LLM을 사용해 추론하고, 어떤 도구를 쓸지 결정한다. 실행 계층은 "손"이다. 실제로 파일을 쓰고, 명령을 실행하고, 웹을 탐색한다.

OpenClaw의 핵심 설계 중 하나는 에이전트의 정체성과 기억을 로컬 파일로 관리한다는 점이다:

~/.openclaw/workspace/

SOUL.md ← 에이전트의 성격과 정체성

AGENTS.md ← 멀티에이전트 협업 규칙

TOOLS.md ← 도구 사용 가이드라인

MEMORY.md ← 장기 기억 인덱스

memory/ ← 일별 기억 로그

skills/ ← 워크스페이스 전용 스킬

SOUL.md가 특히 흥미롭다. 에이전트에게 "너는 누구인가"를 정의하는 파일이다. 마크다운으로 작성되며, 에이전트의 말투, 전문 분야, 행동 원칙을 자유롭게 설정할 수 있다. 기업 문화를 담은 온보딩 문서를 AI에게 주는 셈이다.

OpenClaw의 스킬은 모듈형 도구 번들이다. VS Code의 확장(extension)처럼 필요한 기능을 설치하고 제거할 수 있다. 3단계 우선순위로 적용된다:

각 스킬은 SKILL.md 파일을 포함한 디렉토리이며, YAML 프론트매터로 메타데이터를 정의한다. 에이전트는 스킬 메타데이터를 지연 로딩(lazy loading)하고, 필요할 때만 전체 스킬 내용을 읽어온다.

실제 커뮤니티에서 만들어진 스킬을 직접 탐색해 보자. 카테고리를 필터하고, 카드를 클릭하면 상세 설명과 사용 예시를 볼 수 있다:

OpenClaw의 메모리는 하이브리드 검색 구조다:

장기 기억은 sqlite-vec 기반 벡터 임베딩과 FTS5 전문 검색을 병렬 실행한 뒤, Reciprocal Rank Fusion(RRF)으로 결과를 통합한다. 시맨틱 유사도와 키워드 매칭의 장점을 모두 살리는 방식이다.

이를 통해 에이전트는 3개월 전에 나눈 대화도 맥락에 맞게 기억하고 활용할 수 있다.

OpenClaw는 특정 LLM에 종속되지 않는다. 지원 모델 목록:

모델 간 자동 페일오버(failover) 기능도 내장되어 있다. Claude API가 일시적으로 응답하지 않으면 GPT로 자동 전환하는 식이다.

OpenClaw의 폭발적 성장은 동시에 학술적 관심도 불러일으켰다. 2026년 3월 기준, 주요 논문 네 편이 발표되었다.

Yinjie Wang et al., arXiv 2603.10165, 2026.03.10

가장 주목할 논문이다. 핵심 질문은 이렇다: 사용자가 에이전트와 평소처럼 대화하는 것만으로 에이전트의 성능을 개선할 수 있는가?

답은 "그렇다"였다. OpenClaw-RL은 차기 상태 신호(next-state signal)가 범용적이라는 발견에 기반한다. 개인 대화, 터미널 실행, GUI 조작, 코드 수정 — 이 모든 상호작용에서 동일한 방식으로 학습 신호를 추출할 수 있다.

쉽게 비유하면 이렇다:

두 가지 학습 경로로 이루어진다:

이것이 중요한 이유: 에이전트가 사용될수록 자동으로 나아진다. 별도의 훈련 파이프라인이나 레이블링 없이, 일상적 사용 자체가 학습 데이터가 된다.

| 논문 | 핵심 내용 |

|---|---|

| Defensible Design for OpenClaw (arXiv 2603.13151) | 위험 분류 체계 제안, "기본값이 안전하지 않다"는 구조적 문제 지적 |

| Security Analysis & Defense Framework (arXiv 2603.10387) | 공격 표면 실증 분석, 프롬프트 인젝션·권한 상승 시나리오 |

| OpenClaw Agents on Moltbook (arXiv 2602.02625) | 에이전트 간 지시 공유의 사회적 위험, AI-to-AI 조작 가능성 |

| OpenClaw as Language Infrastructure (Preprints 202603.1060) | 공개 에이전트 생태계의 사례 중심 분석 |

이 논문들이 공통으로 지적하는 핵심: OpenClaw 에이전트는 신뢰할 수 없는 입력, 자율적 행동, 확장 가능한 구조, 시스템 수준 권한이 결합된 존재다. 강력하지만, 그만큼 위험하다.

OpenClaw가 강력한 이유 — 파일 접근, 셸 실행, 브라우저 제어, API 호출 — 는 동시에 위험한 이유이기도 하다.

AI 비평가 Gary Marcus는 이렇게 경고했다:

"이 시스템들은 운영체제와 브라우저의 보안 보호를 위에서 작동한다. 무기화된 에어로졸과 같다."

구체적인 위험 시나리오:

실제로 중국 국가인터넷비상대응센터(CNCERT/CC)는 기본 보안 설정의 취약점을 경고했고, 베이징은 공공기관과 국영기업의 업무 기기에서 OpenClaw 사용을 제한했다.

보안 전문가들이 제안하는 OpenClaw 사용 원칙은 한 문장으로 요약된다:

신입사원을 대하듯 — 최소 권한, 명확한 규칙, 밀착 감독.

실무 가이드라인:

이 글에서 따라온 여정을 되짚어 보자.

OpenClaw의 성공을 하나의 문장으로 설명하면 이렇다: AI가 드디어 "충분히 신뢰할 수 있게" 되었고, OpenClaw는 그 신뢰를 "누구나 쓸 수 있는 형태"로 포장한 첫 번째 프로젝트다.

ChatGPT가 "AI와 대화할 수 있다"는 것을 증명했다면, OpenClaw는 "AI가 나를 대신해 행동할 수 있다"는 것을 증명하고 있다. 채팅 인터페이스에서 에이전트 인터페이스로의 전환. 이것이 젠슨 황이 "다음 ChatGPT"라 부른 이유다.

물론 그림자도 있다. 보안 위험은 현실적이고, "신입사원처럼 대하라"는 원칙은 당분간 유효할 것이다. 하지만 방향은 분명하다.

Peter Steinberger가 원했던 것은 거창한 기술 혁명이 아니었다. 그냥 WhatsApp으로 AI와 편하게 일하고 싶었을 뿐이다. 세상을 바꾸는 프로젝트는 종종 그렇게 시작된다 — 자신의 불편함을 해결하려는 단순한 시도에서.

"Your assistant. Your machine. Your rules."