엣지 AI 완전 가이드: 클라우드 없이 현장에서 추론하는 시대가 열렸다

2026년, AI 추론의 55%가 클라우드가 아닌 현장에서 일어난다. 왜 엣지에서 돌려야 하는지(지연 1ms vs 200ms, 프라이버시, 비용 87% 절감), 어떤 하드웨어를 쓰는지(Jetson Thor 2,070 TOPS, Snapdragon 100 TOPS NPU), 그리고 실전에서 어떻게 배포하는지를 총정리한다.

2026년, AI 추론의 55%가 클라우드가 아닌 현장에서 일어난다. 왜 엣지에서 돌려야 하는지(지연 1ms vs 200ms, 프라이버시, 비용 87% 절감), 어떤 하드웨어를 쓰는지(Jetson Thor 2,070 TOPS, Snapdragon 100 TOPS NPU), 그리고 실전에서 어떻게 배포하는지를 총정리한다.

자율주행 차량이 시속 100km로 달리고 있다. 전방에 갑자기 보행자가 나타난다.

이 상황에서 AI가 "브레이크를 밟아야 한다"고 판단하는 데 걸리는 시간:

200ms 동안 차량은 5.6m를 더 이동한다. 이 5.6m가 생사를 가른다.

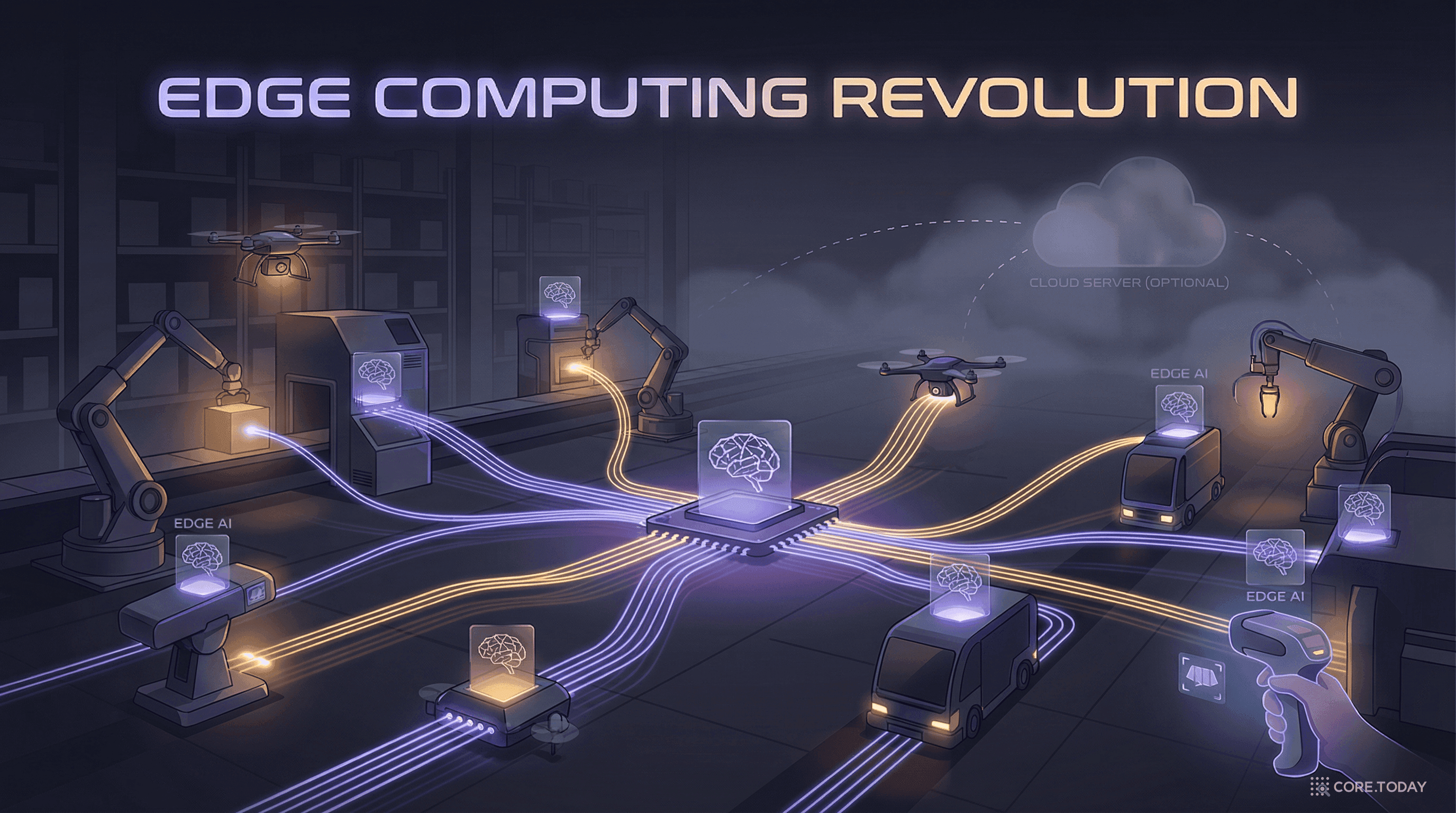

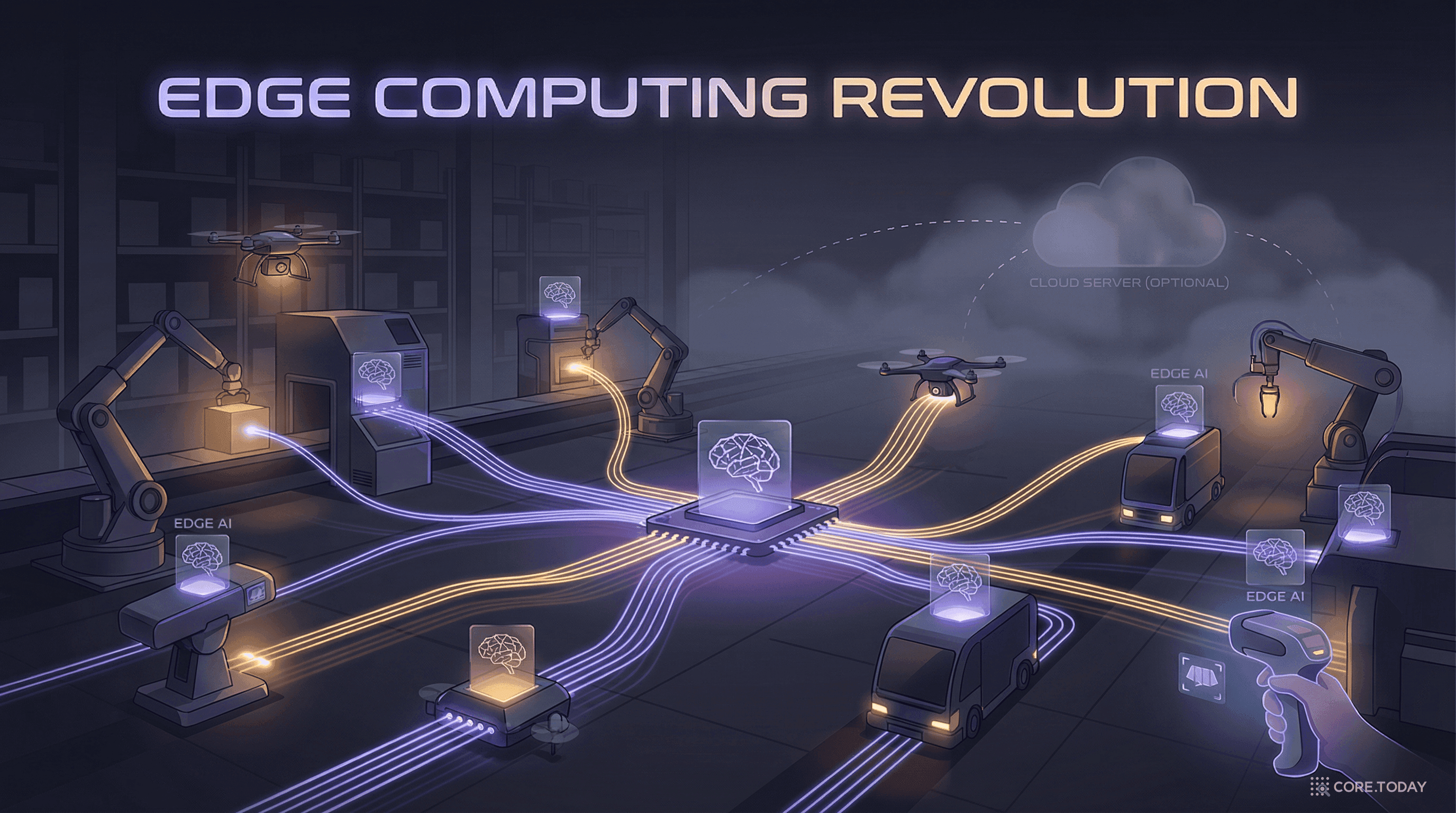

이것이 엣지 AI가 존재하는 가장 근본적인 이유다. 데이터를 클라우드에 보내고 결과를 기다릴 여유가 없는 상황 — 자율주행, 산업용 로봇, 의료 기기, 스마트 팩토리 — 에서 AI는 현장에서 바로 추론해야 한다.

2026년, AI 추론의 55%가 클라우드가 아닌 현장에서 일어난다. 엣지 AI는 더 이상 미래 기술이 아니라 현재의 인프라다.

엣지 AI는 "AI 추론을 데이터가 생성되는 곳 가까이에서 실행하는 것"이다. 하지만 "가까이"의 정도가 다르다.

2026년의 현실: 대부분의 프로덕션 환경은 세 층위를 혼합한다. 실시간 판단은 온디바이스에서, 중간 처리는 엣지 서버에서, 대규모 학습과 분석은 클라우드에서.

| 환경 | 클라우드 | 엣지 서버 | 온디바이스 |

|---|---|---|---|

| 자율주행 | 200ms ❌ | 30ms △ | 5ms ✓ |

| 산업 로봇 제어 | 200ms ❌ | 20ms △ | <10ms ✓ |

| 스마트 교통 신호 | 150ms △ | 20ms ✓ | — |

| 의료 모니터링 | 100ms △ | 10ms ✓ | 5ms ✓ |

| 챗봇 | 100ms ✓ | ✓ | ✓ |

자율주행에서 200ms는 5.6m의 차이이고, 산업 로봇에서 10ms의 차이는 불량률의 차이다. 실시간 교통 신호 제어 시스템은 파일럿 프로젝트에서 교통 혼잡을 20% 감소시켰다.

한국 개인정보보호법(PIPA) 강화, AI 기본법 시행(2026.01.22), GDPR 벌금(최대 연매출 4%) — 데이터 규제가 갈수록 강화되고 있다.

2025년 2월, 한국 개인정보보호위원회(PIPC)는 DeepSeek에 대해 해외 서버로의 무단 데이터 전송을 이유로 데이터 삭제를 명령했다. 이 사건은 "데이터를 클라우드에 보내는 것 자체의 리스크"를 단적으로 보여준다.

엣지 AI는 이 문제를 구조적으로 해결한다: 데이터가 디바이스를 떠나지 않는다. 의료 영상, 금융 데이터, 개인 생체 정보 — 모두 현장에서 처리하고, 결과(추론 결과)만 필요할 때 전송한다.

사용자 수요: 설문에 따르면 78%의 사용자가 클라우드 AI 기능을 거부하며, 91%가 온디바이스 처리에 더 높은 비용을 지불할 의향이 있다.

시나리오: 100만 사용자가 하루 20회 AI 추론을 요청하는 서비스.

87% 비용 절감. 그리고 핵심: 온디바이스 비용은 유저 수와 무관하게 고정이다. 유저가 10만이든 1,000만이든 비용이 같다. 반면 클라우드 비용은 유저 수에 비례하여 선형 증가한다.

추가로, 엣지에서 데이터를 사전 필터링하면 클라우드로 보내는 데이터량이 줄어 대역폭 비용을 최대 70% 절감할 수 있다.

Jetson AGX Thor (2025년 8월 출시)가 게임 체인저다. NVIDIA Blackwell GPU + Arm Neoverse V3AE CPU를 탑재하여 2,070 TOPS(FP4)를 128GB LPDDR5X 메모리와 함께 40~130W에서 제공한다. AGX Orin 대비 7.5배 AI 성능, 3.5배 에너지 효율. 휴머노이드 로봇, 에이전틱 AI, 자율주행에 최적화.

| 모델 | AI 성능 | 메모리 | 전력 | 가격대 | 최적 용도 |

|---|---|---|---|---|---|

| Orin Nano | 40 TOPS | 4~8GB | 7~15W | ~$200 | IoT, 입문용 |

| Orin NX | 70~100 TOPS | 8~16GB | 10~25W | 중급 로보틱스 | |

| AGX Orin | 275 TOPS | 32~64GB | 15~60W | 고급 로보틱스, AV | |

| AGX Thor | 2,070 TOPS | 128GB | 40~130W | 프리미엄 | 휴머노이드, 에이전틱 AI |

2026년, 주요 모바일 AP와 PC 프로세서에 NPU(Neural Processing Unit)가 기본 탑재된다.

| 칩 | 제조사 | NPU 성능 | 공정 | 특징 |

|---|---|---|---|---|

| Snapdragon 8 Elite Gen 5 | Qualcomm | ~100 TOPS | 3nm | LLM 220 tok/s, 에이전틱 AI |

| Exynos 2600 | Samsung | NPU 39%↑ | 2nm | 세계 최초 모바일 2nm SoC |

| Tensor G5 | TPU 60%↑ | 3nm | Gemini Nano 2.6배 성능 | |

| Apple M5 | Apple | 38 TOPS | 3nm | M4 대비 3.5배 AI 성능 |

| Ryzen AI 400 | AMD | 60 TOPS | — | CES 2026 발표, 노트북용 |

| Core Ultra 200V | Intel | 48 TOPS | — | OpenVINO 생태계 |

핵심 인사이트: TOPS(초당 연산 수)가 높다고 실제 성능이 항상 좋은 것은 아니다. Apple은 TOPS가 낮아도 Core ML 통합과 유니파이드 메모리로 경쟁력 있는 성능을 낸다. NPU는 GPU 대비 44% 적은 전력으로 동등한 AI 태스크를 수행한다.

| 칩 | 제조사 | 성능 | 전력 | 최적 용도 |

|---|---|---|---|---|

| Hailo-8 | Hailo | 26 TOPS | 2.5W | 스마트 카메라, 자동차 |

| DX-M1 | DEEPX (한국) | 25 TOPS | <5W | 로보틱스 (현대 로봇 탑재) |

| Coral Edge TPU | 4 TOPS | 2W | 저전력 IoT | |

| SiMa.ai MLSoC | SiMa.ai | 50+ TOPS | <5W | 드론, 임베디드 비전 |

DEEPX는 한국 스타트업으로, 현대 로보틱스에 DX-M1 칩을 공급하고 있다. 차세대 DX-M2(삼성 2nm, 40 TOPS, RISC-V)는 200억 파라미터 모델을 지원할 예정이며, 삼성·Rambus와 2nm AI 칩 얼라이언스를 결성했다.

모델의 가중치를 32비트 부동소수점에서 8비트 또는 4비트 정수로 줄이는 기법.

실전 사례: 스마트 교통 카메라에 INT8 양자화 인식 훈련(Quantization-Aware Training)을 적용하여 에너지 소비를 3배 줄이면서 검출 정확도를 유지했다.

구조적 가지치기: 뉴런/채널 단위로 제거. 하드웨어 친화적. 산업용 진동 모니터링에서 40% 추론 속도 향상, 정확도 손실 2%에 불과.

지식 증류: 큰 "교사" 모델의 지식을 작은 "학생" 모델로 전이. 로보틱스 적용에서 모델 크기 75% 감소, 전력 50% 절감, 정확도 97% 유지.

| 런타임 | 제조사 | 최적 하드웨어 | 핵심 기능 |

|---|---|---|---|

| TensorRT | NVIDIA | Jetson, NVIDIA GPU | 레이어 퓨전, FP16/INT8 |

| Core ML | Apple | iPhone, Mac | Neural Engine 최적화 |

| ONNX Runtime | Microsoft | 크로스 플랫폼 | 다양한 실행 제공자 |

| TFLite (LiteRT) | Android, 임베디드 | 경량, 넓은 디바이스 지원 | |

| OpenVINO | Intel | Intel NPU | Intel 하드웨어 최적화 |

| QNN | Qualcomm | Snapdragon | Hexagon NPU 최적화 |

2026년, 스마트폰과 노트북에서 LLM을 로컬로 실행하는 것이 현실이 되었다.

| 플랫폼 | 모델 | 파라미터 | 특징 |

|---|---|---|---|

| Apple Intelligence | Apple Foundation Model | ~3B | 프라이버시 우선, A19 Pro/M5 |

| Google Gemini Nano | Gemini Nano | 1.8~3.25B | 시스템 수준 AICore, Tensor G5 |

| Qualcomm AI Hub | 다양한 최적화 모델 | 최대 7~13B | Snapdragon NPU 사전 최적화 |

| Samsung Galaxy AI | 온디바이스 모델 | — | Exynos 2600 NPU |

| 모델 | 파라미터 | 성능 | 엣지 성능 | 최적 용도 |

|---|---|---|---|---|

| Phi-3-mini | 3.8B | IFEval 69.0 | 빠르고 고품질 | 범용 |

| Llama 3.2 3B | 3B | MMLU 63.4 | Qualcomm/MediaTek 최적화 | 지시 따르기, 요약 |

| Llama 3.2 1B | 1.2B | 경쟁력 있음 | 100+ tok/s | 초저전력 |

| Gemma 2B | 2.6B | MMLU 57.8 | 최고 모바일 추론 속도 | 온디바이스 챗 |

| TinyLlama | 1.1B | 기본 | <5W 배포 가능 | 극한 엣지/IoT |

128K 토큰 컨텍스트를 지원하는 Llama 3.2 1B/3B이 온디바이스에서 실행 가능하다. SLM은 대형 모델의 80~90% 능력을 1/10~1/30 비용으로 제공한다.

| 프레임워크 | 강점 | 플랫폼 | 성능 특징 |

|---|---|---|---|

| llama.cpp | 순수 C/C++, 의존성 제로 | 모든 플랫폼 | 가장 효율적 단일 스트림 |

| Ollama | 개발자 친화 CLI/API | 데스크톱 | OpenAI 호환 API |

| MLC LLM | 크로스 플랫폼 | iOS/Android/웹/데스크톱 | Paged KV 캐싱 |

| MLX | Apple Silicon 최적화 | macOS | 최고 지속 처리량 |

| MediaPipe | Google 생태계 | Android/웹 | Gemini Nano 통합 |

Snapdragon 8 Elite Gen 5에서 LLM이 220 tok/s로 추론된다. 이것은 클라우드 API 응답 속도와 비교해도 경쟁력 있는 수치다.

엣지 AI 기반 비전 시스템은 생산 라인에서 0.3초 이내에 99.7% 정확도로 불량을 검출한다. 클라우드 기반 시스템이 수 초 걸리는 것과 비교하면, 생산 라인의 속도를 늦추지 않고 실시간 품질 관리가 가능하다.

Siemens 사례: 10,000대 이상의 기계에서 진동·온도·음향 데이터를 엣지에서 분석. 고장을 7~10일 전에 예측. 유지보수 비용 30% 절감, 다운타임 50% 감소, 자산 활용도 15% 향상.

Tesla FSD: 차세대 AI5 칩은 2,000~2,500 TOPS를 목표로 하며, NVIDIA 대비 10배 비용 효율, 3배 전력 효율을 주장. 2026년 3월 21일, 자체 칩 생산 공장(Terafab) 가동 시작.

모든 자율주행 차량의 핵심 원칙: 안전 결정은 반드시 로컬에서. 클라우드는 전체 차량 데이터를 수집하여 모델을 개선하는 역할만 한다.

NVIDIA Jetson Nano에 배포된 CNN-LSTM 모델이 실시간 환자 모니터링에서 91.9% 정확도, 90.8% F1 스코어를 달성. HIPAA를 준수하면서 의료 영상을 현장에서 분석한다.

교차로 RSU(Road Side Unit)에 엣지 AI를 배포하여 실시간 교통 신호를 제어. 파일럿 프로젝트에서 교통 혼잡 20% 감소, 응급차량 대응 시간 40% 단축.

2026년의 선도 기업들은 클라우드 또는 엣지가 아니라 클라우드와 엣지의 최적 조합을 구축한다.

자율주행의 예: 차량 내 칩이 실시간 인지를 처리(온디바이스). 차량 데이터가 클라우드로 전송되어 전체 차량군의 모델을 개선(클라우드). 개선된 모델이 OTA로 차량에 배포(클라우드 → 온디바이스).

하이브리드 아키텍처 도입 기업은 순수 클라우드 또는 순수 엣지 대비 15~30% 비용 절감을 보고한다.

연합학습(Federated Learning)도 하이브리드의 일부다. 엣지 디바이스가 로컬에서 학습하고, 원본 데이터가 아닌 모델 업데이트만 클라우드와 공유한다. 프라이버시를 보호하면서 전체 시스템의 성능을 개선한다.

연속 LLM 추론은 15분 이내에 85°C 이상의 열을 발생시킨다. 동적 주파수 조절과 냉각 주기가 필수적이며, 배터리 구동 디바이스에서는 지속적 AI 워크로드가 심각하게 제한된다.

3B 파라미터 모델도 추론에 2~4GB RAM이 필요하다. 대부분의 엣지 디바이스 메모리는 8~16GB(Jetson Thor 제외). 더 큰 모델은 양자화 없이는 불가능하다.

SLM은 대형 모델의 80~90% 능력을 제공하지만, 100%는 아니다. 복잡한 추론, 장문 생성, 희귀 도메인 지식에서 차이가 난다. 이 차이가 중요한 유스케이스에서는 클라우드 폴백이 필요하다.

이기종 하드웨어(Jetson, Qualcomm, Apple, Intel 등) 각각에 다른 SDK, 런타임, 모델 포맷을 사용한다. OTA 업데이트와 분산 디바이스 관리도 과제다.

| 기업 | 엣지 AI 활동 |

|---|---|

| 삼성 | Exynos 2600 (세계 최초 모바일 2nm), Galaxy AI, DEEPX 2nm 얼라이언스 |

| 현대 | 로보틱스 LAB + DEEPX "Edge Brain" AI 칩 양산 (CES 2026) |

| LG | ThinQ ON AI Home Hub (온디바이스 생성형 AI), AI 가전 |

| SK텔레콤 | AI-RAN 기술, MWC 2026 "AI Native" 선언, NVIDIA 협업 |

| SK하이닉스 | HBM, LPDDR5X AI 메모리, Gaia 생성형 AI 반도체 공정 |

| DEEPX | DX-M1 (25 TOPS, <5W), DX-M2 (40 TOPS, 삼성 2nm), 400+ 특허 |

엣지 AI의 핵심 가치를 한 문장으로:

AI의 가치는 서버실이 아니라 현장에서 만들어진다. 엣지 AI는 AI를 데이터가 생성되는 곳, 결정이 필요한 곳, 가치가 만들어지는 곳으로 가져간다.

2026년의 현실: AI 추론의 55%가 이미 현장에서 일어나고 있다. Jetson Thor의 2,070 TOPS, Snapdragon의 100 TOPS NPU, 삼성의 2nm Exynos — 하드웨어는 준비되었다. Llama 3.2, Phi-3, Gemma 같은 SLM이 스마트폰에서 실행된다. 양자화와 증류로 대형 모델의 지식이 소형 모델에 압축된다.

남은 과제는 "어떻게 현장에 배포하고 관리하는가"다. 코어닷투데이는 하이브리드 AI 배포 솔루션으로 이 과제에 답하고 있다 — 클라우드와 현장을 하나로 연결하여, 50ms 미만의 엣지 추론과 40% 비용 절감을 동시에 달성한다.

AI가 서버실에서 현장으로 내려오는 시대. 그 시대는 이미 시작되었다.

참고 자료