TECH BLOG

기술 블로그

AI 기술 인사이트와 엔지니어링 경험을 공유합니다.

ALL POSTS

모든 포스트

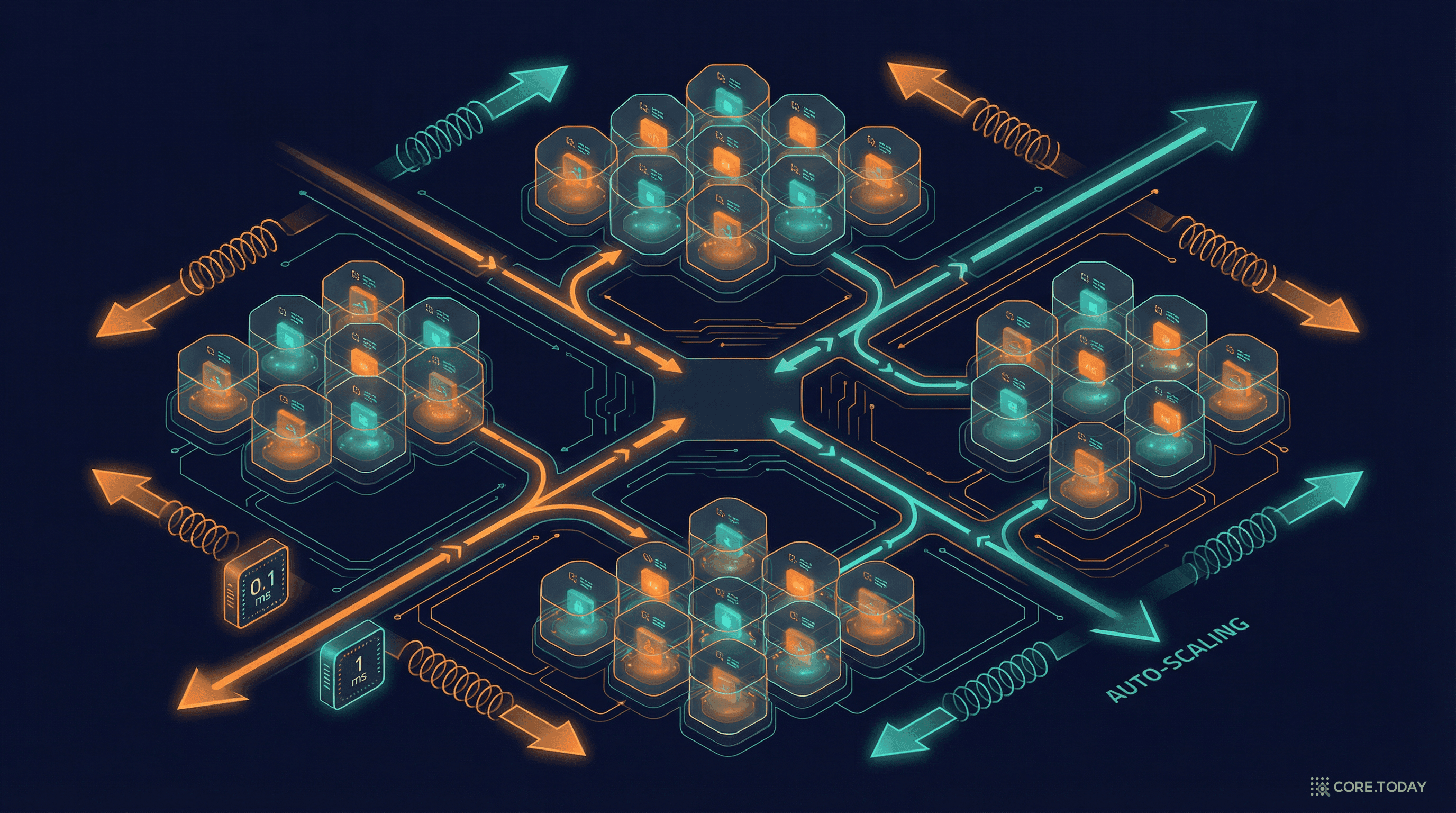

Docker와 컨테이너: '내 컴퓨터에서는 되는데?'를 끝낸 기술의 모든 것

1979년 Unix의 chroot에서 2013년 Docker의 탄생까지. 컨테이너 기술이 왜 등장했고, 어떻게 작동하며, 소프트웨어 개발과 배포를 어떻게 바꿔놓았는지를 역사·원리·실전 사례로 풀어본다.

KERAIA 완전 해부 — AI가 '생각의 길'을 보여주는 시대

AI는 어떻게 지식을 표현하고, 어떻게 추론하고, 왜 그런 결론을 내렸는지 설명할 수 있을까? KERAIA 프레임워크가 제시하는 '생각의 구름'과 '사고의 경로'를 통해, 지식 표현의 역사부터 2026년 설명 가능한 AI의 미래까지 완전 해부한다.

포스트 트레이닝 혁명 — RLHF에서 SimPO, KTO, ORPO, RLVR까지 완전 정리

LLM을 똑똑하게 만드는 건 사전 학습이지만, 쓸모 있게 만드는 건 포스트 트레이닝이다. RLHF의 복잡함에서 DPO의 우아함으로, 그리고 SimPO·KTO·ORPO·RLVR까지 — 2026년 AI 정렬 기술의 모든 것.

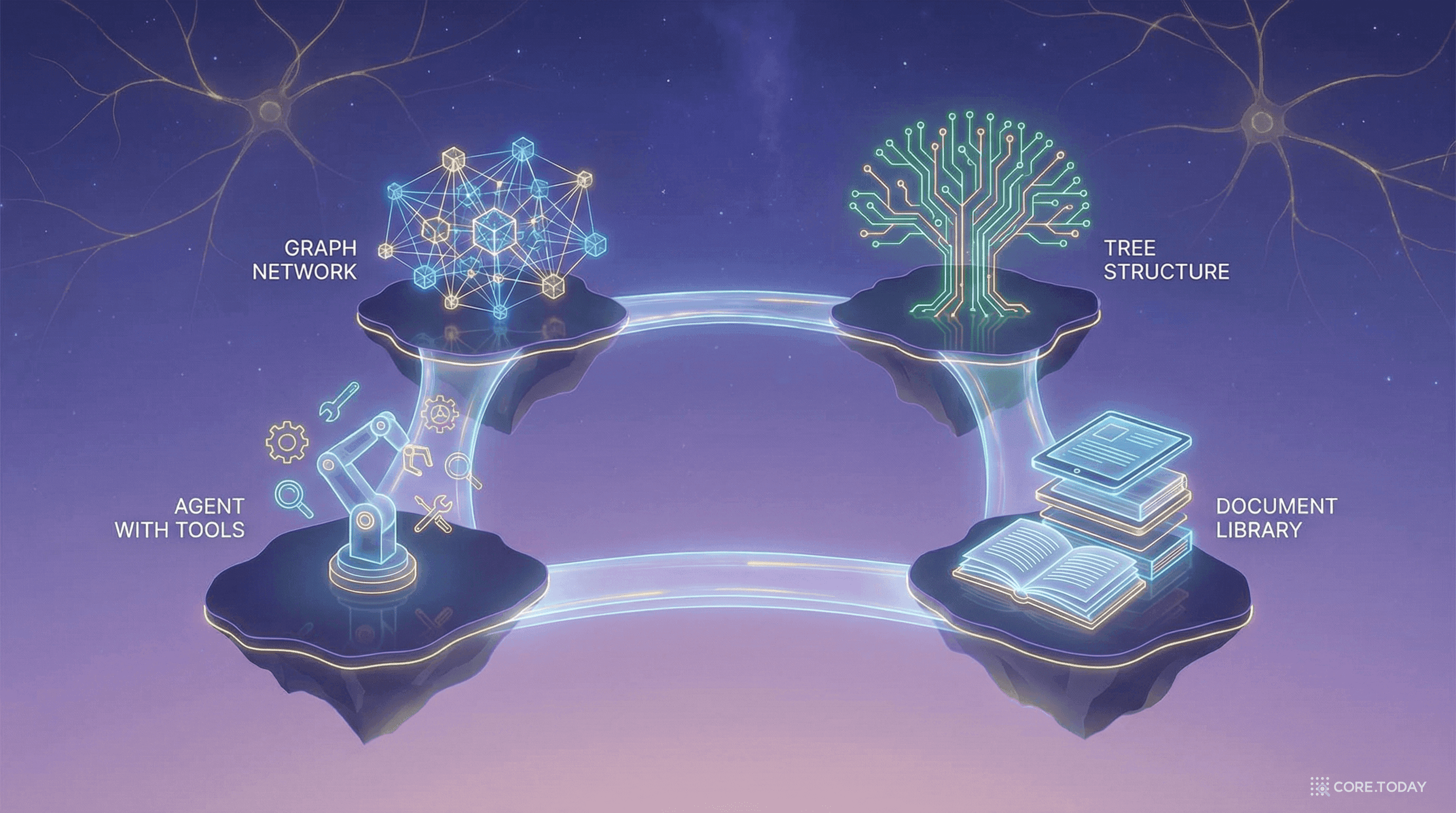

RAG 생태계 완전 가이드: Naive RAG에서 Agentic RAG까지, 언제 무엇을 선택할 것인가

RAG는 이제 하나의 기술이 아니라 하나의 생태계다. 지식 그래프를 활용하는 GraphRAG, 스스로 판단하는 Self-RAG, 에이전트로 진화한 Agentic RAG까지 — 각 접근법이 해결하는 문제와 선택 기준을 논문 기반으로 정리한다.

OpenSearch 완전 정복: 오픈소스 전쟁에서 태어난 검색·분석 엔진의 모든 것

Elasticsearch의 라이선스 전쟁에서 AWS가 포크하여 탄생한 OpenSearch. 검색 엔진의 기원부터 Lucene, Elasticsearch의 부상, 라이선스 분쟁, 그리고 OpenSearch가 로그 분석·벡터 검색·AI까지 확장하는 현재를 풀어본다.

GraphRAG 검색 4총사: Local, Global, DRIFT, Basic — 언제 어떤 검색을 써야 하는가

같은 지식 그래프에서도 질문의 성격에 따라 완전히 다른 검색 전략이 필요하다. GraphRAG의 네 가지 검색 모드 — Local, Global, DRIFT, Basic — 가 각각 어떤 문제를 풀기 위해 설계되었는지, 비용은 얼마나 다른지, 실전에서 어떻게 선택하는지를 사례와 함께 풀어본다.

Kimi Linear 특집: '어텐션이 전부'인 시대, 선형 어텐션이 왕좌를 빼앗다

100만 토큰을 처리할 때 디코딩 속도 6.3배, KV 캐시 75% 절감 — 그러면서도 풀 어텐션 트랜스포머를 모든 벤치마크에서 이긴다. Moonshot AI의 Kimi Linear가 보여준 '선형 어텐션의 역습'을 완전 해부한다.

PathRAG: 그래프에서 '경로'만 골라내면 답변이 달라진다

GraphRAG는 너무 많이 가져오고, LightRAG는 이웃을 통째로 가져온다. PathRAG는 '질문에 답하는 데 필요한 경로만' 골라내는 흐름 기반 가지치기로, 더 적은 토큰으로 더 논리적인 답변을 만든다. 논문의 핵심 아이디어부터 실전 비교까지 풀어본다.

DynamoDB 완전 정복: Amazon이 논문 한 편으로 시작한 NoSQL 혁명

2007년 Amazon 내부 논문에서 시작해, 전 세계 10조 건 이상의 요청을 하루에 처리하는 서비스가 되기까지. Dynamo 논문의 핵심 아이디어, Single Table Design의 철학, 그리고 실전 사례와 주의점을 풀어본다.