프롤로그: 의사의 화요일 오후 3시

서울 강남, 30대 가정의학과 전문의 박의사. 화요일 오후 3시. 진료실.

55세 여성 환자가 들어와 3가지 증상을 호소한다 — 피로감·체중 감소·갈증. 박의사는 머릿속에서 당뇨·갑상선·암을 의심하지만, 환자에게 가능한 진단을 종합적으로 설명해야 한다.

그가 진료 기록 시스템(EMR)에 환자 정보를 빠르게 입력한 뒤, 옆의 다른 모니터에서 ChatGPT를 연다. 그리고 입력한다:

"55세 여성, 피로감 6개월, 체중 5kg 감소, 다음·다뇨 동반. HbA1c 8.2, TSH 0.4, ALT 정상. 가장 가능성 높은 진단과 추가 검사 우선순위 알려줘."

ChatGPT가 2초 만에 깔끔한 답변을 준다. 박의사는 그걸 참고해 환자에게 진단 가능성과 추가 검사를 설명한다. 15분의 진료가 끝난다. 환자는 고맙다는 인사와 함께 진료실을 나간다.

박의사는 — 방금, 자기도 모르게, 4개의 법을 위반했다.

미국 USC Price School은 2024년 *"의사들이 ChatGPT를 쓰며 *모르고 HIPAA를 위반하고 있다"는 보고서를 발표했다. 한국에는 — 더 엄격한 법이 있다.

- 의료법 제19조 (정보 누설 금지) — 위반 시 3년 이하 징역 또는 3천만 원 이하 벌금

- 의료법 제21조 (진료기록 관리) — 환자 외 제3자 열람·복사 금지

- 형법 제317조 (업무상 비밀 누설) — 3년 이하 징역·금고, 10년 이하 자격정지, 700만 원 이하 벌금

- 개인정보보호법 (민감정보 처리) — 별도 동의 + 안전조치

박의사는 진단 도움을 받으려던 것뿐이었다. 그러나 공개 ChatGPT에 환자 식별 가능한 정보를 입력하는 순간 — 위 4개 법의 위반 구성요건이 동시에 발생한다.

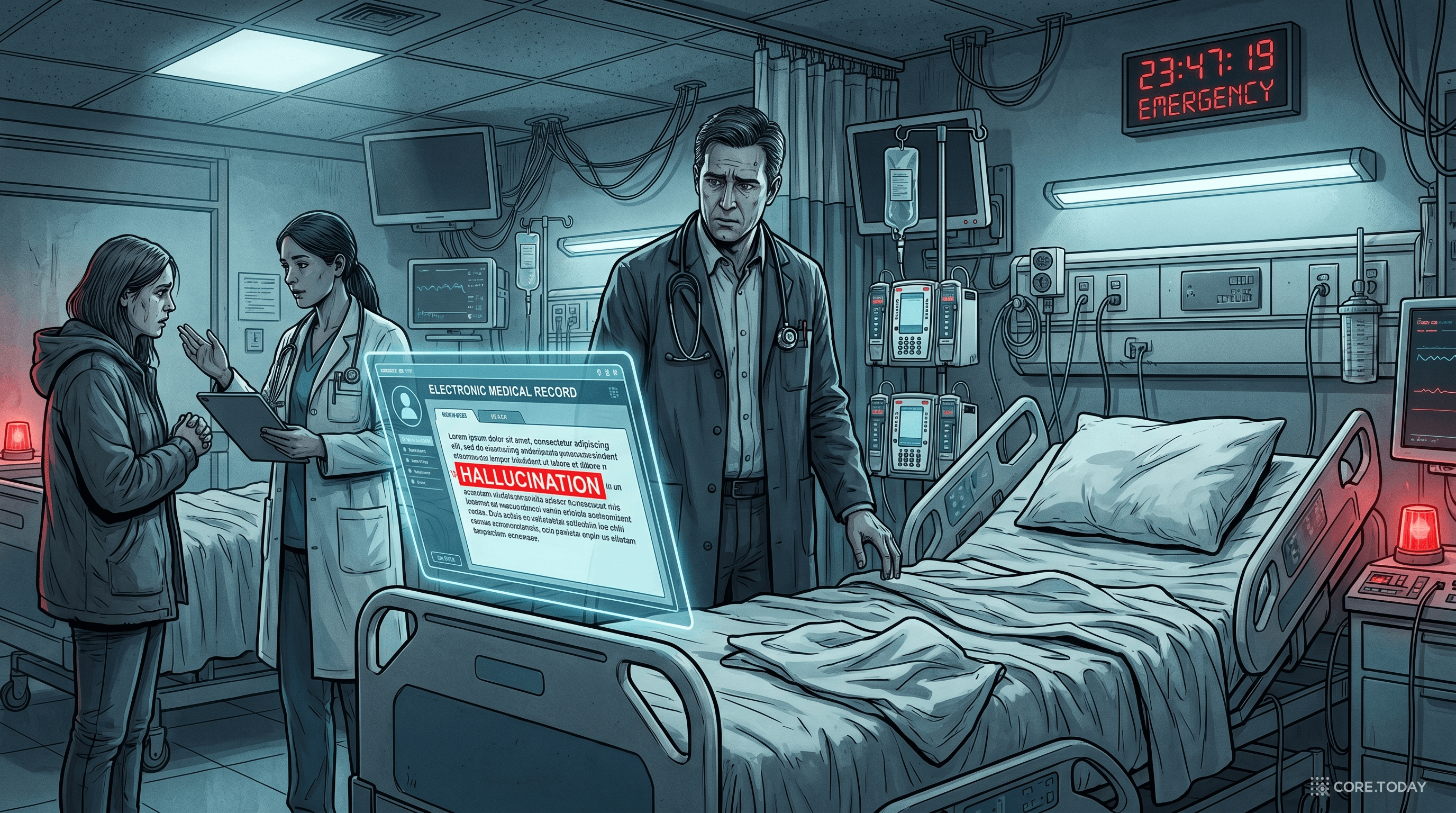

이게 Mata v. Avianca(변호사 환각 사고)와 다른 조용한 위험이다. 변호사 사고는 법정에서 폭발했지만 — 의사의 사고는 환자가 알지 못한 채 누적된다. 그리고 5년 뒤, 한 명의 환자 정보가 어딘가에 노출되면 — 진료 기록 전체가 소급해서 위법 노출이 된다.

이 글은 — Mata 이후의 진짜 위험(변호사 4편)을 의료 영역에 정확히 대응시킨다. 의료편 시리즈 4편. 이 글이 끝날 때까지 — 한국의 모든 의사·의료인이 진료실에서 AI를 안전하게 쓰는 방법을 명확히 안다.

본 글은 코어닷투데이 Claude for Healthcare 시리즈 3편이다. ① Claude for Healthcare 완전 해부, ② 의료 AI 대전 2026에 이은 의료 윤리·법규 심층. 변호사 시리즈 4편에 정확히 대응한다.

1장. 의사 비밀유지의무란 무엇인가

먼저 한국법이 의사에게 부과하는 비밀유지의무를 정확히 정리하자. AI 시대의 모든 의료 윤리 이슈가 여기서 시작된다.

4중 법체계 — 의사의 비밀유지의무

한국에서 의사·치과의사·한의사·간호사·약사 등 의료인은 — 4개의 법이 동시에 비밀유지의무를 부과한다.

| 법 | 조문 요지 | 처벌 |

|---|

| 의료법 제19조 | 의료인이 업무 중 알게 된 다른 사람의 정보를 누설·발표 금지 | 3년 이하 징역 / 3천만 원 이하 벌금 + 면허정지 1년 |

| 의료법 제21조 | 환자 외 제3자에게 진료기록 열람·사본 제공 금지 | 의료법 위반 + 별도 행정 처분 |

| 형법 제317조 | 의사 등이 업무 처리 중 지득한 타인의 비밀 누설 | 3년 이하 징역·금고 / 10년 이하 자격정지 / 700만 원 이하 벌금 |

| 개인정보보호법 | 의료기록은 민감정보 — 별도 동의 + 안전조치 의무 | 5년 이하 징역 / 5천만 원 이하 벌금 |

이 4개 법은 — 동시 적용된다. 한 번의 위반으로 4개 법 위반이 동시 성립할 수 있다.

결정적 디테일들

① 사망한 환자도 포함 — 의료법 제19조의 "다른 사람"에는 이미 사망한 사람도 포함된다(대법원). 의사가 "환자가 사망했으니 정보를 써도 된다"는 오해가 가장 위험하다.

② "다른 사람"의 범위가 환자뿐 아니라 모두 — 환자뿐 아니라 환자 가족·동료·관계자에 관한 정보도 포함. 의사가 진료 중 들은 모든 사람의 정보가 보호 대상.

③ "비밀"의 범위 — 신체·사회·경제·심리 — 단순히 진단명뿐 아니라 — 환자의 직업·재산·가족 관계·종교·성적 지향 등 진료 중 알게 된 모든 사적 정보.

④ 동의가 있어도 안 되는 경우 — 환자 본인의 동의만으로 공개되더라도 — 과실로 추가 정보가 노출되면 책임.

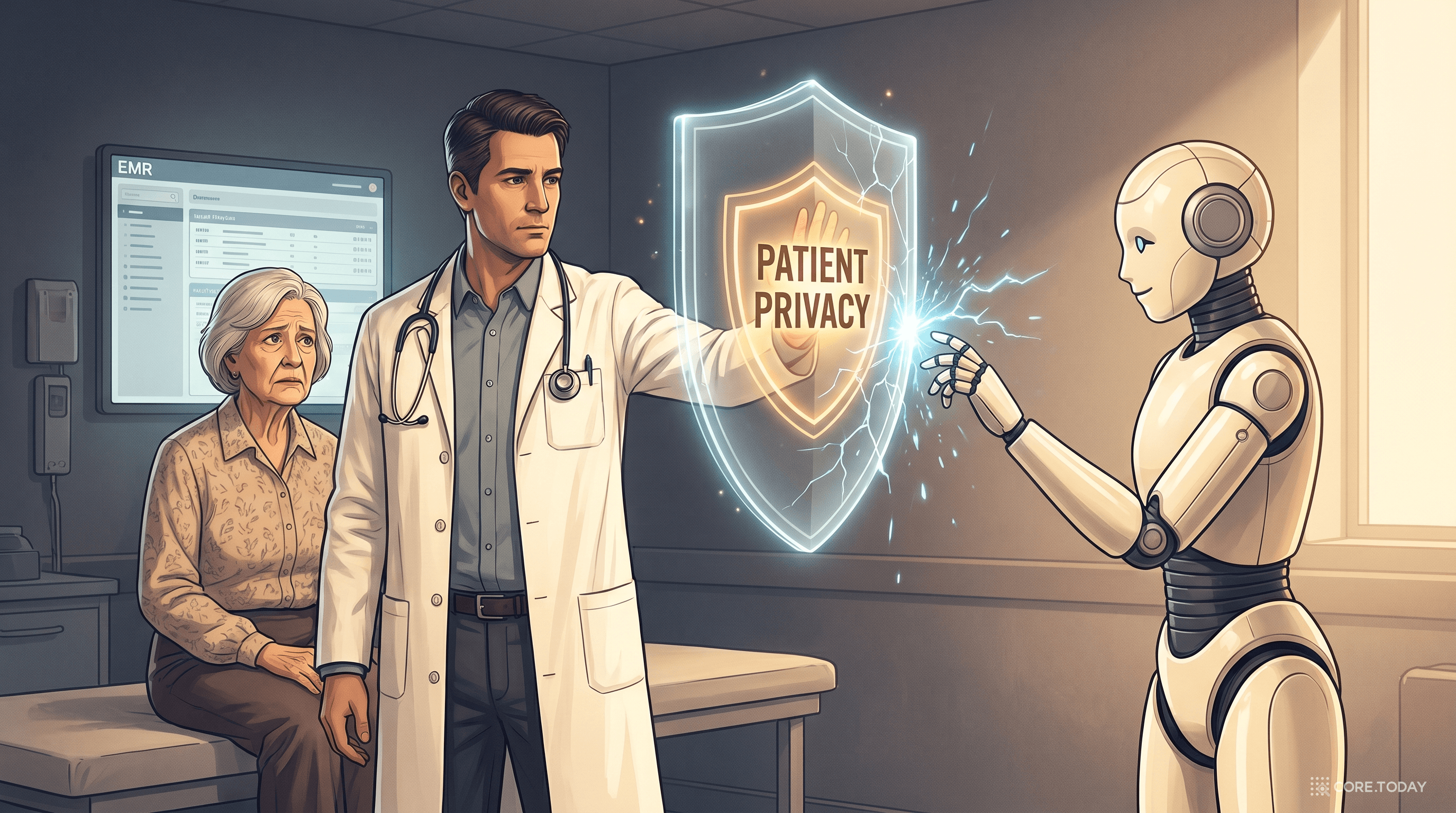

왜 이게 결정적인가

의료 정보는 법조 시스템의 핵심이다. 환자가 모든 사실을 솔직하게 의사에게 말할 수 있어야 — 의사가 최선의 진단·치료를 줄 수 있다. 만약 환자가 "이 정보가 노출될 수 있다"고 두려워하면, 그는 진실을 숨기고 — 결국 자기 건강에 불리한 진료를 받는다.

"의료 비밀이 깨지는 순간, 의료 시스템 자체의 신뢰가 무너진다."

— 히포크라테스 선서, "내가 진료 중 보고 들은 것, 또는 진료 외에서 인간의 삶에 관해 알게 된 것이 외부에 알려져서는 안 되는 것이면 절대 비밀로 한다"

이게 왜 의사의 AI 사용이 위험한가의 핵심 이유다.

2장. HIPAA와 한국법 — 어느 쪽이 더 엄격한가

미국의 Health Insurance Portability and Accountability Act (1996)는 — 전 세계 의료 정보 보호의 표준이다. 한국법과 비교하자.

미국 HIPAA

처벌: 건당 최대 $1.9M (Tier 4, Willful Neglect)

민사 처벌 우선. 형사 처벌은 의도적 위반

BAA (Business Associate Agreement) 필수

HHS OCR가 조사·집행

Notification 의무 — 500명 이상 사고 시 미디어·환자 통지

한국 4중 법체계

처벌: 의료법 위반 3년 이하 징역 + 형법 별도 자격정지

형사 처벌 우선. 자격 정지로 생업 영향

위탁계약 + DPA(개인정보처리 위탁계약) 필수

개인정보보호위원회 + 보건복지부 동시 감독

유출 시 72시간 내 신고 의무

어느 쪽이 더 엄격한가

표면적 금전 처벌은 HIPAA가 크다. 그러나 한국이 더 위험하다는 결정적 이유가 있다.

핵심: 한국은 형사 처벌 + 자격 정지가 우선이다. HIPAA 위반은 금전 배상으로 끝나지만 — 한국 의사가 의료법 19조·형법 317조 위반으로 면허 정지되면 — 생업 자체가 무너진다. 게다가 형사 기록은 영구적이다. 벌금 700만 원이 무서운 게 아니다 — 의사 자격 1년 정지가 더 무섭다.

두 법의 공통점 — AI에 적용

두 법 모두 — 공개 AI(ChatGPT·Claude의 무료/개인 계정 등)에 환자 정보를 입력하는 행위는 명백한 위반이다.

- HIPAA: ChatGPT는 BAA를 체결하지 않는다. 따라서 ChatGPT에 PHI(Protected Health Information) 입력 시 비인가 공개에 해당.

- 한국 의료법: ChatGPT 약관에 제3자 공유·모델 학습 사용 가능 명시. 비밀 누설에 해당.

이게 USC Price School이 경고한 "의사들이 자기도 모르게 HIPAA를 위반"하는 메커니즘이다.

3장. ChatGPT의 HIPAA 위반 — 실제 사례

USC Price School의 충격적 보고

2024년 USC Price School은 — 의사들의 무의식적 HIPAA 위반에 관한 보고서를 발표했다. 핵심:

"대부분의 공개 AI 도구(ChatGPT·Google Gemini 등)는 BAA에 서명하지 않으며 HIPAA 표준을 충족하지 못한다. 의사가 환자 기록·진단 영상·임상 노트를 비호환 AI 도구에 업로드해 분석·도움을 요청할 때 — 그는 비인가 PHI 공개를 만든다."

이 보고서는 DEV Community의 후속 분석에서 충격적 발견으로 확장됐다 — "50개 이상의 기업이 ChatGPT로 자기도 모르게 HIPAA를 위반" 중이라는 추적 보고.

MMG Fusion 사건 (2026.03)

미국 HHS OCR(Office for Civil Rights)이 2026년 3월 발표한 MMG Fusion 합의.

- 회사: MMG Fusion, LLC — HIPAA covered entity로부터 PHI를 받아 환자와 직접 소통하는 소프트웨어 회사

- 위반: PHI 처리에서 적절한 보안·개인정보 보호 조치 미흡

- 합의금: $10,000 (회사의 재정 상태 고려한 소액 합의)

- 추가: 3년간 OCR 감독 + 시정 계획 강제 집행

소액 합의지만 — AI 관련 OCR 집행이 시작됐다는 결정적 신호다.

2026년 4월 — 1.1M 합의 4건

같은 해 4월 23일, OCR은 4개 합의를 한 번에 발표했다. 총 $1.1M+ 벌금. 두 가지 공통 원인:

- 연간 종합 위험 분석(comprehensive annual risk analysis) 부재

- 랜섬웨어·해킹이 가장 흔한 대규모 유출 원인

OCR의 명확한 메시지: "AI 도구를 쓰든 안 쓰든 — 체계적 위험 분석이 없으면 처벌한다."

그래도 ChatGPT Health는 다른가?

OpenAI가 2026년 1월 출시한 ChatGPT Health는 — 개인용이다. 소비자 약관으로 작동.

*"ChatGPT Health는 향상된 개인정보 보호와 입력을 알고리즘 학습에 사용하지 않는 정책을 갖고 있다. 그러나 *HIPAA 표준이 아닌 소비자 등급 약관에 따라 운영된다."

핵심: ChatGPT Health도 의사의 진료용으로는 부적합하다. 환자 본인이 자기 정보를 입력하는 것은 가능하지만 — 의사가 환자 정보를 입력하면 여전히 HIPAA 위반.

4장. 한국 의료법과 AI의 5가지 충돌 시나리오

이제 한국 의사의 실제 진료실 상황에 적용해 보자. 가장 흔한 5가지 위반 시나리오다.

1

시나리오 ① — 공개 ChatGPT에 환자 정보 입력

의사가 진단 도움을 위해 환자 식별 가능 정보(나이·성별·증상·검사 결과)를 ChatGPT에 입력. → ChatGPT 약관상 모델 학습/제3자 공유 가능 → 의료법 19조 + 형법 317조 동시 위반. 가장 흔한 위반 패턴.

2

시나리오 ② — 클라우드 AI에 진료 기록 업로드

EMR에서 진료 기록 파일을 추출해 AI 서비스에 업로드 → 서버 캐싱·로그 저장 → 데이터센터가 해외(미국)에 있으면 국외 이전까지 추가 위반 → 의료법 21조 + 개인정보보호법 위반.

3

시나리오 ③ — AI가 잘못된 진단 → 환자 피해

의사가 AI 추천을 과도 신뢰해 오진 발생 → 환자 피해 → 의사가 주의의무 위반으로 형법 268조 업무상 과실치사상 + 민사 손해배상 책임. 2024년 미국 Malpractice 14% 증가의 한국 도래 시점이 가까움.

4

시나리오 ④ — AI 회사 직원의 환자 정보 접근

AI 서비스 직원이 서비스 개선 목적으로 입력 내용을 수동 검토 가능 → 비밀 누설 경로 형성 → 의료법 19조 위반 (제3자가 AI 회사 직원).

5

시나리오 ⑤ — 사이버 사고 발생

AI 서비스가 해킹·데이터 유출을 당하면 → 환자 정보 외부 노출 → 의사 단독 책임은 아니지만 — 주의의무 위반 (안전 AI 선택 의무) 가능. 개인정보보호법 + 의료법 동시 위반 가능성.

5가지 시나리오의 공통점

모든 시나리오에서 의사 본인은 모르고 위반한다. ChatGPT에 환자 정보를 입력하는 의사는 — 나쁜 의도가 없다. 환자에게 더 좋은 진료를 하고 싶었을 뿐이다. 그러나 — 법은 의도를 묻지 않는다. 결과적 위반이면 처벌이다.

이게 왜 한국 의료계에 명확한 가이드라인이 필요한지의 가장 큰 이유다.

5장. 대한의사협회의 반대와 식약처의 2026 가이드라인

의협의 입장 — "근거 부족"

대한의사협회(KMA)는 — AI 의료 진료 활용에 명확하게 반대 입장을 견지해 왔다.

"과학적·임상적 근거 부족 + 안전 인증·책임 보험 체계 미정 + 알고리즘 편향·데이터 품질·환자 동의 절차 부적절."

— 대한의사협회, 2024 공식 입장

3가지 핵심 우려:

- 알고리즘 편향: AI 학습 데이터의 인종·성별 편향이 진단에 영향

- 데이터 품질: AI 학습 데이터의 임상적 검증 부재

- 환자 동의 절차: AI 사용 시 고지된 동의가 미흡

이는 미국 ABA의 적극적 가이드라인(변호사 4편 참조)과 완전히 다른 자세다. 의협은 AI를 받아들이지 않는 보수적 입장.

보건복지부 + 식약처의 2026 가이드라인

의협의 침묵 속에서 — 2026년 보건복지부와 식약처가 공동 발표한 "2026 의료 AI 윤리·책임 가이드라인"이 등장했다.

핵심 4축:

① 설명 가능한 AI (XAI)

AI가 진단·치료 방향 제시 시 *의료진이 논리적 경로와 근거를 환자에게 설명 가능*해야 함

② 데이터 비식별화

환자 식별 정보 제거·치환. 모니터링·감정 케어 AI는 추가 보안 기술 필수

③ 연합 학습 (Federated Learning)

데이터를 중앙화하지 않고 각 병원 서버 내에서 AI 모델 학습. 데이터 주권 확보

④ 보안 클라우드 + 책임 명확화

모니터링 데이터 보안 클라우드 관리. AI 오류 시 개발자·의료진 책임 분배 명시

이게 충분한가

식약처 가이드라인은 시작에 불과하다. 코어닷투데이의 평가:

- 장점: XAI·연합 학습·비식별화 강조는 적절. 세계 표준과 부합.

- 한계: 진료실 실무에 적용 가능한 체크리스트 부재. 의사가 내일 진료실에서 무엇을 할 수 있고 무엇을 하면 안 되는지 모호.

- 공백: 환자 동의서 표준 양식 부재. 책임 보험 가이드 부재. Malpractice 위험 평가 도구 부재.

이 공백을 메우는 것이 이 글의 후반부 목적이다.

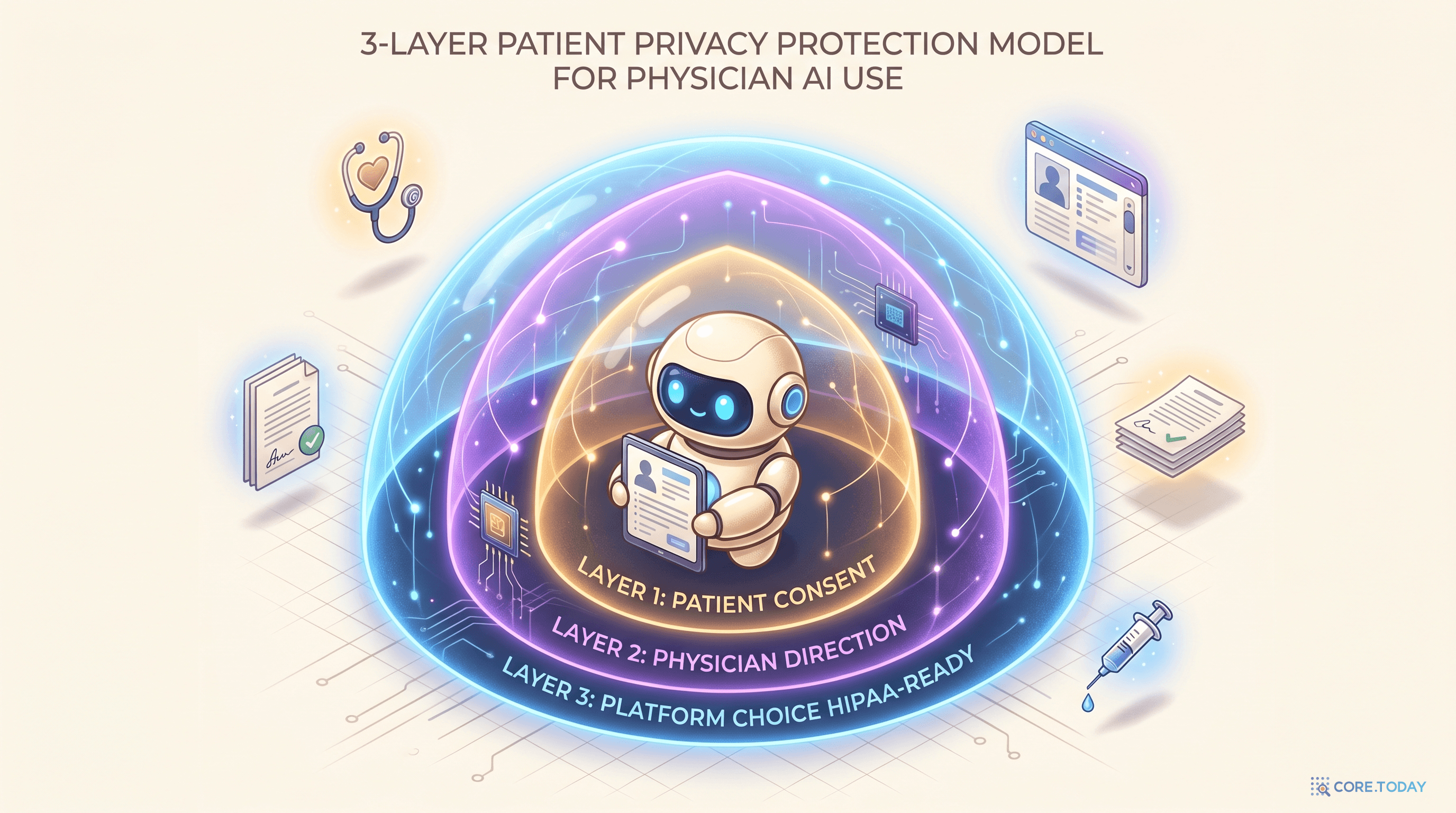

6장. 3중 보호 메커니즘 — Patient · Physician · Platform

변호사 4편의 3중 보호 모델을 의료에 적용하면 — Patient → Physician → Platform의 3단계가 된다.

Layer 1 — Patient Consent (환자 고지된 동의)

가장 안쪽 방패. 모든 의료 AI 사용의 시작점.

- 진료 첫 방문 시 서면 동의 (수술 동의서처럼)

- 어떤 AI, 어떤 데이터, 어떤 보장인지 명시

- 환자가 AI 사용 거부 권리 보장 + 거부 시에도 진료 받을 권리

- 동의서를 진료 기록에 첨부

Layer 2 — Physician Direction (의사 직접 운용)

중간 방패. AI 출력을 반드시 의사가 검토·재구성.

- 의사가 직접 AI를 운용 (보조직원 단독 사용 X)

- AI 출력은 의사의 임상 판단을 보조할 뿐 진단을 결정하지 않음

- 모든 AI 출력은 의사 검토 후 EMR 기록

- AI 활용 사실을 진료 기록에 명시

Layer 3 — Platform Choice HIPAA-Ready (플랫폼 선택)

가장 바깥 방패. 공개 AI 절대 금지.

- 반드시 HIPAA-ready / GDPR-compliant 엔터프라이즈 AI 사용

- Zero data retention 명시적 설정

- BAA(미국) 또는 DPA(한국·EU) 체결

- 서버 위치·암호화·접근 통제 확인

- 가능하면 온프레미스 또는 프라이빗 클라우드 (광장 eLK 모델)

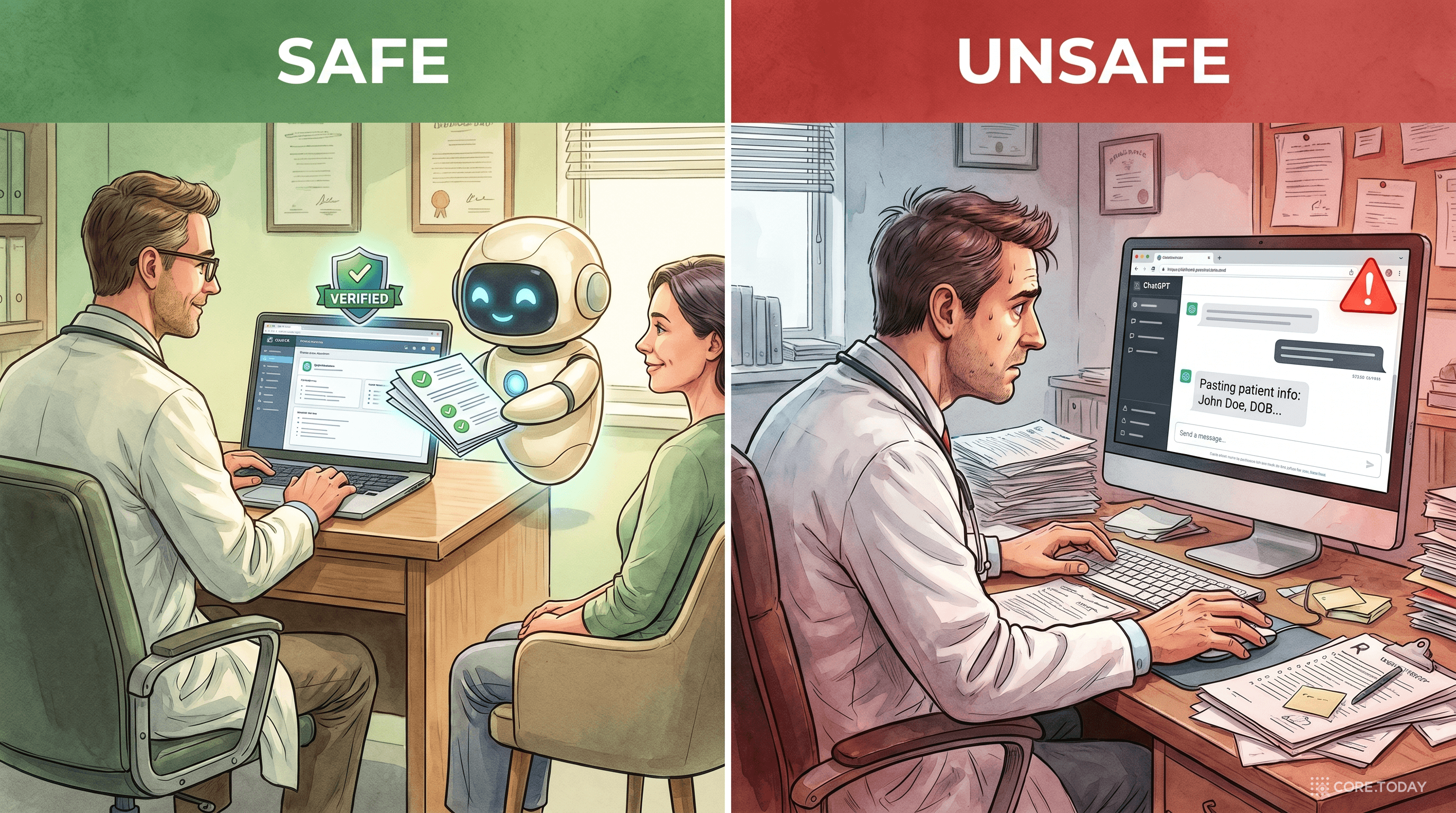

안전 vs 위험 — 한눈에

✅ 안전한 사용

Claude for Enterprise / Healthcare

Banner Health BannerWise 모델

병원 내 온프레미스 LLM

환자 동의서 + EMR 기록

의사 검토 후 활용

❌ 위험한 사용

공개 ChatGPT / Claude 개인 계정

환자 식별 정보 직접 입력

"Help improve" 옵션 켜진 상태

환자 모르게 사용

검증 없이 AI 진단 채택

원칙: 3중 보호 중 하나라도 빠지면 — 위험이 시작된다. 모든 의사가 3중 보호를 표준 절차로 갖춰야 한다.

7장. Malpractice 위험 — 14% 증가의 의미

미국의 Malpractice 동향

2024년 데이터: AI 도구 관련 Malpractice 클레임이 2022년 대비 14% 증가. 주요 영역:

- 방사선학(Radiology) — 영상 AI 오진

- 심장학(Cardiology) — 심전도 AI 누락

- 종양학(Oncology) — ML 기반 암 진단 미스

법학적으로 결정적 흐름:

*"2025년 표준 진료(standard of care)가 점점 의사가 AI 도구를 적절히 사용할 줄 알아야 — 그리고 언제 무시해야 하는지 알아야 — 한다는 기대를 포함한다. 법원은 *합리적 의사가 AI를 써야 했는가, 그리고 안 쓴 것 자체가 과실인가를 검토하고 있다."

이게 의사의 새 의무다. AI를 쓰지 않아도 책임, 쓰고 결과를 안 검증해도 책임. 어느 방향이든 책임이다.

한국의 도래 시점

한국에서 AI 관련 Malpractice 소송은 아직 본격화하지 않았다. 그러나 3가지 신호:

1

신호 ① — 빅5 병원 AI 도입 가속

서울대 KMed.AI + 세브란스 Next Severance + 가톨릭 AI 거버넌스. AI 사용량 폭증 → 오류 사고 가능성도 비례 증가.

2

신호 ② — 환자의 AI 인식 상승

환자가 진단에 AI가 쓰였는지를 묻기 시작. 동의 없이 사용 시 사후 분쟁 위험 증가.

3

신호 ③ — 의사 책임보험의 변화

한국 의사 책임보험은 아직 AI 약관이 명확하지 않다. 보험사들이 2026~2027년 약관 개정 진행 중. 미국처럼 공개 AI 사용 시 보장 거부 가능.

예측: 2027년 한국에서 첫 AI 관련 Malpractice 판결이 나올 것이다. 그 판결이 전국 의사의 AI 사용 표준을 결정한다.

8장. 환자 동의서 양식 — 한국 표준 제안

ABA 512와 식약처 가이드라인을 한국법에 맞게 번안한 동의서 양식 예시다. 코어닷투데이가 제안하는 한국 표준 — 자유 사용·수정 가능.

제1조 (목적)

본인(이하 "환자")은 [의료기관명] / [담당의명](이하 "의료진")이 본인의 진료에 인공지능(AI) 도구를 보조적으로 활용하는 것에 동의합니다.

제2조 (사용 도구)

의료진은 다음 AI 도구를 사용할 수 있습니다:

1. [Anthropic Claude for Healthcare] — HIPAA-ready, 미국 서버, zero retention, 학습 사용 안 함

2. [본 병원 자체 의료 AI 시스템] — 사내 서버, 외부 미전송

3. 위 외 도구 사용 시 환자의 추가 동의를 받습니다.

제3조 (입력 정보 범위)

의료진은 AI에 다음 정보를 입력할 수 있습니다:

✓ 본 진료의 증상·진단·검사 결과 (식별 정보 비식별화 후)

✓ 가족력·과거 병력 (환자 동의 시)

✓ 영상 자료 (방사선·내시경 등) 비식별 형태

입력하지 않습니다:

✗ 환자 성명·주민등록번호·연락처

✗ 환자 직장·거주지 정보

✗ 환자가 명시적으로 입력 거부한 정보

제4조 (환자의 권리)

환자는 다음 권리를 가집니다:

1. 본 동의를 언제든지 서면으로 철회할 권리

2. AI 사용 내역의 보고를 요청할 권리

3. 특정 AI 도구 사용을 거부할 권리

4. AI 사용 거부 시에도 동등한 수준의 진료를 받을 권리

5. AI 사용으로 인한 오류 발견 시 즉시 통지받을 권리

제5조 (의료진의 의무)

의료진은 다음을 보장합니다:

1. 모든 AI 출력을 의료진이 임상적으로 검증

2. 최종 진단·치료 결정의 책임은 의료진에게 있음

3. AI 사용 사실을 진료 기록에 명시

4. AI 사용으로 인한 사이버 사고 발생 시 72시간 내 환자 통지

제6조 (서명)

환자: __________ (서명) 날짜: ____________

보호자(필요 시): __________ (서명)

담당의: __________ (서명) 날짜: ____________

이 동의서 양식은 코어닷투데이가 미국 HIPAA·식약처 2026 가이드라인·한국 의료법·개인정보보호법을 종합해 제안한 비공식 표준안입니다. 실제 사용 전 의료기관·법무팀 검토가 필요하며, 대한의사협회나 보건복지부의 공식 가이드라인 채택 시 그에 맞게 갱신돼야 합니다.

9장. 의사 실무 체크리스트

이 모델을 내일 진료실에 적용하는 한국 의사 체크리스트.

A. 사용 시작 전 (one-time setup)

□ 병원/의원 AI 사용 정책 수립

□ 사용할 AI 도구를 enterprise tier 또는 자체 시스템으로 계약

□ "데이터 학습에 사용 안 함" 설정 확인 및 문서화

□ DPA(개인정보처리 위탁계약) 검토 완료

□ 책임보험사에 AI 사용 사실 고지·승인

□ 환자 동의서 양식 마련 (8장 참고)

□ 진료 기록에 AI 사용 표시 항목 추가

B. 매 환자 첫 방문 시 (per-patient)

□ 환자에게 AI 보조 사용 가능성 *구두 설명*

□ *서면 동의* 받음 (진료 기록에 첨부)

□ 사용할 AI 도구·범위 명시

□ 환자의 거부권 고지

□ 거부 시 *동등한 수준의 진료 보장* 명시

C. 매 진료 시 (per-visit)

□ AI 입력 전 *식별 정보 마스킹* (이름·주민번호·연락처)

□ 진료 핵심 정보만 입력 (불필요한 디테일 배제)

□ AI 출력 전체를 *의사 직접 검토*

□ AI 진단 추천을 *임상 판단으로 검증*

□ 최종 결정은 *의사 책임*으로 EMR 기록

□ AI 사용 사실을 *진료 기록에 명시*

□ 환자에게 *AI 사용 결과 설명* (XAI 원칙)

D. 위반 위험 신호 (red flags)

⚠️ 환자 모르게 AI 사용

⚠️ 공개 AI(ChatGPT 무료판 등)에 식별 정보 입력

⚠️ AI 진단을 검증 없이 채택

⚠️ "Help improve" 옵션 켜진 상태

⚠️ 휴대폰 개인 AI 앱에 환자 정보 입력

⚠️ 사용 후 로그 파기

10장. 한국 의료에 필요한 가이드라인 — 5대 제안

이 글의 가장 건설적 부분이다. 코어닷투데이가 대한의사협회·보건복지부·식약처에 제안하는 — 의사 AI 사용 가이드라인 5대 원칙이다.

대한의사협회 AI 윤리 가이드라인 (제안)

5대 원칙 · 17개 세부 규정 · 부속 환자 동의서 양식

제1원칙 — 환자 고지된 동의

AI 사용 전 서면 동의 의무. 거부 시 동등 진료 보장. 동의서 표준 양식 채택.

제2원칙 — 의료진 직접 운용

환자 정보 AI 입력은 의료진만. 보조직원 단독 사용 금지. EMR 기록 의무.

제3원칙 — HIPAA-ready 엔터프라이즈 의무

환자 정보 입력 시 zero retention·국내 데이터센터 우선. 공개 AI 절대 금지.

제4원칙 — XAI + 임상 검증

AI 출력 시 설명 가능성 확보. 의료진의 임상적 검증 후 채택.

제5원칙 — 책임 명확화 + 보험 갱신

AI 오류 시 개발자·의료진 책임 분배 명시. 책임 보험 AI 약관 의무화.

이 5개 원칙은 — 미국 HIPAA + EU AI Act + 한국 식약처 가이드라인의 교집합이다. 거의 모든 선진국이 유사한 방향으로 가는 국제 표준이기도 하다.

에필로그: 의사 제도의 새 시험

이 글의 첫 장면 — 박의사의 화요일 오후 3시 — 를 다시 떠올려 보자.

그가 환자를 더 잘 진료하려고 ChatGPT에 입력한 한 줄. 그 한 줄이 4개 법의 위반 구성요건을 동시에 발생시킨 순간. 환자는 모른다. 의사도 모른다. 사고는 3년 후 어딘가에서 폭발한다.

이게 AI 시대 의료 제도의 새 시험이다.

미국은 HIPAA + ABA 의료 윤리 + Banner Health 같은 검증된 모델로 — 조심스럽지만 명확한 방향을 잡아가고 있다. EU는 AI Act로 고위험 의료 시스템을 강제하고 있다.

한국만 — 대한의사협회의 완강한 반대와 식약처의 시작 단계 가이드라인이 충돌하는 가운데, *각 의사 한 명 한 명이 *자기 진료실에서 매일 가이드라인 없는 위험을 감수**하고 있다.

이 침묵이 깨지지 않는 한 — 언젠가는 한 환자 정보가 외부에 폭발할 것이다. 그 사건이 한국 의료 AI 전체를 5년 뒤로 되돌릴 수 있다.

코어닷투데이는 — 그 폭발이 오지 않게 하는 방법은 대한의사협회·보건복지부·식약처의 통합 가이드라인 채택이라고 본다. 그리고 그 가이드라인의 초안에 — 이 글의 5대 원칙과 환자 동의서 양식이 참고가 되기를 바란다.

지금 당신이 의사·간호사·약사·의료기사라면 — 이 글을 출력해 진료실에 두세요. 적어도, 내 환자의 위험은 내가 책임진다는 첫 걸음을 시작할 수 있을 것이다.

더 읽어볼 자료

미국·국제 자료

한국 자료

코어닷투데이 시리즈

코어닷투데이의 시각 — 이 글에 담긴 환자 동의서 양식과 5대 원칙은 — 어떤 한국 의료기관·의사·간호사·약사이든 자유롭게 가져다 쓰셔도 좋습니다. 저작권을 주장하지 않습니다. 다만 — 대한의사협회·보건복지부·식약처에 부탁드립니다. 한국에서 첫 AI 의료 사고가 폭발하기 전에 — 공식 통합 가이드라인을 채택해 주세요. 환자 한 명, 의사 한 명의 비밀과 안전이 지켜지는 일은 — 의료 제도 전체의 신뢰 그 자체입니다. 그리고 그 신뢰가 무너지면 — AI 시대 의료의 정통성도 무너집니다. 이 글이, 그 무너짐을 막는 첫 벽돌이 되기를.