Mamba SSM 완전 정복: Transformer의 왕좌를 위협하는 '선택적 기억'의 혁명

Transformer가 AI의 전부인 줄 알았다. 그런데 '모든 토큰을 다 기억하는 것'이 정말 최선일까? 제어 이론에서 출발한 상태 공간 모델이 '선택적 기억'이라는 무기로 AI의 판도를 바꾸고 있다.

Transformer가 AI의 전부인 줄 알았다. 그런데 '모든 토큰을 다 기억하는 것'이 정말 최선일까? 제어 이론에서 출발한 상태 공간 모델이 '선택적 기억'이라는 무기로 AI의 판도를 바꾸고 있다.

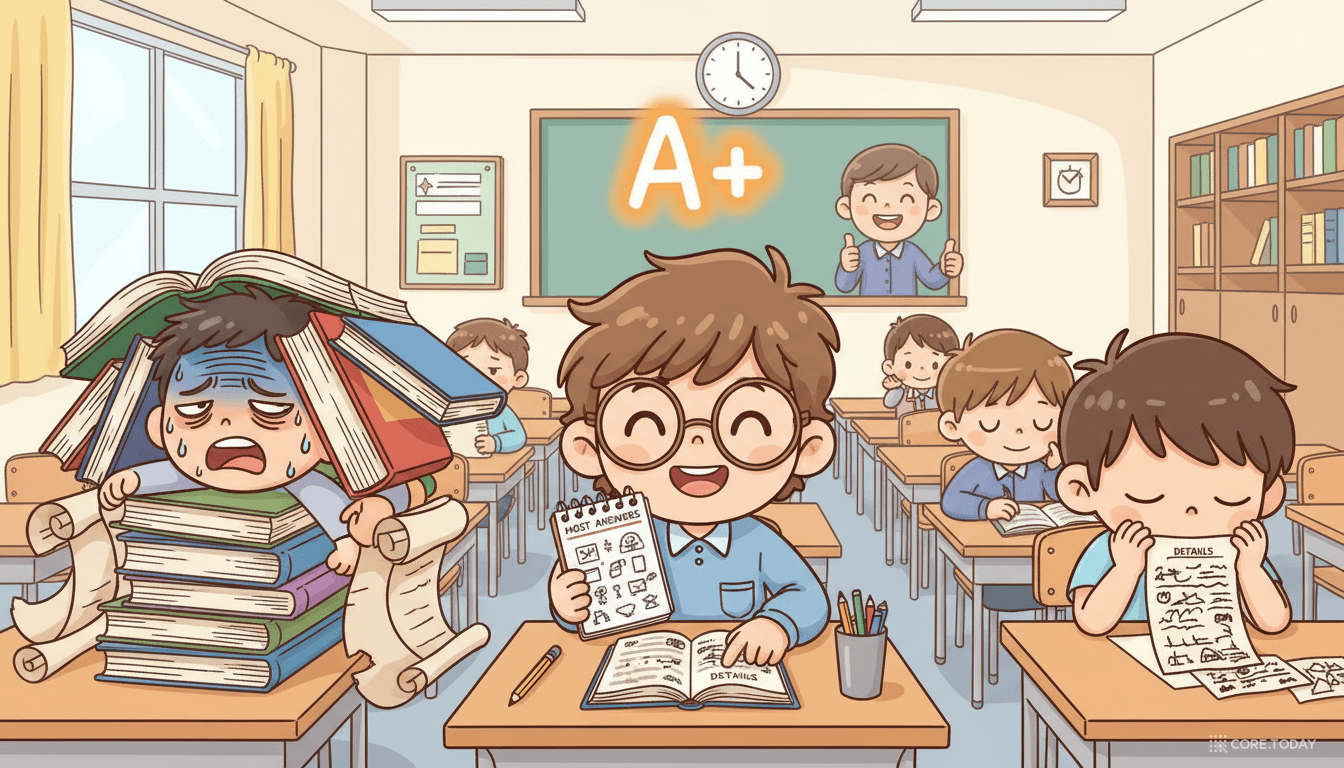

시험을 치는 두 학생을 상상해 보자.

학생 A는 교과서 전체를 시험장에 펼쳐놓는다. 어떤 질문이 나와도 해당 페이지를 찾아볼 수 있다. 대신 책이 두꺼워질수록 원하는 페이지를 찾는 시간이 기하급수적으로 늘어난다. 100페이지 교과서라면 괜찮지만, 100만 페이지라면? 책상 위에 올려놓지도 못한다.

학생 B는 교과서를 읽으면서 핵심만 추려 암기 노트를 작성한다. 노트는 항상 일정한 분량이다. 중요한 내용이 나오면 꼼꼼히 적고, 사소한 부분은 빠르게 넘긴다. 1,000페이지 교과서든 100만 페이지 교과서든, 노트의 크기는 변하지 않는다.

학생 A가 Transformer다. 학생 B가 Mamba다.

2017년 이후 AI의 역사는 곧 Transformer의 역사였다. Self-Attention이라는 메커니즘 덕분에 모든 토큰이 다른 모든 토큰을 직접 참조할 수 있었고, 이것이 GPT, BERT, 그리고 오늘날 수천억 달러 LLM 산업의 기반이 되었다. 하지만 Attention에는 치명적인 대가가 있다. 시퀀스 길이 에 대해 연산량이 으로 증가한다는 것이다. 1만 토큰 문서를 처리하려면 1억 번의 어텐션 연산이 필요하다.

2023년 12월, Carnegie Mellon University의 Albert Gu와 Tri Dao가 한 편의 논문을 발표했다. 제목은 "Mamba: Linear-Time Sequence Modeling with Selective State Spaces". 이 논문은 Transformer의 을 으로 바꾸면서도, 어떤 정보를 기억하고 어떤 정보를 잊을지 선택할 수 있는 새로운 아키텍처를 제안했다. AI 연구 커뮤니티는 즉시 들끓었다.

이 글은 Mamba가 무엇이고, 왜 중요하며, 어디까지 왔는지를 처음부터 끝까지 풀어보려 한다.

Transformer의 Self-Attention은 시퀀스의 모든 토큰 쌍 사이의 관계를 계산한다. 토큰이 개면, 계산해야 할 쌍의 수는 이다.

| 시퀀스 길이 | 어텐션 연산 횟수 | 비유 |

|---|---|---|

| 1,000 토큰 | 100만 번 | 짧은 이메일 |

| 10,000 토큰 | 1억 번 | 긴 보고서 |

| 100,000 토큰 | 100억 번 | 소설 한 권 |

| 1,000,000 토큰 | 1조 번 | 법률 문서 전체 |

시퀀스 길이가 10배 늘면, 연산량은 100배 증가한다.

추론 단계에서는 상황이 더 나쁘다. Transformer는 이전에 생성한 모든 토큰의 Key-Value 쌍을 메모리에 저장해야 한다. 이것을 KV-Cache라고 한다.

GPT-4급 모델(약 175B 파라미터, 128개 레이어, 96개 어텐션 헤드)이 128K 컨텍스트를 처리할 때 KV-Cache에만 필요한 메모리는 약 40GB에 달한다. 이것은 한 명의 사용자, 한 번의 요청에 소모되는 양이다. 동시 사용자가 100명이면? 4TB. 사실상 불가능하다.

비유하자면, 학생 A(Transformer)가 100만 페이지 교과서를 시험장에 가져가야 하는데, 책상이 40평방미터여야 하는 것이다. 그리고 학생이 한 명 추가될 때마다 책상이 40평방미터씩 더 필요하다.

Transformer는 시퀀스가 길어질수록 연산량이 제곱으로 폭증하지만, Mamba는 선형으로만 늘어난다. 이 차이는 시퀀스가 길수록 압도적이 된다.

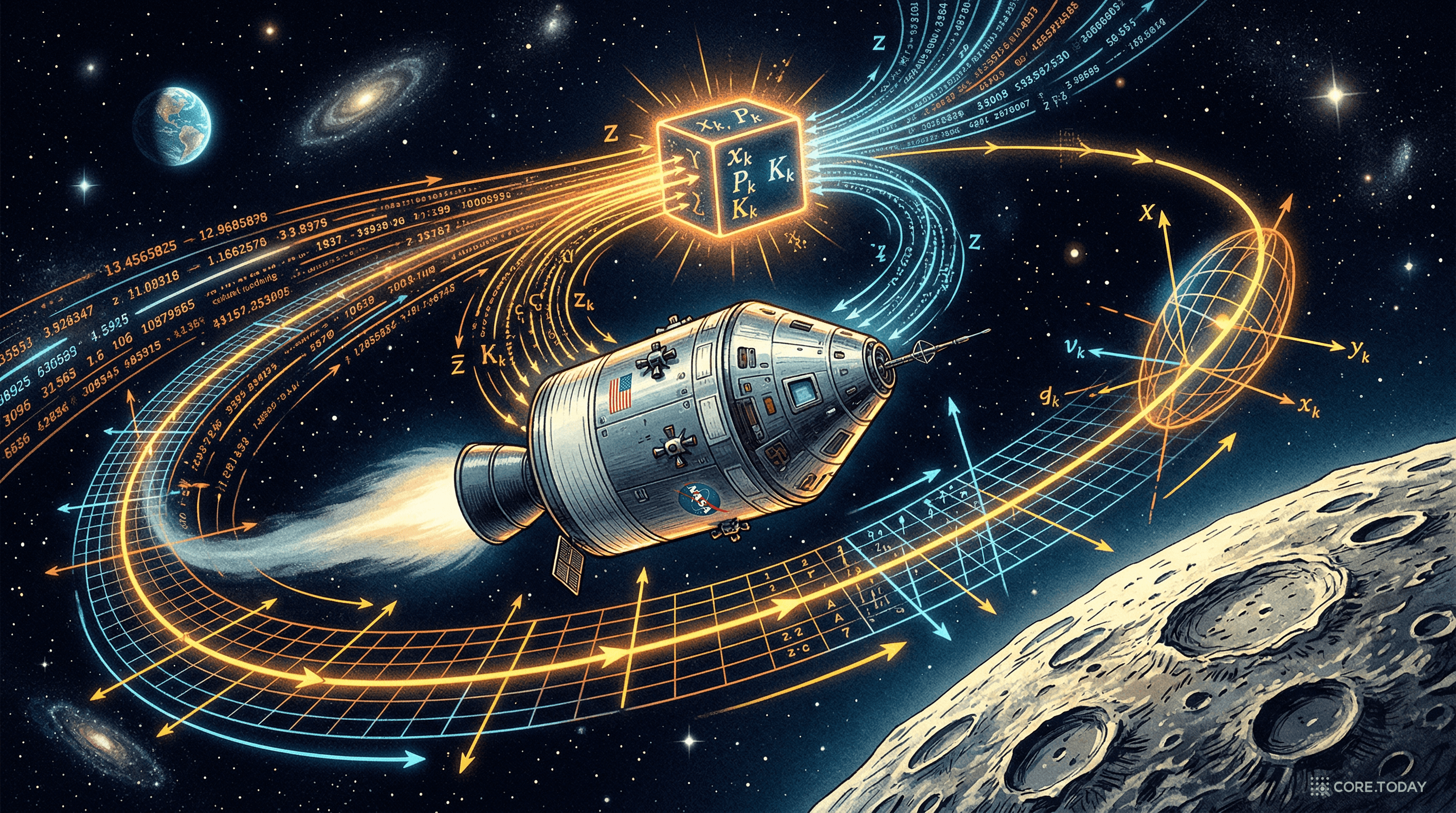

상태 공간 모델(State Space Model, SSM)은 AI가 아니라 제어 이론에서 왔다. 1960년, 헝가리 태생의 수학자 Rudolf Kalman이 칼만 필터를 발표했다. 이것은 NASA가 아폴로 우주선의 위치를 추적하는 데 사용한 바로 그 알고리즘이다.

아폴로 우주선은 지구에서 달까지 38만 km를 비행했다. 센서 데이터에는 항상 노이즈가 섞여 있었고, 모든 순간의 위치를 정확히 알 수는 없었다. 칼만 필터의 해법은 이랬다. 과거의 관측값들을 하나의 "상태 벡터"로 압축하고, 새 관측이 들어올 때마다 이 상태를 업데이트한다. 과거의 모든 데이터를 저장할 필요 없이, 최신 상태 하나만 있으면 된다.

이것이 바로 SSM의 핵심 아이디어다.

연속 시간 SSM은 두 개의 수식으로 정의된다.

상태 업데이트:

출력 생성:

핵심은 이것이다. Transformer가 시퀀스의 모든 토큰을 동시에 참조하는 반면, SSM은 고정된 크기의 상태 벡터를 통해 과거 정보를 흘려보낸다. 상태의 크기는 시퀀스 길이와 무관하다. 따라서 메모리는 , 연산은 ****이다.

SSM의 성능은 A 행렬에 달려 있다. A 행렬이 과거 정보를 어떻게 변환하는지 결정하기 때문이다. 무작위로 초기화한 A 행렬은 몇 스텝만 지나면 과거 정보를 잃어버린다. 마치 아무 규칙 없이 메모하면 나중에 읽을 수 없는 것과 같다.

2020년, Albert Gu(당시 스탠퍼드 박사과정)가 HiPPO(High-order Polynomial Projection Operator) 를 발표했다. 핵심 발견은 놀랍도록 우아했다. A 행렬을 특정한 수학적 구조(르장드르 다항식 기반)로 초기화하면, 상태 벡터가 과거 입력의 최적 다항식 근사를 유지한다는 것이다.

비유하면 이렇다. 무작위 메모지를 쓰는 대신, "체계적 요약법" — 시간순으로 중요도가 감소하는 계층적 요약 — 을 사용하는 것이다. 이 방법으로 시퀀스 분류 정확도가 60%에서 98%로 폭등했다.

HiPPO가 기억의 문제를 풀었다면, S4(Structured State Spaces for Sequence Modeling) 는 속도의 문제를 풀었다. 역시 Albert Gu가 주도했다.

S4의 핵심 기여는 세 가지다.

S4는 SSM이 단순한 이론적 호기심이 아니라 실용적 대안임을 증명했다.

하지만 S4에는 치명적 약점이 있었다. A, B, C 행렬이 입력과 무관하게 고정되어 있었다는 것이다. 모든 토큰을 동일한 방식으로 처리했다. 이것을 content-blind(내용 무관) 하다고 표현한다.

언어에서 이것이 왜 문제인지 생각해 보자. "그는 서울에서 태어나 부산에서 자랐고 대학은 대전에서 다녔으며 현재는 제주도에서 살고 있다"라는 문장에서 "현재 어디에 사나요?"라는 질문에 답하려면, "제주도"는 기억하고 나머지 지명은 상대적으로 덜 중요하다고 판단해야 한다. S4는 이런 선별적 기억이 불가능했다.

2023년 12월, Mamba가 이 문제를 정면으로 해결했다. 핵심 아이디어는 우아하다. B, C, 그리고 이산화 파라미터 를 입력에 따라 동적으로 변경하는 것이다.

기존 SSM (S4) — 파라미터가 입력과 무관하게 고정:

A, B, C = 학습된 상수 (모든 토큰에 동일 적용)

Mamba (S6) — 파라미터가 입력에 따라 동적 변화:

B(t) = Linear_B(x(t)) ← 입력이 상태에 미치는 영향 조절

C(t) = Linear_C(x(t)) ← 상태에서 출력을 읽는 방식 조절

Δ(t) = softplus(Linear_Δ(x(t))) ← 핵심! 기억 유지 vs 망각 결정

Δ(델타)의 역할:

Δ가 크면 → 현재 입력을 강하게 반영, 이전 상태를 많이 잊음 → "이 토큰은 중요해, 새로 기억해!"

Δ가 작으면 → 현재 입력 무시, 이전 상태 유지 → "이건 별로야, 기존 기억 유지해."

비유하면, 속독 전문가가 책을 읽는 방식이다. 중요한 문단은 천천히 꼼꼼히 읽고(큰 ), 사족이나 반복은 빠르게 넘긴다(작은 ). 읽는 속도를 내용에 따라 선택적으로 조절하는 것이다.

선택적 스캔은 개념적으로 우아하지만, 기술적 난제가 있었다. B, C, 가 입력마다 달라지면 더 이상 컨볼루션으로 변환할 수 없다. 즉, S4의 병렬 학습 장점을 잃을 수 있다.

Tri Dao(FlashAttention의 창시자)가 이 문제를 해결했다. GPU의 메모리 계층 구조를 활용하는 하드웨어 인식(hardware-aware) 병렬 스캔 알고리즘이다.

핵심 전략은 세 가지다.

이것은 FlashAttention에서 영감을 받은 IO-aware 설계다. 수학적으로 같은 결과를 내면서도, 실제 GPU에서 3~5배 빠르게 동작한다.

Mamba 논문은 광범위한 벤치마크를 수행했다. 결과는 놀라웠다.

Mamba-3B는 동일 크기의 Transformer-3B를 모든 다운스트림 과제에서 능가했고, 심지어 두 배 크기인 Transformer-6.9B와 대등하거나 우월한 성능을 보였다.

Mamba가 만능은 아니다. "암기 노트"는 효율적이지만, "교과서를 그대로 펼치는" 것만큼 정확하진 않다.

정보 검색(Recall) 실패. "전화번호부에서 홍길동의 번호를 찾아라" 같은 과제에서 Transformer는 정확히 해당 항목을 검색할 수 있지만, Mamba는 수천 개의 번호를 고정 크기 상태로 압축하는 과정에서 특정 항목의 정확한 값을 잃을 수 있다. 이것은 압축의 본질적 한계다.

In-context Learning. Transformer는 프롬프트에 예시 몇 개를 넣으면 새로운 패턴을 즉시 학습하는 강력한 능력이 있다. Mamba는 이 능력에서 Transformer에 밀린다. 예시들 사이의 정확한 대응 관계를 압축된 상태만으로 포착하기 어렵기 때문이다.

복사(Copying) 과제. "이 시퀀스를 그대로 반복해라"와 같은 단순한 과제에서도, 원본을 상태에 완벽히 저장해야 하므로 Mamba가 약점을 보인다.

Mamba가 발표된 지 불과 5개월 만에 후속작이 나왔다. Mamba-2의 가장 충격적인 발견은 수학적인 것이었다. SSM과 Attention이 본질적으로 같은 수학적 프레임워크의 서로 다른 인스턴스라는 증명이었다.

구체적으로, Mamba-2는 SSM의 상태 전이를 반분리 행렬(semiseparable matrix) 로 표현할 수 있음을 보였다. Self-Attention의 어텐션 행렬도 특정 조건에서 반분리 행렬이다. 즉, 둘은 같은 행렬 구조의 서로 다른 제약 조건일 뿐이다.

이 발견의 실용적 의미는 엄청났다.

2026년 3월, Mamba-3가 ICLR 2026에서 발표되었다. 핵심 혁신은 세 가지다.

복소수 상태(Complex State). 실수 대신 복소수를 사용해 상태를 표현한다. 같은 상태 크기로도 더 풍부한 정보를 인코딩할 수 있다. 복소수의 위상(phase)이 추가적인 정보 채널 역할을 하기 때문이다.

MIMO(Multi-Input Multi-Output) 구조. Mamba-2는 각 상태 차원이 독립적으로 작동했지만(SISO), Mamba-3는 상태 차원 간의 상호작용을 허용한다. 이것은 표현력을 크게 높인다.

지수-사다리꼴 이산화(Exponential-Trapezoidal Discretization). 연속 시간 SSM을 이산 시간으로 변환하는 방법을 개선해 수치 안정성과 정확도를 동시에 높였다.

결과적으로 Mamba-3는 Mamba-2 대비 상태 크기를 절반으로 줄이면서 정확도를 +1.8% 향상시켰다.

이론이 아무리 우아해도, 실전에서 쓰이지 않으면 의미가 없다. 2024년부터 주요 AI 기업들이 Mamba를 적극 도입하기 시작했다.

이스라엘의 AI21 Labs가 2024년 3월 공개한 Jamba는 Attention 레이어와 Mamba 레이어를 1:7 비율로 혼합한 최초의 대규모 프로덕션 모델이다. 52B 파라미터(활성 12B)로, 256K 컨텍스트 윈도우를 단일 80GB GPU에서 처리한다. 순수 Transformer로는 같은 컨텍스트 길이를 달성하려면 여러 GPU가 필요했을 것이다.

NVIDIA는 Mamba-2, MLP, Attention을 3종 혼합한 Nemotron-H 아키텍처로 100만(1M) 토큰 컨텍스트를 실현했다. 2026년 3월에는 후속 모델 Nemotron 3 Super(120B 파라미터)가 PinchBench에서 85.6%를 기록하며 동급 최고 성능을 달성했다.

IBM은 더 과감한 비율을 택했다. Granite 4.0은 전체 레이어의 90%를 Mamba로 구성하고, 10%만 Attention을 사용한다. 결과는 놀라웠다. Transformer 전용 모델 대비 8배 빠른 생성 속도를 달성하면서도, 벤치마크 정확도는 대등하거나 우월했다.

"Mamba가 Transformer를 대체할 것인가?"라는 질문은 이제 잘못된 질문이 되었다. 업계의 답은 명확하다. 둘 다 쓴다.

| 모델 | Mamba 비율 | Attention 비율 | 컨텍스트 | 특징 |

|---|---|---|---|---|

| AI21 Jamba | 87.5% | 12.5% | 256K | 최초의 대규모 하이브리드 |

| IBM Granite 4.0 | 90% | 10% | 128K | 극단적 SSM 비율 |

| NVIDIA Nemotron-H | ~60% | ~20% (+MLP 20%) | 1M | 3종 하이브리드 |

| Zamba2 | 85% | 15% (공유) | 128K | Attention 가중치 공유 |

패턴이 보인다. 대부분의 레이어는 Mamba가 담당하고, 소수의 Attention 레이어가 전략적으로 배치된다. Mamba가 시퀀스의 대부분을 효율적으로 처리하고, Attention이 정확한 정보 검색이 필요한 순간에만 개입하는 것이다.

시험장의 학생 비유로 돌아가자.

학생 C가 시험에서 이긴다. 그리고 이것이 2026년 AI 업계의 합의다.

이것이 현재 가장 성공적인 하이브리드 아키텍처의 골격이다. Mamba 레이어가 대부분의 시퀀스를 으로 처리하고, 전략적으로 배치된 소수의 Attention 레이어가 정확한 정보 검색을 보장한다.

이 글을 관통하는 핵심 질문은 하나다. AI는 과거를 어떻게 기억해야 하는가?

Transformer의 답: 모든 것을 기억한다. 강력하지만 비싸다. 1만 토큰이든 100만 토큰이든, 모든 토큰 쌍의 관계를 계산한다. 완벽한 기억이지만, 그 대가는 의 연산과 끝없이 커지는 KV-Cache다.

Mamba의 답: 중요한 것만 기억한다. 효율적이지만, 무엇이 "중요한지" 판단하는 과정에서 정보를 잃을 수 있다. 고정 크기의 상태 벡터 안에 과거 전체를 압축하니, 특정 세부 사항을 정확히 꺼내는 것은 어렵다.

하이브리드의 답: 두 기억 전략을 결합한다. 대부분의 처리는 압축된 기억으로 효율적으로 수행하고, 정밀한 회상이 필요한 순간에만 전체 기억을 펼친다.

흥미로운 것은, 인간의 뇌도 똑같은 전략을 쓴다는 점이다. 우리의 작업 기억(working memory) 은 Attention과 비슷하다 — 약 7개 항목을 동시에 유지하며 정확하게 조작한다. 우리의 장기 기억(long-term memory) 은 SSM과 비슷하다 — 수십 년의 경험을 압축해서 저장하며, 중요한 것은 생생하게 기억하고 사소한 것은 잊는다.

Mamba가 Transformer를 "죽일" 것인가? 아니다. Mamba는 Transformer가 해결하지 못한 문제(긴 시퀀스, 효율성)를 해결하는 상보적 기술이다. 그리고 둘의 결합이 어느 쪽 단독보다 강하다는 것은 이미 실전에서 증명되었다.

AI의 미래는 "Transformer인가 Mamba인가"가 아니다. "어떤 비율로 섞을 것인가"다.