지금 AI에서 가장 중요한 5가지 아이디어 — 2026년, 세상이 바뀌는 원리를 해부하다

AlphaGo Zero의 자기 대국부터 카르파시의 Autoresearch, 바이브 코딩의 탄생, 70만 명의 숨은 AI 훈련사까지 — 2026년 AI를 관통하는 5가지 핵심 아이디어를 역사·논문·사례로 깊이 파고듭니다. 왜 이 개념들이 중요한지, 그리고 이들이 서로 만나면 무슨 일이 벌어지는지.

AlphaGo Zero의 자기 대국부터 카르파시의 Autoresearch, 바이브 코딩의 탄생, 70만 명의 숨은 AI 훈련사까지 — 2026년 AI를 관통하는 5가지 핵심 아이디어를 역사·논문·사례로 깊이 파고듭니다. 왜 이 개념들이 중요한지, 그리고 이들이 서로 만나면 무슨 일이 벌어지는지.

2026년 4월, AI 보안 전문가이자 Unsupervised Learning 뉴스레터를 운영하는 다니엘 미슬러(Daniel Miessler)가 한 편의 글을 발표했습니다. 제목은 "The Most Important Ideas in AI Right Now" — 지금 AI에서 가장 중요한 아이디어들.

이 글이 주목받은 이유는 단순합니다. 미슬러가 짚어낸 5가지 아이디어는 각각 따로 놓으면 "아, 그런 트렌드가 있지"라고 끄덕이게 되지만, 합치면 세상의 작동 방식 자체가 바뀌는 강력한 조합이기 때문입니다.

이 글에서는 미슬러의 원문을 출발점으로, 각 아이디어의 역사적 기원과 핵심 논문, 실제 사례, 그리고 2026년 현재의 의미를 깊이 파고듭니다. 기술적 배경지식이 없어도 이해할 수 있도록 비유와 사례를 풍부하게 담았습니다.

5가지 아이디어를 미리 보겠습니다:

하나씩 깊이 들어가 봅시다.

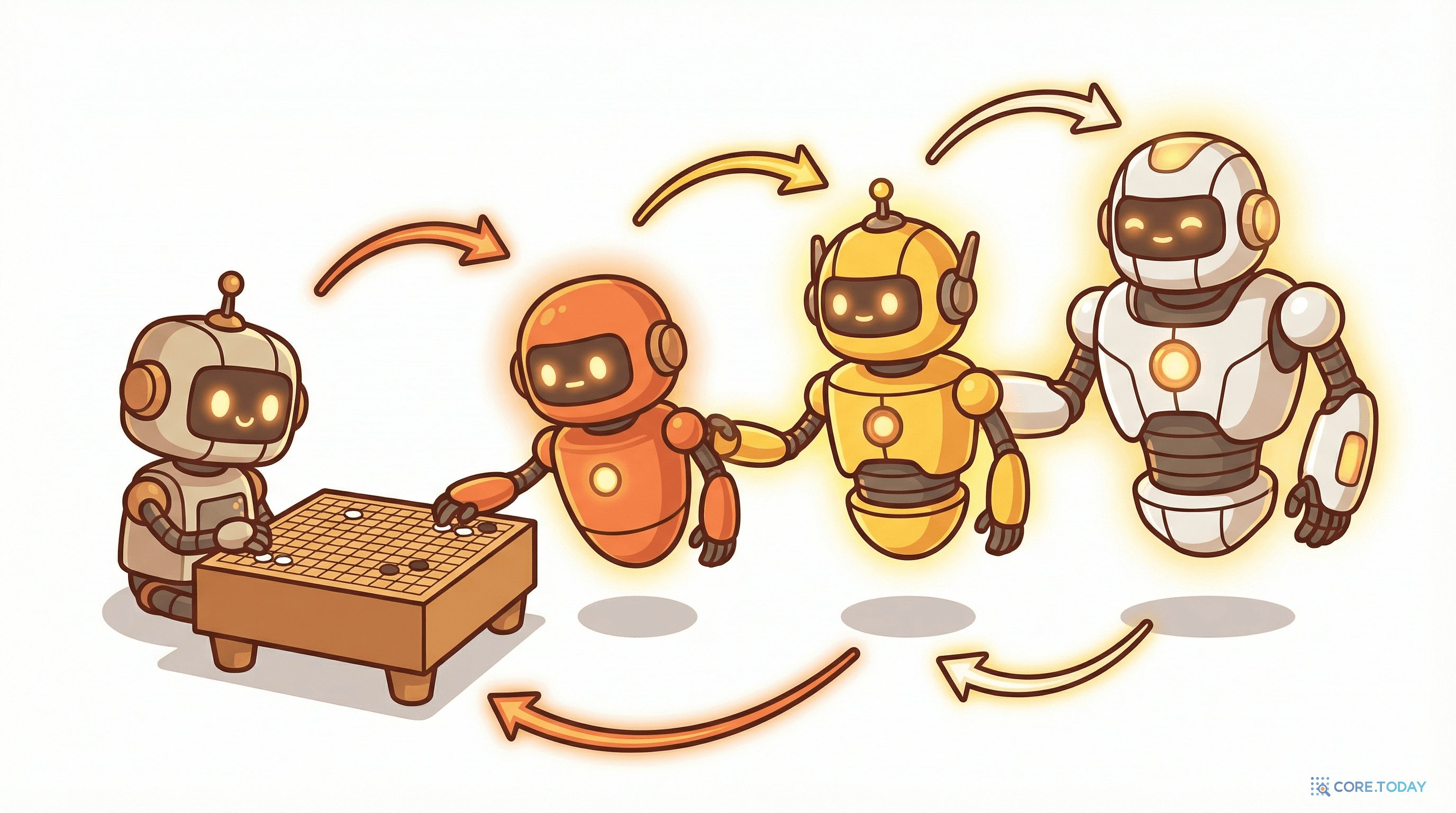

2016년 3월, 전 세계가 충격에 빠졌습니다. 구글 딥마인드의 AlphaGo가 세계 최고의 바둑 기사 이세돌 9단을 4:1로 이겼습니다. 당시 AlphaGo는 인간의 기보(棋譜) 수십만 개를 학습한 AI였습니다.

그런데 불과 1년 반 뒤인 2017년 10월, 딥마인드가 Nature에 발표한 논문이 세상을 다시 한 번 뒤흔듭니다.

"Mastering the game of Go without human knowledge" (인간의 지식 없이 바둑을 마스터하다)

AlphaGo Zero — 이 AI는 인간의 기보를 단 한 건도 보지 않았습니다. 바둑의 규칙만 알려주고, 스스로 자기 자신과 대국하며 실력을 키웠습니다.

결과는 놀라웠습니다:

핵심을 짚어봅시다. AlphaGo Zero가 강해진 비결은 "자기 자신과의 반복적 대국"이었습니다. 이기면 그 전략을 강화하고, 지면 전략을 수정합니다. 평가(eval)가 있으니 개선이 가능했던 것이죠. 바둑에서 평가는 명확합니다 — 이기거나 지거나.

두 달 뒤 나온 AlphaZero(2017년 12월)는 이 원리를 체스와 장기까지 확장했습니다. 체스에서 24시간 만에 세계 최강 엔진 Stockfish를 이겼습니다.

2026년 3월, 전 테슬라 AI 수석이자 OpenAI 공동창업자인 안드레이 카르파시(Andrej Karpathy)가 Autoresearch라는 프로젝트를 공개합니다.

630줄짜리 파이썬 스크립트 하나. 이것이 한 일은 다음과 같습니다:

카르파시가 잠든 동안 2일 만에 700회의 실험을 자동으로 수행하고, 20개의 최적화를 발견하여 GPU 학습 효율을 11% 향상시켰습니다.

카르파시 본인이 이미 충분히 최적화했다고 생각한 프로젝트에서 말입니다.

이 프로젝트는 공개 2일 만에 GitHub 스타 21,000개, 발표 트윗 860만 조회를 기록했습니다. Shopify CEO 토비아스 뤼트케도 직접 테스트해서 37회 실험으로 19% 성능 향상을 달성했습니다.

카르파시는 이렇게 말했습니다:

"모든 AI 프론티어 연구소가 이 방식을 쓰게 될 것입니다. 이것은 최종 보스전이에요."

AlphaGo Zero든 Autoresearch든, 공통 원리는 하나입니다:

측정 가능한 평가(eval) 지표가 있으면, 반복적 개선이 가능하다.

이것을 미슬러는 "일반화된 언덕 오르기(Generalized Hill-Climbing)"라고 부릅니다:

Anthropic(Claude를 만든 회사)은 이를 "평가 주도 개발(Eval-Driven Development)"이라는 공식 용어로 채택했습니다:

"에이전트가 수행할 역량을 먼저 평가 기준으로 정의하고, 그다음에 에이전트를 만들어라."

2022년에 발표된 STaR 논문(Zelikman et al., NeurIPS 2022)은 이 원리를 언어 모델에 적용했습니다. 모델이 스스로 추론 과정을 생성하고, 정답을 맞힌 추론만 골라서 다시 학습하는 자기 교사 학습(Self-Taught Reasoning)입니다.

2026년 현재, Gartner는 "2026년 말까지 AI 프로젝트의 70%가 고급 평가 프레임워크를 내장할 것"이라고 전망합니다.

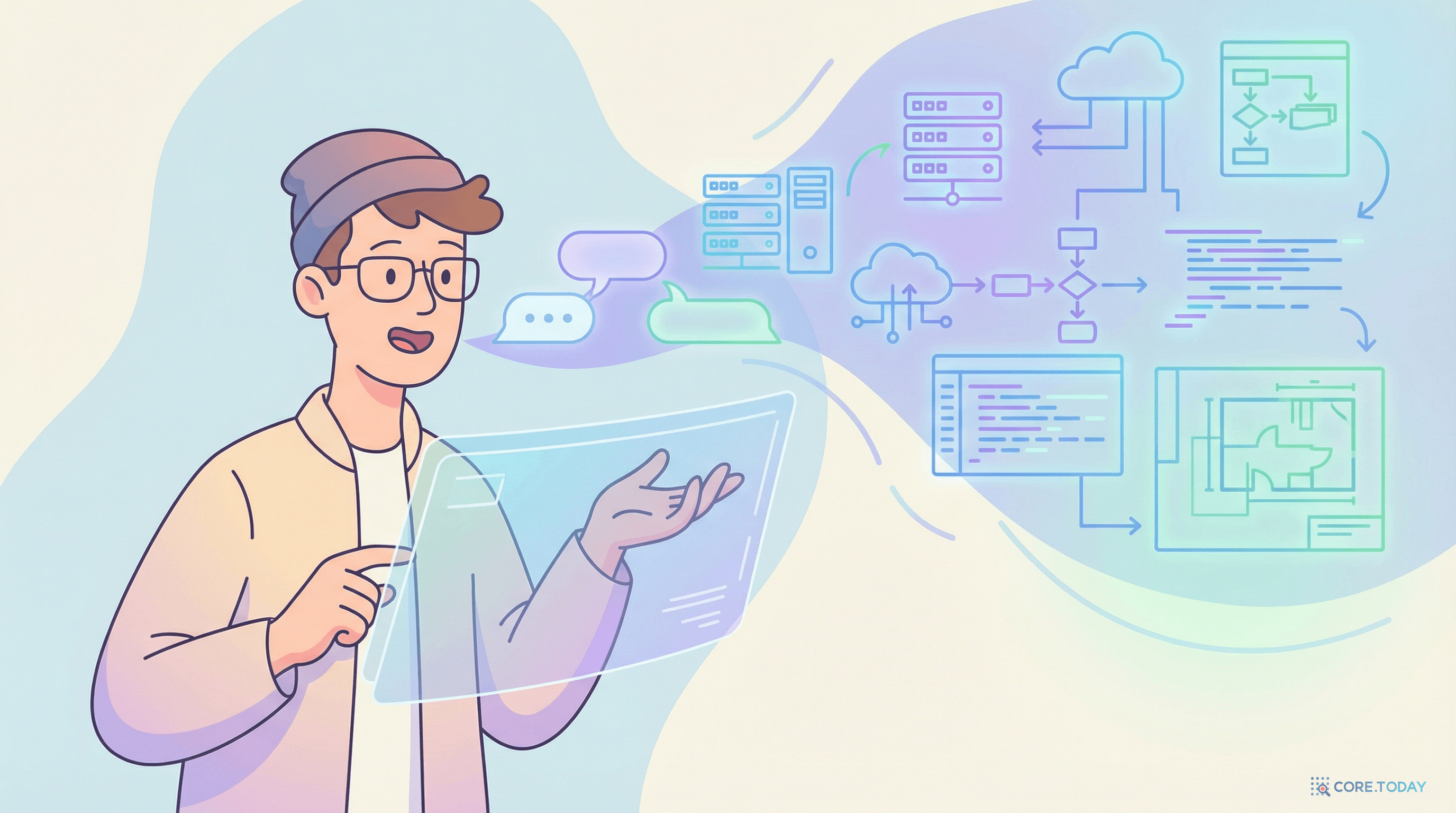

"어떻게 해라"가 아니라 "뭘 원한다"만 말하는 것 — 컴퓨터 과학에서는 이를 선언형(declarative) 프로그래밍이라고 부르며, 사실 50년 된 아이디어입니다.

쿠버네티스 예시를 좀 더 풀어볼까요. 전통적인 서버 관리는 이렇습니다:

쿠버네티스에서는 이렇게 말합니다:

나머지는 쿠버네티스가 알아서 합니다. 서버가 하나 죽으면 자동으로 새 서버를 띄우고, 트래픽이 몰리면 스케일을 늘립니다. 이것이 의도 기반(intent-based) 시스템의 핵심입니다.

2025년 2월 2일, 카르파시가 X(구 트위터)에 올린 한 줄이 세상을 바꿉니다:

"나는 이것을 '바이브 코딩(vibe coding)'이라고 부릅니다. 바이브에 완전히 몸을 맡기고, 코드가 존재한다는 사실 자체를 잊어버리는 새로운 종류의 코딩이죠."

이 용어는 폭발적으로 확산되어 2025년 콜린스 영어사전 올해의 단어로 선정되고, 메리엄-웹스터에도 등재됩니다.

하지만 2026년 초, 카르파시는 바이브 코딩이 이미 "한물갔다"고 선언하며 새로운 개념을 제시합니다:

"에이전틱 엔지니어링 — 코드를 직접 쓰지 않되, AI 에이전트를 조율하고 감독하는 기술. 여기에는 분명한 기술(art)과 과학(science)이 있습니다."

| 구분 | 전통 코딩 | 바이브 코딩 (2025) | 에이전틱 엔지니어링 (2026) |

|---|---|---|---|

| 개발자 역할 | 코드 작성자 | AI에게 대화로 지시 | AI 에이전트 팀의 감독자 |

| 핵심 스킬 | 프로그래밍 언어 숙련 | 프롬프트 작성 능력 | 의도를 명확히 정의하는 능력 |

| 코드 이해 | 모든 줄을 이해 | 결과만 보고 판단 | 아키텍처와 평가 기준 설계 |

| 도구 | VS Code, vim | Cursor, GitHub Copilot | Claude Code, Devin, 멀티에이전트 |

미슬러가 짚는 핵심 통찰은 여기에 있습니다:

"새로운 희소 스킬은 코딩도 프롬프팅도 아닙니다. '자신이 실제로 무엇을 원하는지'를 말할 수 있는 능력입니다."

대부분의 CEO와 팀장이 "성공이란 무엇인가?"라는 질문에 명확하게 대답하지 못합니다. "매출 성장", "고객 만족" 같은 모호한 답변은 AI가 실행할 수 없습니다.

미슬러는 이를 해결하기 위해 ISC(Ideal State Criteria) 프레임워크를 제안합니다:

이 문장이 과장처럼 들린다면, 몇 가지 숫자를 보겠습니다.

갤럽 2024 글로벌 직장 보고서에 따르면:

미슬러의 표현을 빌리면:

"대부분의 조직은 감(vibes)과 스프레드시트로 운영됩니다. 실제로 프로세스에 얼마나 비용이 들고, 실제 일정은 어떻고, 누가 진짜 일을 하고 누가 형식만 채우고 있는지 — 아무도 정확히 모릅니다."

2025년 10월, 호주에서 터진 사건이 이 문제를 적나라하게 보여줍니다.

딜로이트 호주는 호주 정부로부터 복지 시스템 자동화에 대한 보고서를 의뢰받고 44만 호주달러(약 4억 원)를 청구했습니다. 시드니 대학교의 크리스 러지 박사가 이 보고서를 검토한 결과:

미슬러는 이 변화를 "마법에서 엑셀로(Magic to Excel)"라고 표현합니다. 전에는 "우리 팀장은 마법 같은 감각이 있어"라며 넘어갔던 것들이, AI 시대에는 측정 가능한 데이터로 바뀝니다.

| 영역 | 불투명 시대 (~ 2024) | 투명 시대 (2025 ~) |

|---|---|---|

| 채용 | "감이 좋았어" / "면접 인상이 좋았어" | 역량별 점수, 포트폴리오 AI 분석, 실무 테스트 자동 평가 |

| 프로젝트 진행 | "잘 진행 중입니다" (실제로는 2주 지연) | 실시간 작업 로그, 코드 커밋 데이터, 자동 리스크 알림 |

| 컨설팅 | 300페이지 PDF, 검증 불가능한 분석 | 데이터 출처 추적, 분석 과정 재현, 결과 검증 자동화 |

| 성과 평가 | 연 1회, 관리자 주관적 평가 | 지속적 기여도 데이터, 동료 피드백 AI 분석, 편향 감지 |

빅4 컨설팅 기업들은 이 변화를 가장 빨리 체감하고 있습니다. 맥킨지는 내부 생성형 AI "Lilli"를 만들어 과거 프로젝트를 자동 검색하고, PwC는 Agent OS(2025년 3월)로 전문 AI 에이전트를 연결하는 플랫폼을 구축했습니다. 주목할 점: 맥킨지, 베인, BCG의 전직 컨설턴트 150명이 AI 모델 훈련에 투입되어 주니어 컨설턴트의 업무를 AI가 수행하도록 가르치고 있습니다.

건물을 지을 때, 작업자들이 높은 곳에서 일할 수 있도록 임시 구조물을 세웁니다. 이것이 스캐폴딩(scaffolding, 비계)입니다. 건물이 완성되면 모두 해체하죠. 건물의 가치에는 포함되지 않지만, 건물을 짓기 위해서는 반드시 필요한 부수적 작업입니다.

미슬러의 핵심 주장: 지식 노동의 75~99%가 이런 스캐폴딩이다.

과장이 아닙니다. 데이터를 봅시다:

사이버보안 (미슬러의 본업, 99% 스캐폴딩):

미슬러는 보안 전문가로서 이렇게 고백합니다:

"해킹(보안 테스팅)의 99%는 새로운 취약점을 '발견하는 사고'가 아닙니다. 대상 시스템의 컨텍스트를 수집하고, 도구를 만들고 유지하고, 일관된 테스트를 수행할 수 있는 워크플로우를 만들고 유지하는 데 쓰입니다."

소프트웨어 개발:

맥킨지 글로벌 연구소에 따르면, 지식 노동자는 주당 업무 시간의 약 28%를 이메일 관리에, 약 20%를 내부 정보 검색에 씁니다. 코드를 작성하는 개발자도 마찬가지입니다 — 시간의 대부분은 인프라 설정, 라이브러리 업데이트, 인증 시스템 연동, 데이터베이스 마이그레이션 같은 작업에 쓰입니다. "진짜 일"인 설계 사고와 문제 해결은 전체의 작은 부분입니다.

경영 컨설팅 (맥킨지 예시):

"컨설턴트들은 인터뷰를 하고, 이전에 29,346번 풀었던 것과 약간 다른 문제를 듣고, 템플릿을 적용하고, 그 상황에 고유한 2~12%의 '소스'를 넣습니다." — 다니엘 미슬러

미슬러의 표현은 직접적입니다: "AI는 스캐폴딩을 절대적으로 분쇄(absolutely crushes)한다."

이것이 가능한 이유는 에이전트 스킬(Agent Skills) 때문입니다. 에이전트 스킬이란, 전문가의 작업 방식(SOP), 필요한 맥락(context), 품질 기준(guardrails)을 재사용 가능한 패키지로 묶은 것입니다.

Gartner는 "2026년 말까지 기업 앱의 40%에 작업 특화 AI 에이전트가 내장될 것"이라 전망합니다 (2025년 5% 미만에서). AWS는 Strands Agent SOPs를 발표하여 자연어로 에이전트 워크플로우를 정의할 수 있게 했고, Manus AI는 에이전트 스킬을 정식 기능으로 통합했습니다.

그 경제적 효과는 이미 나타나고 있습니다:

ChatGPT가 왜 그렇게 자연스럽게 대화하는지 궁금했던 적 있으신가요? 그 비밀의 한 축은 RLHF(Reinforcement Learning from Human Feedback, 인간 피드백을 통한 강화학습)이라는 기술입니다.

2017년 6월, 다리오 아모데이(현 Anthropic CEO)를 포함한 OpenAI 연구자들이 발표한 논문 "Deep Reinforcement Learning from Human Preferences"가 이 분야를 열었습니다. 놀라운 점: 복잡한 강화학습 과제를 해결하는 데 필요했던 인간 피드백은 약 900비트 — 인간 시간으로 1시간 미만이었습니다.

이 원리가 언어 모델에 적용되면서, 거대한 산업이 태어났습니다.

| 기업 | 규모 | 특이사항 |

|---|---|---|

| Scale AI | 기업가치 ~290억 달러 | 2025년 Meta가 49% 지분을 148억 달러에 인수. 창업자 알렉산더 왕(24세 최연소 자수성가 억만장자)은 Meta 초지능 팀 합류 |

| Surge AI / DataAnnotation.tech | 연매출 12억 달러+ (벤처투자 0원) | 창업자 에드윈 첸(MIT). 5만+ 전문가 네트워크. 벤처캐피탈 없이 매출 12억 달러 달성한 가장 성공적인 부트스트랩 AI 기업 |

| Outlier AI | 프리랜서 수만 명 | Scale AI 산하. 코딩·수학·과학 전문가에게 시간당 40~80달러 지급 |

| 기타 | Aligned, Prolific, OpenTrain, CleverX, Pareto 등 | 전 세계 70만 명+ 자격증 보유 전문가가 AI 훈련에 참여 |

이 숫자가 의미하는 것은 명확합니다: 전 세계 70만 명 이상의 전문가들이 자신의 지식을 AI에게 가르치고 있습니다. 의사, 변호사, 엔지니어, 과학자들이 AI 모델에게 "이 답변이 더 정확하고 유용하다"고 판정해주면, 그 전문 지식이 AI에 내장됩니다.

미슬러의 비유는 강렬합니다:

"전문 지식이 스킬, SOP, 오픈소스 프로젝트, 문서화된 프로세스에 담기면 — 그것은 수영장에 들어간 오줌과 같습니다. 영원히 공공의 지식이 됩니다."

이것이 "표현 격차(Articulation Gap)"의 역설입니다:

인간이 30년간 쌓은 전문성을, AI는 순식간에 흡수하고 무한히 복제합니다. 그리고 한번 AI에 들어간 지식은 절대 사라지지 않습니다.

이 변화의 가장 직접적인 충격은 신입 일자리에 나타나고 있습니다:

Google과 Meta는 2021년 대비 신입 채용을 약 50% 줄였고, Salesforce는 2025년에 주니어 채용을 전면 중단했습니다.

하지만 동시에, AI 활용 능력을 갖춘 직원은 56% 더 높은 임금을 받습니다(PwC 2025 보고서).

맥킨지가 추산한 생성형 AI의 총 경제적 영향은 연간 6.1~7.9조 달러 — 대한민국 GDP의 약 4배입니다.

지금까지 살펴본 5가지 아이디어를 다시 한번 연결해 봅시다:

미슬러는 이것을 "보편적 개선 사이클(Universal Improvement Cycle)"이라고 부릅니다:

목표 설정 → 에이전트 실행 → 모든 것을 기록 → 실패 수집 → 자율 개선 → SOP 업데이트 → 반복

가장 무서운 부분은 이겁니다: 이 사이클 자체도 자기 자신을 개선할 수 있습니다. 개선의 속도가 개선됩니다. 이것이 바로 복합 가속(Compound Acceleration)입니다.

구체적인 예를 들어봅시다. 한 한국 스타트업이 이 5가지 아이디어를 모두 적용한다고 가정합니다:

이 사이클이 매일 자동으로 돌아갑니다. 한 달이면 이전 1년의 개선량을 달성하고, 경쟁사가 따라잡을 수 없는 격차가 생깁니다.

미슬러는 글을 이렇게 마무리합니다:

"이것이 얼마나 미친 일이 될지 표현할 수가 없습니다."

과장이 아닙니다. 이 글에서 다룬 5가지 아이디어 각각은 이미 세상을 바꾸고 있고, 이들이 결합되면 변화의 속도 자체가 가속됩니다.

하지만 이 변화 앞에서 우리가 할 수 있는 것은 분명히 있습니다:

의도를 명확히 하는 연습을 하세요. "대충 좋게"가 아니라, "무엇이 좋은 것인지"를 8~12단어의 이진 기준으로 정의하는 습관을 들이세요. 이것이 AI 시대의 가장 중요한 스킬입니다.

당신의 일에서 스캐폴딩과 핵심을 구분하세요. 하루 일과를 돌아보며, "이 작업 중 AI가 대체할 수 없는 부분은 무엇인가?"를 자문하세요. 그 부분이 당신의 진짜 가치입니다.

투명성을 두려워하지 마세요. 측정 가능한 성과를 만들고, 그것을 공유하는 사람이 AI 시대의 승자입니다.

배우는 것을 멈추지 마세요. 30년 경력의 가치가 줄어드는 세상에서, 배우는 속도가 가장 강력한 경쟁 우위입니다.

AI는 우리가 해왔던 일의 대부분을 대체할 것입니다. 하지만 "무엇을 해야 하는가?"라는 질문은 여전히 인간의 몫입니다. 그리고 그 질문에 가장 명확하게 답할 수 있는 사람이, 이 새로운 시대의 주인공이 될 것입니다.