Nginx 완전 정복: 웹 서버의 '교통 경찰'이 하는 일

전 세계 웹사이트의 34%가 사용하는 Nginx. 단순한 웹 서버를 넘어 리버스 프록시, 로드 밸런서, SSL 터미네이터까지 — 이 '보이지 않는 교통 경찰'이 어떻게 인터넷을 움직이는지 처음부터 끝까지 풀어본다.

전 세계 웹사이트의 34%가 사용하는 Nginx. 단순한 웹 서버를 넘어 리버스 프록시, 로드 밸런서, SSL 터미네이터까지 — 이 '보이지 않는 교통 경찰'이 어떻게 인터넷을 움직이는지 처음부터 끝까지 풀어본다.

브라우저에 주소를 입력하고 엔터를 누른다. 화면에 웹페이지가 나타난다. 그 사이에 무슨 일이 일어났을까?

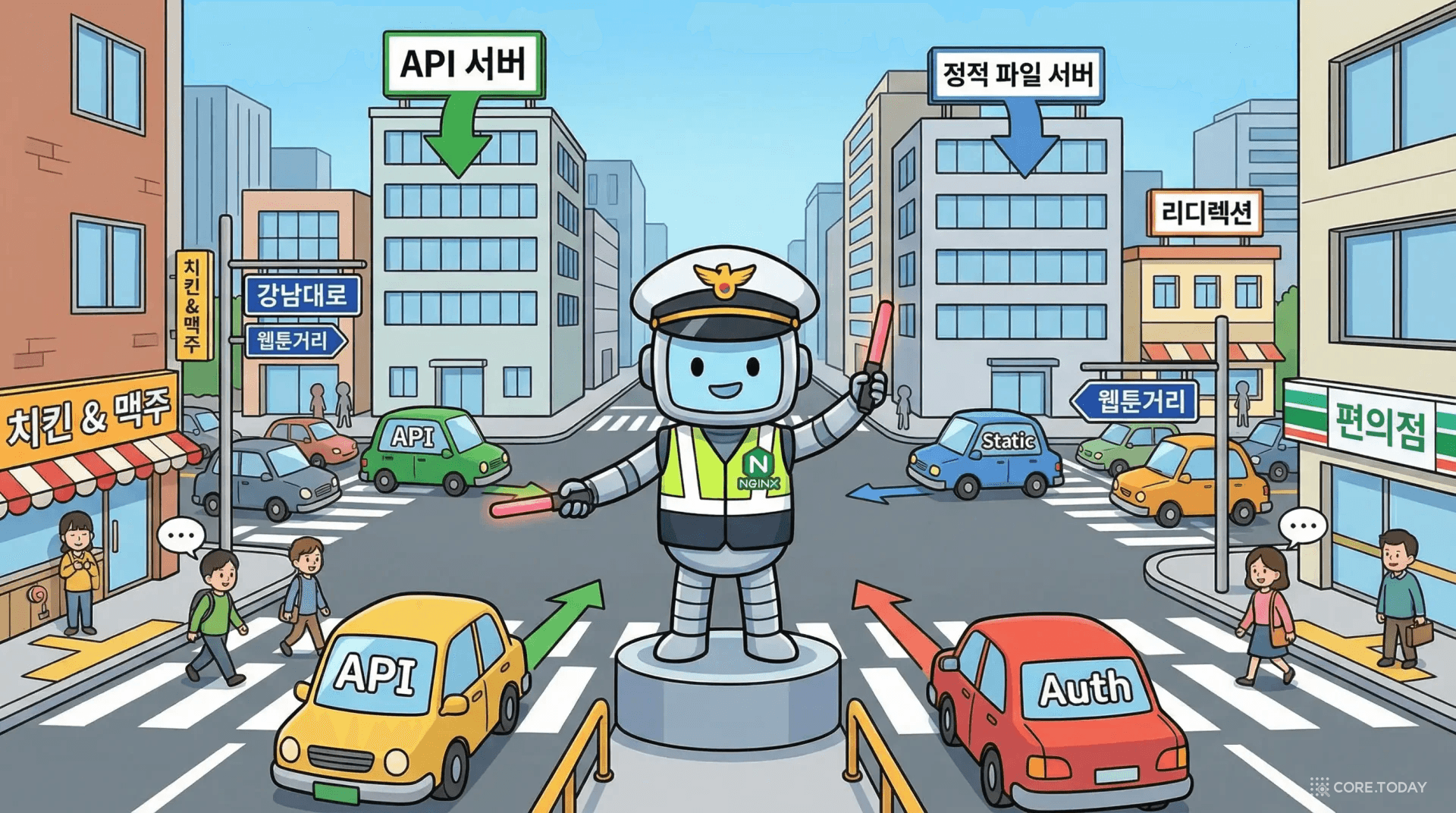

대부분의 사람들은 "서버가 응답했겠지"라고 생각한다. 맞다. 하지만 그 서버 앞에는 보이지 않는 문지기가 있다. 요청을 받아서 어디로 보낼지 판단하고, 악의적인 트래픽은 차단하고, 정적 파일은 직접 처리하고, 암호화된 연결을 해제하는 — 웹 세계의 교통 경찰 같은 존재.

그것이 바로 Nginx(엔진엑스)다.

2026년 4월 기준, W3Techs 통계에 따르면 Nginx는 전 세계 웹사이트의 약 34%에서 사용된다. 이것은 Apache(약 27%)를 넘어선 수치다. Netflix, Airbnb, WordPress.com, GitHub — 이 모든 서비스의 앞단에 Nginx가 있다. 당신이 매일 사용하는 서비스의 상당수가 Nginx 뒤에 숨어 있다.

그런데 Nginx가 정확히 뭘 하는 소프트웨어인지, 왜 이렇게 널리 쓰이는지 설명할 수 있는 사람은 의외로 적다. "웹 서버 아닌가요?"라고 답한다면, 반만 맞는 것이다.

이 글에서는 Nginx를 처음 접하는 사람도 이해할 수 있도록, 역사부터 아키텍처, 설정 방법, 실전 사례, 그리고 클라우드 시대에서의 역할까지 전부 풀어본다.

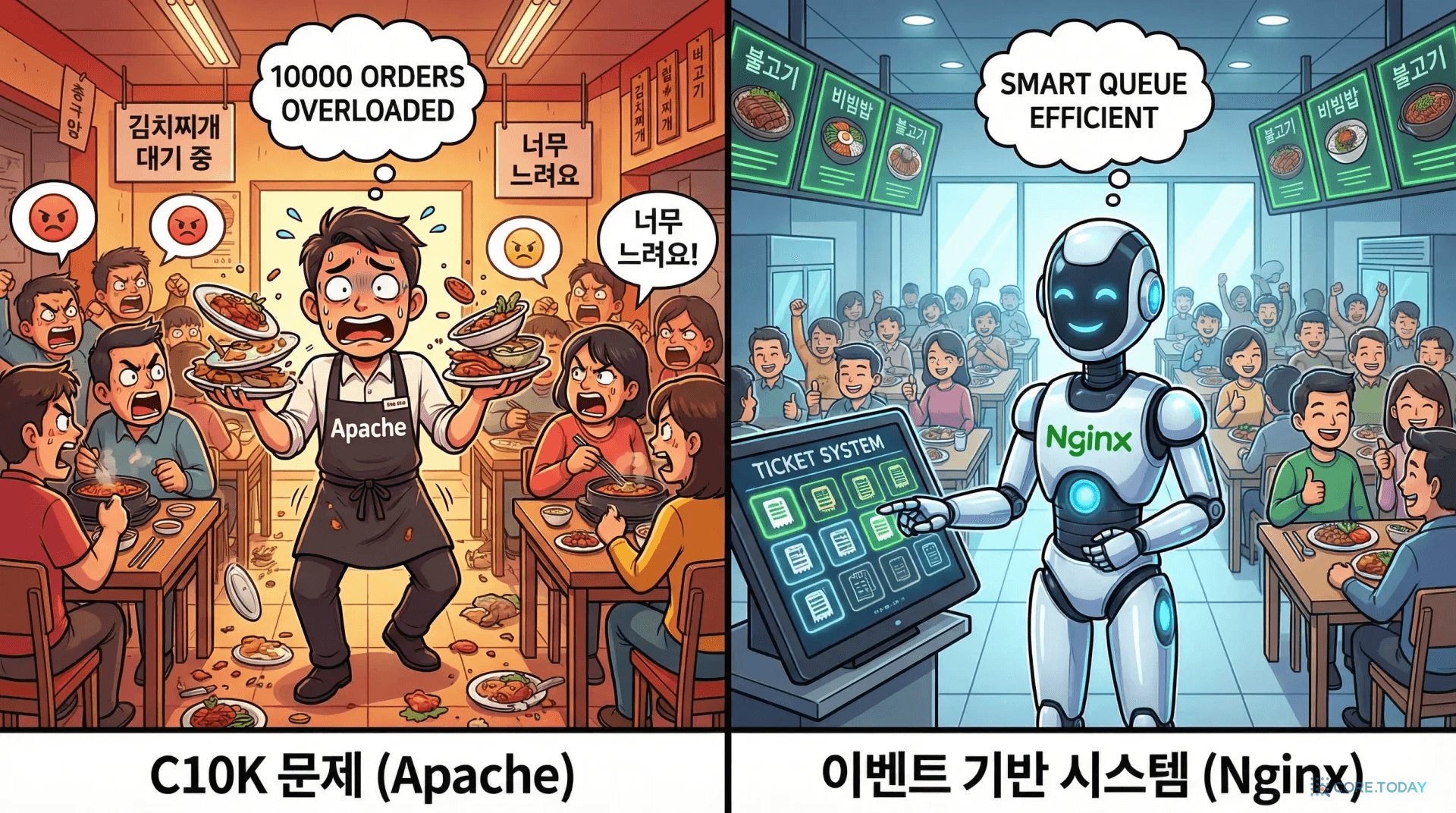

1995년, Apache HTTP Server가 등장했다. 이것은 사실상 월드 와이드 웹의 성장과 함께한 소프트웨어다. 2000년대 초반까지 Apache는 웹 서버 시장의 60% 이상을 점유했다. "웹 서버 = Apache"인 시절이 있었다.

Apache의 구조는 직관적이었다. 클라이언트 요청이 들어오면 프로세스(또는 스레드)를 하나 생성해서 그 요청을 처리한다. 요청이 끝나면 프로세스를 반환한다. 마치 식당에서 손님이 오면 종업원 한 명을 배정하는 것과 같다.

이 방식은 소규모 트래픽에서는 잘 작동했다. 하지만 인터넷이 폭발적으로 성장하면서 문제가 드러났다.

1999년, 엔지니어 Dan Kegel이 유명한 논문을 발표했다. "C10K Problem" — 하나의 서버가 동시에 1만 개의 연결(Concurrent 10,000 connections)을 처리할 수 있는가?

Apache의 "프로세스 하나 = 연결 하나" 모델에서 동시 접속 1만 명은 프로세스 1만 개를 의미했다. 각 프로세스가 메모리를 수 MB씩 잡아먹으니, 순식간에 서버 메모리가 고갈된다. 이것이 C10K 문제의 핵심이었다.

Igor Sysoev(이고르 시소예프)는 러시아의 소프트웨어 엔지니어다. 당시 러시아 최대 검색 엔진 Rambler에서 일하던 그는 Apache가 대규모 트래픽을 감당하지 못하는 문제를 직접 겪고 있었다.

2002년부터 개발을 시작해, 2004년 10월 첫 번째 공개 버전이 릴리즈되었다. Nginx라는 이름은 "engine x"에서 왔다. 발음은 "엔진엑스"다.

Apache와 Nginx의 가장 근본적인 차이는 동시 접속을 처리하는 방식이다.

비유하자면 이렇다:

Nginx의 내부 구조를 좀 더 정확히 보면 이렇다:

이 아키텍처 덕분에 Nginx는 적은 메모리로 엄청난 수의 동시 접속을 처리할 수 있다. 실제로 Nginx 워커 프로세스 하나가 사용하는 메모리는 약 2.5MB 수준이다.

가장 기본적인 역할부터 보자. Nginx는 정적 파일을 서빙하는 웹 서버다.

웹사이트를 구성하는 파일은 크게 두 종류다:

Nginx는 정적 파일 서빙에서 압도적인 성능을 보인다. 파일을 디스크에서 읽어 네트워크로 보내는 과정에서 sendfile() 시스템 콜을 사용해 커널 공간에서 직접 전송하기 때문이다. 사용자 공간으로 데이터를 복사하는 과정을 생략해서 훨씬 빠르다.

이 간단한 설정만으로 Nginx는 /var/www/html 디렉토리의 파일을 서빙한다. Next.js, React, Vue 같은 프레임워크로 빌드한 정적 사이트도 이 방식으로 배포할 수 있다.

위 수치는 일반적인 벤치마크 환경에서의 대략적 수치다. 실제 성능은 하드웨어, OS, 설정에 따라 크게 달라질 수 있다.

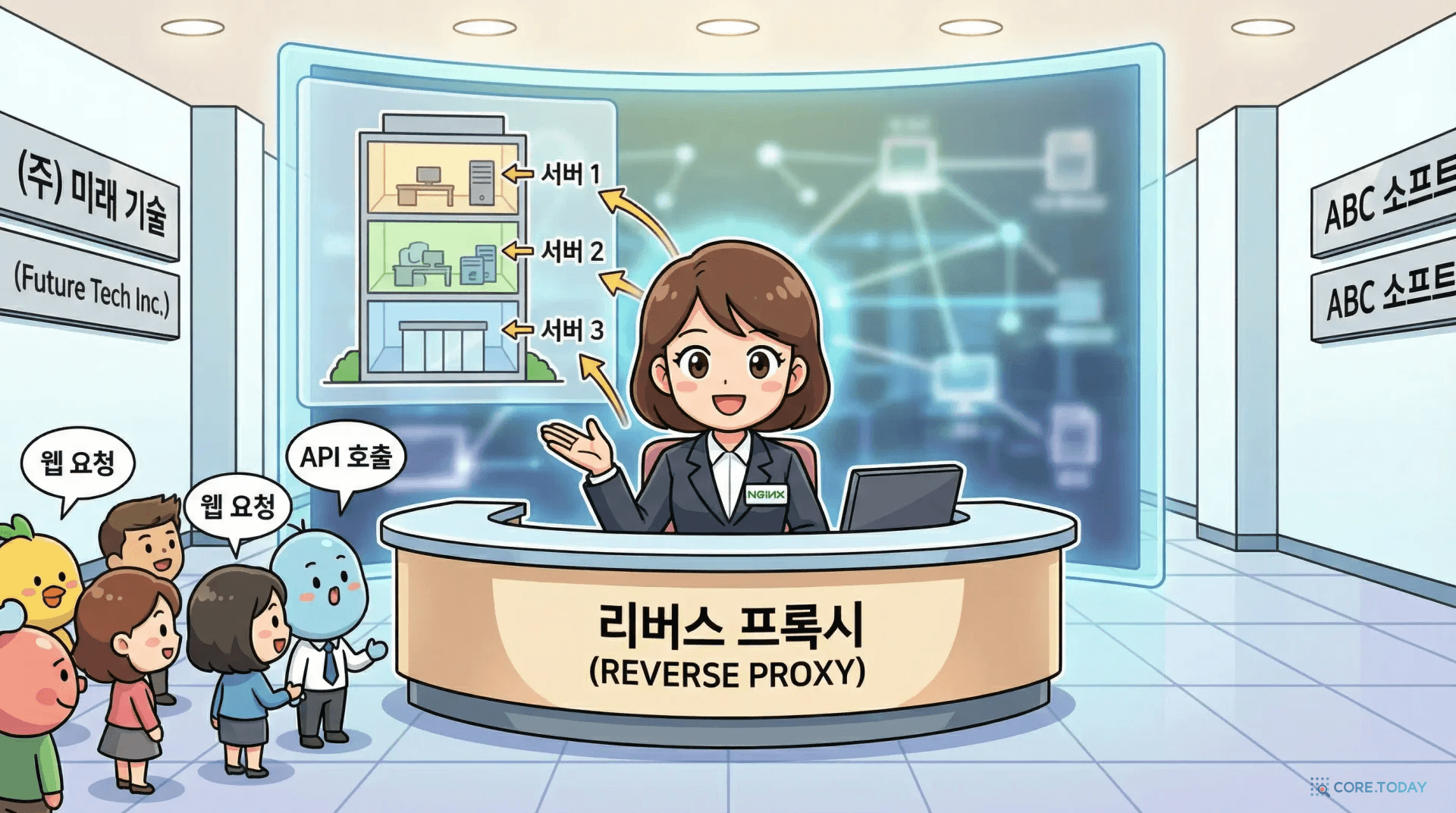

웹 서버보다 더 중요한 역할이 있다. 현대 웹에서 Nginx가 가장 많이 사용되는 이유 — 리버스 프록시(Reverse Proxy)다.

프록시(proxy)는 "대리인"이라는 뜻이다. 두 종류가 있다:

Node.js, Python(Django/Flask), Java(Spring Boot) 같은 애플리케이션 서버를 직접 인터넷에 노출하면 위험하다. Nginx를 앞에 두면 여러 가지를 한 번에 해결할 수 있다.

사용자는 https://example.com에 접속하지만, 실제로는 Nginx가 요청을 받아 내부의 localhost:3000(Node.js 앱)으로 전달한다. 사용자는 Node.js 서버의 존재를 전혀 모른다.

서비스가 성장하면 서버 한 대로는 트래픽을 감당할 수 없다. 같은 애플리케이션을 여러 서버에 배포하고, 요청을 분산해야 한다. 이것이 로드 밸런싱(Load Balancing)이다.

Nginx는 별도의 장비 없이도 소프트웨어 로드 밸런서 역할을 할 수 있다.

각 알고리즘을 좀 더 자세히 보자:

1) Round Robin (라운드 로빈)

가장 단순하다. 서버 3대가 있으면 요청을 1→2→3→1→2→3... 순서로 보낸다. 모든 서버의 성능이 비슷할 때 적합하다. weight 옵션으로 특정 서버에 더 많은 트래픽을 보낼 수도 있다.

2) Least Connections (최소 연결)

현재 활성 연결(active connection)이 가장 적은 서버에 요청을 보낸다. 요청 처리 시간이 들쭉날쭉한 경우(예: 어떤 API는 50ms, 어떤 API는 5초) 라운드 로빈보다 균형 잡힌 분산이 된다.

3) IP Hash

클라이언트 IP 주소를 해시해서 항상 같은 서버로 보낸다. 세션 유지(session persistence)가 필요한 경우에 사용한다. 예를 들어, 장바구니 정보를 서버 메모리에 저장하는 레거시 시스템.

backup 서버는 평소에는 트래픽을 받지 않다가, 다른 서버가 모두 다운되었을 때만 활성화된다. 이것으로 고가용성(High Availability)을 확보할 수 있다.

Nginx를 다루려면 설정 파일의 구조를 이해해야 한다. 주 설정 파일은 보통 /etc/nginx/nginx.conf에 있다.

Nginx 설정은 블록(block) 단위로 중첩된다.

각 블록이 하는 일을 정리하면:

worker_processes), 실행 사용자(user), 에러 로그 경로

worker_connections)

하나의 Nginx 서버에서 여러 도메인(예: blog.example.com, api.example.com)을 운영할 수 있다. 각 도메인을 별도의 server 블록으로 정의한다.

server {

listen 80;

server_name blog.example.com;

root /var/www/blog;

}

server {

listen 80;

server_name api.example.com;

location / {

proxy_pass http://localhost:4000;

}

}

Nginx는 요청의 Host 헤더를 보고 어떤 server 블록으로 라우팅할지 결정한다. 일치하는 server_name이 없으면 default_server로 지정된 블록이 처리한다.

location은 Nginx 설정에서 가장 자주 쓰이는 블록이다. URL 경로에 따라 다른 동작을 정의한다.

location 매칭 순서는 Nginx를 처음 배울 때 가장 헷갈리는 부분이다. 핵심은: 정확 매칭 >

^~접두사 > 정규식 > 일반 접두사 순이다.

이제 실제로 Nginx를 설정하는 시나리오를 살펴보자. 가장 흔한 케이스: Node.js(또는 Next.js) 앱 앞에 Nginx를 리버스 프록시로 두고, Let's Encrypt로 무료 SSL을 적용하는 것.

Node.js 앱이 localhost:3000에서 실행 중이라고 가정한다. Next.js라면 npm run start 후 기본 포트가 3000이다.

# Ubuntu / Debian

sudo apt update && sudo apt install nginx

# CentOS / RHEL

sudo yum install epel-release && sudo yum install nginx

# macOS (Homebrew)

brew install nginx

핵심 포인트:

return 301 — HTTP 접속을 HTTPS로 강제 리다이렉트ssl http2 — SSL과 HTTP/2를 동시에 활성화. HTTP/2는 멀티플렉싱으로 성능이 좋다proxy_set_header — 원본 클라이언트의 정보(IP, 프로토콜)를 백엔드에 전달Upgrade/Connection 헤더 — WebSocket 지원에 필요Certbot을 사용하면 Let's Encrypt 인증서를 자동으로 발급받을 수 있다.

# Certbot 설치

sudo apt install certbot python3-certbot-nginx

# 인증서 발급 + Nginx 설정 자동 수정

sudo certbot --nginx -d myapp.com -d www.myapp.com

# 자동 갱신 확인 (인증서는 90일마다 만료)

sudo certbot renew --dry-run

Certbot은 Nginx 설정에 SSL 관련 라인을 자동으로 추가해준다. 갱신도 cron으로 자동화할 수 있어서, 한 번 설정하면 사실상 무한 무료 SSL이다.

# 문법 검사

sudo nginx -t

# 설정 리로드 (서비스 중단 없이)

sudo nginx -s reload

nginx -t는 설정 파일의 문법 오류를 체크한다. 반드시 reload 전에 실행해야 한다. 문법 오류가 있는 상태로 reload하면 Nginx가 죽을 수 있다.

웹 서버는 Nginx만 있는 것이 아니다. Apache와 최근 인기를 얻고 있는 Caddy를 함께 비교해보자.

| 항목 | Nginx | Apache | Caddy |

|---|---|---|---|

| 출시 | 2004 | 1995 | 2015 |

| 아키텍처 | 이벤트 기반 (비동기) | 프로세스/스레드 기반 | 이벤트 기반 (Go) |

| 동시 접속 성능 | 매우 높음 | 보통 | 높음 |

| 정적 파일 성능 | 최상 | 보통 | 우수 |

| 메모리 사용 | 매우 적음 (~2.5MB/워커) | 많음 (~10MB/프로세스) | 적음 |

| SSL 설정 | 수동 (Certbot 필요) | 수동 (Certbot 필요) | 자동 (ACME 내장) |

| 설정 언어 | 자체 conf 문법 | 자체 conf 문법 | Caddyfile (간결) |

| .htaccess | 미지원 | 지원 | 미지원 |

| 동적 모듈 | 컴파일 시 또는 동적 로드 | 런타임 로드/언로드 | 플러그인 시스템 |

| 사용 비중 (2026) | ~34% | ~27% | ~1% |

| 주요 사용처 | 리버스 프록시, API 게이트웨이, CDN | 공유 호스팅, 레거시 CMS | 소규모 서비스, 개인 프로젝트 |

.htaccess가 반드시 필요한 경우(예: 공유 호스팅 환경, WordPress). 모듈 생태계가 매우 넓다.2020년대 이후 신규 프로젝트에서는 Nginx와 Caddy가 대부분이고, Apache를 새로 도입하는 경우는 점점 줄고 있다.

AWS ALB(Application Load Balancer), Cloudflare, Vercel — 클라우드 서비스가 Nginx의 역할을 많이 대체하고 있다. 그렇다면 Nginx는 더 이상 필요 없을까?

1) 컨테이너 환경 (Docker, Kubernetes)

Docker 이미지 안에서 Next.js나 React 앱을 서빙할 때, Nginx를 같이 넣는 것이 표준 패턴이다. nginx:alpine 이미지는 5MB밖에 안 된다.

FROM nginx:alpine

COPY build/ /usr/share/nginx/html

COPY nginx.conf /etc/nginx/conf.d/default.conf

Kubernetes에서는 Ingress Controller로 Nginx를 사용한다. 클러스터 외부에서 들어오는 트래픽을 내부 서비스로 라우팅하는 역할이다. NGINX Ingress Controller는 Kubernetes 생태계에서 가장 널리 사용되는 Ingress 구현체다.

2) 멀티 서비스 라우팅

하나의 서버에서 여러 서비스를 운영할 때:

클라우드 ALB에서도 이런 라우팅이 가능하지만, 세밀한 헤더 조작, 캐시 규칙, 요청 변환 등은 Nginx 설정이 훨씬 유연하다.

3) 엣지 캐싱과 마이크로캐싱

API 응답을 1초만 캐싱해도 백엔드 부하를 극적으로 줄일 수 있다. 이런 마이크로캐싱(microcaching) 전략은 Nginx의 proxy_cache 지시자로 쉽게 구현된다.

4) 비용

클라우드 로드 밸런서는 시간당/요청당 과금된다. AWS ALB는 월 최소 $20 이상이다. VPS에서 Nginx를 직접 운영하면 이 비용을 절감할 수 있다. 소규모 스타트업이나 사이드 프로젝트에서는 무시할 수 없는 차이다.

Nginx라는 이름 아래에 여러 변형(variant)이 존재한다.

| 항목 | Nginx OSS | NGINX Plus | OpenResty |

|---|---|---|---|

| 가격 | 무료 (BSD 라이선스) | 유료 (연간 ~$2,500) | 무료 (BSD 라이선스) |

| 관리 주체 | F5 Networks | F5 Networks | 커뮤니티 (OpenResty Inc.) |

| 대시보드/모니터링 | 기본적 (stub_status) | 실시간 대시보드 | 서드파티 필요 |

| 헬스 체크 | 패시브만 | 액티브 + 패시브 | Lua로 커스텀 가능 |

| 세션 유지 | ip_hash만 | 쿠키/라우트 기반 | Lua로 커스텀 가능 |

| 프로그래밍 가능 | 제한적 (njs) | njs (JavaScript) | LuaJIT (매우 유연) |

| 사용 사례 | 대부분의 프로젝트 | 엔터프라이즈, SLA 필요 | API 게이트웨이, Kong의 기반 |

대부분의 사용자가 쓰는 버전이다. apt install nginx로 설치하면 이것이다. 리버스 프록시, 로드 밸런싱, SSL 터미네이션 등 핵심 기능은 모두 포함되어 있다. 커뮤니티가 크고, 레퍼런스가 풍부하다.

F5 Networks가 판매하는 유료 버전이다. OSS 대비 주요 추가 기능:

연간 약 $2,500부터 시작한다. 대규모 트래픽을 처리하는 기업이나, SLA가 필요한 환경에서 사용한다.

Nginx 코어에 LuaJIT을 통합한 플랫폼이다. Nginx의 설정 문법만으로는 구현하기 어려운 복잡한 로직을 Lua 코드로 작성할 수 있다.

가장 유명한 사용 사례: Kong API Gateway. Kong은 OpenResty 위에 만들어진 오픈소스 API 게이트웨이다. 인증, 속도 제한, 요청 변환, 로깅 등을 플러그인으로 처리한다.

-- OpenResty: 요청에 커스텀 헤더 추가

content_by_lua_block {

local ip = ngx.var.remote_addr

ngx.header["X-Client-Geo"] = lookup_geo(ip)

ngx.say("Hello from OpenResty!")

}

일반적인 용도라면 Nginx OSS로 충분하다. "Nginx에서 프로그래밍이 필요하다"면 OpenResty를, "엔터프라이즈 지원과 대시보드가 필요하다"면 NGINX Plus를 고려한다.

실무에서 자주 쓰는 명령어를 정리한다.

# 설정 파일 문법 검사 (반드시 reload 전에)

sudo nginx -t

# 설정 리로드 (다운타임 없음)

sudo nginx -s reload

# Nginx 정지

sudo nginx -s stop

# Nginx 시작

sudo systemctl start nginx

# 현재 연결 상태 확인 (stub_status 모듈 필요)

curl http://localhost/nginx_status

curl http://localhost:3000으로 백엔드 직접 접속 테스트. 에러 로그 확인: tail -f /var/log/nginx/error.logwww-data 사용자)가 해당 디렉토리/파일을 읽을 수 없음. 해결: chmod 755 /var/www/html, chown -R www-data:www-data /var/www/htmlnginx -t를 통과했는데도 변경이 안 보이면, 브라우저 캐시를 의심한다. 시크릿/프라이빗 모드에서 테스트하거나 curl -I로 헤더를 직접 확인한다./var/log/nginx/access.log — 모든 요청 기록 (IP, URL, 상태 코드, 응답 시간)

/var/log/nginx/error.log — 에러 메시지 (502, 403, upstream 연결 실패 등)

문제가 생기면 에러 로그부터 본다. 대부분의 답이 거기에 있다.

프로덕션 환경에서 Nginx를 운영한다면 보안 설정도 중요하다.

ssl_protocols TLSv1.2 TLSv1.3; — 구버전 TLS(1.0, 1.1)는 취약하므로 비활성화

add_header Strict-Transport-Security "max-age=31536000; includeSubDomains"; — 브라우저가 HTTPS만 사용하도록 강제

server_tokens off; — 응답 헤더에서 Nginx 버전 정보 제거 (공격 표면 축소)

limit_req_zone $binary_remote_addr zone=api:10m rate=10r/s; — IP당 초당 10개 요청으로 제한

X-Content-Type-Options: nosniff, X-Frame-Options: DENY, Referrer-Policy: strict-origin

특히

server_tokens off;는 설정 한 줄이면 되지만, 빠뜨리는 사람이 많다. 공격자가 Nginx 버전을 알면 해당 버전의 알려진 취약점을 노릴 수 있다.

기본 설정으로도 잘 돌아가지만, 트래픽이 늘면 튜닝이 필요하다.

worker_processes와 worker_connections의 곱이 이론적 최대 동시 연결 수다. 4코어 서버에서 worker_connections 4096이면 최대 16,384개의 동시 연결을 처리할 수 있다.

아니다. Vercel, Netlify 같은 플랫폼을 사용한다면 Nginx를 직접 다룰 일이 거의 없다. 이 플랫폼들은 내부적으로 Nginx(또는 유사한 프록시)를 이미 운영하고 있다. 하지만 VPS에 직접 배포하거나, 온프레미스 서버를 운영하거나, Docker/Kubernetes 환경을 구성한다면 Nginx 지식은 필수다.

가장 큰 차이점은 .htaccess 파일이 없다는 것이다. Apache에서 .htaccess로 처리하던 URL 리라이트, 인증, 리다이렉트 규칙을 모두 nginx.conf의 server/location 블록으로 옮겨야 한다. 이 과정을 도와주는 htaccess to nginx converter 도구들이 있다.

이 글을 쓰는 지금도, 이 페이지를 당신에게 전달하는 과정 어딘가에 Nginx(또는 그와 유사한 프록시)가 관여하고 있을 것이다. CDN 엣지 서버에서, Kubernetes Ingress에서, Docker 컨테이너 안에서 — Nginx는 묵묵히 일한다.

정리하면:

클라우드 서비스가 많은 것을 추상화해주지만, 그 추상화 아래에 있는 것을 이해하는 개발자와 그렇지 않은 개발자의 차이는 문제가 생겼을 때 드러난다. 502 에러가 떴을 때 "서버가 안 돼요"라고만 말하는 사람과, "Nginx 에러 로그에서 upstream connection refused가 뜨는데 백엔드 프로세스가 OOM으로 죽은 것 같다"고 말하는 사람의 차이.

Nginx는 20년 넘게 인터넷의 기반 인프라로 자리잡았고, 컨테이너와 마이크로서비스 시대에도 그 역할을 확장하고 있다. 한 러시아 개발자가 C10K 문제를 해결하려고 시작한 프로젝트가, 전 세계 웹의 3분의 1을 떠받치는 인프라가 된 것이다.

웹 서버의 교통 경찰, Nginx. 이제 당신도 이 보이지 않는 영웅이 하는 일을 안다.