Mixture of Experts 완전 해부: 1.8조 파라미터인데 왜 빠른가

GPT-4는 1.8조 파라미터지만 추론 시 222B만 활성화된다. 어떻게 가능한가? 1991년 MIT에서 시작된 '전문가 혼합' 아이디어가 34년 뒤 모든 프론티어 AI 모델의 핵심 아키텍처가 되기까지 — Expert의 정체, 라우팅의 작동 원리, 실전 사례와 논란까지 완전 해부한다.

GPT-4는 1.8조 파라미터지만 추론 시 222B만 활성화된다. 어떻게 가능한가? 1991년 MIT에서 시작된 '전문가 혼합' 아이디어가 34년 뒤 모든 프론티어 AI 모델의 핵심 아키텍처가 되기까지 — Expert의 정체, 라우팅의 작동 원리, 실전 사례와 논란까지 완전 해부한다.

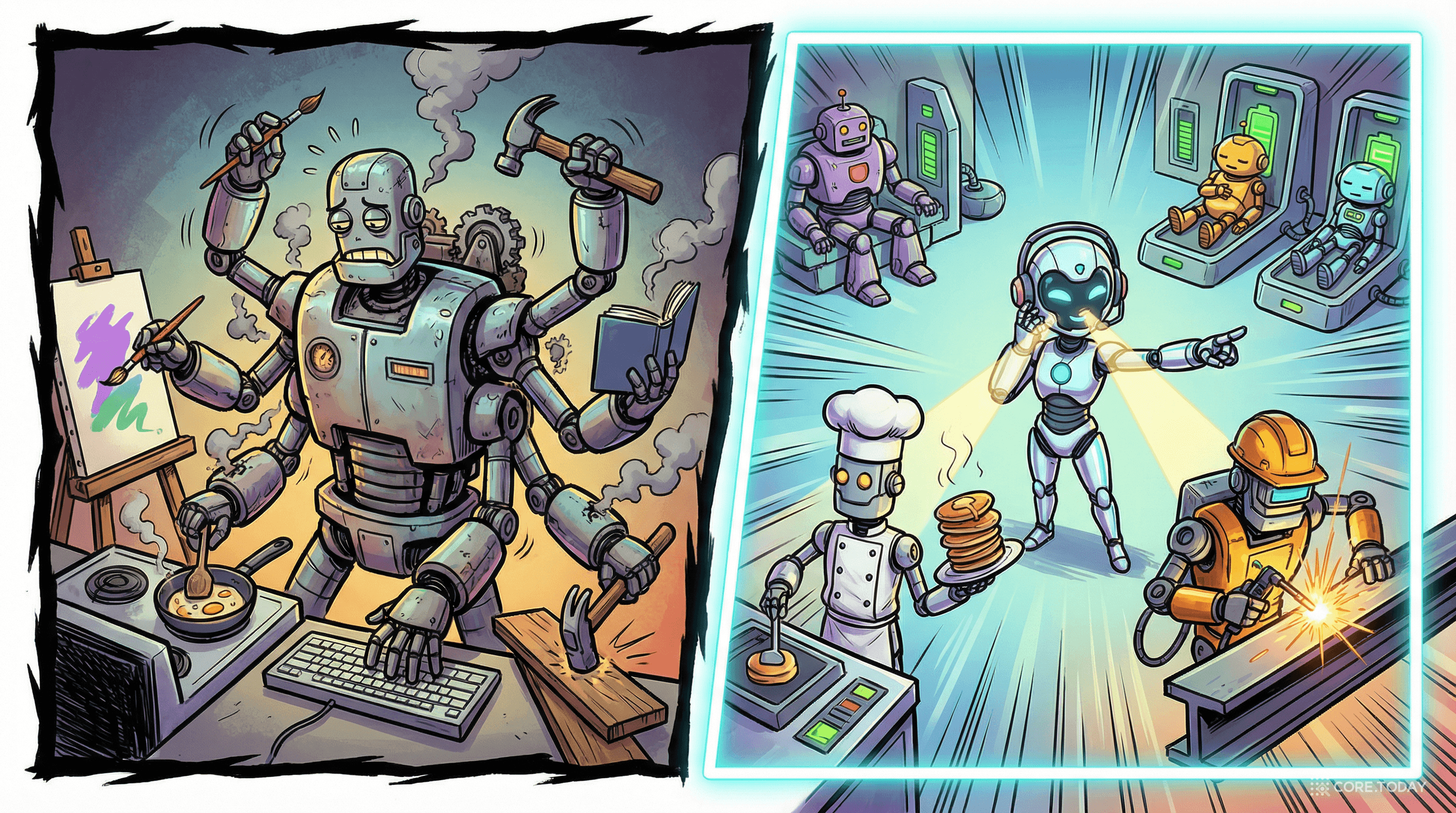

종합병원에 간다고 상상해 보자. 접수처에서 증상을 말하면, 접수 담당자가 적절한 전문의에게 안내한다. 두통이면 신경과, 흉통이면 심장내과. 병원에 100명의 의사가 있지만, 환자 한 명을 보는 의사는 1~2명이다.

이것이 바로 Mixture of Experts(MoE) 의 핵심 아이디어다.

전통적 신경망(Dense 모델)은 모든 뉴런이 모든 입력을 처리한다. 마치 모든 의사가 모든 환자를 동시에 진찰하는 것과 같다 — 비효율의 극치.

MoE는 다르다. 여러 개의 "전문가(Expert)" 네트워크를 두고, 라우터(Router) 가 각 입력을 가장 적합한 소수의 전문가에게만 보낸다. 나머지 전문가는 쉬고 있다. 전체 모델은 거대하지만, 실제로 작동하는 부분은 작다.

GPT-4가 1.8조 파라미터라는 소문이 있다. 그런데 추론 시에는 222B만 활성화된다. 70B 모델보다 훨씬 뛰어난 성능을, 70B 수준의 추론 비용으로 달성한다. 이것이 MoE의 마법이다.

MoE에서 "Expert"라는 이름이 거창하게 들리지만, 실체는 놀랍도록 단순하다:

Expert = 그냥 피드포워드 신경망(FFN) 하나.

트랜스포머의 각 블록은 셀프 어텐션 + FFN으로 구성된다. Dense 모델에서는 FFN이 1개다. MoE에서는 이 FFN을 여러 개 복제하고, 각각을 "Expert"라 부르는 것이다. 어텐션 층은 그대로 공유한다.

| Dense 모델 | MoE 모델 |

|---|---|

| 모든 의사가 모든 환자를 본다 | 접수처(라우터) 가 전문의(Expert) 에게 배정 |

| 의사 1명이 모든 것을 안다 | 각 의사가 특정 분야를 잘한다 |

| 환자가 많으면 모든 의사가 바쁘다 | 담당 의사만 바쁘고, 나머지는 쉰다 |

| 병원 규모 = 진료 비용 | 병원 규모 ≠ 진료 비용 (일부만 가동) |

Mixtral 8x7B라는 이름 때문에 "7B 모델 8개를 합친 56B"라고 오해하기 쉽다. 아니다:

라우터는 놀랍도록 단순한 구조다 — 작은 선형 변환 + softmax:

G(x) = Softmax(x · W_g)

입력 토큰의 숨겨진 상태(hidden state) x에 가중치 행렬 W_g를 곱하면, 각 전문가에 대한 확률 점수가 나온다. 가장 높은 점수의 전문가 k개를 선택한다.

| 방식 | 모델 예시 | 장점 | 단점 |

|---|---|---|---|

| Top-1 | Switch Transformer | 계산·통신 비용 최소 | 전문가 하나에 의존 |

| Top-2 | Mixtral, GPT-4, DeepSeek | 더 풍부한 표현 | 2배 계산 |

| Top-9 | DeepSeek-V3 (256개 중 9개) | 초미세 전문가 조합 | 라우팅 복잡 |

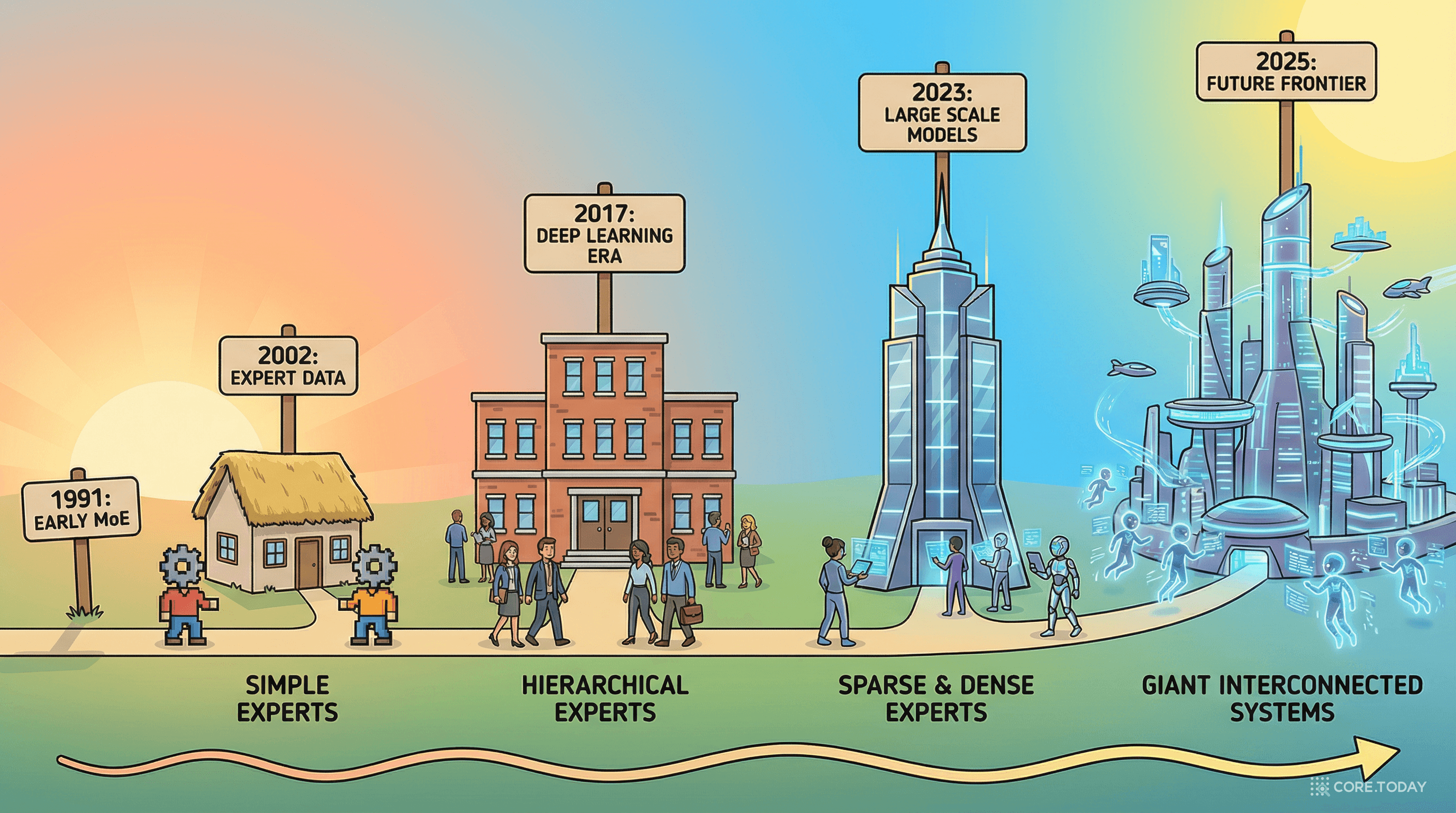

1994년에는 조던과 제이콥스가 이를 트리 구조의 계층적 MoE(Hierarchical MoE) 로 확장했다.

하지만 1991년의 하드웨어로는 대규모 MoE를 실행할 수 없었다. 이 아이디어는 26년간 잠들어 있었다.

논문 제목이 "Outrageously Large(터무니없이 거대한)"인 이유: 2017년에 1,370억 파라미터는 정말 터무니없는 규모였다. 그것을 실용적으로 만든 것이 희소 라우팅이었다.

페두스, 조프, 샤지어(Google, 2021) 의 Switch Transformer는 라우팅을 Top-k에서 Top-1으로 단순화했다. 토큰 하나가 전문가 하나에만 간다.

결과: 1.6조 파라미터 모델(2,048개 전문가), T5-Base 대비 7배 빠른 사전학습.

| 속성 | Dense 70B | MoE 8x7B (Mixtral) |

|---|---|---|

| 총 파라미터 | 70B | 46.7B |

| 활성 파라미터 | 70B (전부) | 12.9B (2/8) |

| 추론 FLOP | 높음 | 낮음 (Dense의 ~18%) |

| VRAM 필요 | ~140 GB | ~93 GB (전체 로드 필요) |

| 성능 | 기준 | 비슷하거나 우수 |

| 추론 속도 | 기준 | ~6배 빠름 |

Mixtral 8x7B가 Llama 2 70B를 대부분의 벤치마크에서 능가하면서, 추론은 6배 빠르다 — 이것이 MoE의 실전적 가치다.

MoE의 가장 위험한 실패 모드: 라우터가 소수의 전문가에게만 토큰을 몰아보내는 것.

이것은 "부익부 빈익빈"의 전형이다. 한번 시작되면 자기 강화적이어서 복구가 어렵다.

| 시기 | 방법 | 아이디어 | 한계 |

|---|---|---|---|

| 2017 | 노이지 게이팅 (Shazeer) | softmax 전에 가우시안 노이즈 추가 | 노이즈 크기 튜닝 어려움 |

| 2021 | 보조 손실 (Switch Transformer) | 부하 균형을 위한 추가 손실 항 | 품질 vs 균형 트레이드오프 |

| 2022 | Router Z-loss (ST-MoE) | softmax 로짓 크기 제한 | 여전히 손실 간섭 존재 |

| 2024 | 보조 손실 없는 균형 (DeepSeek-V3) | 라우팅에 바이어스 항 추가, 역전파에 미포함 | 최초의 품질 무손실 균형 |

DeepSeek-V3의 혁신은 결정적이었다. 과부하된 전문가의 바이어스를 낮추고, 한가한 전문가의 바이어스를 높여 — 기울기 계산에는 영향을 주지 않으면서 라우팅만 조정한다. 품질과 균형의 트레이드오프를 최초로 해소했다.

Mistral AI가 2023년 12월 공개한 Mixtral 8x7B는 MoE의 실전적 가치를 처음으로 대중에게 증명했다:

이후 수천 개의 커뮤니티 파인튜닝 모델이 Hugging Face에 등장했다. MoE가 "프론티어 랩만의 기술"에서 "누구나 쓸 수 있는 기술" 로 전환된 순간이었다.

DeepSeek이 671B/37B active 모델을 $560만에 학습했다고 발표하면서 업계가 충격에 빠졌다.

DeepSeek-V3의 기술적 혁신은 진짜였다:

Meta가 2025년 4월 Llama 4를 출시하며 발생한 논란은 MoE 모델 평가의 어려움을 보여주었다.

DeepSeek은 MoE 아키텍처에 두 가지 결정적 혁신을 도입했다:

기존: 8개의 큰 전문가 중 2개 선택 → 조합 수 = C(8,2) = 28가지

DeepSeek: 256개의 작은 전문가 중 9개 선택 → 조합 수 = C(256,9) = 약 140조 가지

더 많은 작은 전문가로 더 유연한 조합이 가능해져, 입력마다 정밀하게 최적화된 전문가 조합을 구성한다.

공유 전문가가 공통 지식을 담당하므로, 라우팅 전문가들 사이의 중복이 줄어든다. 각 라우팅 전문가가 더 뚜렷한 전문성을 갖게 된다.

| 모델 | 연도 | 전문가 수 |

|---|---|---|

| Mixtral | 2023 | 8 |

| DBRX | 2024 | 16 |

| Llama 4 Scout | 2025 | 16 |

| Llama 4 Maverick | 2025 | 128 |

| DeepSeek-V3 | 2024 | 256 + 1 shared |

더 많은 작은 전문가 → 더 정밀한 라우팅 → 더 효율적 계산. 연구는 "지수적 표현력 분리"가 세분화와 함께 증가함을 보였다.

SwitchHead (Csordás et al., NeurIPS 2024): FFN뿐 아니라 어텐션 헤드에도 MoE를 적용. 어텐션 행렬을 최대 8배 적게 계산하면서 기준 성능 유지. "SwitchAll"은 FFN + 어텐션 모두 MoE로 — 완전 MoE 트랜스포머의 시작.

2025년 현재, 모든 프론티어 랩이 MoE를 출시했다:

MoE는 더 이상 "대안 아키텍처"가 아니다. 기본 아키텍처가 되었다.

1991년, MIT의 로버트 제이콥스와 마이클 조던은 간단한 관찰에서 출발했다: 하나의 네트워크가 모든 것을 배우는 것보다, 여러 전문가가 각자의 분야를 맡는 것이 효율적이다.

34년이 지난 2025년, 이 아이디어는 인류가 만든 가장 강력한 AI 모델들의 핵심이 되었다. GPT-4의 1.8조 파라미터가 70B 수준의 비용으로 작동하고, DeepSeek-V3의 671B가 37B의 계산으로 추론하고, Mixtral이 1/6의 비용으로 70B 모델을 능가하는 것 — 이 모든 것이 MoE 덕분이다.

MoE가 가르쳐 주는 교훈은 인간 사회의 원리와 동일하다:

모든 것을 아는 한 명의 제너럴리스트보다, 각자의 전문성을 가진 팀이 더 강하다. 단, 누가 어떤 일을 맡을지 잘 정하는 코디네이터가 있어야 한다.

종합병원의 접수처처럼, MoE의 라우터는 각 환자(토큰)를 적절한 전문의(Expert)에게 안내한다. 그리고 대부분의 전문의는 쉬고 있다 — 이것이 효율의 비밀이다.