LLM은 문서를 읽고도 얼마나 거짓말할까? 1,720억 토큰 대실험의 충격적 결과

35개 오픈소스 LLM에 1,720억 토큰을 먹여 문서 Q&A 환각률을 측정한 사상 최대 규모 연구. 최고의 모델도 1.19%는 거짓말하고, 컨텍스트가 길어지면 환각이 3배로 뛰며, Temperature 0이 반드시 최선은 아닌 — 놀라운 발견들을 정리한다.

35개 오픈소스 LLM에 1,720억 토큰을 먹여 문서 Q&A 환각률을 측정한 사상 최대 규모 연구. 최고의 모델도 1.19%는 거짓말하고, 컨텍스트가 길어지면 환각이 3배로 뛰며, Temperature 0이 반드시 최선은 아닌 — 놀라운 발견들을 정리한다.

2025년 말, 대형 로펌 Baker McKenzie의 AI 시스템이 계약 검토 중 존재하지 않는 조항을 인용하는 사고가 발생했다. 문서를 "읽고" 답하는 RAG(검색 증강 생성) 파이프라인이었는데, AI는 문서에 없는 면책 조항을 자신 있게 만들어냈다. 이것이 바로 문서 기반 Q&A에서의 환각(hallucination) 문제다.

"문서를 줬으니 그 안에서만 답하겠지"라는 가정은 위험하다. 2026년, JV Roig가 발표한 논문 "How Much Do LLMs Hallucinate in Document Q&A Scenarios?"는 이 질문에 대해 역대 최대 규모의 실증 연구를 수행했다. 35개 오픈소스 모델, 3가지 컨텍스트 길이(32K, 128K, 200K), 4가지 Temperature 설정, 3개 하드웨어 플랫폼(NVIDIA H200, AMD MI300X, Intel Gaudi3)에 걸쳐 총 1,720억 토큰 — 이전 연구의 8배 규모다.

결과는 충격적이다. 이 글에서 그 발견들을 하나하나 풀어본다.

LLM 환각(hallucination)이란, 모델이 사실에 기반하지 않은 내용을 자신 있게 생성하는 현상이다. 2023년 뉴욕 변호사 Steven Schwartz가 ChatGPT가 지어낸 가짜 판례를 법원에 제출한 사건은 유명하다. 하지만 문서 Q&A에서의 환각은 더 교묘하다 — AI에게 "이 문서를 읽고 답해"라고 했는데, 문서에 없는 내용을 만들어내기 때문이다.

기존 환각 측정 방법들은 각각 심각한 한계를 가지고 있었다:

| 벤치마크 | 측정 대상 | 한계 | 오염 위험 |

|---|---|---|---|

| TruthfulQA | 일반 사실성 | 정적 데이터셋, 짧은 답변 | 높음 |

| SimpleQA | 단문 사실 확인 | 짧은 형식만 지원 | 높음 |

| FActScore | 원자적 사실 분해 | LLM-Judge 의존 | 중간 |

| Needle-in-a-Haystack | 긴 컨텍스트 검색 | 검색만 테스트, 이해력 X | 낮음 |

| RULER | 멀티홉 추론 | 날조 테스트 없음 | 낮음 |

| RIKER (본 논문) | 문서 Q&A 전체 | 영어만, 오픈소스만 | 불가능 (동적 생성) |

"기존 벤치마크는 대부분 그라운딩(문서에서 정보 찾기)만 테스트한다. 이것은 위험할 정도로 불완전하다." — 논문 Section 6.2

기존 벤치마크는 "문서를 먼저 준비하고 → 거기서 질문과 정답을 추출하는" 방식이다. 이 과정에서 인간 어노테이션이나 LLM 판정이 필요하고, 이것이 편향의 원인이 된다.

RIKER는 완전히 반대로 간다:

핵심 혁신: 정답을 먼저 만들고, 그 정답이 포함된 문서를 나중에 생성한다. 이렇게 하면:

RIKER의 질문은 3개 범주, 12개 난이도로 구성된다:

이전 RIKER 연구(2025)는 33개 모델, 210억 토큰이었다. 이번에는 8배 확장했다:

| 컨텍스트 길이 | 모델 수 | 총 실행 횟수 | 총 토큰 수 |

|---|---|---|---|

| 32K | 35 | 1,856 | 181.6억 |

| 128K | 26 | 1,480 | 725억 |

| 200K | 11 | 928 | 810.9억 |

| 합계 | 35 | 4,264 | 1,717.6억 |

각 구성별로 4가지 Temperature(0.0, 0.4, 0.7, 1.0) × 8회 반복 실행. 3개 하드웨어 플랫폼에서 교차 검증. 모든 모델은 vLLM으로 서빙.

| 패밀리 | 모델 | 파라미터 |

|---|---|---|

| GLM | 4.5, 4.5 Air, 4.6, 4.7 | 비공개 |

| Qwen | 2.5 (7B~72B), Qwen3 (4B~480B) | 4B ~ 480B |

| Llama | 3.1 (8B~405B), 3.2, 3.3, 4 Scout/Maverick | 1B ~ 405B |

| DeepSeek | V3, V3.1 | 685B (MoE) |

| MiniMax | M2, M2.1 | 비공개 |

| Granite | 4.0 H (Tiny, Micro, Small) | 소형 |

32K 컨텍스트에서 가장 뛰어난 모델도 1.19%의 날조율을 보였다. 35개 모델 중 날조율 10% 미만은 7개뿐이었고, 5% 미만은 단 2개(GLM 4.5, GLM 4.5 Air)뿐이었다.

이것이 의미하는 바: 문서 기반 Q&A 100건 중 최소 1~2건은 AI가 지어낸 답이다. 의료, 법률, 금융 분야에서 이 1%는 치명적일 수 있다.

종합 정확도 범위가 72 퍼센트포인트(24.80% ~ 97.40%)에 달했다. 모델 선택이 Temperature, 컨텍스트 길이, 하드웨어를 합친 것보다 압도적으로 중요하다.

더 흥미로운 발견: 모델 크기보다 모델 패밀리가 날조 저항성을 더 잘 예측한다.

| 모델 | 파라미터 | 종합 정확도 | 날조율 |

|---|---|---|---|

| Qwen3 Next 80B-A3B | 3B 활성 | 93.87% | 7.04% |

| Llama 3.1 405B | 405B | 83.10% | 26.51% |

활성 파라미터 3B인 Qwen3 Next가 405B Llama를 10pp 이상 앞섰다. 크기가 능사가 아니다.

모든 모델이 128K에서 성능이 떨어졌다. 중앙값 손실 10.4pp, 평균 12.4pp.

200K 컨텍스트에서는 두 가지 극단적 패턴이 나타났다:

| 패턴 | 우아한 저하 (Graceful) | 재앙적 붕괴 (Catastrophic) |

|---|---|---|

| 대표 모델 | Qwen3 Next 80B-A3B | GLM 4.6 |

| 32K 정확도 | 93.87% | 93.26% |

| 200K 정확도 | 82.68% (-11.19pp) | 37.65% (-55.61pp) |

| 32K 날조율 | 7.04% | 7.04% |

| 200K 날조율 | 10.25% | 71.62% (10배 폭증) |

두 모델은 32K에서 거의 동일한 성능이었다. 그런데 200K에서 하나는 견디고, 하나는 무너졌다. 광고된 컨텍스트 윈도우 크기 ≠ 실제 사용 가능한 용량이라는 중요한 교훈이다.

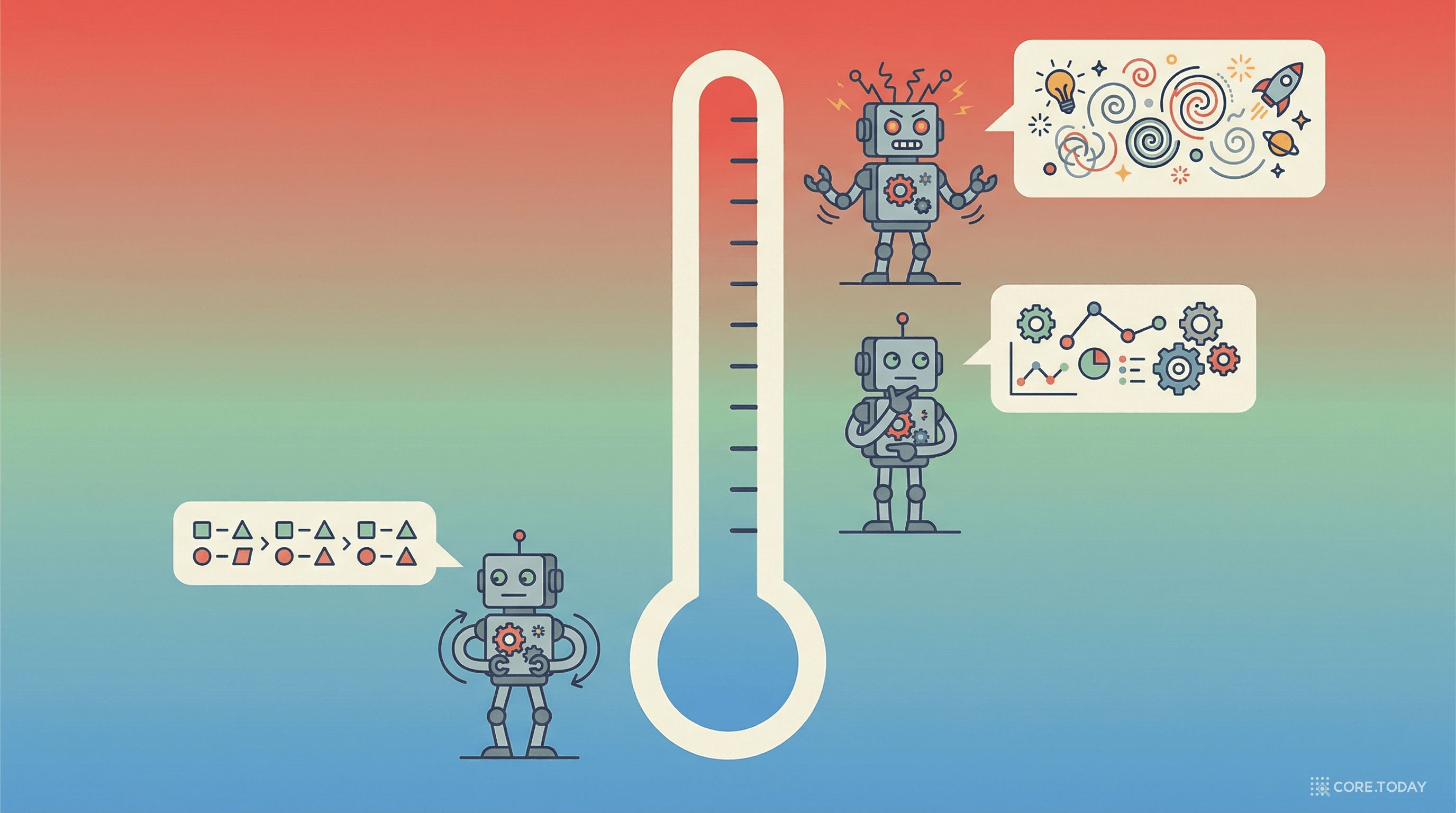

많은 기업이 프로덕션에서 Temperature=0.0을 사용한다. "랜덤성을 없애면 더 정확하겠지"라는 직관 때문이다. 이 논문은 그 통념에 강력한 반증을 제시한다.

| 지표 | T=0.0이 최선인 비율 | 더 높은 T가 나은 비율 |

|---|---|---|

| 종합 정확도 | ~60% | ~40% |

| 그라운딩 | 47% | 53% |

| 날조율 | 47% | 53% (높은 T가 더 낮은 날조) |

가장 놀라운 발견 중 하나다. T=0.0은 무한 반복 생성(coherence loss)을 극적으로 증가시킨다. 모델이 같은 패턴을 끝없이 반복하면서 의미 있는 답을 생성하지 못하는 현상이다.

GLM 4.7의 경우, 200K 컨텍스트에서 T=0.0은 T=1.0 대비 48배 높은 무한 생성률을 보였다 (2.59% vs 0.05%). 이는 거의 단조적(monotonic) 관계: T=0.0 >> T=0.4 >> T=0.7 >> T=1.0.

실무 권장사항: T=0.0 대신 T=0.4 또는 T=0.7이 정확도-날조율-안정성의 균형점으로 더 나을 수 있다.

이것이 논문의 가장 중요한 발견이라고 할 수 있다.

"문서에서 정보를 잘 찾는 모델은 없는 정보를 지어내지도 않을 것이다"라는 가정은 틀렸다. 두 능력은 약하게만 상관되어 있다.

| 모델 | 그라운딩 (%) | 날조율 (%) | Gap (편차) | 평가 |

|---|---|---|---|---|

| GLM 4.5 | 98.86% | 1.19% | -1.1 | 잘 교정됨 |

| MiniMax M2.1 | 97.73% | 5.26% | +3.3 | 잘 교정됨 |

| DeepSeek V3.1 | 97.04% | 6.35% | +3.6 | 잘 교정됨 |

| GLM 4.5 Air | 91.47% | 3.37% | -5.2 | 보수적 (과소 답변) |

| Llama 3.1 405B | 95.08% | 26.51% | +21.6 | 검색 강하나 날조 심각 |

| Llama 3.1 70B | 90.18% | 49.50% | +39.7 | 검색 강하나 날조 극심 |

가장 극적인 비교: GLM 4.5 Air와 Llama 3.1 70B는 그라운딩이 거의 동일하다 (91.47% vs 90.18%). 하지만 날조율은 3.37% vs 49.50% — 46 퍼센트포인트 차이다.

Llama 3.1 70B는 문서에서 정보를 90% 이상 정확하게 찾아내면서도, 존재하지 않는 엔티티에 대해 물으면 절반 가량을 지어낸다. 이것은 마치 도서관 사서가 책을 잘 찾아주지만, 없는 책에 대해 물으면 가짜 ISBN까지 만들어내는 것과 같다.

"Llama 3.1 70B는 90% 이상의 그라운딩 정확도를 달성하면서도, 존재하지 않는 엔티티에 대한 질문의 거의 절반에 답을 날조했다." — 논문 Section 6.2

Gap = 그라운딩 + 날조율 - 100

3개 플랫폼(NVIDIA H200, AMD MI300X, Intel Gaudi3) 간 정확도 차이는 평균 0.58 퍼센트포인트에 불과했다. Temperature 변동(평균 1.28pp)의 절반도 안 된다.

결론: GPU 선택은 비용과 가용성으로 결정하면 된다. 정확도는 하드웨어에 의존하지 않는다. 이는 특히 AMD나 Intel 하드웨어를 고려하는 기업에 좋은 소식이다.

아래에서 35개 모델의 성능을 직접 탐색해보세요. 컨텍스트 길이, 정렬 기준, 모델 패밀리를 바꿔가며 데이터를 확인할 수 있습니다.

논문의 결론을 실무에 적용하면 다음과 같은 우선순위가 나온다:

AI 환각 문제는 2022년 ChatGPT 출시 이후 본격적으로 부각되었다. 4년간 업계는 RAG, CoVe(Chain-of-Verification), 시맨틱 그라운딩 등 다양한 대응 기법을 발전시켜 왔다. 하지만 이 논문이 보여주는 것은 명확하다: 근본적 해결은 아직 멀었다.

1,720억 토큰의 데이터가 말해주는 메시지는 분명하다:

AI가 "이 문서에 따르면..."이라고 시작하는 답변을 할 때, 그 답이 정말 문서에 있는지 확인해야 한다. 특히 엔터프라이즈 환경에서는 신뢰하되, 반드시 검증하라(Trust, but verify)는 원칙이 그 어느 때보다 중요하다.

논문 원문: arXiv:2603.08274 — JV Roig, "How Much Do LLMs Hallucinate in Document Q&A Scenarios? A 172-Billion-Token Study Across Temperatures, Context Lengths, and Hardware Platforms"

이 글은 코어닷투데이의 AI 기술 특집 시리즈입니다. 최신 AI 연구를 실무자 관점에서 해석하고, 기업이 AI를 안전하게 활용할 수 있도록 돕습니다.