Giveme5W1H — AI가 뉴스를 읽는 법: 육하원칙으로 해체하는 기사 분석의 모든 것

기자가 기사를 쓸 때 반드시 답하는 육하원칙(누가, 무엇을, 언제, 어디서, 왜, 어떻게) — 이걸 AI가 자동으로 추출할 수 있을까? 2019년 독일 콘스탄츠 대학 연구팀이 만든 Giveme5W1H 시스템의 원리부터 2026년 LLM 시대의 의미까지, 뉴스 이벤트 추출의 세계를 완전 해부한다.

기자가 기사를 쓸 때 반드시 답하는 육하원칙(누가, 무엇을, 언제, 어디서, 왜, 어떻게) — 이걸 AI가 자동으로 추출할 수 있을까? 2019년 독일 콘스탄츠 대학 연구팀이 만든 Giveme5W1H 시스템의 원리부터 2026년 LLM 시대의 의미까지, 뉴스 이벤트 추출의 세계를 완전 해부한다.

아침에 스마트폰을 열면 수십 개의 뉴스가 쏟아진다. 우리는 무의식적으로 각 기사에서 핵심 정보를 추출한다:

"아, 미국 대통령이(누가) 관세를 인상했구나(무엇을), 어제(언제) 워싱턴에서(어디서) 무역 적자 때문에(왜) 행정명령을 통해서(어떻게)."

이 과정은 너무 자연스러워서 의식하지 못하지만, 사실 인간의 뇌는 매 기사마다 여섯 가지 질문에 답하고 있다. 저널리즘에서는 이것을 육하원칙(5W1H) — Who, What, When, Where, Why, How — 이라고 부른다.

그런데 하루에 생산되는 뉴스가 수십만 건이라면 어떨까? 인간이 일일이 읽을 수 없다. 그래서 연구자들은 오래전부터 물었다:

"컴퓨터가 뉴스 기사를 읽고, 육하원칙에 자동으로 답할 수 있을까?"

2019년, 독일 콘스탄츠(Konstanz) 대학의 Felix Hamborg 연구팀이 이 질문에 대한 최초의 범용적이고 오픈소스인 답을 내놓았다. 그 이름은 Giveme5W1H.

이 글에서는 논문 "Giveme5W1H: A Universal System for Extracting Main Events from News Articles"를 중심으로, 왜 이런 시스템이 필요한지, 어떻게 작동하는지, 그리고 2026년 LLM 시대에 이 기술이 어떤 의미를 갖는지를 자세히, 쉽고, 재밌게 풀어본다.

육하원칙의 역사는 놀라울 정도로 오래됐다. 기원전 1세기, 로마의 수사학자 헤르마고라스(Hermagoras of Temnos)는 연설을 구성할 때 반드시 답해야 할 질문들을 정리했다:

Quis, quid, quando, ubi, cur, quem ad modum, quibus adminiculis (누가, 무엇을, 언제, 어디서, 왜, 어떻게, 무엇으로)

이 일곱 가지 질문은 중세를 거치며 저널리즘의 핵심 원칙으로 자리 잡았다. 19세기 미국 신문 산업이 폭발적으로 성장하면서, "좋은 기사의 첫 문단(리드)은 반드시 5W1H에 답해야 한다"는 것이 기자 교육의 기본이 되었다.

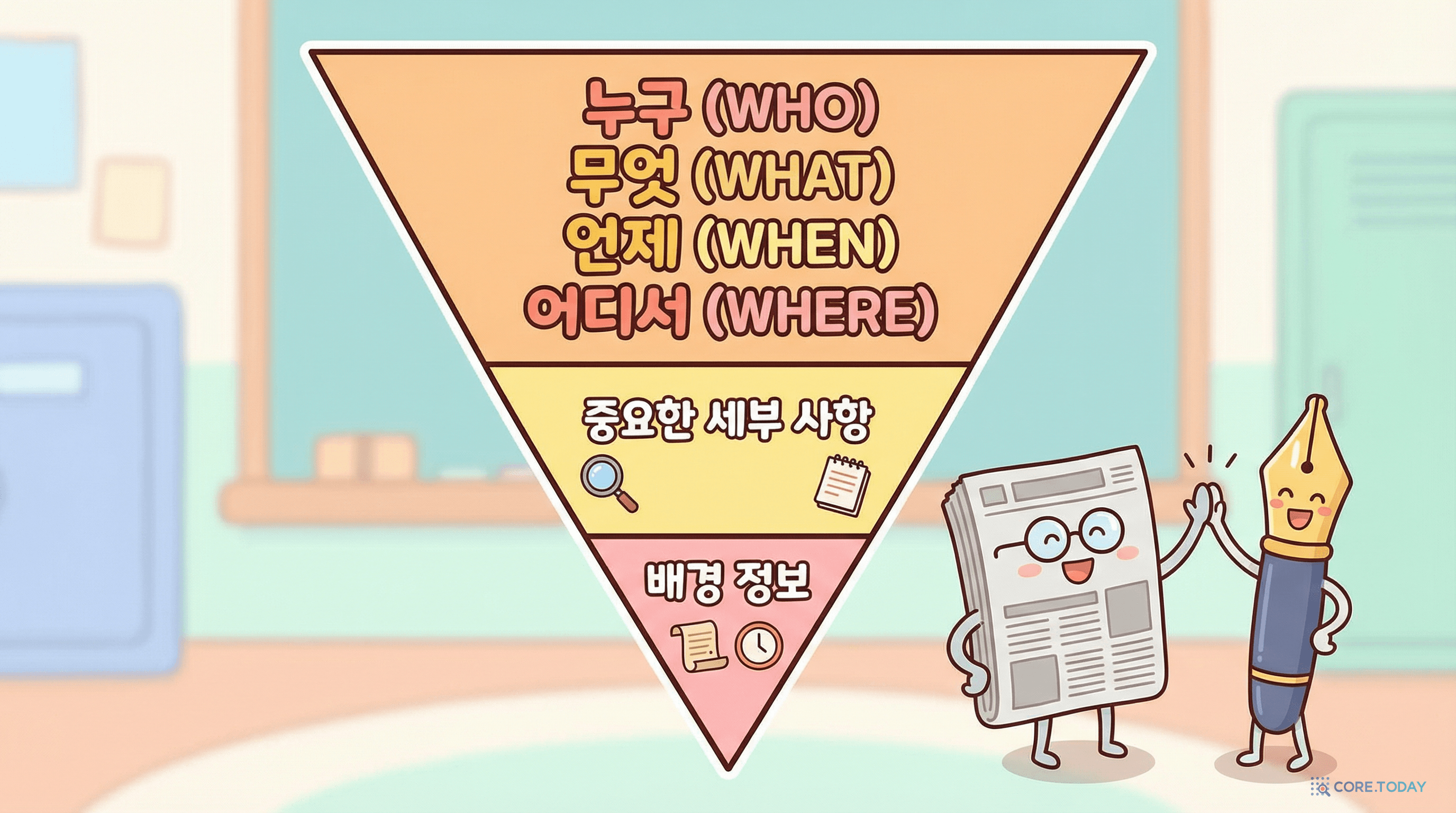

뉴스 기사는 역피라미드(Inverted Pyramid) 구조를 따른다. 가장 중요한 정보가 기사의 맨 위(헤드라인과 리드 문단)에 오고, 아래로 갈수록 부가 정보와 배경이 나온다. 이 구조가 중요한 이유는:

이렇게 2,000년 넘게 이어진 프레임워크가 이제 기계가 뉴스를 이해하는 언어가 되려 하고 있다.

2016년 11월, 아프가니스탄 마자르이샤리프에서 탈레반이 독일 영사관을 공격했다. 이 사건 하나를 두고 수십 개 언론사가 각자의 기사를 쏟아냈다. Reuters, AP, BBC, Al Jazeera, 현지 언론까지.

뉴스 집계 서비스(Google News, Naver News 등)는 이 기사들을 같은 사건에 대한 기사로 묶어야 한다. 어떻게? 각 기사에서 누가(탈레반), 무엇을(공격), 언제(2016-11-10), 어디서(마자르이샤리프)를 추출해서 비교하면 된다.

같은 사건이라도 언론사마다 다르게 프레이밍한다:

| 질문 | A 언론사 | B 언론사 |

|---|---|---|

| Who | "무장 세력" | "탈레반 테러리스트" |

| What | "건물 손상" | "치명적 자살 폭탄 공격" |

| Why | "지역 불안정" | "서방 세력에 대한 보복" |

5W1H 추출을 자동화하면, 같은 사건에 대해 언론사마다 어떻게 다르게 표현하는지 대규모로 분석할 수 있다. Hamborg 연구팀이 바로 이런 미디어 편향(media bias) 연구를 위해 이 시스템을 만들었다.

지진, 홍수, 테러 등 재난 발생 시 실시간으로 쏟아지는 뉴스에서 "어디서, 언제, 어떤 규모로" 발생했는지 자동 추출하면, 구호 기관이 더 빠르게 대응할 수 있다.

Giveme5W1H 논문이 지적한 기존 연구의 세 가지 한계를 정리하면 이렇다:

특히, 당시(2019년) 최고 성능을 보인 Yaman et al. (2009)의 시스템은 4W 정밀도 를 달성했지만, 10년이 넘은 비공개 시스템이었고, 평가 방법도 달라 직접 비교가 어려웠다.

논문의 저자들은 이 세 가지 한계를 동시에 해결하려 했다:

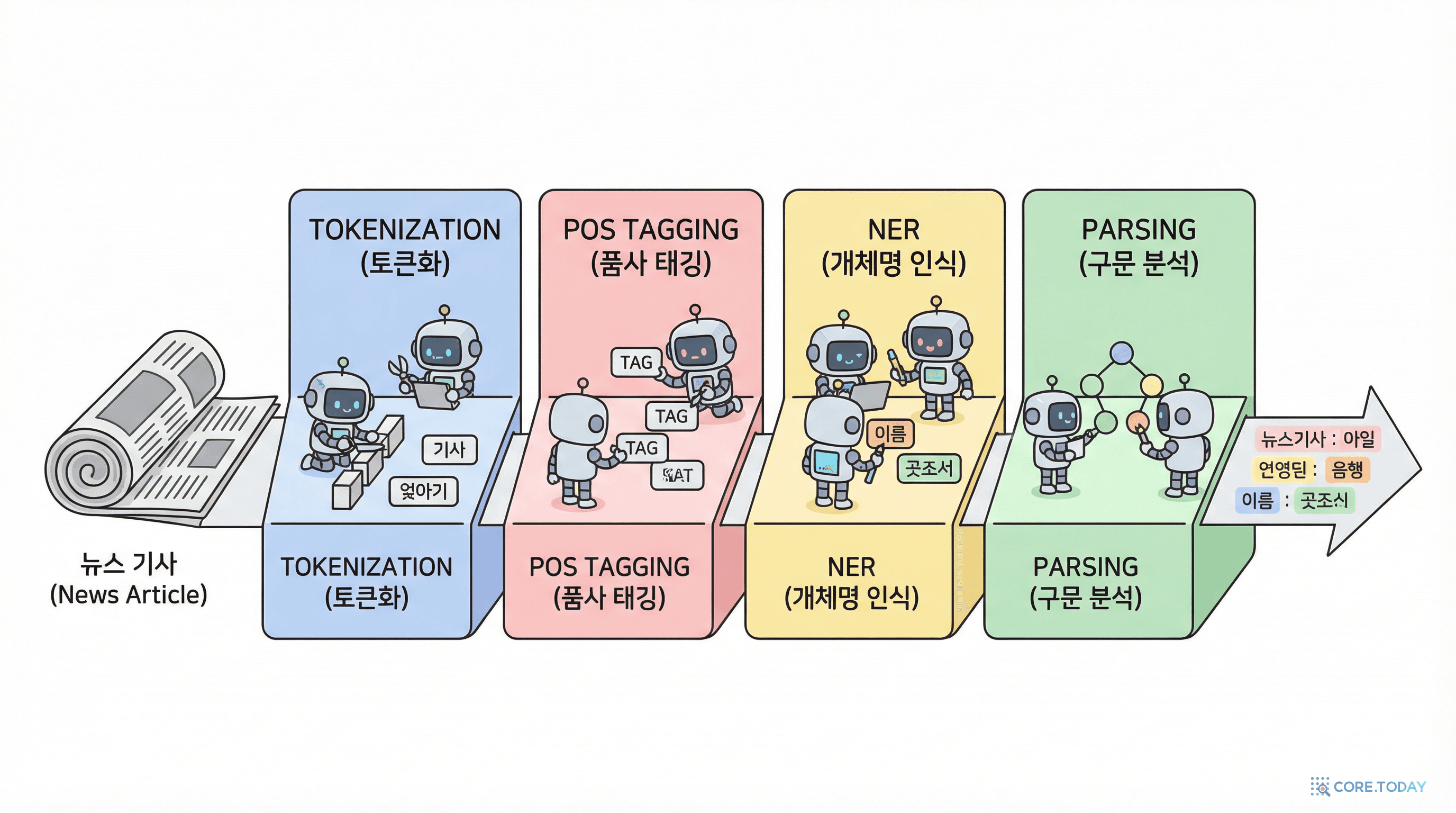

Giveme5W1H 시스템은 세 단계로 뉴스 기사를 분석한다. 마치 숙련된 편집자가 기사를 읽는 과정을 기계적으로 모방한 것이다.

원시 텍스트가 들어오면, Stanford CoreNLP를 사용해 다음 작업을 순차적으로 수행한다. 마치 작은 로봇 팀이 각자의 역할을 맡아 텍스트를 분석하는 것과 같다:

여기서 특히 중요한 것이 상호참조 해결(Coreference Resolution)이다. 예를 들어:

"그는"이 "바이든 대통령"을 가리킨다는 것을 컴퓨터가 이해해야 Who 질문에 정확히 답할 수 있다.

전처리 후, 추출된 개체(entity)를 표준 형태(canonical form)로 변환한다. 논문에서는 세 가지 정규화를 수행한다:

| 유형 | 도구 | 변환 예시 |

|---|---|---|

| 시간 | SUTime → TIMEX3 | "어제 오후 1시" → 2016-11-10T13:00 |

| 장소 | Nominatim (OpenStreetMap) | "Mazar-i-Sharif" → 36.7°N, 67.1°E |

| 인물/조직 | AIDA → YAGO 지식그래프 | "트럼프" → YAGO:Donald_Trump |

이 정규화가 왜 중요한가? "yesterday", "last night", "the previous day"는 모두 같은 날짜를 가리킬 수 있다. 정규화를 통해 다른 표현이지만 같은 의미인 것들을 통일한다.

Phase 2에서는 네 개의 독립적인 추출기가 각각 후보 문구를 추출한다:

각 추출기가 어떻게 작동하는지 하나씩 살펴보자.

핵심 아이디어: 각 문장의 주어(Subject)가 Who 후보, 술어(Predicate)가 What 후보다.

구문 분석 트리(parse tree)에서 다음 규칙을 적용한다:

What 추출은 VP에서 수행하되, VP가 너무 길면 자식 NP 이후를 잘라낸다. 단, VP가 3개 이하의 토큰이면서 전치사구(PP)가 뒤따르면 잘라내지 않는다 — 정보가 너무 적어지는 것을 방지하기 위해서다.

이해를 돕기 위해 실제 예시를 보자:

"왜" 질문은 가장 어려운 추출 대상이다. Giveme5W1H는 세 가지 인과관계 지표를 찾는다:

예를 들어:

"The attack was carried out because of growing tensions in the region."

여기서 "because of" 다음에 오는 "growing tensions in the region"이 Why 후보가 된다.

How 추출은 두 가지 전략을 사용한다:

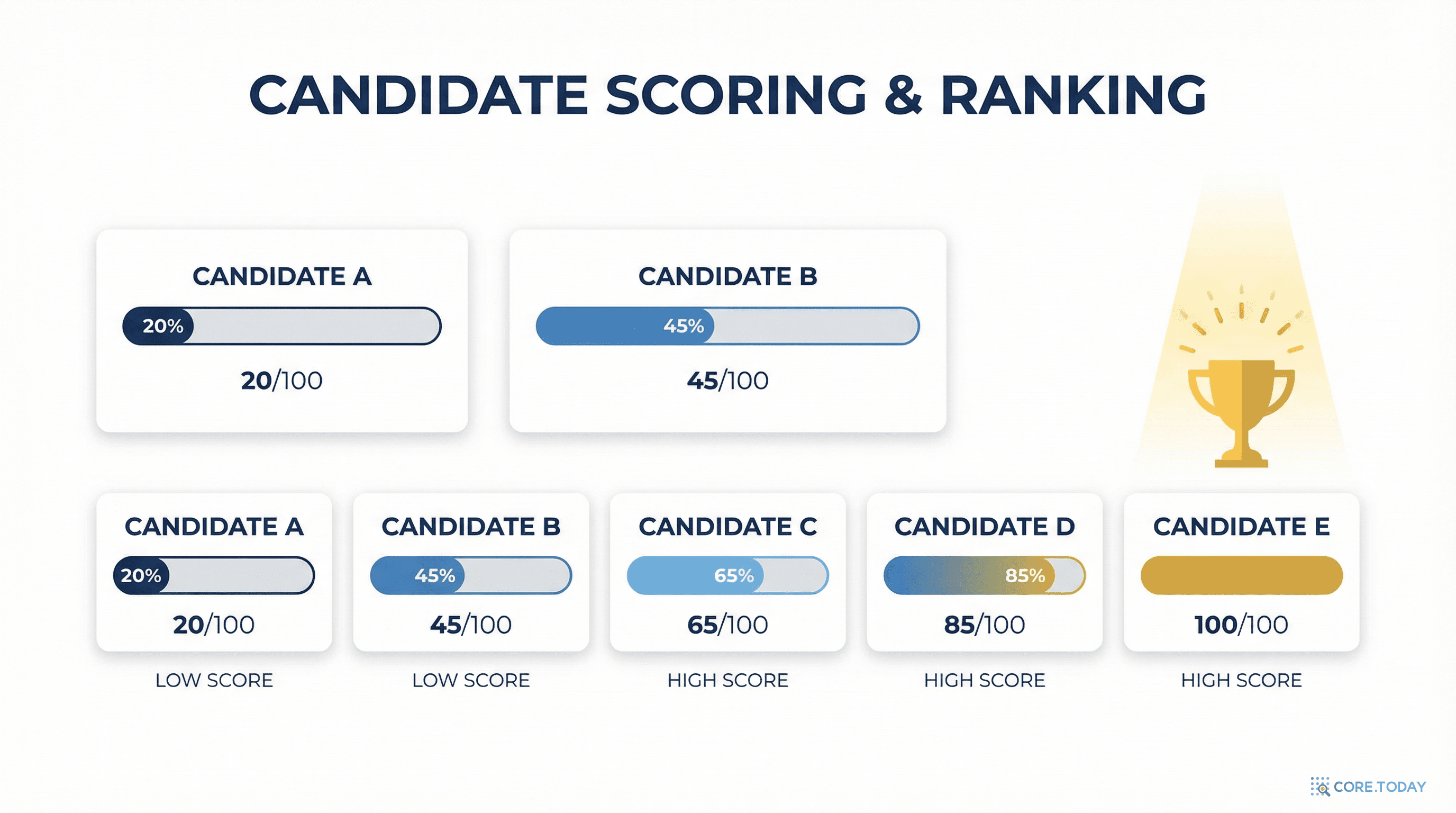

Phase 2에서 추출된 후보는 보통 여러 개다. 기사에서 "the Taliban"이 Who로 추출될 수도 있고, "Afghan security forces"가 추출될 수도 있다. 어떤 후보가 주요 이벤트를 가장 잘 설명하는가?

Giveme5W1H는 각 질문별로 가중치가 다른 점수화 함수를 사용한다:

여기서 는 질문 에 대한 후보 의 점수, 는 번째 점수화 인자의 가중치다.

각 질문별로 어떤 인자를 사용하는지 보자:

When은 네 가지 인자를 사용한다. 특히 흥미로운 것은 기사 발행일과의 근접성(closeness) 인자다:

발행일 근접성은 뉴스의 본질을 반영한다 — 뉴스는 최근에 일어난 일을 보도한다. "1990년대 냉전 시대"보다 "어제 오후"가 기사의 주요 이벤트 시점일 가능성이 훨씬 높다.

짧은 지속시간 인자는 "어제"(하루)가 "지난 10년간"보다 높은 점수를 받도록 한다. 이벤트는 특정 시점에 일어나기 때문이다.

지리적 포함관계(containment)가 흥미롭다. "마자르이샤리프"가 "아프가니스탄" 안에 포함되므로, 더 구체적인 "마자르이샤리프"가 높은 점수를 받는다. 구체성은 해당 장소의 면적으로 계산한다 — 225m²(작은 부지) ~ 530,000km²(국가 평균 면적) 범위에서 로그 정규화한다.

| 인자 | Why 가중치 | How 가중치 |

|---|---|---|

| 위치 | 0.56 | 0.23 |

| 인과/방법 유형 신뢰도 | 0.44 | 0.63 |

| 빈도 | - | 0.14 |

Why에서는 인과관계 유형의 신뢰도가 중요하다:

How에서는 방법 유형 신뢰도가 가장 높은 가중치(0.63)를 받는다.

마지막으로, 서로 다른 질문의 후보들 사이의 관계를 활용한다. "방법(how)"은 "행위(what)"와 같은 문장에 있을 가능성이 높다는 가정 하에:

방법 후보 와 행위 후보 사이의 문장 거리가 멀수록 점수를 감점한다. "어떻게 했는지"는 "무엇을 했는지"와 가까이 언급되기 마련이라는 직관을 수학적으로 표현한 것이다.

BBC 뉴스 데이터셋에서 120개 기사를 5개 카테고리(비즈니스, 엔터테인먼트, 정치, 스포츠, 기술)에서 추출하고, 3명의 평가자가 각 기사에서 추출된 5W1H 문구의 관련성을 3점 척도로 평가했다:

| 카테고리 | Who | What | When | Where | Why | How |

|---|---|---|---|---|---|---|

| 비즈니스 | 0.85 | 0.69 | 0.89 | 0.83 | 0.42 | 0.21 |

| 엔터테인먼트 | 0.89 | 0.70 | 0.93 | 0.79 | 0.29 | 0.40 |

| 정치 | 0.85 | 0.42 | 0.63 | 0.49 | 0.17 | 0.58 |

| 스포츠 | 0.47 | 0.38 | 0.58 | 0.45 | 0.13 | 0.53 |

| 기술 | 0.80 | 0.67 | 0.81 | 0.86 | 0.41 | 0.40 |

논문의 Figure 2에 제시된 시스템 아키텍처를 재구성하면 다음과 같다:

논문 저자들은 자체 어노테이션 데이터셋을 구축했다:

3명의 대학원생(IT 전공, 22-32세)이 독립적으로 각 기사의 5W1H 문구를 어노테이션했다. 평가자 간 일치도(inter-rater reliability)는 로, "거의 완전한 일치(almost perfect agreement)"에 해당한다.

불일치가 있을 경우 다음 규칙으로 조합했다:

60/40 비율로 학습/테스트 세트를 나누고, 텍스트 후보(Who, What, Why, How)에는 Word Mover's Distance(WMD) — 두 문구의 의미적 유사도를 측정하는 최신 기법 — 를, When에는 초 단위 차이를, Where에는 미터 단위 거리를 오차 함수로 사용했다.

5,000개의 최적 파라미터 구성 중 통계적으로 유의미한 차이가 없는 것들은 걸러내고, 최종적으로 각 질문별 최적 가중치를 선정했다.

논문에서 사용된 예시 기사를 통해 시스템의 작동을 직관적으로 살펴보자.

Giveme5W1H의 추출 결과:

| 질문 | 추출된 문구 | 정규화 결과 |

|---|---|---|

| Who | The Taliban | YAGO: Taliban |

| What | attacked the German consulate | — |

| When | on Friday night | 2016-11-10 (TIMEX3) |

| Where | Mazar-i-Sharif | 36.7°N, 67.1°E |

| Why | growing insurgency against the government | — |

| How | with a powerful car bomb | — |

이 여섯 개의 답만으로도, 기사를 읽지 않고도 무슨 일이 일어났는지 파악할 수 있다. 이것이 5W1H 추출의 핵심 가치다.

What의 정밀도(0.57)가 Who(0.77)보다 낮은 이유는 두 가지다:

일부 기사는 시간이나 장소를 명시적으로 언급하지 않는다:

논문 저자들은 YAGO 지식그래프를 활용해 "Apple → Cupertino", "칸 영화제 → 5월"과 같은 암묵적 정보를 추론하는 방법을 향후 연구 과제로 제시했다.

"왜"와 "어떻게"는 본질적으로 추론(reasoning)을 요구하는 질문이다. 기사에서 "because"라고 명시하는 경우는 드물고, 여러 문단에 걸쳐 원인이 암시되는 경우가 대부분이다. 2019년 기준으로 이런 심층적 이해는 규칙 기반 NLP의 한계를 넘어서는 것이었다.

2019년에 Giveme5W1H가 구문 분석 트리와 규칙으로 고군분투했던 일을 2026년의 LLM은 자연스럽게 수행한다:

| 차원 | Giveme5W1H (2019) | LLM 기반 (2026) |

|---|---|---|

| Why 추출 | 접속사/동사 매칭 (0.28) | 문맥 추론 가능 |

| How 추출 | 접속 구문 + 부사 (0.42) | 의미 이해 기반 |

| 다국어 | 영어 전용 | 100+ 언어 |

| 추론 속도 | CoreNLP 기반 빠른 처리 | API 호출 비용 |

| 정규화 | TIMEX3, 좌표, YAGO | 별도 구현 필요 |

| 해석 가능성 | 규칙이 명확히 정의됨 | 블랙박스 |

2026년의 최신 트렌드는 규칙 기반 + LLM 하이브리드다:

1차로 규칙 기반 시스템이 빠르고 저렴하게 처리하고, 신뢰도가 낮은 결과(특히 Why, How)만 LLM에 넘겨 정제하는 방식이다. 비용은 90% 절약하면서 품질은 최대화하는 전략이다.

Google News, Naver News, Apple News 등은 5W1H 추출을 통해:

Giveme5W1H의 원래 동기였던 미디어 편향 분석:

5W1H 추출 결과는 자연스럽게 이벤트 지식 그래프의 노드와 엣지가 된다:

이런 구조화된 이벤트 데이터는 EventRAG, GraphRAG 등 최신 검색 증강 생성(RAG) 시스템의 핵심 자원이 된다.

실시간 뉴스에서 재난 이벤트를 자동 추출하여:

논문의 평가에서 핵심적으로 사용된 Word Mover's Distance(WMD)는 그 자체로 흥미로운 기법이다.

두 문장의 의미적 거리를 측정하고 싶다고 하자:

단어 수준에서 보면 완전히 다른 문장이지만, 의미는 거의 같다. WMD는 Word2Vec 같은 단어 임베딩 공간에서, 한 문장의 단어들을 다른 문장의 단어들로 "이동"시키는 최소 비용을 계산한다.

WMD = 0.15 + 0.12 + 0.08 = 0.35 (의미적으로 가까움)

이 기법을 사용해, Giveme5W1H가 추출한 문구와 사람이 어노테이션한 정답 문구 사이의 의미적 거리를 오차로 사용한 것이다.

2,000년 전 로마의 수사학에서 시작된 육하원칙(5W1H)이, 2019년에는 컴퓨터 과학의 정보 추출 문제로 재탄생했고, 2026년에는 LLM의 구조화된 출력 프레임워크로 진화하고 있다.

Giveme5W1H 논문의 가장 큰 기여는 단순히 높은 성능의 시스템을 만든 것이 아니다. 그것은:

뉴스를 읽는 것은 인간에게 너무나 자연스러운 일이지만, 기계에게 "누가 무엇을 왜 했는지"를 이해시키는 것은 자연어 처리의 핵심 도전 중 하나다. Giveme5W1H는 그 도전에 대한 체계적이고 실용적인 첫 번째 답이었다.

그리고 이제, 이 프레임워크 위에 LLM이라는 강력한 엔진이 올라탄 2026년, "기계가 뉴스를 이해한다"는 말은 더 이상 은유가 아닌 현실이 되어가고 있다.

참고 문헌