Flow Matching 완전정복: 확산 모델 이후의 생성 AI 패러다임

DALL-E, Midjourney를 만든 확산 모델은 왜 느렸나? Meta AI의 Flow Matching은 '구불구불한 길' 대신 '직선 경로'로 노이즈를 이미지로 바꾼다. FLUX, SD3, Movie Gen, Voicebox — 2026년 최강 생성 모델들의 공통 비밀을 해부한다.

DALL-E, Midjourney를 만든 확산 모델은 왜 느렸나? Meta AI의 Flow Matching은 '구불구불한 길' 대신 '직선 경로'로 노이즈를 이미지로 바꾼다. FLUX, SD3, Movie Gen, Voicebox — 2026년 최강 생성 모델들의 공통 비밀을 해부한다.

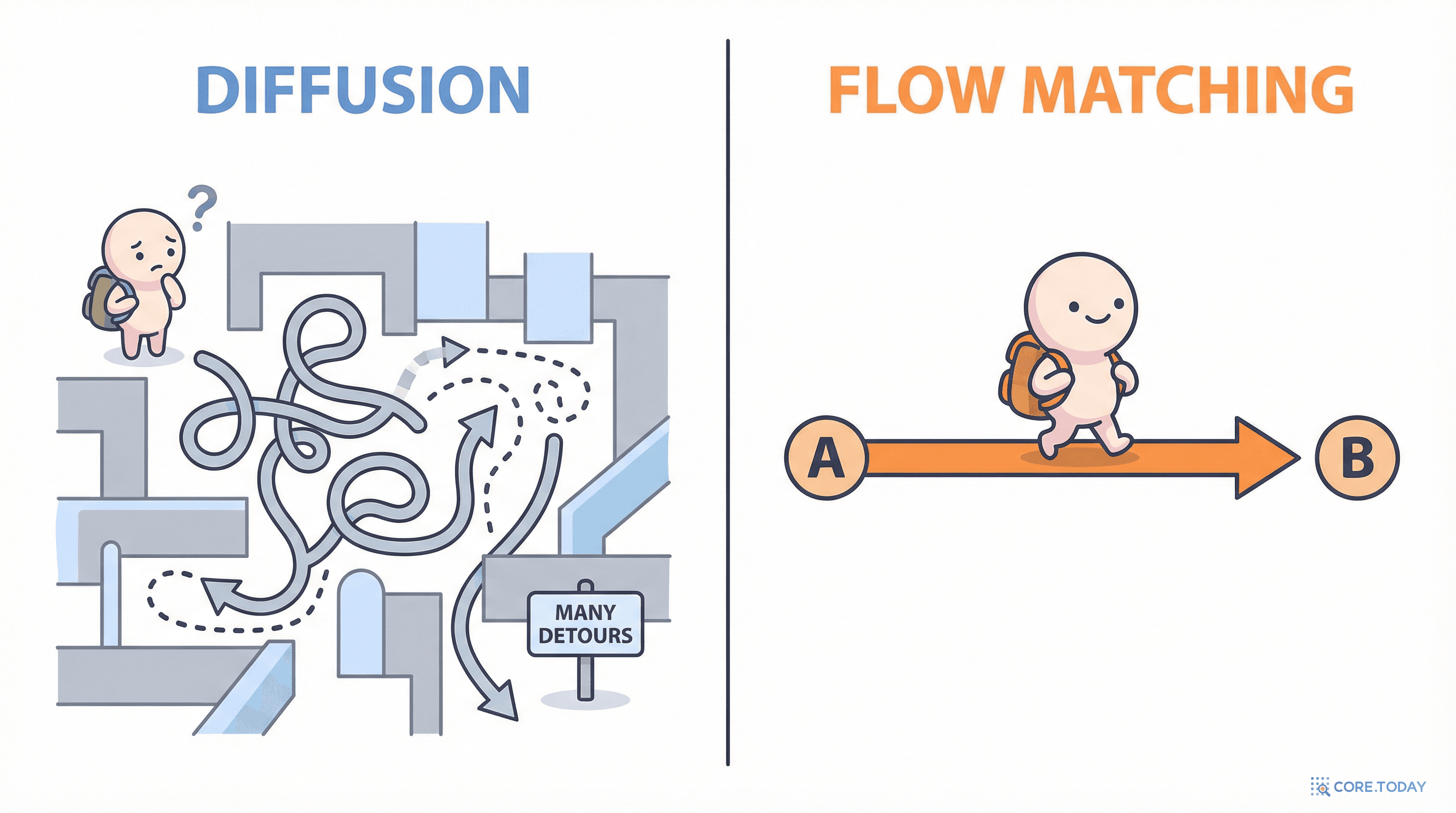

2022년, Stable Diffusion이 세상을 바꿨다. 텍스트 한 줄로 그림을 만들어내는 마법. 하지만 사용해 본 사람이라면 알 것이다 — 느리다. 고해상도 이미지 한 장에 20~50 스텝, 고급 GPU에서도 수십 초. 왜?

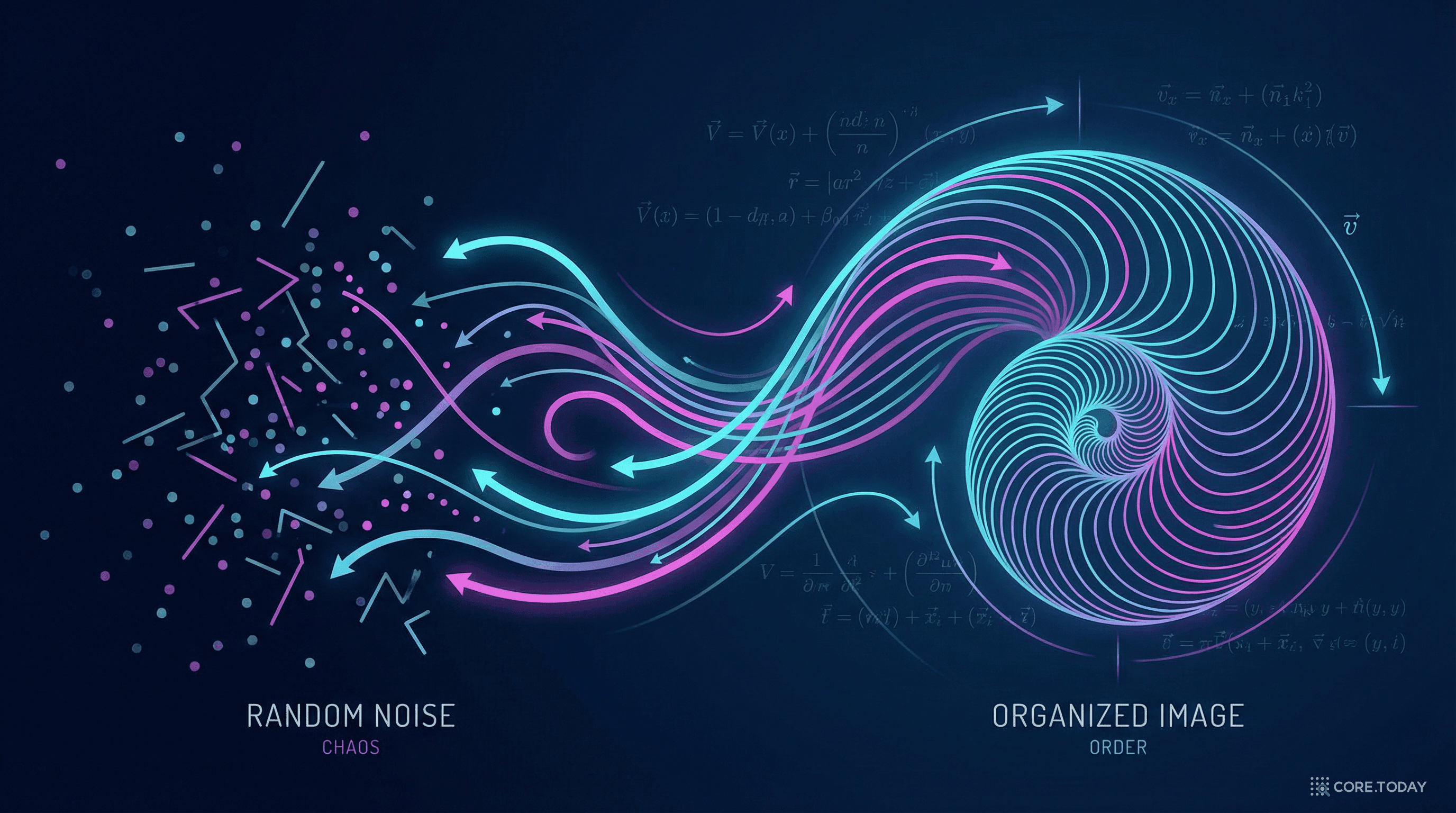

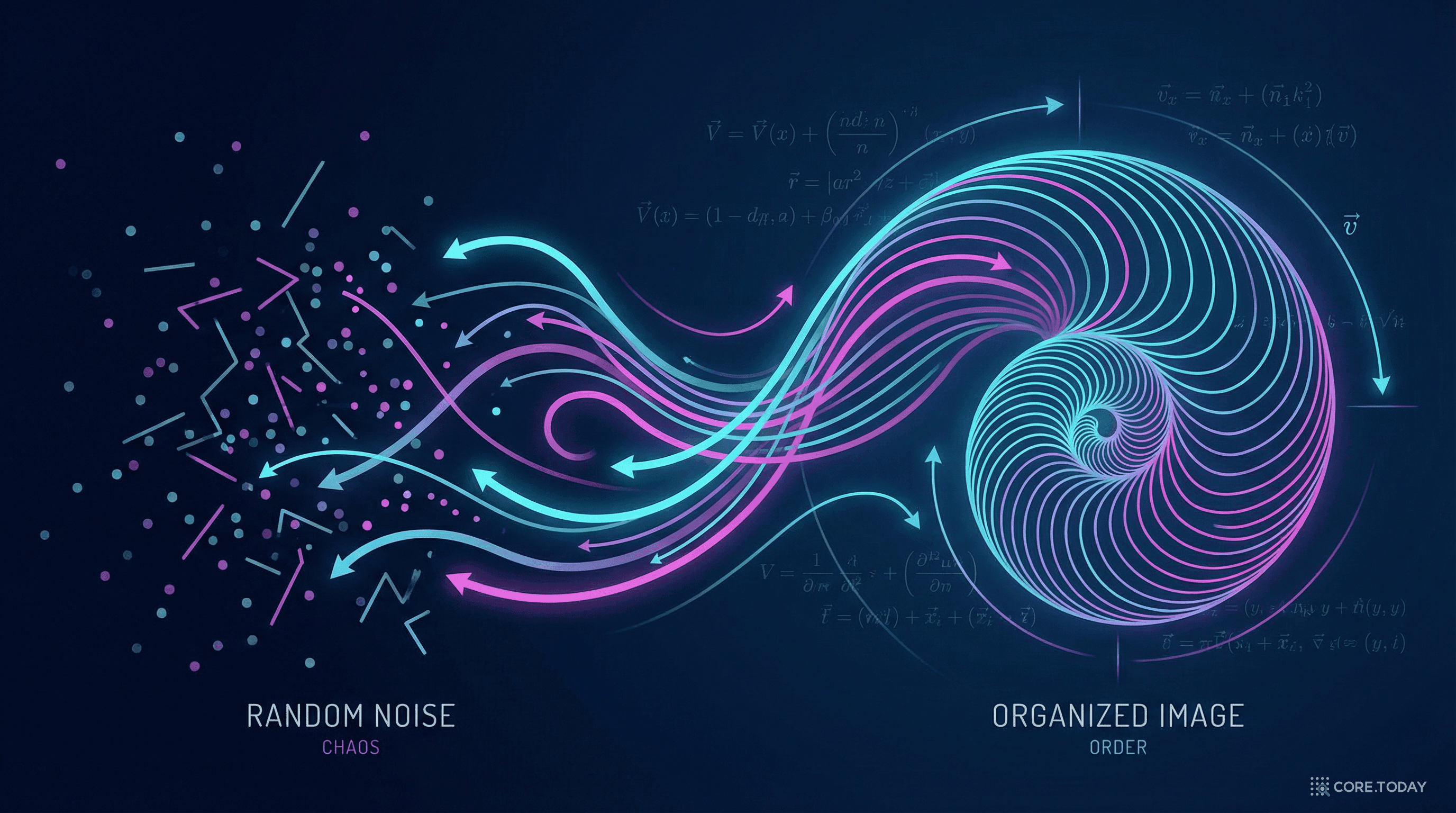

답은 그 이름에 있다. 확산(Diffusion). 확산 모델은 이미지를 만들 때, 마치 향수가 방 안에 퍼지듯 노이즈를 점진적으로 제거한다. 향수가 퍼지는 과정이 구불구불하고 비효율적이듯, 확산 모델의 경로도 그렇다. 노이즈 제거의 대부분이 마지막 몇 스텝에 몰려 있고, 나머지 스텝은 거의 아무 일도 하지 않는다.

만약 노이즈에서 이미지로 가는 직선 경로가 있다면? 구불구불 돌아갈 필요 없이, 최단 거리로 한 번에 도달할 수 있다면?

이것이 Flow Matching의 핵심 아이디어다.

2022년 말, 세 그룹의 연구자들이 거의 동시에 같은 통찰에 도달했다:

그로부터 3년, 2026년 현재 — FLUX, Stable Diffusion 3, Meta Movie Gen, Voicebox, HunyuanVideo, Wan 2.1 — 세계 최강의 생성 모델들은 모두 Flow Matching을 사용한다.

이 글에서는 Flow Matching이 왜 필요했고, 어떻게 작동하며, 왜 확산 모델을 대체하고 있는지를 처음부터 끝까지 설명한다.

생성 모델의 역사를 4세대로 나눌 수 있다:

1세대: VAE (2013). Kingma & Welling의 변분 오토인코더. 데이터를 잠재 공간(latent space)으로 압축하고 복원한다. 안정적이지만 출력이 흐릿하다.

2세대: GAN (2014). Goodfellow의 적대적 생성 신경망. 생성자와 판별자가 경쟁하며 학습. 선명한 이미지를 만들지만 학습이 극도로 불안정하고, 모드 붕괴(mode collapse)가 빈번.

3세대: 확산 모델 (2020). Ho 등의 DDPM. 이미지에 점진적으로 노이즈를 추가하는 과정을 학습하고, 역으로 노이즈를 제거하여 이미지를 생성. GAN보다 안정적이고 다양하지만, 느리다 (수십~수백 스텝).

4세대: Flow Matching (2022~). 노이즈와 이미지 사이의 직선 경로를 학습하여, 적은 스텝으로 고품질 생성. 확산 모델을 일반화하고 개선한 프레임워크.

Flow Matching을 이해하려면 2018년으로 돌아가야 한다. NeurIPS 2018 최우수 논문, Ricky Chen 등의 "Neural Ordinary Differential Equations."

핵심 아이디어: 데이터의 변환을 연속적인 미분방정식(ODE)으로 표현하자. 이산적 레이어(layer 1, layer 2, ...)가 아니라, 시간에 따라 연속적으로 변하는 흐름(flow)으로.

이론적으로 아름다웠지만, 치명적 문제가 있었다 — 학습하려면 ODE를 매번 시뮬레이션해야 했다. 시뮬레이션 기반(simulation-based) 학습은 느리고, 불안정하고, 메모리를 잡아먹었다. 아이디어는 옳았지만, 실용화가 불가능했다.

Flow Matching은 이 문제를 4년 후에 우아하게 해결한 것이다.

확산 모델의 역방향 경로를 시각화하면, 대부분의 스텝에서 거의 변화가 없다. 노이즈 제거가 마지막 몇 스텝에 집중된다. 앞의 수십 스텝은 "고민만 하고 움직이지 않는" 시간이다.

비유하자면:

서울에서 부산까지 가는데, 확산 모델은 고속도로를 타지 않고 전국의 국도를 돌아다닌다. 마지막에야 "아, 부산이 저기구나" 하고 방향을 잡는다. 20~50번의 방향 전환(스텝)이 필요하다.

Flow Matching은 서울에서 부산까지 직선 고속도로를 탄다. 1~4번의 방향 확인만으로 도착한다.

| 관점 | 확산 모델 (DDPM) | Flow Matching |

|---|---|---|

| 수학적 도구 | SDE (확률적 미분방정식) | ODE (상미분방정식) |

| 예측 대상 | 노이즈 (-prediction) | 속도장 (velocity field) |

| 경로 형태 | 곡선 (마지막에 급변) | 직선 (선형 보간) |

| 필요 스텝 수 | 20~1000 | 1 |

| 이론적 기반 | 스코어 매칭, 랑주뱅 동역학 | 연속 방정식, 최적 수송 이론 |

| 일반성 | 특정 노이즈 스케줄에 종속 | 확산 경로를 특수한 경우로 포함 |

마지막 행이 결정적이다 — 확산 모델은 Flow Matching의 특수한 경우다. Flow Matching은 확산을 포함하면서, 그보다 더 효율적인 경로(직선 경로)를 사용할 수 있는 일반적 프레임워크다.

Flow Matching의 핵심을 한 문장으로:

시간 의 노이즈에서 시간 의 이미지까지, 각 시점에서 데이터가 어느 방향으로 얼마나 빠르게 움직여야 하는지(속도장, velocity field)를 학습한다.

Meta의 "Flow Matching Guide and Code" (2024)에 따르면, Flow Matching은 정확히 두 단계로 작동한다:

Step 1: 확률 경로(Probability Path) 설계. 소스 분포(가우시안 노이즈, )에서 타겟 분포(실제 데이터, )로 가는 연속적인 확률 경로 를 정의한다.

가장 단순한 선택: 선형 보간. 여기서 은 노이즈, 은 데이터 샘플.

Step 2: 속도장 학습. 신경망 를 학습하여, 각 시점 에서 데이터 가 어느 방향으로 이동해야 하는지 예측한다.

손실 함수는 놀랍도록 단순하다:

"현재 위치에서의 예측 속도"와 "실제 속도(= 데이터 - 노이즈)"의 차이를 최소화하라. 이것이 전부다.

이론적으로 "모든 데이터 포인트에 대한 평균 속도장"을 직접 계산하는 것은 불가능하다 (비다루기, intractable). 하지만 조건부 Flow Matching(CFM)이 이 문제를 해결한다.

핵심 정리: 개별 데이터 포인트에 조건화된 속도장(conditional vector field)을 학습하는 것은, 전체 속도장(marginal vector field)을 학습하는 것과 수학적으로 동일한 그래디언트를 준다.

따라서 학습 시에는 데이터 포인트 하나, 노이즈 하나를 뽑아서 선형 보간하고, 그 속도를 예측하기만 하면 된다. 확산 모델의 -prediction과 비슷한 수준의 단순함이지만, 더 효율적인 경로를 학습한다.

Flow Matching이 직선 경로를 사용하는 것은 우연이 아니다. 수학적으로 이것은 최적 수송 이론과 연결된다.

1780년대, 프랑스 수학자 가스파르 몽주(Gaspard Monge)는 이런 문제를 제시했다: "흙더미를 구덩이에 옮길 때, 가장 적은 비용으로 옮기는 방법은?" 이것이 최적 수송 문제다.

2000년대, Benamou와 Brenier는 이 문제의 동적 형식화를 제시했다: 확률 분포를 연속적으로 이동시킬 때, 운동 에너지를 최소화하는 경로는 무엇인가? 답은 직선(측지선, geodesic)이다.

Flow Matching의 직선 보간 은 정확히 이 최적 수송의 해에 해당한다. 노이즈와 데이터 사이의 가장 에너지 효율적인 경로다.

FLUX.1은 Black Forest Labs가 2024년 8월 출시한 120억 파라미터 이미지 생성 모델이다. 개발팀은 Stable Diffusion의 원 저자들(Robin Rombach, Andreas Blattmann, Patrick Esser)이 독립하여 설립한 회사다.

FLUX.1의 핵심 아키텍처는 Rectified Flow Transformer — Flow Matching의 직선 경로와 트랜스포머를 결합한 것이다.

세 가지 변형:

FLUX.1은 Midjourney, DALL-E 3, Stable Diffusion 3, SDXL을 모두 능가하는 성능을 보인다.

2024년 3월, Stability AI의 Esser 등이 발표한 SD3 논문 "Scaling Rectified Flow Transformers for High-Resolution Image Synthesis"(ICML 2024)는 Flow Matching을 대중에게 알린 결정적 논문이다.

핵심 기여:

2024년 10월, Meta가 공개한 Movie Gen은 300억 파라미터의 Flow Matching 기반 비디오 생성 모델이다.

2023년 6월 발표된 Voicebox는 Flow Matching의 첫 대규모 음성 적용 사례다 (NeurIPS 2023).

텐센트 HunyuanVideo (2024~2025): 130억 파라미터, Flow Matching 기반 최대 오픈소스 비디오 생성 모델. 15억 비디오 + 100억 이미지로 학습.

알리바바 Wan 2.1 (2025년 2월): 140억 파라미터 Flow Matching 모델. VBench 리더보드 1위 (86.22%) — OpenAI Sora (84.28%), Luma (83.61%)를 능가.

Flow Matching은 연속 데이터(이미지, 오디오)에서 시작했지만, 2024년 Meta의 Discrete Flow Matching (NeurIPS 2024 Spotlight)이 이산 데이터(텍스트, 코드)까지 확장했다.

17억 파라미터로 스케일하여, 비자기회귀 텍스트 생성에서 최고 성능을 달성했다. 자기회귀 모델(GPT 스타일)과 달리, 모든 토큰을 동시에 생성할 수 있어 이론적으로 훨씬 빠르다.

Nature npj AI (2025)에 발표된 서베이 "Flow Matching meets Biology"에 따르면, Flow Matching은 생명과학에서 폭발적으로 확산 중이다.

단백질 접힘(folding) 이후의 다음 큰 도전 — 단백질 설계(design) — 에서 Flow Matching이 핵심 도구로 자리잡고 있다.

확산 모델은 길을 모르는 택시 기사다. 일단 출발해서, 매 교차로마다 "여기가 맞나?" 확인하며 돌아다닌다. 50번의 교차로를 지나서야 목적지에 도착한다.

Flow Matching은 네비게이션이 있는 택시 기사다. 출발지에서 목적지까지의 최적 경로를 알고 있어, 직선으로 달린다. 4번의 방향 확인이면 충분하다.

확산 모델은 대리석 블록에서 망치와 정으로 먼지를 조금씩 떨어뜨린다. 형태가 서서히 드러나는데, 마지막 단계에서야 세부 디테일이 나타난다.

Flow Matching은 대리석 블록의 모든 지점이 최종 형태의 해당 위치로 직접 이동한다. 불필요한 중간 형태 없이, 노이즈가 이미지의 올바른 위치로 직행한다.

확산 모델은 문제를 풀 때 무작위로 답을 쓰고, 지우고, 다시 쓰는 과정을 반복한다. 결국 맞는 답에 도달하지만 시간이 오래 걸린다.

Flow Matching은 풀이 과정을 알고 있어서, 첫 줄부터 마지막 줄까지 한 번에 쓴다.

Flow Matching은 2018년 Neural ODE에서 제안된 연속 정규화 흐름(CNF)의 후속 발전이다. CNF의 핵심 문제 — 학습 시 ODE 시뮬레이션 필요 — 를 Flow Matching이 시뮬레이션 없는(simulation-free) 학습으로 해결했다.

비교:

Rectified Flow (Liu et al., 2022)는 Flow Matching에 정류(rectification) 절차를 추가한다:

완벽한 직선은 이산화 오차가 0이므로, 단 1회의 오일러 스텝으로 정확한 생성이 가능하다. FLUX.1 [schnell]이 1~4 스텝으로 고품질 이미지를 생성할 수 있는 이유다.

Albergo, Boffi, Vanden-Eijnden (2023)의 확률적 보간법(Stochastic Interpolants)은 Flow Matching과 확산 모델을 하나의 프레임워크로 통합한다.

핵심 통찰: 동일한 보간법에서 출발하되, 확산 계수(diffusion coefficient)를 조절할 수 있다:

이것은 Flow Matching과 확산이 연속적인 스펙트럼의 양 끝점임을 보여준다. 설계자는 문제에 따라 최적의 지점을 선택할 수 있다.

Meta AI(FAIR)는 Flow Matching의 산파이자 최대 기여자다:

flow_matching PyTorch 라이브러리: 연속/이산 FM 구현 및 예제 (github.com/facebookresearch/flow_matching)수학자 몽주가 1780년대에 물었다: "흙을 옮기는 가장 효율적인 경로는?" 답은 직선이었다.

240년 뒤, AI 연구자들이 물었다: "노이즈를 이미지로 바꾸는 가장 효율적인 경로는?" 답은 역시 직선이었다.

확산 모델은 "어떤 경로든 결국 목적지에 도달한다"는 것을 보여주었다. Flow Matching은 "최적의 경로가 존재하고, 그것을 직접 학습할 수 있다"는 것을 보여주었다. 그 차이가 50 스텝과 4 스텝의 차이, 수십 초와 수 초의 차이, 그리고 2022년과 2026년의 차이를 만들었다.

FLUX가 1초에 이미지를 그리고, Movie Gen이 16초 비디오를 만들고, Voicebox가 20배 빠르게 말하고, Wan 2.1이 VBench 1위를 차지한 것 — 이 모든 것의 수학적 기반에는 "직선이 가장 빠르다"는 단순하고도 깊은 통찰이 있다.

때로는 가장 단순한 답이 가장 강력하다.

참고 문헌